仮想インフラストラクチャ マネージャ

UI パス: [仮想管理(Virtual Management)] > [仮想インフラストラクチャ マネージャ(Virtual Infrastructure Manager)]

(注) |

Cisco Nexus Dashboard ファブリックコントローラの仮想マシンのネットワーク可視化機能が有効になっていることを確認します。 |

-

[設定(Settings)] > [機能管理(Feature Management)] を選択し、次のチェックボックスをオンにします。

-

Kubernetes ビジュアライザ

-

VMM ビジュアライザ

-

OpenStack ビジュアライザ

-

-

[Apply] をクリックします。

次の表では、[仮想インフラストラクチャ マネージャ(Virtual Infrastructure Manager)] ウィンドウに表示されるフィールドについて説明します。

|

フィールド |

説明 |

|---|---|

|

[サーバ(Server)] |

サーバー IP アドレスを指定します。 |

|

タイプ |

次のいずれかのインスタンスのタイプを指定します。

|

|

管理対象(Managed) |

管理対象または管理対象外のクラスタのステータスを指定します。 |

|

ステータス |

追加されたクラスタの状態を指定します。 |

|

ユーザー(User) |

クラスタを作成したユーザーを指定します。 |

|

最終更新時刻 |

クラスタの最終更新時刻を指定します。 |

(注) |

[更新(Refresh)] アイコンをクリックして、仮想インフラストラクチャ マネージャ テーブルを更新します。 |

次の表では、[アクション(Actions)] メニューのドロップダウン リストで、[仮想インフラストラクチャ マネージャ(Virtual Infrastracture Manager)] に表示されるアクション項目について説明します。

|

アクション項目 |

説明 |

||

|---|---|---|---|

|

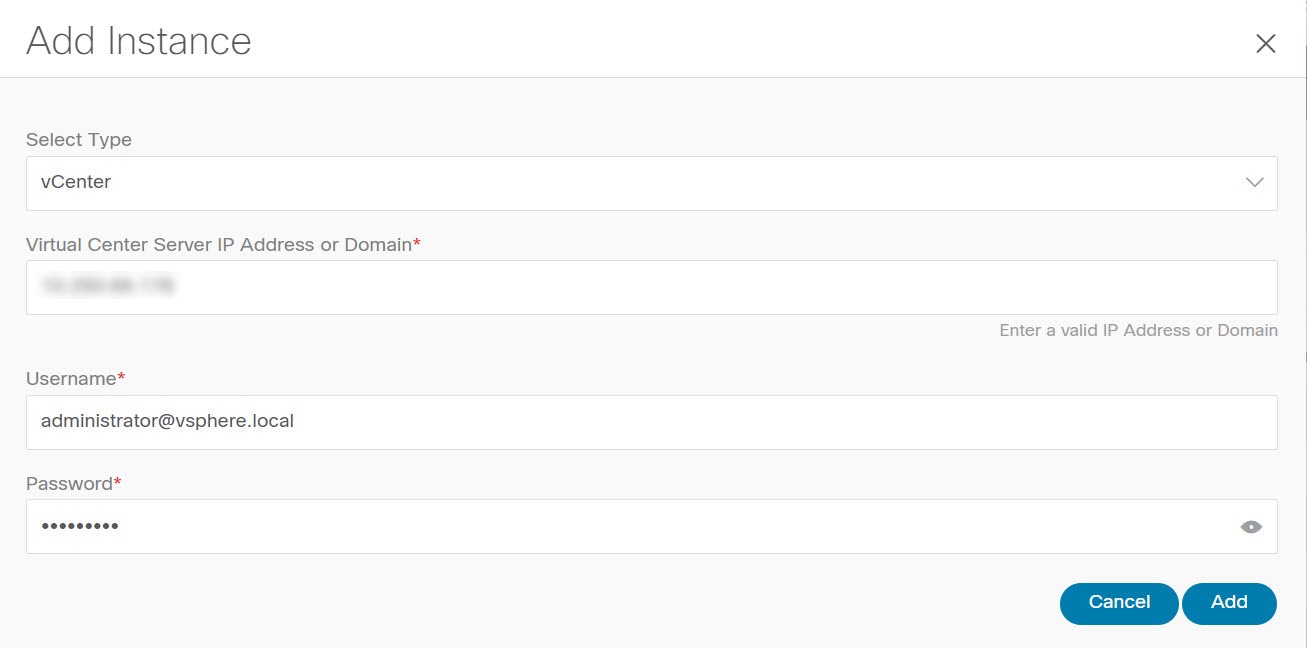

インスタンスの追加 |

[アクション(Actions)] ドロップダウンリストから [インスタンスの追加(Add Instance)] を選択します。詳細については、「インスタンスの追加」を参照してください。

|

||

|

インスタンスの編集 |

編集するインスタンスを選択します。[アクション(Actions)] ドロップダウンリストから [インスタンスの編集(Edit Instance)] を選択します。必要な変更を行って、[保存(Save)] をクリックします。[キャンセル(Cancel)] をクリックして、変更を破棄します。 | ||

|

インスタンスの削除 |

削除する 1 つ以上の必要なインスタンスを選択します。[アクション(Actions)] ドロップダウンリストから、[削除(Delete)] を選択します。[確認(Confirm)] をクリックしてインスタンスを削除します。[キャンセル(Cancel)] をクリックしてこの削除を破棄します。 |

||

|

インスタンスの再検出 |

再検出する 1 つ以上の必要なインスタンスを選択します。[アクション(Actions)] ドロップダウンリストから、[インスタンスの再検出(Rediscover Instance(s))] を選択します。確認メッセージが表示されます。 |

詳細については、次を参照してください。

Cisco UCS B シリーズ ブレードサーバーのサポート

NDFC は、ファブリックインターコネクトの背後にある UCS タイプ B (シャーシ UCS)で実行されているホストをサポートします。この機能を使用するには、Cisco UCSM で vNIC の CDP を有効にする必要があります。

(注) |

デフォルトでは、CDP は Cisco UCSM で無効になっています。 |

参考のために、VMM-A と VMM-B の 2 つの VMM について考えてみましょう。Cisco UCS UCS B シリーズ ブレードサーバーの検出後、トポロジに青色の VMM-A と VMM-B がファブリック インターコネクト ノードであることが表示されます。トポロジの例を下図に示します。

UCSM で CDP を有効にするには、次の手順を使用して新しいネットワーク制御ポリシーを作成する必要があります。

-

USCM で、[LAN] を選択し、ポリシーを展開します。

-

[ネットワーク制御ポリシー(Network Control Policies)] を右クリックして、新しいポリシーを作成します。

-

[名前(Name)] フィールド、にポリシーの名前を EnableCDP と入力します。

-

CDP の有効なオプションを選択します。

-

[OK] をクリックしてポリシーを作成します。

新しいポリシーを ESX NIC に適用するには、次の手順を実行します。

-

更新された vNIC テンプレートを使用している場合は、ESXi vNIC の各 vNIC テンプレートを選択し、[ネットワーク制御ポリシー] ドロップダウンリストから EnableCDP ポリシーを適用します。

-

vNIC テンプレートを使用していない場合は、更新されたサービス プロファイル テンプレートを使用します。各サービス プロファイル テンプレートに EnableCDP ポリシーを適用します。

-

1 回限りのサービスプロファイルを使用している場合(つまり、各サーバーが独自のサービス プロファイルを使用している場合)、すべてのサービスプロファイルに移動し、すべての vNIC で EnableCDP ポリシーを有効にする必要があります。

Cisco UCSM の詳細については、『Cisco UCSM ネットワーク管理ガイド』を参照してください。

ルート IP アドレスの設定

IP アドレスを vCenter に追加する前に、Cisco Nexus ダッシュボードで同じ IP アドレスを設定する必要があります。

Cisco Nexus ダッシュボードでルートを設定するには、次の手順を実行します。

手順

| ステップ 1 |

[インフラストラクチャ(Infrastructure)] > [クラスタ設定(Cluster Configuration)] を選択します。 |

| ステップ 2 |

[全般(General)] タブの [ルート(Routes)] カードで、[編集(Edit)] アイコンをクリックします。 [ルート(Routes)] ウィンドウが表示されます。 |

| ステップ 3 |

IP アドレスを設定するには、[管理ネットワーク ルートの追加(Add Management Network Routes)] をクリックし、必要な IP アドレスを入力して、[チェック(check)] アイコンをクリックします。 |

| ステップ 4 |

[保存(Save)] をクリックします。 ルート設定は、次の 2 つのシナリオによって管理されます。

|

フィードバック

フィードバック