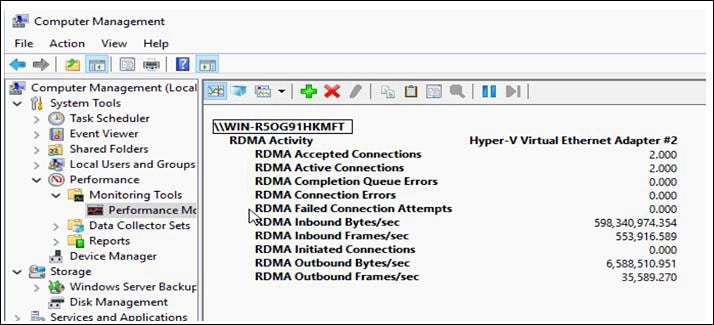

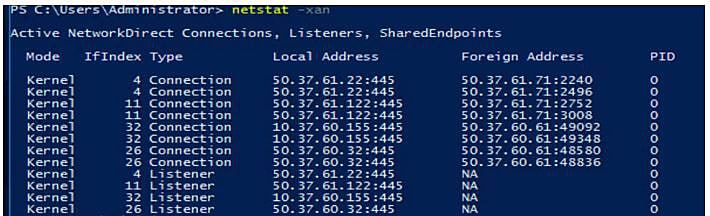

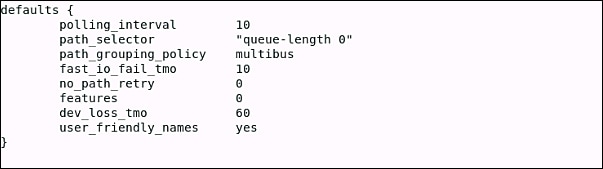

Cisco Intersight でのモード 1 の設定

Cisco Intersight で RoCE v2 モード 1 インターフェイスを構成するには、次の手順に従います。

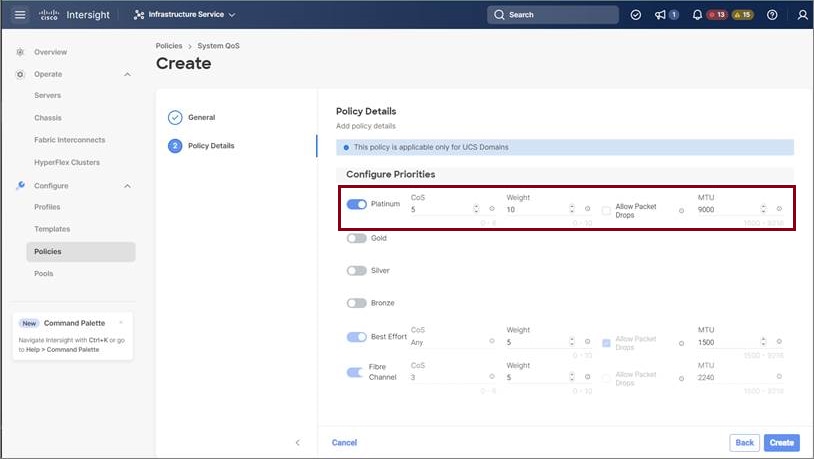

RDMA パケット ドロップの可能性を回避するには、ネットワーク全体で同じ非ドロップ COS が構成されていることを確認してください。次の手順に従えば、システム QoS ポリシーで非ドロップ クラスを構成して、RDMA でサポートされているインターフェイス用に使用できます。

Cisco UCS M8 C シリーズまたは X シリーズ サーバでは、 VIC 15000 シリーズがサポートされますが、Cisco UCS VIC 1400 シリーズ、14000 シリーズは M8 サーバと互換性がありません。

手順

|

ステップ 1 |

[構成(CONFIGURE)] > [ポリシー(Policies)] に移動します。[ポリシーの作成(Create Policy)] をクリックし、[UCS ドメイン(UCS Domain)] プラットフォーム タイプを選択し、[システム QoS(System QoS)] を検索または選択して、[Start(開始)] をクリックします。 |

||

|

ステップ 2 |

[全般(General)] ページでポリシー名を入力し、[次へ(Next)] をクリックします。 次に、[ポリシーの詳細(Policy Details)] ページで、次のようにシステム QoS ポリシーのプロパティ設定を構成します。

|

||

|

ステップ 3 |

[作成(Create)] をクリックします。 |

||

|

ステップ 4 |

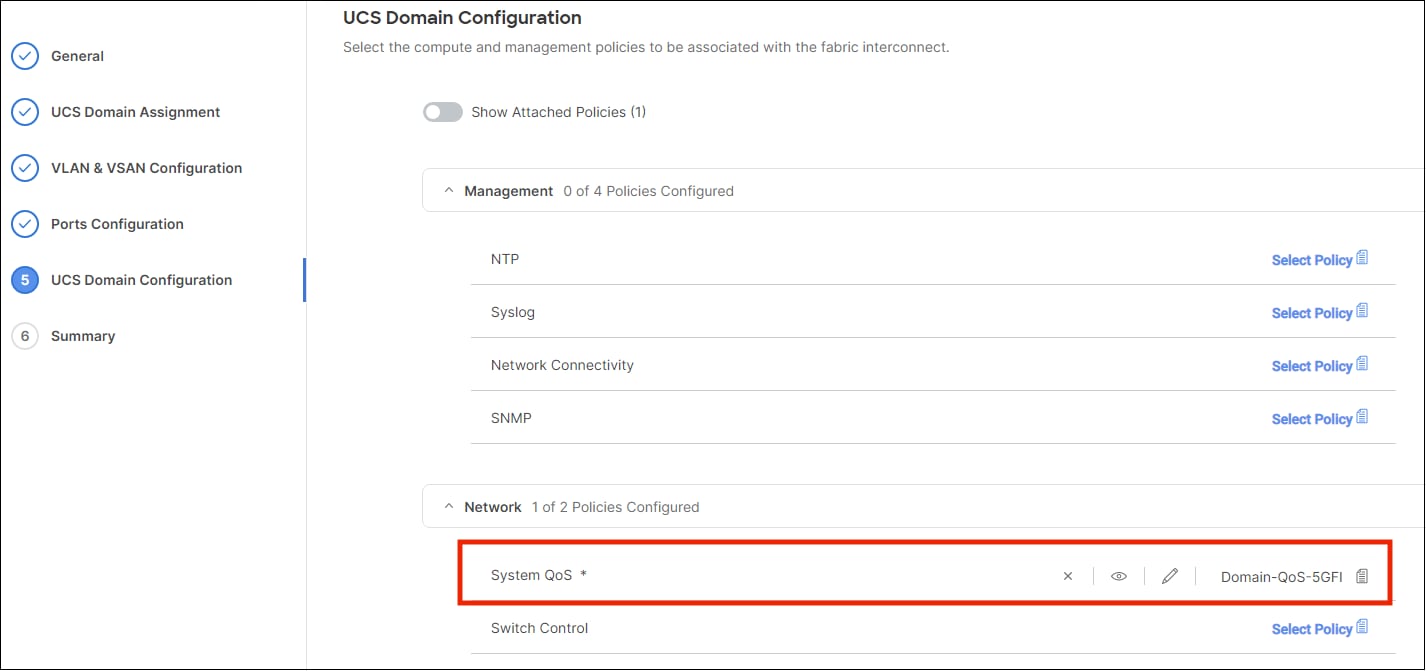

システムの QoS ポリシーをドメイン プロファイルに関連付け、 展開します。

|

システム QoS ポリシーが正常に作成され、ドメイン プロファイルに展開されます。

次のタスク

LAN 接続ポリシーで RoCE v2 vNIC 設定を使用してサーバ プロファイルを構成します。

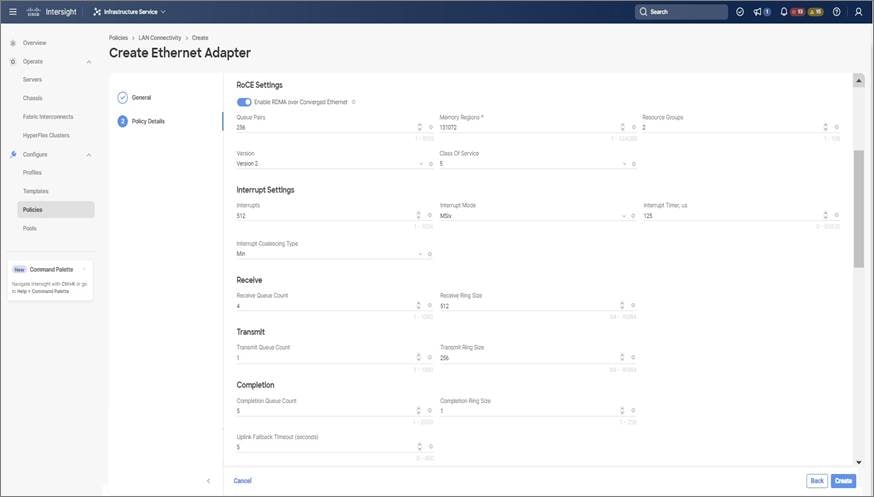

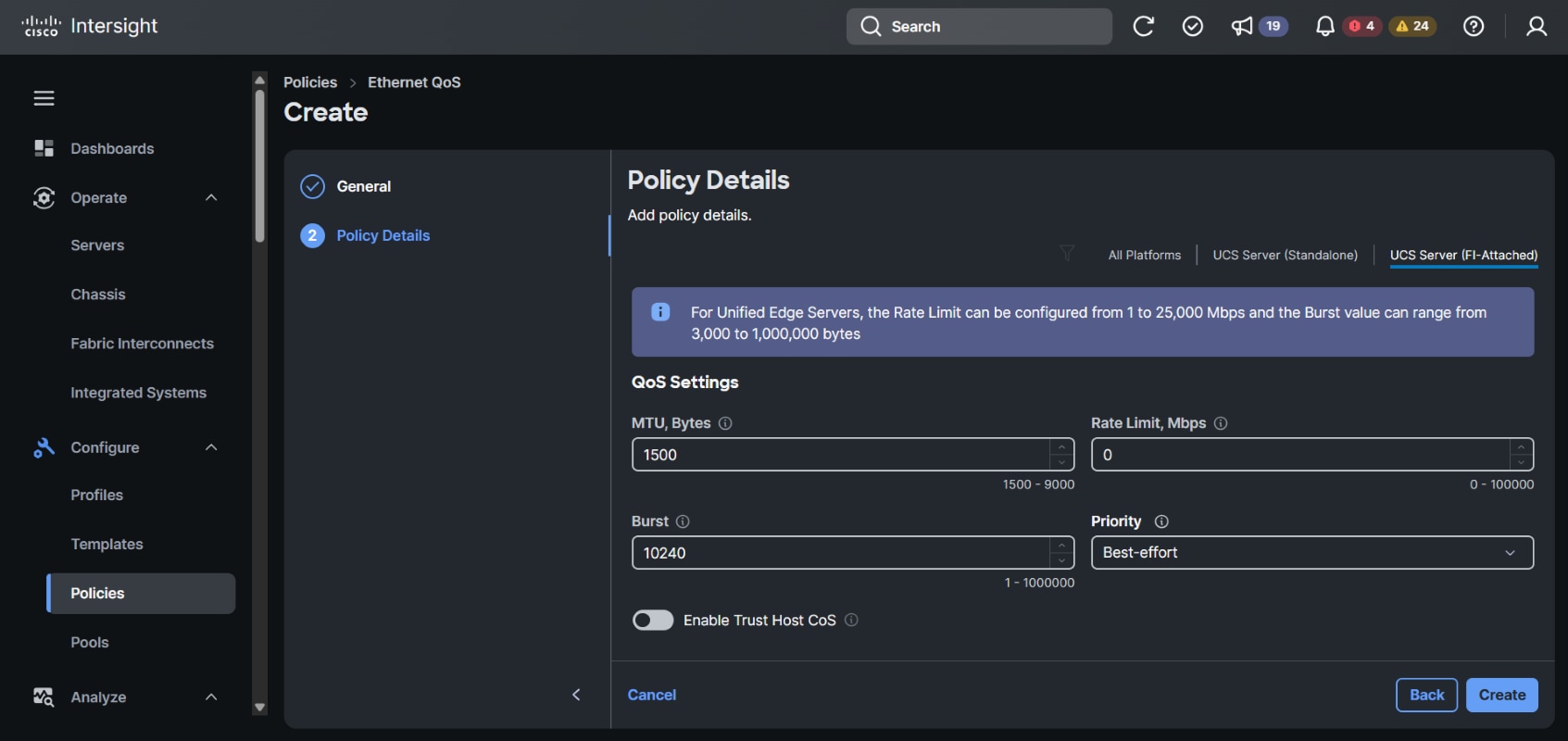

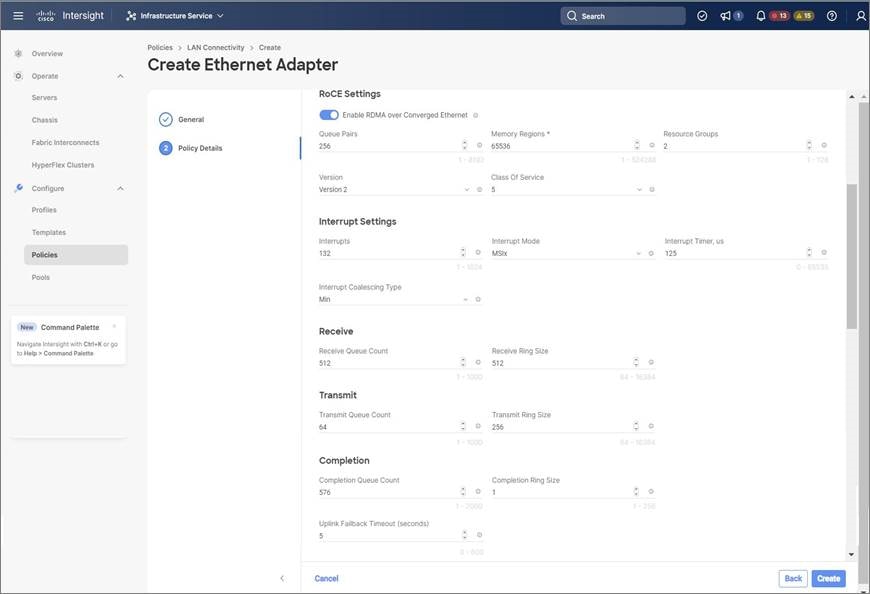

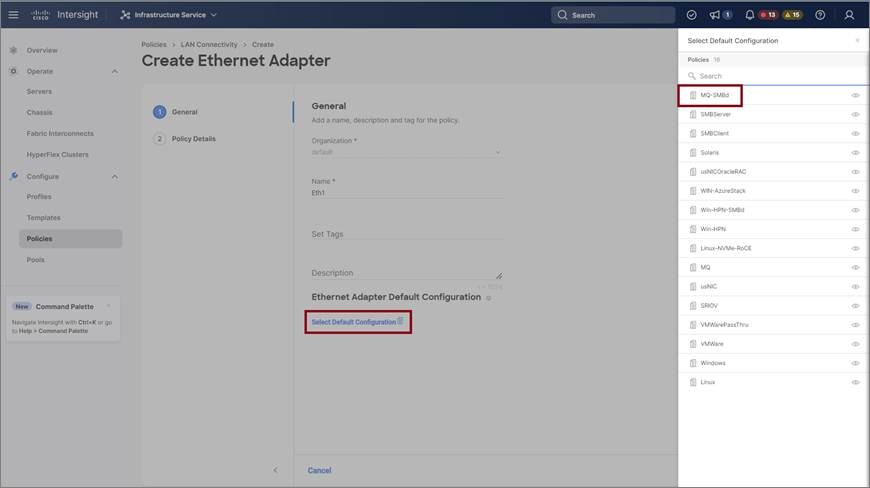

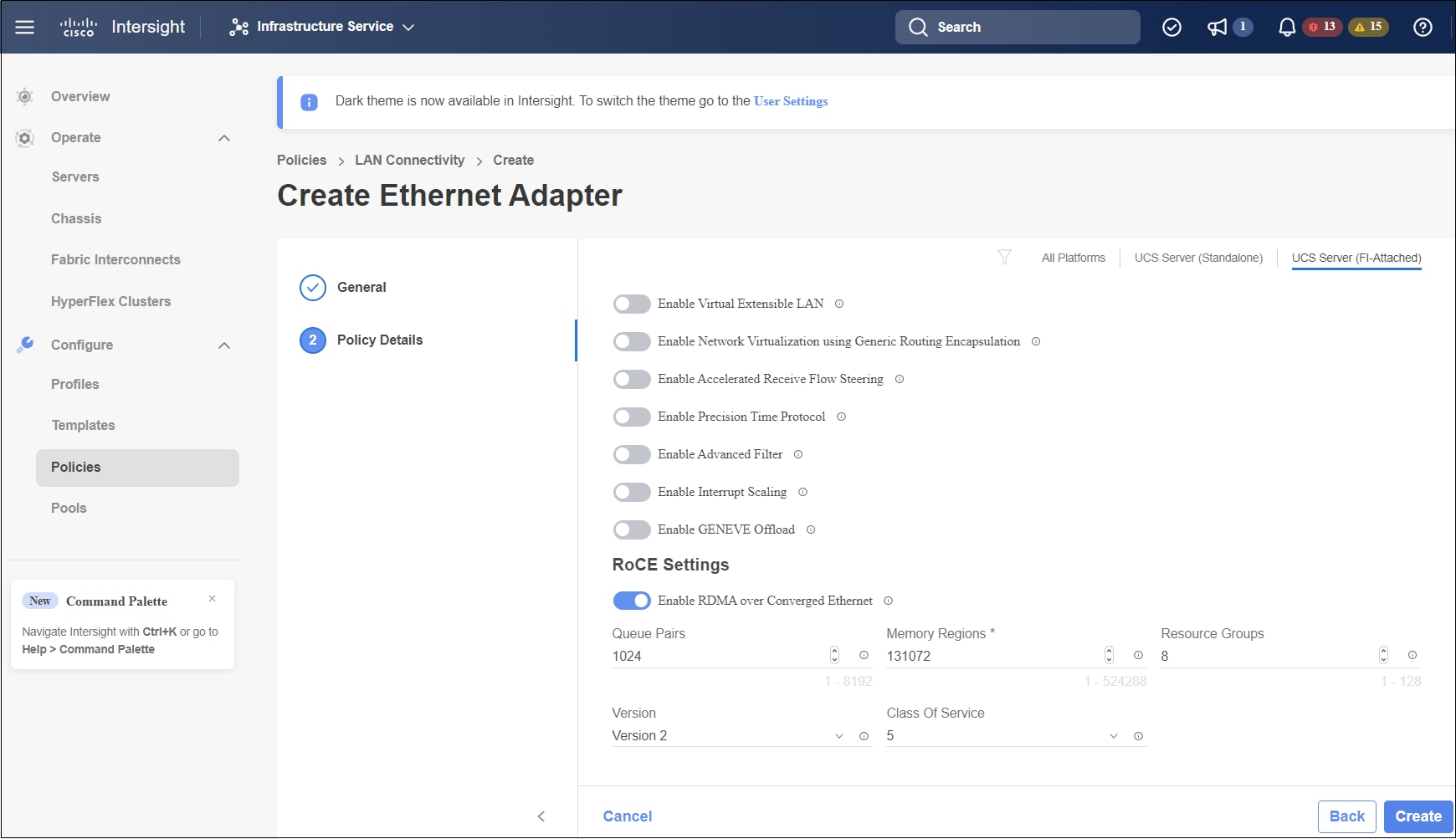

LAN 接続ポリシーで RoCE 設定を有効化する

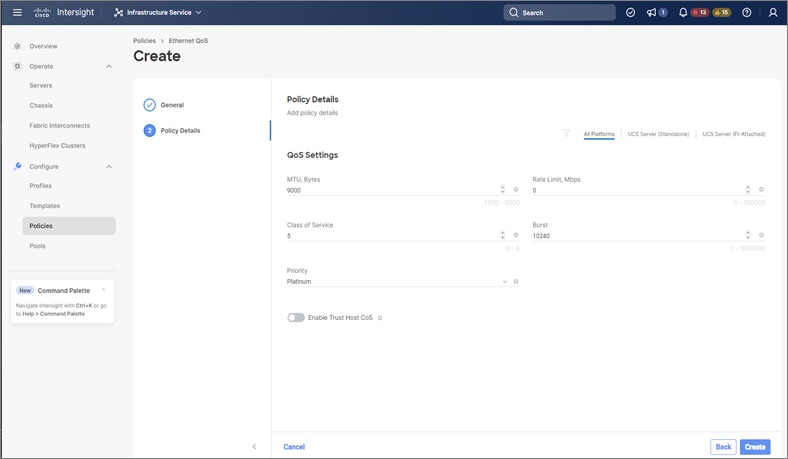

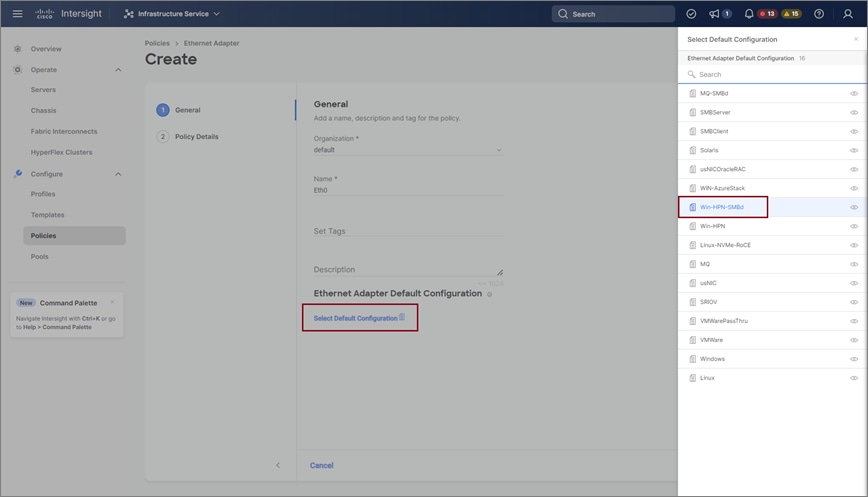

モード 1 で RoCE v2 vNIC を構成するには、次の手順を実行します。Cisco Intersight LAN 接続ポリシーでは、次のようにモード 1 構成のイーサネット QoS ポリシーとイーサネット アダプタ ポリシーの RoCE 設定を有効にできます。

手順

|

ステップ 1 |

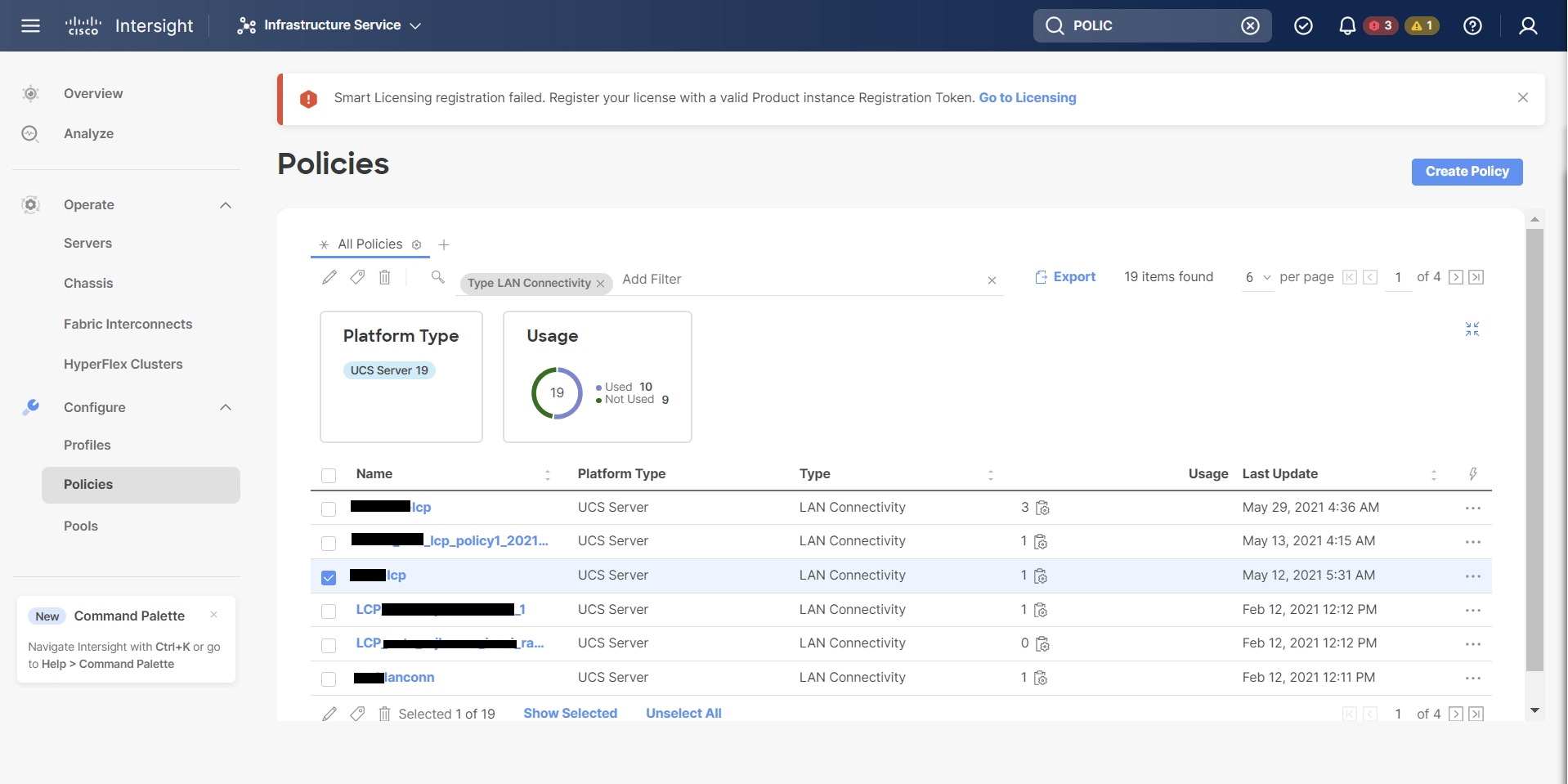

[構成(CONFIGURE)] > [ポリシー(Policies)] に移動します。[ポリシーの作成(Create Policy)] をクリックし、[UCS サーバ(UCS Server)] プラットフォーム タイプを選択し、[LAN 接続ポリシー(LAN Connectivity policy)] を検索または選択して、[Start(開始)] をクリックします。 |

||||||

|

ステップ 2 |

ポリシーの [全般(General)] ページで、ポリシー名を入力し、[ターゲット プラットフォーム(Target Platform)] として [UCS サーバ(スタンドアロン)(UCS Server(Standalone))] または [UCS サーバ(FI アタッチ)(UCS Server(FI-Attached)))] を選択し、[次へ(Next)] をクリックします。 |

||||||

|

ステップ 3 |

[ポリシーの詳細(Policy Details)] ページで、[vNIC の追加(Add vNIC)] をクリックして新しい vNIC を作成します。 |

||||||

|

ステップ 4 |

[vNIC の追加(Add vNIC)] ページで、構成パラメータに従って RoCE vNIC 設定を有効にします。

|

||||||

|

ステップ 5 |

[作成(Create)] をクリックし、RoCE v2 プロパティ設定によって LAN 接続ポリシーを完成させます。 |

||||||

|

ステップ 6 |

LAN 接続ポリシーをサーバ プロファイルに関連付け、展開します。

|

イーサネット QoS ポリシーとイーサネット アダプタ ポリシーの vNIC 設定を含む LAN 接続ポリシーが正常に作成され、RoCE v2 構成を有効にするためのサーバ プロファイルが展開されます。

次のタスク

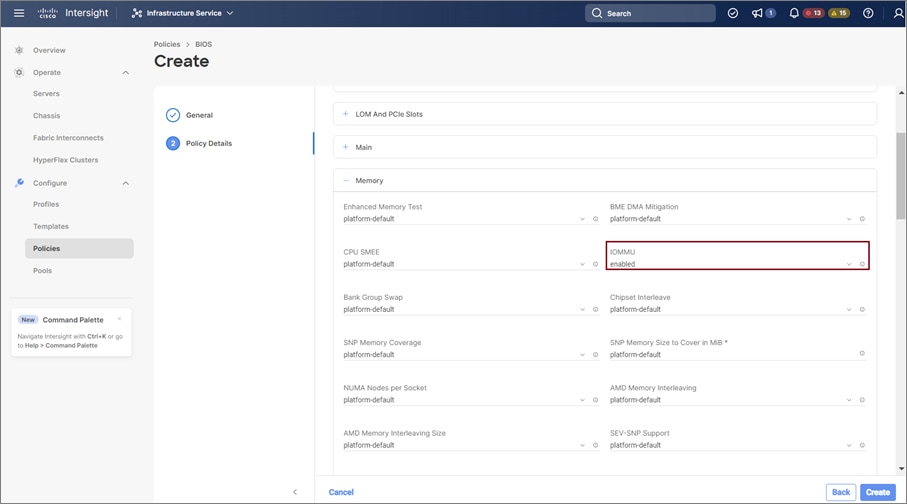

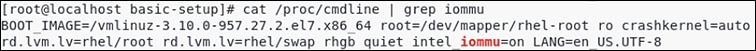

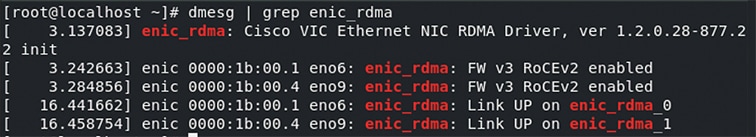

RoCE v2 のポリシー構成が完了したら、続いて、BIOS ポリシーで IOMMU を有効にします。

フィードバック

フィードバック