DCNM 11.2(1)によるEVPN VXLANマルチサイトの導入

ダウンロード オプション

偏向のない言語

この製品のドキュメントセットは、偏向のない言語を使用するように配慮されています。このドキュメントセットでの偏向のない言語とは、年齢、障害、性別、人種的アイデンティティ、民族的アイデンティティ、性的指向、社会経済的地位、およびインターセクショナリティに基づく差別を意味しない言語として定義されています。製品ソフトウェアのユーザインターフェイスにハードコードされている言語、RFP のドキュメントに基づいて使用されている言語、または参照されているサードパーティ製品で使用されている言語によりドキュメントに例外が存在する場合があります。シスコのインクルーシブ ランゲージの取り組みの詳細は、こちらをご覧ください。

翻訳について

シスコは世界中のユーザにそれぞれの言語でサポート コンテンツを提供するために、機械と人による翻訳を組み合わせて、本ドキュメントを翻訳しています。ただし、最高度の機械翻訳であっても、専門家による翻訳のような正確性は確保されません。シスコは、これら翻訳の正確性について法的責任を負いません。原典である英語版(リンクからアクセス可能)もあわせて参照することを推奨します。

内容

はじめに

このドキュメントでは、2つの個別のEVPN VXLANファブリックを導入する方法と、Cisco Data Center Manager(DCNM)11.2(1)を使用して、これら2つのファブリックをEVPN Multi-Site Fabric導入にマージする方法について説明します。

DCNM 11.0(1)リリースで導入されたMulti-Site Domain(MSD)は、複数のメンバーファブリックを管理するために作成されるマルチファブリックコンテナです。これは、メンバーファブリック間で共有されるオーバーレイネットワークとVirtual Routing and Forwarding(VRF)の定義に対するシングルポイント制御です。

注:このドキュメントでは、DCNM内の各タブの機能/プロパティに関する詳細については説明していません。詳細な説明については、末尾の「参考資料」を参照してください。

前提条件

要 件

次の項目に関する知識があることが推奨されます。

-

vCenter/UCSによるDCNM仮想マシンの導入

-

NX-OSおよびNexus 9000sに精通していること

-

Nexus 9000のToR、リーフ/スパイン方式で接続されたEoR

使用するコンポーネント

このドキュメントの情報は、次のソフトウェアとハードウェアに基づいています。

- DCNM 11.2(1)

- NX-OS 7.0(3)I7(7)およびNX-OS 9.2(3)

- スパイン:N9K-C9508/N9K-X97160YC-EXおよびN9K-C9508/N9K-X9636PQ

- リーフ:N9K-C9372TX、N9K-C93180YC-EX、N9K-C9372TX-E、N9K-C92160YC-X

- ボーダーゲートウェイ:N9K-C93240YC-FX2およびN9K-C93180YC-FX

- 7,000台の「ホスト」:N77-C7709

このドキュメントの情報は、特定のラボ環境にあるデバイスに基づいて作成されたものです。このドキュメントで使用するすべてのデバイスは、クリアな(デフォルト)設定で作業を開始しています。本稼働中のネットワークでは、各コマンドによって起こる可能性がある影響を十分確認してください。

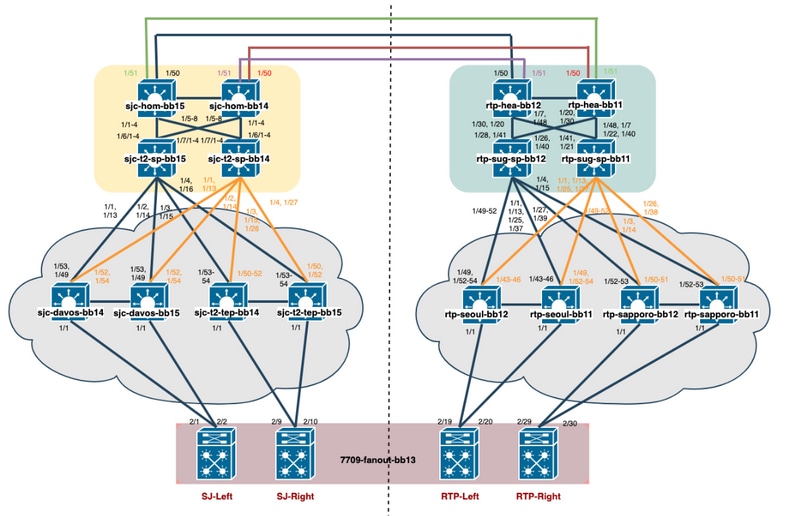

構築された物理トポロジ

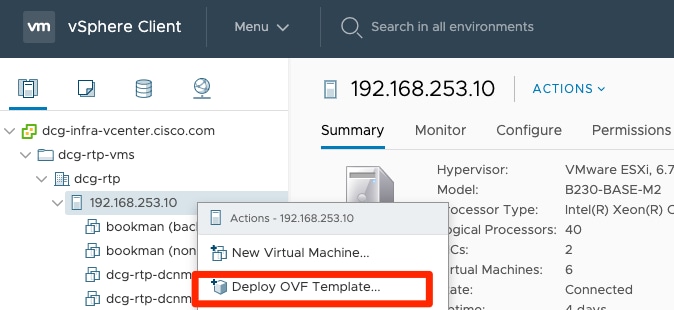

vCenterでのOVA/OVFの導入

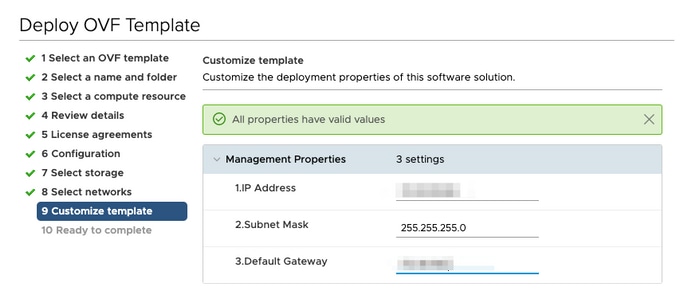

ステップ 1:vCenterの下で、図に示すように、選択したサーバ/ホストにOpen Virtualization Format(OVF)テンプレートを展開します。

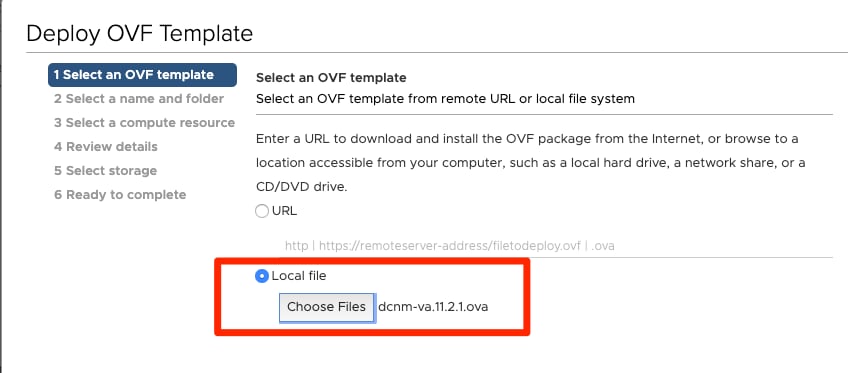

- 図に示すように、OVA/OVFなどのファイルをローカルに作成し、Choose Filesで選択します。

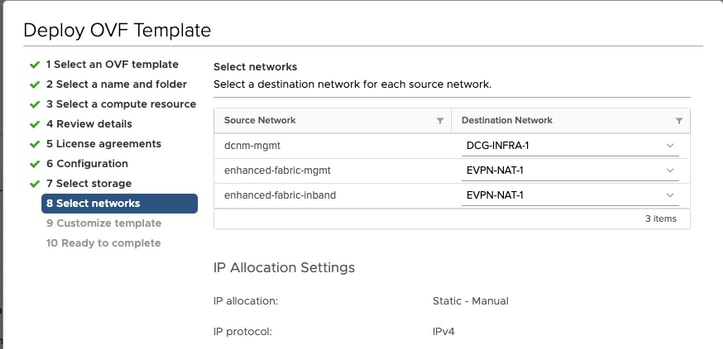

- 残りのプロンプト(図に示すVM名、ホスト、ネットワーク設定)に従って、Finishをクリックします。

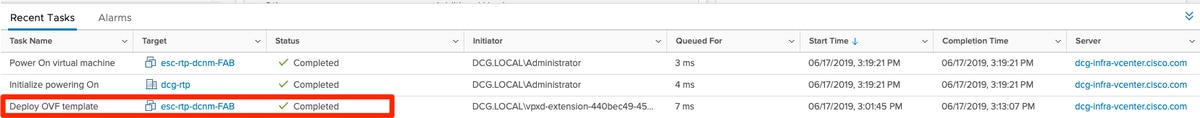

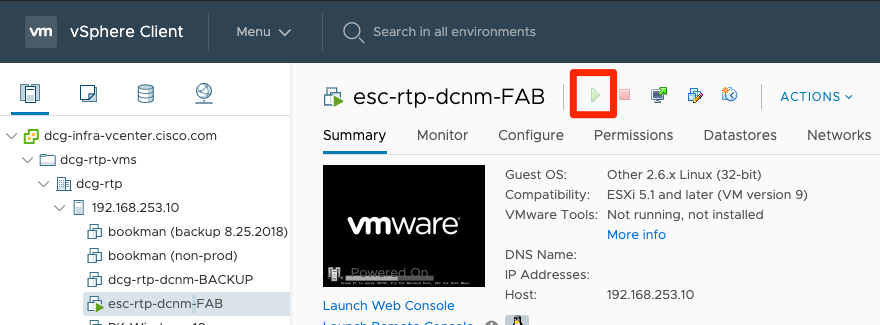

ステップ 2完了したら、次に示すようにDCNM VMを起動します。

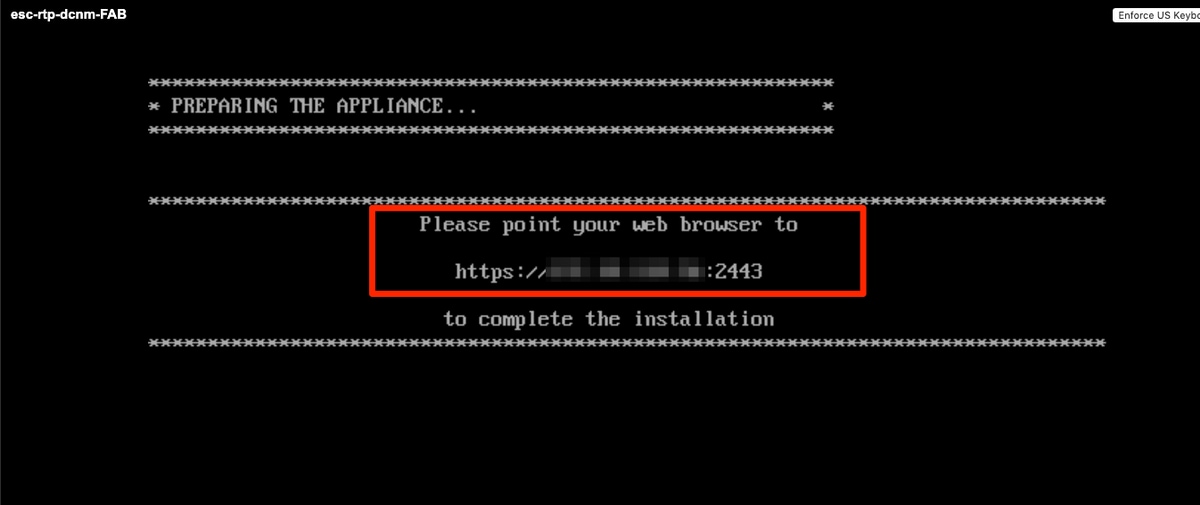

ステップ 3Webコンソールを起動します。コンソールに次のプロンプトが表示されます(IPは環境や設定によって異なります)。

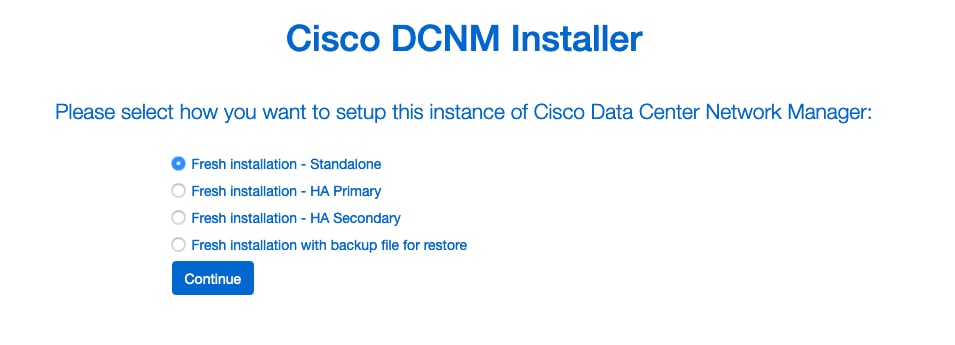

ステップ 4https://<your IP>:2443(これは、OVAの導入時に以前に設定したIPです)に進み、Get Startedをクリックします。この例では、新規インストールについて説明します。

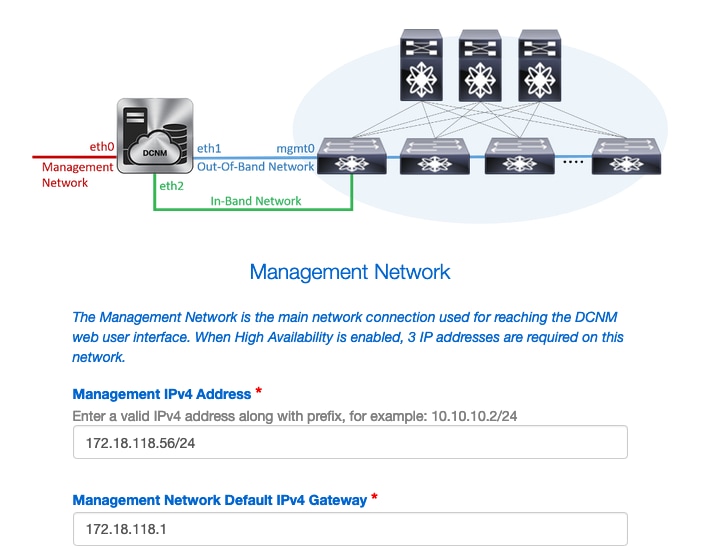

ステップ 5管理者パスワードを設定したら、インストールするファブリックのタイプを選択する必要があります。LANまたはFABを選択します。それぞれのタイプには異なる目的があるため、正しく理解して選択してください。この例では、LANファブリックが使用され、ほとんどのVXLAN-EVPN導入に使用されます。

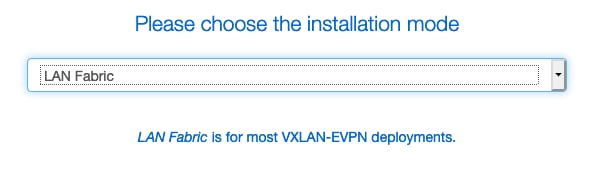

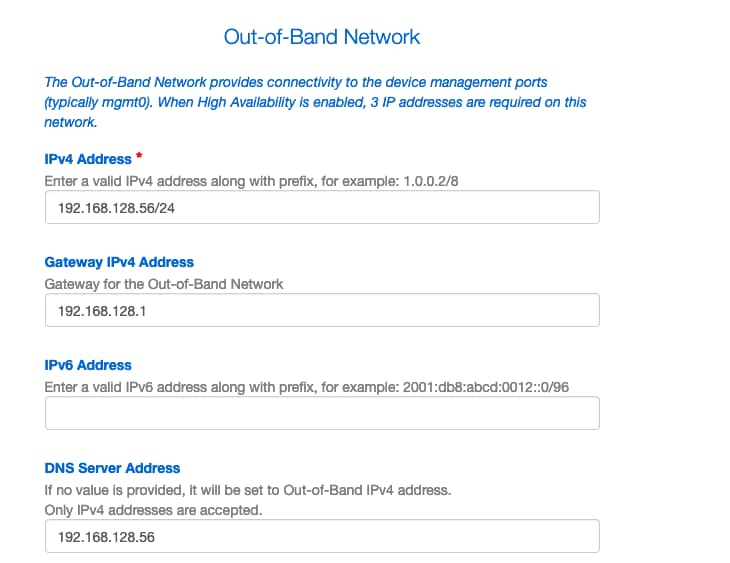

ステップ 6インストーラのプロンプトに従って、ネットワークのDNS、Network Time Protocol(NTP)サーバ、DCNMホスト名などを入力します。

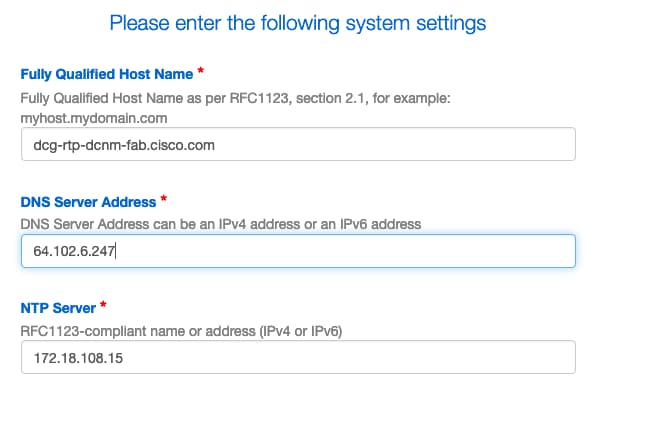

ステップ 7管理IPと管理ゲートウェイを設定します。管理ネットワークは、DCNMサーバへの接続(SSH、SCP、HTTP、HTTPS)を提供します。これは、GUIに到達するために使用するIPでもあります。IPアドレスは、先に実行したOVAのインストールから事前に設定しておく必要があります。

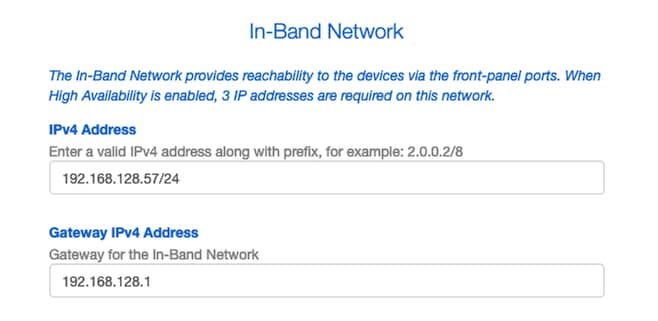

ステップ 8インバンドネットワークを設定します。インバンドネットワークは、エンドポイントロケータ(EPG)などのアプリケーションに使用されます。DCNMと9Kの間でボーダーゲートウェイプロトコル(BGP)セッションが確立されるために、ファブリック内の9Kへの前面パネルポート接続が必要です。

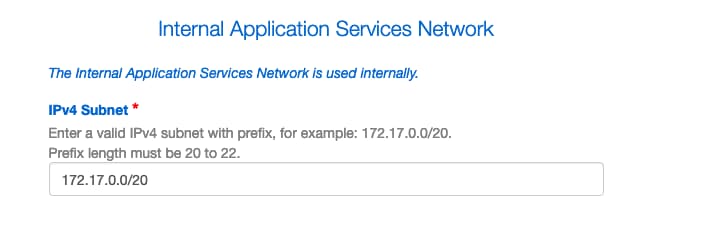

ステップ 9内部アプリケーションサービスネットワークの設定 –

DCNM 11.0リリースから、DCNMはDCNM LAN OVA/ISOインストールを使用したアプリケーションフレームワーク(AFW)をサポートしています。このフレームワークでは、スケールアウトアーキテクチャを実現するために、クラスタ環境と非クラスタ環境の両方でマイクロサービスとしてアプリケーションをオーケストレーションするためにDockerを使用します。

DCNMにデフォルトで付属するその他のアプリケーションには、エンドポイントロケータ、監視タワー、Virtual Machine Managerプラグイン、構成コンプライアンスなどがあります。AFWは、ネットワーキング、ストレージ、認証、セキュリティなどの提供を含め、これらのアプリケーションのライフサイクル管理を行います。AFWは、Network Insightsアプリケーション(NIRおよびNIA)の導入とライフサイクルも管理します。このサブネットは、NIA/NIRを有効にした場合のDockerサービス用です。

NIA/NIRのインストール方法は、「Day 2 Operations」セクションで説明しています。

注:このサブネットは、DCNMおよびコンピュートノードに割り当てられたeth0/eth1/eth2インターフェイスに割り当てられたネットワークと重複してはいけません。また、このサブネットは、DCNMによって管理されるスイッチまたは他のデバイスに割り当てられたIPと重複してはなりません。DCNMプライマリノードとセカンダリノードをインストールする際(ネイティブHA導入の場合)、選択したサブネットは一貫している必要があります。

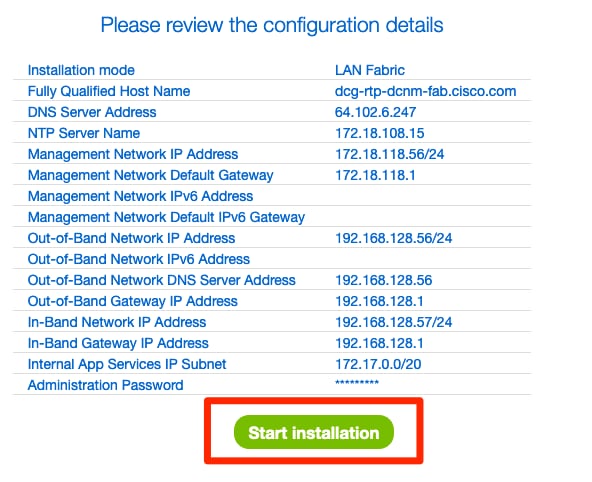

ステップ 10すべての設定の詳細を確認して確認し、インストールを開始します。

ステップ 11DCNMが完全にインストールされたら、GUI(以前に設定したIPアドレスまたはホスト名)にログインします。

最初のファブリックの導入:RTPファブリック

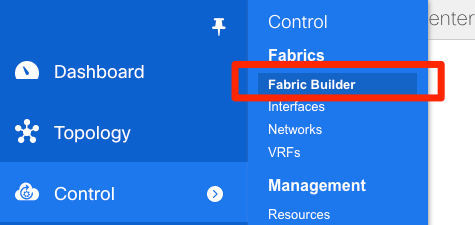

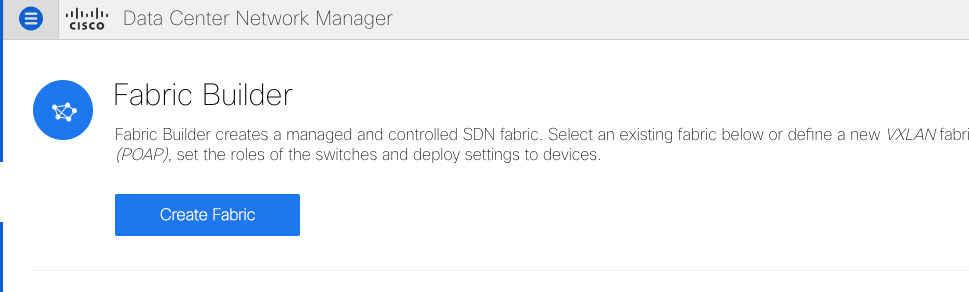

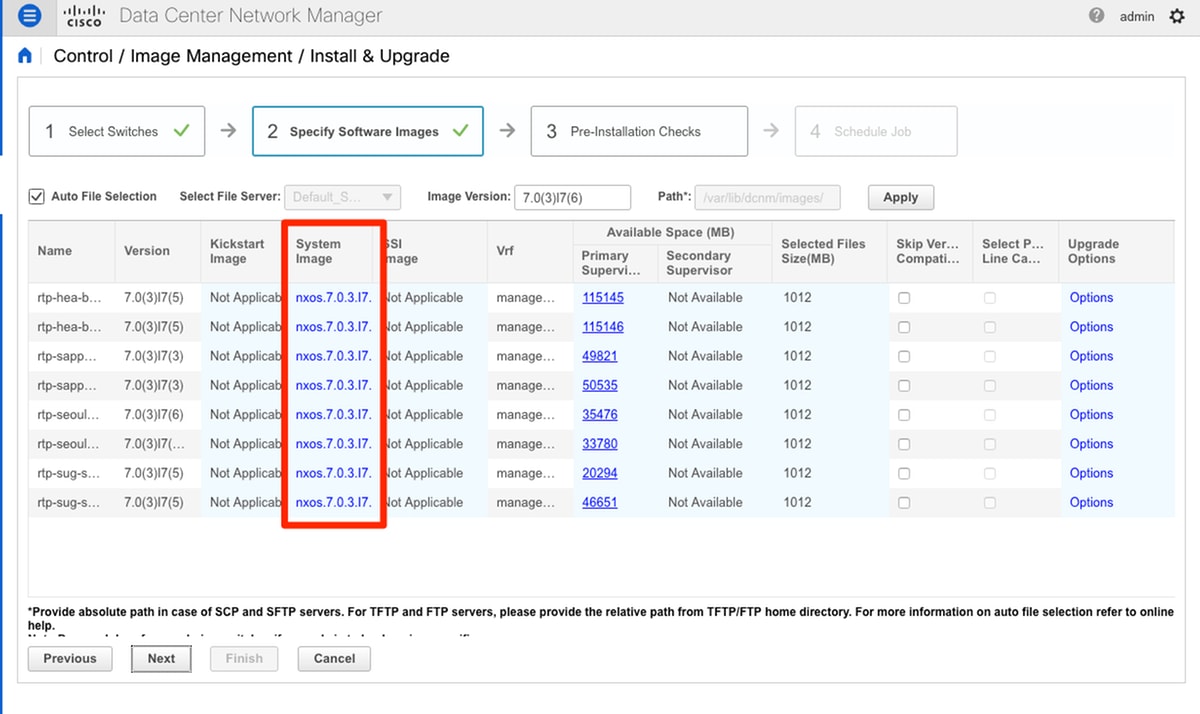

ステップ 1:DCNM GUIで、Fabric Builderに移動します。Control > Fabrics > Fabric Builderの順に選択し、最初のファブリックを作成します。

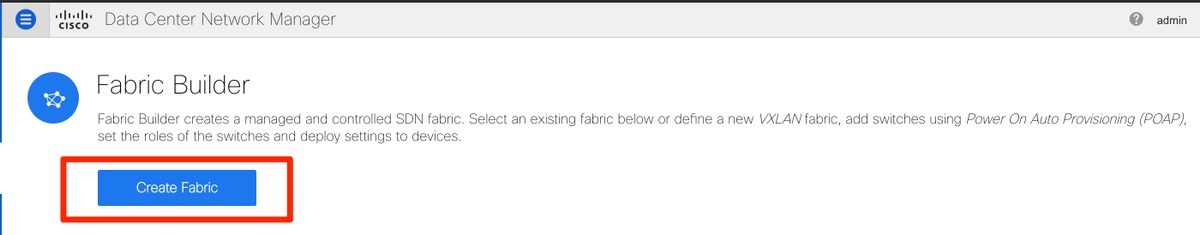

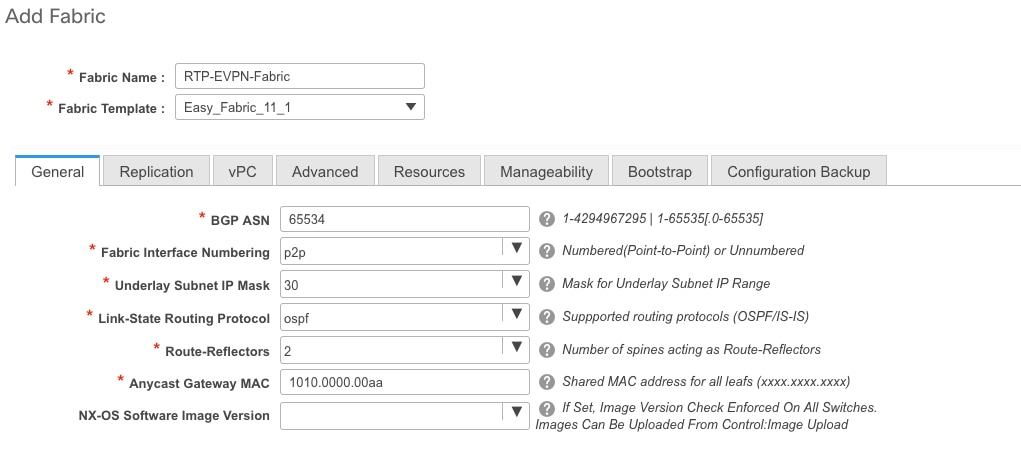

ステップ 2Create Fabricをクリックし、ネットワークに必要なフォームに入力します。Easy Fabricは、ローカルEVPN VXLAN導入に適したテンプレートです。

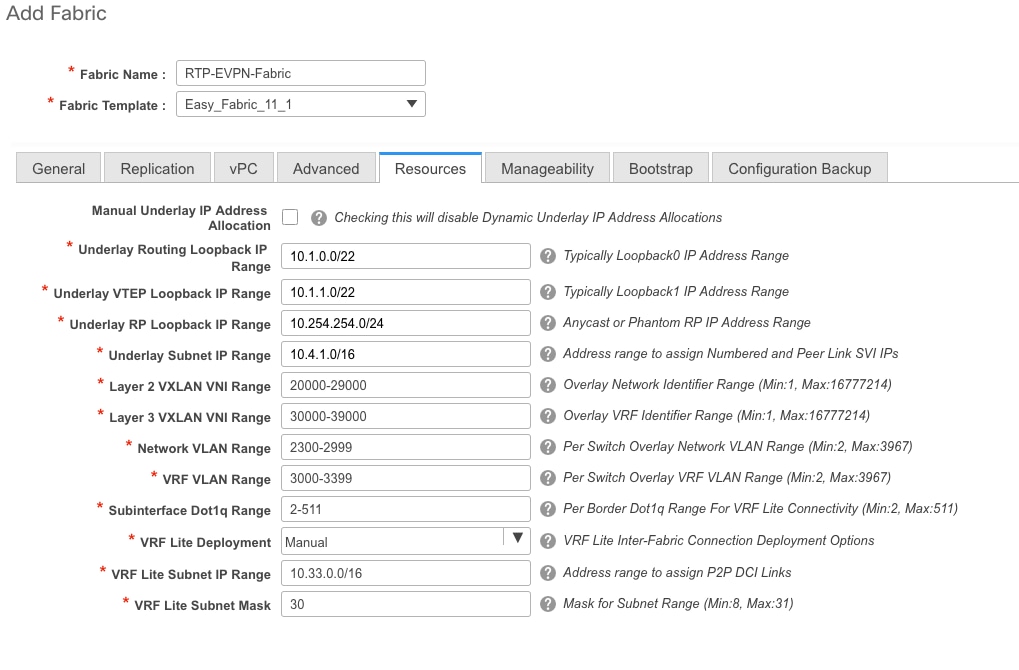

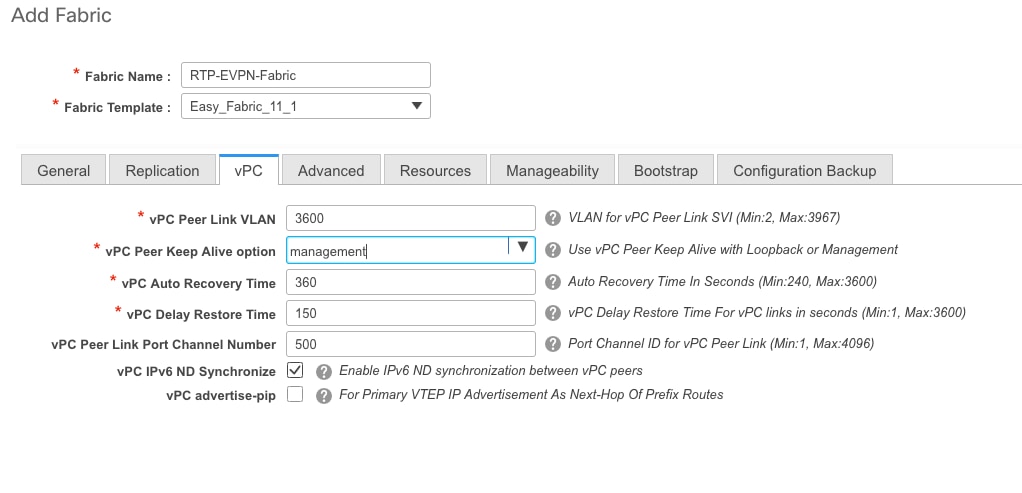

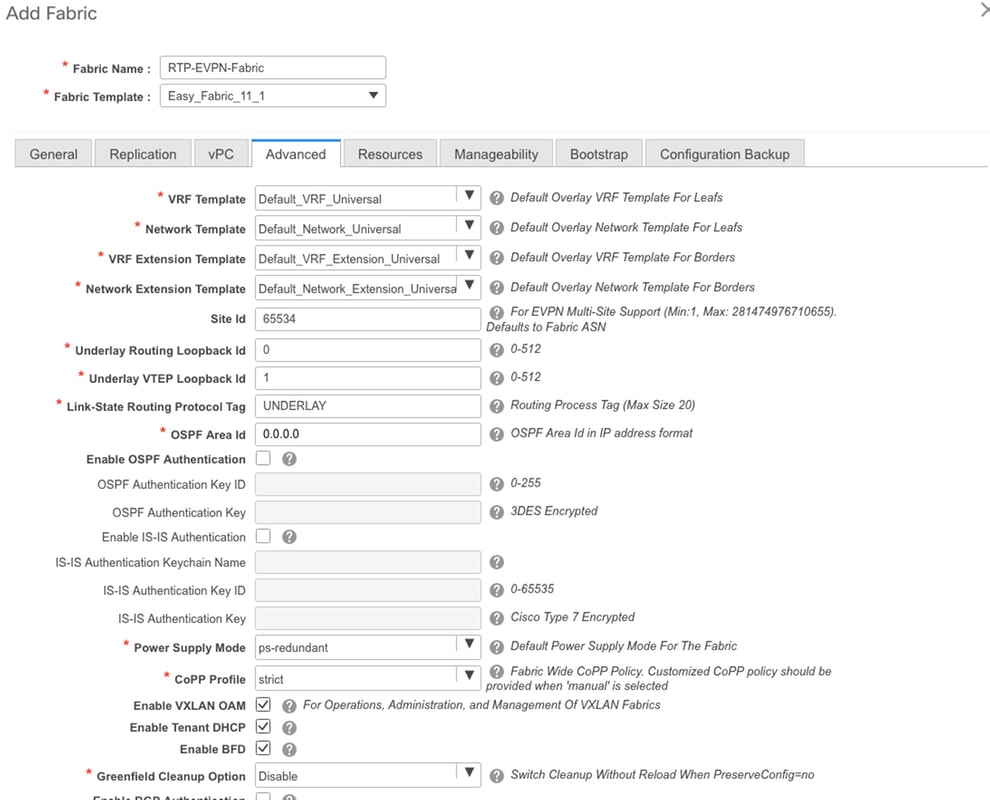

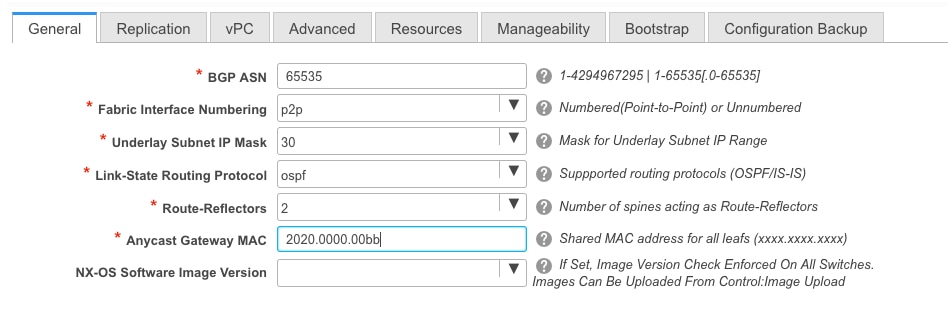

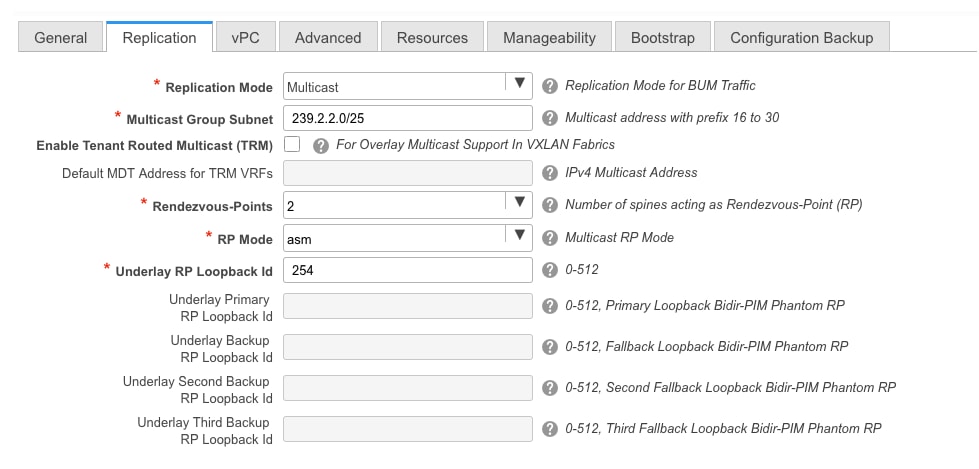

ステップ 3ファブリックのアンダーレイ、オーバーレイ、vPC、レプリケーション、リソースなどの要件を記入します。

このセクションでは、DCNMで必要なアンダーレイ、オーバーレイ、vPC、レプリケーションなどのすべての設定について説明します。これは、ネットワークアドレッシング方式、要件などによって異なります。この例では、ほとんどのフィールドがデフォルトのままになっています。後でトラブルシューティングしやすくするために、L2VNIは2で始まり、L3VNIは3で始まるようにL2VNIとL3VNIが変更されました。Bidirectional Forwarding Detection(BFD)も、他の機能とともに有効になります。

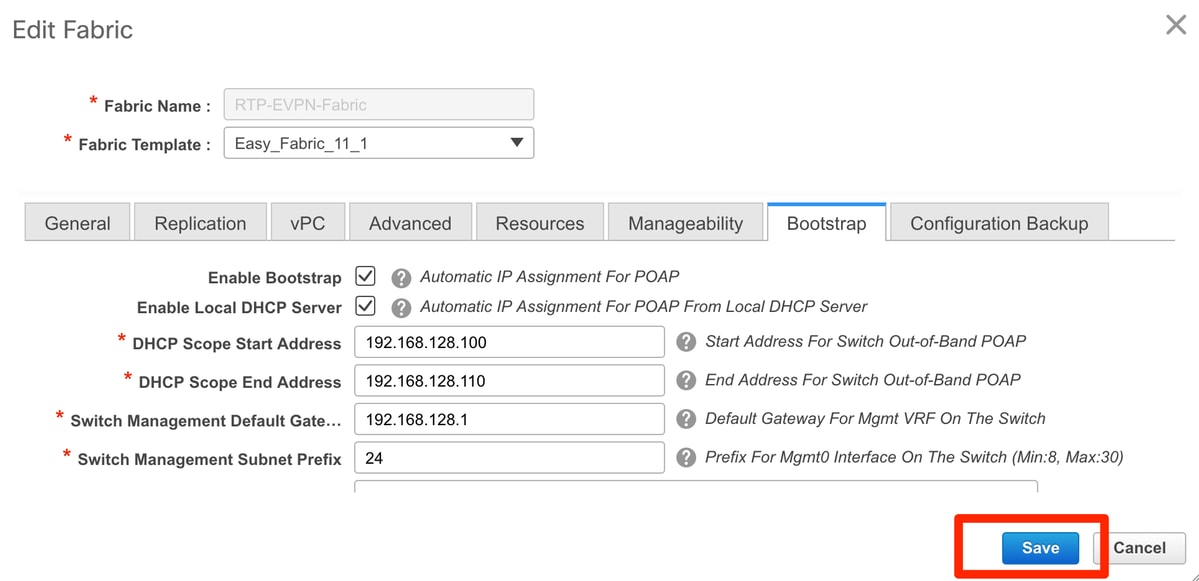

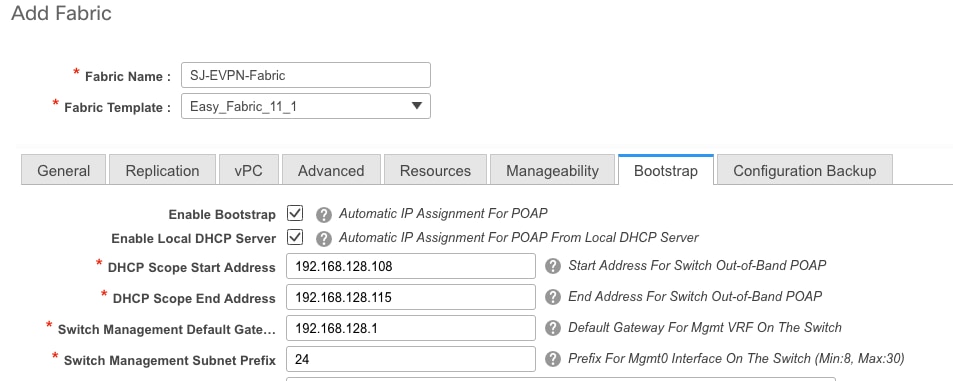

ステップ 4ブートストラップ構成で、POAPプロセス中にDCNMからファブリック内のスイッチに渡すDHCPアドレスの範囲を構成します。適切な(既存の)デフォルトゲートウェイも設定します。完了したらSaveをクリックします。次に、ファブリックにスイッチを追加します。

ファブリックへのスイッチの追加

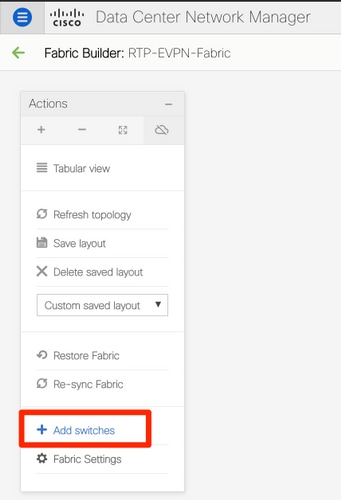

ステップ 1:Control > Fabrics > Fabric Builderの順に移動し、ファブリックを選択します。左側のパネルで、図に示すように、スイッチの追加をクリックします。

シードIPを使用してスイッチを検出する(つまり、各スイッチのmgmt0 IPを手動で設定する必要がある)か、POAPを介してスイッチを検出し、DCNMにすべてのmgmt0 IPアドレスやVRF管理などを設定させることができる。この例では、POAPを使用します。

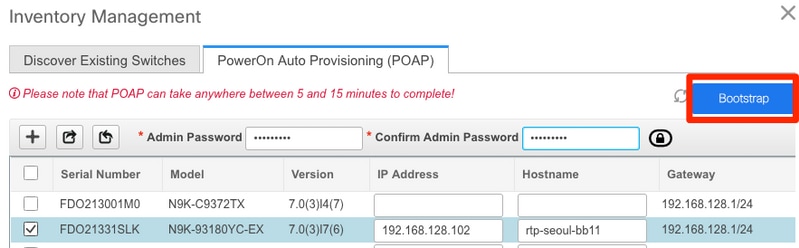

ステップ 2目的のスイッチが表示されたら、DCNMで使用する目的のIPアドレスとホスト名を入力します。次に、Admin PWと入力し、図に示すようにBootstrapをクリックします。

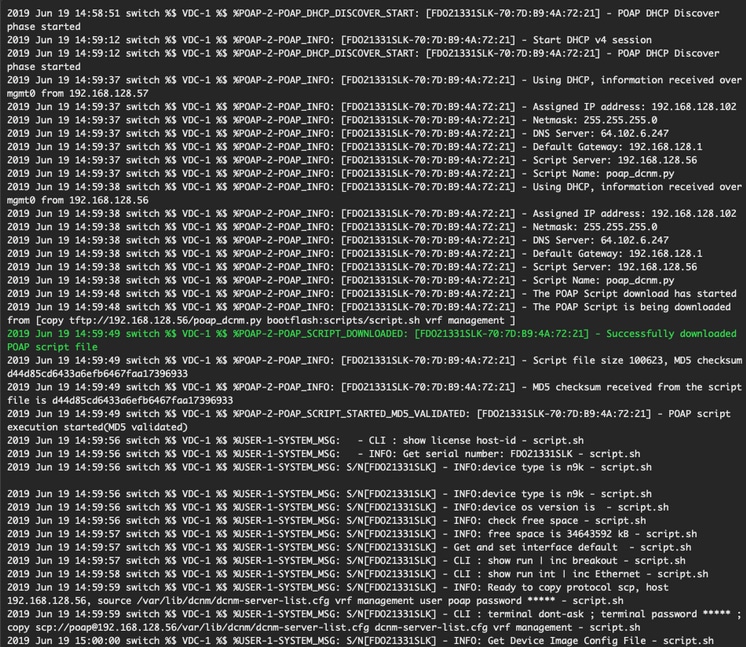

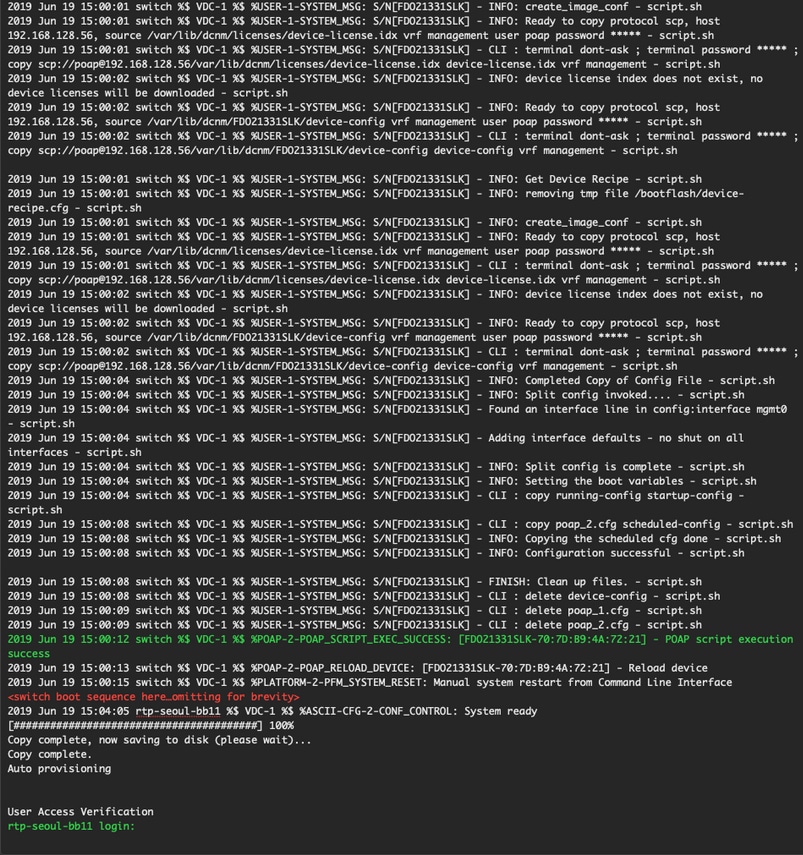

正常なブートのログは、スイッチのコンソールから次の図のように表示されるはずです。

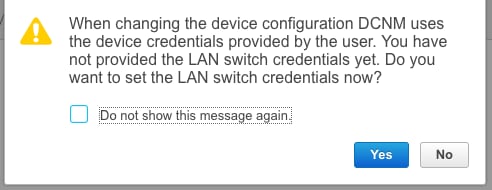

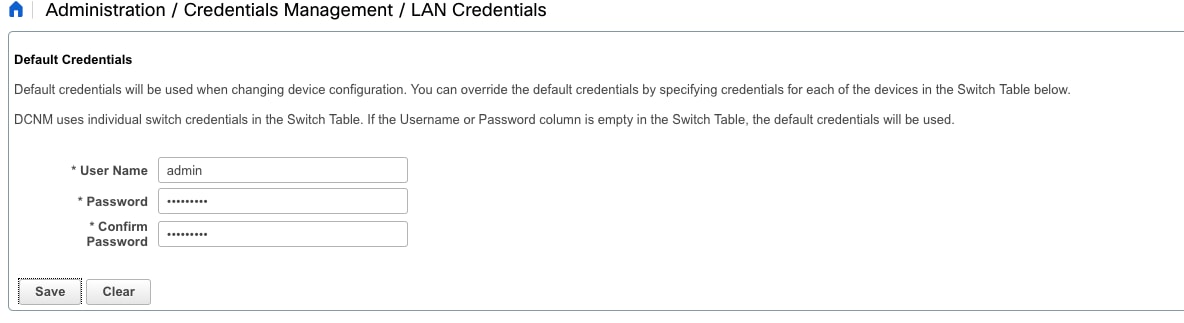

ステップ 3ファブリック全体の設定を展開する前に、デバイスのクレデンシャルを使用してDCNMを事前に設定してあることを確認してください。ログインすると、ポップアップがGUIに表示されます。アクティブにならない場合は、Administration > Credentials Management > LAN Credentialsでいつでもアクセスできます。

注:デバイスのクレデンシャルがない場合、DCNMは設定をスイッチにプッシュできません。

ファブリックの設定の導入

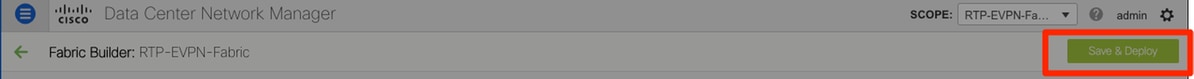

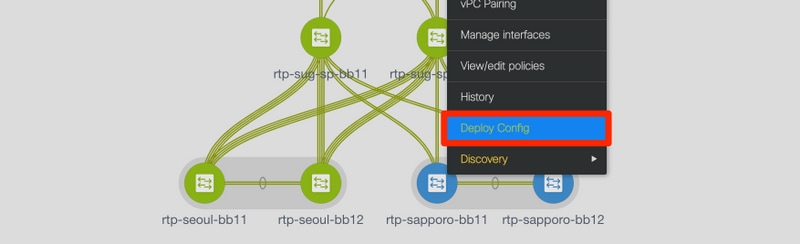

ステップ 1:同じ手順で特定のファブリックのすべてのスイッチを検出したら、Control > Fabrics > Fabric Builder > <your selected Fabric>の順に移動します。ここにあるすべてのリンクとともに、スイッチが表示されます。Save & Deployをクリックします。

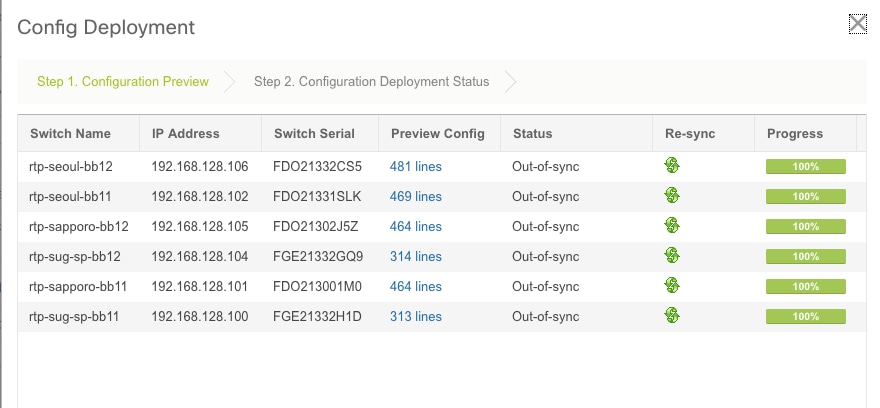

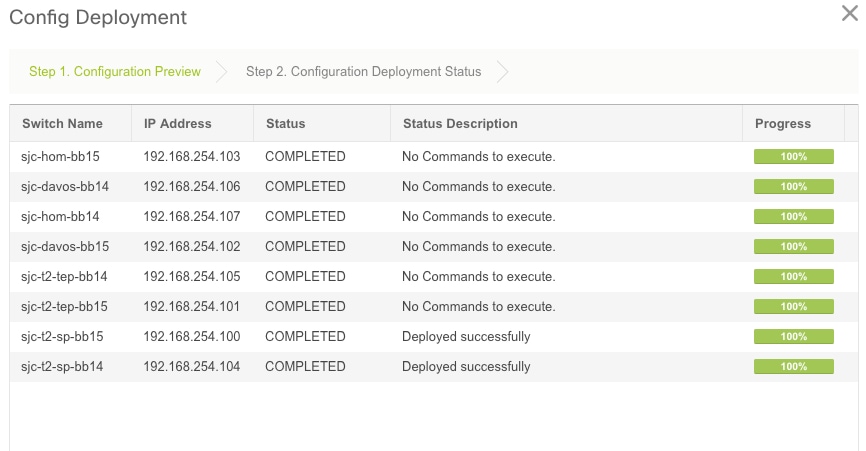

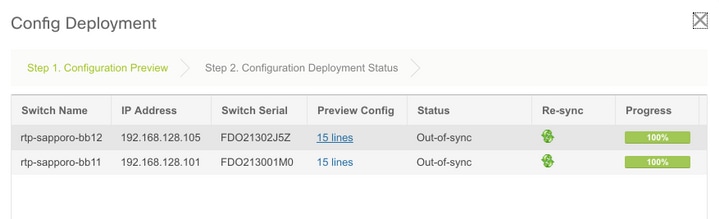

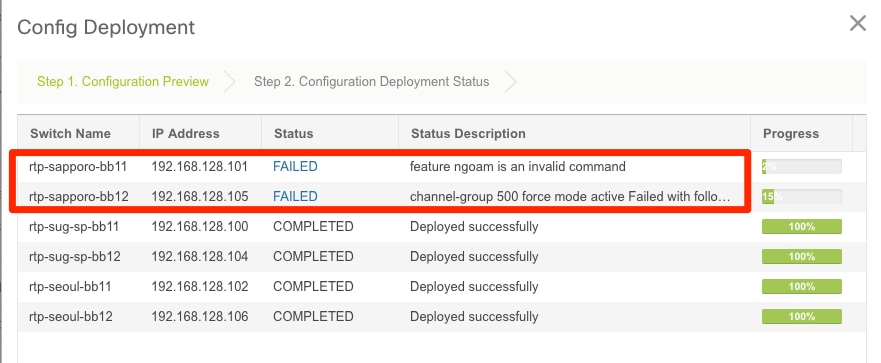

ステップ 2Config Deploymentウィンドウに、スイッチDCNMがプッシュする設定行の数が表示されます。必要に応じて設定をプレビューし、前後の設定を比較できます。

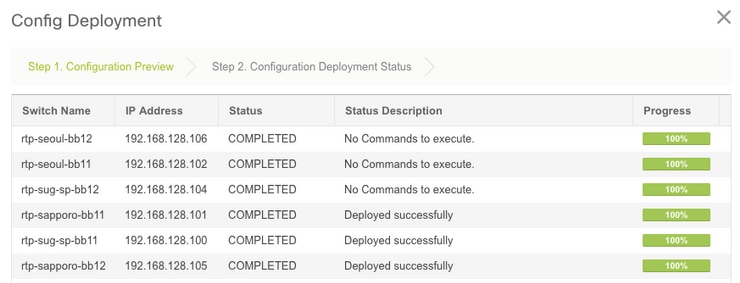

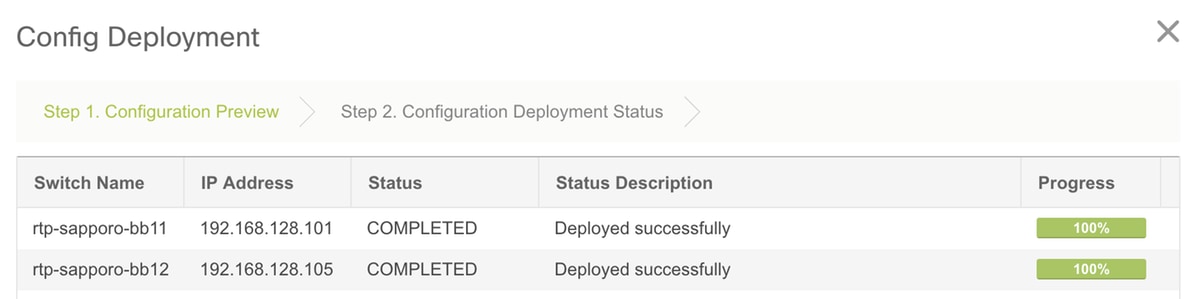

すべてのスイッチの状態がCOMPLETEDであり、エラーなしで100 %であることを確認する:エラーが発生する場合は、エラーに一度に1つずつ対処してください(例については、「この導入時に発生した問題」の項を参照)

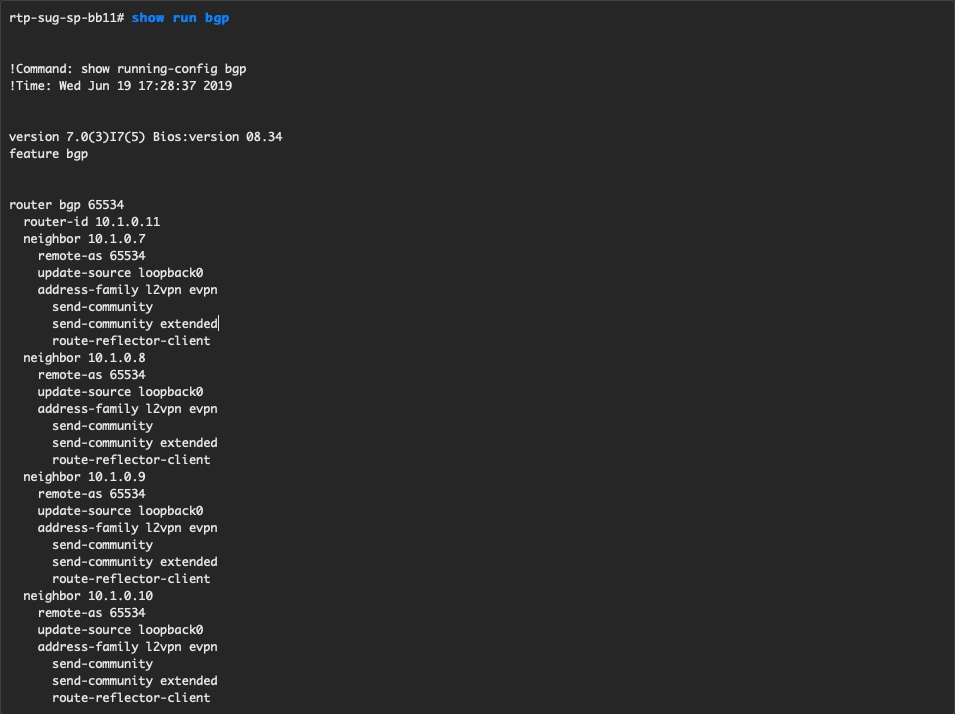

ステップ3:(オプション)この時点でデバイスにログインし、show run CLIを発行して、設定がDCNMによって正常にプッシュされたことを確認できます。

例:

2つ目のファブリックの導入:SJ

BGP ASなどに異なる値を使用して、RTPファブリックに対して以前と同じ手順を実行します。

ステップ 1:Control > Fabrics > Fabric Builder > Create Fabric > Name it!の順に移動します。

このセクションでは、必要なアンダーレイ、オーバーレイ、vPC、レプリケーションなどのすべての設定について説明します。これは、ネットワークアドレッシング方式、要件などによって異なります。

注:マルチサイトを使用する場合、ここで使用するエニーキャストゲートウェイMACは他のファブリックと一致する必要があります。後で、異なるエニーキャストゲートウェイMACはサポートされません。これは、後の「マルチサイト導入」セクションで修正されています(簡略化のため、この文書では示されていません)。

ステップ 2前と同様にブートストラップセクションを設定します。Add Switchesの順に再び移動します。すべて検出されたら、Save & Deployをクリックして設定を展開します。これについては、「RTPファブリックの導入」のセクションで説明しました(簡略化するため、ここでは省略)。

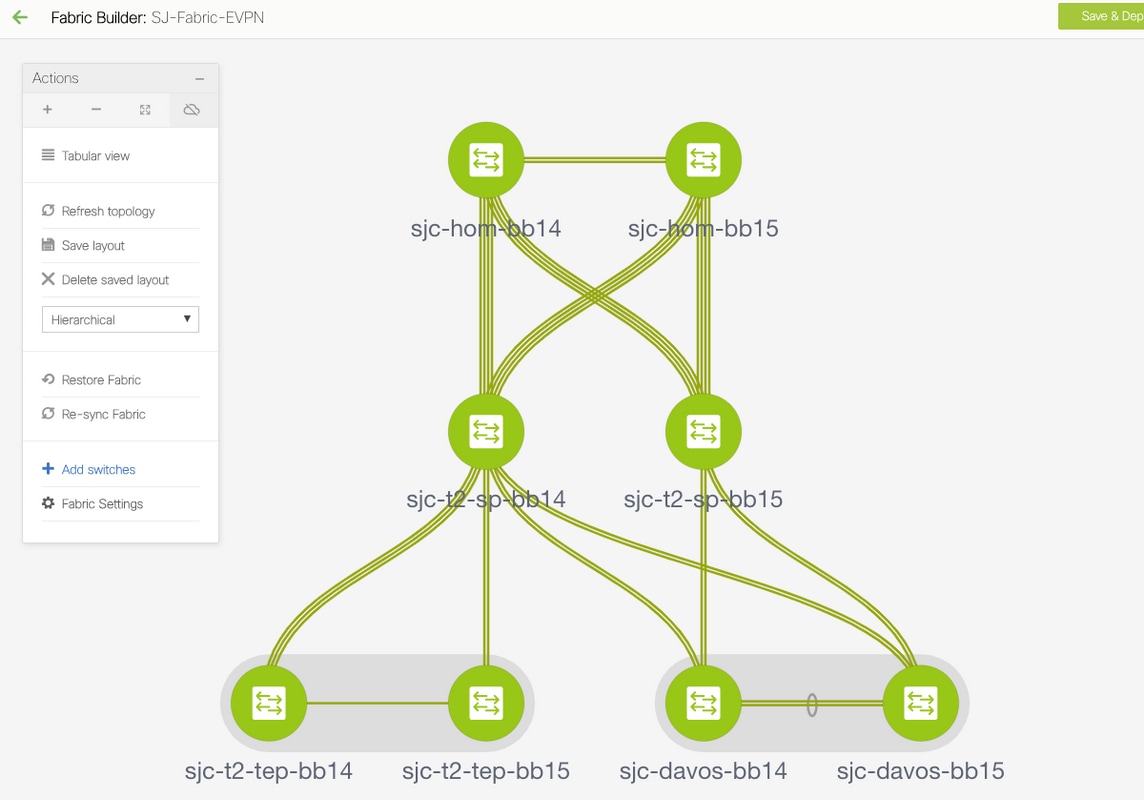

最後にFabric Builderの観点から見たトポロジ。

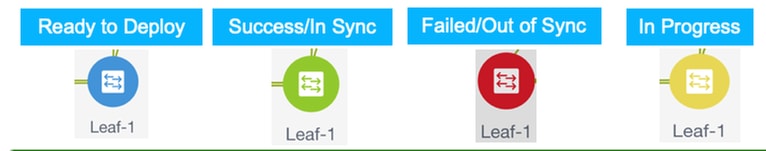

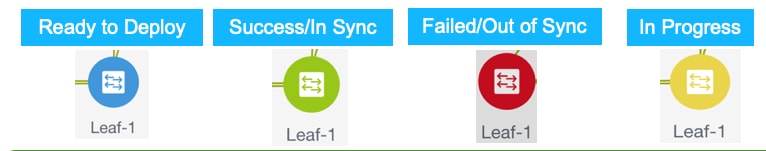

すべてのスイッチがリンクとともに緑色で表示されていることが理想的です。次の図は、DCNM平均のさまざまなステータスカラーを示しています。

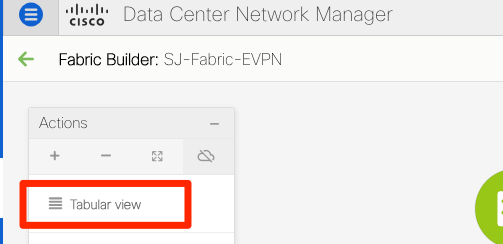

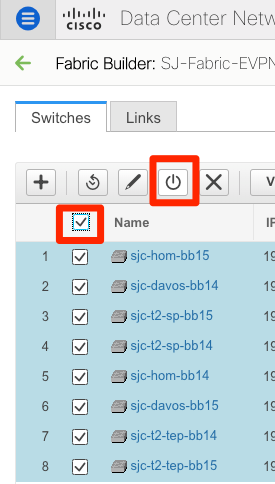

ステップ 3両方のファブリックを設定して展開したら、TCAMの変更を有効にするために、設定を保存してリロードします。図に示すように、Controls > Fabrics > Fabric Builder > <your Fabric>の順に選択し、Tabular Viewに移動します。

ステップ 4次に、電源ボタンをクリックします(これにより、すべてのスイッチが同時にリロードされます)。

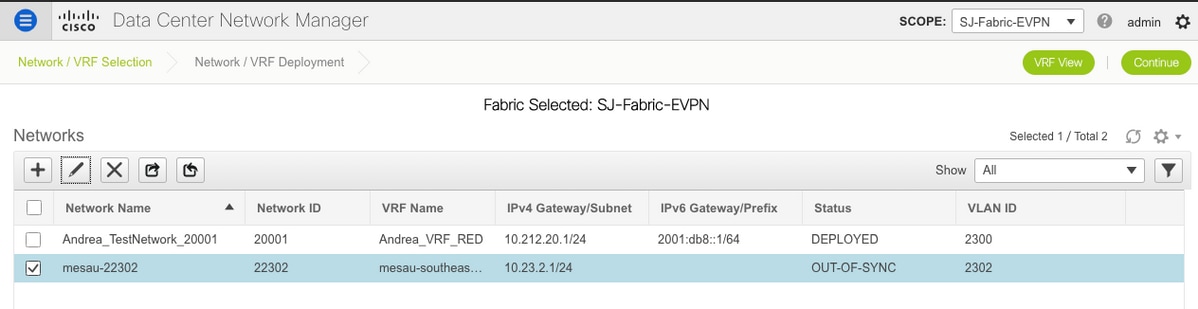

ネットワーク(VLAN/L2VNI)とVRF(L3VNI)の作成

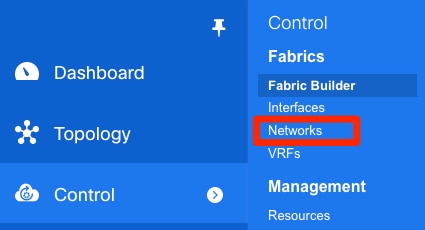

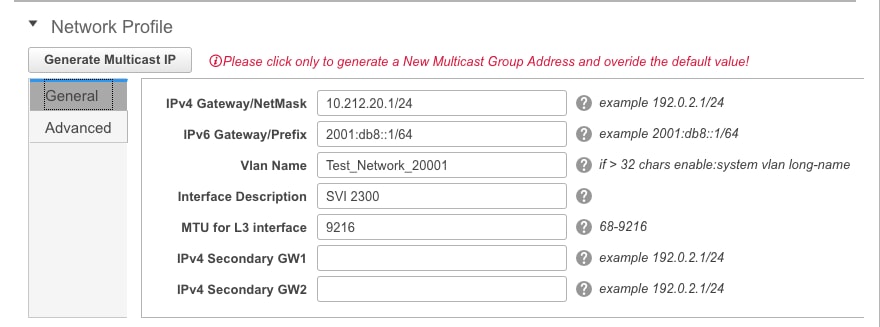

ステップ 1:図に示すように、Control > Fabrics > Networksの順に選択します。

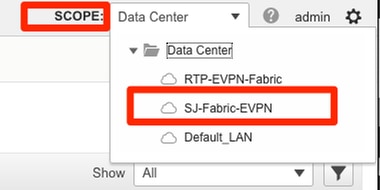

ステップ 2図に示すように、変更のスコープ(つまり、この設定を適用する必要があるファブリック)を選択します。

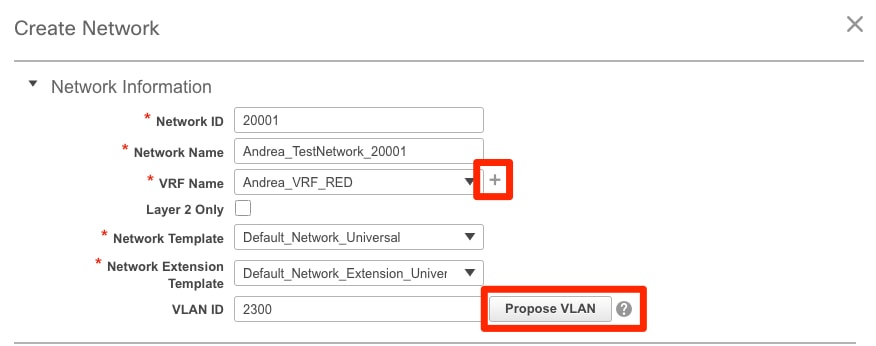

ステップ 3図に示すように、+記号をクリックします。

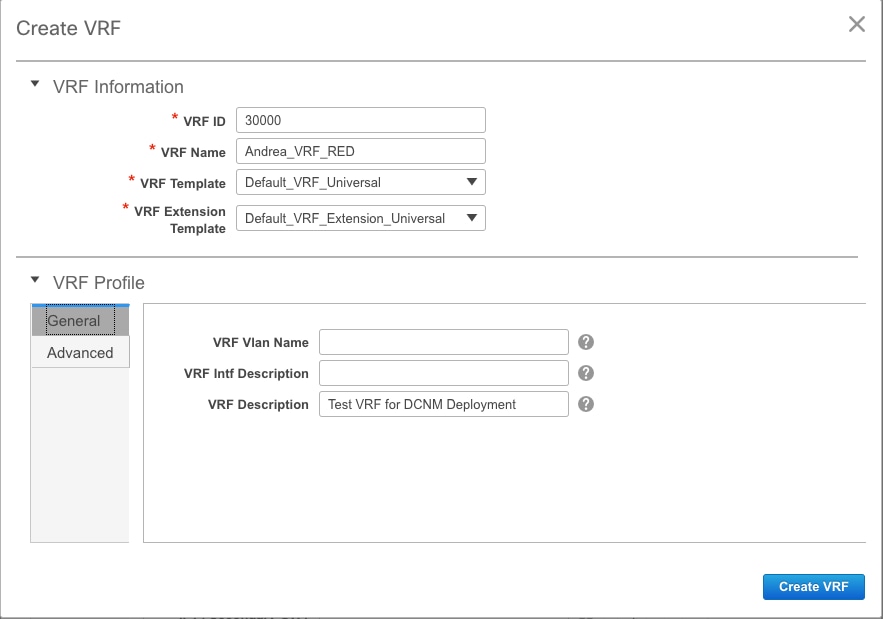

ステップ 4DCNMの手順に従ってスイッチ仮想インターフェイス(SVI)(または純粋なL2 VLAN)を作成します。 この段階でVRFが作成されていない場合は、もう一度+ボタンをクリックすると、SVIの設定に進む前に、一時的にVRFのウォークスルーに移動します。

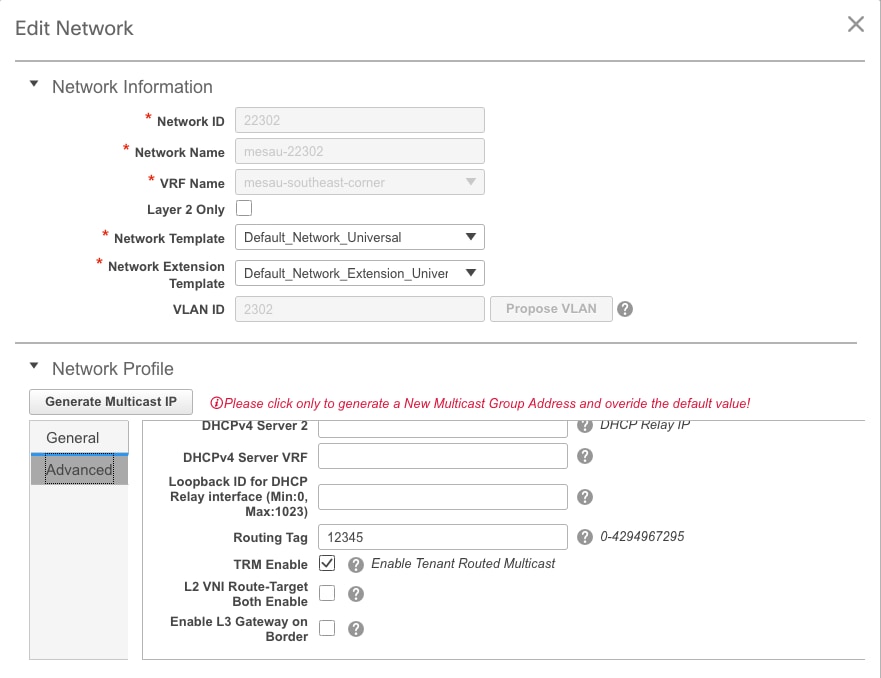

次の機能は、Advanced タブで設定できます。

- ARP抑制

- 入力レプリケーション

- マルチキャストグループ

- DCHP

- ルートタグ

- TRM

- L2 VNIルートターゲット

- 境界でのL3ゲートウェイの有効化

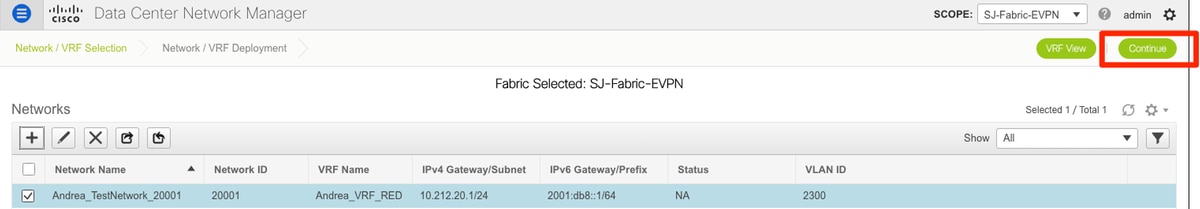

ステップ 5Continueをクリックして、ネットワーク/VRF設定を展開します。

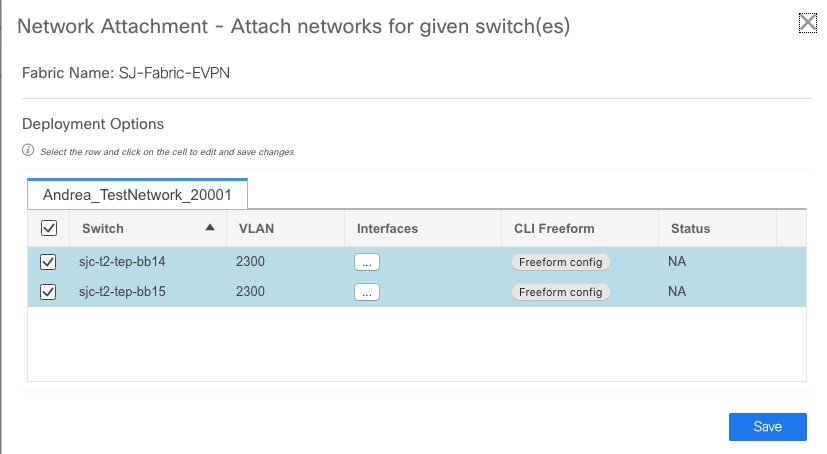

ステップ 6トポロジビューでデバイスをダブルクリックし(DCNMにより自動的に表示されます)、該当する構成に合わせて選択します。図に示すように、Saveをクリックします。

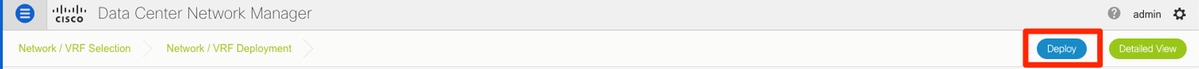

ステップ 7選択すると、次の図に示すように、スイッチが青く表示されます(Ready to Deploy)。

注:導入する前にCLIの設定を確認する場合は、次の画面でDeployの代わりにDetailed Viewをクリックし、Previewをクリックします。

スイッチは設定の適用中に黄色に変わり、完了すると緑色に戻ります。

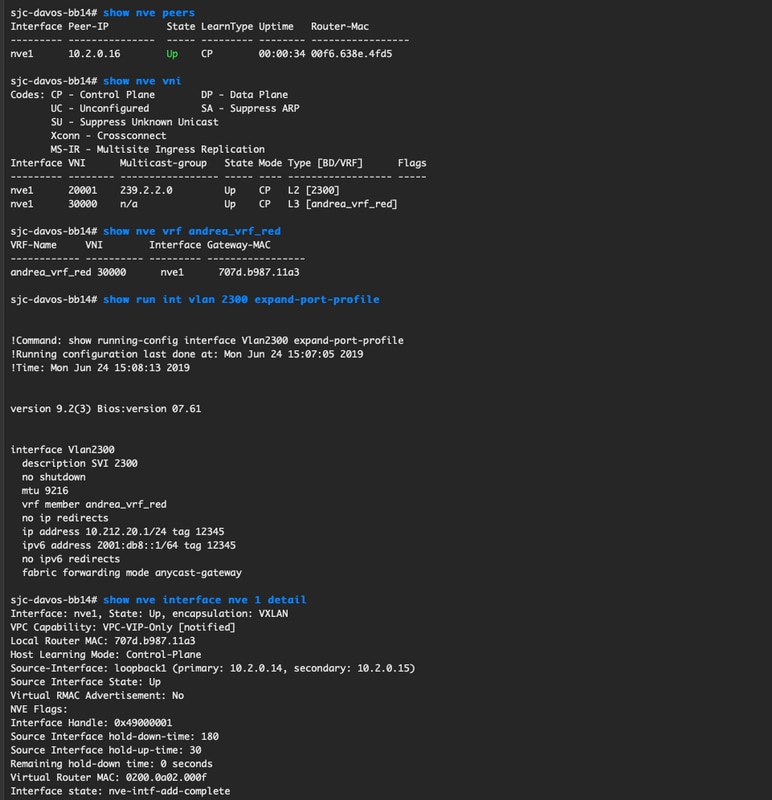

ステップ8:(オプション)必要に応じて、CLIにログインして設定を確認できます(expand-port-profileオプションを使用することを忘れないでください)。

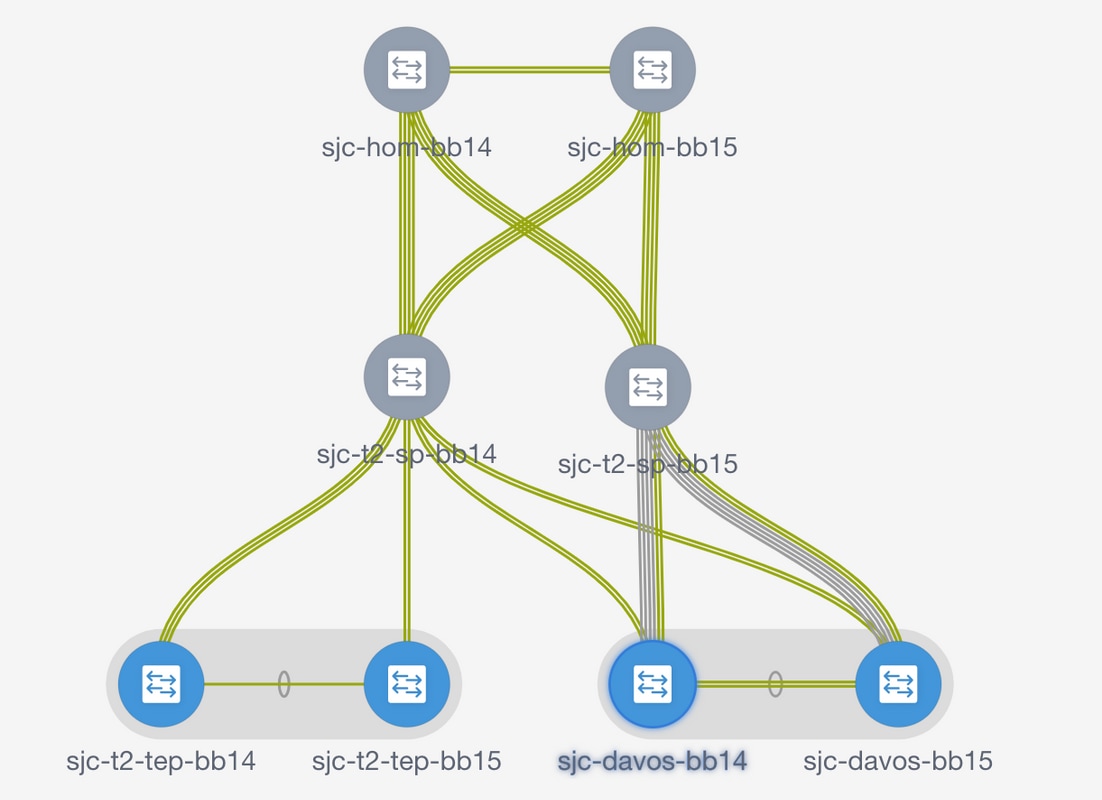

マルチサイト構成

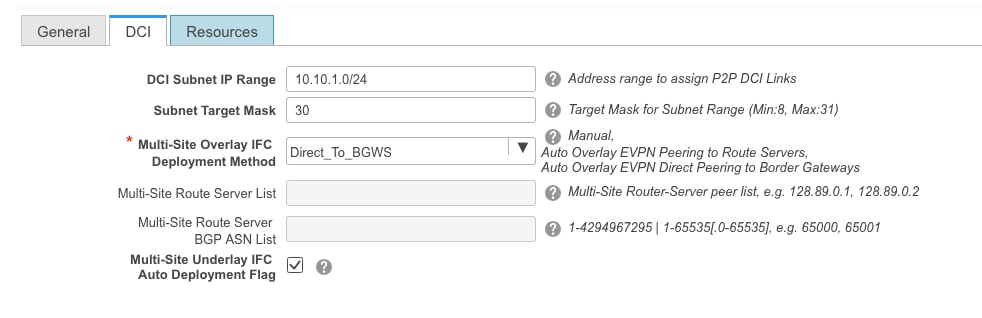

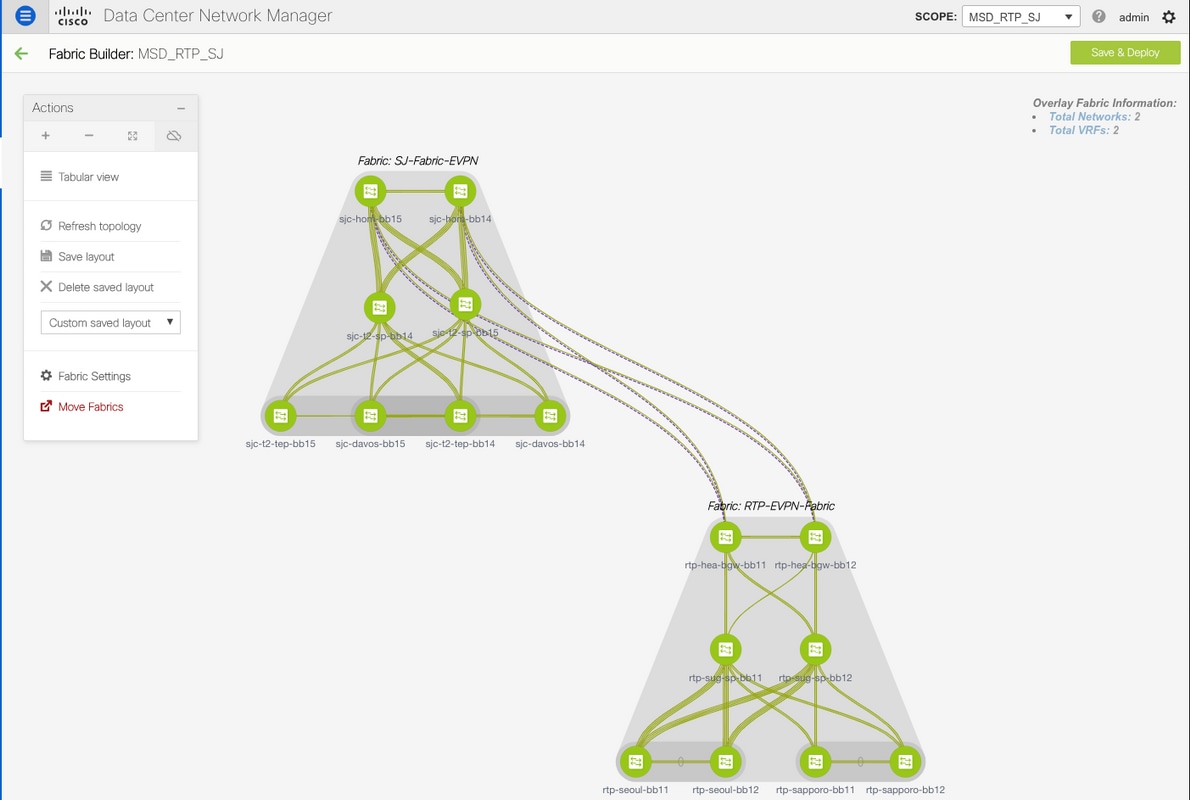

このGreenfield導入では、MSDファブリックはBorder Gateway(BGW)間の直接ピアリングを介して導入されます。 別の方法として、集中型ルートサーバを使用することもできます。このドキュメントでは説明しません。

ステップ 1:図に示すように、Control > Fabric Builder > Create Fabricの順に移動します。

ステップ 2Multi-Site Fabricに名前を付け、Fabric TemplateのドロップダウンでMSD_Fabric_11_1を選択します。

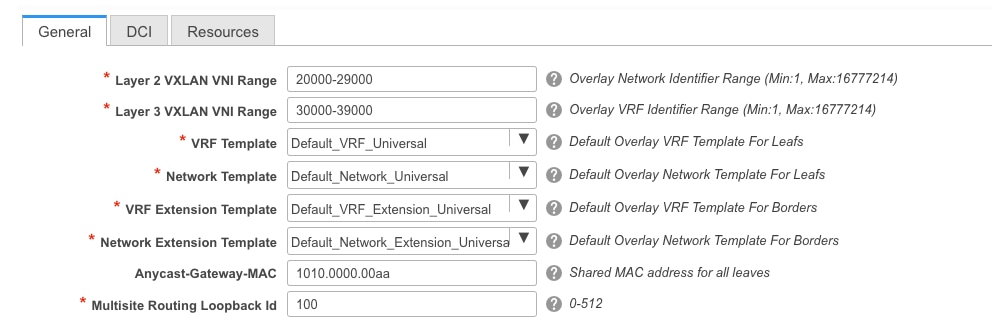

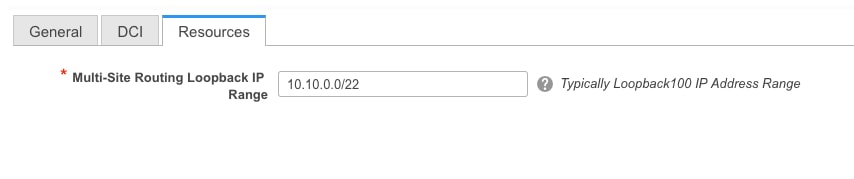

ステップ 3Generalの下で、L2およびL3 VNIの範囲が個々のファブリックで使用しているものと一致していることを確認します。また、エニーキャストゲートウェイMACは両方のファブリック(この例ではRTP/SJ)で一致している必要があります。 DCNMでは、ゲートウェイMACが不一致で、MSD導入に進む前に修正が必要な場合に、エラーが発生します。

ステップ 4Saveをクリックし、MSD Fabricに移動してSave & Deployをクリックします。正常に完了すると、トポロジは次のようになります(すべてのスイッチとリンクが緑色)。

ホストアクセス/トランクポリシーの導入

この例では、2つの異なるVTEPペアのvPCトランクが設定され、ローカルRTPファブリック内の接続がテストされます。図に示す関連トポロジ:

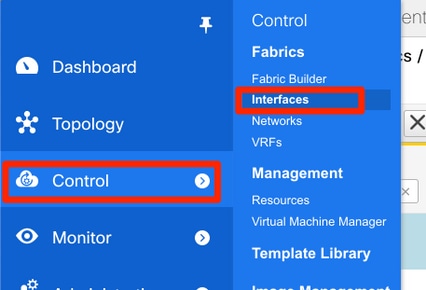

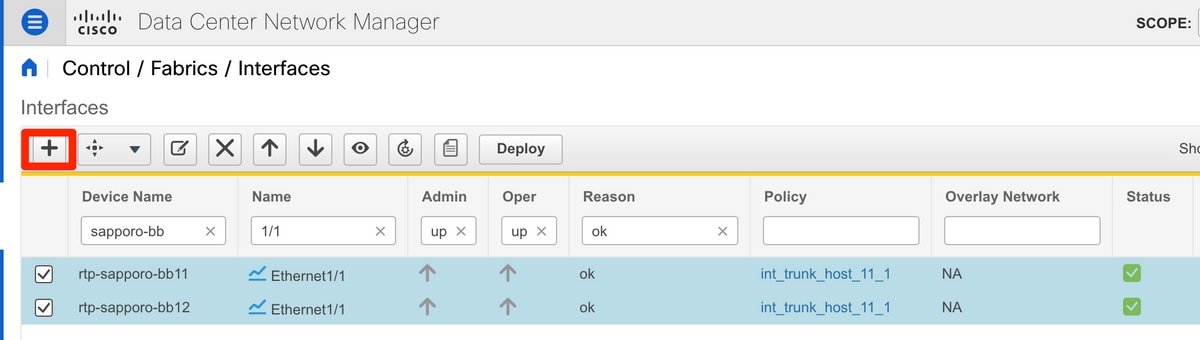

ステップ 1:図に示すように、Control > Fabrics > Interfacesの順に移動します。

ステップ 2図に示すように、+記号をクリックして、インターフェイスの追加ウィザードに入ります。

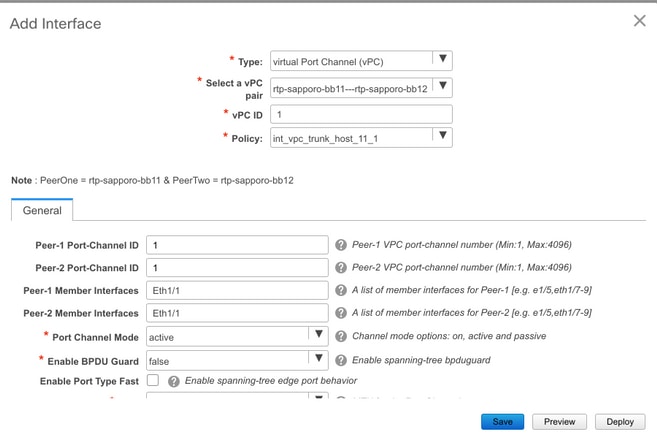

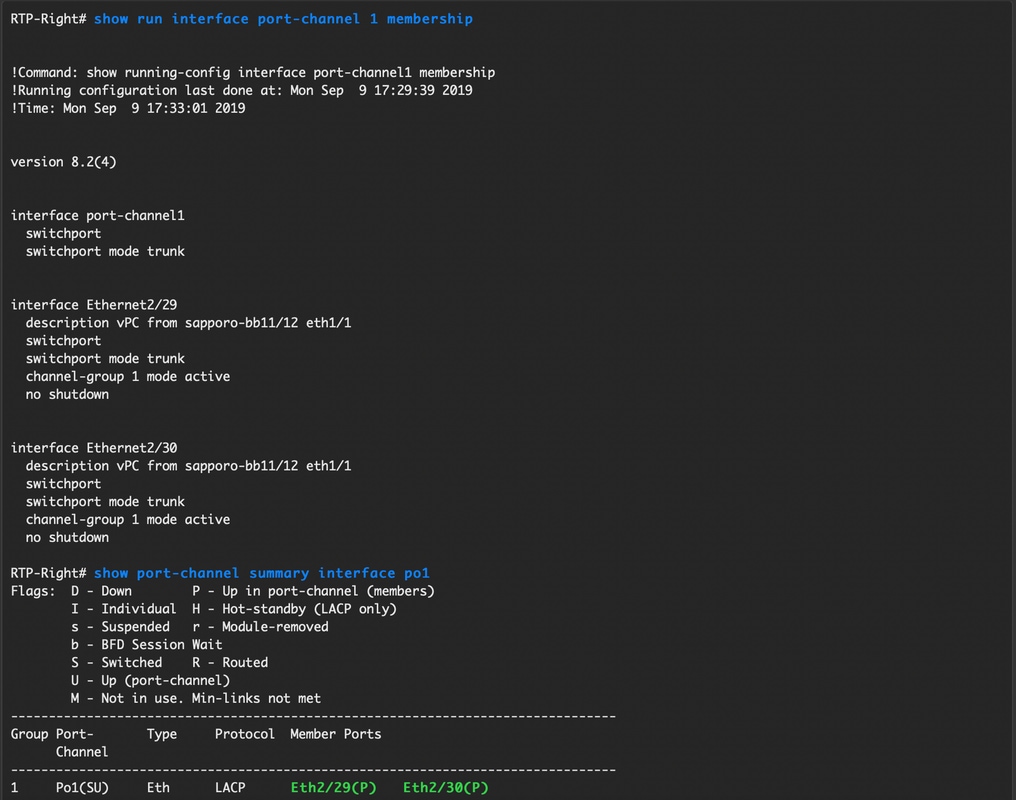

この例では、vPCトランクはN7Kのダウンストリームに作成され、このウォークスルーでテストにpingを実行するために使用されます。

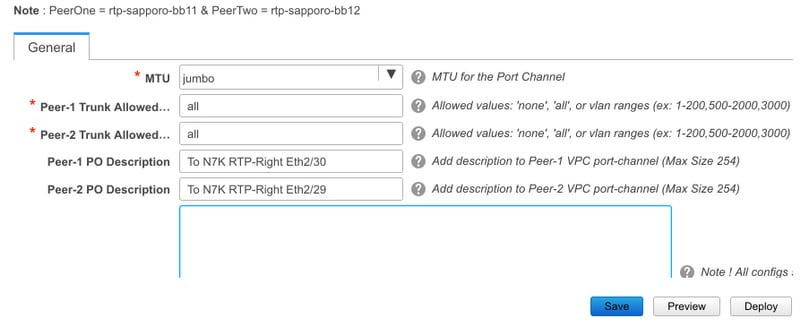

ステップ 3適切なvPCペア、物理インターフェイス、LACPオン/オフ、BPDUGuardなどを選択します。

ステップ 4終了したら、Saveをクリックします。または、図に示すように、直接導入することもできます。

ステップ5:(オプション)適用する設定を確認します。

ステップ6:(オプション)7Kでの手動設定:

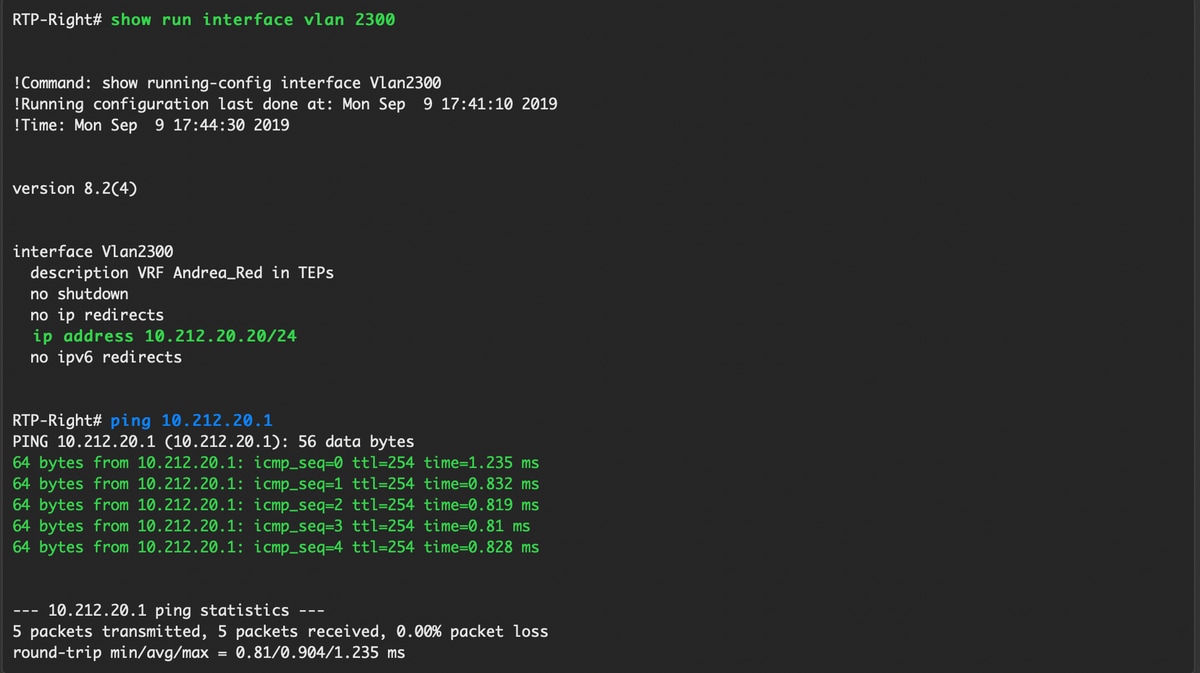

手順7.(オプション)N7K上でテストSVIを作成し、RTP内のVTEPにpingを実行します(VTEPのVRF andrea_redに10.212.20.1のエニーキャストゲートウェイがあります)。

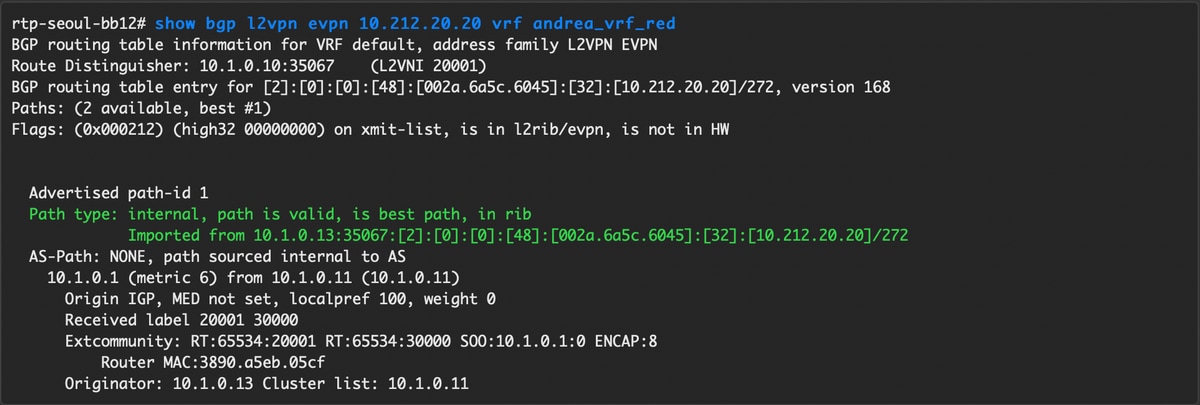

ステップ8:(オプション)RTP内の他のVTEPがEVPN/HMM経由でこのホストを認識できることを確認します。

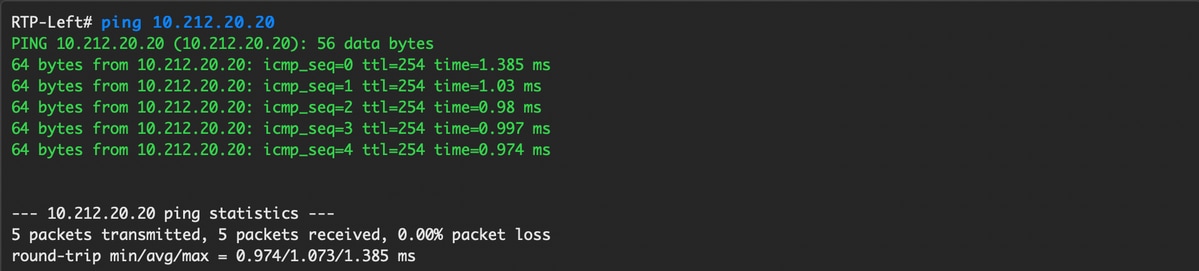

ステップ9:(オプション)seoul-bb11/12に対して同じプロセスを繰り返します(vPCポートチャネルを作成し、SVI 2300を作成します)。 RTPファブリック内のEVPN経由のL2接続を確認するためにRTP左からRTP右にpingを実行します。

インターフェイスの追加コンテキストで非vPCポートチャネル、アクセスインターフェイスなどを作成するには、同様の手順を実行できます。

Day 2の運用

DCNMによるNX-OSソフトウェアのアップグレード

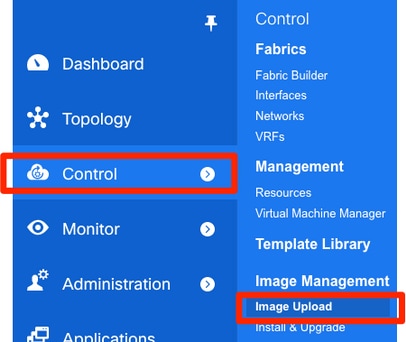

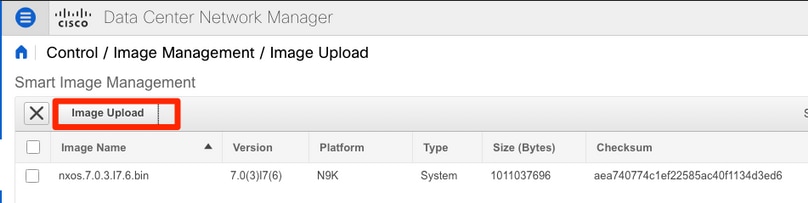

ステップ 1:イメージ(またはイメージのセット)をDCNMのサーバにアップロードし、次の図に示すように、Control > Image Management > Image Uploadの順に選択します。

ステップ 2ローカルアップロードのプロンプトに従うと、ファイルは次の図のように表示されます。

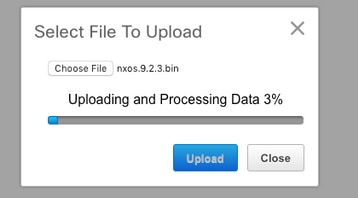

ステップ 3ファイルがアップロードされたら、スイッチのアップグレードが必要な場合は「インストールとアップグレード」に進むことができます。図に示すように、Control > Image Management > Install & Upgradeの順に移動します。

ステップ 4アップグレードするスイッチを選択します。この例では、RTPファブリック全体がアップグレードされます。

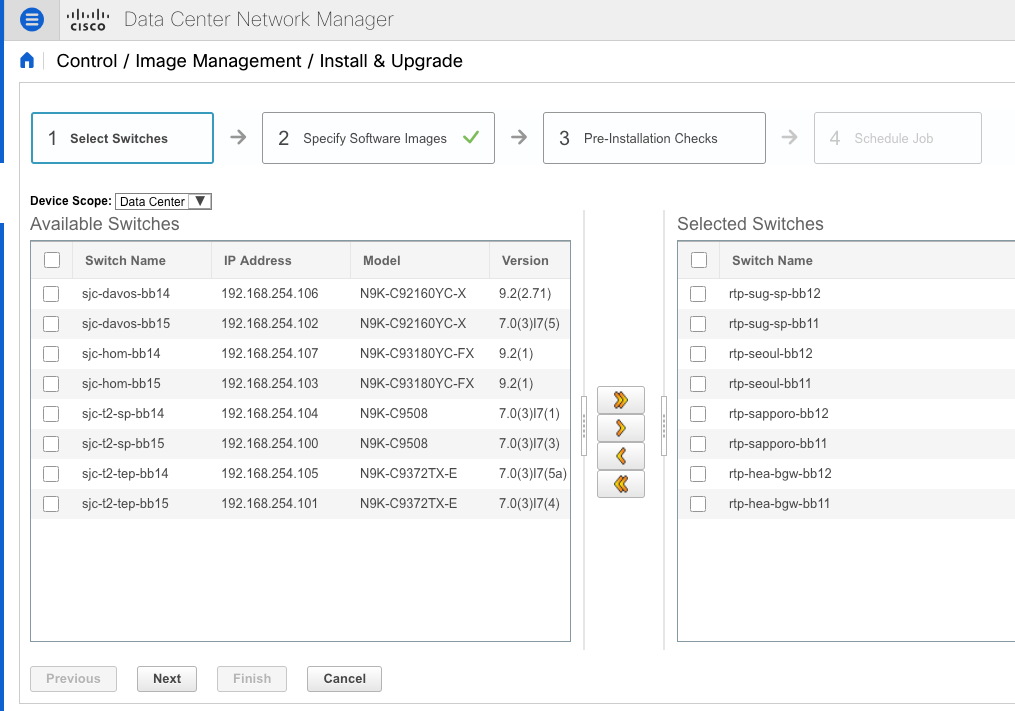

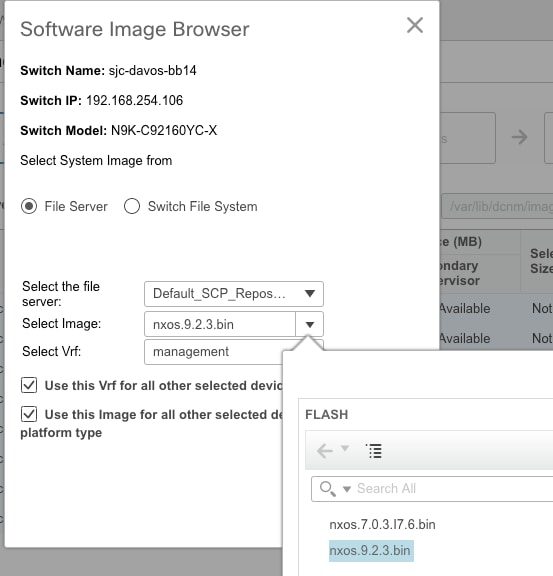

ステップ 5スイッチをアップグレードするNX-OSバージョンを選択します(ベストプラクティスとして、すべてのスイッチを同じNX-OSバージョンにアップグレードします)。

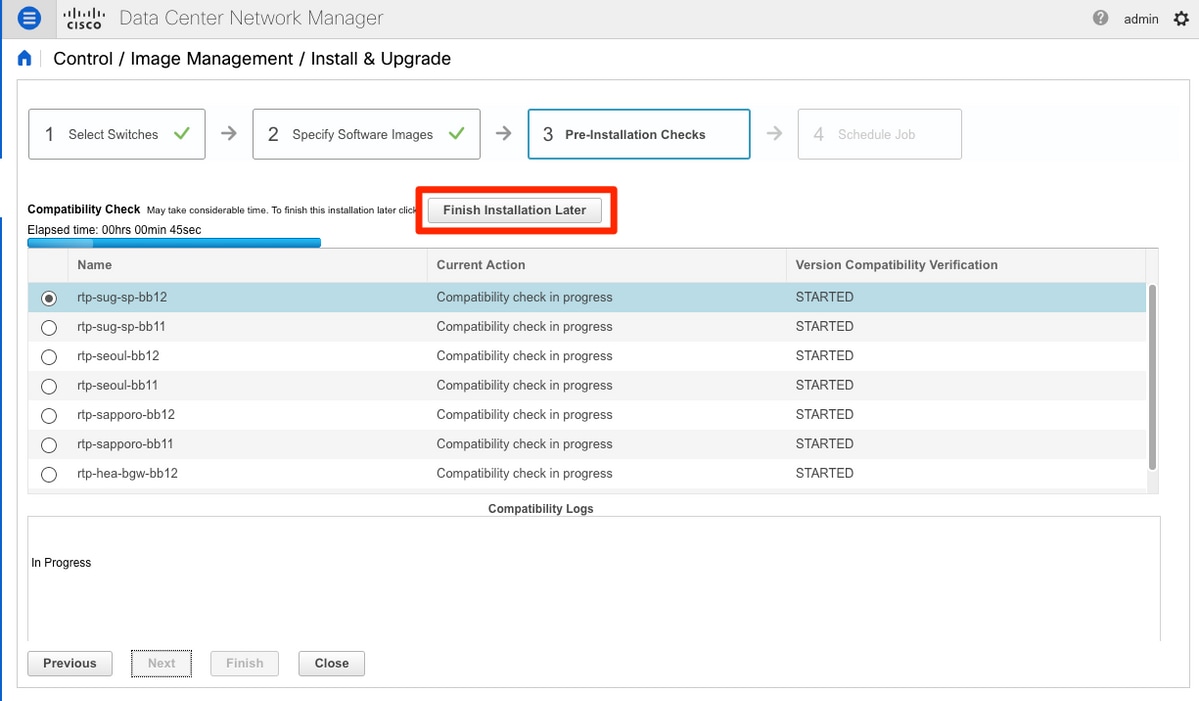

ステップ 6Nextをクリックすると、DCNMはインストール前のチェックによってスイッチを実行します。このウィンドウはかなり時間がかかる場合があるため、代わりにFinish Installation Laterを選択して、外出中にアップグレードをスケジュールすることもできます。

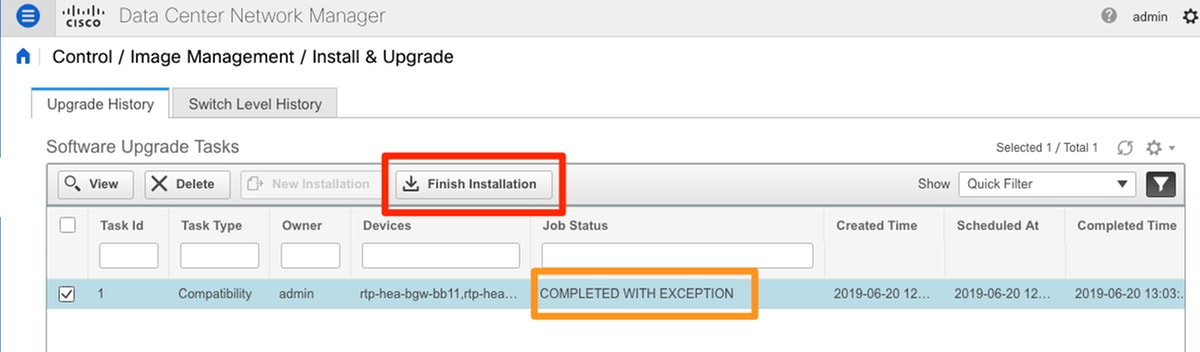

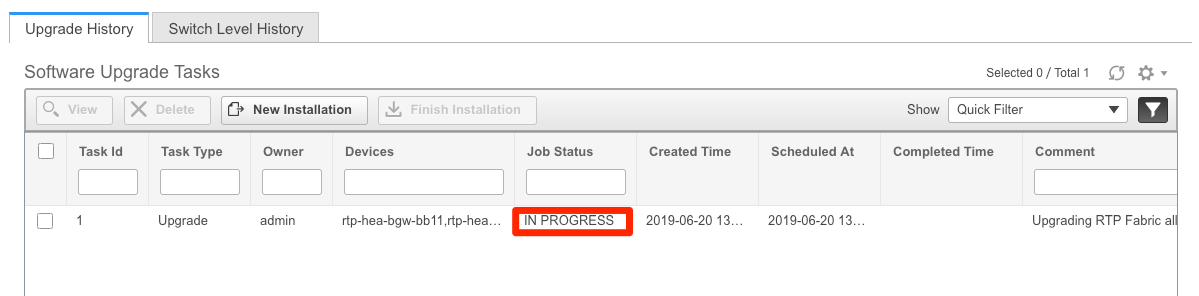

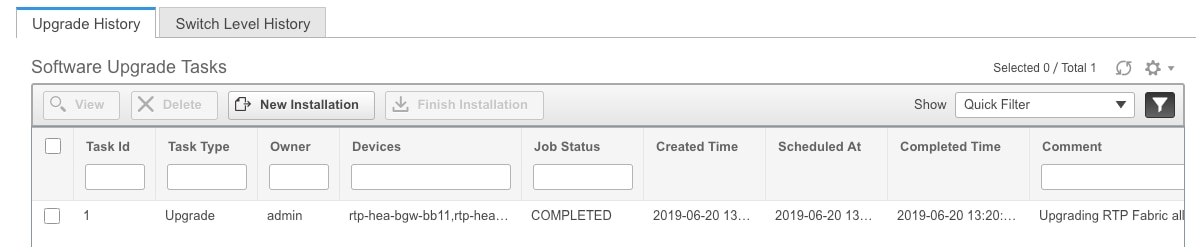

完了すると、タスクがキューに入れられ、次の図のように表示されます。

注:上記のケースの例外は、RTPスイッチの1つにNX-OSイメージ用の十分な容量がなかったことです。

ステップ 7互換性が確認されたら、図に示すように、同じウィンドウでFinish Installationをクリックします。

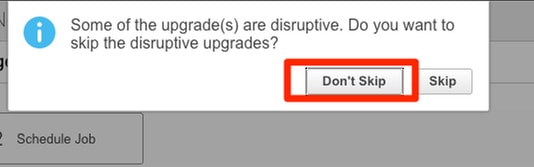

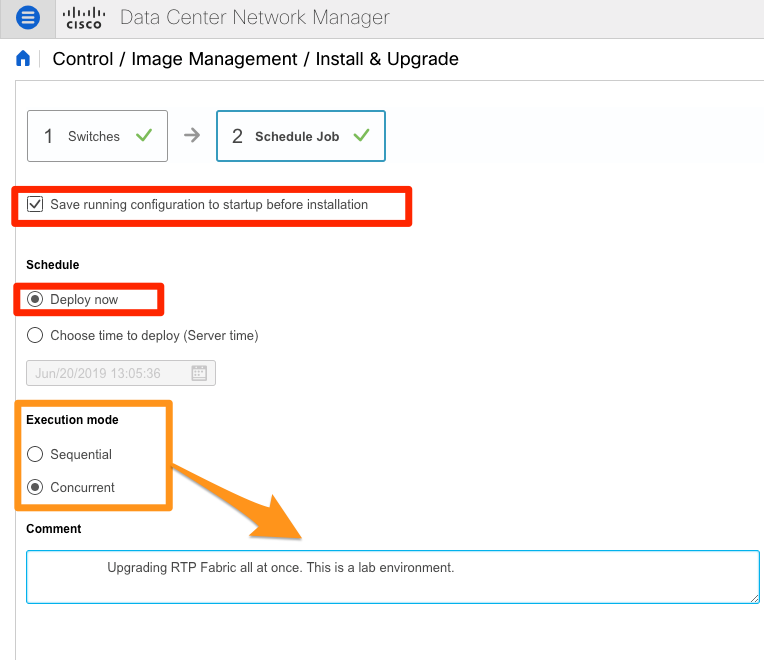

ステップ 8同時(すべて同時)に実行するアップグレードと、順番(一度に1つずつ)に実行するアップグレードを選択できます。 これはラボ環境なので、「selected」が「concurrent」になっています。

次の図に示すように、タスクが作成され、IN PROGRESSと表示されます。

イメージを選択する別の方法を次に示します。

エンドポイントロケータのインストール

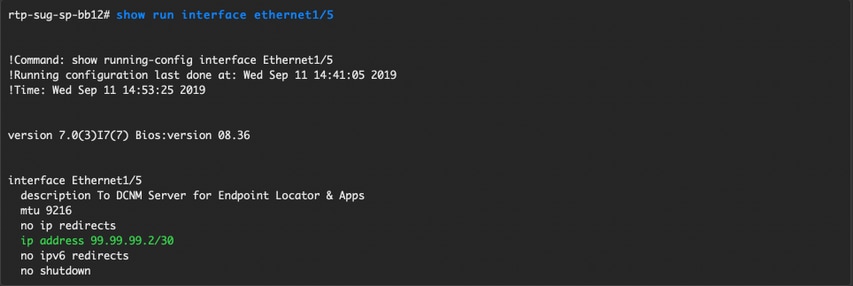

DCNMアプリケーションが正しく動作するには、DCNMサーバと前面パネルポートの間に、ファブリック内のNexus 9000の1つに対するインバンド接続が必要です。この例では、DCNMサーバはRTPファブリック内の一方のスパインのEthernet1/5に接続されています。

ステップ 1:このCLIは、Nexus 9000に手動で追加されます。

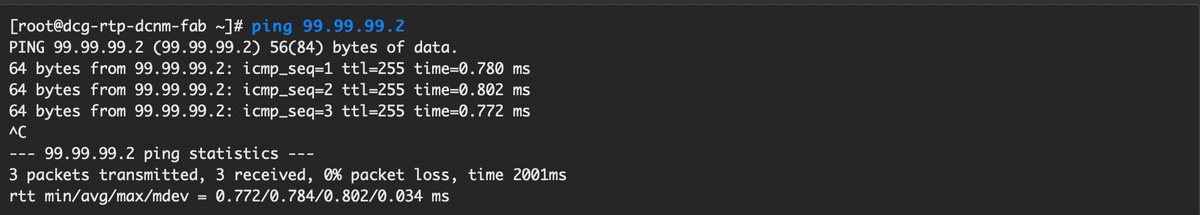

ステップ 2このポイントツーポイント接続でDCNMサーバにpingできることを確認します(逆も可)。

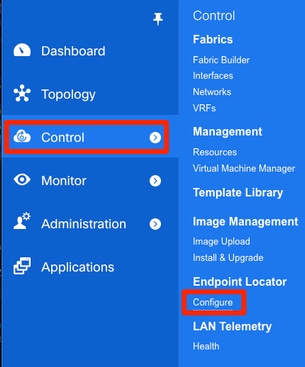

ステップ 3図に示すように、DCNM GUI > Control > Endpoint Locator > Configureの順に移動します。

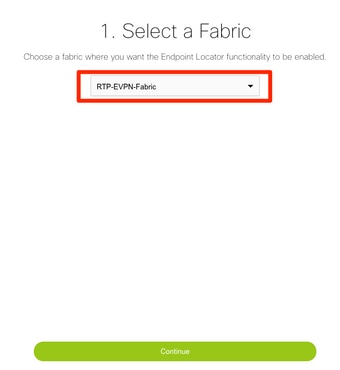

ステップ 4図に示すように、エンドポイントロケータを有効にするファブリックを選択します。

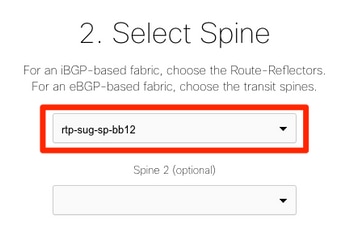

ステップ 5図に示すように、スパインを選択します。

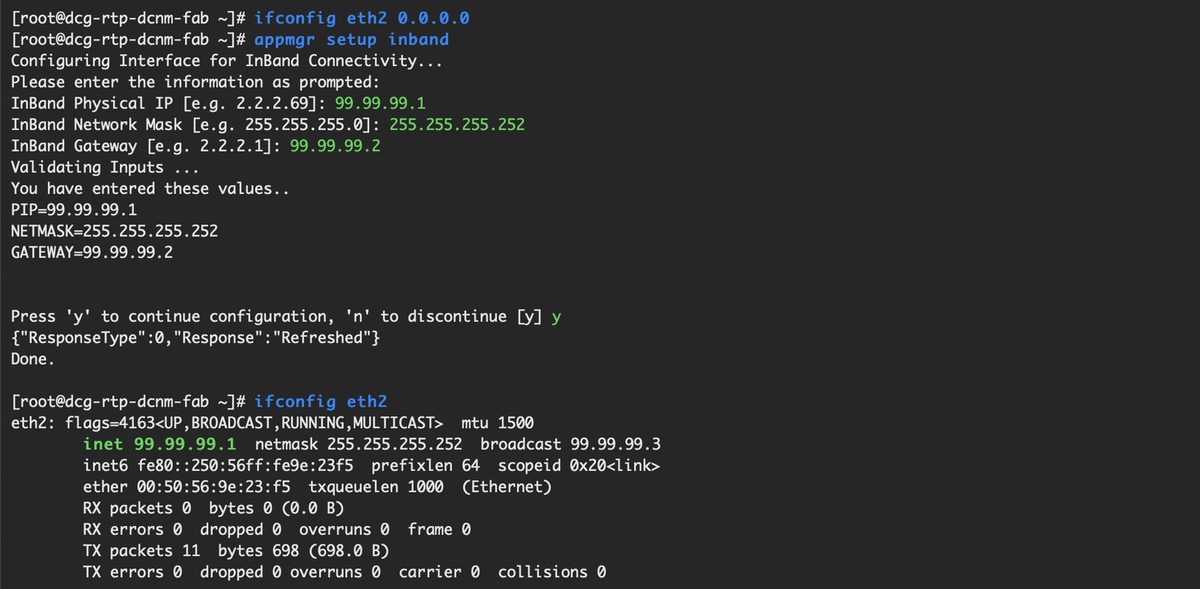

ステップ 6: (任意)。 次の手順に進む前に、eth2のIPがDCNMサーバ上で次のCLIを使用して元の導入から変更されています(DCNMサーバの新規インストール時に設定された元のIPが正しい場合、この手順は必要ありません)。

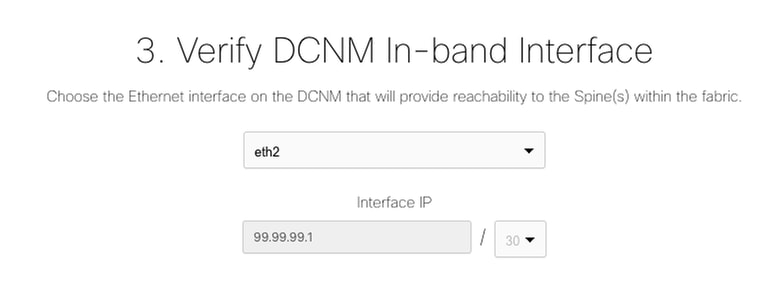

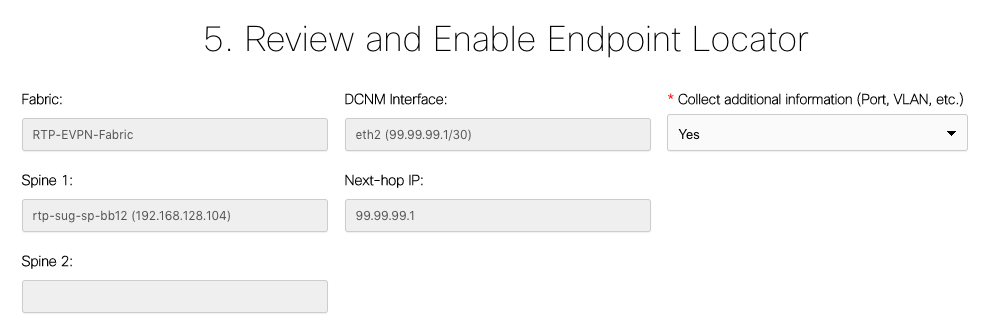

ステップ 7インバンドインターフェイスの設定を確認します。これは、前の手順で設定した内容と一致している必要があります。

ステップ 8設定を確認したら、Configureをクリックします。このステップには数分かかることがあります。

完了すると、図に示すように通知が表示されます。

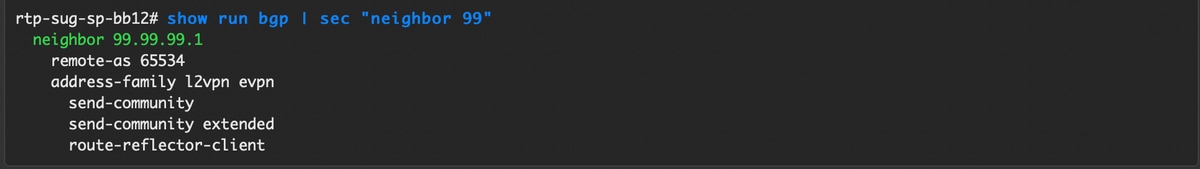

DCNMは、L2VPN EVPNファミリ内の選択されたスパインにBGPネイバーを設定しています。

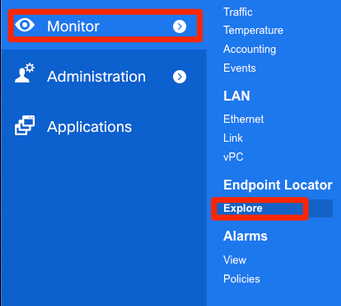

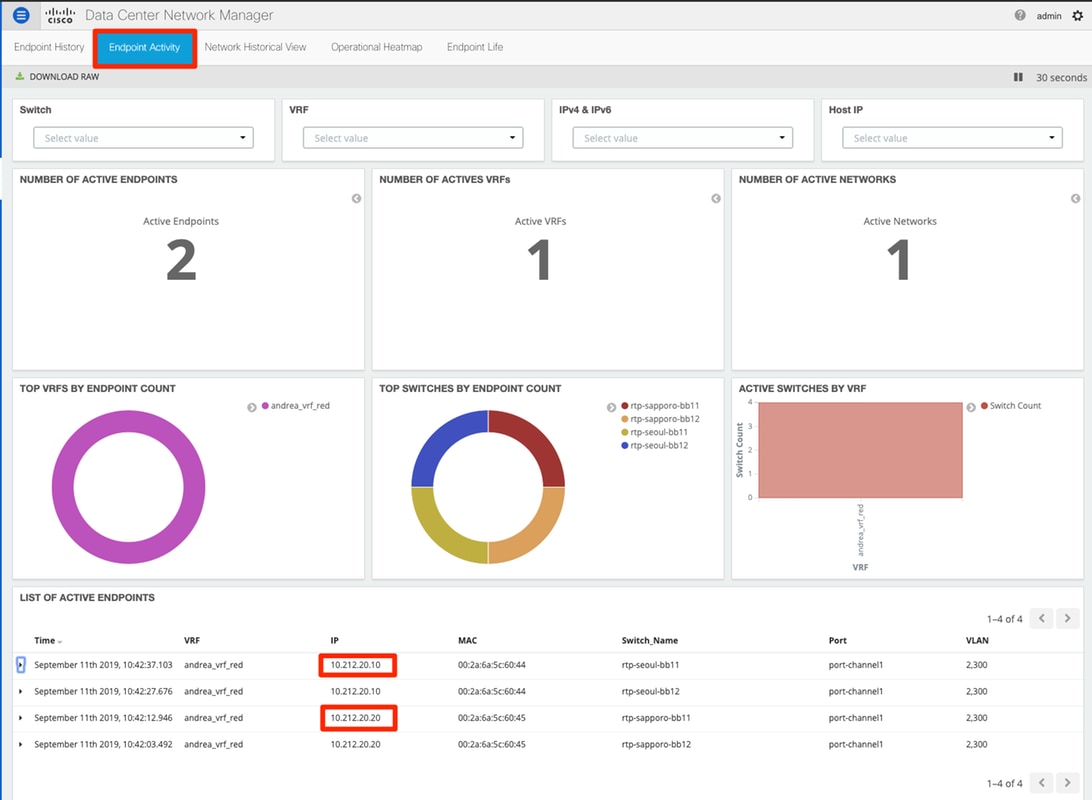

ステップ 9これで、エンドポイントロケータを使用できるようになります。Monitor > Endpoint Locator > Exploreの順に移動します。

この例では、RTPファブリック内のローカルpingテスト用に設定された2台のホストを確認できます。

この展開中に発生した問題

不適切なケーブル配線

スイッチのペアに不適切なケーブル配線があり、vPCピアリンクポートチャネル500のバンドリングエラーの原因となった。例:

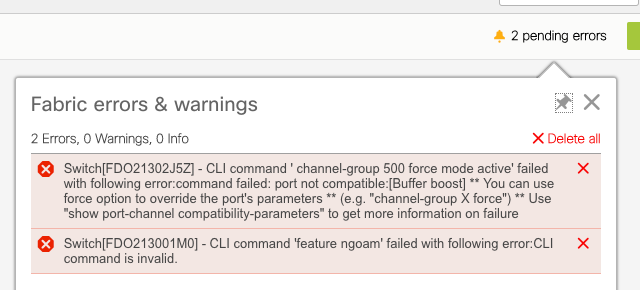

ステップ 1:Control >Fabric Builderの順に戻り、エラーを確認します。

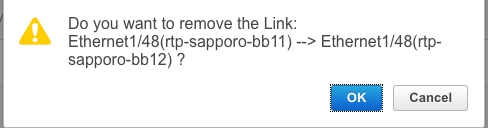

ステップ 2port-channel500コマンド失敗に関する最初のエラーについては、show cdp neighborsを使用して、vPCピアへの接続が10Gおよび40Gポート上にあった(互換性がない)ことを確認しました。 10Gポートを物理的に削除し、DCNMからもリンクを削除:

機能を設定できませんでした

「feature ngoam」の設定失敗に関する2つ目のエラーについて:スイッチが、「feature ngoam」をサポートする最新のNX-OSバージョンにアップグレードされており、再度Save & Deployをクリックします。両方の問題が解決されました。

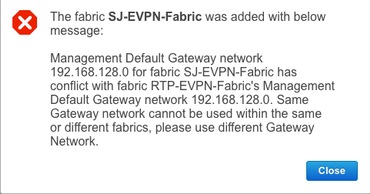

異なるファブリックの管理サブネットのオーバーラップ

2番目のファブリックが導入されている間、SJでは同じサブネットが使用されました(物理的に分離している場合は問題ありません)。ただし、DCNMでは競合がログに記録され、POAPは失敗します。これは、SJファブリックが異なる管理VLANに配置され、DHCPアドレスの範囲が変更されることで解決されます。

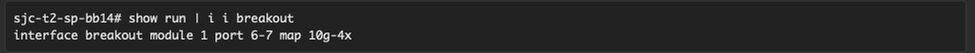

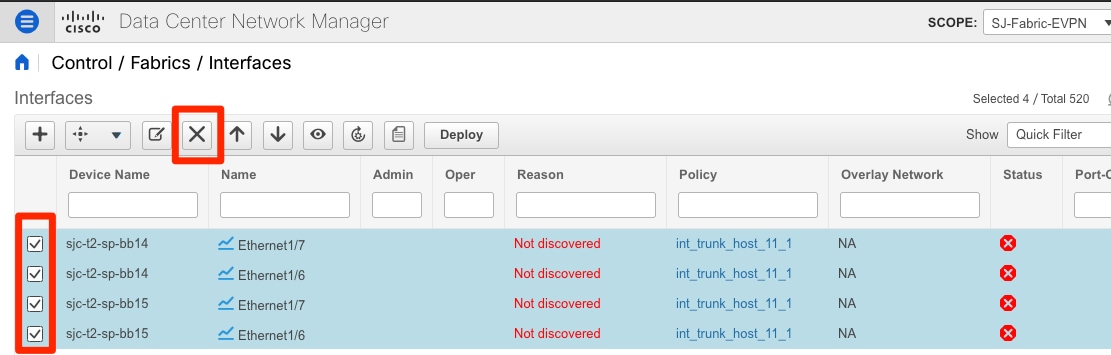

ブレイクアウトインターフェイス

ステップ 1:一部のスイッチ(トポロジを参照)のブレークアウトインターフェイスとして、このCLIはT2スパイン用に手動で追加されました。

ステップ 2Control > Interfacesの順に移動し、親インターフェイスを削除します。

実際に使用されるインターフェイスは、Eth1/6/1-4とEth1/7/1-4です。これを修正しないと、後で保存と展開が失敗します。DCNM自体(+記号の横にあるボタン。ただし、この記事では説明しません)を通じてブレークアウトを実行する方法があります

サポートされていない機能に導入された場合のファブリックエラー

SJファブリック内の一部のシャーシ(T2)はTRMをサポートしていないため、DCNMがこの設定をプッシュしようとしたときに先に進むことができませんでした。TRMのサポート:https://www.cisco.com/c/en/us/td/docs/switches/datacenter/nexus9000/sw/92x/vxlan-92x/configuration/guide/b-cisco-nexus-9000-series-nx-os-vxlan-configuration-guide-92x/b_Cisco_Nexus_9000_Series_NX-OS_VXLAN_Configuration_Guide_9x_chapter_01001.html#concept_vw1_syb_zfb

Network and VRF Editウィンドウの下のTRM Enableボックスのチェックマークを外すと、次の図のようになります。

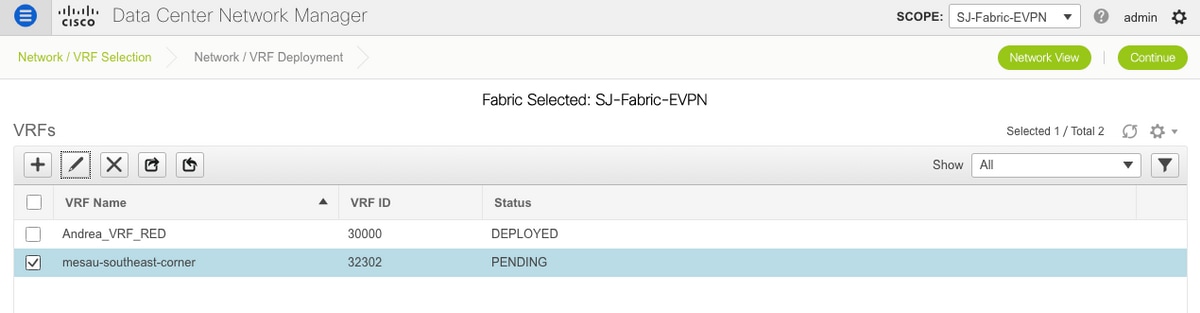

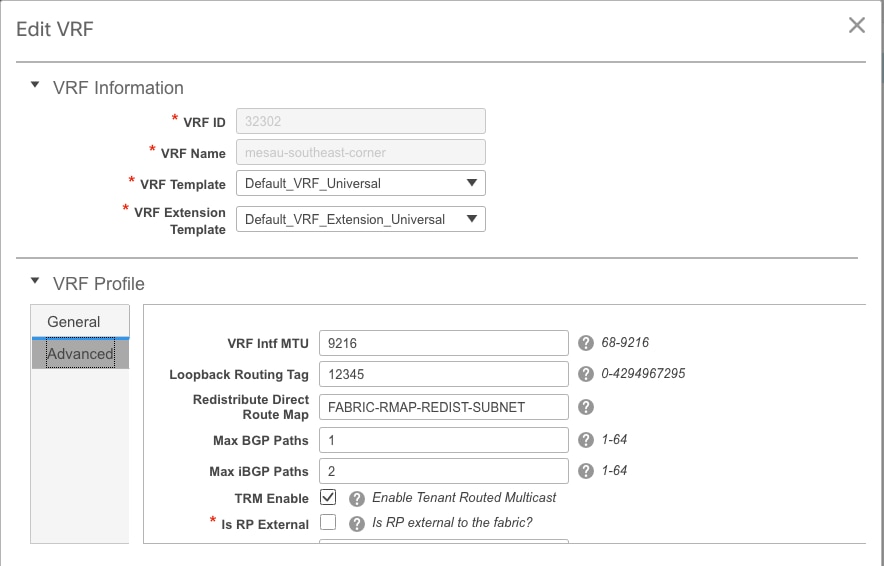

Control > Fabric Builder > VRFで同じプロセスを繰り返します。

前述したように、Continue、Deployの順にクリックします。

DCNM 11.2の新機能

-

vPC のファブリックペアリング

-

eBGPベースルーテッドファブリック

-

EVPNを有効にする

-

-

Easy Fabricの既存環境の機能拡張

-

境界スパイン/境界ゲートウェイスパイン

-

PIM双方向

-

テナントルーテッドマルチキャスト

-

-

外部DHCPサーバを使用するDay-0/Bootstrap

Day 2運用:

-

Network Insightsリソース

-

ネットワーク分析アドバイザー

-

外部アクセスのIPv6サポート(eth0)

-

UCS-FIによるVMMコンピューティングの可視化

-

トポロジビューの機能拡張

-

11.0/11.1からのインラインアップグレード

DCNMを使用した従来のvPCからMCTを使用しないvPCへの変更:

MCTレスvPCの利点:

-

物理ポートを無駄にせずにデュアルホーミングソリューションを強化

-

従来のvPCの特性を維持

-

PIPを使用したシングルホームエンドポイント向けの最適化されたルーティング

関連情報

- Cisco DCNM LANファブリックコンフィギュレーションガイド、リリース11.2(1)

https://www.cisco.com/c/en/us/td/docs/switches/datacenter/sw/11_2_1/config_guide/lanfabric/b_dcnm_fabric_lan/control.html - 章:VXLAN BGP EVPNファブリックでのボーダープロビジョニングの使用例 – マルチサイト

https://www.cisco.com/c/en/us/td/docs/switches/datacenter/sw/11_2_1/config_guide/lanfabric/b_dcnm_fabric_lan/border-provisioning-multisite.html - ホワイトペーパー:NextGen DCI with VXLAN EVPN Multi-Site Using vPC Border Gateways

https://www.cisco.com/c/en/us/products/collateral/switches/nexus-9000-series-switches/whitepaper-c11-742114.html#_Toc5275096 - 第1章:DCNMアプリケーション

https://www.cisco.com/c/en/us/td/docs/switches/datacenter/sw/11_2_1/config_guide/lanfabric/b_dcnm_fabric_lan/applications.html

更新履歴

| 改定 | 発行日 | コメント |

|---|---|---|

1.0 |

19-Sep-2019

|

初版 |

シスコ エンジニア提供

- アンドレア・テスティーノシスコのエンジニアリング

シスコに問い合わせ

- サポート ケースをオープン

- (シスコ サービス契約が必要です。)

フィードバック

フィードバック