vManage GUI 또는 CLI를 사용하여 SD-WAN 컨트롤러 업그레이드

다운로드 옵션

편견 없는 언어

본 제품에 대한 문서 세트는 편견 없는 언어를 사용하기 위해 노력합니다. 본 설명서 세트의 목적상, 편견 없는 언어는 나이, 장애, 성별, 인종 정체성, 민족 정체성, 성적 지향성, 사회 경제적 지위 및 교차성에 기초한 차별을 의미하지 않는 언어로 정의됩니다. 제품 소프트웨어의 사용자 인터페이스에서 하드코딩된 언어, RFP 설명서에 기초한 언어 또는 참조된 서드파티 제품에서 사용하는 언어로 인해 설명서에 예외가 있을 수 있습니다. 시스코에서 어떤 방식으로 포용적인 언어를 사용하고 있는지 자세히 알아보세요.

이 번역에 관하여

Cisco는 전 세계 사용자에게 다양한 언어로 지원 콘텐츠를 제공하기 위해 기계 번역 기술과 수작업 번역을 병행하여 이 문서를 번역했습니다. 아무리 품질이 높은 기계 번역이라도 전문 번역가의 번역 결과물만큼 정확하지는 않습니다. Cisco Systems, Inc.는 이 같은 번역에 대해 어떠한 책임도 지지 않으며 항상 원본 영문 문서(링크 제공됨)를 참조할 것을 권장합니다.

목차

소개

이 문서에서는 SD-WAN(Software-Defined Wide Area Network) 컨트롤러를 업그레이드하는 프로세스에 대해 설명합니다.

사전 요구 사항

요구 사항

다음 주제에 대한 지식을 보유하고 있으면 유용합니다.

- Cisco SD-WAN(소프트웨어 정의 WAN)

- Cisco Software Central

- software.cisco.com에서 컨트롤러 소프트웨어 다운로드

- CiscoDevNet/sure를 업그레이드하기 전에 AURA 스크립트를 실행합니다. SD-WAN 업그레이드 준비 상태 경험

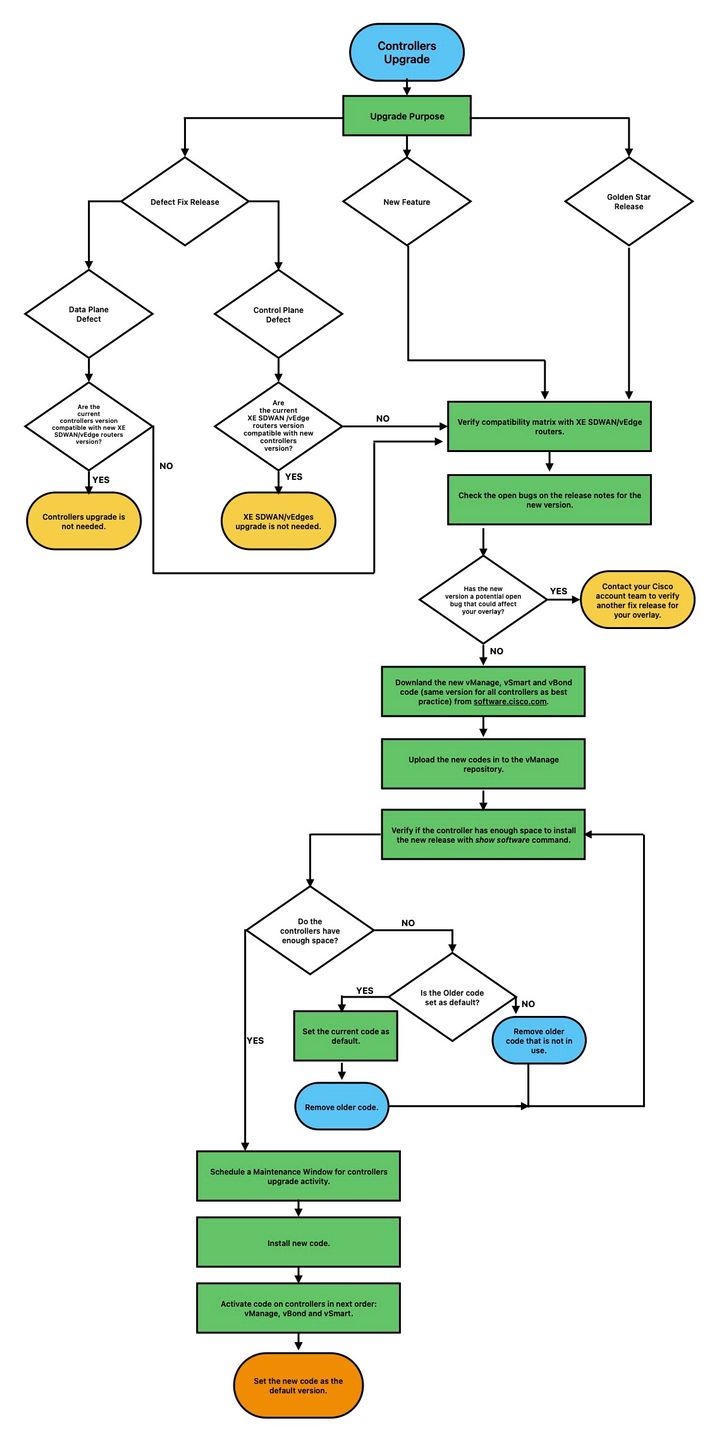

컨트롤러 업그레이드를 계획하는 데에는 다음과 같은 여러 가지 이유가 있습니다.

- 새로운 기능이 포함된 새로운 릴리스입니다.

- 알려진 경고/버그를 수정합니다.

- 보류 릴리스.

참고: 릴리스가 연기된 경우 가능한 한 빨리 gold-star 버전으로 업그레이드하는 것이 좋습니다. 지연 릴리스는 알려진 결함으로 인해 프로덕션 컨트롤러에서 권장되지 않습니다.

컨트롤러를 업그레이드할 때 다음 유용한 정보를 고려하십시오.

- SD-WAN 컨트롤러의 릴리스 정보를 확인합니다.

- Cisco vManage 업그레이드 경로를 확인합니다.

- Cisco SD-WAN 컨트롤러가 권장 컴퓨팅 리소스를 충족하는지 확인합니다.

- SD-WAN 제품의 End-of-Life 및 End-of-Sale 알림을 확인합니다.

참고: SD-WAN 컨트롤러를 업그레이드하려면 vManage > vBonds > vSmarts를 선택합니다.

사용되는 구성 요소

이 문서는 다음 소프트웨어 버전을 기반으로 합니다.

- Cisco vManage 20.12.6 및 20.15.4.1

- Cisco vBond 및 vSmart 20.12.16 및 20.15.4.1

이 문서의 정보는 특정 랩 환경의 디바이스를 토대로 작성되었습니다. 이 문서에 사용된 모든 디바이스는 초기화된(기본) 컨피그레이션으로 시작되었습니다. 현재 네트워크가 작동 중인 경우 모든 명령의 잠재적인 영향을 미리 숙지하시기 바랍니다.

컨트롤러 업그레이드 전에 수행할 사전 검사

vManage 백업

- 클라우드를 호스팅하는 경우 최신 백업이 완료되었는지 확인하거나 다음 단계에서 설명한 대로 config db의 백업을 시작합니다.

- SSP 포털에서 현재 백업을 보고 온디맨드 스냅샷을 트리거할 수 있습니다. 자세한 지침은 여기를 참조하십시오.

- 온프레미스:

- config-db 백업 수행

- 모든 컨트롤러의 VM 스냅샷입니다.

vManage# request nms configuration-db backup path /home/admin/db_backup

successfully saved the database to /home/admin/db_backup.tar.gz

- on-prem인 경우 show running-config를 수집하고 이를 로컬에 저장합니다.

- 온-프렘인 경우 configuration-db(neo4j) 사용자 이름 및 비밀번호를 알고 정확한 현재 버전에 알립니다.

컨피그레이션 DB 자격 증명을 검색하는 데 도움이 필요한 경우 Cisco TAC에 문의할 수 있습니다.

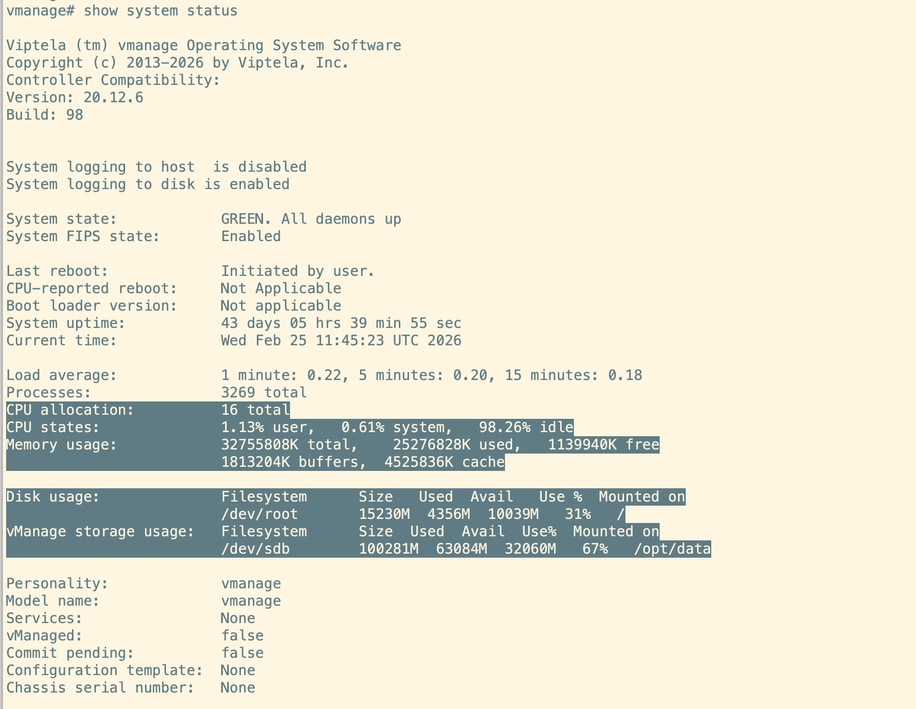

vManage의 시스템 컴퓨팅

참고: 이 검사는 vBonds 및 vSmarts에도 적용됩니다.

각 vManage 노드의 CLI에서 show system status 명령을 실행합니다. 필요한 컴퓨팅이 vManage 노드에 매핑되었는지 확인합니다. Compute Guide를 참조하십시오.

AURA 검사 실행

- CiscoDevNet/sure에서 AURA를 실행하려면 다음 단계를 다운로드하고 따르십시오. SD-WAN 업그레이드 준비 상태 경험

- 자세한 단계는 이 가이드를 참조하십시오. 업그레이드 전에 Aura 구축을 구성합니다.

- AURA 보고서에서 실패한 검사와 관련된 문제를 해결하려면 TAC SR에게 문의합니다.

- 20.11.x 이후부터는 이미지가 활성화되어 vManage UI를 사용할 때 vManage에서 AURA가 자동으로 실행됩니다.

디스크 공간 사용률 vManage

업그레이드를 시작하기 전에 세 가지 주요 파티션(/boot, /rootfs.rw, /opt/data)의 디스크 사용량이 60% 이하인지 확인하십시오.

정리를 위해 불필요한 사용자 복사 파일 또는 압축되지 않은 로그 파일을 찾아 제거합니다.

관리 기술 파일, 힙 덤프, Neo4j 백업, 스레드 덤프 또는 디스크 공간을 사용하는 임시 파일을 삭제합니다.

어떤 파일을 안전하게 삭제할 수 있는지 확실하지 않으면 Cisco TAC 케이스를 열어 지원을 받으십시오.

컨트롤러로 전송/vBond로 전송 완료 확인

vManage UI에서 Configuration(컨피그레이션) —> Certificates(인증서) —> Controllers(컨트롤러)로 이동하고 send to vBond(vBond로 보내기)를 선택합니다

vManage 통계 수집 간격 확인

Cisco는 Administration > Settings에서 Statistics Collection Interval(통계 수집 간격)을 30분의 기본 타이머로 설정하는 것을 권장합니다.

참고: Cisco에서는 업그레이드 전에 vSmarts 및 vBond를 vManage 템플릿에 연결하는 것이 좋습니다.

모든 vManage 노드에서 NMS 진단 확인

"request nms all diagnostics" 명령을 실행하고 모든 NMS 서비스에 대한 NPing이 성공했는지 확인합니다. vManage 클러스터의 경우 모든 vManage 노드에서 이러한 검사를 수행해야 합니다.

참고: 6노드 vManage 클러스터에서 configuration-db는 3개 노드에서만 실행됩니다.

configuration-db에 대한 진단 유틸리티를 확인합니다.

다음과 같이 configuration-db 특성을 가져올 수 있는지 확인합니다.

모든 vManage 노드가 "neo4j" 및 "system" 모두에 대해 Neo4j 클러스터 상태에 나열되어 있는지 확인합니다.

스키마 유효성 검사에 성공하고 Neo4j 노드가 격리되지 않았는지 확인합니다.

전체 출력을 검토하고 오류 또는 장애가 발견되면 업그레이드를 진행하기 전에 TAC에 문의하십시오.

vManage 노드의 디스크 공간 사용량 확인

/rootfs.ro을 제외하고 다른 디스크 파티션의 사용 비율이 60%를 넘지 않아야 합니다. 모든 vManage 노드에서 이를 확인합니다.

vSmart 및 vBond의 디스크 공간 확인

df -kh 명령을 사용합니다. | vShell에서 grep 부팅을 수행하여 디스크의 크기를 확인합니다.

controller:~$ df -kh | grep boot

/dev/sda1 2.5G 232M 2.3G 10% /boot

controller:~$크기가 200MB보다 큰 경우 컨트롤러 업그레이드를 진행합니다.

크기가 200MB 미만인 경우 다음 단계를 수행합니다.

1. 현재 버전이 show software 명령에 나열된 버전인지 확인합니다. 이 검사는 vManage, vBond 및 vSmart의 3개 컨트롤러 모두에 적용됩니다.

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

------------------------------------------------------------------------------

20.12.6 true true false auto 2023-05-02T16:48:45-00:00

20.9.1 false false true user 2023-05-02T19:16:09-00:00

2. show software version 명령에서 현재 버전이 기본값으로 설정되어 있는지 확인합니다. 이 검사는 vManage, vBond 및 vSmart의 세 컨트롤러 모두에 적용됩니다.

controller# request software set-default 20.12.6

status mkdefault 20.11.1: successful

controller#

3. 더 많은 버전이 나열되면, 명령 요청 소프트웨어 remove <version>에서 활성 상태가 아닌 버전을 제거합니다. 이렇게 하면 업그레이드를 진행할 수 있는 공간이 늘어납니다. 이 검사는 vManage, vBond 및 vSmart의 세 컨트롤러 모두에 적용됩니다.

controller# request software remove 20.9.1

status remove 20.9.1: successful

vedge-1# show software

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

------------------------------------------------------------------------------

20.12.6 true true false auto 2023-05-02T16:48:45-00:00

controller#

4. 디스크 공간이 200MB보다 큰지 확인합니다. 그렇지 않은 경우 계속 진행하여 TAC SR을 엽니다.

Before 및 After 명령

업그레이드 전후에 다음 명령을 실행하여 컨트롤러가 제대로 통합되었는지 확인합니다.

-

제어 연결 표시

각 컨트롤러가 다른 모든 컨트롤러(풀 메시)와 활성 제어 연결을 갖는지 확인합니다. -

show omp peers(vSmart에만 해당)

각 vSmart 컨트롤러에서 OMP 피어 수를 확인합니다. -

show omp summary(vSmart에만 해당)

전반적인 OMP 상태 및 피어 정보를 확인합니다. -

실행 중인 정책 표시(vSmart에만 해당)

원하는 모든 정책이 활성 상태이고 컨트롤러에서 표시되는지 확인합니다.업그레이드 전후에 이러한 명령의 출력을 검토하여 네트워크 안정성과 적절한 컨버전스를 보장합니다.

컨트롤러 업그레이드 워크플로

vManage 클러스터 업그레이드

클러스터 업그레이드의 경우 Cisco SD-WAN 시작 가이드 - 클러스터 관리 [Cisco SD-WAN] - Cisco 설명서에 설명된 단계를 수행해야 합니다.

참고: vManage 클러스터 업그레이드는 데이터 네트워크에 영향을 미치지 않습니다. 독립형 vManage의 경우 vManage UI를 사용하여 새 소프트웨어를 설치하고 활성화할 수 있습니다. vManage 클러스터의 경우, 아래 CLI를 통한 SD-WAN 컨트롤러 업그레이드 섹션에 설명된 대로 vManage UI를 사용하여 소프트웨어를 설치하고 vManage CLI를 사용하여 소프트웨어 활성화 < > 요청 소프트웨어를 사용하여 소프트웨어를 활성화하는 것이 좋습니다.

주의: 클러스터를 업그레이드할 때 질문이나 문제가 있는 경우, 계속 진행하기 전에 TAC에 문의하십시오.

vManage GUI(Graphic User Interface)를 통해 SD-WAN 컨트롤러 업그레이드

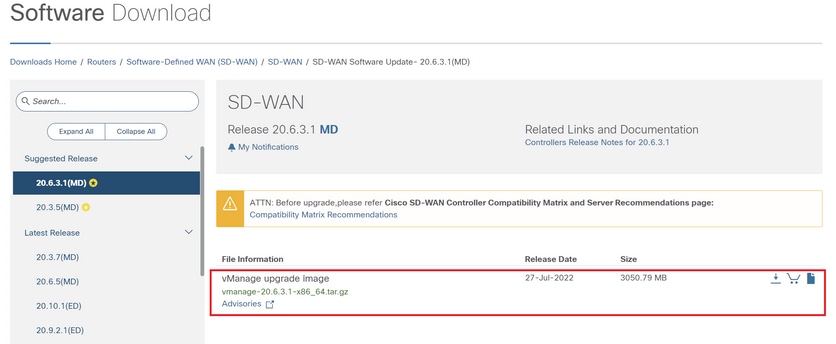

1단계. vManage 리포지토리에 소프트웨어 이미지를 업로드합니다.

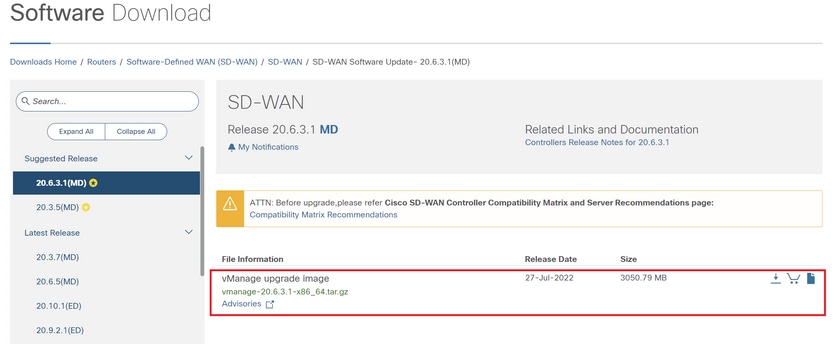

Software Download(소프트웨어 다운로드)로 이동하여 vManage에 필요한 소프트웨어 버전 이미지를 다운로드합니다.

참고: 컨트롤러에는 두 가지 유형의 이미지가 있습니다. 새로운 구축 및 업그레이드. 이 설명서의 범위에 따라 다운로드할 이미지는 업그레이드 이미지여야 합니다.

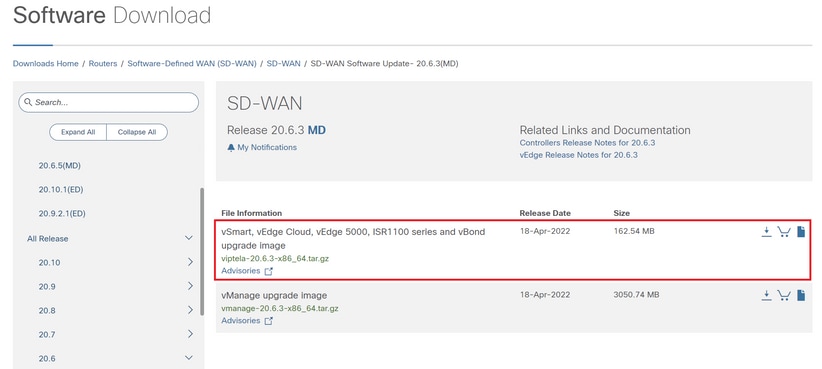

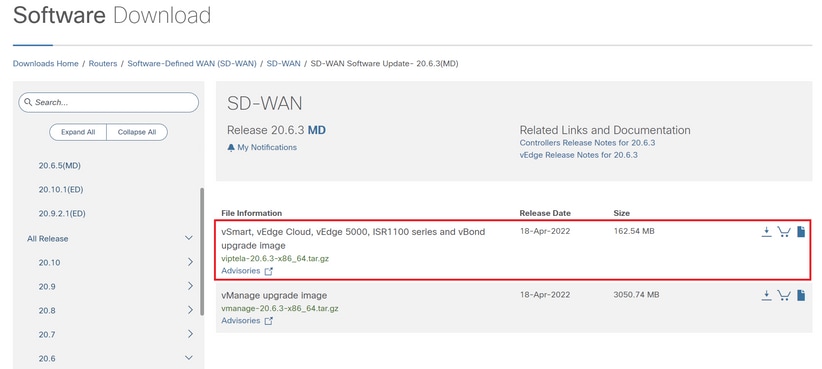

Software Download(소프트웨어 다운로드)로 이동하여 vBond 및 vSmart의 소프트웨어 버전 이미지를 다운로드합니다.

참고: vBond와 vSmart의 업그레이드 이미지가 동일합니다.

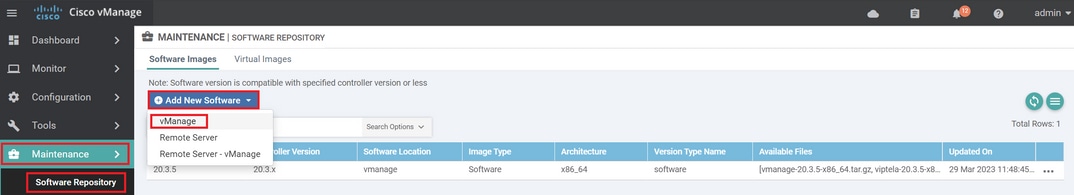

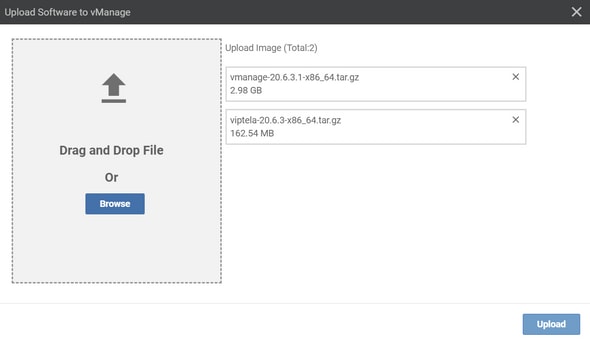

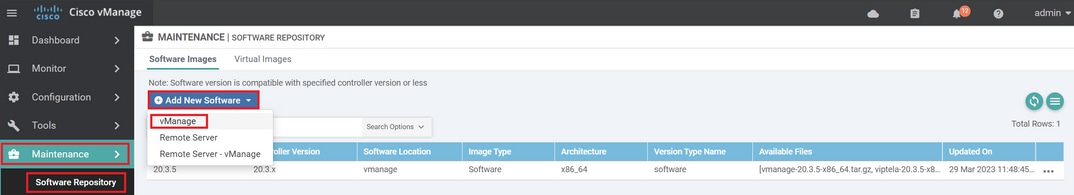

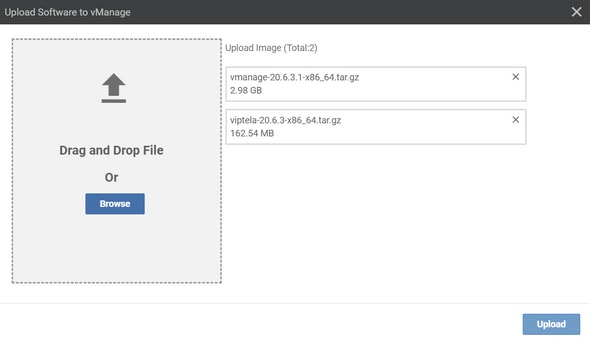

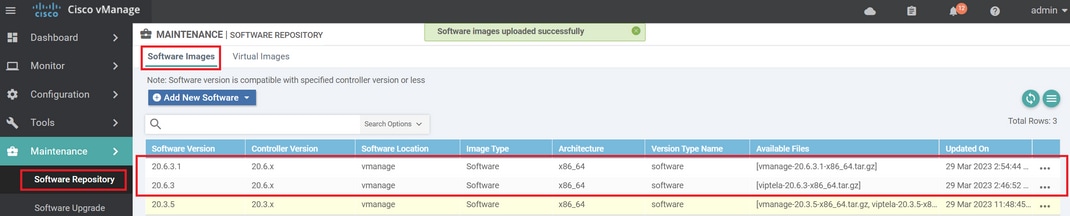

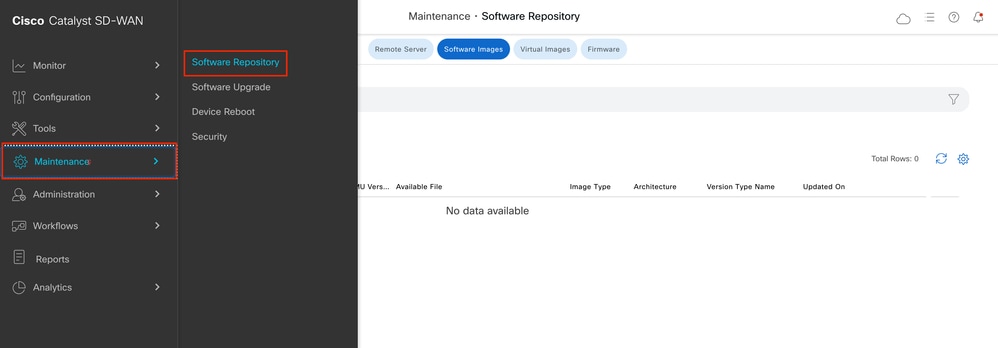

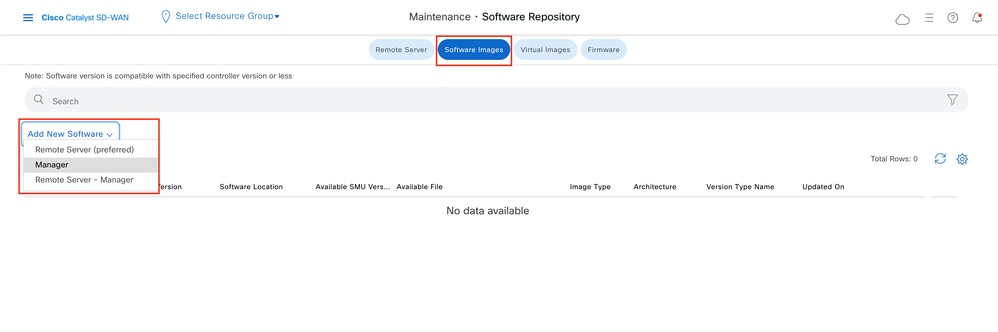

새 이미지를 업로드하려면 Maintenance(유지 관리) > Software Repository(소프트웨어 저장소) > Software Images(소프트웨어 이미지)로 이동합니다.

Add New Software(새 소프트웨어 추가)를 클릭하고 드롭다운 메뉴에서 vManage(vManage)를 선택합니다.

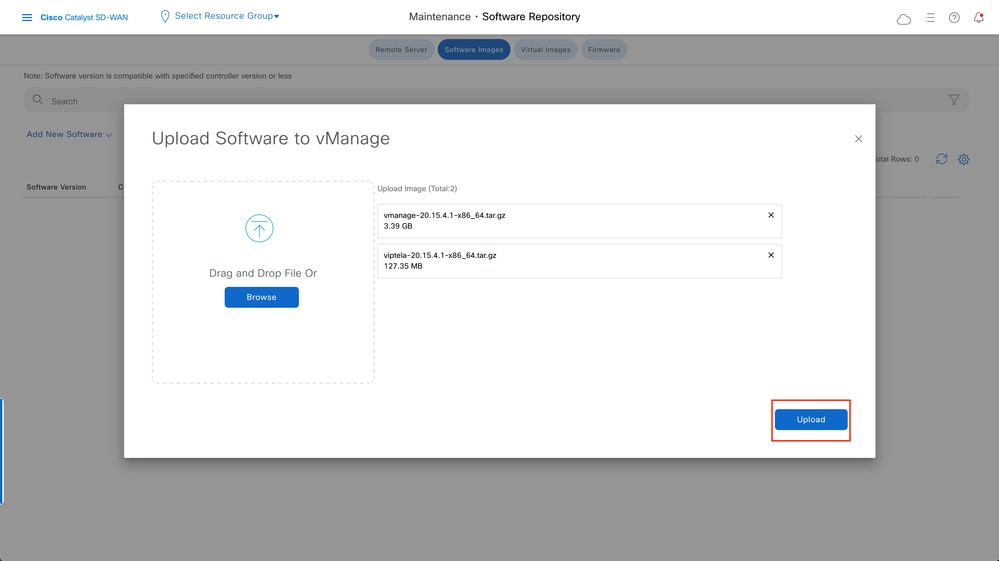

이미지를 선택하고 업로드를 클릭합니다.

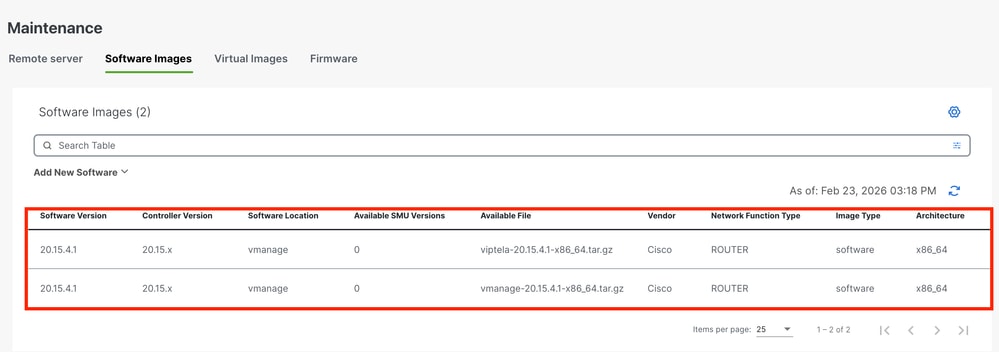

이미지가 업로드되면 Software Repository(소프트웨어 저장소) > Software Images(소프트웨어 이미지)에 나열되어 있는지 확인합니다.

2단계. 설치, 활성화 및 새 버전을 기본값으로 설정

이 단계에서는 설치, 활성화 및 새 버전을 기본값으로 설정하는 세 단계로 업그레이드를 수행하는 방법에 대해 설명합니다.

vManage

주의: vManage 업그레이드 전에 수행할 사전 검사를 검증했는지 확인합니다.

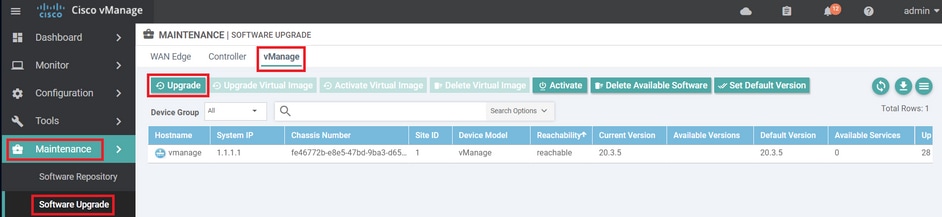

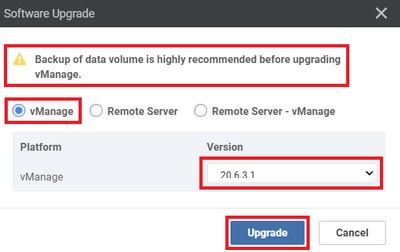

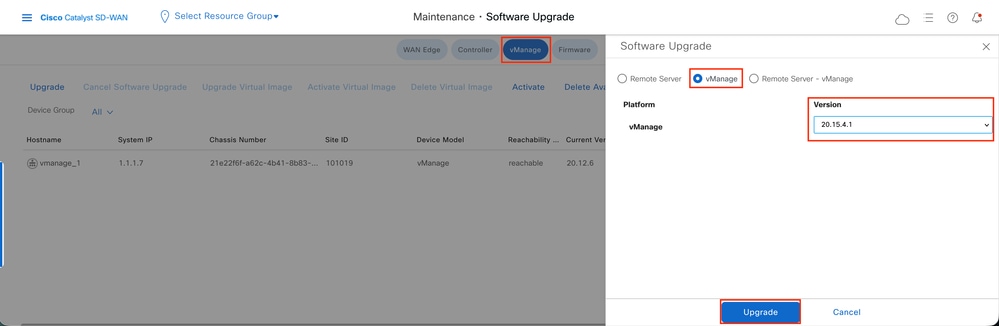

A단계. 설치

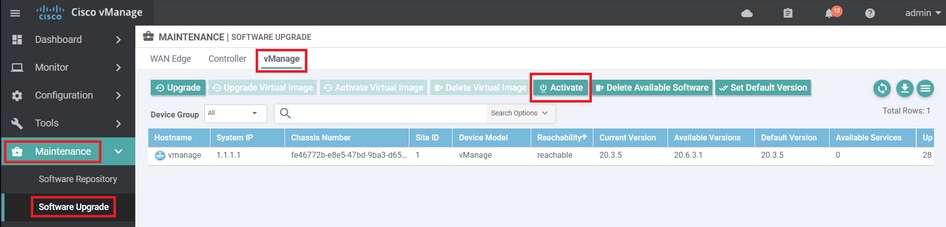

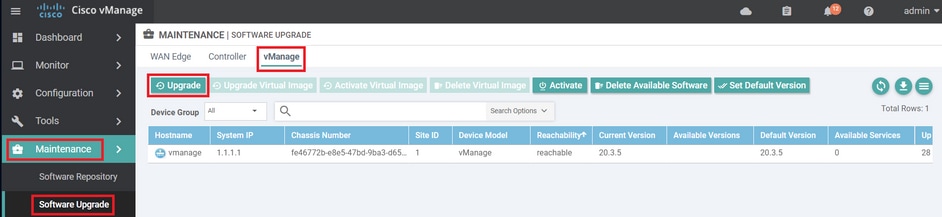

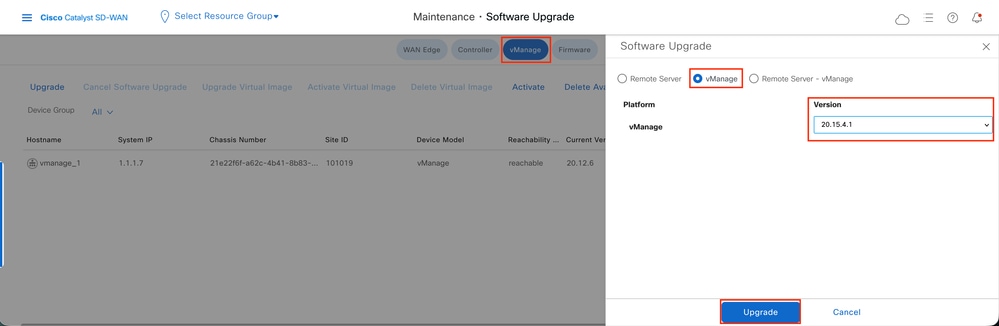

주 메뉴에서 Maintenance(유지 관리) > Software Upgrade(소프트웨어 업그레이드) > vManage(vManage)로 이동하고 Upgrade(업그레이드)를 클릭합니다.

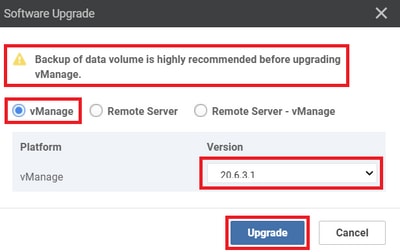

Software Upgrade 팝업 창에서 다음과 같이 합니다.

- vManage(vManage) 탭을 선택합니다.

- 버전 드롭다운 목록에서 업그레이드할 이미지 버전을 선택합니다.

- Upgrade(업그레이드)를 클릭합니다.

참고: 이 프로세스에서는 vManage의 재부팅을 실행하지 않으며 업그레이드에 필요한 디렉토리만 전송, 압축 해제 및 생성합니다.

참고: vManage 업그레이드를 진행하기 전에 데이터 볼륨을 백업하는 것이 좋습니다.

작업이 성공으로 표시될 때까지 작업의 상태를 확인합니다.

B단계. 활성화

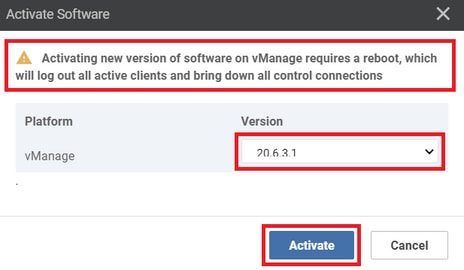

이 단계에서 vManage는 설치된 새 소프트웨어 버전을 활성화하고 자체 재부팅하여 새 소프트웨어로 부팅합니다.

Maintenance(유지 관리) > Software Upgrade(소프트웨어 업그레이드) > vManage(vManage)로 이동하고 Activate(활성화)를 클릭합니다.

새 버전을 선택하고 활성화를 클릭합니다.

참고: vManage가 재부팅되는 동안에는 GUI에 액세스할 수 없습니다. 전체 활성화에는 최대 60분이 소요될 수 있습니다.

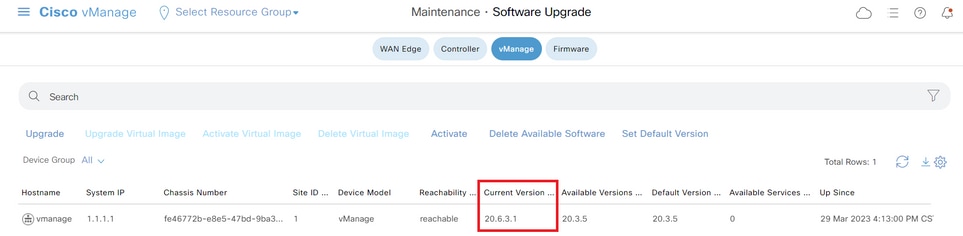

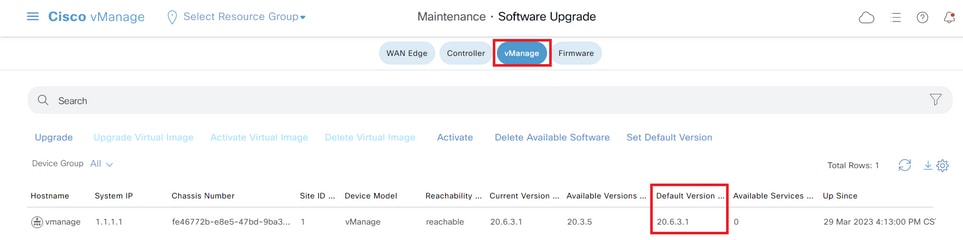

프로세스가 완료되면 로그인하고 Maintenance(유지 관리) > Software Upgrade(소프트웨어 업그레이드) > Manager(관리자)로 이동하여 새 버전이 활성화되어 있는지 확인합니다.

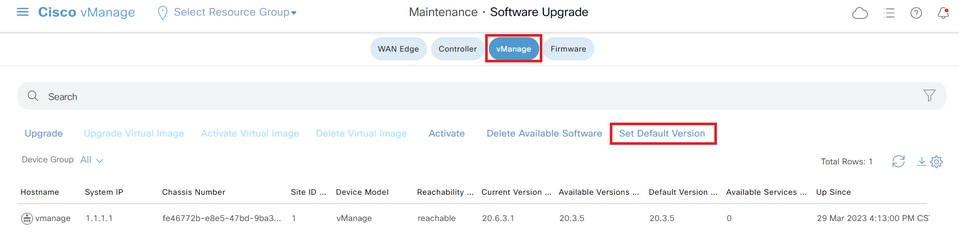

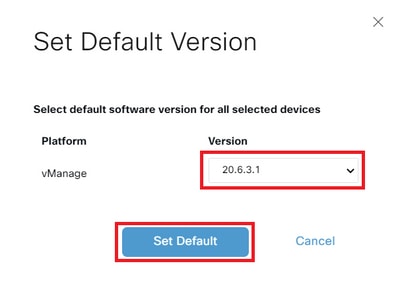

C단계. 기본 소프트웨어 버전 설정

소프트웨어 이미지를 Cisco SD-WAN 디바이스의 기본 이미지로 설정할 수 있습니다. 소프트웨어가 디바이스와 네트워크에서 원하는 대로 작동하는지 확인한 후 새 이미지를 기본값으로 설정하는 것이 좋습니다.

디바이스에서 공장 재설정이 수행되는 경우 디바이스는 기본값으로 설정된 이미지로 부팅합니다.

참고: vManage가 재부팅되면 이전 버전이 부팅되므로 새 버전을 기본값으로 설정하는 것이 좋습니다. 이로 인해 데이터베이스가 손상될 수 있습니다. 주 릴리스에서 이전 릴리스로 다운그레이드되는 버전은 vManage에서 지원되지 않습니다.

소프트웨어 이미지를 기본 이미지로 설정하려면 다음과 같이 하십시오.

- Maintenance(유지 관리) > Software Upgrade(소프트웨어 업그레이드) > Manager(관리자) > Software Image Actions(소프트웨어 이미지 작업)로 이동합니다.

- Set Default Version(기본 버전 설정)을 클릭하고 드롭다운 목록에서 새 버전을 선택한 다음 Set Default(기본값 설정)를 클릭합니다.

참고: 이 프로세스에서는 vManage의 재부팅을 수행하지 않습니다.

작업이 성공으로 표시될 때까지 작업의 상태를 확인합니다.

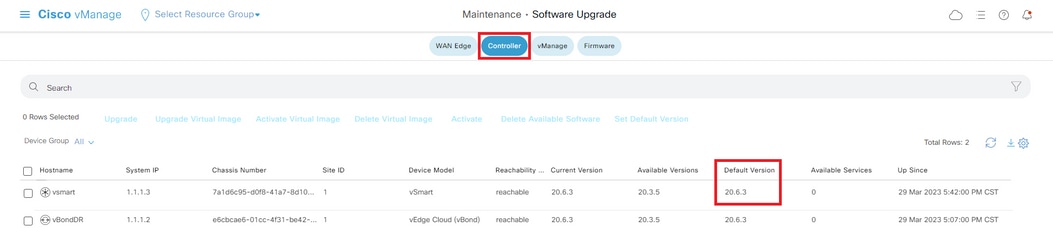

Default Version(기본 버전)을 확인하려면 Maintenance(유지 관리) > Software Upgrade(소프트웨어 업그레이드) > Manager로 이동합니다.

브이본드

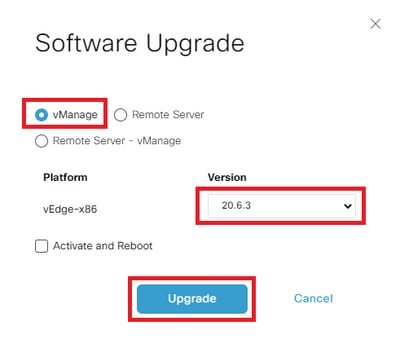

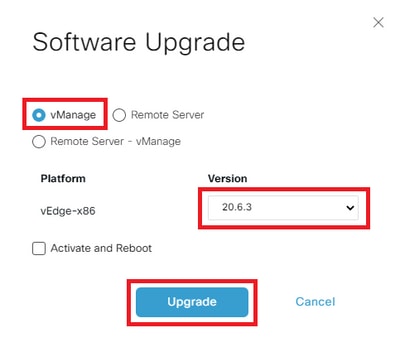

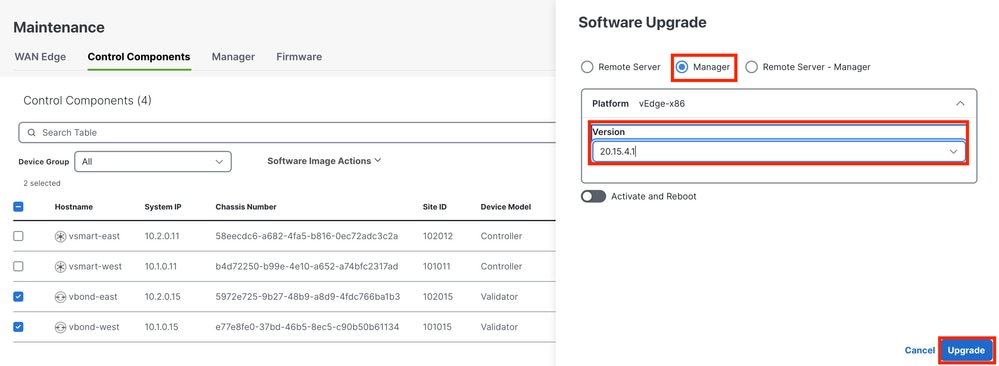

A단계. 설치

이 단계에서 vManage는 새 소프트웨어를 vBond로 전송하고 새 이미지를 설치합니다.

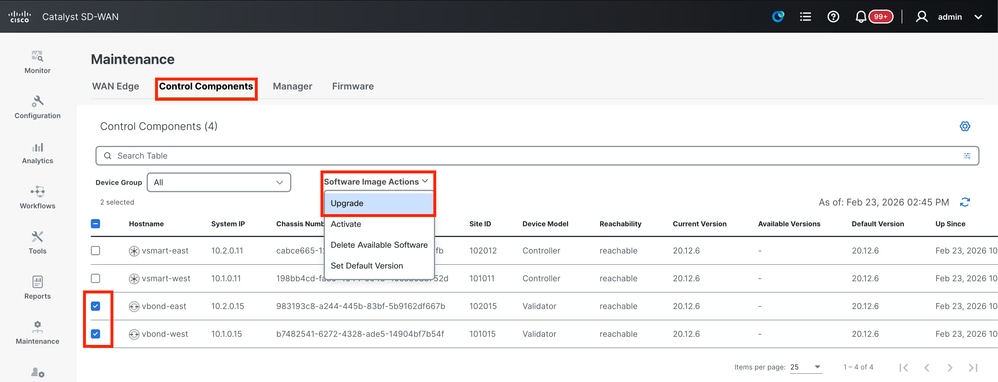

Maintenance(유지 관리) > Software Upgrade(소프트웨어 업그레이드) > Control Components(제어 구성 요소)로 이동하고 Upgrade(업그레이드)를 클릭합니다.

Software Upgrade 팝업 창에서 다음과 같이 합니다.

- Manage(관리) 탭을 선택합니다.

- 버전 드롭다운 목록에서 업그레이드할 이미지 버전을 선택합니다.

- 업그레이드를 클릭합니다.

참고: 이 프로세스에서는 vBond의 재부팅을 실행하지 않으며 업그레이드에 필요한 디렉토리만 전송, 압축 해제 및 생성합니다.

작업이 성공으로 표시될 때까지 작업의 상태를 확인합니다.

B단계. 활성화

이 단계에서 vBond는 설치된 새 소프트웨어 버전을 활성화하고 자체 재부팅하여 새 소프트웨어로 부팅합니다.

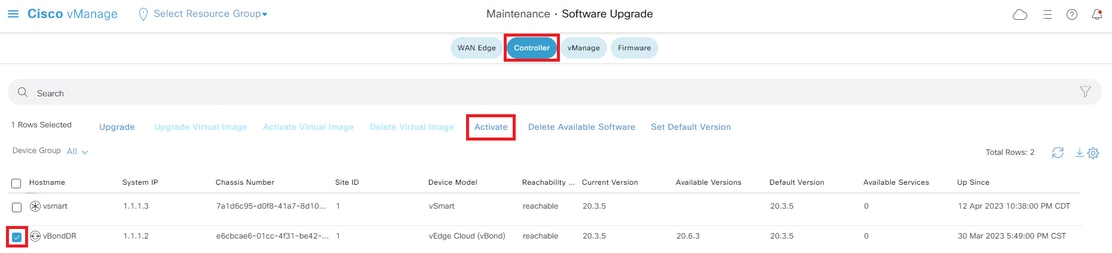

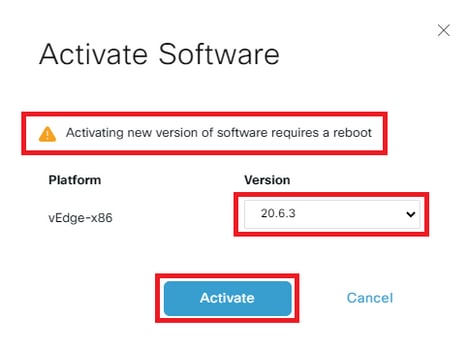

Maintenance(유지 관리)>Software Upgrade(소프트웨어 업그레이드)>Control Components(제어 구성 요소)로 이동하고 Activate(활성화)를 클릭합니다.

새 버전을 선택하고 활성화를 클릭합니다.

참고: 이 프로세스에서는 vBond를 다시 부팅해야 합니다. 전체 활성화에 최대 30분이 소요될 수 있습니다.

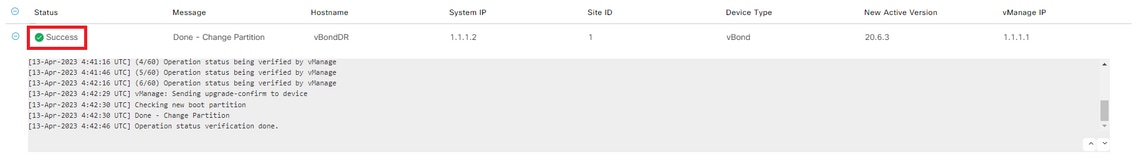

작업이 성공으로 표시될 때까지 작업의 상태를 확인합니다.

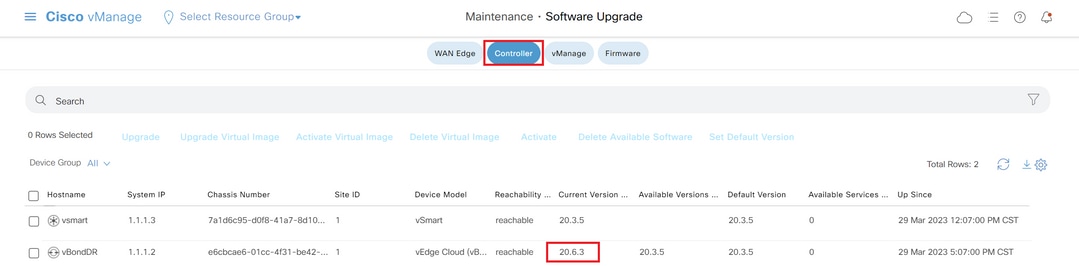

프로세스가 완료되면 Maintenance(유지 관리) > Software Upgrade(소프트웨어 업그레이드) > Control Components(제어 구성 요소)로 이동하여 새 버전이 활성화되어 있는지 확인합니다.

선택적 단계. 새 소프트웨어 이미지 활성화 및 재부팅

참고: 이 단계는 선택 사항입니다. 설치 과정 중에 Activate and Reboot(활성화 및 재부팅) 옵션의 상자를 선택할 수 있습니다. 이 절차를 사용하여 업그레이드된 새 소프트웨어 버전을 설치하고 활성화합니다.

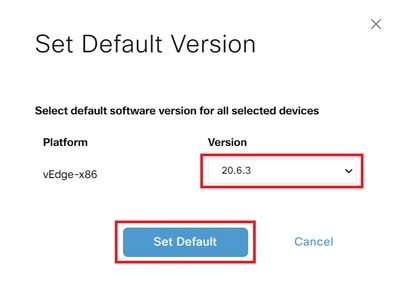

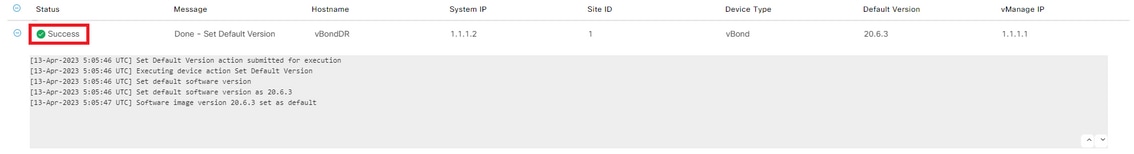

C단계. 기본 소프트웨어 버전 설정

소프트웨어 이미지를 Cisco SD-WAN 디바이스의 기본 이미지로 설정할 수 있습니다. 소프트웨어가 디바이스와 네트워크에서 원하는 대로 작동하는지 확인한 후 새 이미지를 기본값으로 설정하는 것이 좋습니다.

디바이스에서 공장 재설정이 수행되는 경우 디바이스는 기본값으로 설정된 이미지로 부팅합니다.

소프트웨어 이미지를 기본 이미지로 설정하려면 다음과 같이 하십시오.

- Maintenance(유지 관리)>Software Upgrade(소프트웨어 업그레이드)>Control Components(제어 구성 요소) > Software Image Actions(소프트웨어 이미지 작업)로 이동합니다.

- 기본 버전 설정을 클릭하고 드롭다운 목록에서 새 버전을 선택한 다음 기본 설정을 클릭합니다.

참고: 이 프로세스에서는 vBond 재부팅을 수행하지 않습니다.

작업이 성공으로 표시될 때까지 작업의 상태를 확인합니다.

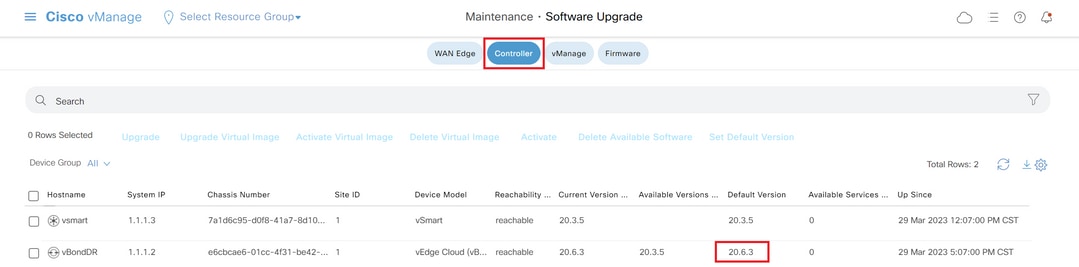

Default Version(기본 버전)을 확인하려면 Maintenance(유지 관리) > Software Upgrade(소프트웨어 업그레이드) > Control Components(제어 구성 요소)로 이동합니다.

v스마트

vSmart(컨트롤러) 업그레이드 지침

- Cisco에서는 먼저 vSmart 컨트롤러의 50%를 업그레이드할 것을 권장합니다. 최초 업그레이드 후 최소 24시간 동안 시스템의 안정성을 모니터링합니다. 문제가 발견되지 않으면 나머지 vSmart 컨트롤러를 업그레이드합니다.

- vSmart(컨트롤러)를 업그레이드하려면 CLI 대신 vManage GUI를 사용하는 것이 좋습니다.

참고: vManage GUI는 더욱 간소화된 사용자 친화적 업그레이드 프로세스를 제공합니다.

vSmart Controller를 업그레이드하기 전에 업그레이드 후 원활한 데이터 플레인 작업을 유지하기 위한 사전 요구 사항이 충족되었는지 확인하십시오.

전제 조건

1단계. 대시보드에서 참조 스크린샷 수집

- vSmart 컨트롤러의 경우, Monitor(모니터링) > Overview(개요) > Controller(컨트롤러) > System Status(시스템 상태)로 이동하여 CPU 및 메모리 사용률을 캡처합니다.

- vManage의 모든 vSmarts에서 Real-Time 명령 show omp 요약을 수집합니다.

2단계. OMP 피어 상태 알림 확인

- OMP 피어 상태 작동 중지 상태를 나타내는 알림에 대해서는 이벤트 또는 경보 대시보드를 검토합니다.

- 이렇게 하려면 업그레이드를 진행하기 전에 Monitor(모니터링) > Logs(로그) > Alarms/Events(경보/이벤트)로 이동하여 관련 경고를 확인합니다.

3단계. vSmart 컨피그레이션 백업

- 현재 vSmart 정책을 포함하여 모든 vSmart 컨트롤러의 실행 중인 컨피그레이션을 수집합니다.

- 이러한 컨피그레이션을 백업으로 저장하여 업그레이드 후 필요한 경우 설정을 복원할 수 있도록 합니다.

4단계. 디스크 공간 확인

업그레이드를 시작하기 전에 vSmart의 디스크 사용량을 검토하여 사용 가능한 공간이 충분한지 확인합니다. 아래 출력의

/var/volatile/log/tmplog와 같이 현재 100%인 전체 용량에 있거나 이에 가까운 파티션에 각별한 주의를 기울입니다. 필요에 따라 스토리지 문제를 해결하여 업그레이드 장애 또는 운영 중단을 방지합니다.vSmart# df -h

Filesystem Size Used Avail Use% Mounted on

none 7.6G 4.0K 7.6G 1% /dev

/dev/nvme0n1p1 7.9G 1.8G 6.0G 23% /boot

/dev/loop0 139M 139M 0 100% /rootfs.ro

/dev/nvme1n1 20G 7.6G 12G 41% /rootfs.rw

aufs 20G 7.6G 12G 41% /

tmpfs 7.6G 728K 7.6G 1% /run

shm 7.6G 16K 7.6G 1% /dev/shm

tmp 1.0G 16K 1.0G 1% /tmp

tmplog 120M 120M 0 100% /var/volatile/log/tmplog

svtmp 2.0M 1.2M 876K 58% /etc/sv

vSmart#5단계. vSmart 리소스 사용률 모니터링

- vSmart 컨트롤러의 CPU 및 메모리 사용량을 확인합니다.

- vshell에서 topandfree -m 명령을 실행하여 현재 리소스 통계를 수집합니다

vSmart# vshell

vSmart~$top

vSmart~$ free -m6단계. 모든 vSmarts에서 OMP 및 제어 상태 확인

- 모든 vSmarts에서 OMP 및 제어 검증을 수행하여 변경하기 전에 기준을 설정합니다.

- show omp 요약을 실행하고 업그레이드 후 비교를 위한 원본 상태의 참조로 출력을 기록합니다.

- 제어 요약 및 표시 제어 연결을 사용하여 가장자리, 기타 vSmarts, vBonds 및 vManage에 대한 제어 연결 수가 정확한지 확인합니다.

- Runshow control local-properties를 실행하여 추가 컨트롤 플레인 세부 정보를 확인합니다.

- Executeshow system status를 통해 각 vSmart에 "vManaged" 상태가 불가능하며 "Configuration template"이 None으로 설정되지 않았는지 확인합니다.

7단계. 샘플 에지 장치의 유효성 검사

서로 다른 사이트 목록에서 10~15개의 디바이스 샘플을 선택하고 다음을 확인합니다.

- show sdwan omp peer를 실행하여 각 디바이스에서 모든 예상 vSmarts에 대한 활성 OMP 피어링이 있는지 확인합니다.

- Executeshow sdwan omp 요약을 실행하여 전반적인 OMP 상태를 검토합니다.

- sdwan bfd 세션을 사용하여 활성 BFD 세션의 수와 해당 업타임을 캡처합니다.

Cisco 권장 구성 설정

업그레이드에 반드시 필요한 것은 아니지만 Cisco에서는 최적의 운영을 위해 이러한 컨피그레이션 모범 사례를 적극 권장합니다.

OMP 보류 타이머

- 소프트웨어 버전 20.12.1 이상의 경우 OMP 보류 타이머를 300초로 구성합니다.

- Versionsphere를 20.12.1로 설정하려면 OMP 보류 타이머를 60초로 설정합니다.

OMP Graceful Restart 타이머

- 기본 타이머는 12시간(43,200초)으로 임시 vSmart 중단 중에 데이터 플레인 터널을 유지하기에 충분합니다.

IPsec 키 재설정 타이머

- OMP가 중단된 동안 IPsec 키 재입력을 방지하려면 IPsec rekey 타이머를 OMP Graceful Restart 타이머의 두 배로 구성합니다.

이러한 설정을 통해 네트워크 안정성을 높이고 계획된 또는 예상치 못한 가동 중단 시 중단을 최소화할 수 있습니다.

모든 검증이 성공한 경우에만 다음 단계로 진행합니다.

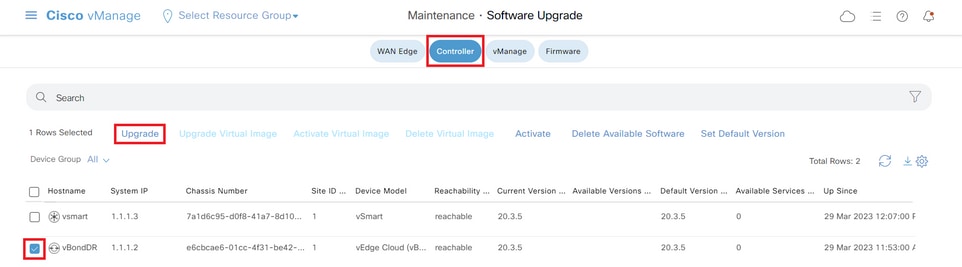

A단계. 설치

이 단계에서 vManages는 새 소프트웨어를 vSmart로 종료하고 새 이미지를 설치합니다.

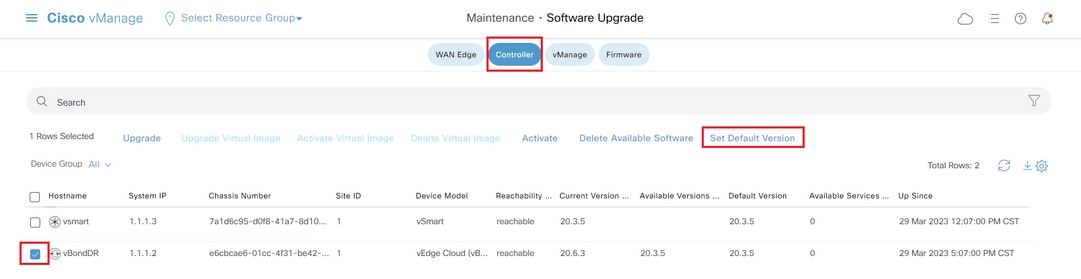

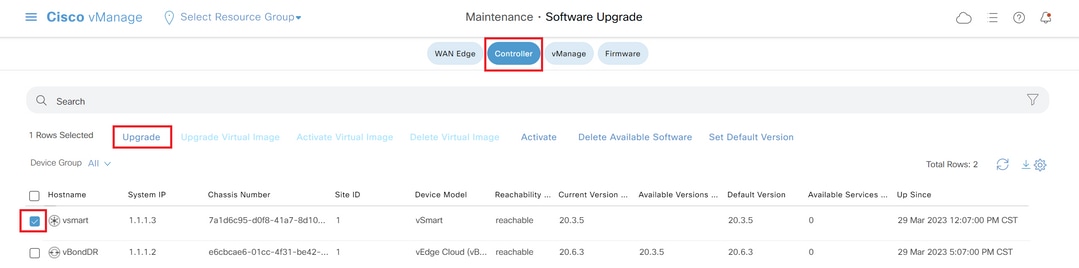

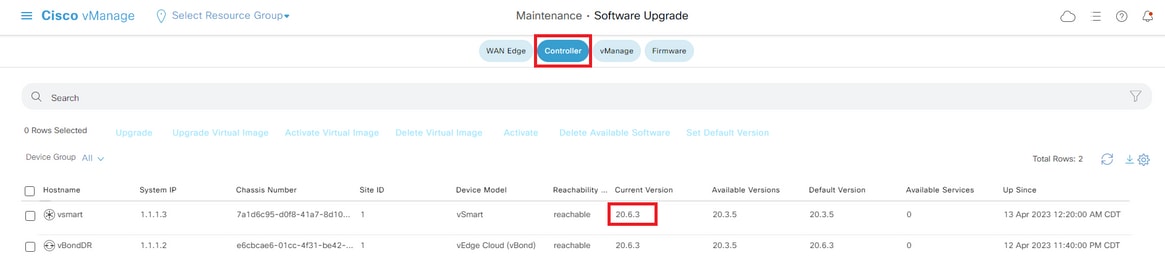

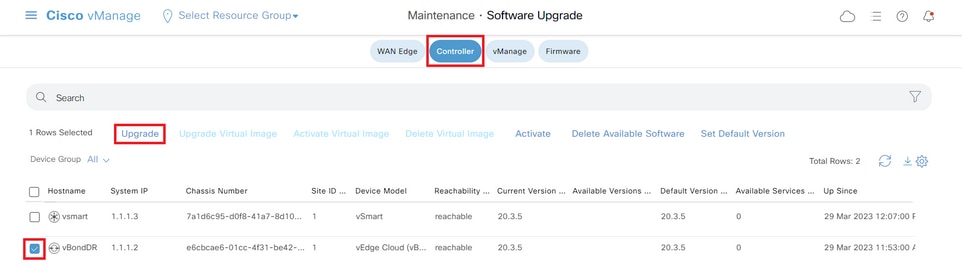

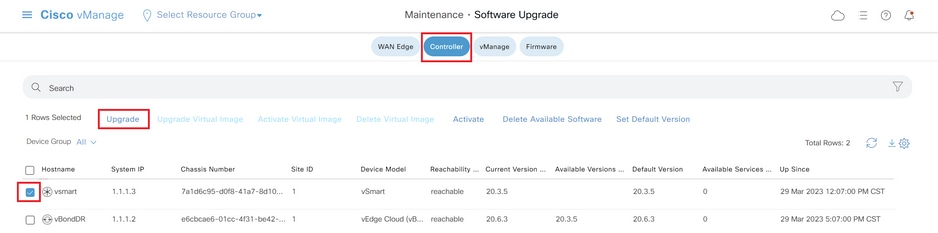

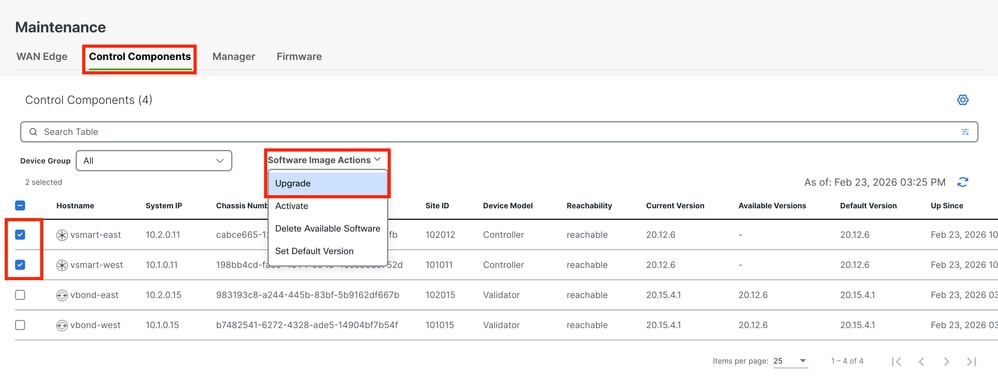

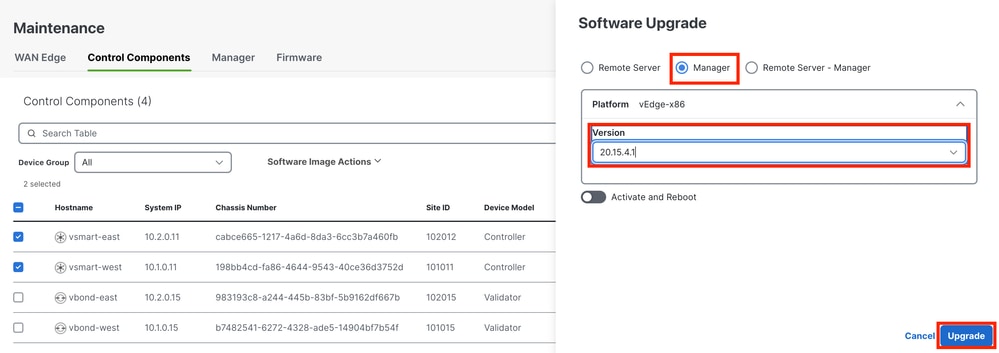

Maintenance(유지 관리)>Software Upgrade(소프트웨어 업그레이드)>Controller로 이동하여 Upgrade(업그레이드)를 클릭합니다.

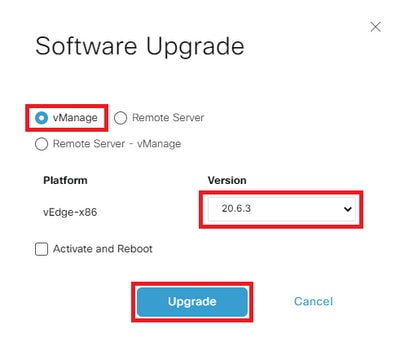

Software Upgrade 팝업 창에서 다음과 같이 합니다.

- vManage(vManage) 탭을 선택합니다.

- 버전 드롭다운 목록에서 업그레이드할 이미지 버전을 선택합니다.

- 업그레이드를 클릭합니다.

참고: 이 프로세스에서는 vSmart의 재부팅을 실행하지 않으며 업그레이드에 필요한 디렉토리만 전송, 압축 해제 및 생성합니다.

작업이 성공으로 표시될 때까지 작업의 상태를 확인합니다.

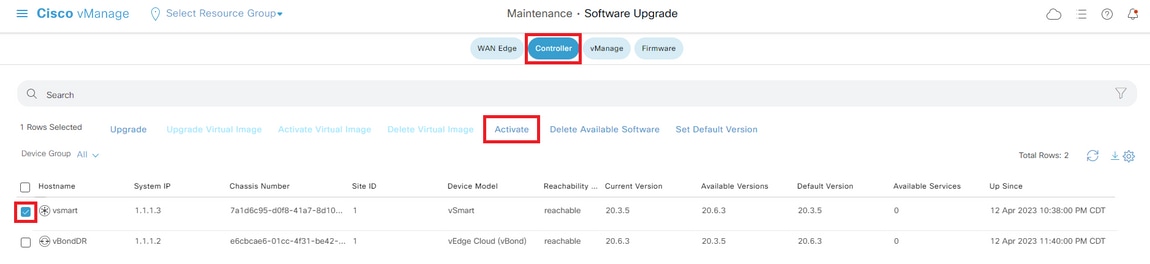

B단계. 활성화

이 단계에서 vSmart는 설치된 새 소프트웨어 버전을 활성화하고 자체 재부팅하여 새 소프트웨어로 부팅합니다.

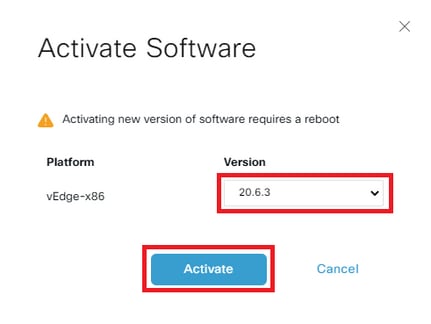

Maintenance(유지 관리)>Software Upgrade(소프트웨어 업그레이드)>Controller(컨트롤러)로 이동하여 Activate(활성화)를 클릭합니다.

새 버전을 선택하고 활성화를 클릭합니다.

참고: 이 프로세스에는 vSmart를 다시 부팅해야 합니다. 전체 정품 인증을 완료하는 데 최대 30분이 걸릴 수 있습니다.

작업이 성공으로 표시될 때까지 작업의 상태를 확인합니다.

프로세스가 완료되면 Maintenance(유지 관리) > Software Upgrade(소프트웨어 업그레이드) > Controller(컨트롤러)로 이동하여 새 버전이 활성화되어 있는지 확인합니다.

선택적 단계. 새 소프트웨어 이미지 활성화 및 재부팅

참고: 이 단계는 선택 사항입니다. 설치 과정 중에 Activate and Reboot(활성화 및 재부팅) 옵션의 상자를 선택할 수 있습니다. 이 절차를 사용하여 업그레이드된 새 소프트웨어 버전을 설치하고 활성화합니다.

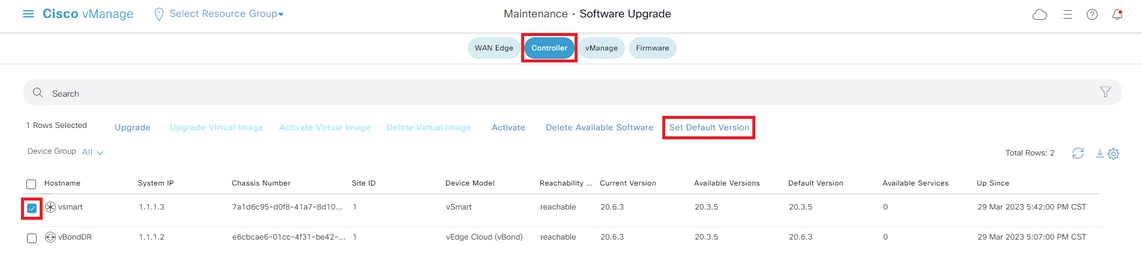

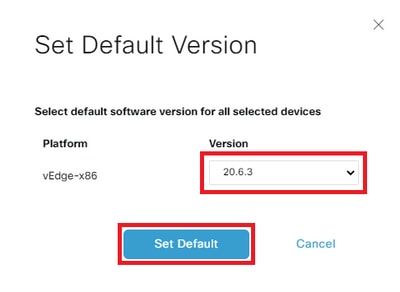

C단계. 기본 소프트웨어 버전 설정

소프트웨어 이미지를 Cisco SD-WAN 디바이스의 기본 이미지로 설정할 수 있습니다. 소프트웨어가 디바이스와 네트워크에서 원하는 대로 작동하는지 확인한 후 새 이미지를 기본값으로 설정하는 것이 좋습니다.

디바이스에서 공장 재설정이 수행되는 경우 디바이스는 기본값으로 설정된 이미지로 부팅합니다.

소프트웨어 이미지를 기본 이미지로 설정하려면 다음과 같이 하십시오.

- Maintenance(유지 관리)>Software Upgrade(소프트웨어 업그레이드)>Controller(컨트롤러)로 이동합니다.

- 기본 버전 설정을 클릭하고 드롭다운 목록에서 새 버전을 선택한 다음 기본 설정을 클릭합니다.

참고: 이 프로세스에서는 vSmart 재부팅을 수행하지 않습니다.

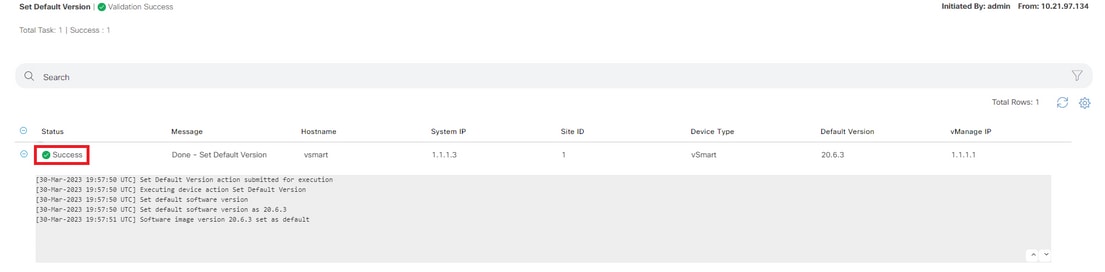

작업이 성공으로 표시될 때까지 작업의 상태를 확인합니다.

Default Version(기본 버전)을 확인하려면 Maintenance(유지 관리) > Software Upgrade(소프트웨어 업그레이드) > Controller(컨트롤러)로 이동합니다.

CLI를 통해 SD-WAN 컨트롤러 업그레이드

1단계. 설치

이미지를 설치하는 옵션은 두 가지입니다.

옵션 1: HTTP, FTP 또는 TFTP를 사용하는 CLI에서.

CLI에서 소프트웨어 이미지를 설치하려면

-

소프트웨어 업그레이드가 성공했는지 확인하기 위한 시간 제한을 구성합니다. 시간은 1분에서 60분 사이입니다.

Viptela# system upgrade-confirm minutes - 소프트웨어를 설치합니다.

Viptela#request software install url/vmanage-20.15.4.1-x86_64.tar.gz [reboot]다음 방법 중 하나로 이미지 위치를 지정합니다.

- 이미지 파일은 로컬 서버에 있습니다.

/directory-path/

CLI의 자동 완성 기능을 사용하여 경로와 파일 이름을 완료할 수 있습니다.

- 이미지 파일은 FTP 서버에 있습니다.

ftp://hostname/

- 이미지 파일은 HTTP 서버에 있습니다.

http://hostname/

- 이미지 파일은 TFTP 서버에 있습니다.

tftp://hostname/

선택적으로, 서버가 있는 VPN 식별자를 지정합니다.

재부팅은 새 소프트웨어 이미지를 활성화하고 설치가 완료되면 디바이스를 재부팅합니다.

3. 2단계에 재부팅 옵션이 포함되지 않은 경우 새 소프트웨어 이미지를 활성화하면 자동으로 인스턴스 재부팅을 수행하여 새 버전을 부팅합니다.

Viptela#request software activate4. 구성된 업그레이드 확인 시간 제한(기본값 12분) 내에 소프트웨어 설치가 성공적으로 완료되었는지 확인합니다.

Viptela#request software upgrade-confirm이 시간 제한 내에 이 명령을 실행하지 않으면 디바이스는 자동으로 이전 소프트웨어 이미지로 돌아갑니다.

옵션 2: vManage GUI에서

이 단계에서는 이미지를 vManage 리포지토리에 업로드할 수 있습니다.

Software Download(소프트웨어 다운로드)로 이동하여 vManage용 소프트웨어 버전 이미지를 다운로드합니다.

Software Download(소프트웨어 다운로드)로 이동하여 vBond 및 vSmart의 소프트웨어 버전 이미지를 다운로드합니다.

새 이미지를 업로드하려면 주 메뉴에서 Maintenance(유지 관리) > Software Repository(소프트웨어 저장소) > Software Images(소프트웨어 이미지)로 이동하고 Add New Software(새 소프트웨어 추가)를 클릭한 다음 드래그 앤 드롭 옵션에서 vManage(v관리)를 자.

이미지를 선택하고 업로드를 클릭합니다.

이미지를 사용할 수 있는지 확인하려면 Software Repository(소프트웨어 저장소) > Software Images(소프트웨어 이미지)로 이동합니다.

참고: 이 프로세스는 모든 컨트롤러에 대해 수행해야 합니다.

vManage:

업그레이드를 클릭합니다.

vBond:

Upgrade(업그레이드)를 클릭합니다.

vSmart:

Upgrade(업그레이드)를 클릭합니다.

Software Upgrade 팝업 창에서 다음과 같이 합니다.

- vManage(vManage) 탭을 선택합니다.

- 버전 드롭다운 목록에서 업그레이드할 이미지 버전을 선택합니다.

- 업그레이드를 클릭합니다.

vManage:

vBond 및 vSmart의 경우:

2단계. 활성화

설치가 완료되면 컨트롤러에 설치된 소프트웨어 이미지를 확인합니다.

vmanage# show software

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

---------------------------------------------------------------------------

20.12.6 true true - - 2023-02-01T22:25:24-00:00

20.15.4.1 false false false - -vbond# show software

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

--------------------------------------------------------------------------

20.12.6 true true - - 2022-10-01T00:30:40-00:00

20.15.4.1 false false false - -vsmart# show software

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

--------------------------------------------------------------------------

20.12.6 true true - - 2022-10-01T00:31:34-00:00

20.15.4.1 false false false - -참고: 이미지를 활성화하려면 컨트롤러에서 다음 명령을 실행하십시오(컨트롤러, 첫 번째 vManage, 두 번째 vBond, 세 번째 vSmart). vManage 클러스터의 경우 클러스터의 모든 vManage 노드에서 소프트웨어를 함께 활성화하는 것이 중요합니다.

vmanage# request software activate ?

Description: Display software versions

Possible completions:

20.12.6

20.15.4.1

clean Clean activation

now Activate software version

vmanage# request software activate 20.15.4.1

This will reboot the node with the activated version.

Are you sure you want to proceed? [yes,NO] yes

Broadcast message from root@vmanage (console) (Tue Feb 28 01:01:04 2023):

Tue Feb 28 01:01:04 UTC 2023: The system is going down for reboot NOW!vbond# request software activate ?

Description: Display software versions

Possible completions:

20.12.6

20.15.4.1

clean Clean activation

now Activate software version

vbond# request software activate 20.15.4.1

This will reboot the node with the activated version.

Are you sure you want to proceed? [yes,NO] yes

Broadcast message from root@vbond (console) (Tue Feb 28 01:05:59 2023):

Tue Feb 28 01:05:59 UTC 2023: The system is going down for reboot NOWvsmart# request software activate ?

Description: Display software versions

Possible completions:

20.12.6

20.15.4.1

clean Clean activation

now Activate software version

vsmart# request software activate 20.15.4.1

This will reboot the node with the activated version.

Are you sure you want to proceed? [yes,NO] yes

Broadcast message from root@vsmart (console) (Tue Feb 28 01:13:44 2023):

Tue Feb 28 01:13:44 UTC 2023: The system is going down for reboot NOW!참고: 컨트롤러는 새 이미지를 활성화하고 자체적으로 재부팅합니다.

새 소프트웨어 버전이 활성화되었는지 확인하려면 다음 명령을 실행합니다.

vmanage# show version

20.15.4.1

vmanage# show software

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

---------------------------------------------------------------------------

20.12.6 false true true - 2023-02-01T22:25:24-00:00

20.15.4.1 true false false auto 2023-02-28T01:05:14-00:00vbond# show version

20.15.4.1

vbond# show software

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

--------------------------------------------------------------------------

20.12.6 false true true - 2022-10-01T00:30:40-00:00

20.15.4.1 true false false - 2023-02-28T01:09:05-00:00vsmart# show version

20.15.4.1

vsmart# show software

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

--------------------------------------------------------------------------

20.12.6 false true true - 2022-10-01T00:31:34-00:00

20.15.4.1 true false false - 2023-02-28T01:16:36-00:003단계. 기본 소프트웨어 버전 설정

소프트웨어 이미지를 Cisco SD-WAN 디바이스의 기본 이미지로 설정할 수 있습니다. 소프트웨어가 디바이스와 네트워크에서 원하는 대로 작동하는지 확인한 후 새 이미지를 기본값으로 설정하는 것이 좋습니다.

디바이스에서 공장 재설정이 수행되는 경우 디바이스는 기본값으로 설정된 이미지로 부팅합니다.

참고: vManage가 재부팅되면 이전 버전이 부팅되므로 새 버전을 기본값으로 설정하는 것이 좋습니다. 이로 인해 데이터베이스가 손상될 수 있습니다. 주 릴리스에서 이전 릴리스로 다운그레이드되는 버전은 vManage에서 지원되지 않습니다.

참고: 이 프로세스에서는 컨트롤러 재부팅을 수행하지 않습니다.

소프트웨어 버전을 기본값으로 설정하려면 컨트롤러에서 다음 명령을 실행합니다.

vmanage# request software set-default ?

Possible completions:

20.12.6

20.15.4.1

cancel Cancel this operation

start-at Schedule start.

| Output modifiers

<cr>

vmanage# request software set-default 20.15.4.1

status mkdefault 20.15.4.1: successfulvbond# request software set-default ?

Possible completions:

20.12.6

20.15.4.1

cancel Cancel this operation

start-at Schedule start.

| Output modifiers

<cr>

vbond# request software set-default 20.15.4.1

status mkdefault 20.15.4.1: successfulvsmart# request software set-default ?

Possible completions:

20.12.6

20.15.4.1

cancel Cancel this operation

start-at Schedule start.

| Output modifiers

<cr>

vsmart# request software set-default 20.15.4.1

status mkdefault 20.15.4.1: successful새 기본 버전이 컨트롤러에 설정되어 있는지 확인하려면 다음 명령을 실행합니다.

vmanage# show software

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

---------------------------------------------------------------------------

20.12.6 false false true - 2023-02-01T22:25:24-00:00

20.15.4.1 true true false auto 2023-02-28T01:05:14-00:00vbond# show software

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

--------------------------------------------------------------------------

20.12.6 false false true - 2022-10-01T00:30:40-00:00

20.15.4.1 true true false - 2023-02-28T01:09:05-00:00vsmart# show software

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

--------------------------------------------------------------------------

20.12.6 false false true - 2022-10-01T00:31:34-00:00

20.15.4.1 true true false - 2023-02-28T01:16:36-00:00재해 복구가 활성화된 vManage/vManage 클러스터 업그레이드

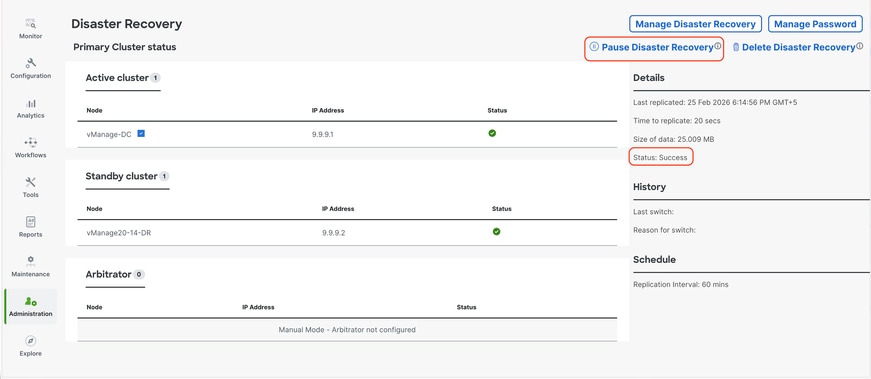

재해 복구가 활성화된 vManage 또는 vManage 클러스터의 경우

진행 중인 재해 복구 복제가 없는지 확인합니다. Administration(관리) —> Disaster Recovery(재해 복구)로 이동하고 Import Pending(가져오기 보류 중), Export Pending(내보내기 보류 중) 또는 Download Pending(다운로드 보류 중)과 같은 일시적인 상태가 아닌 Success(성공) 상태를 확인합니다. 현재 활성 vManage에서 재해 복구를 일시 중지하는 것이 중요합니다.

상태가 성공이 아닌 경우 상태가 "성공"으로 표시될 때까지 기다립니다. 다른 상태에서 더 오랜 시간(복제 간격에 따라 1시간 이상) 방치되는 경우, 재해 복구를 일시 중지하기 전에 Cisco TAC에 문의하여 복제가 성공적인지 확인하십시오.

먼저 재해 복구를 일시 중지하고 작업이 성공했는지 확인합니다. 그런 다음 위에 설명된 단계에 따라 Active vManage를 업그레이드합니다.

참고: 독립형 Active vManage의 경우 vManage UI를 사용하여 새 소프트웨어를 설치하고 활성화할 수 있습니다. Active vManage 클러스터의 경우, 아래 CLI를 통한 SD-WAN 컨트롤러 업그레이드 섹션에 설명된 대로 vManage UI를 사용하여 소프트웨어를 설치하고 vManage CLI를 사용하여 소프트웨어 활성화 < > 요청을 사용하여 소프트웨어를 활성화하는 것이 좋습니다.

대기 vManage/vManage 클러스터의 경우 vManage 노드의 CLI를 사용하여 소프트웨어를 설치하고 활성화해야 합니다.

-

업그레이드 후 검증 검사

-

소프트웨어 버전 확인: 모든 컨트롤러에서 원하는 소프트웨어 버전을 실행하고 있는지 확인합니다.

-

SD-WAN 관리자 서비스 확인: SD-WAN Manager 인스턴스의 모든 서비스가 작동하는지 확인합니다.

-

컨트롤러 간 컨트롤 연결 확인: 모든 컨트롤러에서 제어 연결이 설정되고 안정되는지 확인합니다.

-

정책 활성화 확인: SD-WAN 관리자에서 정책이 활성화되었는지 확인합니다.

-

Check Control Connection Distribution(제어 연결 배포 확인): 제어 연결이 모든 SD-WAN Manager 노드에 올바르게 배포되었는지 확인합니다. Monitor(모니터링) > Network(네트워크)로 이동하고 Controlcolumn(제어 열)을 검토합니다.

-

사이트 수준 업그레이드 후 테스트: 업그레이드 전 확인이 수행된 모든 사이트에 대해 다음 확인을 수행합니다.

-

제어 연결 및 BFD 세션:

show sd-wan control connections

show sd-wan bfd sessions -

라우팅 확인:

show ip route

show ip route vrf <vrf_id>

show sd-wan omp routes vpn <vpn_id> -

데이터 센터 연결성: 데이터 센터 서비스에 대한 연결을 확인합니다.

-

템플릿 동기화: 업그레이드 후 디바이스 템플릿이 디바이스에 연결 및 동기화되었는지 확인합니다.

-

컨트롤러에서 정책 확인:

-

show sd-wan policy from-controller

-

사용자 승인 테스트: 마이그레이션된 사이트에서 사용자 테스트를 수행하여 애플리케이션 기능 검증

-

롤백 계획

vBond 및 vSmart 롤백 계획

업그레이드 후 Validator(vBond) 또는 Controller(vSmart)에 예기치 않은 문제가 발생하면 영향을 받는 디바이스에서 이전 이미지를 활성화하여 이전 소프트웨어 버전으로 되돌립니다.

vSmart# request software activate <older image version>

vBond# request software activate <older image version>vManage 롤백 계획

업그레이드 후 SD-WAN 관리자(vManage)에 예기치 않은 문제가 발생하면 업그레이드 전에 만든 스냅샷을 사용하여 시스템을 복원합니다.

참고:vManage는 CLI를 통한 이전 버전으로의 다운그레이드를 지원하지 않습니다.

문제 해결

1. 활성화 후 GUI가 오랫동안 중단되었지만 다시 연결할 수 없는 경우 이러한 출력은 근본 원인을 찾아내는 데 도움이 됩니다.

vmanage# request nms application-server status

NMS application server

Enabled: true <<<<<<<<<<< "false"

Status: running PID:26470 for 22279s <<<<<<<<<< "not running"app-server 상태가 Enabled(활성화됨)를 false로 표시하고 Status(상태)가 Running(실행 중)이 아닌 경우 다음 명령을 실행하여 GUI를 복원할 수 있습니다.

vmanage# request nms application-server restart

2. 모든 nms 서비스의 상태를 확인하려면 다음 명령을 실행할 수 있습니다.

vmanage# request nms all status

NMS service proxy

Enabled: true

Status: running PID:30888 for 819s

NMS service proxy rate limit

Enabled: true

Status: running PID:32029 for 812s

NMS application server

Enabled: true

Status: running PID:30834 for 819s

NMS configuration database

Enabled: true

Status: running PID:28321 for 825s

Native metrics status: ENABLED

Server-load metrics status: ENABLED

NMS coordination server

Enabled: true

Status: running PID:16814 for 535s

NMS messaging server

Enabled: true

Status: running PID:32561 for 799s

NMS statistics database

Enabled: false

Status: not running

NMS data collection agent

Enabled: true

Status: running PID:31051 for 824s

NMS CloudAgent v2

Enabled: true

Status: running PID:31902 for 817s

NMS cloud agent

Enabled: true

Status: running PID:18517 for 1183s

NMS SDAVC server

Enabled: false

Status: not running

NMS SDAVC gateway

Enabled: false

Status: not running

vManage Device Data Collector

Enabled: true

Status: running PID:3709 for 767s

NMS OLAP database

Enabled: true

Status: running PID:18167 for 521s

vManage Reporting

Enabled: true

Status: running PID:30015 for 827s3. TCP 핸드셰이크가 완료되었는지 확인하려면 다음 명령을 실행합니다.

vmanage# request nms all diagnostics NMS service server Pinging vManage node on localhost ... Starting Nping 0.7.80 ( https://nmap.org/nping ) at 2026-02-24 06:17 UTC SENT (0.0014s) Starting TCP Handshake > localhost:8443 (127.0.0.1:8443) RCVD (0.0014s) Handshake with localhost:8443 (127.0.0.1:8443) completed SENT (1.0025s) Starting TCP Handshake > localhost:8443 (127.0.0.1:8443) RCVD (1.0025s) Handshake with localhost:8443 (127.0.0.1:8443) completed SENT (2.0036s) Starting TCP Handshake > localhost:8443 (127.0.0.1:8443) RCVD (2.0036s) Handshake with localhost:8443 (127.0.0.1:8443) completed Max rtt: 0.012ms | Min rtt: 0.010ms | Avg rtt: 0.010ms TCP connection attempts: 3 | Successful connections: 3 | Failed: 0 (0.00%) Nping done: 1 IP address pinged in 2.00 seconds Server network connections -------------------------- tcp6 0 0 127.0.0.1:8443 127.0.0.1:43682 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43892 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 169.254.1.1:8443 169.254.1.8:52962 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43738 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:43738 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43828 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43836 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43866 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:52020 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43828 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:43896 ESTABLISHED 31081/envoy tcp6 0 0 169.254.1.1:8443 169.254.1.8:51382 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43726 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:43810 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43756 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43748 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 169.254.0.254:8443 151.186.182.23:35154 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43898 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43860 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:56308 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:52028 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43756 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43712 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:43834 ESTABLISHED 31081/envoy tcp6 0 0 169.254.0.254:8443 151.186.182.23:52168 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43810 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43836 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43852 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 169.254.0.254:8443 151.186.182.23:53030 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43898 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:43892 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:52028 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:44096 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43896 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43866 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43730 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43860 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43878 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43772 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:52020 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:56308 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43874 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:43772 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43826 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:52038 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:43754 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43726 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43782 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43862 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43834 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 169.254.1.1:8443 169.254.1.8:52964 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:44096 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43754 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:43874 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43712 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43794 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:43696 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43696 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 169.254.1.1:8443 169.254.1.8:52978 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43748 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43730 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43852 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43878 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43826 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43682 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:43794 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43862 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:52038 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43782 ESTABLISHED 31081/envoy NMS application server Sending ICMP Echo to vManage on localhost ... PING localhost.localdomain (127.0.0.1) 56(84) bytes of data. 64 bytes from localhost.localdomain (127.0.0.1): icmp_seq=1 ttl=64 time=0.022 ms 64 bytes from localhost.localdomain (127.0.0.1): icmp_seq=2 ttl=64 time=0.030 ms 64 bytes from localhost.localdomain (127.0.0.1): icmp_seq=3 ttl=64 time=0.027 ms --- localhost.localdomain ping statistics --- 3 packets transmitted, 3 received, 0% packet loss, time 2034ms rtt min/avg/max/mdev = 0.022/0.026/0.030/0.003 ms Pinging vManage node on localhost ... Starting Nping 0.7.80 ( https://nmap.org/nping ) at 2026-02-24 06:17 UTC SENT (0.0015s) Starting TCP Handshake > localhost:8443 (127.0.0.1:8443) RCVD (0.0015s) Handshake with localhost:8443 (127.0.0.1:8443) completed SENT (1.0026s) Starting TCP Handshake > localhost:8443 (127.0.0.1:8443) RCVD (1.0026s) Handshake with localhost:8443 (127.0.0.1:8443) completed SENT (2.0037s) Starting TCP Handshake > localhost:8443 (127.0.0.1:8443) RCVD (2.0037s) Handshake with localhost:8443 (127.0.0.1:8443) completed Max rtt: 0.012ms | Min rtt: 0.009ms | Avg rtt: 0.010ms TCP connection attempts: 3 | Successful connections: 3 | Failed: 0 (0.00%) Nping done: 1 IP address pinged in 2.00 seconds Disk I/O statistics for vManage storage --------------------------------------- avg-cpu: %user %nice %system %iowait %steal %idle 1.63 0.00 0.37 0.06 0.00 97.93 Device tps kB_read/s kB_wrtn/s kB_dscd/s kB_read kB_wrtn kB_dscd nvme1n1 24.49 74.59 913.44 0.00 2717198 33273456 0 NMS configuration database Checking cluster connectivity for ports 7687,7474 ... Pinging vManage node 0 on 169.254.1.5:7687,7474... Starting Nping 0.7.80 ( https://nmap.org/nping ) at 2026-02-24 06:17 UTC SENT (0.0013s) Starting TCP Handshake > 169.254.1.5:7474 RCVD (0.0013s) Handshake with 169.254.1.5:7474 completed SENT (1.0024s) Starting TCP Handshake > 169.254.1.5:7687 RCVD (1.0024s) Handshake with 169.254.1.5:7687 completed SENT (2.0035s) Starting TCP Handshake > 169.254.1.5:7474 RCVD (2.0035s) Handshake with 169.254.1.5:7474 completed SENT (3.0046s) Starting TCP Handshake > 169.254.1.5:7687 RCVD (3.0046s) Handshake with 169.254.1.5:7687 completed SENT (4.0057s) Starting TCP Handshake > 169.254.1.5:7474 RCVD (4.0058s) Handshake with 169.254.1.5:7474 completed SENT (5.0069s) Starting TCP Handshake > 169.254.1.5:7687 RCVD (5.0069s) Handshake with 169.254.1.5:7687 completed Max rtt: 0.021ms | Min rtt: 0.010ms | Avg rtt: 0.013ms TCP connection attempts: 6 | Successful connections: 6 | Failed: 0 (0.00%) Nping done: 1 IP address pinged in 5.01 seconds Server network connections -------------------------- tcp 0 0 169.254.1.5:7687 169.254.1.1:59650 ESTABLISHED 30148/java tcp 0 0 169.254.1.5:7687 169.254.1.1:49998 ESTABLISHED 30148/java tcp 0 0 169.254.1.5:7687 169.254.1.13:55794 ESTABLISHED 30148/java tcp 0 0 169.254.1.5:7687 169.254.1.1:35374 ESTABLISHED 30148/java tcp 0 0 169.254.1.5:7687 169.254.1.1:40100 ESTABLISHED 30148/java tcp 0 0 169.254.1.5:7687 169.254.1.1:52748 ESTABLISHED 30148/java tcp 0 0 169.254.1.5:7687 169.254.1.1:35380 ESTABLISHED 30148/java tcp 0 0 169.254.1.5:7687 169.254.1.1:40618 ESTABLISHED 30148/java tcp 0 0 169.254.1.5:7687 169.254.1.1:59658 ESTABLISHED 30148/java tcp 0 0 169.254.1.5:7687 169.254.1.13:55782 ESTABLISHED 30148/java Connecting to localhost... +------------------------------------------------------------------------------------+ | type | row | attributes[row]["value"] | +------------------------------------------------------------------------------------+ | "StoreSizes" | "TotalStoreSize" | 156365978 | | "PageCache" | "Flush" | 68694 | | "PageCache" | "EvictionExceptions" | 0 | | "PageCache" | "UsageRatio" | 0.1795189950980392 | | "PageCache" | "Eviction" | 3186 | | "PageCache" | "HitRatio" | 1.0 | | "ID Allocations" | "NumberOfRelationshipIdsInUse" | 8791 | | "ID Allocations" | "NumberOfPropertyIdsInUse" | 47067 | | "ID Allocations" | "NumberOfNodeIdsInUse" | 4450 | | "ID Allocations" | "NumberOfRelationshipTypeIdsInUse" | 77 | | "Transactions" | "LastCommittedTxId" | 26470 | | "Transactions" | "NumberOfOpenTransactions" | 1 | | "Transactions" | "NumberOfOpenedTransactions" | 109412 | | "Transactions" | "PeakNumberOfConcurrentTransactions" | 10 | | "Transactions" | "NumberOfCommittedTransactions" | 106913 | +------------------------------------------------------------------------------------+ 15 rows ready to start consuming query after 126 ms, results consumed after another 2 ms Completed Connecting to localhost... Displaying the Neo4j Cluster Status +---------------------------------------------------------------------------------------------------------------------------------+ | name | aliases | access | address | role | requestedStatus | currentStatus | error | default | home | +---------------------------------------------------------------------------------------------------------------------------------+ | "neo4j" | [] | "read-write" | "localhost:7687" | "standalone" | "online" | "online" | "" | TRUE | TRUE | | "system" | [] | "read-write" | "localhost:7687" | "standalone" | "online" | "online" | "" | FALSE | FALSE | +---------------------------------------------------------------------------------------------------------------------------------+ 2 rows ready to start consuming query after 3 ms, results consumed after another 1 ms Completed Total disk space used by configuration-db: 63M . Detailed disk space usage of configuration-db: 0 database_lock 8.0K neostore 48K neostore.counts.db 1.8M neostore.indexstats.db 48K neostore.labelscanstore.db 8.0K neostore.labeltokenstore.db 40K neostore.labeltokenstore.db.id 32K neostore.labeltokenstore.db.names 40K neostore.labeltokenstore.db.names.id 72K neostore.nodestore.db 48K neostore.nodestore.db.id 8.0K neostore.nodestore.db.labels 40K neostore.nodestore.db.labels.id 1.9M neostore.propertystore.db 312K neostore.propertystore.db.arrays 48K neostore.propertystore.db.arrays.id 72K neostore.propertystore.db.id 8.0K neostore.propertystore.db.index 48K neostore.propertystore.db.index.id 32K neostore.propertystore.db.index.keys 40K neostore.propertystore.db.index.keys.id 4.2M neostore.propertystore.db.strings 104K neostore.propertystore.db.strings.id 16K neostore.relationshipgroupstore.db 48K neostore.relationshipgroupstore.db.id 48K neostore.relationshipgroupstore.degrees.db 296K neostore.relationshipstore.db 48K neostore.relationshipstore.db.id 48K neostore.relationshiptypescanstore.db 8.0K neostore.relationshiptypestore.db 40K neostore.relationshiptypestore.db.id 8.0K neostore.relationshiptypestore.db.names 40K neostore.relationshiptypestore.db.names.id 16K neostore.schemastore.db 48K neostore.schemastore.db.id 11M profiles 44M schema ############################################## Running schema violation pre-check script WARNING: sun.reflect.Reflection.getCallerClass is not supported. This will impact performance. Validating Schema from the configuration-db Successfully validated configuration-db schema written to file /opt/data/containers/mounts/upgrade-coordinator/schema.json Contents of /opt/data/containers/mounts/upgrade-coordinator/schema.json: { "check_name": "Validating configuration-db admin names", "check_result": "SUCCESSFUL", "check_analysis": "Successfully validated configuration-db schema", "check_action": "" } ############################################## ############################################## Running quarantine check WARNING: sun.reflect.Reflection.getCallerClass is not supported. This will impact performance. Check if Neo4j Nodes are Quarantined None of the neo4j nodes is quarantined ############################################## ############################################## Checking High Direct Memory Usage in Neo4j High Direct Memory Usage in Neo4j not found NMS data collection agent Checking data-collection-agent status ------------------------ data-collection-agent container exists Checking Data collection agent processes status ------------------------ Data collection agent parent processs ID 12 Data collection agent process ID 104 Data collection bulk process ID 97 Data collection rest process ID 98 Data collection monitor process ID 99 Checking vmanage access ------------------------ Successfully logged into vmanage. Checking DCS Push Status ------------------------ vAnalytics not enabled. NMS coordination server Checking cluster connectivity for ports 2181 ... Pinging vManage node 0 on 169.254.1.4:2181... Starting Nping 0.7.80 ( https://nmap.org/nping ) at 2026-02-24 06:18 UTC SENT (0.0014s) Starting TCP Handshake > 169.254.1.4:2181 RCVD (0.0014s) Handshake with 169.254.1.4:2181 completed SENT (1.0025s) Starting TCP Handshake > 169.254.1.4:2181 RCVD (1.0025s) Handshake with 169.254.1.4:2181 completed SENT (2.0036s) Starting TCP Handshake > 169.254.1.4:2181 RCVD (2.0036s) Handshake with 169.254.1.4:2181 completed Max rtt: 0.012ms | Min rtt: 0.010ms | Avg rtt: 0.010ms TCP connection attempts: 3 | Successful connections: 3 | Failed: 0 (0.00%) Nping done: 1 IP address pinged in 2.00 seconds Server network connections -------------------------- tcp 0 0 169.254.1.4:2181 169.254.1.1:56716 ESTABLISHED 16814/java NMS container manager Checking container-manager status Listing all images ------------------------ REPOSITORY TAG IMAGE ID CREATED SIZE sdwan/host-agent 1.0.1 ca71fd3fe4a2 5 months ago 131MB sdwan/cluster-oracle 1.0.1 8ef918482315 5 months ago 294MB sdwan/data-collection-agent 1.0.1 4bf055257027 5 months ago 157MB sdwan/application-server 19.1.0 6a9624dc3125 5 months ago 508MB sdwan/configuration-db 4.4.38 700fe6e56199 5 months ago 472MB sdwan/coordination-server 3.7.1 a04198d518b3 5 months ago 606MB sdwan/olap-db 23.3.13.6 a17712731d5f 5 months ago 494MB sdwan/device-data-collector 1.0.0 515f2793ee43 5 months ago 116MB sdwan/service-proxy 1.27.2 5174f58b97b1 5 months ago 105MB sdwan/messaging-server 0.20.0 9560cd4b7c42 5 months ago 105MB sdwan/statistics-db 7.17.6 b9f8ab30d647 5 months ago 589MB cloudagent-v2 3358cee09e99 66063bed474e 5 months ago 458MB sdwan/upgrade-coordinator 2.0.0 969cd2f1626a 5 months ago 93.3MB sdwan/vault 1.0.1 0883c094affc 6 months ago 511MB sdwan/support-tools latest 022aebae12e6 13 months ago 143MB sdavc 4.6.0 730e83b39087 17 months ago 602MB sdavc-gw 4.6.0 84083ed484ba 18 months ago 369MB sdwan/reporting latest 509ec99584fd 19 months ago 772MB sdwan/ratelimit latest 719f624e9268 2 years ago 45.7MB Listing all containers ------------------------ CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES c676b358b12d sdwan/olap-db:23.3.13.6 "/usr/bin/docker-ini…" 10 hours ago Up 10 hours (healthy) 127.0.0.1:8123->8123/tcp olap-db 627c1dcf16fa sdwan/coordination-server:3.7.1 "/docker-entrypoint.…" 10 hours ago Up 10 hours (healthy) 127.0.0.1:2181->2181/tcp, 127.0.0.1:2888->2888/tcp, 127.0.0.1:3888->3888/tcp coordination-server 9299443ff7a1 sdwan/messaging-server:0.20.0 "/entrypoint.sh" 10 hours ago Up 10 hours (healthy) 127.0.0.1:4222->4222/tcp, 127.0.0.1:6222->6222/tcp, 127.0.0.1:8222->8222/tcp messaging-server 0c5236ee911b sdwan/ratelimit:latest "/usr/local/bin/rate…" 10 hours ago Up 10 hours (healthy) 6379/tcp, 127.0.0.1:8460-8462->8460-8462/tcp ratelimit 094166df1cd9 cloudagent-v2:3358cee09e99 "./entrypoint.sh" 10 hours ago Up 10 hours 127.0.0.1:9051-9052->9051-9052/tcp cloudagent-v2 8f1287c11840 sdwan/reporting:latest "/sbin/tini -g -- py…" 10 hours ago Up 10 hours 80/tcp, 127.0.0.1:9080->9080/tcp reporting 66a46485cfab sdwan/vault:1.0.1 "docker-entrypoint.s…" 10 hours ago Up 10 hours (healthy) 8200/tcp, 127.0.0.1:8201->8201/tcp vault ccf5336112b6 sdwan/data-collection-agent:1.0.1 "/usr/bin/docker-ini…" 10 hours ago Up 10 hours (healthy) data-collection-agent 079ecfe36482 sdwan/service-proxy:1.27.2 "/entrypoint.sh" 10 hours ago Up 10 hours (healthy) service-proxy ec1b50457302 sdwan/configuration-db:4.4.38 "/usr/bin/docker-ini…" 10 hours ago Up 10 hours (healthy) 127.0.0.1:5000->5000/tcp, 127.0.0.1:6000->6000/tcp, 127.0.0.1:6362->6362/tcp, 127.0.0.1:6372->6372/tcp, 127.0.0.1:7000->7000/tcp, 127.0.0.1:7473-7474->7473-7474/tcp, 127.0.0.1:7687-7688->7687-7688/tcp configuration-db f54ccdcf7a14 sdwan/device-data-collector:1.0.0 "/bin/sh -c /vMDDC/v…" 10 hours ago Up 10 hours (healthy) 127.0.0.1:8129->8129/tcp device-data-collector 605f986dc9f1 sdwan/application-server:19.1.0 "/sbin/tini -g -- /e…" 10 hours ago Up 10 hours (healthy) application-server 50377e02b120 sdwan/host-agent:1.0.1 "/entrypoint.sh pyth…" 10 hours ago Up 10 hours (healthy) 127.0.0.1:9099->9099/tcp host-agent ca36faf52f36 sdwan/cluster-oracle:1.0.1 "/entrypoint.sh java…" 10 hours ago Up 10 hours (healthy) 127.0.0.1:9090->9090/tcp cluster-oracle Docker info ------------------------ Client: Context: default Debug Mode: false Server: Containers: 14 Running: 14 Paused: 0 Stopped: 0 Images: 19 Server Version: 20.10.25-ce Storage Driver: overlay2 Backing Filesystem: extfs Supports d_type: true Native Overlay Diff: true userxattr: false Logging Driver: local Cgroup Driver: cgroupfs Cgroup Version: 1 Plugins: Volume: local Network: bridge host ipvlan macvlan null overlay Log: awslogs fluentd gcplogs gelf journald json-file local logentries splunk syslog Swarm: inactive Runtimes: io.containerd.runc.v2 io.containerd.runtime.v1.linux runc Default Runtime: runc Init Binary: docker-init containerd version: 1e1ea6e986c6c86565bc33d52e34b81b3e2bc71f.m runc version: v1.1.4-8-g974efd2d-dirty init version: b9f42a0-dirty Security Options: seccomp Profile: default Kernel Version: 5.15.146-yocto-standard Operating System: Linux OSType: linux Architecture: x86_64 CPUs: 16 Total Memory: 30.58GiB Name: vmanage_1 ID: GHLX:JUWP:Z7JP:J3UX:MOF7:ZY7G:MSLS:E7BI:3LKT:2WRU:K2HZ:YWL7 Docker Root Dir: /var/lib/nms/docker Debug Mode: false Registry: https://index.docker.io/v1/ Labels: Experimental: false Insecure Registries: 127.0.0.0/8 Live Restore Enabled: false WARNING: No cpu cfs quota support WARNING: No cpu cfs period support WARNING: No blkio throttle.read_bps_device support WARNING: No blkio throttle.write_bps_device support WARNING: No blkio throttle.read_iops_device support WARNING: No blkio throttle.write_iops_device support NMS SDAVC server is disabled on this vmanage node NMS Device Data Collector Checking Device Data Collector Port.... Port 8129 is reachable Current Health Status:- true Getting docker stats of Device Data Collector container .... CONTAINER ID NAME CPU % MEM USAGE / LIMIT MEM % NET I/O BLOCK I/O PIDS f54ccdcf7a14 device-data-collector 0.00% 9.773MiB / 30.58GiB 0.03% 1.85MB / 876kB 0B / 0B 21 NMS OLAP database Checking cluster connectivity for ports 9000,8123,9009 ... Pinging vManage node 0 on 169.254.1.10:9000,8123,9009... Starting Nping 0.7.80 ( https://nmap.org/nping ) at 2026-02-24 06:18 UTC SENT (0.0013s) Starting TCP Handshake > 169.254.1.10:8123 RCVD (0.0013s) Handshake with 169.254.1.10:8123 completed SENT (1.0024s) Starting TCP Handshake > 169.254.1.10:9000 RCVD (1.0024s) Handshake with 169.254.1.10:9000 completed SENT (2.0036s) Starting TCP Handshake > 169.254.1.10:9009 RCVD (2.0036s) Handshake with 169.254.1.10:9009 completed SENT (3.0047s) Starting TCP Handshake > 169.254.1.10:8123 RCVD (3.0047s) Handshake with 169.254.1.10:8123 completed SENT (4.0058s) Starting TCP Handshake > 169.254.1.10:9000 RCVD (4.0058s) Handshake with 169.254.1.10:9000 completed SENT (5.0069s) Starting TCP Handshake > 169.254.1.10:9009 RCVD (5.0070s) Handshake with 169.254.1.10:9009 completed SENT (6.0081s) Starting TCP Handshake > 169.254.1.10:8123 RCVD (6.0081s) Handshake with 169.254.1.10:8123 completed SENT (7.0092s) Starting TCP Handshake > 169.254.1.10:9000 RCVD (7.0092s) Handshake with 169.254.1.10:9000 completed SENT (8.0103s) Starting TCP Handshake > 169.254.1.10:9009 RCVD (8.0103s) Handshake with 169.254.1.10:9009 completed Max rtt: 0.014ms | Min rtt: 0.008ms | Avg rtt: 0.009ms TCP connection attempts: 9 | Successful connections: 9 | Failed: 0 (0.00%) Nping done: 1 IP address pinged in 8.01 seconds Server network connections -------------------------- tcp 0 0 169.254.1.10:8123 169.254.1.1:38848 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38736 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38864 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38826 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:32996 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38792 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38720 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38704 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38790 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38740 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38786 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38576 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38766 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38754 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38828 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38676 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38770 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38620 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:32768 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38820 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38574 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38878 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38804 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38692 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38808 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38844 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:32984 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:60970 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:60974 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:51222 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38712 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38662 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:60986 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38598 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38640 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38652 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:32982 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38572 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38630 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38606 ESTABLISHED 18258/clickhouse-se Mode: SingleTenant ---------------------------- Node health state ---------------------------- Server status: [OK] Replica status: [OK] Database summary ---------------------------- database count: 5 table count in db(INFORMATION_SCHEMA) : 4 table count in db(backup) : 0 table count in db(default) : 61 table count in db(information_schema) : 4 table count in db(system) : 82 Tables in database default ---------------------------- - aggregated_apps_dpi_app_60min_summary_view_default - aggregated_apps_dpi_app_summary_default - aggregated_apps_dpi_site_5min_summary_view_default - aggregated_apps_dpi_site_summary_default - aggregated_apps_dpi_stats_default - aggregated_apps_dpi_summary_default - alarm_default - api_telemetry - api_telemetry_metadata - app_hosting_interface_stats_default - app_hosting_stats_default - approute_stats_default - approute_stats_routing_summary_default - approute_stats_transport_summary_default - art_stats_default - audit_log_default - bridge_interface_stats_default - bridge_mac_stats_default - cloudx_stats_default - device_configuration_default - device_events_default - device_health_stats_default - device_stats_files_default - device_system_status_stats_default - dpi_stats_default - eio_lte_stats_default - flow_log_stats_default - fwall_stats_default - interface_stats_default - ips_alert_stats_default - nwa_default - nwapending_default - nwpi_agg_metrics_default - nwpi_app_default - nwpi_domain_agg_trend_default - nwpi_domain_default - nwpi_flow_default - nwpi_flow_event_default - nwpi_flow_metric_default - nwpi_hops_of_flow_default - nwpi_routing_default - nwpi_te_default - nwpi_time_series_default - nwpi_trace_and_task_default - pagination_request_info_default - perf_mon_statistics_default - perf_mon_summary_default - perfmon_app_15min_summary_view_default - perfmon_app_summary_default - qos_stats_default - sdra_stats_default - site_health_stats_default - sleofflinereport_default - speed_test_default - sul_stats_default - tracker_stats_default - umbrella_stats_default - umtsrestevent_default - urlf_stats_default - vnf_stats_default - wlan_client_info_stats_default ---------------------------- ┌─parts.table──────────────────────────────┬──rows─┬─latest_modification─┬─disk_size──┬─primary_keys_size─┬─engine─────────────┬─bytes_size─┬─min_date───┬─max_date───┬─compressed_size─┬─uncompressed_size─┬─ratio─┐ │ device_system_status_stats_default │ 7238 │ 2026-02-24 06:13:12 │ 430.24 KiB │ 100.00 B │ MergeTree │ 440561 │ 2026-02-23 │ 2026-02-24 │ 0.00 B │ 0.00 B │ nan │ │ api_telemetry │ 34476 │ 2026-02-24 06:06:32 │ 306.22 KiB │ 264.00 B │ MergeTree │ 313574 │ tuple() │ tuple() │ 0.00 B │ 0.00 B │ nan │ │ audit_log_default │ 744 │ 2026-02-24 06:15:48 │ 200.16 KiB │ 48.00 B │ MergeTree │ 204967 │ 2026-02-23 │ 2026-02-24 │ 0.00 B │ 0.00 B │ nan │ │ device_events_default │ 4819 │ 2026-02-24 06:17:06 │ 189.26 KiB │ 245.00 B │ MergeTree │ 193802 │ 2026-02-23 │ 2026-02-24 │ 0.00 B │ 0.00 B │ nan │ │ interface_stats_default │ 7036 │ 2026-02-24 06:10:50 │ 117.07 KiB │ 104.00 B │ MergeTree │ 119879 │ 2026-02-23 │ 2026-02-24 │ 0.00 B │ 0.00 B │ nan │ │ alarm_default │ 408 │ 2026-02-23 21:48:41 │ 69.99 KiB │ 212.00 B │ ReplacingMergeTree │ 71671 │ 2026-02-23 │ 2026-02-23 │ 0.00 B │ 0.00 B │ nan │ │ api_telemetry_metadata │ 5342 │ 2026-02-24 06:01:04 │ 57.52 KiB │ 32.00 B │ MergeTree │ 58899 │ tuple() │ tuple() │ 0.00 B │ 0.00 B │ nan │ │ approute_stats_default │ 2540 │ 2026-02-24 06:10:20 │ 37.25 KiB │ 259.00 B │ MergeTree │ 38139 │ 2026-02-23 │ 2026-02-24 │ 0.00 B │ 0.00 B │ nan │ │ device_configuration_default │ 18 │ 2026-02-23 20:55:39 │ 33.97 KiB │ 51.00 B │ MergeTree │ 34787 │ 2026-02-23 │ 2026-02-23 │ 0.00 B │ 0.00 B │ nan │ │ device_health_stats_default │ 1463 │ 2026-02-24 06:15:00 │ 23.07 KiB │ 303.00 B │ ReplacingMergeTree │ 23626 │ 2026-02-23 │ 2026-02-24 │ 0.00 B │ 0.00 B │ nan │ │ site_health_stats_default │ 1413 │ 2026-02-24 06:15:01 │ 9.95 KiB │ 230.00 B │ ReplacingMergeTree │ 10185 │ 2026-02-23 │ 2026-02-24 │ 0.00 B │ 0.00 B │ nan │ │ approute_stats_routing_summary_default │ 70 │ 2026-02-23 20:30:17 │ 1.79 KiB │ 83.00 B │ MergeTree │ 1837 │ tuple() │ tuple() │ 0.00 B │ 0.00 B │ nan │ │ nwa_default │ 120 │ 2026-02-24 06:11:08 │ 1.69 KiB │ 32.00 B │ MergeTree │ 1734 │ 2026-02-23 │ 2026-02-24 │ 0.00 B │ 0.00 B │ nan │ │ approute_stats_transport_summary_default │ 18 │ 2026-02-23 20:30:17 │ 997.00 B │ 83.00 B │ MergeTree │ 997 │ tuple() │ tuple() │ 0.00 B │ 0.00 B │ nan │ └──────────────────────────────────────────┴───────┴─────────────────────┴────────────┴───────────────────┴────────────────────┴────────────┴────────────┴────────────┴─────────────────┴───────────────────┴───────┘ Application server stats --------------------------------- STATISTICS --------------------------------- Success: 20418 Fail: 0 CONN DOWN: 0 OOM: 0 ILL ARG: 0 --------------------------------- This action is not supported vmanage_1# -

개정 이력

| 개정 | 게시 날짜 | 의견 |

|---|---|---|

4.0 |

13-Oct-2023

|

vManage Cluster Upgrade 섹션 |

3.0 |

11-Jul-2023

|

컨트롤러 업그레이드 전에 수행할 사전 검사 |

2.0 |

27-Apr-2023

|

최초 릴리스 |

1.0 |

26-Apr-2023

|

최초 릴리스 |

Cisco 엔지니어가 작성

- 세사르 다니엘 아빌라기술 컨설팅 엔지니어

- 이안 에스트라다기술 컨설팅 엔지니어

지원 문의

- 지원 케이스 접수

- (시스코 서비스 계약 필요)

피드백

피드백