Mise à niveau des contrôleurs SD-WAN à l'aide de l'interface utilisateur graphique ou CLI vManage

Options de téléchargement

Langage exempt de préjugés

Dans le cadre de la documentation associée à ce produit, nous nous efforçons d’utiliser un langage exempt de préjugés. Dans cet ensemble de documents, le langage exempt de discrimination renvoie à une langue qui exclut la discrimination en fonction de l’âge, des handicaps, du genre, de l’appartenance raciale de l’identité ethnique, de l’orientation sexuelle, de la situation socio-économique et de l’intersectionnalité. Des exceptions peuvent s’appliquer dans les documents si le langage est codé en dur dans les interfaces utilisateurs du produit logiciel, si le langage utilisé est basé sur la documentation RFP ou si le langage utilisé provient d’un produit tiers référencé. Découvrez comment Cisco utilise le langage inclusif.

À propos de cette traduction

Cisco a traduit ce document en traduction automatisée vérifiée par une personne dans le cadre d’un service mondial permettant à nos utilisateurs d’obtenir le contenu d’assistance dans leur propre langue. Il convient cependant de noter que même la meilleure traduction automatisée ne sera pas aussi précise que celle fournie par un traducteur professionnel.

Table des matières

Introduction

Ce document décrit le processus de mise à niveau des contrôleurs de réseau étendu défini par logiciel (SD-WAN).

Conditions préalables

Exigences

Cisco vous recommande de prendre connaissance des rubriques suivantes :

- Réseau étendu défini par logiciel (SD-WAN) Cisco

- Cisco Software Central

- Téléchargez le logiciel Controllers depuis le site software.cisco.com

- Exécutez le script AURA avant la mise à niveau CiscoDevNet/sure : Prêt pour la mise à niveau SD-WAN

Il peut y avoir plusieurs raisons de planifier une mise à niveau des contrôleurs, telles que :

- Nouvelles versions avec de nouvelles fonctionnalités.

- Correction des avertissements/bugs connus.

- Versions différées.

Remarque : si la version a été différée, il est recommandé de mettre à niveau la version Gold-Star dès que possible. Les versions différées ne sont pas recommandées sur les contrôleurs de production en raison de défauts connus.

Quand il est temps de mettre à niveau vos contrôleurs, veuillez considérer les informations utiles suivantes :

- Vérifiez les notes de version des contrôleurs SD-WAN.

- Vérifiez les chemins de mise à niveau de Cisco vManage.

- Vérifiez que les contrôleurs Cisco SD-WAN répondent aux ressources informatiques recommandées.

- Vérifiez les avis de fin de vie et de fin de commercialisation des produits SD-WAN.

Remarque : L'ordre de mise à niveau des contrôleurs SD-WAN est vManage > vBonds > vSmarts.

Composants utilisés

Ce document est basé sur ces versions logicielles :

- Cisco vManage 20.12.6 et 20.15.4.1

- Cisco vBond et vSmart 20.12.16 et 20.15.4.1

The information in this document was created from the devices in a specific lab environment. All of the devices used in this document started with a cleared (default) configuration. Si votre réseau est en ligne, assurez-vous de bien comprendre l’incidence possible des commandes.

Prévérifications à effectuer avant une mise à niveau du contrôleur

Sauvegarder votre vManage

- Si le cloud est hébergé, vérifiez que la dernière sauvegarde est effectuée ou lancez une sauvegarde de config db comme mentionné dans l'étape suivante.

- Vous pouvez afficher les sauvegardes en cours et déclencher un snapshot à la demande à partir du portail SSP. Pour plus d'informations, cliquez ici.

- Si on-prem :

- effectuer une sauvegarde config-db

- Instantané de VM de tous les contrôleurs.

vManage# request nms configuration-db backup path /home/admin/db_backup

successfully saved the database to /home/admin/db_backup.tar.gz

- Si vous êtes sur site, collectez la commande show running-config et enregistrez-la localement.

- Si vous êtes sur place, assurez-vous de connaître votre nom d'utilisateur et votre mot de passe configuration-db (neo4j) et notez votre version actuelle exacte.

Si vous avez besoin d'aide pour récupérer vos identifiants configuration-db, vous pouvez contacter le TAC Cisco.

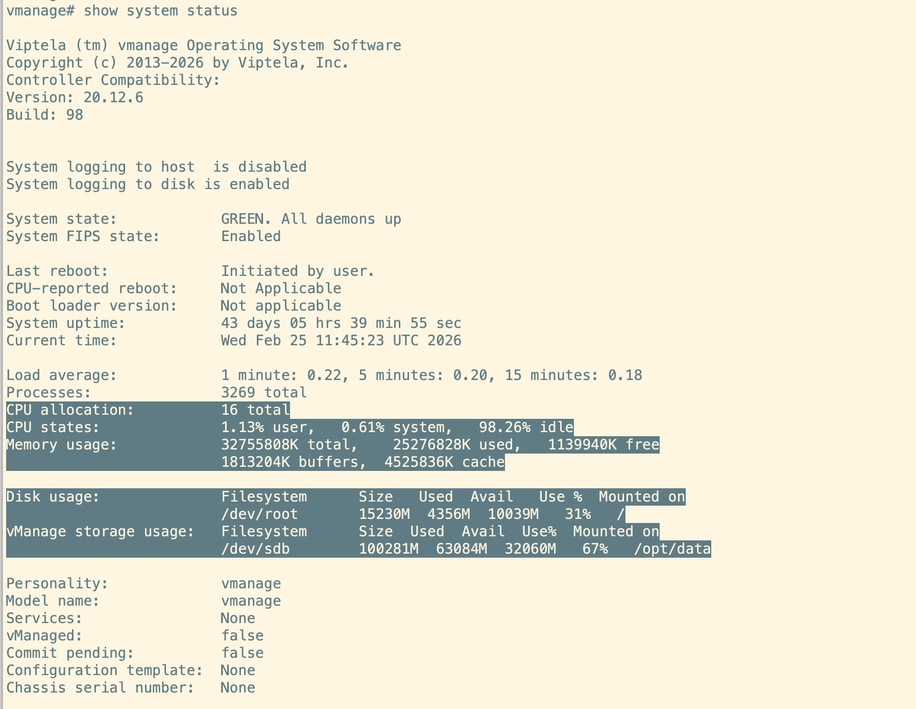

Calcul du système sur vManage

Remarque : Cette vérification s'applique également aux vBonds et aux vSmarts.

Sur l'interface de ligne de commande de chaque noeud vManage, exécutez la commande show system status. Assurez-vous que les ordinateurs requis sont mappés aux noeuds vManage. Vous pouvez vous reporter au guide de calcul.

Exécuter une vérification AURA

- Téléchargez et suivez les étapes afin d'exécuter AURA à partir de CiscoDevNet/sure : Prêt pour la mise à niveau SD-WAN

- Pour obtenir des instructions détaillées, reportez-vous au guide suivant : Configurer Le Déploiement Aura Avant La Mise À Niveau.

- Demandez à un représentant commercial du TAC de répondre à toute question relative aux contrôles ayant échoué dans le rapport AURA.

- À partir de la version 20.11.x, vManage exécute automatiquement AURA lorsque l'image est activée à l'aide de l'interface utilisateur vManage.

Utilisation de l'espace disque vManage

Avant de commencer la mise à niveau, vérifiez que l'utilisation du disque sur les trois partitions critiques (/boot, /rootfs.rw, et /opt/data) est de 60 % ou moins.

Pour le nettoyage, recherchez et supprimez les fichiers inutiles copiés par l'utilisateur ou les fichiers journaux non compressés.

Supprimez les fichiers admin-tech, les vidages de tas, les sauvegardes Neo4j, les vidages de threads ou les fichiers temporaires qui consomment de l'espace disque.

Si vous ne savez pas quels fichiers peuvent être supprimés en toute sécurité, ouvrez un dossier Cisco TAC pour obtenir de l'aide.

Assurez-vous que l'envoi aux contrôleurs/l'envoi à vBond est terminé

Dans l'interface utilisateur vManage, accédez à Configuration —> Certificats —> Contrôleurs et sélectionnez Envoyer vers vBond

Vérifier l'intervalle de collecte des statistiques vManage

Cisco recommande que l'intervalle de collecte de statistiques dans Administration > Settings soit défini sur le minuteur par défaut de 30 minutes.

Remarque : Cisco recommande de joindre vos vSmarts et vBonds au modèle vManage avant une mise à niveau.

Vérification des diagnostics NMS sur tous les noeuds vManage

Exécutez la commande « request nms all diagnostics » et assurez-vous que la requête NP pour tous les services NMS est réussie. Dans le cas d'un cluster vManage, ces vérifications doivent être effectuées sur tous les noeuds vManage :

Remarque : Dans un cluster vManage à 6 noeuds, configuration-db s'exécute sur 3 noeuds uniquement.

Recherchez configuration-db dans les diagnostics :

Assurez-vous que nous sommes en mesure d'obtenir les attributs configuration-db comme ci-dessous :

Assurez-vous que tous les noeuds vManage sont répertoriés dans l'état du cluster Neo4j pour « neo4j » et « system »

Assurez-vous que la validation du schéma a réussi et qu'aucun des noeuds Neo4j n'est mis en quarantaine.

Examinez l'intégralité du résultat et si des erreurs ou des échecs sont détectés, contactez le TAC avant de procéder à la mise à niveau.

Vérifier l'utilisation de l'espace disque sur les noeuds vManage

Assurez-vous qu'à l'exception de /rootfs.ro, aucune des autres partitions de disque n'a plus de 60 % d'utilisation. Vérifiez cela sur tous les noeuds vManage.

Vérification de l'espace disque sur vSmart et vBond

Utilisez la commande df -kh | démarrage grep à partir de vShell pour déterminer la taille du disque.

controller:~$ df -kh | grep boot

/dev/sda1 2.5G 232M 2.3G 10% /boot

controller:~$Si la taille est supérieure à 200 Mo, procédez à la mise à niveau des contrôleurs.

Si la taille est inférieure à 200 Mo, procédez comme suit :

1. Vérifiez que la version actuelle est la seule répertoriée sous la commande show software. Cette vérification s'applique aux 3 contrôleurs, vManage, vBond et vSmart.

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

------------------------------------------------------------------------------

20.12.6 true true false auto 2023-05-02T16:48:45-00:00

20.9.1 false false true user 2023-05-02T19:16:09-00:00

2. Vérifiez que la version actuelle est définie comme version par défaut sous la commande show software version. Cette vérification s'applique aux 3 contrôleurs, vManage, vBond et vSmart.

controller# request software set-default 20.12.6

status mkdefault 20.11.1: successful

controller#

3. Si d’autres versions sont répertoriées, supprimez toutes les versions qui ne sont pas actives à l’aide de la commande request software remove <version>. Cela augmente l'espace disponible pour poursuivre la mise à niveau. Cette vérification s'applique aux 3 contrôleurs, vManage, vBond et vSmart.

controller# request software remove 20.9.1

status remove 20.9.1: successful

vedge-1# show software

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

------------------------------------------------------------------------------

20.12.6 true true false auto 2023-05-02T16:48:45-00:00

controller#

4. Vérifiez l'espace disque afin de vous assurer qu'il est supérieur à 200 Mo. Si ce n'est pas le cas, ouvrez une demande de service TAC.

Commandes Avant et Après

Avant et après la mise à niveau, exécutez ces commandes pour vérifier que les contrôleurs ont convergé correctement :

-

show control connections

Assurez-vous que chaque contrôleur dispose de connexions de contrôle actives avec tous les autres contrôleurs (maillage global). -

show omp peers (vSmart uniquement)

Vérifiez le nombre d'homologues OMP sur chaque contrôleur vSmart. -

show omp summary (vSmart uniquement)

Vérifiez l'état OMP global et les informations sur les homologues. -

show running policy (vSmart uniquement)

Vérifiez que toutes les stratégies prévues sont actives et visibles sur le contrôleur.Examinez le résultat de ces commandes avant et après la mise à niveau pour garantir la stabilité du réseau et une convergence appropriée.

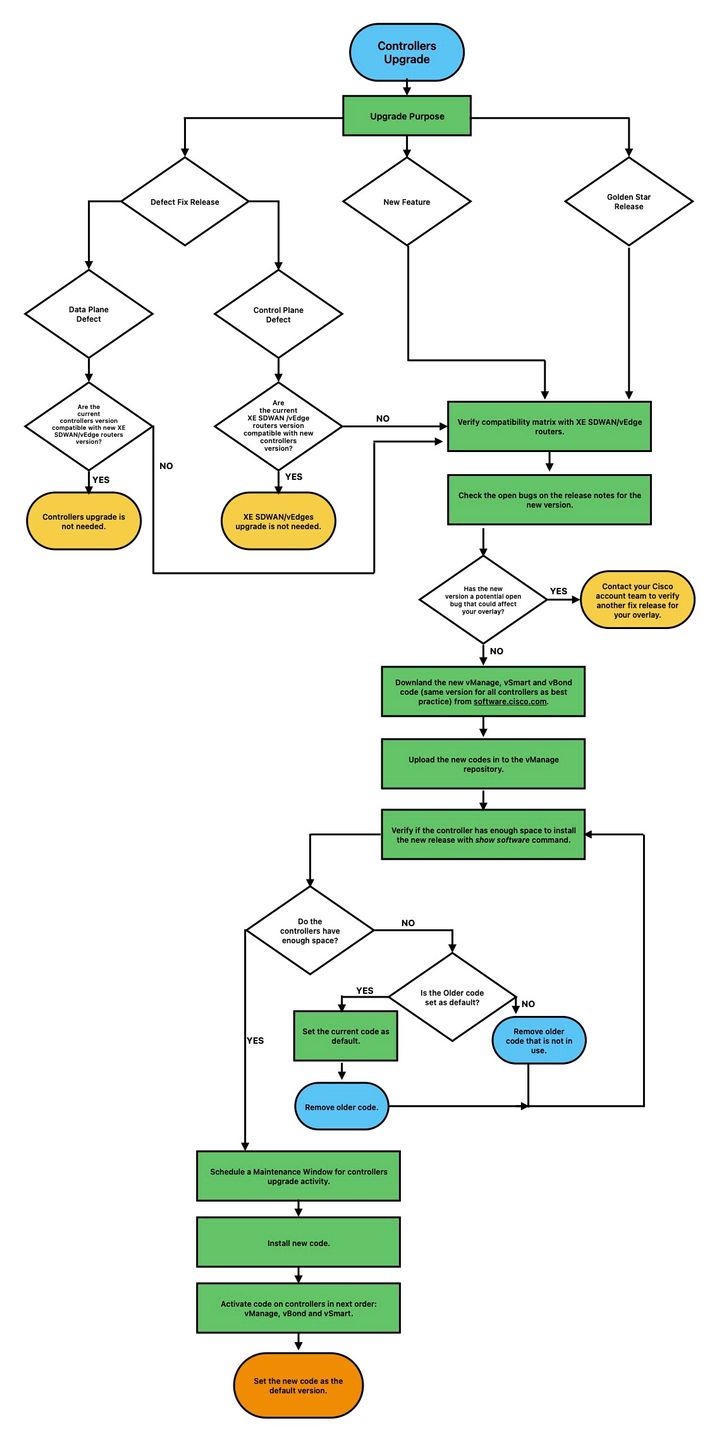

Workflow de mise à niveau des contrôleurs

Mise à niveau du cluster vManage

Dans le cas d'une mise à niveau de cluster, les étapes mentionnées dans le guide Cisco SD-WAN Getting Started Guide - Cluster Management [Cisco SD-WAN] - Cisco guide doivent être suivies.

Remarque : La mise à niveau du cluster vManage n'a aucun impact sur le réseau de données. Pour vManage autonome, nous pouvons installer et activer le nouveau logiciel à l'aide de l'interface utilisateur vManage. Pour le cluster vManage, il est recommandé d'installer le logiciel à l'aide de l'interface utilisateur vManage et d'activer le logiciel à l'aide de l'interface de ligne de commande vManage à l'aide du logiciel de requête activate < > comme décrit dans la section Mise à niveau des contrôleurs SD-WAN via l'interface de ligne de commande ci-dessous.

Mise en garde : si vous avez des questions ou des problèmes lors de la mise à niveau de votre cluster, contactez le TAC avant de continuer.

Mise à niveau des contrôleurs SD-WAN via l'interface graphique utilisateur (GUI) vManage

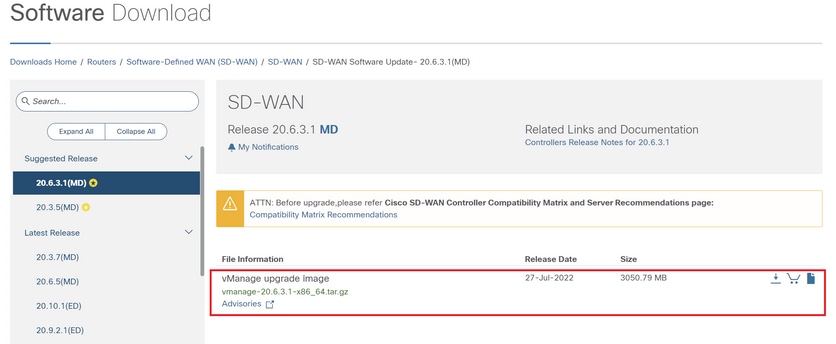

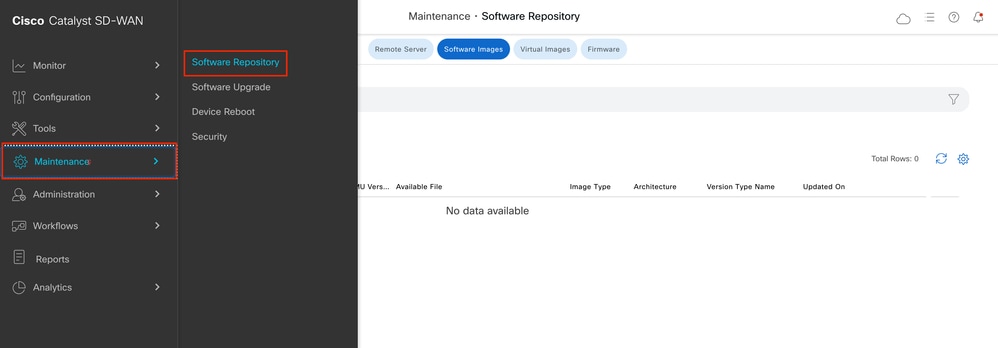

Étape 1. Télécharger les images logicielles dans le référentiel vManage

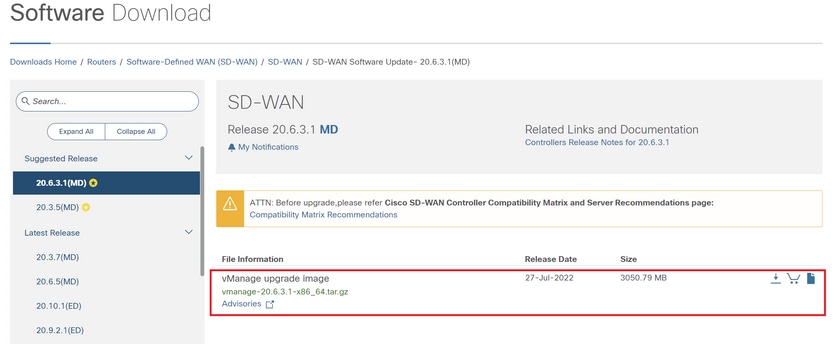

Accédez à Téléchargement de logiciel et téléchargez l'image de version de logiciel requise pour vManage.

Remarque : Il existe deux types d'images pour les contrôleurs : nouveau déploiement et mise à niveau. Dans le cadre de ce guide, l'image à télécharger doit être une image de mise à niveau.

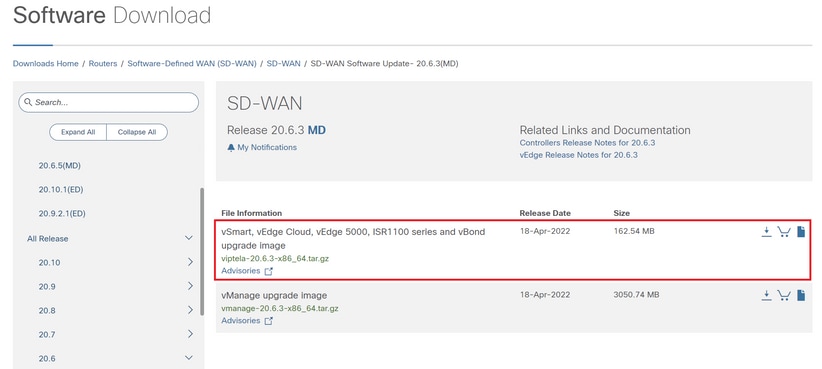

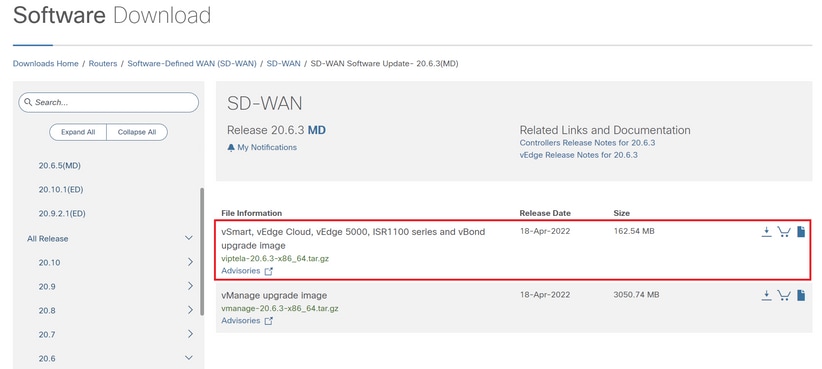

Accédez à Software Download et téléchargez l'image de la version du logiciel pour vBond et vSmart.

Remarque : L'image de mise à niveau pour vBond et vSmart est identique.

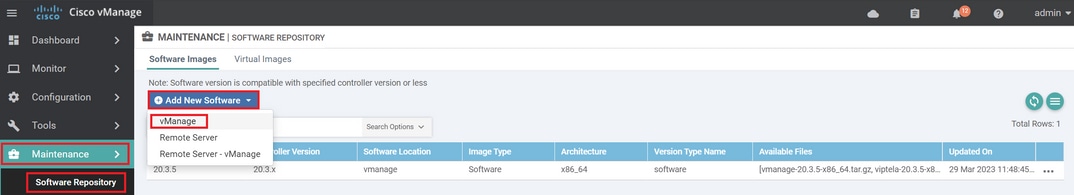

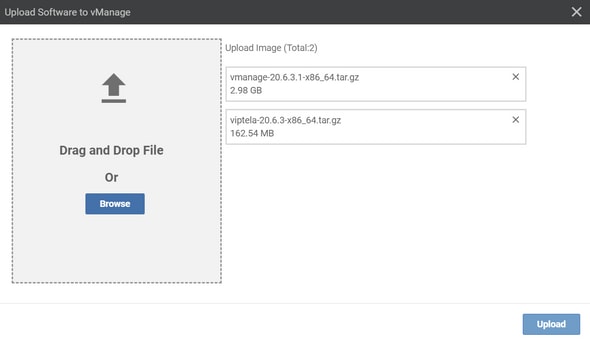

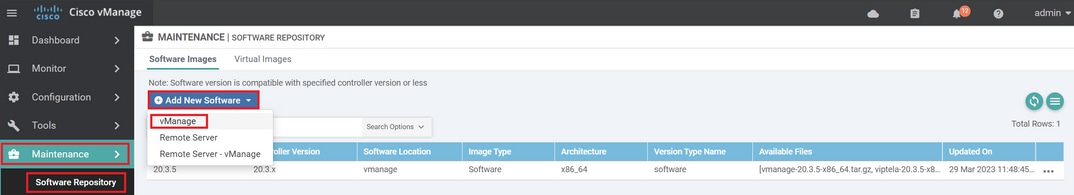

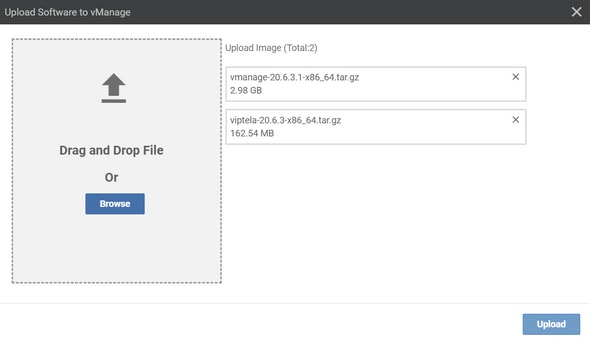

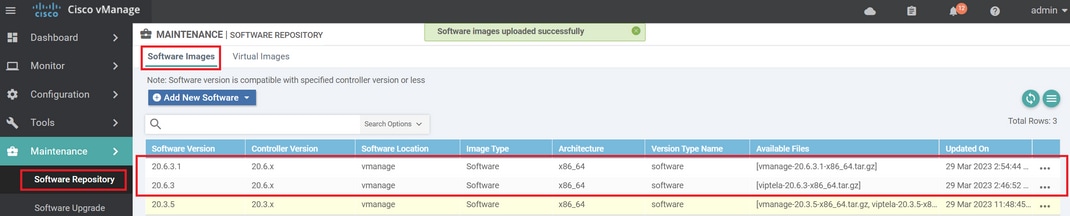

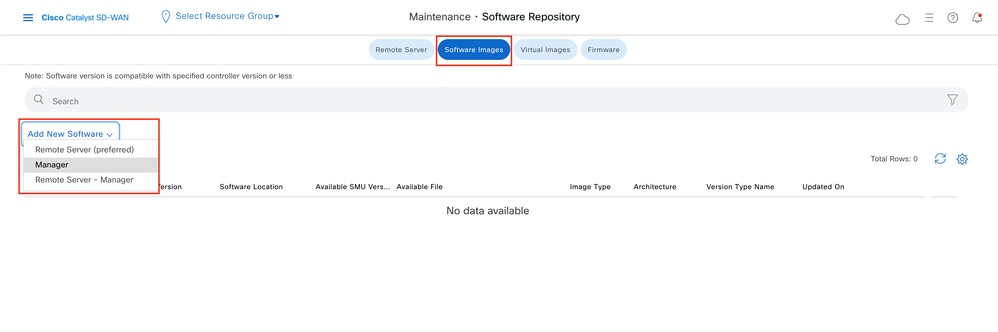

Pour télécharger les nouvelles images, accédez à Maintenance > Référentiel de logiciels > Images de logiciels.

Cliquez sur Add New Software et sélectionnez vManage dans le menu déroulant.

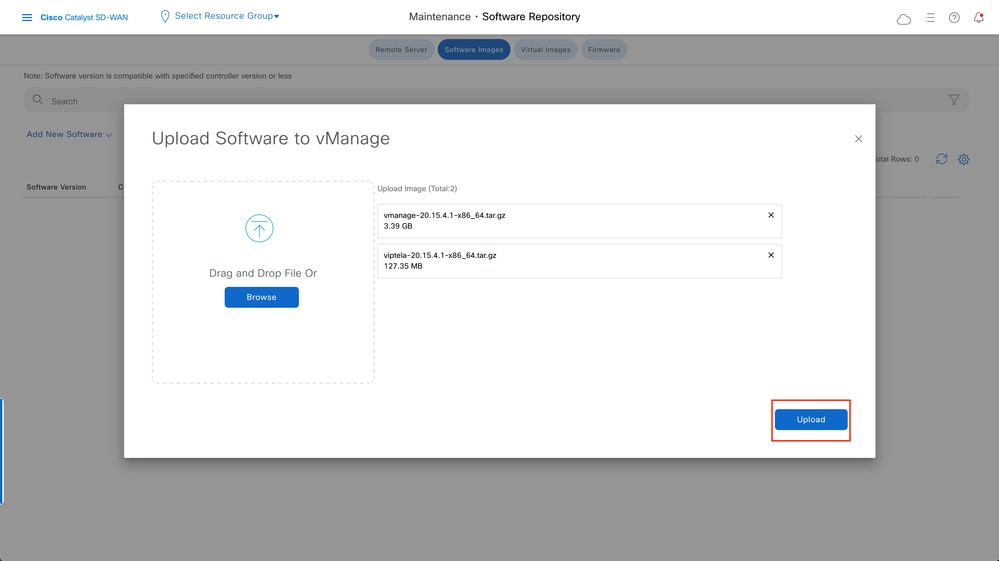

Sélectionnez les images et cliquez sur Upload.

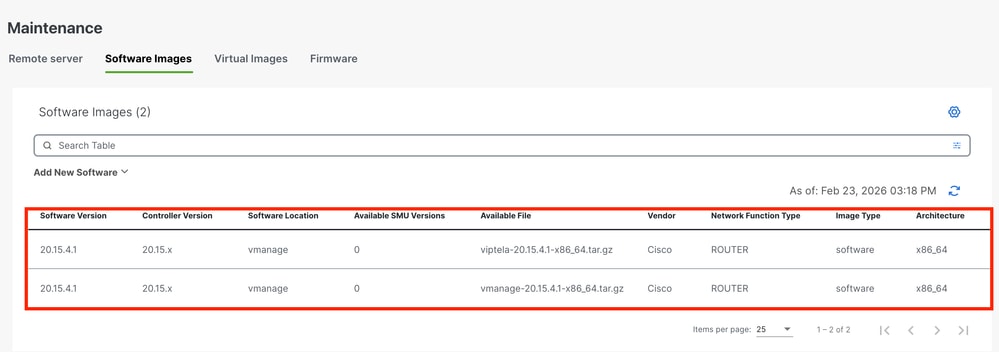

Une fois les images téléchargées, vérifiez qu'elles sont répertoriées dans Référentiel de logiciels > Images de logiciels.

Étape 2. Installation, activation et définition de la nouvelle version par défaut

Cette étape explique comment effectuer la mise à niveau en trois étapes : l'installation, l'activation et la définition de la nouvelle version par défaut.

vManage

Mise en garde : Assurez-vous que vous avez validé les vérifications préalables à effectuer avant une mise à niveau vManage.

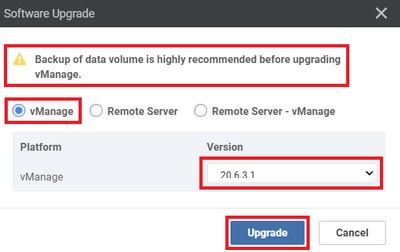

Étape A. Installation

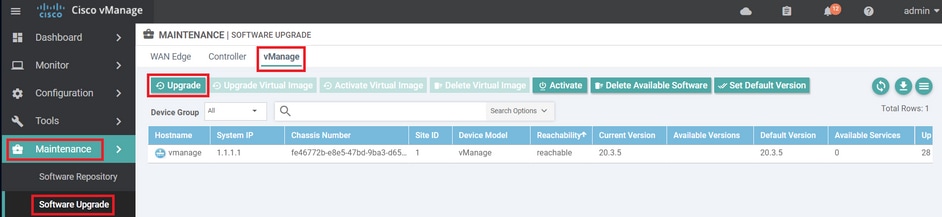

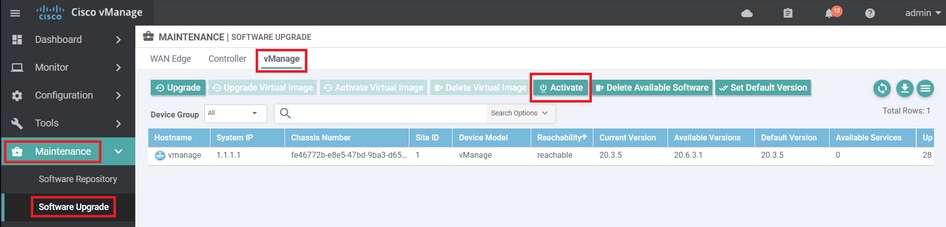

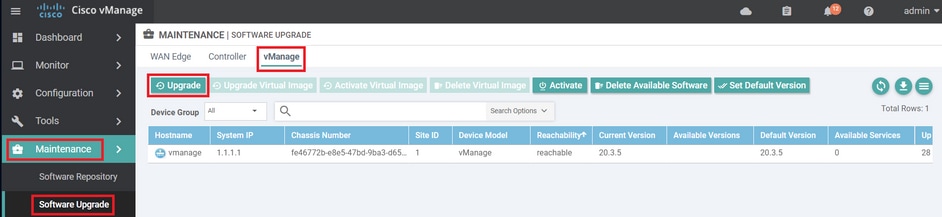

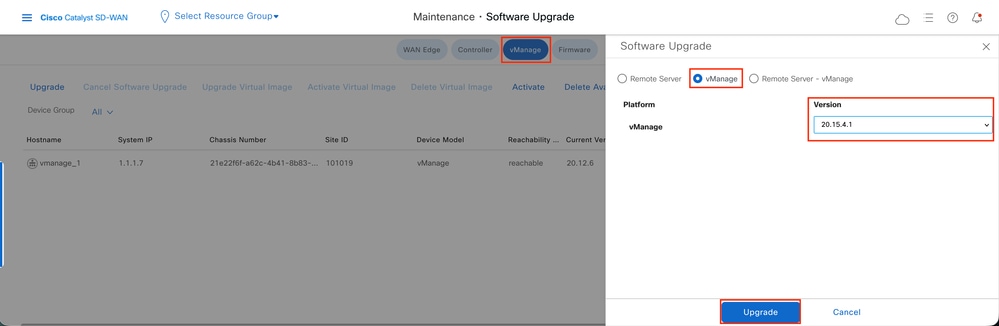

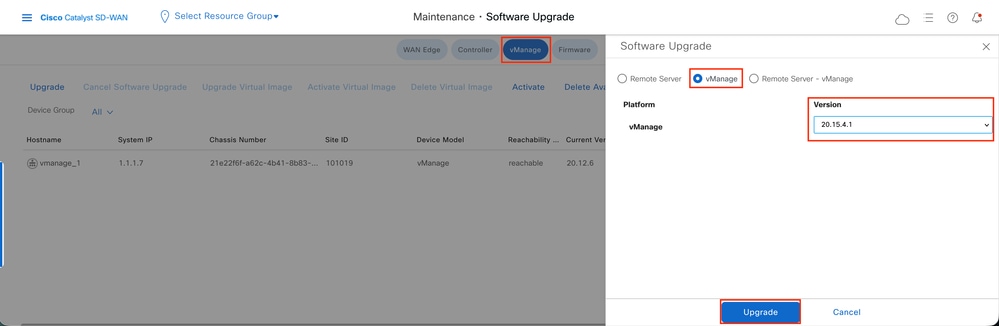

Dans le menu principal, accédez à Maintenance > Mise à niveau logicielle > vManage et cliquez sur Mise à niveau.

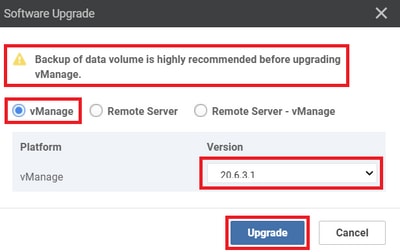

Dans la fenêtre contextuelle Mise à niveau logicielle, procédez comme suit :

- Sélectionnez l'onglet vManage.

- Sélectionnez la version de l'image vers laquelle effectuer la mise à niveau dans la liste déroulante Version.

- Cliquez sur Upgrade.

Remarque : Ce processus n'exécute pas un redémarrage de vManage, il transfère, décompresse et crée uniquement les répertoires nécessaires à la mise à niveau.

Remarque : La sauvegarde du volume de données est vivement recommandée avant de procéder à la mise à niveau de vManage.

Vérifiez l'état de la tâche jusqu'à ce qu'elle s'affiche comme Réussite.

Étape B. Activation

À cette étape, vManage active la nouvelle version du logiciel installé et redémarre automatiquement pour démarrer avec le nouveau logiciel.

Accédez à Maintenance > Software Upgrade > vManage, et cliquez sur Activate.

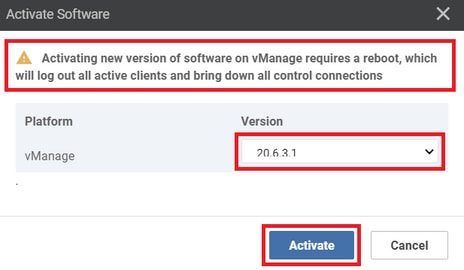

Sélectionnez la nouvelle version et cliquez sur Activate.

Remarque : L'accès à l'interface utilisateur graphique n'est pas disponible pendant le redémarrage de vManage. L'activation complète peut prendre jusqu'à 60 minutes.

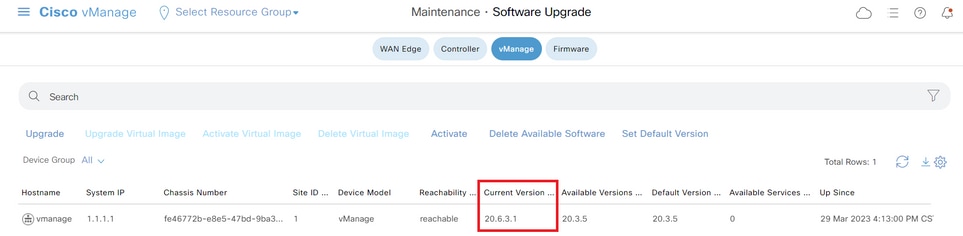

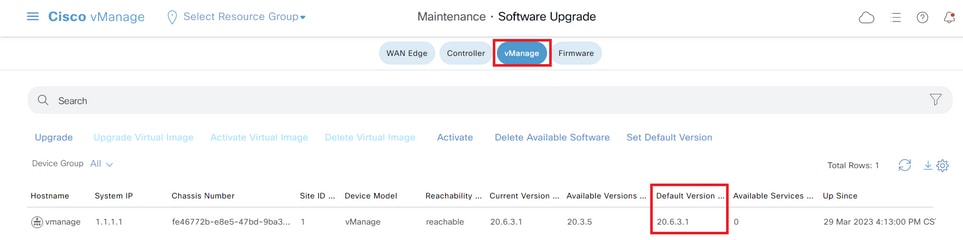

Une fois le processus terminé, connectez-vous et accédez à Maintenance > Software Upgrade > Manager pour vérifier que la nouvelle version est activée.

Étape C. Définition de la version logicielle par défaut

Vous pouvez définir une image logicielle comme image par défaut sur un périphérique Cisco SD-WAN. Il est recommandé de définir la nouvelle image par défaut après avoir vérifié que le logiciel fonctionne comme souhaité sur le périphérique et sur le réseau.

Si une réinitialisation d'usine est effectuée sur le périphérique, celui-ci démarre avec l'image définie par défaut.

Remarque : Il est recommandé de définir la nouvelle version comme version par défaut, car si vManage redémarre, l'ancienne version est démarrée. La base de données peut être endommagée. Une version rétrogradée d'une version principale à une version plus ancienne n'est pas prise en charge dans vManage.

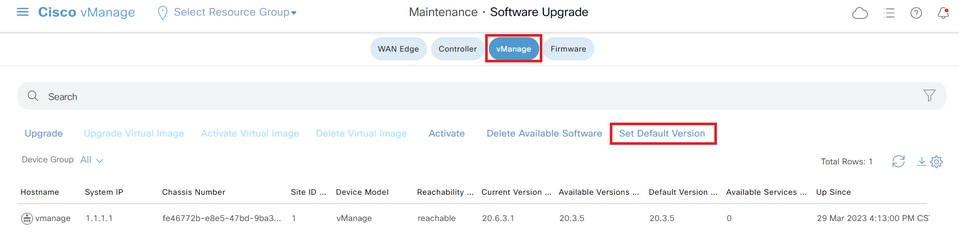

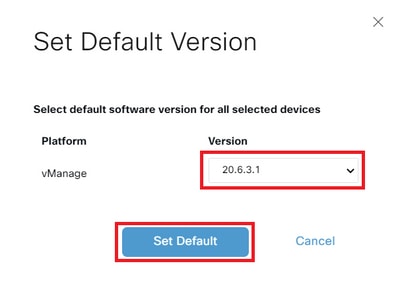

Pour définir une image logicielle comme image par défaut, procédez comme suit :

- Accédez à Maintenance > Software Upgrade> Manager > Software Image Actions.

- Cliquez sur Set Default Version, sélectionnez la nouvelle version dans la liste déroulante et cliquez sur Set Default.

Remarque : Ce processus n'effectue pas de redémarrage de vManage.

Vérifiez l'état de la tâche jusqu'à ce qu'elle s'affiche comme Réussite.

Pour vérifier la version par défaut, accédez à Maintenance > Software Upgrade > Manager.

Obligation

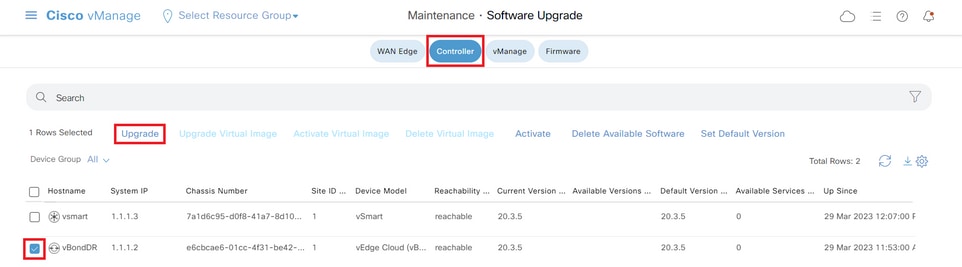

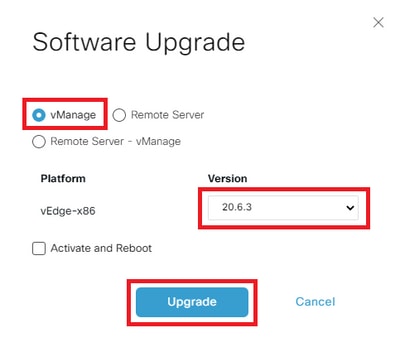

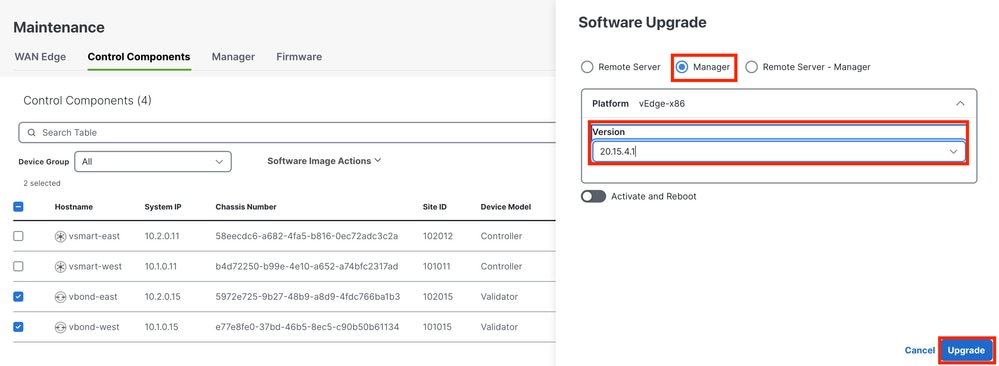

Étape A. Installation

À cette étape, vManage envoie le nouveau logiciel à vBond et installe la nouvelle image.

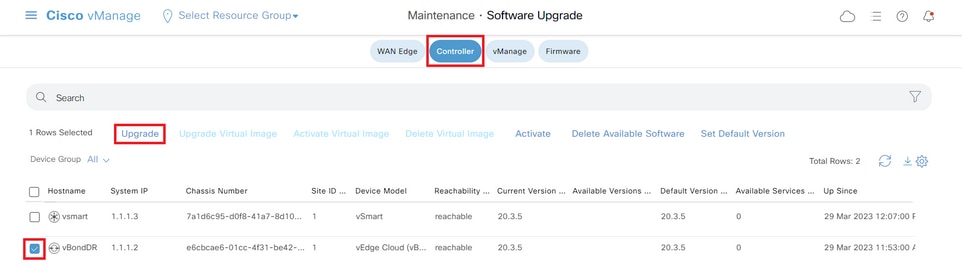

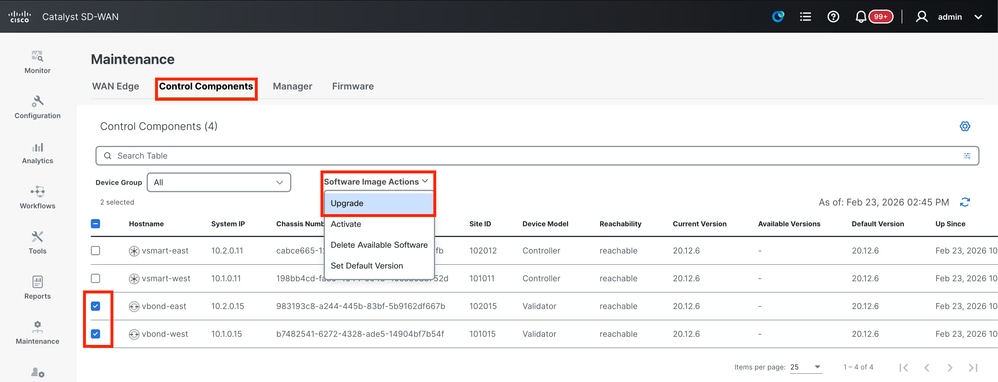

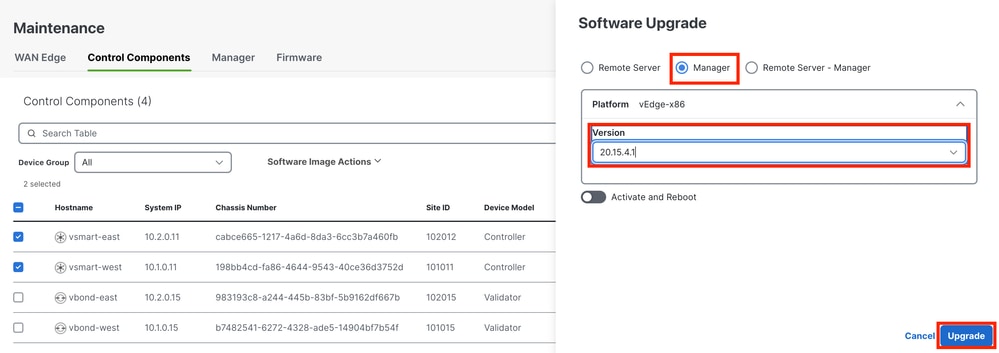

Accédez à Maintenance > Software Upgrade > Control Components et cliquez sur Upgrade.

Dans la fenêtre contextuelle Mise à niveau logicielle, procédez comme suit :

- Sélectionnez l'onglet Gérer.

- Sélectionnez la version de l'image vers laquelle effectuer la mise à niveau dans la liste déroulante Version.

- Cliquez sur Mettre à niveau.

Remarque : Ce processus n'exécute pas un redémarrage du vBond, il transfère, décompresse et crée uniquement les répertoires nécessaires à la mise à niveau.

Vérifiez l'état de la tâche jusqu'à ce qu'elle s'affiche comme Réussite.

Étape B. Activation

À cette étape, vBond active la nouvelle version du logiciel installé et redémarre automatiquement pour démarrer avec le nouveau logiciel.

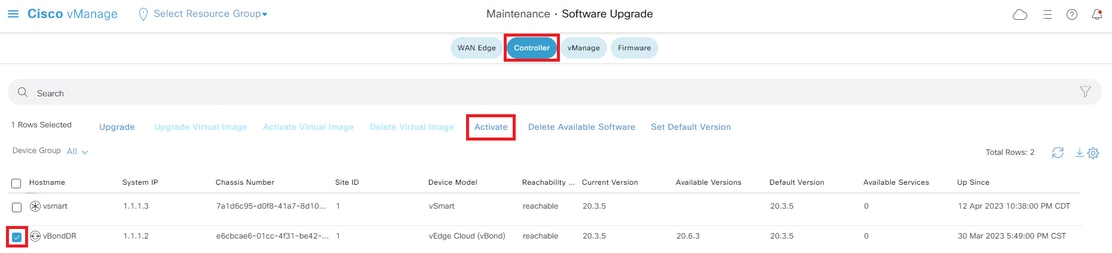

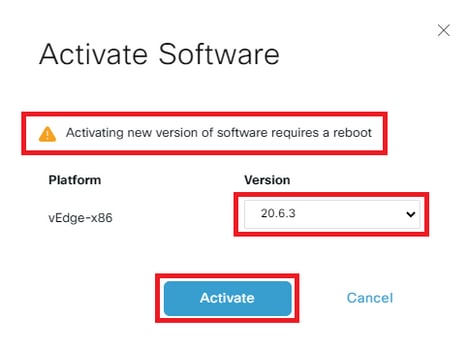

Accédez à Maintenance>Software Upgrade>Control Components, puis cliquez sur Activate.

Sélectionnez la nouvelle version et cliquez sur Activate.

Remarque : Ce processus nécessite un redémarrage de vBond. L'activation complète peut prendre jusqu'à 30 minutes.

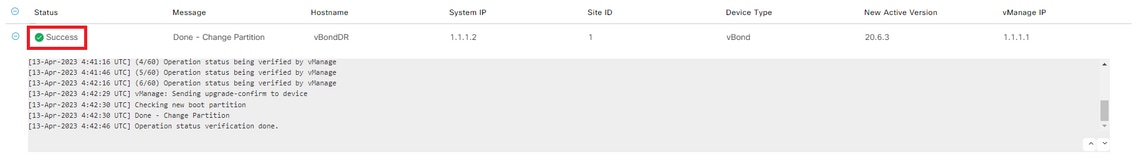

Vérifiez l'état de la tâche jusqu'à ce qu'elle s'affiche comme Réussite.

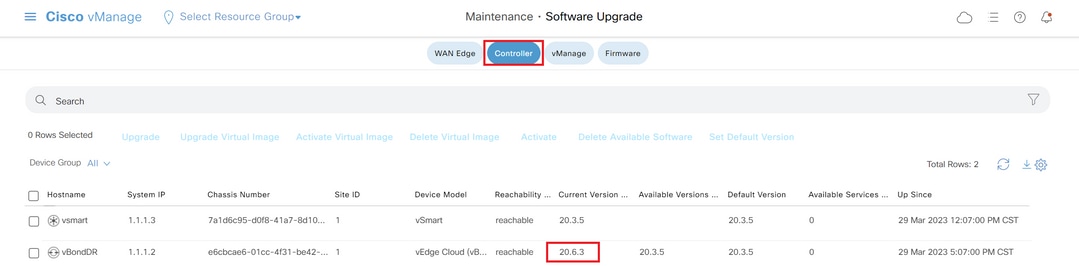

Une fois le processus terminé, accédez à Maintenance > Software Upgrade > Control Components pour vérifier que la nouvelle version est activée.

Étape facultative. Activation et redémarrage de la nouvelle image logicielle

Remarque : Cette étape est facultative. Vous pouvez cocher la case de l'option Activate and Reboot pendant le processus d'installation. Suivez cette procédure pour installer et activer la nouvelle version du logiciel mise à niveau.

Étape C. Définition de la version logicielle par défaut

Vous pouvez définir une image logicielle comme image par défaut sur un périphérique Cisco SD-WAN. Il est recommandé de définir la nouvelle image par défaut après avoir vérifié que le logiciel fonctionne comme souhaité sur le périphérique et sur le réseau.

Si une réinitialisation d'usine est effectuée sur le périphérique, celui-ci démarre avec l'image définie par défaut.

Pour définir une image logicielle comme image par défaut, procédez comme suit :

- Accédez à Maintenance>Mise à niveau logicielle>Composants de contrôle > Actions d'image logicielle.

- Cliquez sur Définir la version par défaut, sélectionnez la nouvelle version dans la liste déroulante et cliquez sur Définir la version par défaut.

Remarque : Ce processus n'effectue pas de redémarrage de vBond.

Vérifiez l'état de la tâche jusqu'à ce qu'elle s'affiche comme Réussite.

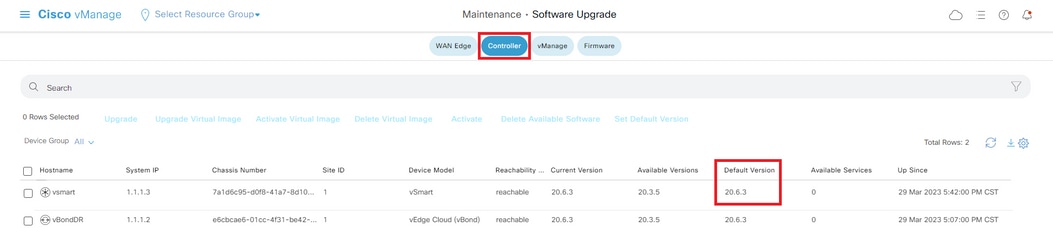

Pour vérifier la version par défaut, accédez à Maintenance > Software Upgrade > Control Components.

vSmart

Directives de mise à niveau vSmart (contrôleur)

- Cisco recommande de mettre à niveau 50 % des contrôleurs vSmart en premier. Après la mise à niveau initiale, surveillez la stabilité du système pendant au moins 24 heures. Si aucun problème n'est observé, poursuivez la mise à niveau des contrôleurs vSmart restants.

- Pour la mise à niveau de vSmart (contrôleur), Cisco recommande d'utiliser l'interface utilisateur graphique vManage au lieu de l'interface de ligne de commande.

Remarque : l'interface graphique utilisateur vManage offre un processus de mise à niveau plus simple et convivial.

Avant de mettre à niveau les contrôleurs vSmart, assurez-vous que les conditions requises sont remplies pour maintenir un fonctionnement transparent du plan de données après la mise à niveau.

Conditions préalables

Étape 1. Collecter des captures d'écran de référence à partir du tableau de bord

- Pour les contrôleurs vSmart, accédez à Monitor > Overview > Controller > System Status pour capturer l'utilisation du processeur et de la mémoire.

- Collectez la commande en temps réel show omp summary à partir de tous les vSmarts sur le vManage.

Étape 2 : vérification des notifications d’état d’homologue OMP

- Consultez le tableau de bord des événements ou des alarmes pour toute notification indiquant l'état d'arrêt de l'homologue OMP.

- Pour ce faire, accédez à Monitor > Logs > Alarms/Events et recherchez les alertes pertinentes avant de procéder à la mise à niveau.

Étape 3. Sauvegarde des configurations vSmart

- Collecter la configuration en cours de tous les contrôleurs vSmart, y compris la stratégie vSmart actuelle.

- Enregistrez ces configurations en tant que sauvegarde pour vous assurer que vous pourrez restaurer les paramètres si nécessaire après la mise à niveau.

Étape 4. Vérification de l’espace disque

Vérifiez l'utilisation du disque sur votre vSmart pour vous assurer qu'il y a suffisamment d'espace libre avant de commencer la mise à niveau. Portez une attention particulière aux partitions qui sont à pleine capacité ou presque, telles que

/var/volatile/log/tmplogdans le résultat ci-dessous, qui est actuellement à 100 %. Résolvez les problèmes de stockage nécessaires pour éviter les pannes de mise à niveau ou les interruptions de fonctionnement.vSmart# df -h

Filesystem Size Used Avail Use% Mounted on

none 7.6G 4.0K 7.6G 1% /dev

/dev/nvme0n1p1 7.9G 1.8G 6.0G 23% /boot

/dev/loop0 139M 139M 0 100% /rootfs.ro

/dev/nvme1n1 20G 7.6G 12G 41% /rootfs.rw

aufs 20G 7.6G 12G 41% /

tmpfs 7.6G 728K 7.6G 1% /run

shm 7.6G 16K 7.6G 1% /dev/shm

tmp 1.0G 16K 1.0G 1% /tmp

tmplog 120M 120M 0 100% /var/volatile/log/tmplog

svtmp 2.0M 1.2M 876K 58% /etc/sv

vSmart#Étape 5. Surveillance de l'utilisation des ressources vSmart

- Vérifiez l'utilisation du processeur et de la mémoire sur les contrôleurs vSmart.

- Dans vshell, exécutez les commandes opandfree -m pour collecter les statistiques de ressources actuelles

vSmart# vshell

vSmart~$top

vSmart~$ free -mÉtape 6. Vérification de l'état OMP et du contrôle sur tous les vSmarts

- Effectuez une vérification OMP et de contrôle sur tous les vSmarts pour établir une ligne de base avant d'effectuer des modifications.

- Exécutez la commande show omp summary et enregistrez le résultat en tant que référence de l'état d'origine pour comparaison après la mise à niveau.

- Utilisez show control summary et show control connections pour confirmer que le nombre de connexions de contrôle aux arêtes, aux autres vSmarts, vBonds et vManage est correct.

- Exécutez show control local-properties pour obtenir des détails supplémentaires sur le plan de contrôle.

- Exécute la commande show system status pour s'assurer que chaque vSmart a l'état « vManaged » sous forme de valeur et que le « modèle de configuration » n'est pas défini sur None.

Étape 7. Validation des exemples de périphériques de périphérie

Sélectionnez un échantillon de 10 à 15 périphériques dans différentes listes de sites et effectuez les vérifications suivantes :

- Exécutez la commande show sdwan omp peer pour vous assurer que chaque périphérique dispose d'appairages OMP actifs avec tous les vSmarts attendus.

- Exécutez la commande show sdwan omp summary pour consulter l'état OMP global.

- Utilisez show sdwan bfd sessions pour capturer le nombre de sessions BFD actives et leur temps de disponibilité.

Paramètres de configuration recommandés par Cisco

Bien que cela ne soit pas obligatoire pour la mise à niveau, Cisco recommande fortement ces bonnes pratiques de configuration pour garantir un fonctionnement optimal.

Minuteur de mise en attente OMP

- Pour les versions logicielles20.12.1 et ultérieures, configurez le minuteur de mise en attente OMP sur300 secondes.

- Pour les versions antérieures à 20.12.1, définissez le minuteur de mise en attente OMP sur 60 secondes.

Compteur de redémarrage progressif OMP

- Le minuteur par défaut de 12 heures (43 200 secondes) est généralement suffisant pour maintenir les tunnels du plan de données pendant les pannes vSmart temporaires.

Temporisateur de nouvelle clé IPsec

- Pour empêcher la nouvelle génération de clé IPsec lorsque le protocole OMP est arrêté, configurez le compteur de nouvelle clé IPsec à deux fois la valeur du compteur de redémarrage en douceur OMP.

Ces paramètres permettent d'améliorer la stabilité du réseau et de minimiser les interruptions lors des pannes planifiées ou non.

Passez à l'étape suivante uniquement si toutes les vérifications ont réussi.

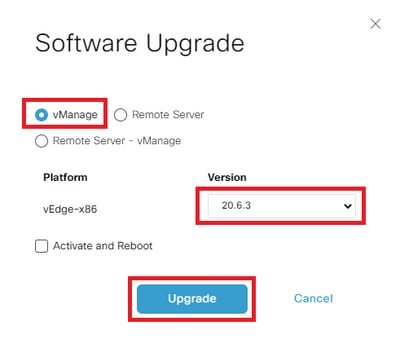

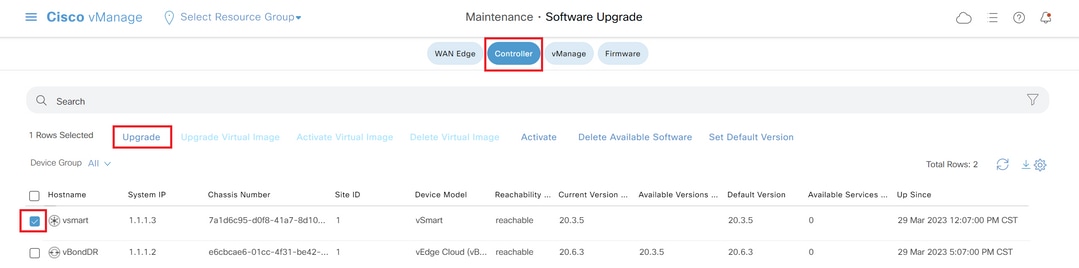

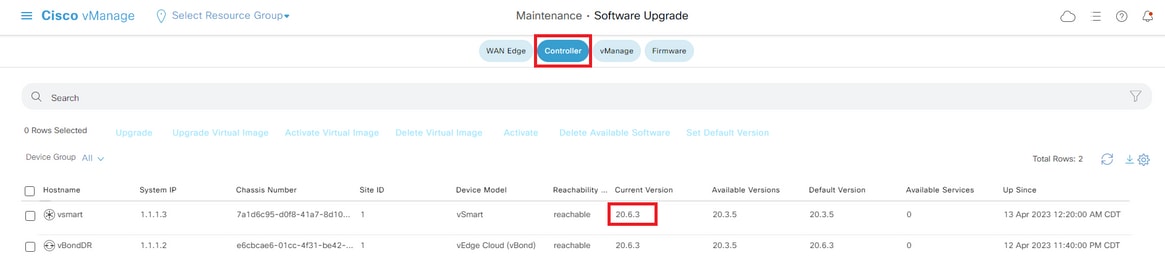

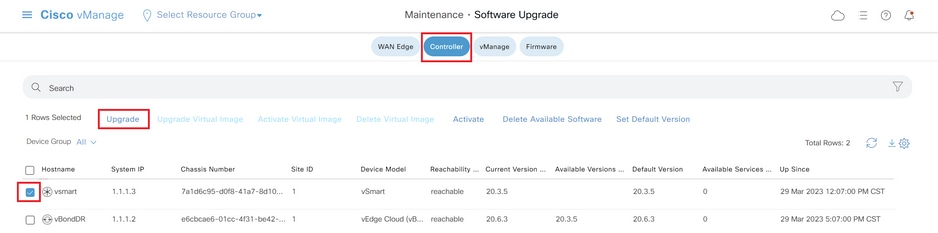

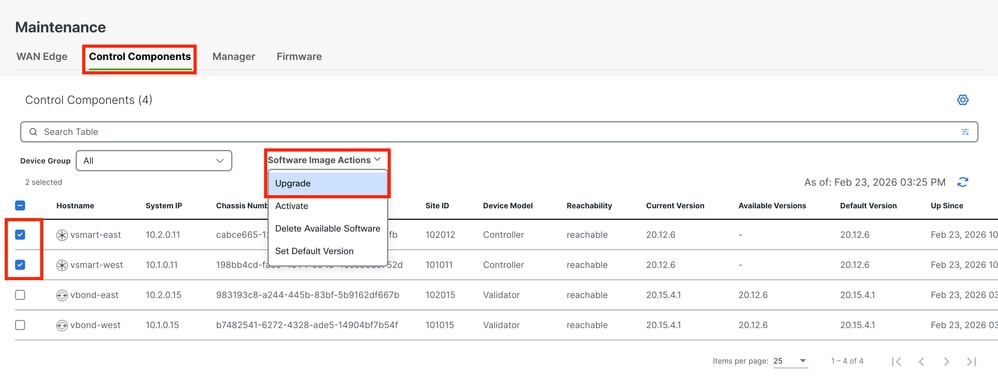

Étape A. Installation

À cette étape, vManager envoie le nouveau logiciel à vSmart et installe la nouvelle image.

Accédez à Maintenance>Mise à niveau logicielle>Contrôleur et cliquez sur Mise à niveau.

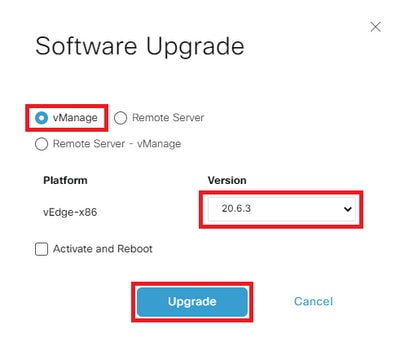

Dans la fenêtre contextuelle Mise à niveau logicielle, procédez comme suit :

- Sélectionnez l'onglet vManage.

- Sélectionnez la version de l'image vers laquelle effectuer la mise à niveau dans la liste déroulante Version.

- Cliquez sur Mettre à niveau.

Remarque : Ce processus n'exécute pas un redémarrage de la vSmart, mais transfère, décompresse et crée uniquement les répertoires nécessaires à la mise à niveau.

Vérifiez l'état de la tâche jusqu'à ce qu'elle s'affiche comme Réussite.

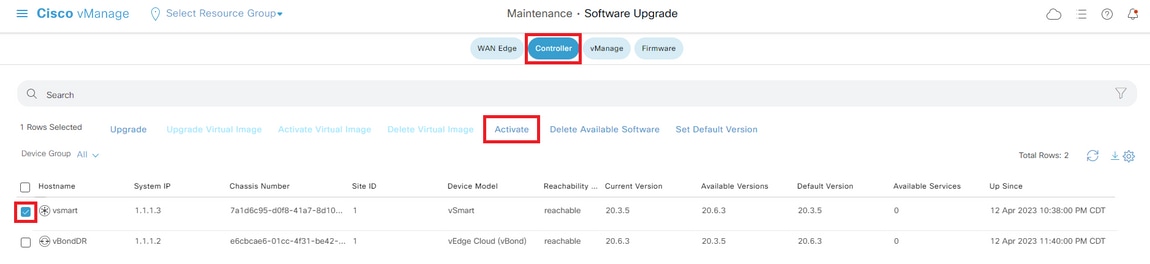

Étape B. Activation

À cette étape, vSmart active la nouvelle version du logiciel installé et redémarre automatiquement pour démarrer avec le nouveau logiciel.

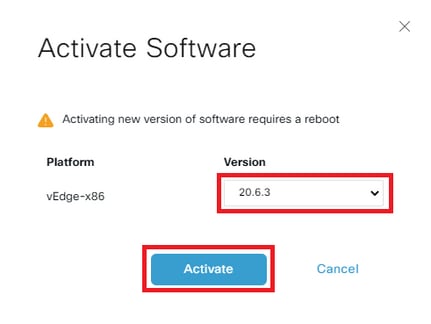

Accédez à Maintenance>Mise à niveau logicielle>Contrôleur, puis cliquez sur Activer.

Sélectionnez la nouvelle version et cliquez sur Activate.

Remarque : Ce processus nécessite un redémarrage de vSmart. L'activation complète peut prendre jusqu'à 30 minutes.

Vérifiez l'état de la tâche jusqu'à ce qu'elle s'affiche comme Réussite.

Une fois le processus terminé, accédez à Maintenance > Software Upgrade > Controller pour vérifier que la nouvelle version est activée.

Étape facultative. Activation et redémarrage de la nouvelle image logicielle

Remarque : Cette étape est facultative. Vous pouvez cocher la case de l'option Activate and Reboot pendant le processus d'installation. Suivez cette procédure pour installer et activer la nouvelle version du logiciel mise à niveau.

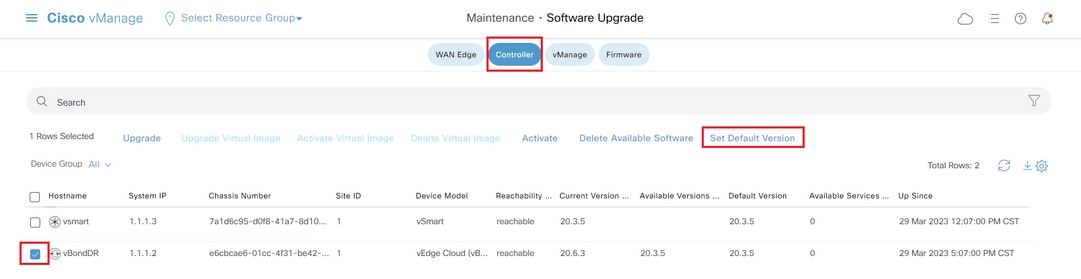

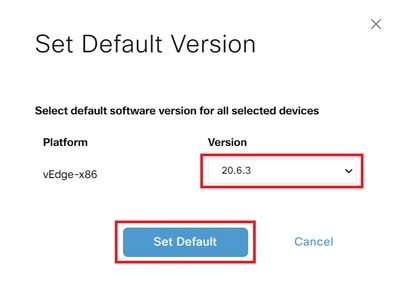

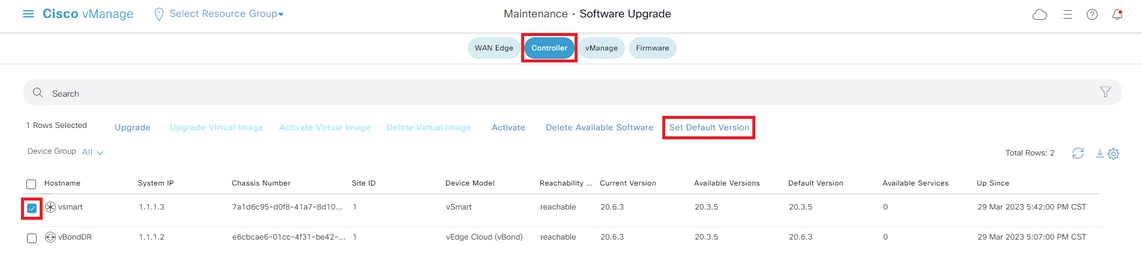

Étape C. Définition de la version logicielle par défaut

Vous pouvez définir une image logicielle comme image par défaut sur un périphérique Cisco SD-WAN. Il est recommandé de définir la nouvelle image par défaut après avoir vérifié que le logiciel fonctionne comme souhaité sur le périphérique et sur le réseau.

Si une réinitialisation d'usine est effectuée sur le périphérique, celui-ci démarre avec l'image définie par défaut.

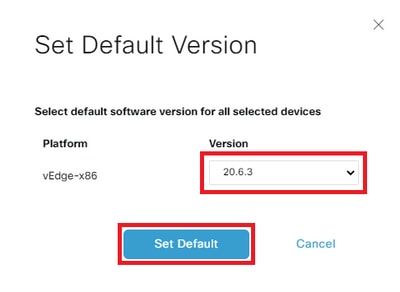

Pour définir une image logicielle comme image par défaut, procédez comme suit :

- Accédez à Maintenance>Mise à niveau logicielle>Contrôleur.

- Cliquez sur Définir la version par défaut, sélectionnez la nouvelle version dans la liste déroulante et cliquez sur Définir la version par défaut.

Remarque : Ce processus n'effectue pas de redémarrage de vSmart.

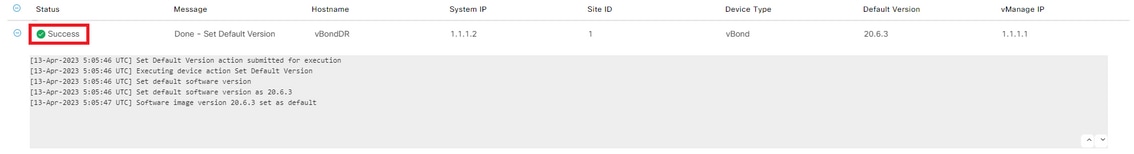

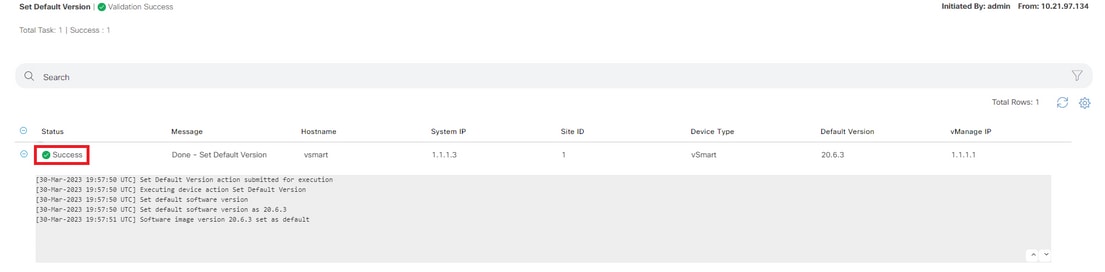

Vérifiez l'état de la tâche jusqu'à ce qu'elle s'affiche comme Réussite.

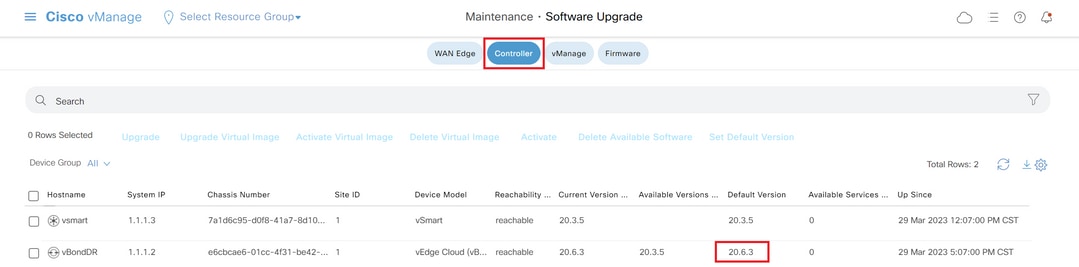

Pour vérifier la version par défaut, accédez à Maintenance > Software Upgrade > Controller.

Mise à niveau des contrôleurs SD-WAN via CLI

Étape 1. Installation

Il existe deux options pour installer l'image :

Option 1: À partir de l'interface de ligne de commande avec HTTP, FTP ou TFTP.

Pour installer l'image logicielle depuis l'interface de ligne de commande :

-

Configurez le délai pour confirmer qu'une mise à niveau logicielle a réussi. Le temps peut être de 1 à 60 minutes.

Viptela# system upgrade-confirm minutes - Installez le logiciel :

Viptela#request software install url/vmanage-20.15.4.1-x86_64.tar.gz [reboot]Spécifiez l'emplacement de l'image de l'une des manières suivantes :

- Le fichier image se trouve sur le serveur local :

/directory-path/

Vous pouvez utiliser la fonction de saisie semi-automatique de l'interface en ligne de commande pour compléter le chemin et le nom de fichier.

- Le fichier image se trouve sur un serveur FTP.

ftp://hostname/

- Le fichier image se trouve sur un serveur HTTP.

http://hostname/

- Le fichier image se trouve sur un serveur TFTP.

tftp://hostname/

Spécifiez éventuellement l'identificateur VPN dans lequel se trouve le serveur.

L'option de démarrage active la nouvelle image logicielle et redémarre le périphérique une fois l'installation terminée.

3. Si vous n'avez pas inclus l'option de redémarrage à l'étape 2, activez la nouvelle image logicielle et cela effectue automatiquement un redémarrage de l'instance pour démarrer la nouvelle version.

Viptela#request software activate4. Confirmez, dans le délai de confirmation de mise à niveau configuré (12 minutes par défaut), que l'installation du logiciel a réussi :

Viptela#request software upgrade-confirmSi vous n'exécutez pas cette commande dans ce délai, le périphérique revient automatiquement à l'image logicielle précédente.

Option 2: Depuis l'interface graphique vManage

Cette étape vous aide à télécharger les images dans le référentiel vManage.

Accédez à Téléchargement de logiciel et téléchargez l'image de version de logiciel pour vManage.

Accédez à Software Download et téléchargez l'image de la version du logiciel pour vBond et vSmart.

Pour télécharger les nouvelles images, dans le menu principal, accédez à Maintenance > Référentiel de logiciels > Images de logiciels, cliquez sur Ajouter un nouveau logiciel et sur l'option de glisser-déposer sélectionnez vManage.

Sélectionnez les images et cliquez sur Upload.

Pour vérifier si les images sont disponibles, accédez à Référentiel de logiciels > Images de logiciels.

Remarque : Cette procédure doit être effectuée pour tous les contrôleurs.

vManage:

Cliquez sur Mettre à niveau.

vBond :

Cliquez sur Upgrade.

vSmart :

Cliquez sur Upgrade.

Dans la fenêtre contextuelle Mise à niveau logicielle, procédez comme suit :

- Sélectionnez l'onglet vManage.

- Sélectionnez la version de l'image vers laquelle effectuer la mise à niveau dans la liste déroulante Version.

- Cliquez sur Mettre à niveau.

Pour vManage :

Pour vBond et vSmart :

Étape 2. Activation

Une fois l'installation terminée, vérifiez les images logicielles qui sont installées dans les contrôleurs.

vmanage# show software

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

---------------------------------------------------------------------------

20.12.6 true true - - 2023-02-01T22:25:24-00:00

20.15.4.1 false false false - -vbond# show software

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

--------------------------------------------------------------------------

20.12.6 true true - - 2022-10-01T00:30:40-00:00

20.15.4.1 false false false - -vsmart# show software

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

--------------------------------------------------------------------------

20.12.6 true true - - 2022-10-01T00:31:34-00:00

20.15.4.1 false false false - -Remarque : Pour activer l'image, exécutez la commande suivante dans les contrôleurs (Controller by Controller, 1st vManage, 2nd vBond, 3rd vSmart). Dans le cas d'un cluster vManage, il est important d'activer le logiciel sur tous les noeuds vManage du cluster ensemble.

vmanage# request software activate ?

Description: Display software versions

Possible completions:

20.12.6

20.15.4.1

clean Clean activation

now Activate software version

vmanage# request software activate 20.15.4.1

This will reboot the node with the activated version.

Are you sure you want to proceed? [yes,NO] yes

Broadcast message from root@vmanage (console) (Tue Feb 28 01:01:04 2023):

Tue Feb 28 01:01:04 UTC 2023: The system is going down for reboot NOW!vbond# request software activate ?

Description: Display software versions

Possible completions:

20.12.6

20.15.4.1

clean Clean activation

now Activate software version

vbond# request software activate 20.15.4.1

This will reboot the node with the activated version.

Are you sure you want to proceed? [yes,NO] yes

Broadcast message from root@vbond (console) (Tue Feb 28 01:05:59 2023):

Tue Feb 28 01:05:59 UTC 2023: The system is going down for reboot NOWvsmart# request software activate ?

Description: Display software versions

Possible completions:

20.12.6

20.15.4.1

clean Clean activation

now Activate software version

vsmart# request software activate 20.15.4.1

This will reboot the node with the activated version.

Are you sure you want to proceed? [yes,NO] yes

Broadcast message from root@vsmart (console) (Tue Feb 28 01:13:44 2023):

Tue Feb 28 01:13:44 UTC 2023: The system is going down for reboot NOW!Remarque : Les contrôleurs activent la nouvelle image et redémarrent eux-mêmes.

Pour vérifier que la nouvelle version du logiciel est activée, exécutez la commande suivante :

vmanage# show version

20.15.4.1

vmanage# show software

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

---------------------------------------------------------------------------

20.12.6 false true true - 2023-02-01T22:25:24-00:00

20.15.4.1 true false false auto 2023-02-28T01:05:14-00:00vbond# show version

20.15.4.1

vbond# show software

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

--------------------------------------------------------------------------

20.12.6 false true true - 2022-10-01T00:30:40-00:00

20.15.4.1 true false false - 2023-02-28T01:09:05-00:00vsmart# show version

20.15.4.1

vsmart# show software

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

--------------------------------------------------------------------------

20.12.6 false true true - 2022-10-01T00:31:34-00:00

20.15.4.1 true false false - 2023-02-28T01:16:36-00:00Étape 3. Définition de la version logicielle par défaut

Vous pouvez définir une image logicielle comme image par défaut sur un périphérique Cisco SD-WAN. Il est recommandé de définir la nouvelle image par défaut après avoir vérifié que le logiciel fonctionne comme souhaité sur le périphérique et sur le réseau.

Si une réinitialisation d'usine est effectuée sur le périphérique, celui-ci démarre avec l'image définie par défaut.

Remarque : Il est recommandé de définir la nouvelle version comme version par défaut, car si vManage redémarre, l'ancienne version est démarrée. La base de données peut être endommagée. Une version rétrogradée d'une version principale à une version plus ancienne n'est pas prise en charge dans vManage.

Remarque : Ce processus n'effectue pas de redémarrage des contrôleurs.

Pour définir une version logicielle par défaut, exécutez la commande suivante dans les contrôleurs :

vmanage# request software set-default ?

Possible completions:

20.12.6

20.15.4.1

cancel Cancel this operation

start-at Schedule start.

| Output modifiers

<cr>

vmanage# request software set-default 20.15.4.1

status mkdefault 20.15.4.1: successfulvbond# request software set-default ?

Possible completions:

20.12.6

20.15.4.1

cancel Cancel this operation

start-at Schedule start.

| Output modifiers

<cr>

vbond# request software set-default 20.15.4.1

status mkdefault 20.15.4.1: successfulvsmart# request software set-default ?

Possible completions:

20.12.6

20.15.4.1

cancel Cancel this operation

start-at Schedule start.

| Output modifiers

<cr>

vsmart# request software set-default 20.15.4.1

status mkdefault 20.15.4.1: successfulPour vérifier que la nouvelle version par défaut est définie sur les contrôleurs, exécutez la commande suivante :

vmanage# show software

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

---------------------------------------------------------------------------

20.12.6 false false true - 2023-02-01T22:25:24-00:00

20.15.4.1 true true false auto 2023-02-28T01:05:14-00:00vbond# show software

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

--------------------------------------------------------------------------

20.12.6 false false true - 2022-10-01T00:30:40-00:00

20.15.4.1 true true false - 2023-02-28T01:09:05-00:00vsmart# show software

VERSION ACTIVE DEFAULT PREVIOUS CONFIRMED TIMESTAMP

--------------------------------------------------------------------------

20.12.6 false false true - 2022-10-01T00:31:34-00:00

20.15.4.1 true true false - 2023-02-28T01:16:36-00:00Mise à niveau du cluster vManage/vManage avec reprise après sinistre activée

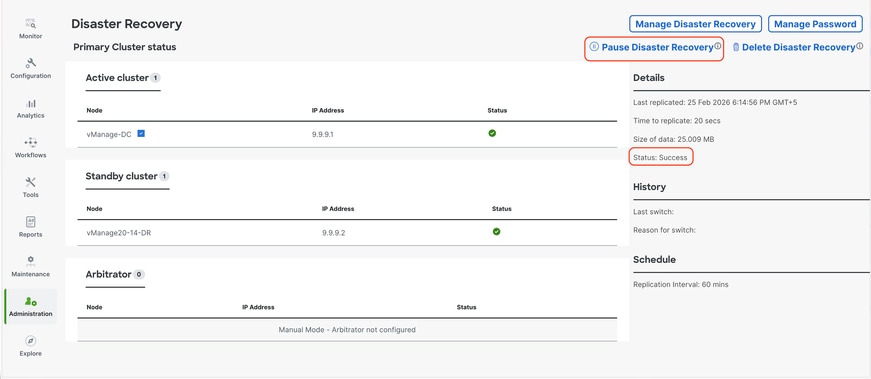

Pour le cluster vManage ou vManage dans lequel la reprise après sinistre est activée,

Vérifiez qu'aucune réplication de reprise après sinistre n'est en cours. Accédez à Administration —> Reprise après sinistre et assurez-vous que l'état est Réussite et qu'il n'est pas dans un état transitoire tel que Importation en attente, Exportation en attente ou Téléchargement en attente. Il est important d'interrompre la reprise après sinistre sur le vManage actif actuel.

Si l'état n'est pas Success, attendez que l'état s'affiche comme Success. S'il reste bloqué sur un autre état pendant une période plus longue (plus d'une heure selon l'intervalle de réplication défini), contactez le TAC Cisco et assurez-vous que la réplication réussit avant de poursuivre la pause de la reprise après sinistre.

Tout d'abord, suspendez la reprise après sinistre et assurez-vous que la tâche est réussie. Procédez ensuite à la mise à niveau d'Active vManage conformément aux étapes décrites ci-dessus.

Remarque : pour Active vManage autonome, nous pouvons installer et activer le nouveau logiciel à l'aide de l'interface utilisateur de vManage. Pour le cluster vManage actif, il est recommandé d'installer le logiciel à l'aide de l'interface utilisateur vManage et d'activer le logiciel à l'aide de l'interface de ligne de commande vManage à l'aide du logiciel de demande activate < > comme décrit dans la section Mise à niveau des contrôleurs SD-WAN via l'interface de ligne de commande ci-dessous.

Pour le cluster vManage/vManage de secours, nous devons installer et activer le logiciel à l'aide de l'interface de ligne de commande des noeuds vManage.

-

Contrôles de validation post-mise à niveau

-

Vérifier les versions logicielles : Vérifiez que tous les contrôleurs exécutent la version logicielle prévue.

-

Vérifiez les services du gestionnaire SD-WAN : Assurez-vous que tous les services sur les instances de SD-WAN Manager sont opérationnels.

-

Valider les connexions de contrôle entre les contrôleurs : Vérifiez que les connexions de contrôle sont établies et stables entre tous les contrôleurs.

-

Confirm Policy Activation : vérifiez que la stratégie est activée sur le gestionnaire SD-WAN.

-

Check Control Connection Distribution : Assurez-vous que les connexions de contrôle sont correctement distribuées sur tous les noeuds du gestionnaire SD-WAN. Accédez à Monitor > Network et vérifiez la colonne Control.

-

Tests post-mise à niveau au niveau du site : Effectuez les vérifications suivantes sur tous les sites où des vérifications préalables à la mise à niveau ont été effectuées :

-

Connexions de contrôle et sessions BFD :

show sd-wan control connections

show sd-wan bfd sessions -

Vérification du routage :

show ip route

show ip route vrf <vrf_id>

show sd-wan omp routes vpn <vpn_id> -

Accessibilité du data center : Vérifier la connectivité aux services du data center

-

Synchronisation des modèles : Vérifiez que les modèles de périphériques sont connectés et synchronisés sur les périphériques après la mise à niveau.

-

Vérification des stratégies par les contrôleurs :

-

show sd-wan policy from-controller

-

Test d'acceptation utilisateur : Effectuer des tests sur les sites migrés pour valider la fonctionnalité des applications

-

Plan de restauration

Plan de restauration vBond et vSmart

Si des problèmes inattendus sont observés avec le Validator (vBond) ou le Controller (vSmart) après la mise à niveau, revenez à la version précédente du logiciel en activant l'image plus ancienne sur les périphériques concernés.

vSmart# request software activate <older image version>

vBond# request software activate <older image version>Plan de restauration vManage

Si des problèmes inattendus se produisent avec le gestionnaire SD-WAN (vManage) après la mise à niveau, restaurez le système à l'aide du snapshot pris avant la mise à niveau.

Remarque : vManage ne prend pas en charge la rétrogradation vers des versions précédentes via l'interface de ligne de commande.

Dépannage

1. Si l'interface utilisateur graphique s'arrête pendant une longue période après l'activation, et ne redevient jamais accessible, ces résultats peuvent être utiles pour trouver la cause première :

vmanage# request nms application-server status

NMS application server

Enabled: true <<<<<<<<<<< "false"

Status: running PID:26470 for 22279s <<<<<<<<<< "not running"Si l'état du serveur d'applications indique Enabled comme false et que l'état n'est pas en cours d'exécution, vous pouvez émettre la commande suivante pour restaurer l'interface graphique utilisateur :

vmanage# request nms application-server restart

2. Pour vérifier l’état de tous les services nms, vous pouvez exécuter la commande suivante :

vmanage# request nms all status

NMS service proxy

Enabled: true

Status: running PID:30888 for 819s

NMS service proxy rate limit

Enabled: true

Status: running PID:32029 for 812s

NMS application server

Enabled: true

Status: running PID:30834 for 819s

NMS configuration database

Enabled: true

Status: running PID:28321 for 825s

Native metrics status: ENABLED

Server-load metrics status: ENABLED

NMS coordination server

Enabled: true

Status: running PID:16814 for 535s

NMS messaging server

Enabled: true

Status: running PID:32561 for 799s

NMS statistics database

Enabled: false

Status: not running

NMS data collection agent

Enabled: true

Status: running PID:31051 for 824s

NMS CloudAgent v2

Enabled: true

Status: running PID:31902 for 817s

NMS cloud agent

Enabled: true

Status: running PID:18517 for 1183s

NMS SDAVC server

Enabled: false

Status: not running

NMS SDAVC gateway

Enabled: false

Status: not running

vManage Device Data Collector

Enabled: true

Status: running PID:3709 for 767s

NMS OLAP database

Enabled: true

Status: running PID:18167 for 521s

vManage Reporting

Enabled: true

Status: running PID:30015 for 827s3. Pour vérifier que la connexion TCP est terminée, exécutez la commande suivante :

vmanage# request nms all diagnostics NMS service server Pinging vManage node on localhost ... Starting Nping 0.7.80 ( https://nmap.org/nping ) at 2026-02-24 06:17 UTC SENT (0.0014s) Starting TCP Handshake > localhost:8443 (127.0.0.1:8443) RCVD (0.0014s) Handshake with localhost:8443 (127.0.0.1:8443) completed SENT (1.0025s) Starting TCP Handshake > localhost:8443 (127.0.0.1:8443) RCVD (1.0025s) Handshake with localhost:8443 (127.0.0.1:8443) completed SENT (2.0036s) Starting TCP Handshake > localhost:8443 (127.0.0.1:8443) RCVD (2.0036s) Handshake with localhost:8443 (127.0.0.1:8443) completed Max rtt: 0.012ms | Min rtt: 0.010ms | Avg rtt: 0.010ms TCP connection attempts: 3 | Successful connections: 3 | Failed: 0 (0.00%) Nping done: 1 IP address pinged in 2.00 seconds Server network connections -------------------------- tcp6 0 0 127.0.0.1:8443 127.0.0.1:43682 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43892 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 169.254.1.1:8443 169.254.1.8:52962 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43738 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:43738 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43828 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43836 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43866 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:52020 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43828 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:43896 ESTABLISHED 31081/envoy tcp6 0 0 169.254.1.1:8443 169.254.1.8:51382 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43726 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:43810 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43756 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43748 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 169.254.0.254:8443 151.186.182.23:35154 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43898 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43860 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:56308 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:52028 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43756 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43712 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:43834 ESTABLISHED 31081/envoy tcp6 0 0 169.254.0.254:8443 151.186.182.23:52168 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43810 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43836 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43852 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 169.254.0.254:8443 151.186.182.23:53030 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43898 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:43892 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:52028 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:44096 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43896 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43866 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43730 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43860 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43878 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43772 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:52020 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:56308 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43874 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:43772 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43826 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:52038 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:43754 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43726 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43782 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43862 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:43834 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 169.254.1.1:8443 169.254.1.8:52964 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:44096 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43754 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:43874 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43712 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43794 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:43696 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43696 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 169.254.1.1:8443 169.254.1.8:52978 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43748 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43730 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43852 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43878 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43826 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:43682 127.0.0.1:8443 ESTABLISHED 30944/java tcp6 0 0 127.0.0.1:8443 127.0.0.1:43794 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43862 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:52038 ESTABLISHED 31081/envoy tcp6 0 0 127.0.0.1:8443 127.0.0.1:43782 ESTABLISHED 31081/envoy NMS application server Sending ICMP Echo to vManage on localhost ... PING localhost.localdomain (127.0.0.1) 56(84) bytes of data. 64 bytes from localhost.localdomain (127.0.0.1): icmp_seq=1 ttl=64 time=0.022 ms 64 bytes from localhost.localdomain (127.0.0.1): icmp_seq=2 ttl=64 time=0.030 ms 64 bytes from localhost.localdomain (127.0.0.1): icmp_seq=3 ttl=64 time=0.027 ms --- localhost.localdomain ping statistics --- 3 packets transmitted, 3 received, 0% packet loss, time 2034ms rtt min/avg/max/mdev = 0.022/0.026/0.030/0.003 ms Pinging vManage node on localhost ... Starting Nping 0.7.80 ( https://nmap.org/nping ) at 2026-02-24 06:17 UTC SENT (0.0015s) Starting TCP Handshake > localhost:8443 (127.0.0.1:8443) RCVD (0.0015s) Handshake with localhost:8443 (127.0.0.1:8443) completed SENT (1.0026s) Starting TCP Handshake > localhost:8443 (127.0.0.1:8443) RCVD (1.0026s) Handshake with localhost:8443 (127.0.0.1:8443) completed SENT (2.0037s) Starting TCP Handshake > localhost:8443 (127.0.0.1:8443) RCVD (2.0037s) Handshake with localhost:8443 (127.0.0.1:8443) completed Max rtt: 0.012ms | Min rtt: 0.009ms | Avg rtt: 0.010ms TCP connection attempts: 3 | Successful connections: 3 | Failed: 0 (0.00%) Nping done: 1 IP address pinged in 2.00 seconds Disk I/O statistics for vManage storage --------------------------------------- avg-cpu: %user %nice %system %iowait %steal %idle 1.63 0.00 0.37 0.06 0.00 97.93 Device tps kB_read/s kB_wrtn/s kB_dscd/s kB_read kB_wrtn kB_dscd nvme1n1 24.49 74.59 913.44 0.00 2717198 33273456 0 NMS configuration database Checking cluster connectivity for ports 7687,7474 ... Pinging vManage node 0 on 169.254.1.5:7687,7474... Starting Nping 0.7.80 ( https://nmap.org/nping ) at 2026-02-24 06:17 UTC SENT (0.0013s) Starting TCP Handshake > 169.254.1.5:7474 RCVD (0.0013s) Handshake with 169.254.1.5:7474 completed SENT (1.0024s) Starting TCP Handshake > 169.254.1.5:7687 RCVD (1.0024s) Handshake with 169.254.1.5:7687 completed SENT (2.0035s) Starting TCP Handshake > 169.254.1.5:7474 RCVD (2.0035s) Handshake with 169.254.1.5:7474 completed SENT (3.0046s) Starting TCP Handshake > 169.254.1.5:7687 RCVD (3.0046s) Handshake with 169.254.1.5:7687 completed SENT (4.0057s) Starting TCP Handshake > 169.254.1.5:7474 RCVD (4.0058s) Handshake with 169.254.1.5:7474 completed SENT (5.0069s) Starting TCP Handshake > 169.254.1.5:7687 RCVD (5.0069s) Handshake with 169.254.1.5:7687 completed Max rtt: 0.021ms | Min rtt: 0.010ms | Avg rtt: 0.013ms TCP connection attempts: 6 | Successful connections: 6 | Failed: 0 (0.00%) Nping done: 1 IP address pinged in 5.01 seconds Server network connections -------------------------- tcp 0 0 169.254.1.5:7687 169.254.1.1:59650 ESTABLISHED 30148/java tcp 0 0 169.254.1.5:7687 169.254.1.1:49998 ESTABLISHED 30148/java tcp 0 0 169.254.1.5:7687 169.254.1.13:55794 ESTABLISHED 30148/java tcp 0 0 169.254.1.5:7687 169.254.1.1:35374 ESTABLISHED 30148/java tcp 0 0 169.254.1.5:7687 169.254.1.1:40100 ESTABLISHED 30148/java tcp 0 0 169.254.1.5:7687 169.254.1.1:52748 ESTABLISHED 30148/java tcp 0 0 169.254.1.5:7687 169.254.1.1:35380 ESTABLISHED 30148/java tcp 0 0 169.254.1.5:7687 169.254.1.1:40618 ESTABLISHED 30148/java tcp 0 0 169.254.1.5:7687 169.254.1.1:59658 ESTABLISHED 30148/java tcp 0 0 169.254.1.5:7687 169.254.1.13:55782 ESTABLISHED 30148/java Connecting to localhost... +------------------------------------------------------------------------------------+ | type | row | attributes[row]["value"] | +------------------------------------------------------------------------------------+ | "StoreSizes" | "TotalStoreSize" | 156365978 | | "PageCache" | "Flush" | 68694 | | "PageCache" | "EvictionExceptions" | 0 | | "PageCache" | "UsageRatio" | 0.1795189950980392 | | "PageCache" | "Eviction" | 3186 | | "PageCache" | "HitRatio" | 1.0 | | "ID Allocations" | "NumberOfRelationshipIdsInUse" | 8791 | | "ID Allocations" | "NumberOfPropertyIdsInUse" | 47067 | | "ID Allocations" | "NumberOfNodeIdsInUse" | 4450 | | "ID Allocations" | "NumberOfRelationshipTypeIdsInUse" | 77 | | "Transactions" | "LastCommittedTxId" | 26470 | | "Transactions" | "NumberOfOpenTransactions" | 1 | | "Transactions" | "NumberOfOpenedTransactions" | 109412 | | "Transactions" | "PeakNumberOfConcurrentTransactions" | 10 | | "Transactions" | "NumberOfCommittedTransactions" | 106913 | +------------------------------------------------------------------------------------+ 15 rows ready to start consuming query after 126 ms, results consumed after another 2 ms Completed Connecting to localhost... Displaying the Neo4j Cluster Status +---------------------------------------------------------------------------------------------------------------------------------+ | name | aliases | access | address | role | requestedStatus | currentStatus | error | default | home | +---------------------------------------------------------------------------------------------------------------------------------+ | "neo4j" | [] | "read-write" | "localhost:7687" | "standalone" | "online" | "online" | "" | TRUE | TRUE | | "system" | [] | "read-write" | "localhost:7687" | "standalone" | "online" | "online" | "" | FALSE | FALSE | +---------------------------------------------------------------------------------------------------------------------------------+ 2 rows ready to start consuming query after 3 ms, results consumed after another 1 ms Completed Total disk space used by configuration-db: 63M . Detailed disk space usage of configuration-db: 0 database_lock 8.0K neostore 48K neostore.counts.db 1.8M neostore.indexstats.db 48K neostore.labelscanstore.db 8.0K neostore.labeltokenstore.db 40K neostore.labeltokenstore.db.id 32K neostore.labeltokenstore.db.names 40K neostore.labeltokenstore.db.names.id 72K neostore.nodestore.db 48K neostore.nodestore.db.id 8.0K neostore.nodestore.db.labels 40K neostore.nodestore.db.labels.id 1.9M neostore.propertystore.db 312K neostore.propertystore.db.arrays 48K neostore.propertystore.db.arrays.id 72K neostore.propertystore.db.id 8.0K neostore.propertystore.db.index 48K neostore.propertystore.db.index.id 32K neostore.propertystore.db.index.keys 40K neostore.propertystore.db.index.keys.id 4.2M neostore.propertystore.db.strings 104K neostore.propertystore.db.strings.id 16K neostore.relationshipgroupstore.db 48K neostore.relationshipgroupstore.db.id 48K neostore.relationshipgroupstore.degrees.db 296K neostore.relationshipstore.db 48K neostore.relationshipstore.db.id 48K neostore.relationshiptypescanstore.db 8.0K neostore.relationshiptypestore.db 40K neostore.relationshiptypestore.db.id 8.0K neostore.relationshiptypestore.db.names 40K neostore.relationshiptypestore.db.names.id 16K neostore.schemastore.db 48K neostore.schemastore.db.id 11M profiles 44M schema ############################################## Running schema violation pre-check script WARNING: sun.reflect.Reflection.getCallerClass is not supported. This will impact performance. Validating Schema from the configuration-db Successfully validated configuration-db schema written to file /opt/data/containers/mounts/upgrade-coordinator/schema.json Contents of /opt/data/containers/mounts/upgrade-coordinator/schema.json: { "check_name": "Validating configuration-db admin names", "check_result": "SUCCESSFUL", "check_analysis": "Successfully validated configuration-db schema", "check_action": "" } ############################################## ############################################## Running quarantine check WARNING: sun.reflect.Reflection.getCallerClass is not supported. This will impact performance. Check if Neo4j Nodes are Quarantined None of the neo4j nodes is quarantined ############################################## ############################################## Checking High Direct Memory Usage in Neo4j High Direct Memory Usage in Neo4j not found NMS data collection agent Checking data-collection-agent status ------------------------ data-collection-agent container exists Checking Data collection agent processes status ------------------------ Data collection agent parent processs ID 12 Data collection agent process ID 104 Data collection bulk process ID 97 Data collection rest process ID 98 Data collection monitor process ID 99 Checking vmanage access ------------------------ Successfully logged into vmanage. Checking DCS Push Status ------------------------ vAnalytics not enabled. NMS coordination server Checking cluster connectivity for ports 2181 ... Pinging vManage node 0 on 169.254.1.4:2181... Starting Nping 0.7.80 ( https://nmap.org/nping ) at 2026-02-24 06:18 UTC SENT (0.0014s) Starting TCP Handshake > 169.254.1.4:2181 RCVD (0.0014s) Handshake with 169.254.1.4:2181 completed SENT (1.0025s) Starting TCP Handshake > 169.254.1.4:2181 RCVD (1.0025s) Handshake with 169.254.1.4:2181 completed SENT (2.0036s) Starting TCP Handshake > 169.254.1.4:2181 RCVD (2.0036s) Handshake with 169.254.1.4:2181 completed Max rtt: 0.012ms | Min rtt: 0.010ms | Avg rtt: 0.010ms TCP connection attempts: 3 | Successful connections: 3 | Failed: 0 (0.00%) Nping done: 1 IP address pinged in 2.00 seconds Server network connections -------------------------- tcp 0 0 169.254.1.4:2181 169.254.1.1:56716 ESTABLISHED 16814/java NMS container manager Checking container-manager status Listing all images ------------------------ REPOSITORY TAG IMAGE ID CREATED SIZE sdwan/host-agent 1.0.1 ca71fd3fe4a2 5 months ago 131MB sdwan/cluster-oracle 1.0.1 8ef918482315 5 months ago 294MB sdwan/data-collection-agent 1.0.1 4bf055257027 5 months ago 157MB sdwan/application-server 19.1.0 6a9624dc3125 5 months ago 508MB sdwan/configuration-db 4.4.38 700fe6e56199 5 months ago 472MB sdwan/coordination-server 3.7.1 a04198d518b3 5 months ago 606MB sdwan/olap-db 23.3.13.6 a17712731d5f 5 months ago 494MB sdwan/device-data-collector 1.0.0 515f2793ee43 5 months ago 116MB sdwan/service-proxy 1.27.2 5174f58b97b1 5 months ago 105MB sdwan/messaging-server 0.20.0 9560cd4b7c42 5 months ago 105MB sdwan/statistics-db 7.17.6 b9f8ab30d647 5 months ago 589MB cloudagent-v2 3358cee09e99 66063bed474e 5 months ago 458MB sdwan/upgrade-coordinator 2.0.0 969cd2f1626a 5 months ago 93.3MB sdwan/vault 1.0.1 0883c094affc 6 months ago 511MB sdwan/support-tools latest 022aebae12e6 13 months ago 143MB sdavc 4.6.0 730e83b39087 17 months ago 602MB sdavc-gw 4.6.0 84083ed484ba 18 months ago 369MB sdwan/reporting latest 509ec99584fd 19 months ago 772MB sdwan/ratelimit latest 719f624e9268 2 years ago 45.7MB Listing all containers ------------------------ CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES c676b358b12d sdwan/olap-db:23.3.13.6 "/usr/bin/docker-ini…" 10 hours ago Up 10 hours (healthy) 127.0.0.1:8123->8123/tcp olap-db 627c1dcf16fa sdwan/coordination-server:3.7.1 "/docker-entrypoint.…" 10 hours ago Up 10 hours (healthy) 127.0.0.1:2181->2181/tcp, 127.0.0.1:2888->2888/tcp, 127.0.0.1:3888->3888/tcp coordination-server 9299443ff7a1 sdwan/messaging-server:0.20.0 "/entrypoint.sh" 10 hours ago Up 10 hours (healthy) 127.0.0.1:4222->4222/tcp, 127.0.0.1:6222->6222/tcp, 127.0.0.1:8222->8222/tcp messaging-server 0c5236ee911b sdwan/ratelimit:latest "/usr/local/bin/rate…" 10 hours ago Up 10 hours (healthy) 6379/tcp, 127.0.0.1:8460-8462->8460-8462/tcp ratelimit 094166df1cd9 cloudagent-v2:3358cee09e99 "./entrypoint.sh" 10 hours ago Up 10 hours 127.0.0.1:9051-9052->9051-9052/tcp cloudagent-v2 8f1287c11840 sdwan/reporting:latest "/sbin/tini -g -- py…" 10 hours ago Up 10 hours 80/tcp, 127.0.0.1:9080->9080/tcp reporting 66a46485cfab sdwan/vault:1.0.1 "docker-entrypoint.s…" 10 hours ago Up 10 hours (healthy) 8200/tcp, 127.0.0.1:8201->8201/tcp vault ccf5336112b6 sdwan/data-collection-agent:1.0.1 "/usr/bin/docker-ini…" 10 hours ago Up 10 hours (healthy) data-collection-agent 079ecfe36482 sdwan/service-proxy:1.27.2 "/entrypoint.sh" 10 hours ago Up 10 hours (healthy) service-proxy ec1b50457302 sdwan/configuration-db:4.4.38 "/usr/bin/docker-ini…" 10 hours ago Up 10 hours (healthy) 127.0.0.1:5000->5000/tcp, 127.0.0.1:6000->6000/tcp, 127.0.0.1:6362->6362/tcp, 127.0.0.1:6372->6372/tcp, 127.0.0.1:7000->7000/tcp, 127.0.0.1:7473-7474->7473-7474/tcp, 127.0.0.1:7687-7688->7687-7688/tcp configuration-db f54ccdcf7a14 sdwan/device-data-collector:1.0.0 "/bin/sh -c /vMDDC/v…" 10 hours ago Up 10 hours (healthy) 127.0.0.1:8129->8129/tcp device-data-collector 605f986dc9f1 sdwan/application-server:19.1.0 "/sbin/tini -g -- /e…" 10 hours ago Up 10 hours (healthy) application-server 50377e02b120 sdwan/host-agent:1.0.1 "/entrypoint.sh pyth…" 10 hours ago Up 10 hours (healthy) 127.0.0.1:9099->9099/tcp host-agent ca36faf52f36 sdwan/cluster-oracle:1.0.1 "/entrypoint.sh java…" 10 hours ago Up 10 hours (healthy) 127.0.0.1:9090->9090/tcp cluster-oracle Docker info ------------------------ Client: Context: default Debug Mode: false Server: Containers: 14 Running: 14 Paused: 0 Stopped: 0 Images: 19 Server Version: 20.10.25-ce Storage Driver: overlay2 Backing Filesystem: extfs Supports d_type: true Native Overlay Diff: true userxattr: false Logging Driver: local Cgroup Driver: cgroupfs Cgroup Version: 1 Plugins: Volume: local Network: bridge host ipvlan macvlan null overlay Log: awslogs fluentd gcplogs gelf journald json-file local logentries splunk syslog Swarm: inactive Runtimes: io.containerd.runc.v2 io.containerd.runtime.v1.linux runc Default Runtime: runc Init Binary: docker-init containerd version: 1e1ea6e986c6c86565bc33d52e34b81b3e2bc71f.m runc version: v1.1.4-8-g974efd2d-dirty init version: b9f42a0-dirty Security Options: seccomp Profile: default Kernel Version: 5.15.146-yocto-standard Operating System: Linux OSType: linux Architecture: x86_64 CPUs: 16 Total Memory: 30.58GiB Name: vmanage_1 ID: GHLX:JUWP:Z7JP:J3UX:MOF7:ZY7G:MSLS:E7BI:3LKT:2WRU:K2HZ:YWL7 Docker Root Dir: /var/lib/nms/docker Debug Mode: false Registry: https://index.docker.io/v1/ Labels: Experimental: false Insecure Registries: 127.0.0.0/8 Live Restore Enabled: false WARNING: No cpu cfs quota support WARNING: No cpu cfs period support WARNING: No blkio throttle.read_bps_device support WARNING: No blkio throttle.write_bps_device support WARNING: No blkio throttle.read_iops_device support WARNING: No blkio throttle.write_iops_device support NMS SDAVC server is disabled on this vmanage node NMS Device Data Collector Checking Device Data Collector Port.... Port 8129 is reachable Current Health Status:- true Getting docker stats of Device Data Collector container .... CONTAINER ID NAME CPU % MEM USAGE / LIMIT MEM % NET I/O BLOCK I/O PIDS f54ccdcf7a14 device-data-collector 0.00% 9.773MiB / 30.58GiB 0.03% 1.85MB / 876kB 0B / 0B 21 NMS OLAP database Checking cluster connectivity for ports 9000,8123,9009 ... Pinging vManage node 0 on 169.254.1.10:9000,8123,9009... Starting Nping 0.7.80 ( https://nmap.org/nping ) at 2026-02-24 06:18 UTC SENT (0.0013s) Starting TCP Handshake > 169.254.1.10:8123 RCVD (0.0013s) Handshake with 169.254.1.10:8123 completed SENT (1.0024s) Starting TCP Handshake > 169.254.1.10:9000 RCVD (1.0024s) Handshake with 169.254.1.10:9000 completed SENT (2.0036s) Starting TCP Handshake > 169.254.1.10:9009 RCVD (2.0036s) Handshake with 169.254.1.10:9009 completed SENT (3.0047s) Starting TCP Handshake > 169.254.1.10:8123 RCVD (3.0047s) Handshake with 169.254.1.10:8123 completed SENT (4.0058s) Starting TCP Handshake > 169.254.1.10:9000 RCVD (4.0058s) Handshake with 169.254.1.10:9000 completed SENT (5.0069s) Starting TCP Handshake > 169.254.1.10:9009 RCVD (5.0070s) Handshake with 169.254.1.10:9009 completed SENT (6.0081s) Starting TCP Handshake > 169.254.1.10:8123 RCVD (6.0081s) Handshake with 169.254.1.10:8123 completed SENT (7.0092s) Starting TCP Handshake > 169.254.1.10:9000 RCVD (7.0092s) Handshake with 169.254.1.10:9000 completed SENT (8.0103s) Starting TCP Handshake > 169.254.1.10:9009 RCVD (8.0103s) Handshake with 169.254.1.10:9009 completed Max rtt: 0.014ms | Min rtt: 0.008ms | Avg rtt: 0.009ms TCP connection attempts: 9 | Successful connections: 9 | Failed: 0 (0.00%) Nping done: 1 IP address pinged in 8.01 seconds Server network connections -------------------------- tcp 0 0 169.254.1.10:8123 169.254.1.1:38848 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38736 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38864 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38826 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:32996 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38792 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38720 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38704 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38790 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38740 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38786 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38576 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38766 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38754 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38828 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38676 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38770 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38620 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:32768 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38820 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38574 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38878 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38804 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38692 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38808 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38844 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:32984 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:60970 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:60974 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:51222 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38712 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38662 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:60986 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38598 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38640 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38652 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:32982 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38572 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38630 ESTABLISHED 18258/clickhouse-se tcp 0 0 169.254.1.10:8123 169.254.1.1:38606 ESTABLISHED 18258/clickhouse-se Mode: SingleTenant ---------------------------- Node health state ---------------------------- Server status: [OK] Replica status: [OK] Database summary ---------------------------- database count: 5 table count in db(INFORMATION_SCHEMA) : 4 table count in db(backup) : 0 table count in db(default) : 61 table count in db(information_schema) : 4 table count in db(system) : 82 Tables in database default ---------------------------- - aggregated_apps_dpi_app_60min_summary_view_default - aggregated_apps_dpi_app_summary_default - aggregated_apps_dpi_site_5min_summary_view_default - aggregated_apps_dpi_site_summary_default - aggregated_apps_dpi_stats_default - aggregated_apps_dpi_summary_default - alarm_default - api_telemetry - api_telemetry_metadata - app_hosting_interface_stats_default - app_hosting_stats_default - approute_stats_default - approute_stats_routing_summary_default - approute_stats_transport_summary_default - art_stats_default - audit_log_default - bridge_interface_stats_default - bridge_mac_stats_default - cloudx_stats_default - device_configuration_default - device_events_default - device_health_stats_default - device_stats_files_default - device_system_status_stats_default - dpi_stats_default - eio_lte_stats_default - flow_log_stats_default - fwall_stats_default - interface_stats_default - ips_alert_stats_default - nwa_default - nwapending_default - nwpi_agg_metrics_default - nwpi_app_default - nwpi_domain_agg_trend_default - nwpi_domain_default - nwpi_flow_default - nwpi_flow_event_default - nwpi_flow_metric_default - nwpi_hops_of_flow_default - nwpi_routing_default - nwpi_te_default - nwpi_time_series_default - nwpi_trace_and_task_default - pagination_request_info_default - perf_mon_statistics_default - perf_mon_summary_default - perfmon_app_15min_summary_view_default - perfmon_app_summary_default - qos_stats_default - sdra_stats_default - site_health_stats_default - sleofflinereport_default - speed_test_default - sul_stats_default - tracker_stats_default - umbrella_stats_default - umtsrestevent_default - urlf_stats_default - vnf_stats_default - wlan_client_info_stats_default ---------------------------- ┌─parts.table──────────────────────────────┬──rows─┬─latest_modification─┬─disk_size──┬─primary_keys_size─┬─engine─────────────┬─bytes_size─┬─min_date───┬─max_date───┬─compressed_size─┬─uncompressed_size─┬─ratio─┐ │ device_system_status_stats_default │ 7238 │ 2026-02-24 06:13:12 │ 430.24 KiB │ 100.00 B │ MergeTree │ 440561 │ 2026-02-23 │ 2026-02-24 │ 0.00 B │ 0.00 B │ nan │ │ api_telemetry │ 34476 │ 2026-02-24 06:06:32 │ 306.22 KiB │ 264.00 B │ MergeTree │ 313574 │ tuple() │ tuple() │ 0.00 B │ 0.00 B │ nan │ │ audit_log_default │ 744 │ 2026-02-24 06:15:48 │ 200.16 KiB │ 48.00 B │ MergeTree │ 204967 │ 2026-02-23 │ 2026-02-24 │ 0.00 B │ 0.00 B │ nan │ │ device_events_default │ 4819 │ 2026-02-24 06:17:06 │ 189.26 KiB │ 245.00 B │ MergeTree │ 193802 │ 2026-02-23 │ 2026-02-24 │ 0.00 B │ 0.00 B │ nan │ │ interface_stats_default │ 7036 │ 2026-02-24 06:10:50 │ 117.07 KiB │ 104.00 B │ MergeTree │ 119879 │ 2026-02-23 │ 2026-02-24 │ 0.00 B │ 0.00 B │ nan │ │ alarm_default │ 408 │ 2026-02-23 21:48:41 │ 69.99 KiB │ 212.00 B │ ReplacingMergeTree │ 71671 │ 2026-02-23 │ 2026-02-23 │ 0.00 B │ 0.00 B │ nan │ │ api_telemetry_metadata │ 5342 │ 2026-02-24 06:01:04 │ 57.52 KiB │ 32.00 B │ MergeTree │ 58899 │ tuple() │ tuple() │ 0.00 B │ 0.00 B │ nan │ │ approute_stats_default │ 2540 │ 2026-02-24 06:10:20 │ 37.25 KiB │ 259.00 B │ MergeTree │ 38139 │ 2026-02-23 │ 2026-02-24 │ 0.00 B │ 0.00 B │ nan │ │ device_configuration_default │ 18 │ 2026-02-23 20:55:39 │ 33.97 KiB │ 51.00 B │ MergeTree │ 34787 │ 2026-02-23 │ 2026-02-23 │ 0.00 B │ 0.00 B │ nan │ │ device_health_stats_default │ 1463 │ 2026-02-24 06:15:00 │ 23.07 KiB │ 303.00 B │ ReplacingMergeTree │ 23626 │ 2026-02-23 │ 2026-02-24 │ 0.00 B │ 0.00 B │ nan │ │ site_health_stats_default │ 1413 │ 2026-02-24 06:15:01 │ 9.95 KiB │ 230.00 B │ ReplacingMergeTree │ 10185 │ 2026-02-23 │ 2026-02-24 │ 0.00 B │ 0.00 B │ nan │ │ approute_stats_routing_summary_default │ 70 │ 2026-02-23 20:30:17 │ 1.79 KiB │ 83.00 B │ MergeTree │ 1837 │ tuple() │ tuple() │ 0.00 B │ 0.00 B │ nan │ │ nwa_default │ 120 │ 2026-02-24 06:11:08 │ 1.69 KiB │ 32.00 B │ MergeTree │ 1734 │ 2026-02-23 │ 2026-02-24 │ 0.00 B │ 0.00 B │ nan │ │ approute_stats_transport_summary_default │ 18 │ 2026-02-23 20:30:17 │ 997.00 B │ 83.00 B │ MergeTree │ 997 │ tuple() │ tuple() │ 0.00 B │ 0.00 B │ nan │ └──────────────────────────────────────────┴───────┴─────────────────────┴────────────┴───────────────────┴────────────────────┴────────────┴────────────┴────────────┴─────────────────┴───────────────────┴───────┘ Application server stats --------------------------------- STATISTICS --------------------------------- Success: 20418 Fail: 0 CONN DOWN: 0 OOM: 0 ILL ARG: 0 --------------------------------- This action is not supported vmanage_1# -

Historique de révision

| Révision | Date de publication | Commentaires |

|---|---|---|

4.0 |

13-Oct-2023

|

Section Mise à niveau du cluster vManage |

3.0 |

11-Jul-2023

|

Prévérifications à effectuer avant une mise à niveau du contrôleur |

2.0 |

27-Apr-2023

|

Première publication |

1.0 |

26-Apr-2023

|

Première publication |

Contribution d’experts de Cisco

- Cesar Daniel AvilaIngénieur-conseil technique

- Ian EstradaIngénieur-conseil technique

Contacter Cisco

- Ouvrir un dossier d’assistance

- (Un contrat de service de Cisco est requis)

Commentaires

Commentaires