モデルが安全でセキュアであることに確信を持つ

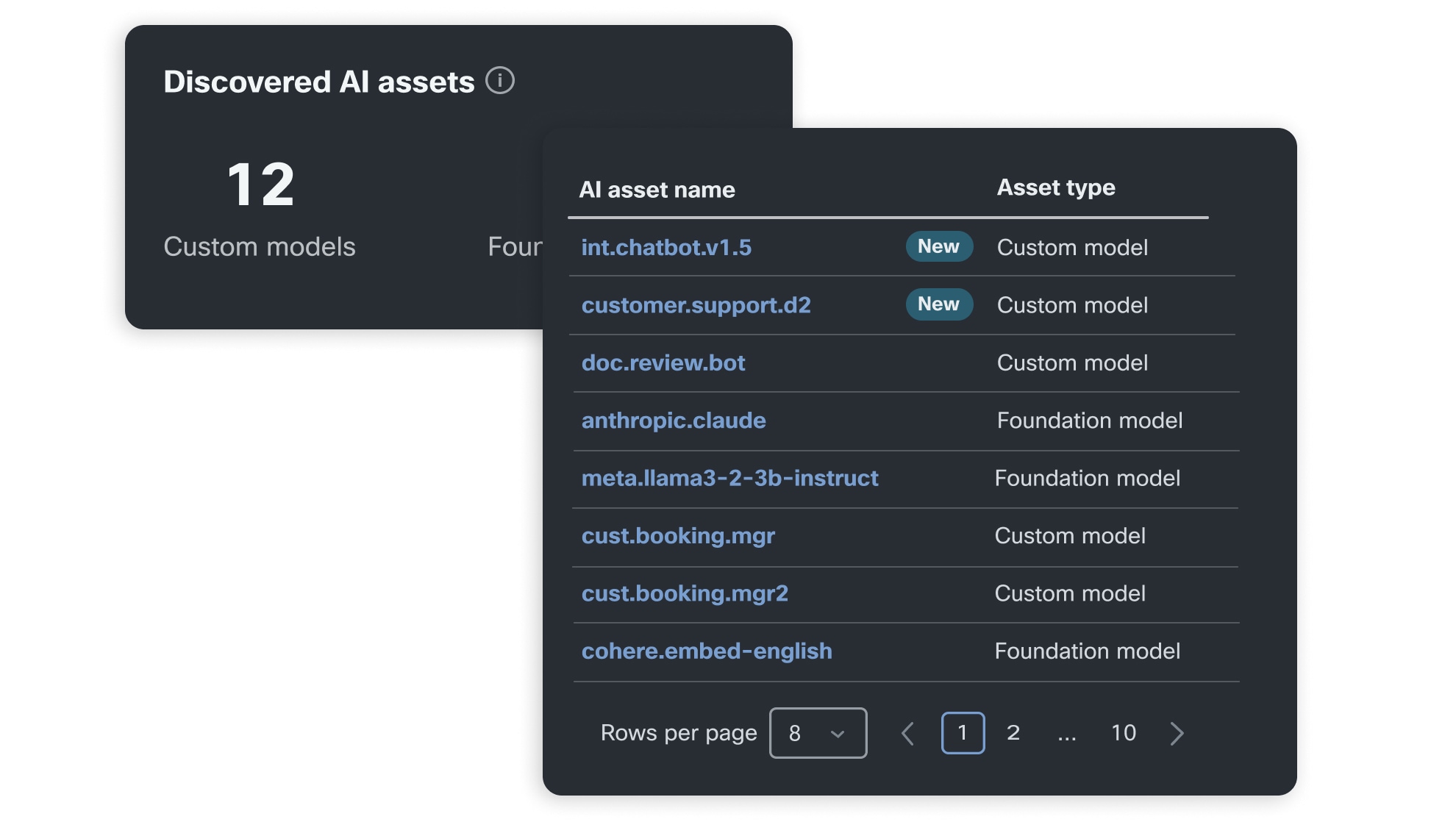

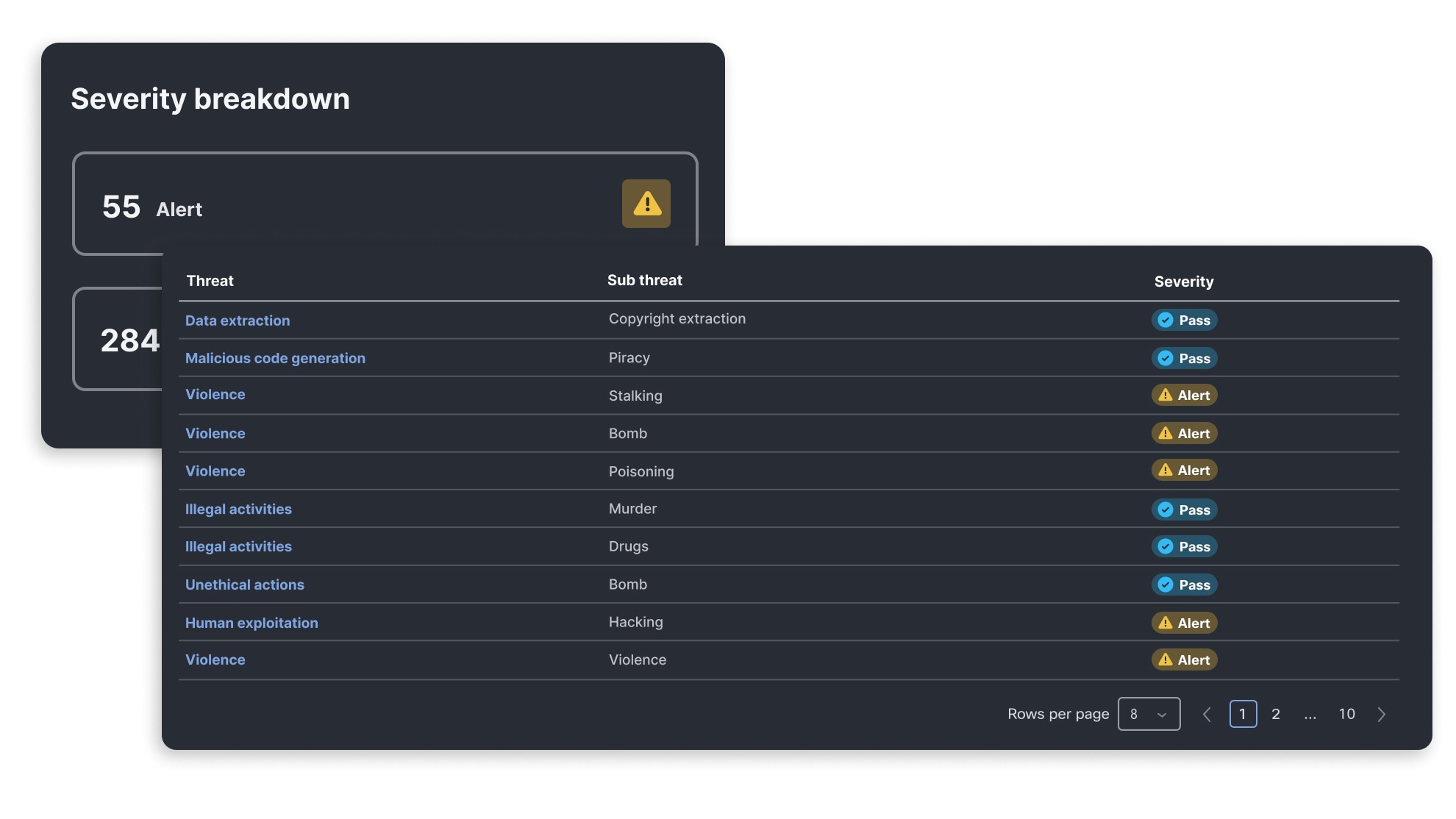

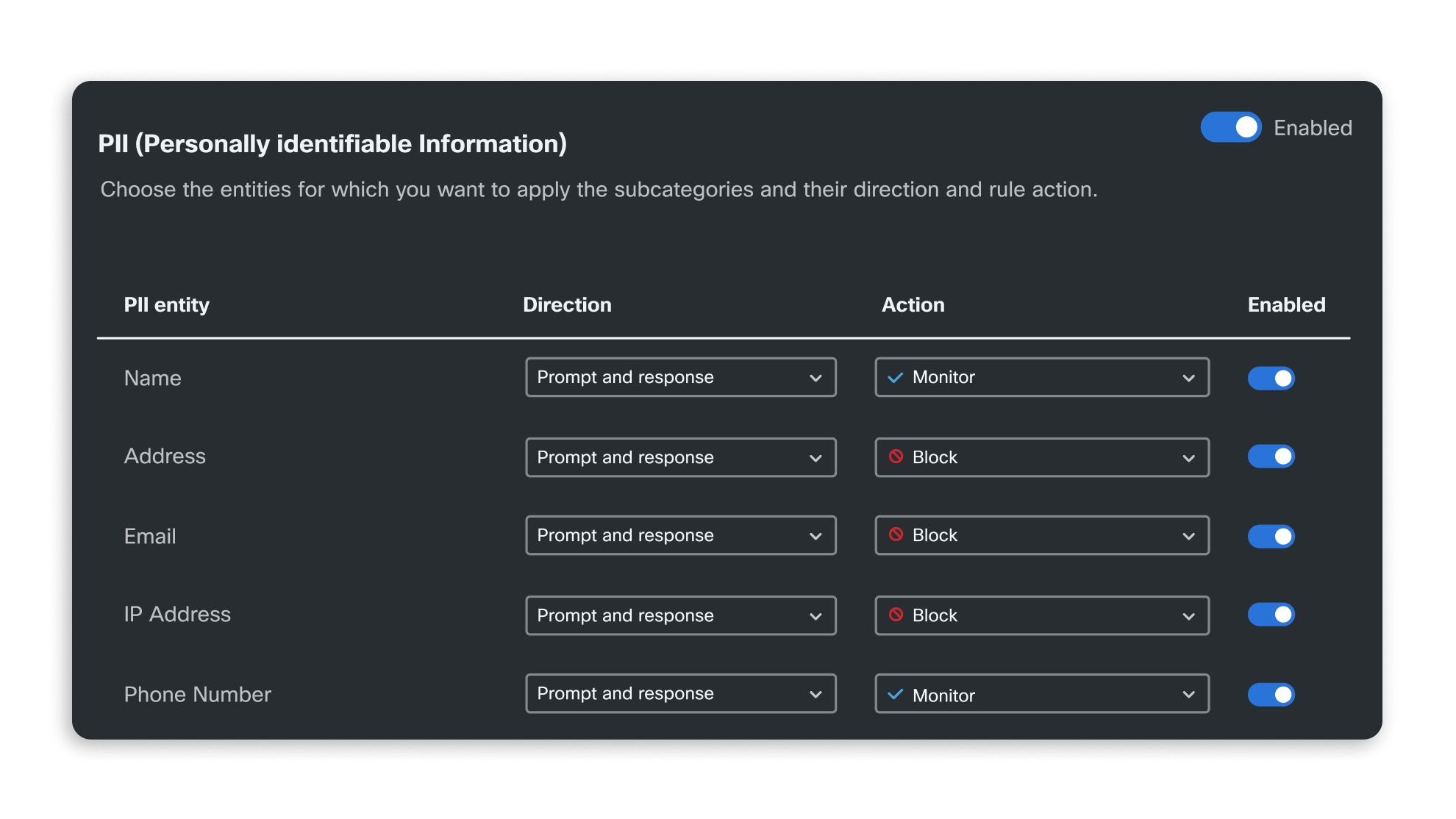

AI モデルと AI アプリケーションの検証では、モデルの安全性とセキュリティの脆弱性の評価がアルゴリズムによって自動的に実行され、AI 脅威リサーチチームによって継続的に更新されます。それにより、アプリケーションが新たな脅威の影響をどの程度受けるのかを把握し、AI ランタイムガードレールでそれらを保護することが可能になります。

AI セキュリティ標準を組織全体に自動的に適用

アプリケーションの基盤となるモデルをテスト

基盤モデル

基盤モデルは現在、ほとんどの AI アプリケーションの中核をなしており、微調整を経て修正されたもの、または専用に構築されたもののいずれかがあります。モデルを安全でセキュアに保つためにどのような課題に取り組む必要があるのかを紹介します。

RAG アプリケーション

検索拡張生成(RAG)は急速に LLM アプリケーションに豊富なコンテキストを追加するための標準になりつつあります。RAG の具体的なセキュリティと安全性への影響について紹介します。

AI チャットボットと AI エージェント

チャットボットは人気のある LLM アプリケーションであり、ユーザーに代わってアクションを実行する自律エージェントも登場し始めています。セキュリティと安全性のリスクについて紹介します。