DCNM을 통해 EVPN VXLAN, 멀티 사이트 구축 11.2(1)

다운로드 옵션

편견 없는 언어

본 제품에 대한 문서 세트는 편견 없는 언어를 사용하기 위해 노력합니다. 본 설명서 세트의 목적상, 편견 없는 언어는 나이, 장애, 성별, 인종 정체성, 민족 정체성, 성적 지향성, 사회 경제적 지위 및 교차성에 기초한 차별을 의미하지 않는 언어로 정의됩니다. 제품 소프트웨어의 사용자 인터페이스에서 하드코딩된 언어, RFP 설명서에 기초한 언어 또는 참조된 서드파티 제품에서 사용하는 언어로 인해 설명서에 예외가 있을 수 있습니다. 시스코에서 어떤 방식으로 포용적인 언어를 사용하고 있는지 자세히 알아보세요.

이 번역에 관하여

Cisco는 전 세계 사용자에게 다양한 언어로 지원 콘텐츠를 제공하기 위해 기계 번역 기술과 수작업 번역을 병행하여 이 문서를 번역했습니다. 아무리 품질이 높은 기계 번역이라도 전문 번역가의 번역 결과물만큼 정확하지는 않습니다. Cisco Systems, Inc.는 이 같은 번역에 대해 어떠한 책임도 지지 않으며 항상 원본 영문 문서(링크 제공됨)를 참조할 것을 권장합니다.

목차

소개

이 문서에서는 두 개의 개별 EVPN VXLAN 패브릭을 구축하는 방법과 Cisco DCNM(Data Center Manager) 11.2(1)을 사용하여 이 두 패브릭을 EVPN 멀티 사이트 패브릭 구축으로 병합하는 방법에 대해 설명합니다.

DCNM 11.0(1) 릴리스에 도입된 MSD(Multi-Site Domain)는 여러 멤버 패브릭을 관리하기 위해 생성된 멀티패브릭 컨테이너입니다. 멤버 패브릭 간에 공유되는 오버레이 네트워크 및 VRF(Virtual Routing and Forwarding)의 정의를 위한 단일 제어 지점입니다.

참고: 이 문서에서는 DCNM 내의 각 탭의 기능/등록 정보와 관련된 세부사항을 설명하지 않습니다. 자세한 설명은 뒷부분의 참고문헌을 참고하세요.

사전 요구 사항

요구 사항

다음 주제에 대한 지식을 보유하고 있으면 유용합니다.

-

DCNM 가상 머신 구축을 위한 vCenter/UCS

-

NX-OS 및 Nexus 9000에 익숙함

-

Nexus 9000s ToRs, 리프/스파인 방식으로 연결된 EoRs

사용되는 구성 요소

이 문서의 정보는 다음 소프트웨어 및 하드웨어를 기반으로 합니다.

- DCNM 11.2(1)

- NX-OS 7.0(3)I7(7) 및 NX-OS 9.2(3)

- 스파인: N9K-C9508 / N9K-X97160YC-EX & N9K-C9508 / N9K-X9636PQ

- Leaf: N9K-C9372TX, N9K-C93180YC-EX, N9K-C9372TX-E, N9K-C92160YC-X

- 보더 게이트웨이: N9K-C93240YC-FX2 & N9K-C93180YC-FX

- 7K "호스트": N77-C7709

이 문서의 정보는 특정 랩 환경의 디바이스를 토대로 작성되었습니다. 이 문서에 사용된 모든 디바이스는 초기화된(기본) 컨피그레이션으로 시작되었습니다. 현재 네트워크가 작동 중인 경우 모든 명령의 잠재적인 영향을 미리 숙지하시기 바랍니다.

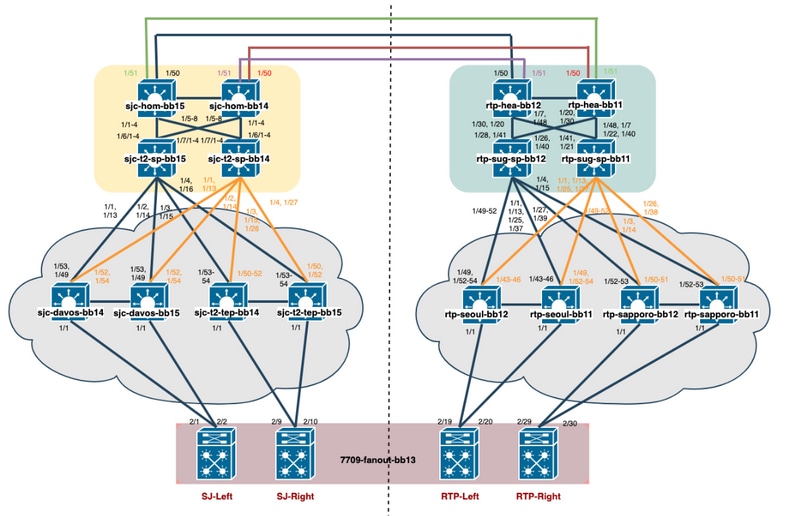

물리적 토폴로지 구축

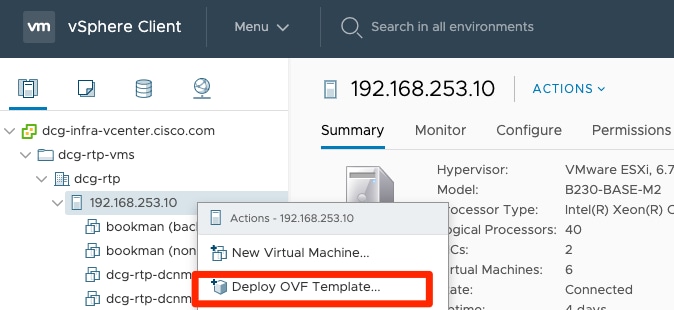

vCenter에서 OVA/OVF 구축

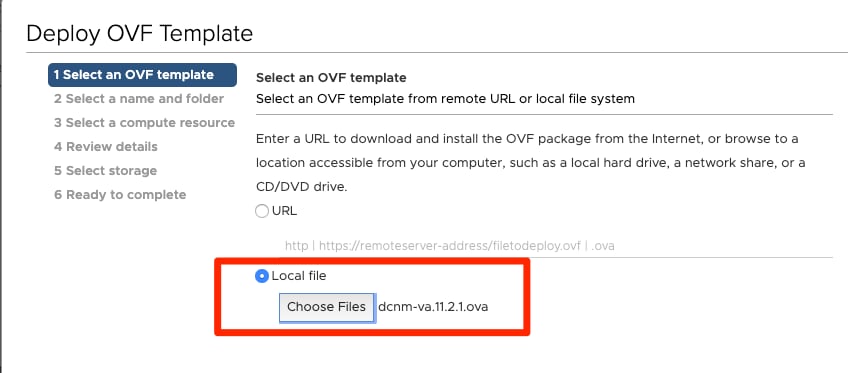

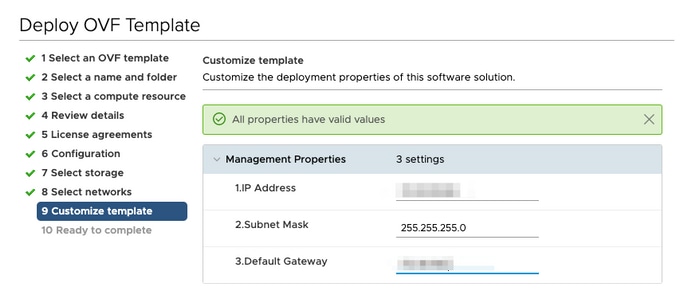

1단계. vCenter에서 이미지에 표시된 대로 선택한 서버/호스트에 OVF(Open Virtualization Format) 템플릿을 구축합니다.

- OVA/OVF 등의 파일을 로컬에 저장하고 Choose Files(파일 선택)를 통해 이미지에 표시된 대로 선택합니다.

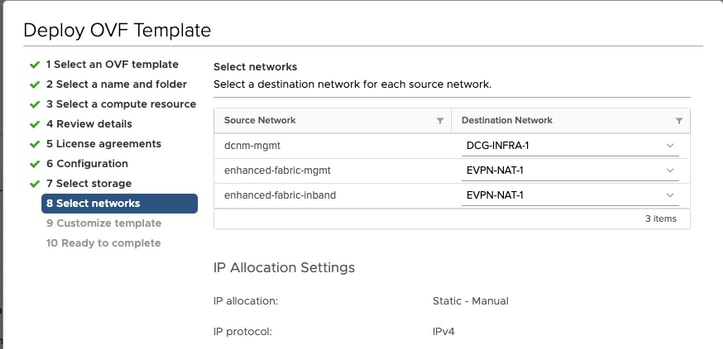

- 나머지 프롬프트(VM 이름, 어떤 호스트, 네트워크 설정, 이미지)를 따르고 Finish(마침)를 클릭합니다.

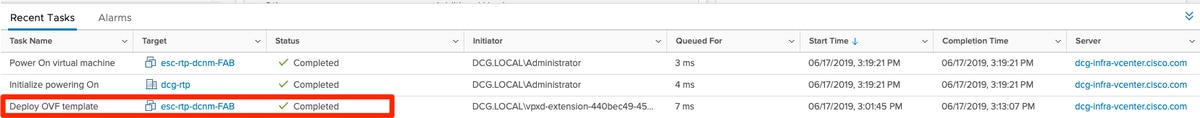

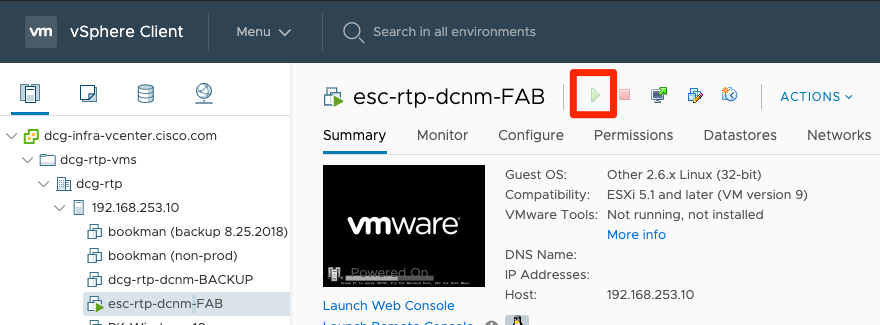

2단계. 완료되면 여기에 표시된 대로 DCNM VM을 시작합니다.

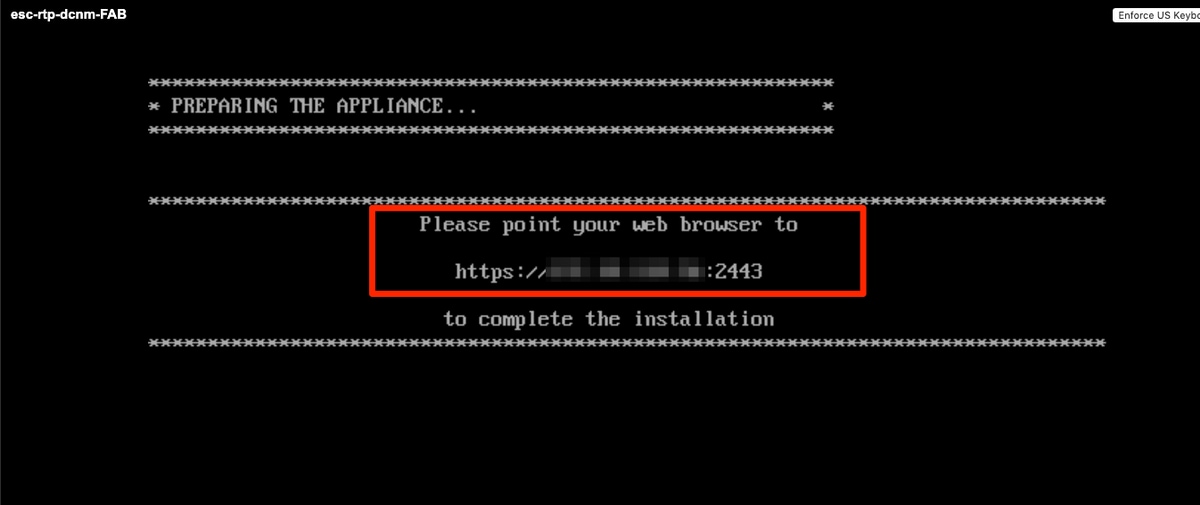

3단계. 웹 콘솔을 실행하면 콘솔에 다음과 같은 프롬프트가 표시됩니다(IP는 사용자 환경 및 컨피그레이션에 따라 다름).

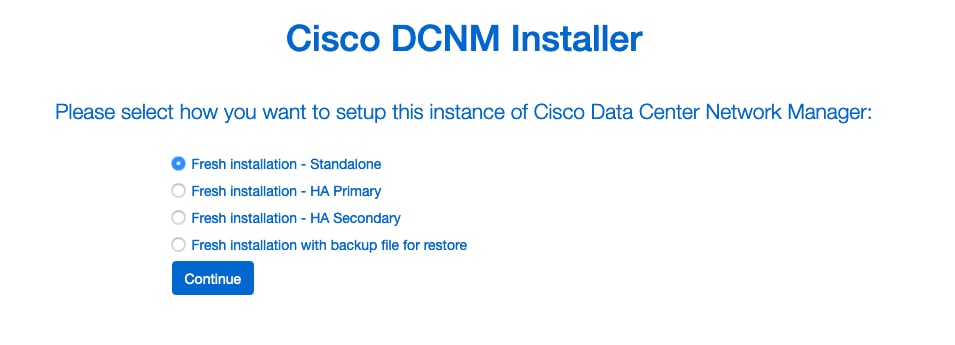

4단계. https://<your IP>:2443(OVA 구축 과정에서 이전에 구성한 IP)으로 이동하여 Get Started(시작하기)를 클릭합니다. 이 예에서는 신규 설치에 대해 설명합니다.

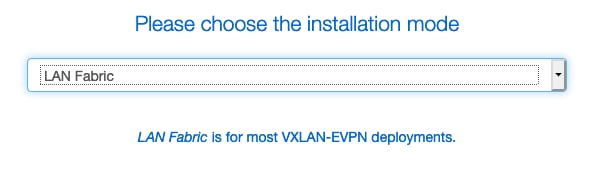

5단계. 관리자 비밀번호를 구성한 후에는 설치할 패브릭 유형을 선택해야 합니다. 각 유형에 대한 용도가 다르므로 LAN과 FAB 중에서 선택해야 합니다. 이 예에서는 LAN 패브릭이 사용되며, 이는 대부분의 VXLAN-EVPN 구축에 사용됩니다.

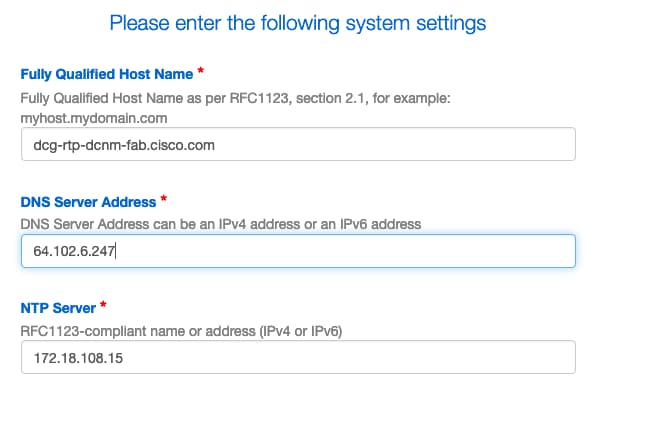

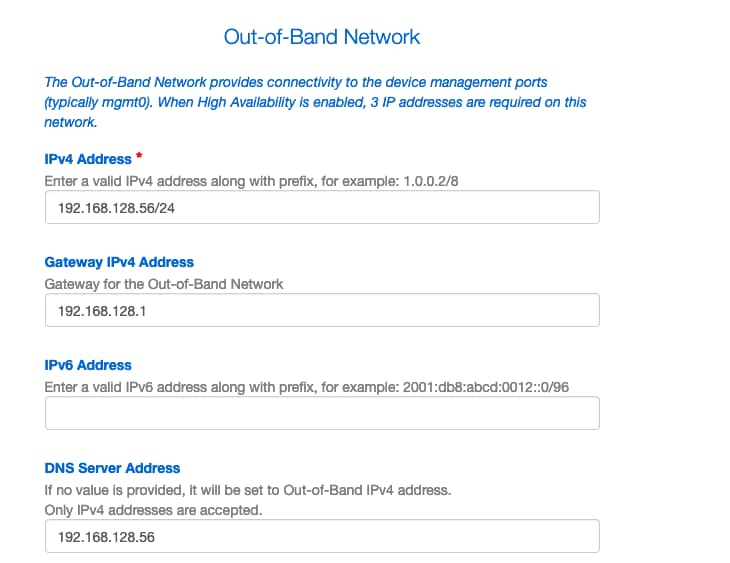

6단계. 설치 관리자의 프롬프트에 따라 네트워크의 DNS, NTP(Network Time Protocol) 서버, DCNM 호스트 이름 등을 사용합니다.

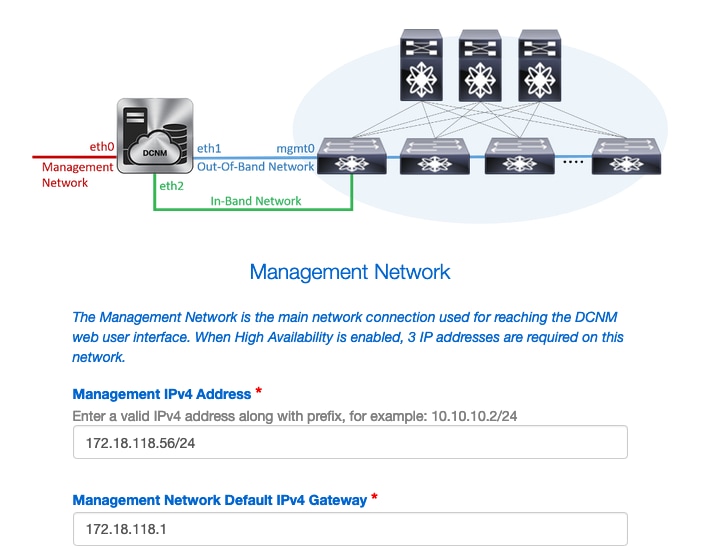

7단계. 관리 IP 및 관리 게이트웨이를 구성합니다. 관리 네트워크는 DCNM 서버에 대한 연결(SSH, SCP, HTTP, HTTPS)을 제공합니다. 이는 GUI에 연결하기 위해 사용하는 IP이기도 합니다. IP 주소는 이전에 수행한 OVA 설치에서 사용자가 미리 구성해야 합니다.

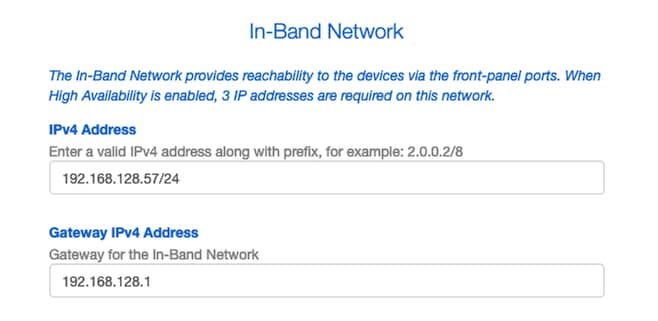

8단계. 대역 내 네트워크를 구성합니다. 대역 내 네트워크는 DCNM과 9K 간에 BGP(Border Gateway Protocol) 세션이 설정되는 방식으로 작동하기 위해 패브릭의 9K에 대한 전면 패널 포트 연결이 필요한 Endpoint Locator와 같은 애플리케이션에 사용됩니다.

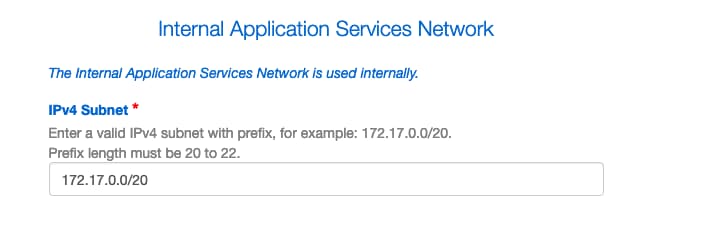

9단계. Internal Application Services 네트워크 구성 —

DCNM 11.0 릴리스부터 DCNM은 DCNM LAN OVA/ISO 설치와 함께 AFW(Application Framework)를 지원합니다. 이 프레임워크는 확장 아키텍처를 구현하기 위해 클러스터링된 환경과 클러스터링되지 않은 환경 모두에서 마이크로서비스로서 애플리케이션을 오케스트레이션하기 위해 Docker를 사용합니다.

DCNM과 함께 기본적으로 제공되는 다른 애플리케이션은 Endpoint Locator, Watch Tower, Virtual Machine Manager 플러그인, Config Compliance 등입니다. AFW는 네트워킹, 스토리지, 인증, 보안 등의 제공을 포함하여 이러한 애플리케이션의 라이프사이클 관리를 담당합니다. 또한 AFW는 Network Insights 애플리케이션의 구축 및 라이프사이클(즉, NIR 및 NIA)을 관리합니다. 이 서브넷은 NIA/NIR을 활성화한 경우 Docker 서비스를 위한 것입니다.

NIA/NIR 설치 방법은 Day 2 운영 섹션에 설명되어 있습니다.

참고: 이 서브넷은 DCNM 및 컴퓨팅 노드에 할당된 eth0/eth1/eth2 인터페이스에 할당된 네트워크와 중복되어서는 안됩니다. 또한 이 서브넷은 DCNM에서 관리하는 스위치 또는 기타 디바이스에 할당된 IP와 중복되어서는 안 됩니다. 선택한 서브넷은 DCNM 기본 및 보조 노드를 설치할 때(기본 HA 구축의 경우) 일관성을 유지해야 합니다.

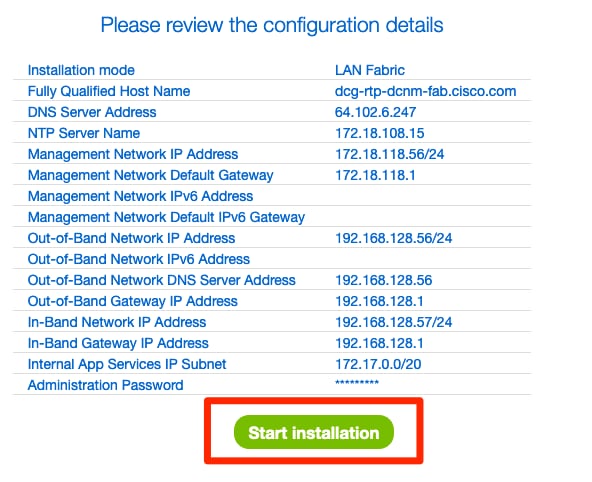

10단계. 모든 구성 세부 정보를 검토 및 확인하고 설치를 시작합니다.

11단계. DCNM이 완전히 설치되면 GUI(이전에 구성한 IP 주소 또는 호스트 이름)에 로그인합니다.

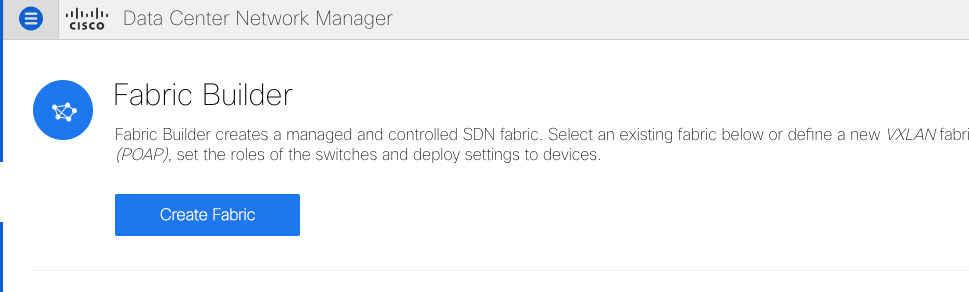

첫 번째 패브릭 구축 — RTP 패브릭

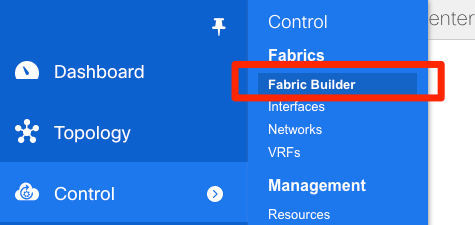

1단계. DCNM GUI에서 Fabric Builder로 이동합니다. 첫 번째 패브릭을 생성하려면 Control(제어) > Fabrics(패브릭) > Fabric Builder(패브릭 빌더)를 선택합니다.

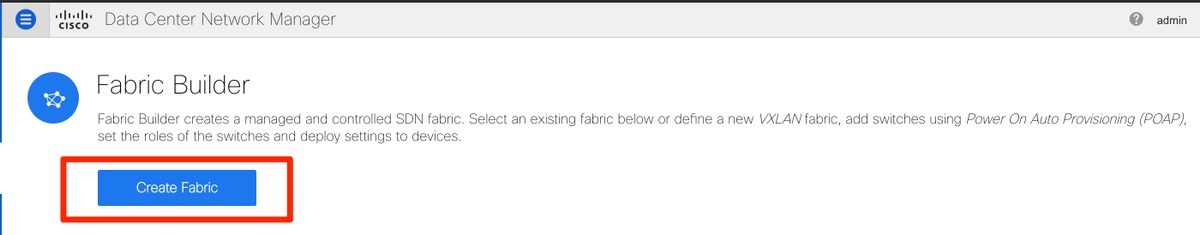

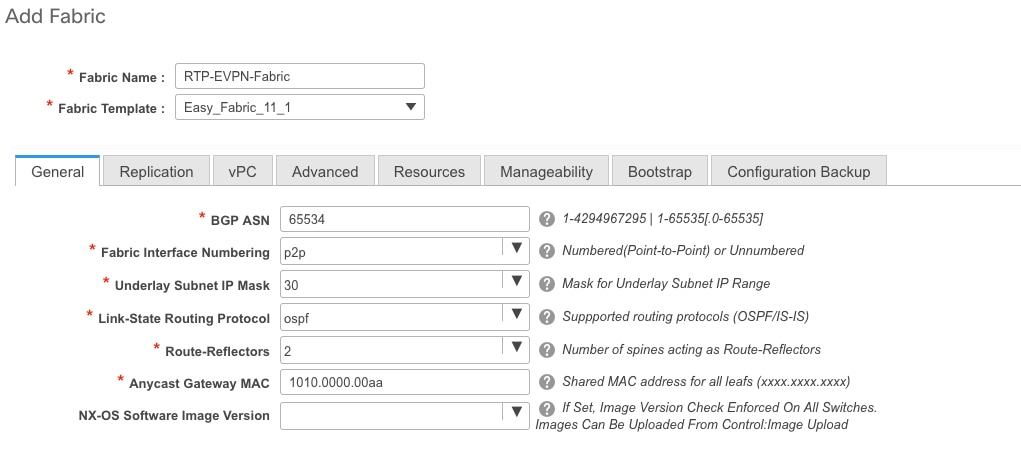

2단계. Create Fabric(패브릭 생성)을 클릭하고 네트워크에 필요한 양식을 입력합니다. Easy Fabric(Easy 패브릭)은 로컬 EVPN VXLAN 구축을 위한 올바른 템플릿입니다.

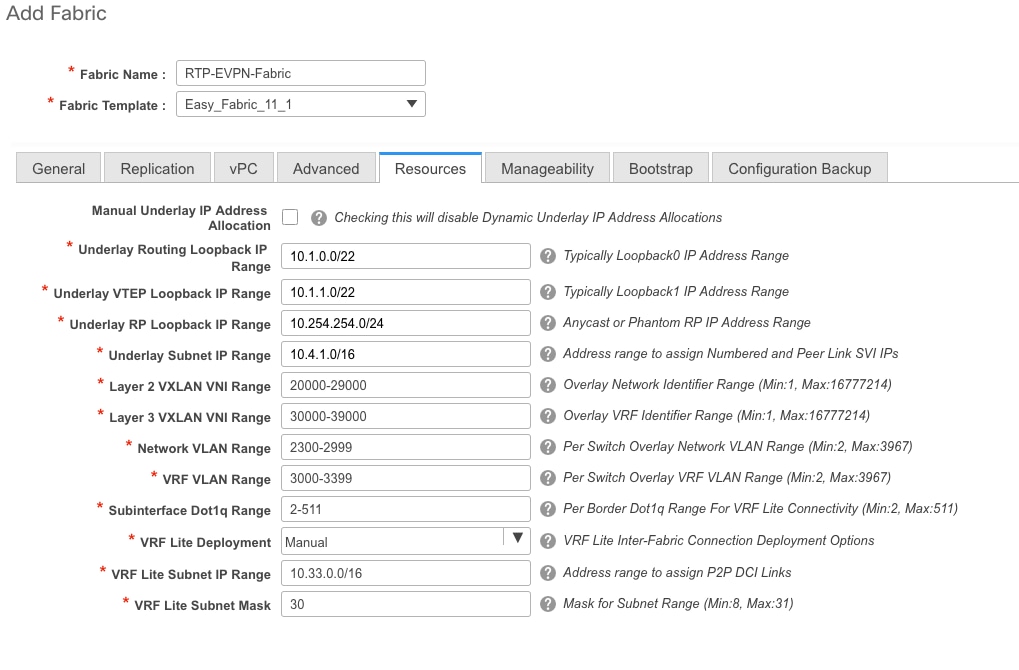

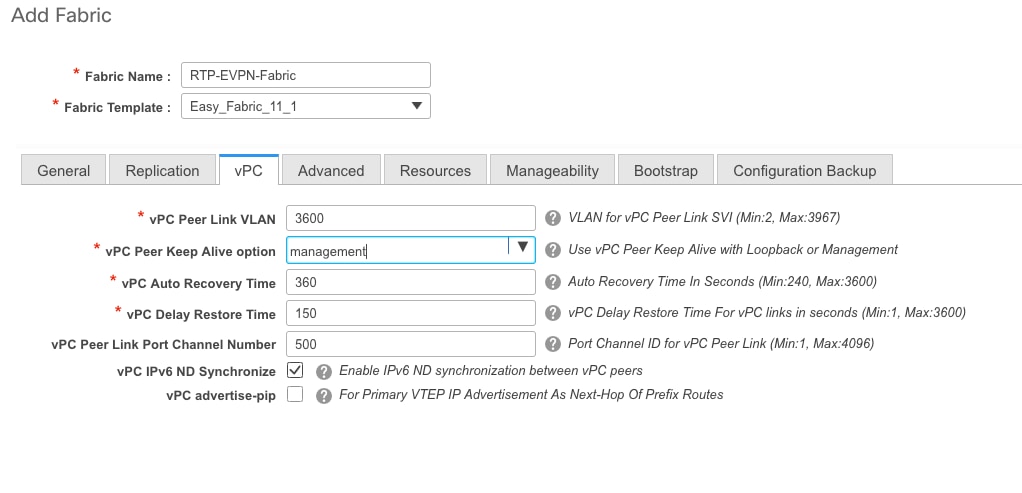

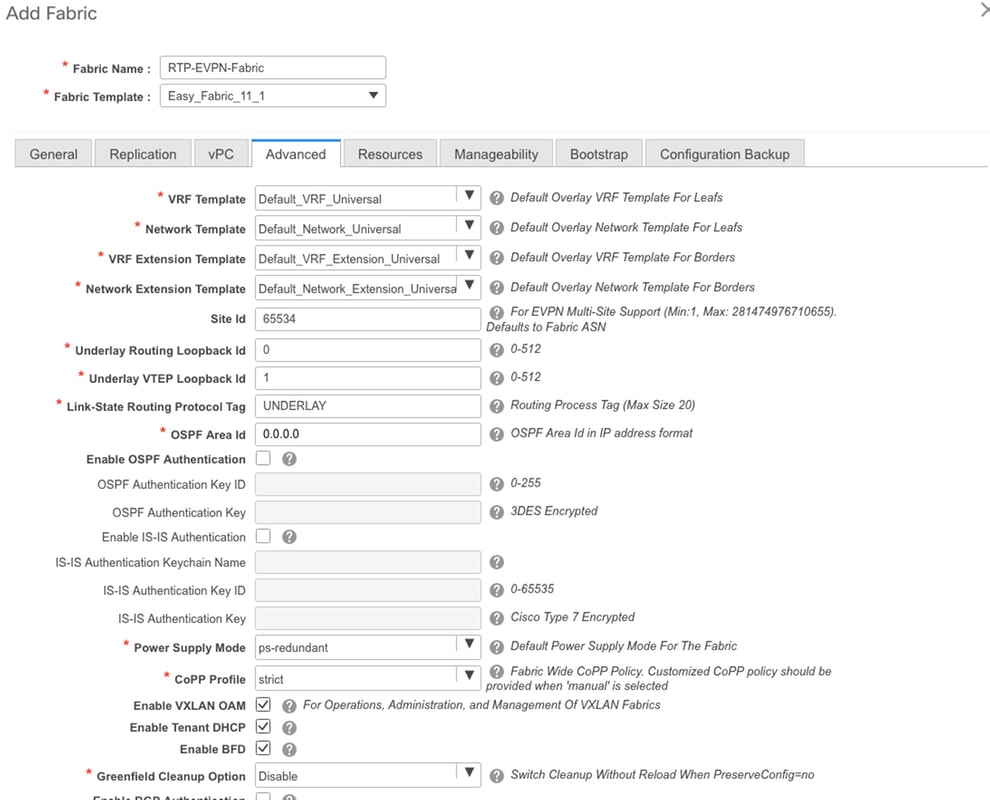

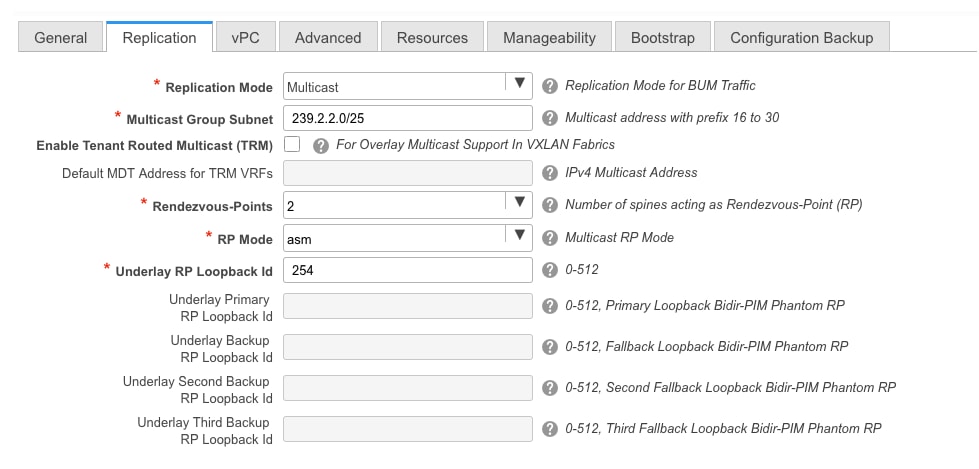

3단계. 패브릭의 언더레이, 오버레이, vPC, 복제, 리소스 등의 요구 사항을 입력합니다.

이 섹션에서는 DCNM을 통해 필요한 모든 언더레이, 오버레이, vPC, 복제 등의 설정에 대해 설명합니다. 이는 네트워크 주소 지정 체계, 요구 사항 등에 따라 달라집니다. 이 예에서는 대부분의 필드가 기본값으로 유지됩니다. L2VNI와 L3VNI가 변경되어 L2VNI는 2로 시작하고 L3VNI는 3으로 시작하므로 나중에 문제를 쉽게 해결할 수 있습니다. BFD(Bidirectional Forwarding Detection)도 다른 기능과 함께 활성화됩니다.

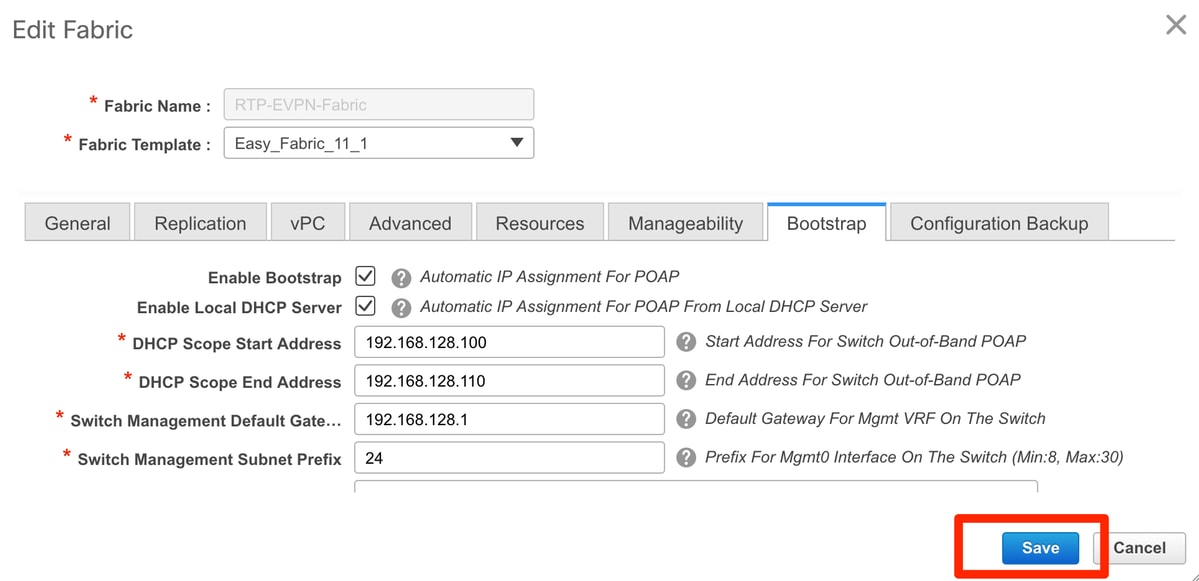

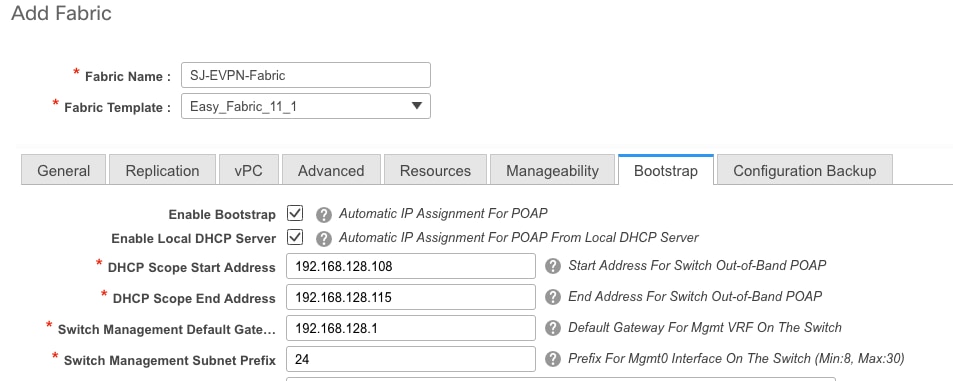

4단계. 부트스트랩 컨피그레이션에서 POAP 프로세스 동안 DCNM이 패브릭 내의 스위치에 전달할 DHCP 주소의 범위를 구성합니다. 적절한(기존) 기본 게이트웨이도 구성합니다. 완료 후 Save(저장)를 클릭하면 이제 패브릭에 스위치를 추가하는 단계로 이동할 수 있습니다.

패브릭에 스위치 추가

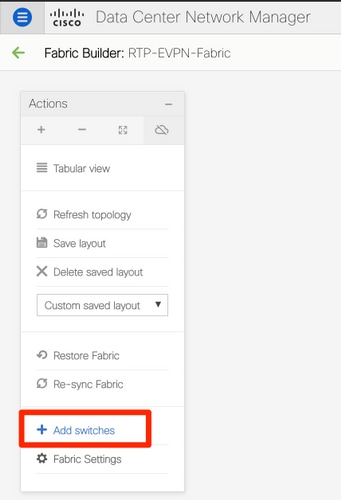

1단계. Control(제어) > Fabrics(패브릭) > Fabric Builder(패브릭 빌더)로 이동한 다음 패브릭을 선택합니다. 그림과 같이 왼쪽 패널에서 Add Switches(스위치 추가)를 클릭합니다.

시드 IP(각 스위치의 mgmt0 IP를 수동으로 구성해야 함을 의미)를 사용하여 스위치를 검색하거나, POAP를 통해 스위치를 검색하고 DCNM에서 모든 mgmt0 IP 주소, VRF 관리 등을 구성하도록 할 수 있습니다. 이 예에서는 POAP를 사용합니다.

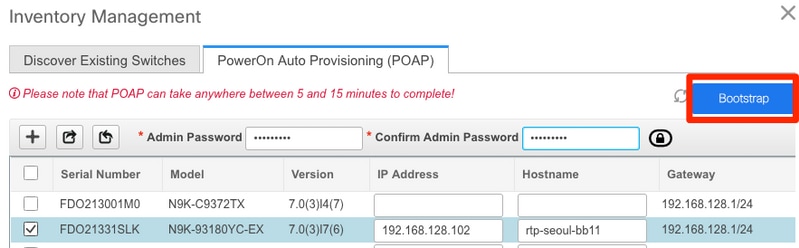

2단계. 원하는 스위치가 표시되면 원하는 IP 주소 및 호스트 이름을 입력하여 DCNM에서 사용할 수 있도록 하고 Admin PW를 입력한 다음 이미지와 같이 Bootstrap을 클릭합니다.

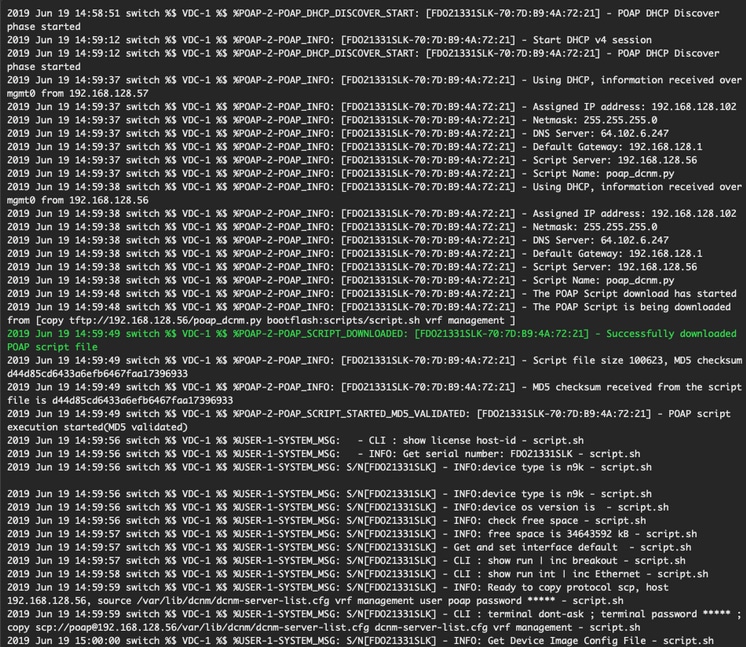

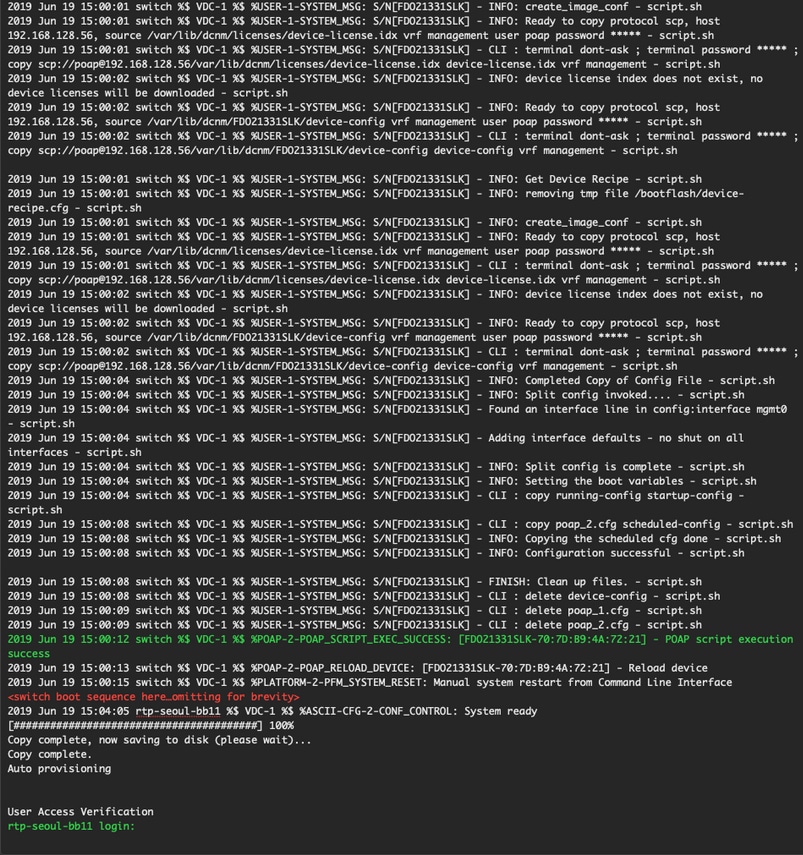

부팅 로그가 정상적으로 생성되면 스위치 콘솔의 이 그림과 같이 표시되어야 합니다.

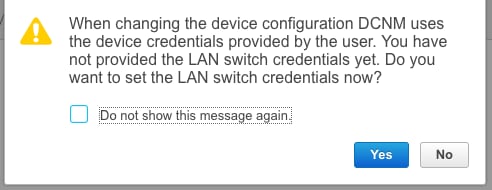

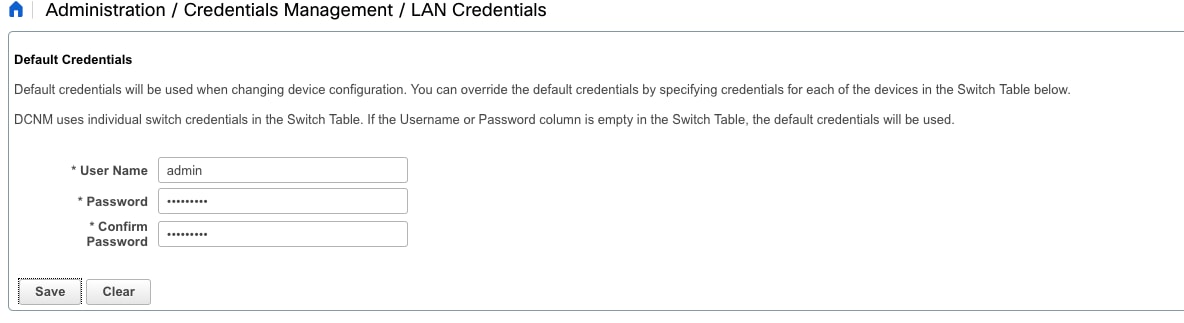

3단계. 전체 패브릭에 대한 컨피그레이션을 구축하기 전에 디바이스 자격 증명으로 DCNM을 이전에 구성했는지 확인합니다. 로그인하는 동안 GUI에 팝업이 표시되어야 합니다. 그렇지 않은 경우 Administration(관리) > Credentials Management(자격 증명 관리) > LAN Credentials(LAN 자격 증명)를 통해 항상 액세스할 수 있습니다.

참고: 디바이스 자격 증명이 없으면 DCNM에서 스위치에 컨피그레이션을 푸시하지 못합니다.

패브릭 컨피그레이션 구축

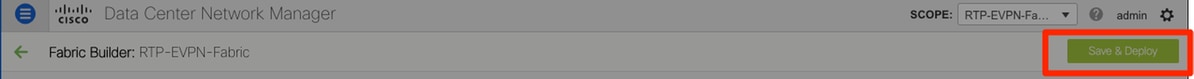

1단계. 동일한 단계를 사용하여 지정된 패브릭에 대한 모든 스위치를 발견한 경우 Control > Fabrics > Fabric Builder > <your selected Fabric>으로 이동합니다. 여기에 모든 스위치와 링크가 표시됩니다. Save & Deploy를 클릭합니다.

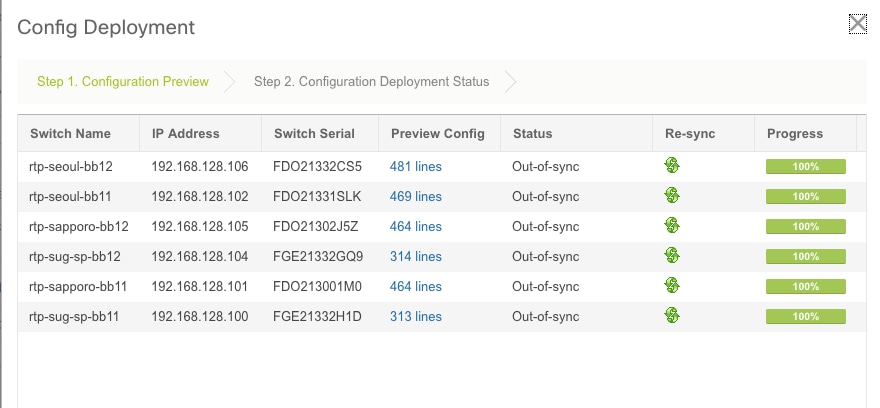

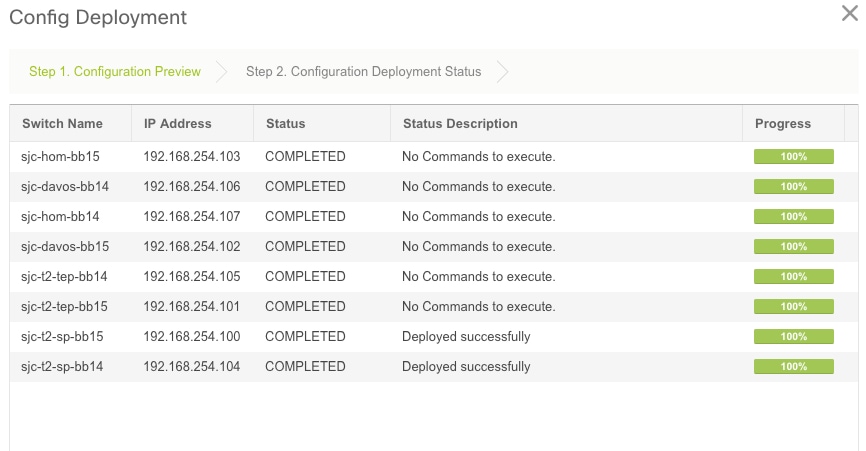

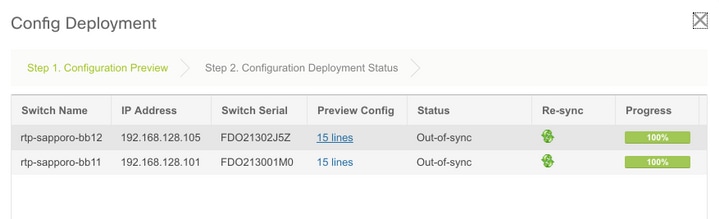

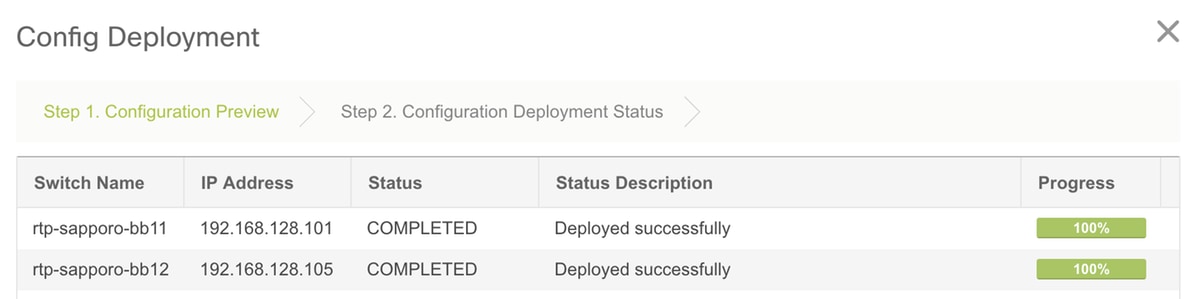

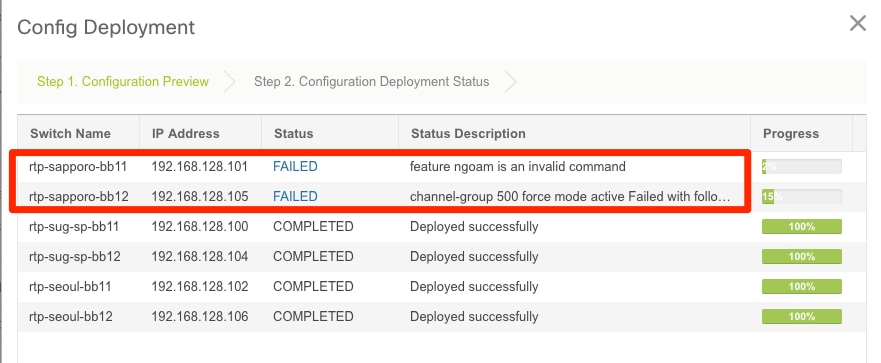

2단계. Config Deployment(컨피그레이션 구축) 창에서 각 스위치 DCNM에 대해 몇 개의 컨피그레이션을 푸시하는지 확인합니다. 원하는 경우 컨피그레이션도 미리 보고 전과 후를 비교할 수 있습니다.

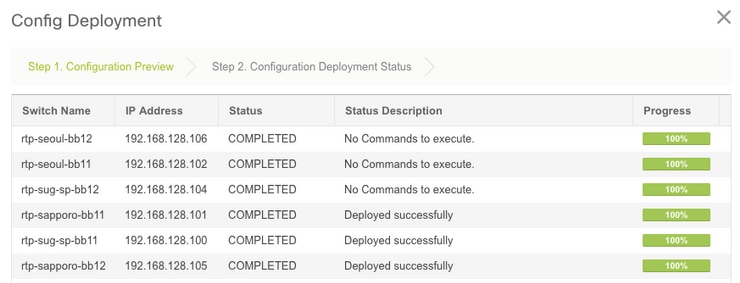

모든 스위치의 상태가 COMPLETED이고 오류 없이 100%인지 확인 — 오류가 있는 경우 한 번에 하나씩 해결하십시오(예를 보려면 이 구축 과정에서 발생한 문제 섹션 참조).

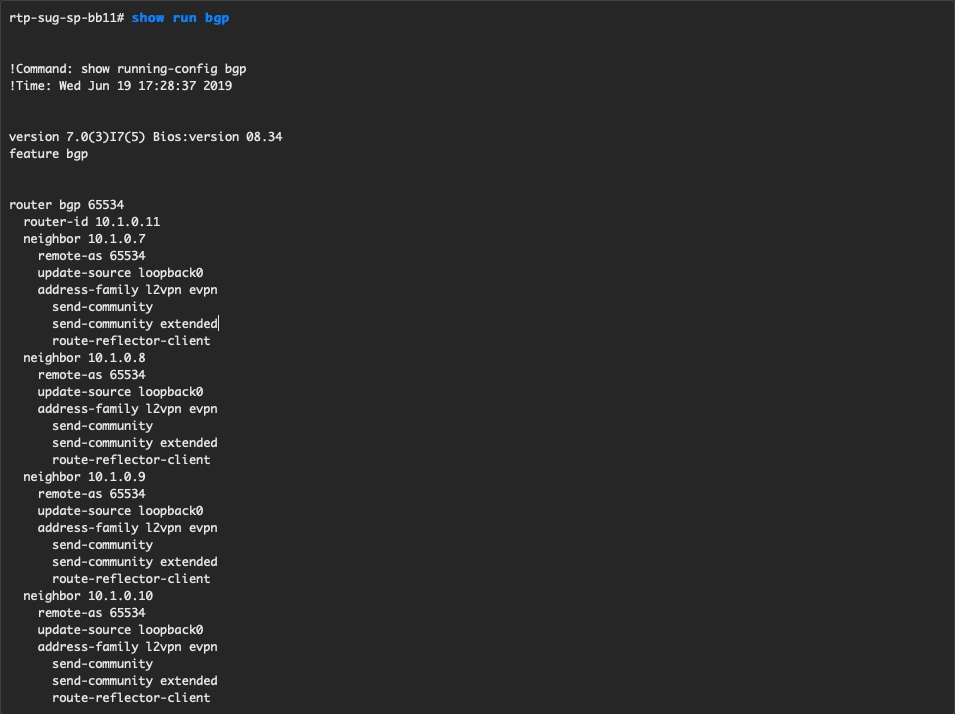

3단계(선택 사항) 이 시점에서 디바이스에 로그인하고 show run CLI를 실행하여 DCNM에서 컨피그레이션을 성공적으로 푸시했는지 확인할 수 있습니다.

예:

두 번째 패브릭 구축 — SJ

BGP AS에 대해 서로 다른 값을 사용하는 RTP 패브릭을 사용하여 이전과 동일한 단계를 수행합니다.

1단계. Control(제어) > Fabrics(패브릭) > Fabric Builder > Create Fabric(패브릭 생성) > Name it!(이름 지정)로 이동합니다.

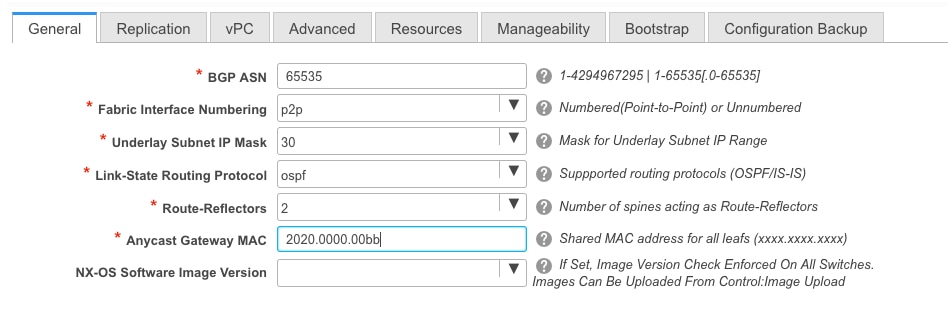

이 섹션에서는 필요한 모든 언더레이, 오버레이, vPC, 복제 등의 설정에 대해 설명합니다. 이는 네트워크 주소 지정 체계, 요구 사항 등에 따라 달라집니다.

참고: 멀티사이트를 사용하는 경우 나중에 다른 Anycast Gateway MAC가 지원되지 않는 경우 여기서 Anycast Gateway MAC는 다른 Fabric과 일치해야 합니다. 이 문제는 나중에 다중 사이트 구축 섹션(간결성을 위해 기사 내에 표시되지 않음)에서 수정되었습니다.

2단계. 이전에 구성한 대로 부트스트랩 섹션을 구성합니다. Add Switches(스위치 추가)를 다시 탐색합니다. 모두 검색되면 Save & Deploy(저장 및 구축)를 클릭하여 컨피그레이션을 구축합니다. 이 내용은 모두 RTP Fabric Deployment 섹션에서 다룹니다(간결성을 위해 여기를 생략).

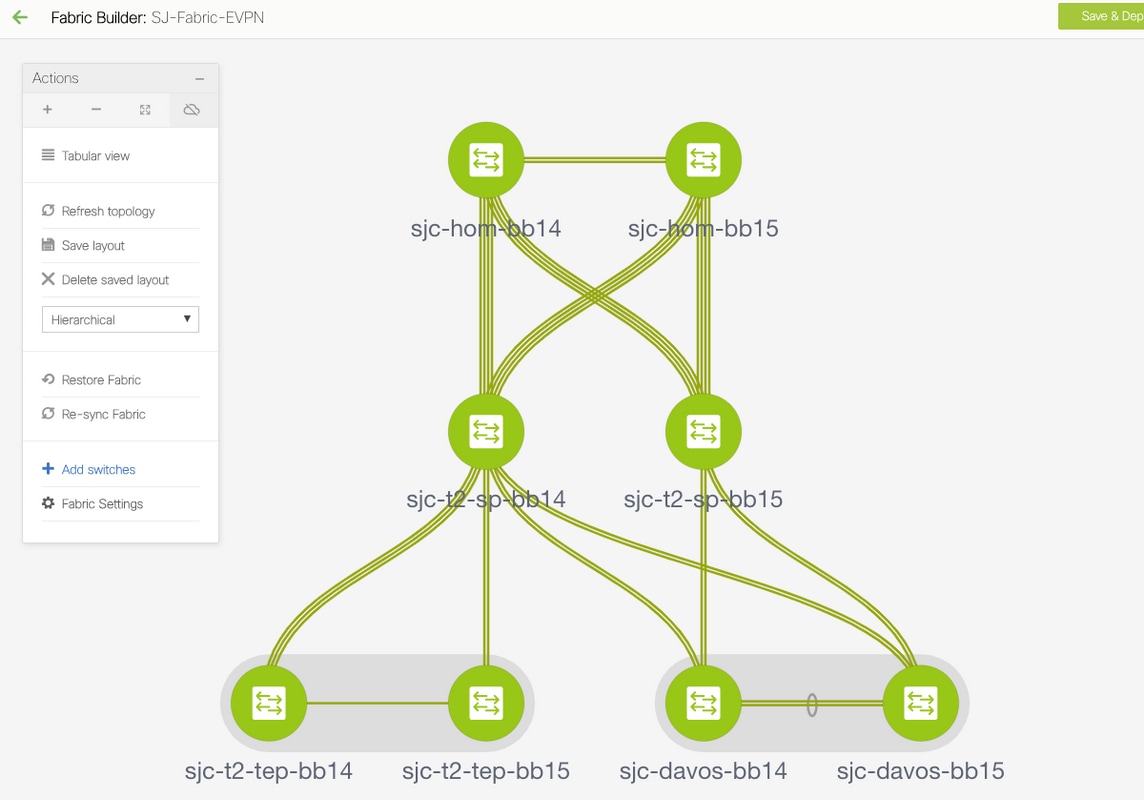

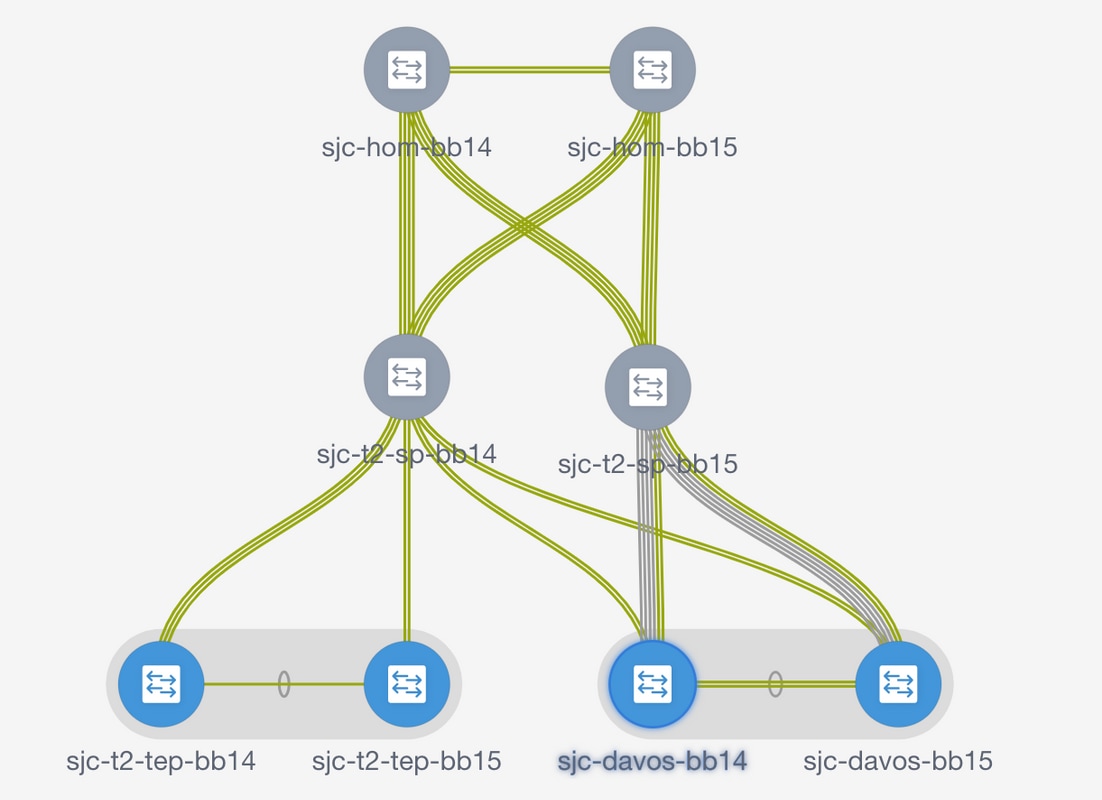

끝에 Fabric Builder의 관점에서 토폴로지가 나와 있습니다.

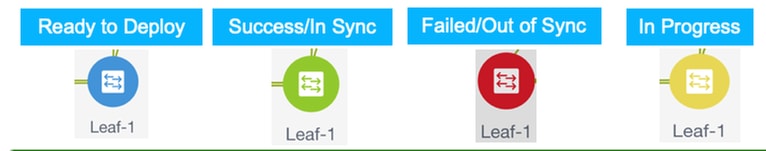

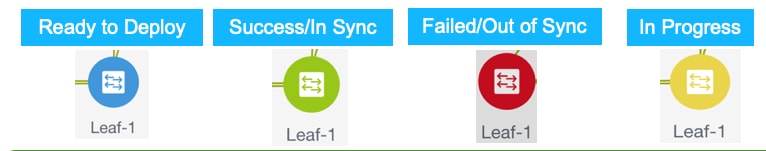

모든 스위치는 링크와 함께 녹색으로 표시되는 것이 좋습니다. 이 그림에서는 DCNM 평균의 여러 상태 색상을 보여 줍니다.

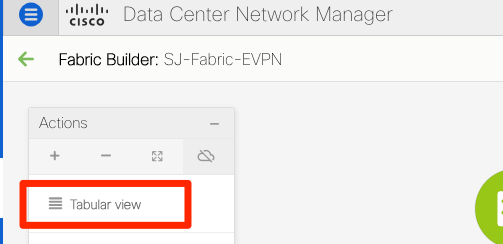

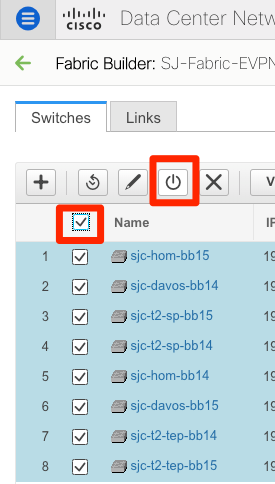

3단계. 두 패브릭을 모두 구성하고 구축한 후에는 TCAM 변경 사항을 반영하기 위해 config & reload를 저장해야 합니다. 그림과 같이 Controls > Fabrics > Fabric Builder > <your Fabric>으로 이동하여 Tabular View로 이동합니다.

4단계. 전원 버튼을 클릭합니다(모든 스위치가 동시에 다시 로드됨).

네트워크(VLAN/L2VNI) 및 VRF(L3VNI) 생성

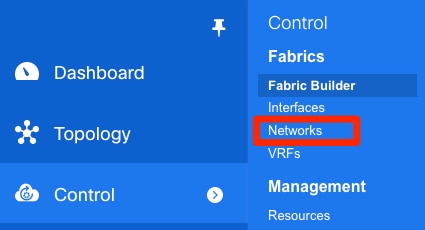

1단계. 이미지에 표시된 대로 Control(제어) > Fabrics(패브릭) > Networks(네트워크)로 이동합니다.

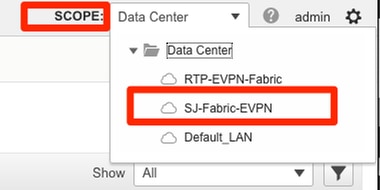

2단계. 그림과 같이 변경 범위를 선택합니다. 즉, 이 구성을 어떤 패브릭에 적용해야 합니까?

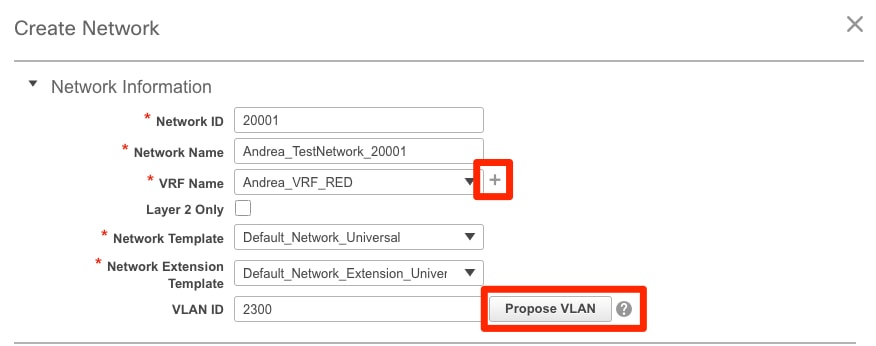

3단계. 그림과 같이 + 기호를 클릭합니다.

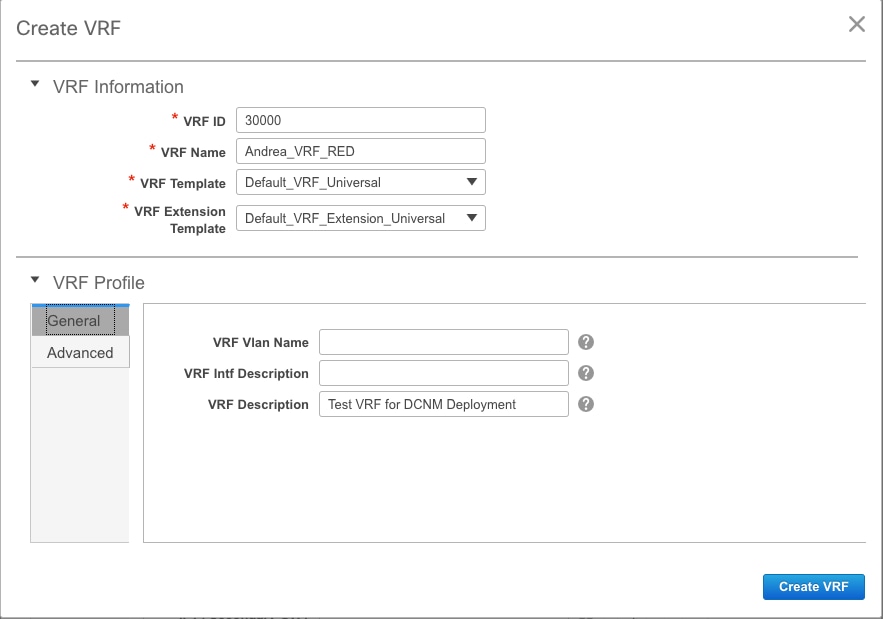

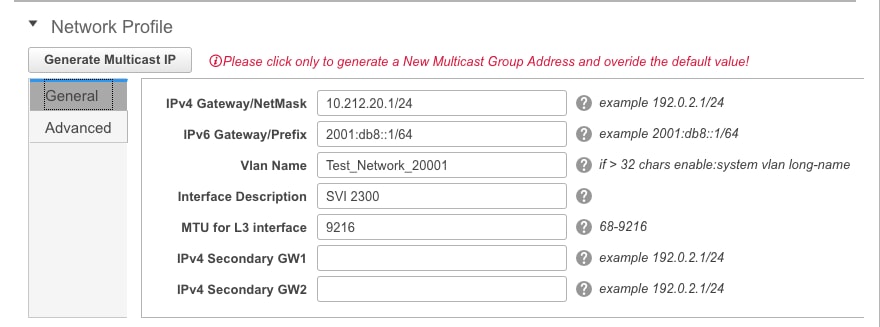

4단계. DCNM은 SVI(Switch Virtual Interface)(또는 순수 L2 VLAN)를 생성하는 프로세스를 안내합니다. 이 단계에서 VRF가 생성되지 않은 경우 + 버튼을 다시 클릭하면 SVI 설정으로 진행하기 전에 임시로 VRF 워크스루로 이동합니다.

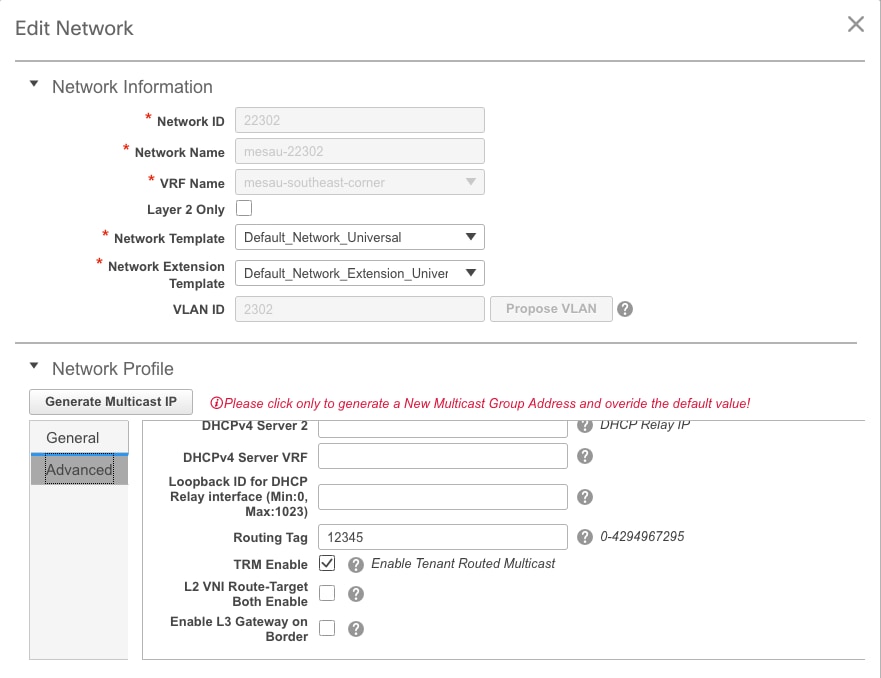

Advanced(고급) 탭에서 이러한 기능을 구성할 수 있습니다.

- ARP 억제

- 인그레스 복제

- 멀티캐스트 그룹

- DCHP

- 경로 태그

- TRM

- L2 VNI 경로-대상

- 테두리에서 L3 게이트웨이 사용

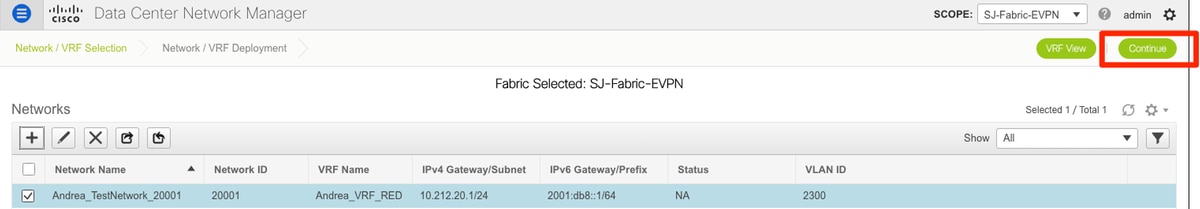

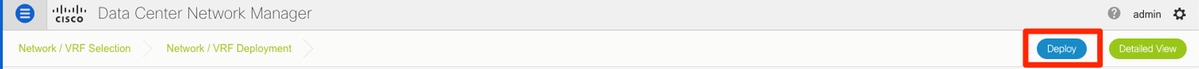

5단계. Continue(계속)를 클릭하여 네트워크/VRF 컨피그레이션을 구축합니다.

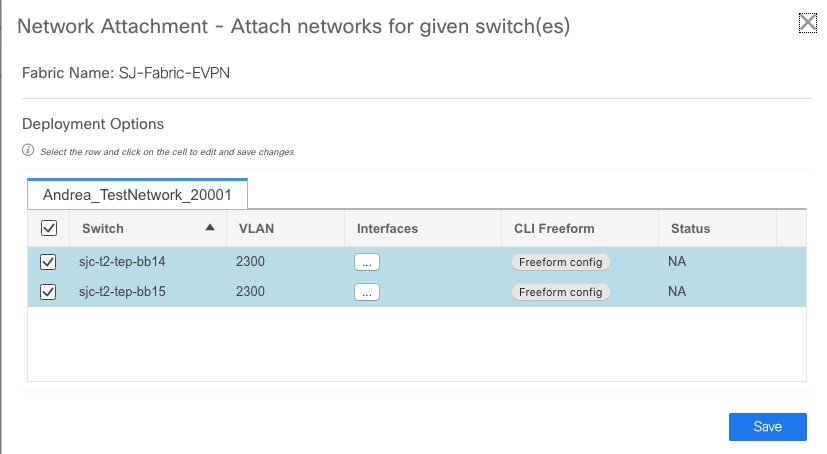

6단계. 토폴로지 보기에서 디바이스(또는 디바이스)를 더블 클릭하여(DCNM에서 자동으로 여기로 이동) 해당 컨피그레이션에 대해 선택합니다. 이미지에 표시된 대로 Save(저장)를 클릭합니다.

7단계. 이 옵션을 선택하면 이 이미지에 표시된 것처럼 스위치가 파란색으로 표시됩니다(Ready to Deploy).

참고: 구축하기 전에 CLI에 대한 컨피그레이션을 확인하려면 Deploy 대신 Detailed View를 클릭하고 다음 화면에서 Preview를 클릭합니다.

컨피그레이션이 적용되는 동안 스위치가 노란색으로 바뀌며, 완료되면 녹색으로 돌아갑니다.

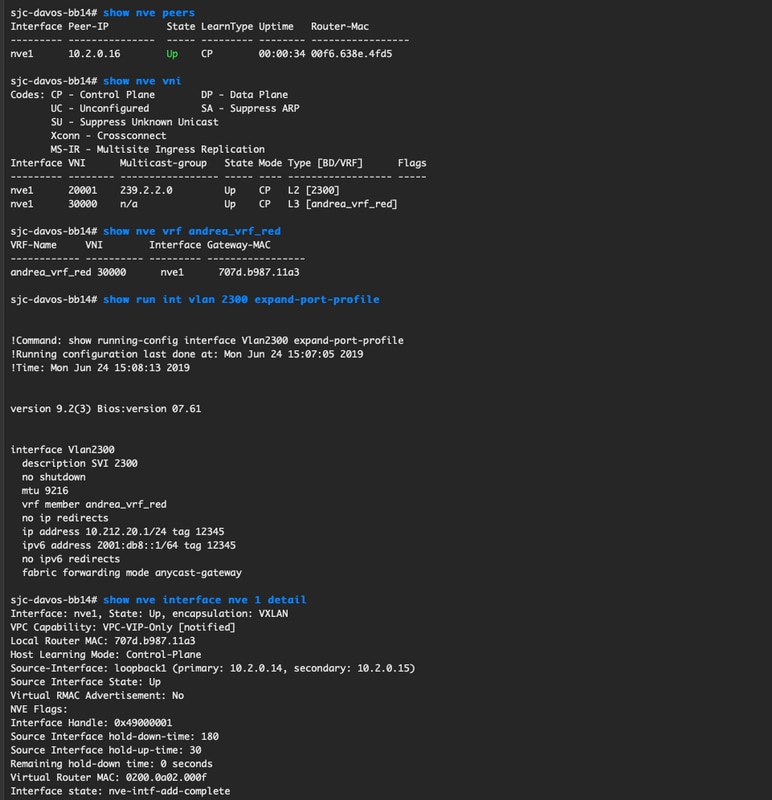

8단계(선택 사항) 필요한 경우 CLI에 로그인하여 컨피그레이션을 확인할 수 있습니다(expand-port-profile 옵션을 사용해야 함).

멀티 사이트 컨피그레이션

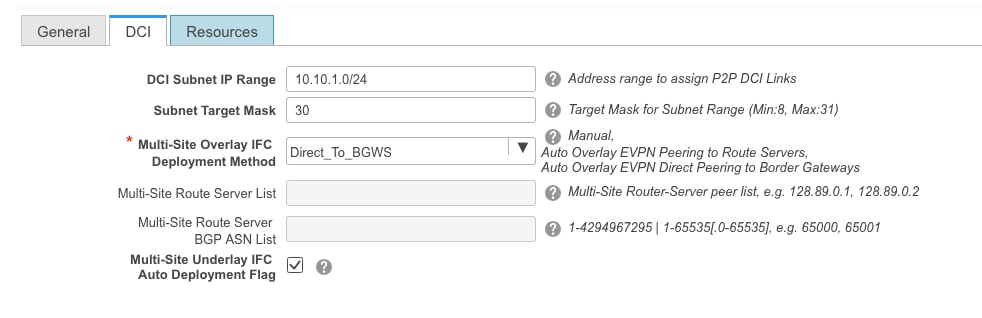

이 Greenfield 구축의 경우 BGW(Border Gateway) 간 직접 피어링을 통해 MSD 패브릭이 구축됩니다. 또 다른 방법은 이 문서에서 다루지 않는 중앙 집중식 경로 서버를 사용하는 것입니다.

1단계. 그림과 같이 Control > Fabric Builder > Create Fabric으로 이동합니다.

2단계. 다중 사이트 패브릭에 이름을 지정하고 패브릭 템플릿에 대한 드롭다운에서 MSD_Fabric_11_1을 선택합니다.

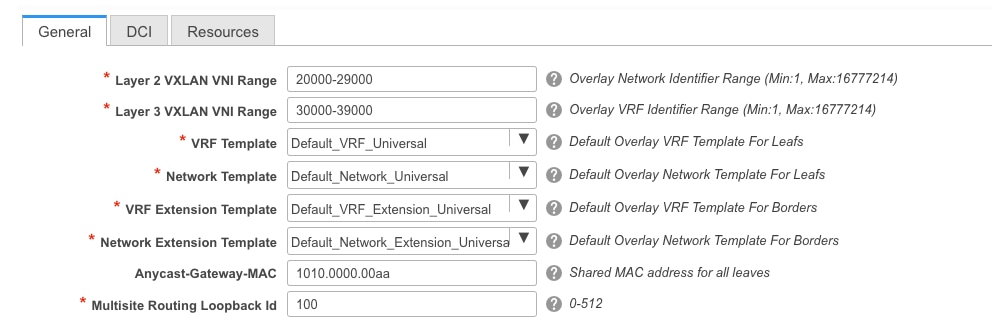

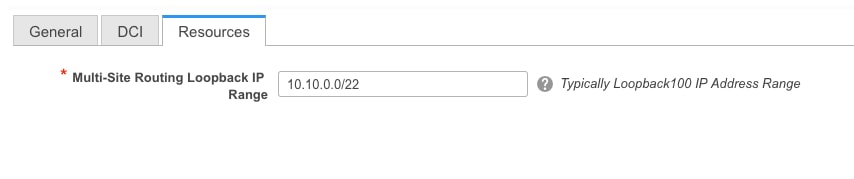

3단계. General(일반) 아래에서 L2 및 L3 VNI 범위가 개별 패브릭에서 사용 중인 범위와 일치하는지 확인합니다. 또한 Anycast Gateway MAC는 두 패브릭(이 예에서는 RTP/SJ)에서 일치해야 합니다. DCNM은 게이트웨이 MAC가 일치하지 않는 경우 오류를 제공하며 MSD 구축을 진행하기 전에 오류를 수정해야 합니다.

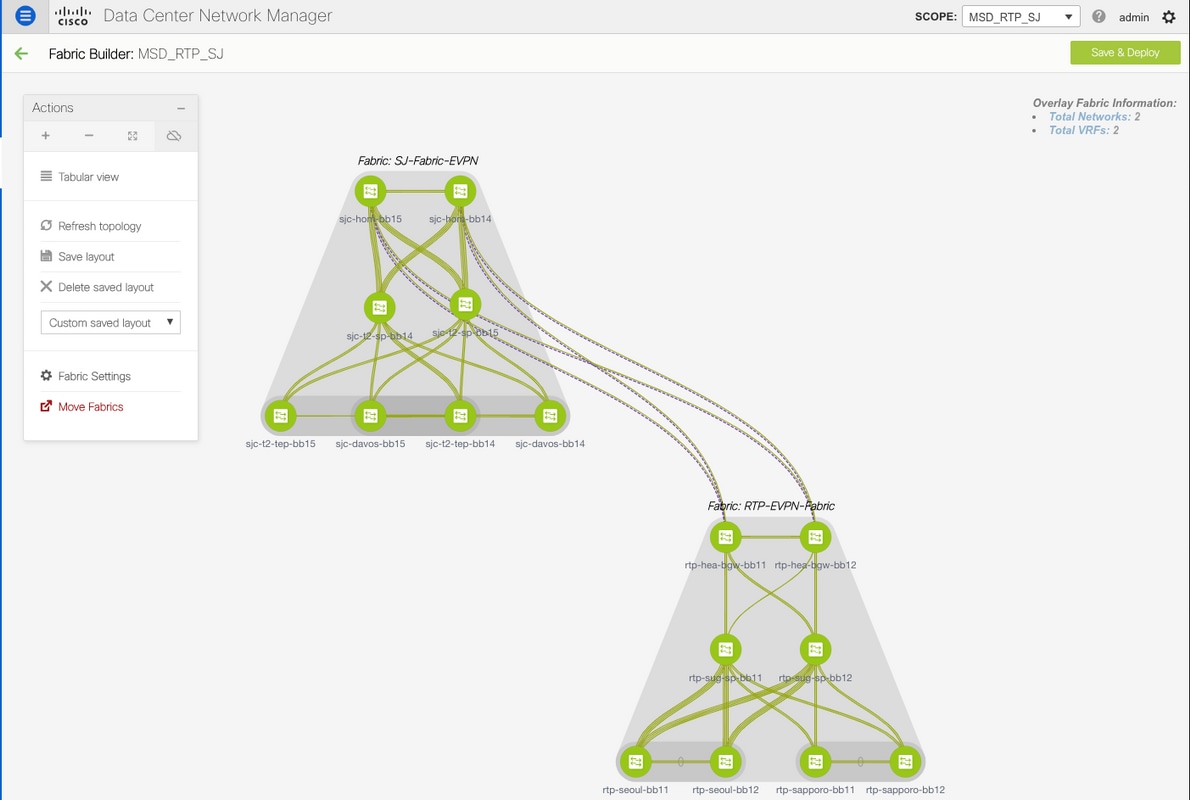

4단계. Save(저장)를 클릭한 다음 MSD Fabric(MSD 패브릭)으로 이동하여 Save & Deploy(저장 및 구축)를 클릭합니다. 성공적으로 완료되면 토폴로지는 다음과 비슷해야 합니다(모든 스위치 + 링크가 녹색).

호스트 액세스/트렁크 정책 구축

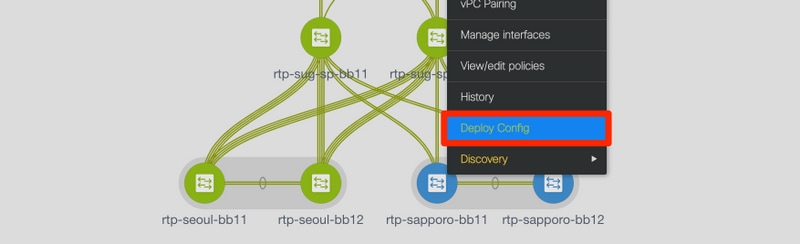

이 예에서는 서로 다른 두 VTEP 쌍의 vPC 트렁크가 구성되어 로컬 RTP 패브릭 내에서 연결을 테스트합니다. 이미지에 표시된 관련 토폴로지:

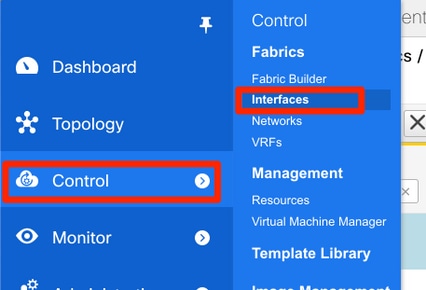

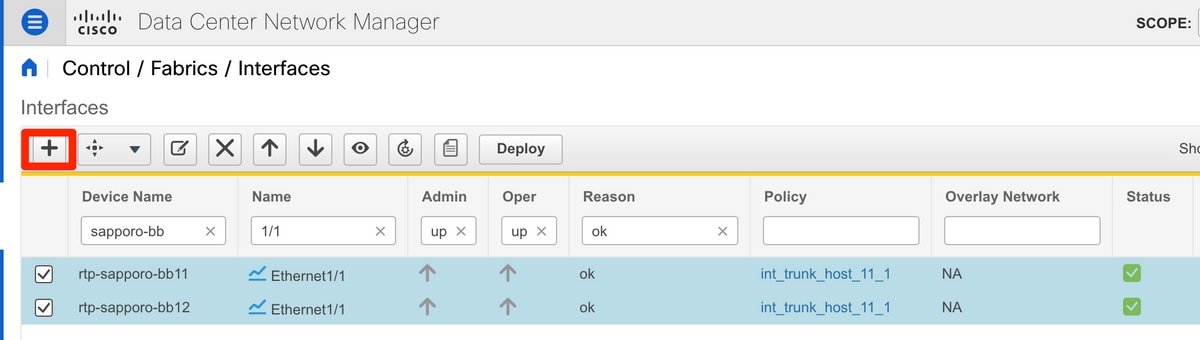

1단계. 이미지에 표시된 대로 Control > Fabrics > Interfaces로 이동합니다.

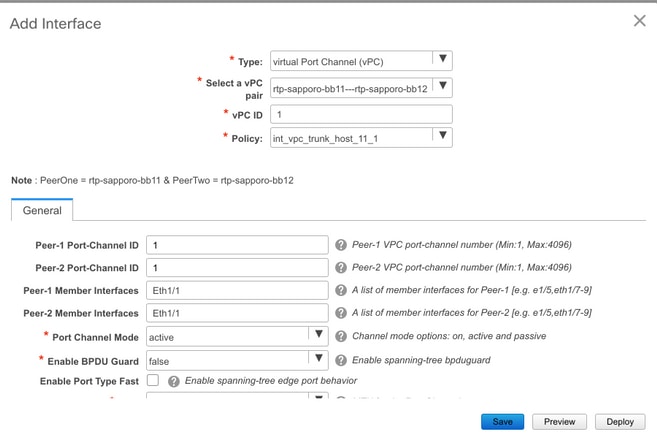

2단계. + 기호를 클릭하여 그림과 같이 Add an Interface(인터페이스 추가) 마법사를 입력합니다.

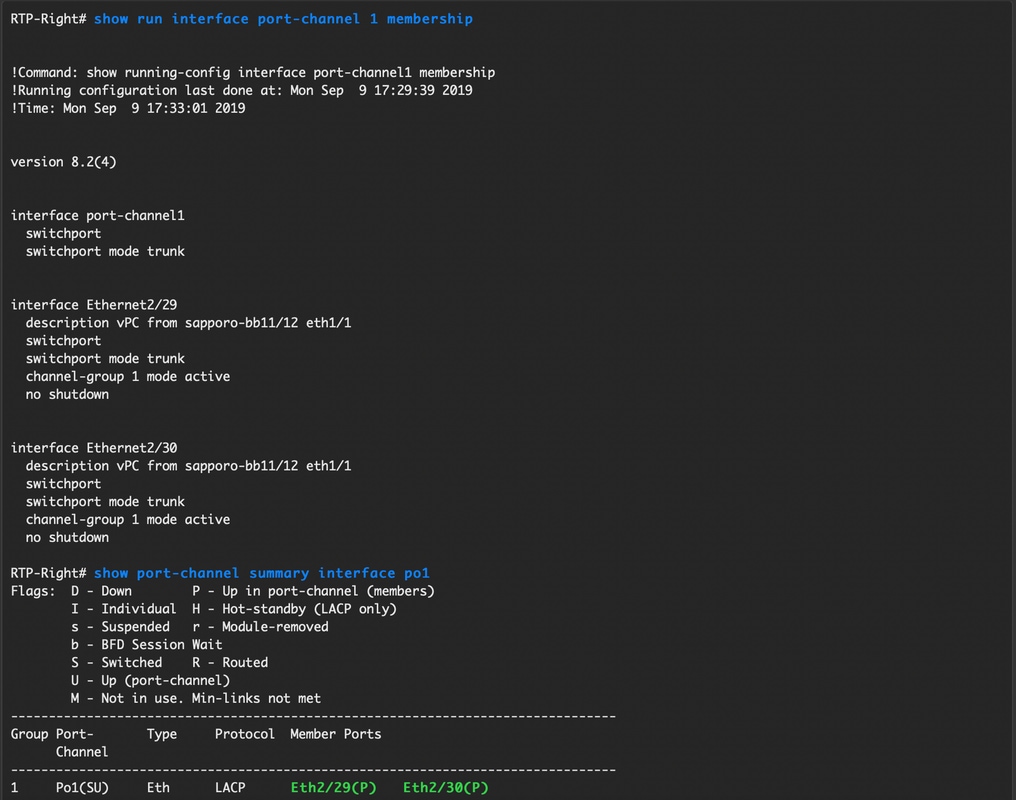

이 예에서는 vPC 트렁크가 N7K의 다운스트림에 만들어지며, 이 트렁크는 이 워크스루에서 테스트를 ping하는 데 사용됩니다.

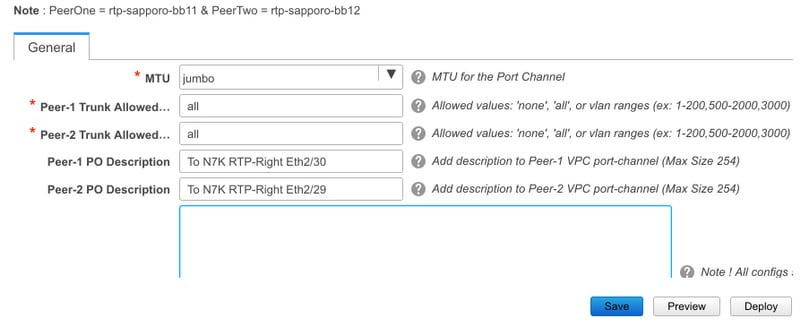

3단계. 적절한 vPC 쌍, 물리적 인터페이스, LACP on/off, BPDUCKuard 등을 선택합니다.

4단계. 완료되면 Save(저장)를 클릭합니다. 또는 그림과 같이 직접 구축할 수도 있습니다.

5단계. (선택 사항) 적용할 컨피그레이션을 검토합니다.

6단계. (선택 사항) 7K에서 수동 구성:

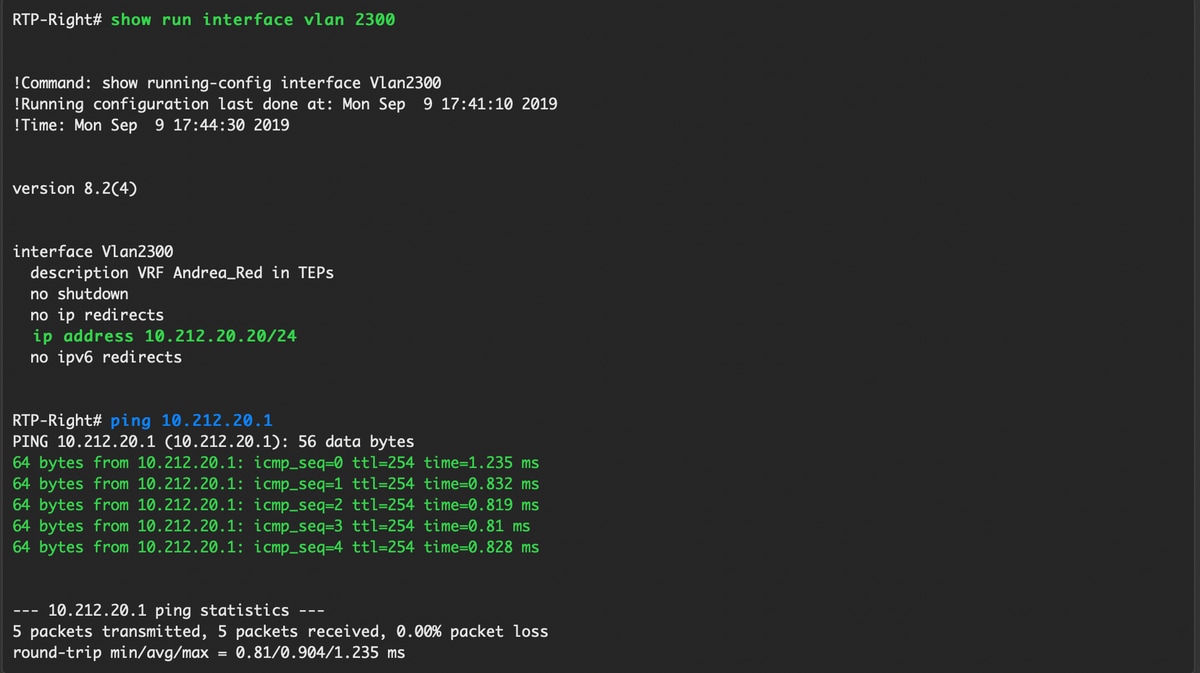

7단계. (선택 사항) N7K에서 테스트 SVI를 생성하여 RTP에서 VTEP를 ping합니다(VTEP의 Anycast Gateway는 VRF andrea_red에서 10.212.20.1임).

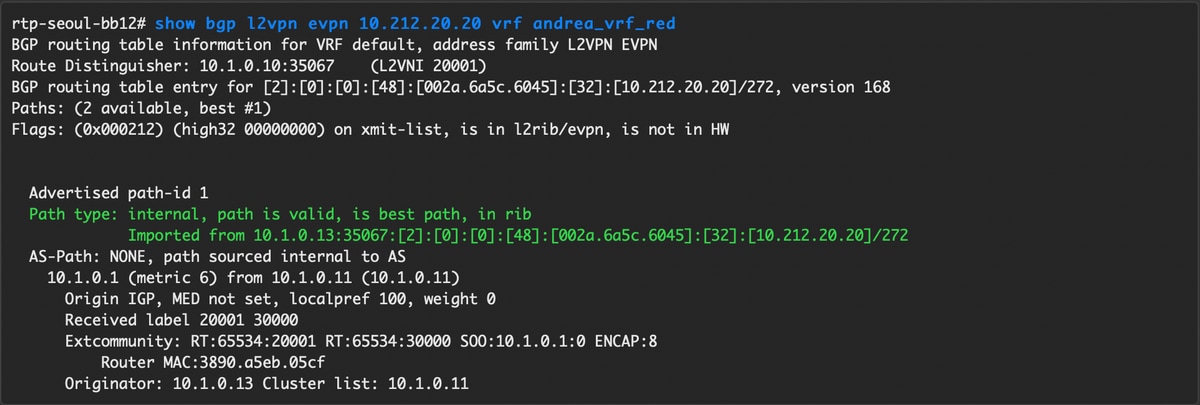

8단계. (선택 사항) RTP 내의 다른 VTEP에서 EVPN/HMM을 통해 이 호스트를 인식하는지 확인합니다.

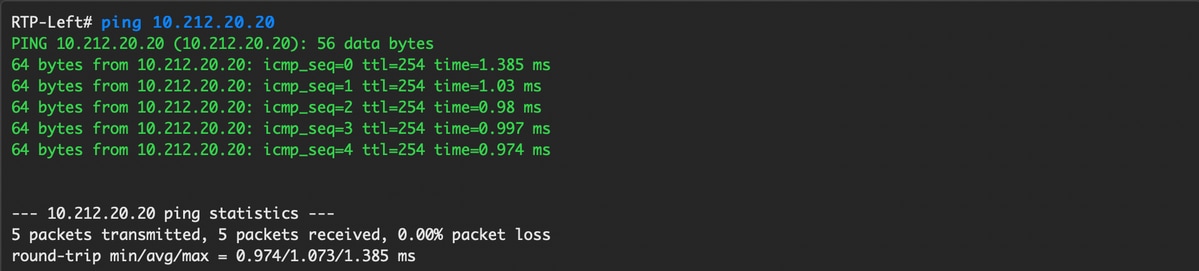

9단계(선택 사항) seoul-bb11/12에 대해 동일한 프로세스를 반복합니다(vPC 포트 채널 생성, SVI 2300 생성). RTP Fabric 내에서 EVPN을 통해 L2 연결을 확인하기 위해 RTP-Left에서 RTP-Right로 ping합니다.

Add Interfaces(인터페이스 추가) 컨텍스트 아래에서 비 vPC 포트 채널, 액세스 인터페이스 등을 생성하는 유사한 단계를 수행할 수 있습니다.

Day 2 운영

DCNM을 통해 NX-OS 소프트웨어 업그레이드

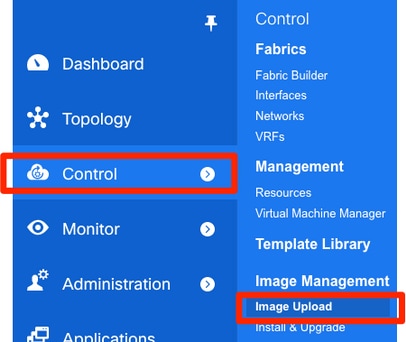

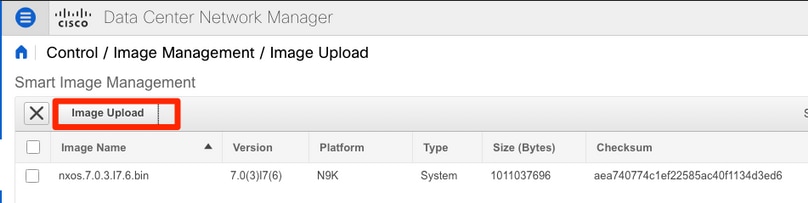

1단계. 이미지(또는 이미지 세트)를 DCNM의 서버에 업로드한 다음 그림과 같이 Control(제어) > Image Management(이미지 관리) > Image Upload(이미지 업로드)로 이동합니다.

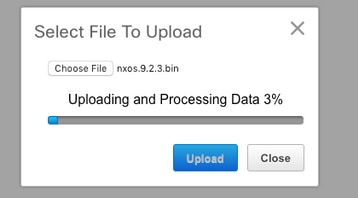

2단계. 프롬프트에 따라 로컬 업로드를 수행하면 이 이미지에 표시된 대로 파일이 표시됩니다.

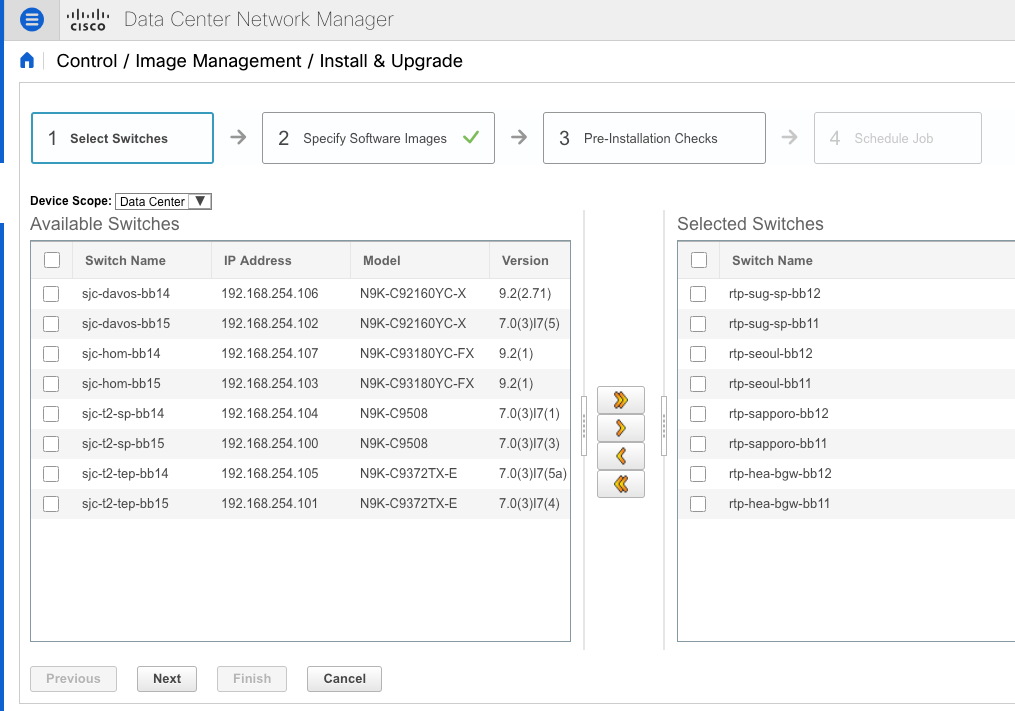

3단계. 파일이 업로드되면 스위치에 업그레이드가 필요한 경우 Install & Upgrade(설치 및 업그레이드)로 이동할 수 있습니다. 이미지에 표시된 대로 Control(제어) > Image Management(이미지 관리) > Install & Upgrade(설치 및 업그레이드)로 이동합니다.

4단계. 업그레이드할 스위치를 선택합니다. 이 예에서는 전체 RTP 패브릭이 업그레이드됩니다.

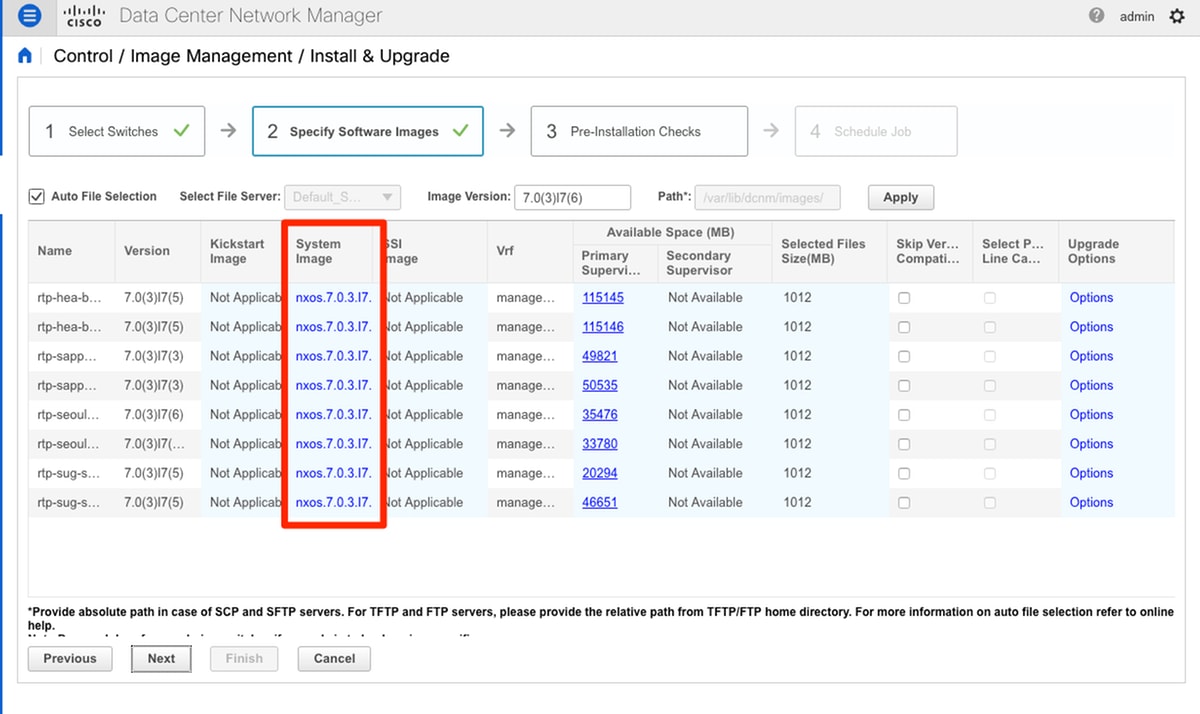

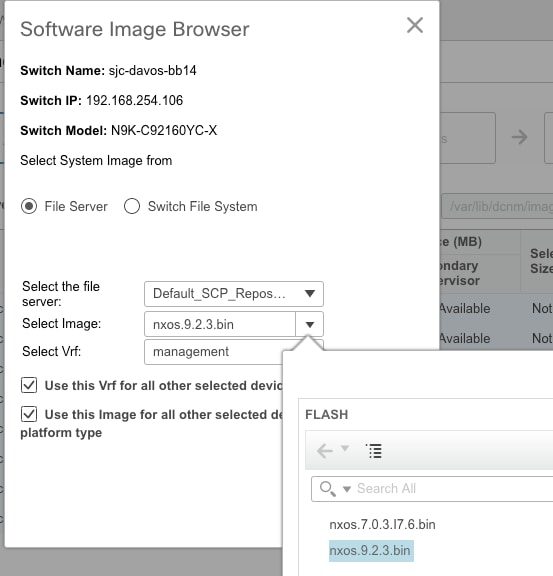

5단계. 스위치를 업그레이드할 NX-OS 버전을 선택합니다(모범 사례로서 모든 스위치를 동일한 NX-OS 버전으로 업그레이드).

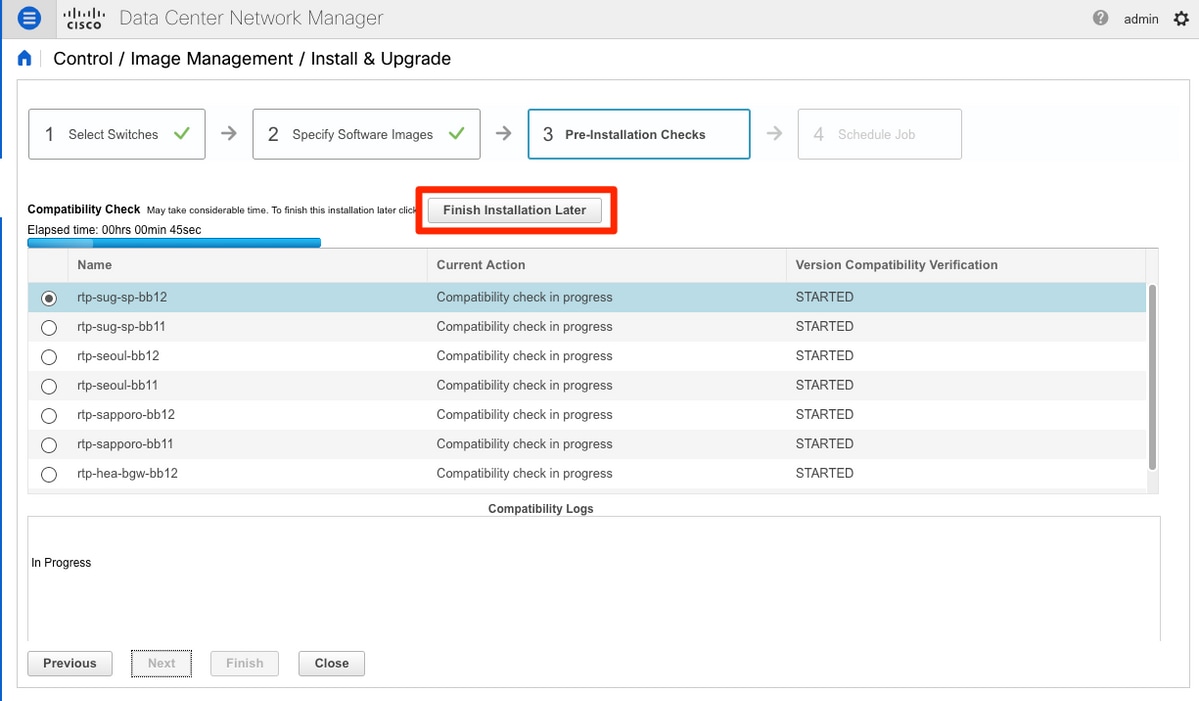

6단계. Next(다음)를 클릭하면 DCNM에서 사전 설치 검사를 통해 스위치를 실행합니다. 이 창은 시간이 꽤 걸릴 수 있으므로 나중에 설치 완료를 선택하고 부재 중 업그레이드 일정을 잡을 수도 있습니다.

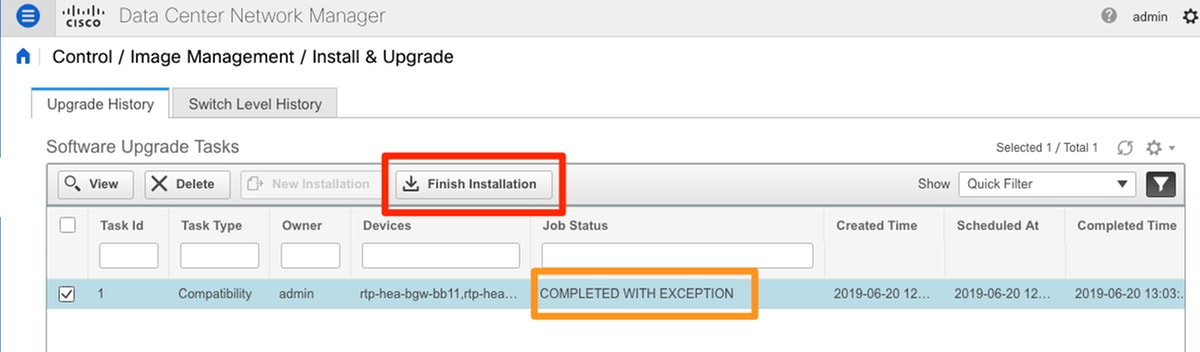

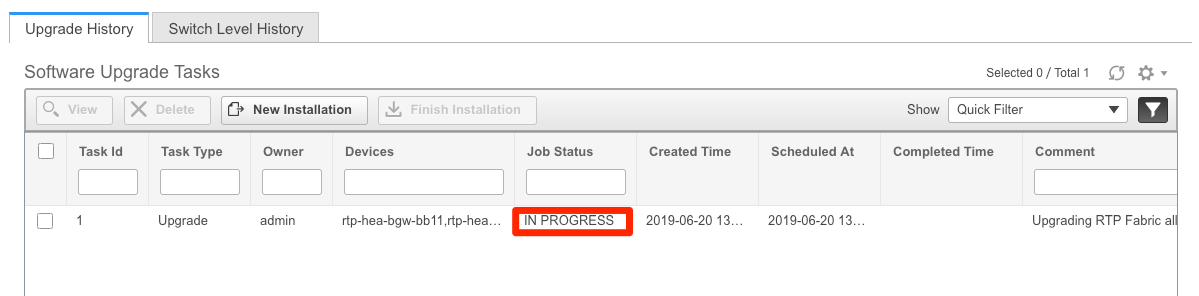

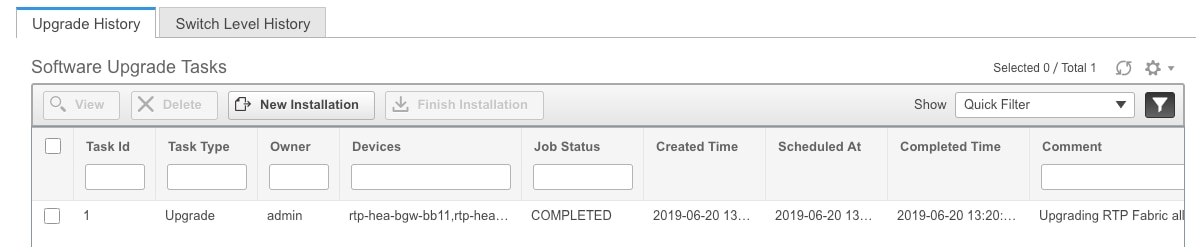

이 큐는 작업을 대기열에 추가하며, 작업이 완료되면 여기 이미지에 표시된 것과 유사하게 표시됩니다.

참고: 위 사례의 예외는 RTP 스위치 중 하나에 NX-OS 이미지를 위한 충분한 공간이 없다는 것이었습니다.

7단계. 호환성이 완료되면 그림과 같이 같은 창에서 Finish Installation(설치 마침)을 클릭합니다.

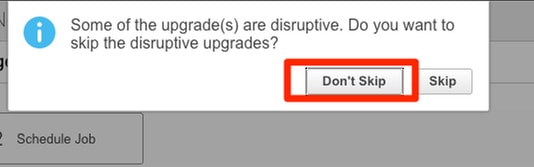

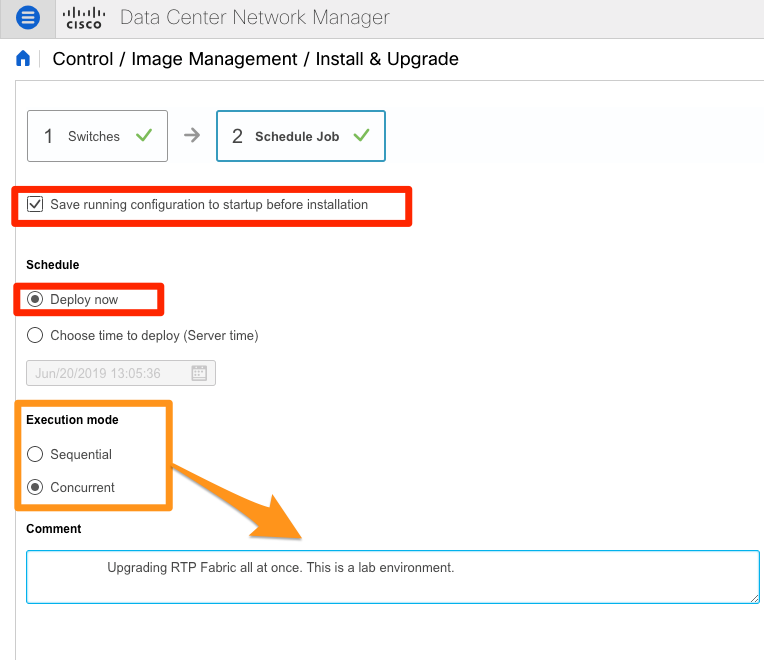

8단계. 동시(동시에 모두) 또는 순차(한 번에 하나씩)로 수행할 업그레이드를 선택할 수 있습니다. 이 환경은 랩 환경이므로 선택된 항목은 동시에 사용됩니다.

작업이 생성되고 이미지에 표시된 것처럼 IN PROGRESS(진행 중)로 표시됩니다.

이미지를 선택할 수 있는 다른 방법이 여기에 표시됩니다.

엔드포인트 로케이터 설치

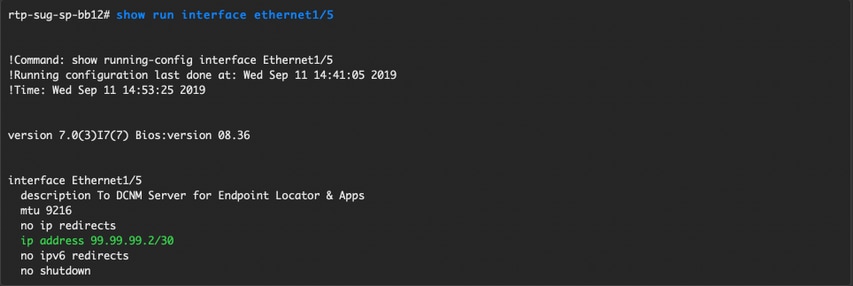

DCNM 앱이 제대로 작동하려면 DCNM 서버와 패브릭의 Nexus 9000 중 하나에 대한 전면 패널 포트 간에 인밴드 연결이 있어야 합니다. 이 예에서 DCNM 서버는 RTP 패브릭에 있는 스파인 중 하나의 Ethernet1/5에 연결됩니다.

1단계. 이 CLI는 Nexus 9000에 수동으로 추가됩니다.

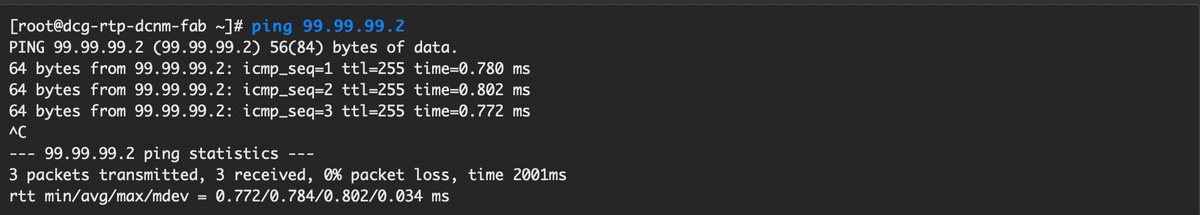

2단계. 이 포인트-투-포인트 연결에서 DCNM 서버에 ping하거나 DCNM 서버를 ping할 수 있는지 확인합니다.

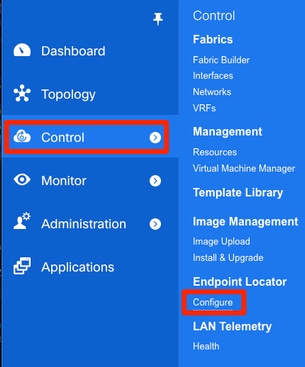

3단계. 그림과 같이 DCNM GUI > Control > Endpoint Locator > Configure로 이동합니다.

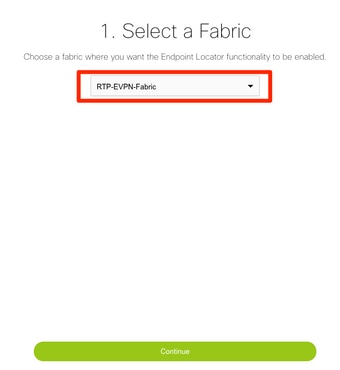

4단계. 이미지에 표시된 대로 엔드포인트 로케이터를 활성화할 패브릭을 선택합니다.

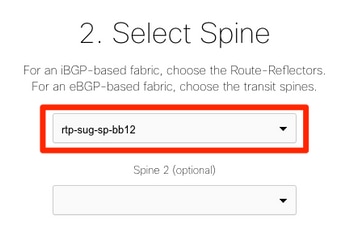

5단계. 그림과 같이 Spine(스파인)을 선택합니다.

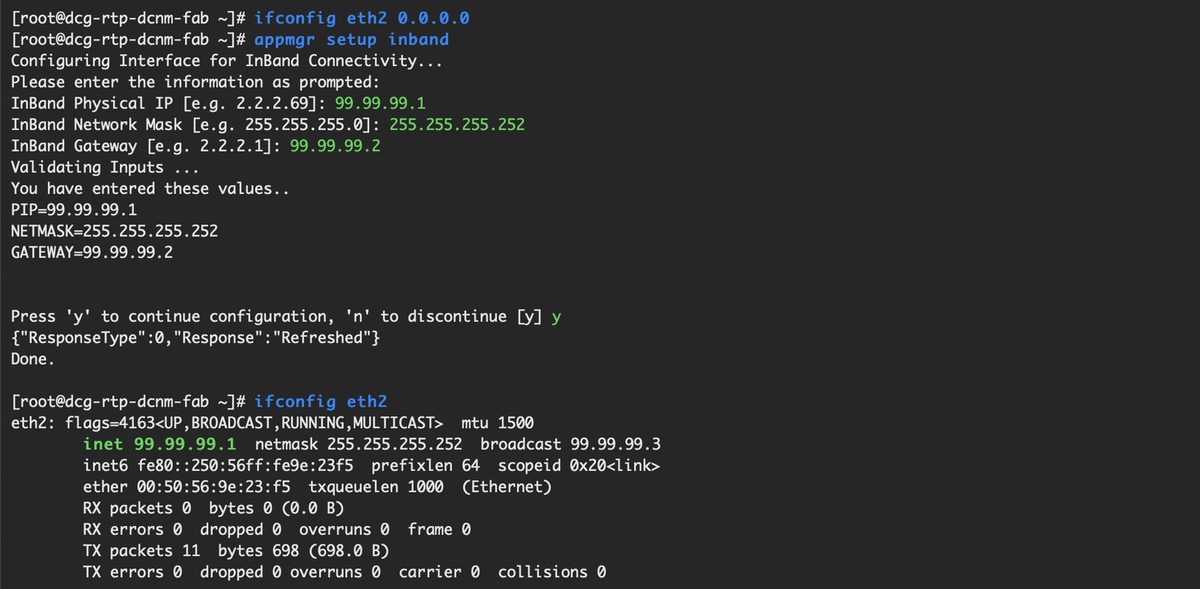

6단계. (선택 사항) 다음 단계로 진행하기 전에 eth2의 IP가 DCNM 서버에서 이 CLI를 통해 원래 구축에서 변경되었습니다(DCNM 서버 새로 설치 중에 구성된 원래 IP가 올바른 상태인 경우 이 단계는 필요하지 않음).

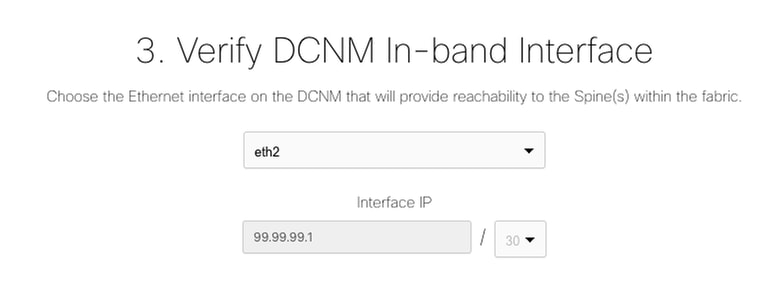

7단계. 대역 내 인터페이스 컨피그레이션을 확인합니다. 이는 이전 단계에서 구성된 것과 일치해야 합니다.

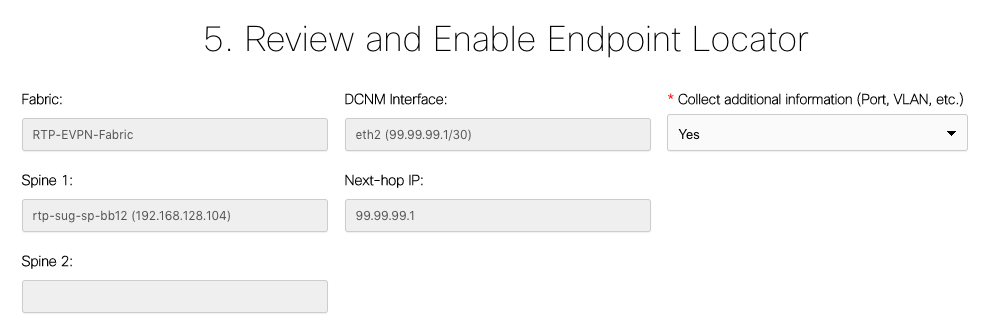

8단계. 구성을 검토한 후 Configure(구성)를 클릭합니다. 이 단계는 몇 분 정도 걸릴 수 있습니다.

완료되면 이미지에 표시된 것처럼 알림이 나타납니다.

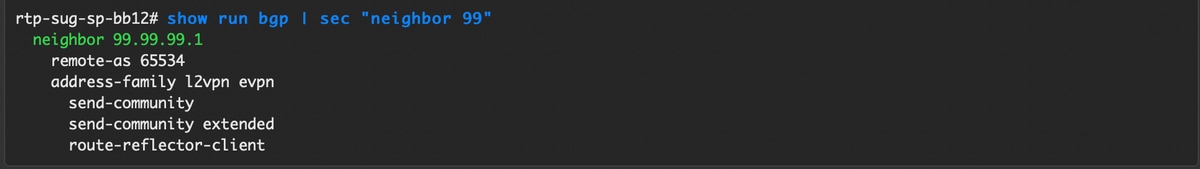

DCNM에서 L2VPN EVPN 패밀리의 선택한 스파인에 BGP 인접 디바이스를 구성했습니다.

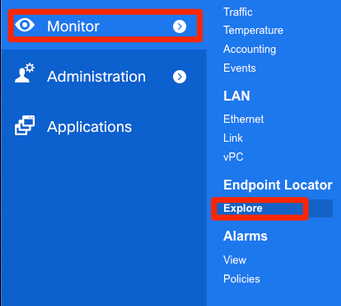

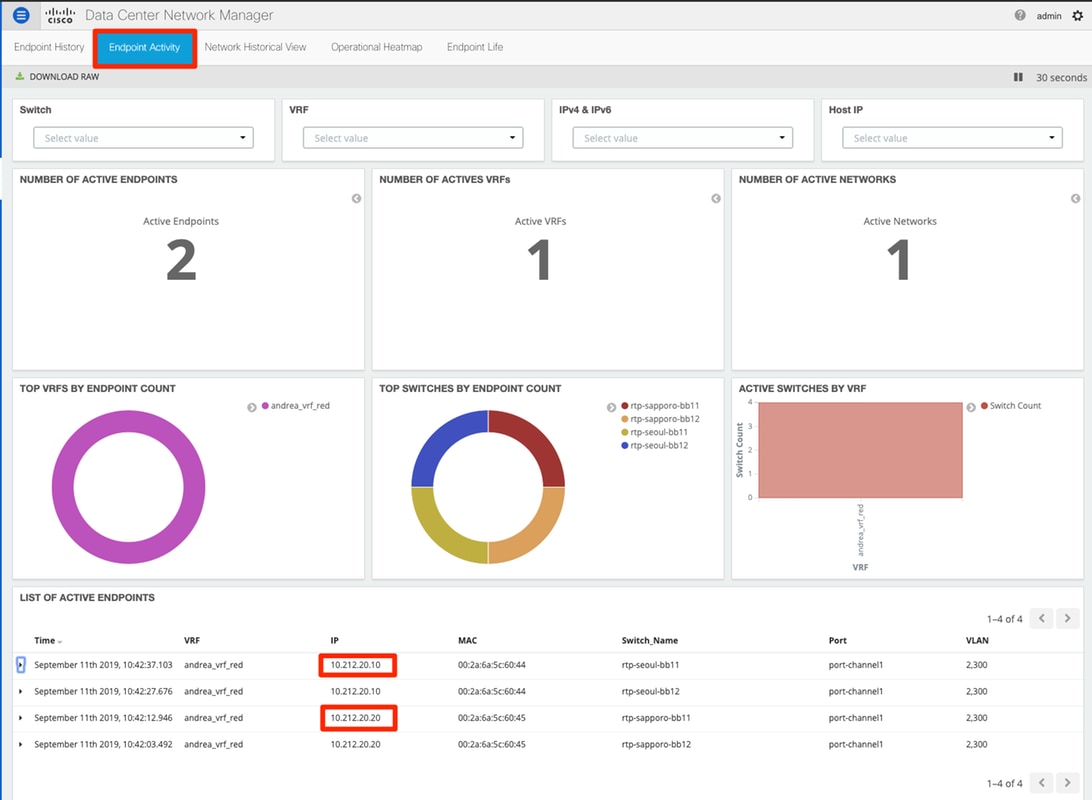

9단계. 이제 Endpoint Locator를 사용할 수 있습니다. Monitor(모니터링) > Endpoint Locator(엔드포인트 로케이터) > Explore(탐색)로 이동합니다.

이 예에서는 RTP 패브릭에서 로컬 ping 테스트를 위해 구성된 두 호스트를 볼 수 있습니다.

이 배포 중에 발생한 문제

케이블 불량

스위치 쌍에 케이블 연결이 잘못되어 vPC 피어 링크 포트 채널 500에 대한 번들링 오류가 발생했습니다. 예:

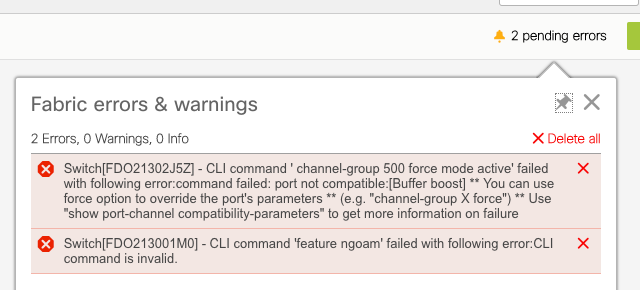

1단계. Control > Fabric Builder로 다시 이동하여 오류를 검토합니다.

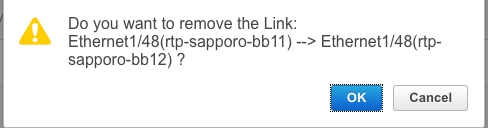

2단계. port-channel500 명령 실패와 관련된 첫 번째 오류 — show cdp neighbors를 통해 vPC 피어에 대한 연결이 10G 및 40G 포트(호환되지 않음)에 있음을 확인했습니다. 10G 포트를 물리적으로 제거하고 DCNM에서 링크도 삭제했습니다.

기능을 구성하지 못했습니다.

"feature ngoam"을 구성하지 못하는 것과 관련된 두 번째 오류 - 스위치가 "feature ngoam"이 지원되는 최신 NX-OS 버전으로 업그레이드되었으며 Save & Deploy를 다시 클릭합니다. 두 가지 문제가 모두 해결되었습니다.

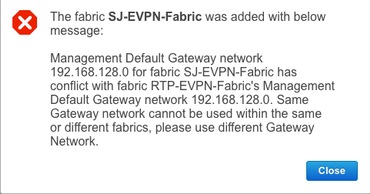

다른 패브릭에 대한 관리 서브넷 중첩

두 번째 패브릭인 SJ가 구축된 동안 동일한 서브넷이 사용되었습니다(물리적으로 분리된 경우 정상). 그러나 DCNM은 충돌을 로깅하고 POAP에 실패합니다. 이는 SJ 패브릭이 다른 관리 VLAN에 배치되고 DHCP 주소의 범위가 변경됨에 따라 해결됩니다.

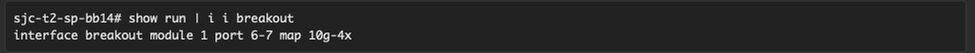

분할 인터페이스

1단계. 일부 스위치의 분할 인터페이스(토폴로지 참조)에 대해 T2 Spine에 대해 이 CLI를 수동으로 추가했습니다.

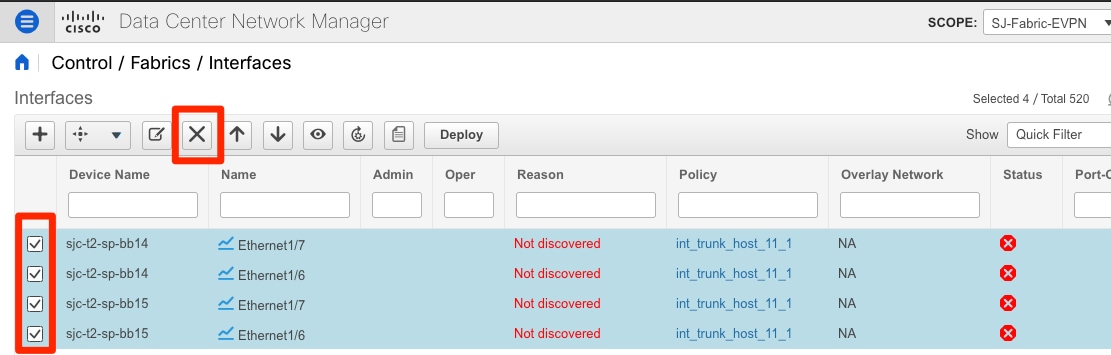

2단계. Control > Interfaces로 이동하여 상위 인터페이스를 삭제합니다.

실제로 사용되는 인터페이스는 Eth1/6/1-4 및 Eth1/7/1-4입니다. 이 문제를 해결하지 않으면 나중에 저장 및 배포가 실패합니다. DCNM을 통해 분할(+ 기호 옆의 버튼)하는 방법이 있습니다. 그러나 이 문서에서는 다루지 않음)

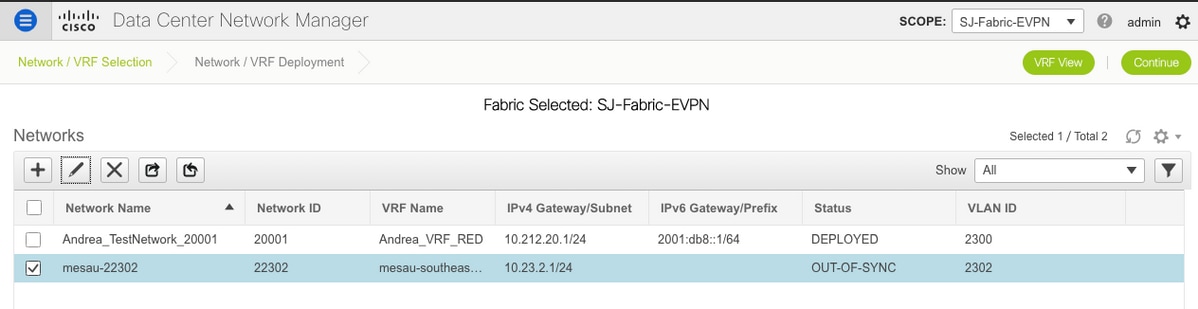

지원되지 않는 기능에 배포될 때 패브릭 오류 발생

SJ 패브릭의 섀시(T2) 중 일부는 TRM을 지원하지 않으므로 DCNM에서 이 컨피그레이션을 푸시하려고 할 때 앞으로 이동할 수 없습니다. TRM 지원 위치: https://www.cisco.com/c/en/us/td/docs/switches/datacenter/nexus9000/sw/92x/vxlan-92x/configuration/guide/b-cisco-nexus-9000-series-nx-os-vxlan-configuration-guide-92x/b_Cisco_Nexus_9000_Series_NX-OS_VXLAN_Configuration_Guide_9x_chapter_01001.html#concept_vw1_syb_zfb

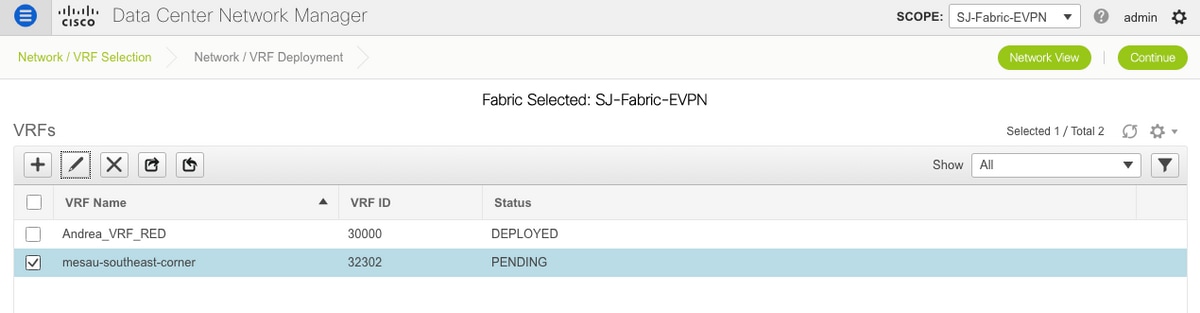

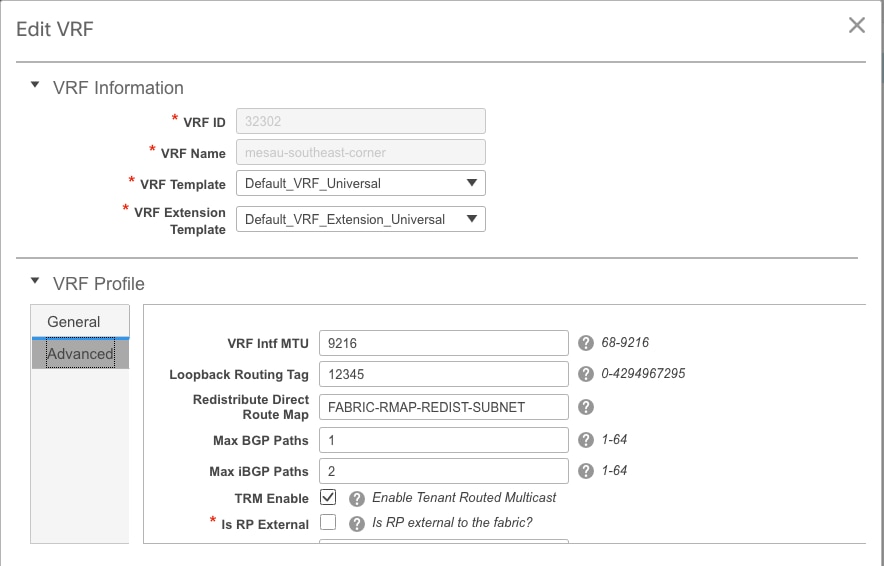

이미지에 Network(네트워크) 및 VRF Edit(VRF 수정) 창에서 모두 TRM Enable(TRM 활성화) 상자를 선택 취소했습니다.

Control(제어) > Fabric Builder(패브릭 빌더) > VRF에서 동일한 프로세스를 반복합니다.

Continue(계속)를 클릭한 다음 이전에 수행한 대로 각각 Deploy(구축)를 클릭합니다.

DCNM 11.2의 새로운 기능

-

vPC 패브릭 피어링

-

eBGP 기반 라우팅 패브릭

-

위에서 EVPN 활성화

-

-

Easy Fabric Brownfield 개선 사항

-

Border Spine/Border GW Spine

-

PIM 비디르

-

테넌트 라우팅된 멀티캐스트

-

-

외부 DHCP 서버를 사용한 Day-0/부트스트랩

Day 2 운영:

-

Network Insights 리소스

-

네트워크 인사이트 관리자

-

외부 액세스에 대한 IPv6 지원(eth0)

-

UCS-FI를 통한 VMM 컴퓨팅 가시성

-

토폴로지 보기 개선 사항

-

11.0/11.1에서 인라인 업그레이드

DCNM을 사용하여 기존 vPC에서 MCT-Less vPC로 변경:

MCT-Less vPC의 이점:

-

물리적 포트 낭비 없이 개선된 듀얼 홈 방식 솔루션

-

기존 vPC 특성 보존

-

PIP를 사용하여 싱글 홈 엔드포인트에 최적화된 라우팅

관련 정보

- Cisco DCNM LAN 패브릭 컨피그레이션 가이드, 릴리스 11.2(1)

https://www.cisco.com/c/en/us/td/docs/switches/datacenter/sw/11_2_1/config_guide/lanfabric/b_dcnm_fabric_lan/control.html - 장: VXLAN BGP EVPN 패브릭의 Border Provisioning 활용 사례 - 멀티 사이트

https://www.cisco.com/c/en/us/td/docs/switches/datacenter/sw/11_2_1/config_guide/lanfabric/b_dcnm_fabric_lan/border-provisioning-multisite.html - NextGen DCI with VXLAN EVPN Multi-Site Using vPC Border Gateways 백서

https://www.cisco.com/c/en/us/products/collateral/switches/nexus-9000-series-switches/whitepaper-c11-742114.html#_Toc5275096 - 장: DCNM 애플리케이션

https://www.cisco.com/c/en/us/td/docs/switches/datacenter/sw/11_2_1/config_guide/lanfabric/b_dcnm_fabric_lan/applications.html

개정 이력

| 개정 | 게시 날짜 | 의견 |

|---|---|---|

1.0 |

19-Sep-2019

|

최초 릴리스 |

피드백

피드백