Bereitstellung von EVPN VXLAN an mehreren Standorten über DCNM 11.2(1)

Download-Optionen

Inklusive Sprache

In dem Dokumentationssatz für dieses Produkt wird die Verwendung inklusiver Sprache angestrebt. Für die Zwecke dieses Dokumentationssatzes wird Sprache als „inklusiv“ verstanden, wenn sie keine Diskriminierung aufgrund von Alter, körperlicher und/oder geistiger Behinderung, Geschlechtszugehörigkeit und -identität, ethnischer Identität, sexueller Orientierung, sozioökonomischem Status und Intersektionalität impliziert. Dennoch können in der Dokumentation stilistische Abweichungen von diesem Bemühen auftreten, wenn Text verwendet wird, der in Benutzeroberflächen der Produktsoftware fest codiert ist, auf RFP-Dokumentation basiert oder von einem genannten Drittanbieterprodukt verwendet wird. Hier erfahren Sie mehr darüber, wie Cisco inklusive Sprache verwendet.

Informationen zu dieser Übersetzung

Cisco hat dieses Dokument maschinell übersetzen und von einem menschlichen Übersetzer editieren und korrigieren lassen, um unseren Benutzern auf der ganzen Welt Support-Inhalte in ihrer eigenen Sprache zu bieten. Bitte beachten Sie, dass selbst die beste maschinelle Übersetzung nicht so genau ist wie eine von einem professionellen Übersetzer angefertigte. Cisco Systems, Inc. übernimmt keine Haftung für die Richtigkeit dieser Übersetzungen und empfiehlt, immer das englische Originaldokument (siehe bereitgestellter Link) heranzuziehen.

Inhalt

Einleitung

In diesem Dokument wird beschrieben, wie zwei einzelne EVPN VXLAN-Fabrics bereitgestellt werden und wie diese beiden Fabrics mithilfe von Cisco Data Center Manager (DCNM) 11.2(1) zu einer EVPN Multi-Site-Fabric-Bereitstellung zusammengeführt werden.

Die Multi-Site Domain (MSD), die in der DCNM 11.0(1)-Version eingeführt wurde, ist ein Multi-Fabric-Container, der zur Verwaltung mehrerer Mitglieder-Fabrics erstellt wird. Sie bietet einen zentralen Kontrollpunkt für die Definition von Overlay-Netzwerken und Virtual Routing and Forwarding (VRF), die von den einzelnen Fabrics genutzt werden.

Hinweis: In diesem Dokument werden keine Details zu den Funktionen/Eigenschaften der einzelnen Registerkarten in DCNM beschrieben. Siehe Referenzen am Ende, die ausführliche Erläuterungen enthalten.

Voraussetzungen

Anforderungen

Cisco empfiehlt, dass Sie über Kenntnisse in folgenden Bereichen verfügen:

-

vCenter/UCS für die Bereitstellung eines virtuellen DCNM-Systems

-

Vertrautheit mit NX-OS und Nexus 9000

-

ToRs der Nexus Serie 9000s, EoRs-Verbindungen nach Leaf/Spine-Methode

Verwendete Komponenten

Die Informationen in diesem Dokument basieren auf der folgenden Software und Hardware:

- DCNM 11.2(1)

- NX-OS 7.0(3)I7(7) und NX-OS 9.2(3)

- Spines: N9K-C9508/N9K-X97160YC-EX und N9K-C9508/N9K-X9636PQ

- Leafs: N9K-C9372TX, N9K-C93180YC-EX, N9K-C9372TX-E, N9K-C92160YC-X

- Border Gateways: N9K-C93240YC-FX2 und N9K-C93180YC-FX

- 7.000 "Server": N77-C7709

Die Informationen in diesem Dokument beziehen sich auf Geräte in einer speziell eingerichteten Testumgebung. Alle Geräte, die in diesem Dokument benutzt wurden, begannen mit einer gelöschten (Nichterfüllungs) Konfiguration. Wenn Ihr Netzwerk in Betrieb ist, stellen Sie sicher, dass Sie die möglichen Auswirkungen aller Befehle kennen.

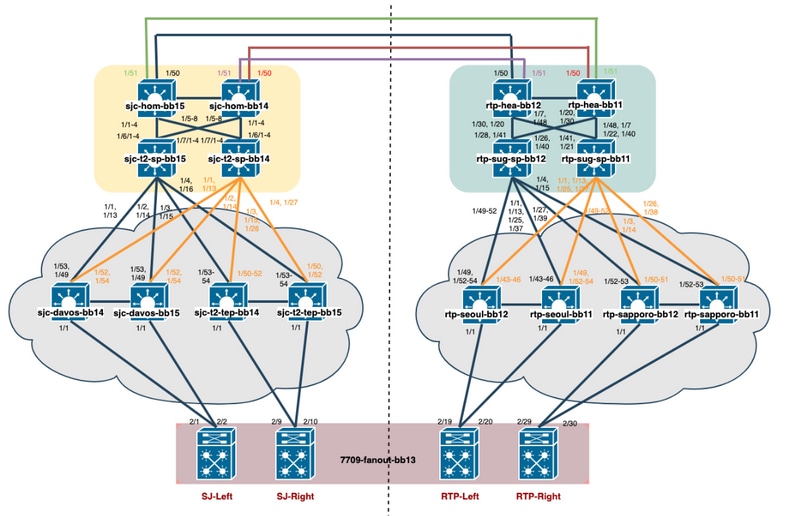

Aufbau der physischen Topologie

Bereitstellung von OVA/OVF in vCenter

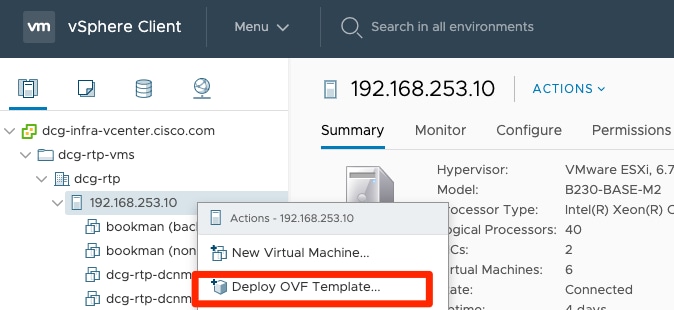

Schritt 1: Stellen Sie unter vCenter eine OVF-Vorlage (Open Virtualization Format) auf dem Server/Host Ihrer Wahl bereit, wie im Bild gezeigt.

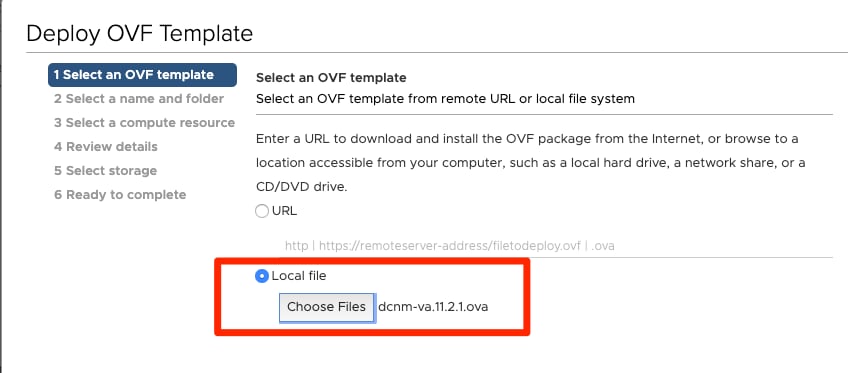

- OVA-/OVF- usw. Datei lokal haben und über Choose Files auswählen, wie im Bild gezeigt:

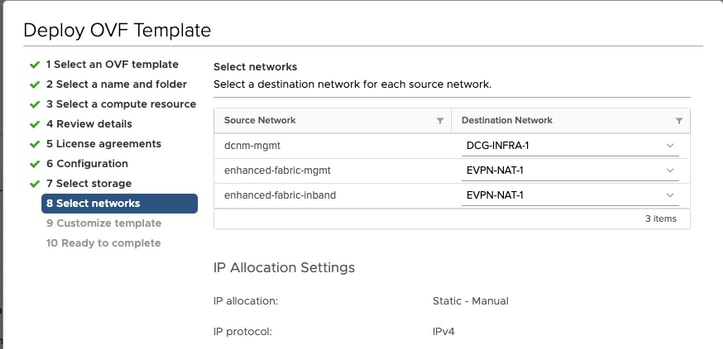

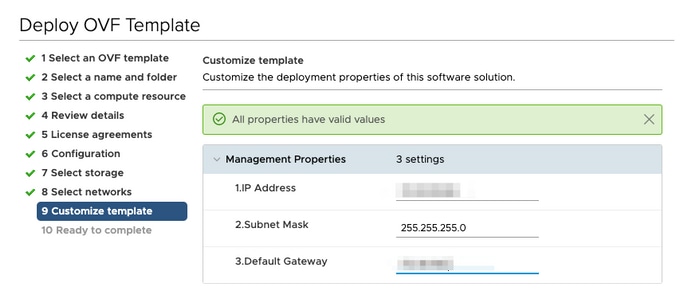

- Folgen Sie den übrigen Aufforderungen (VM-Name, Host, Netzwerkeinstellungen, wie im Bild gezeigt), und klicken Sie auf Fertig stellen.

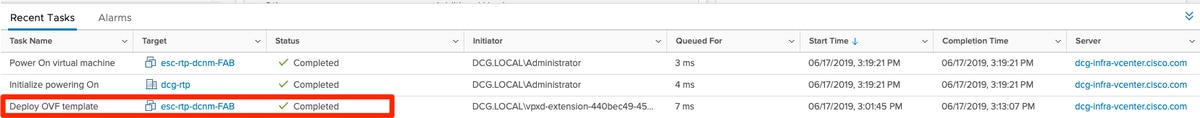

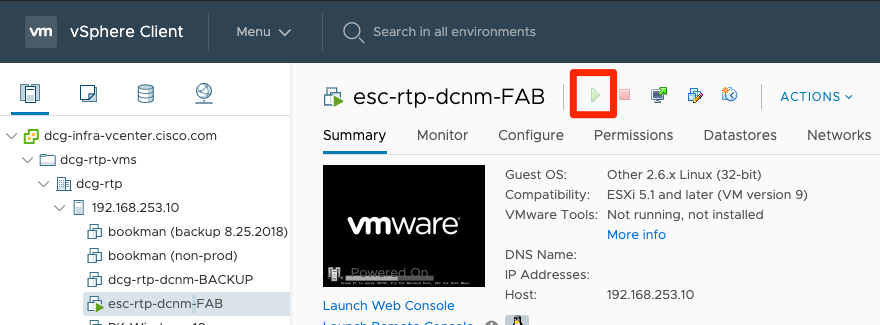

Schritt 2: Starten Sie nach Abschluss des Vorgangs Ihr DCNM VM, wie hier dargestellt.

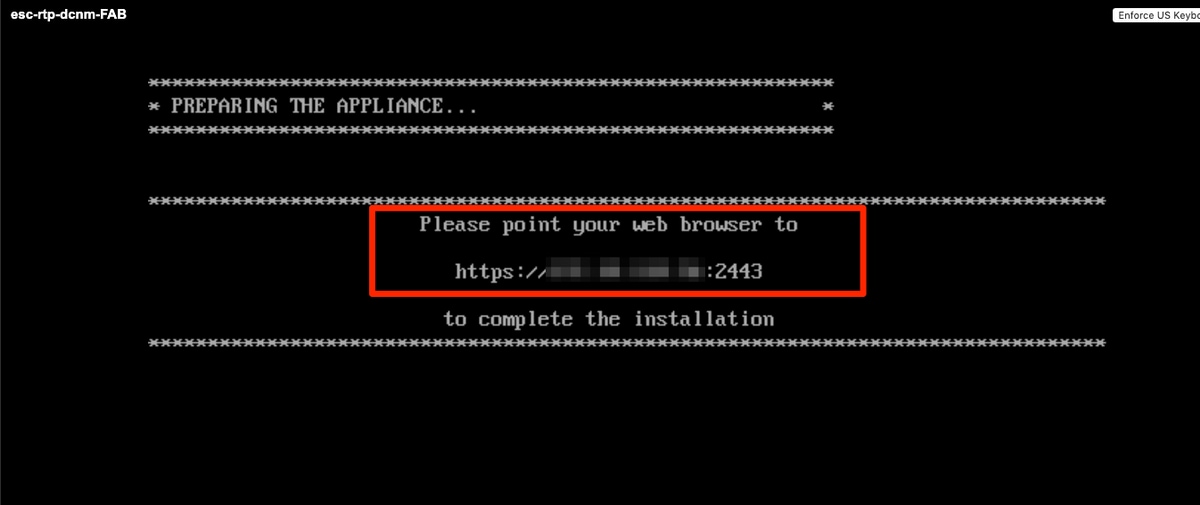

Schritt 3. Starten Sie die Webkonsole, sobald diese sich in der Konsole befindet, sollten Sie diese Eingabeaufforderung sehen (IP unterscheidet sich je nach Umgebung und Konfiguration):

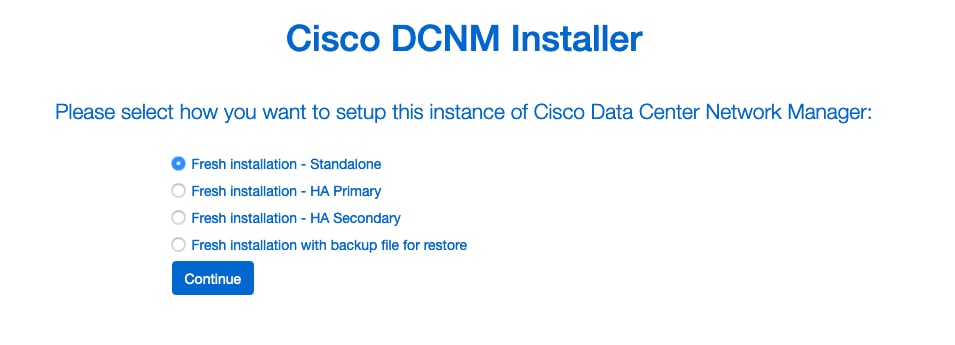

Schritt 4: Gehen Sie zu https://<Ihre IP>:2443 (Dies ist die IP, die Sie zuvor während der OVA-Bereitstellung konfiguriert haben), und klicken Sie auf "Erste Schritte". In diesem Beispiel wird eine Fresh-Installation behandelt.

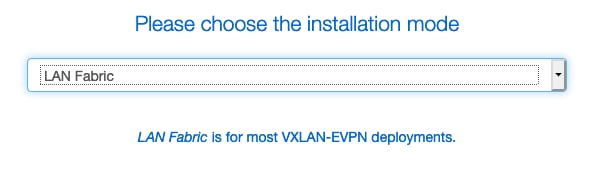

Schritt 5: Nachdem Sie das Admin-Kennwort konfiguriert haben, müssen Sie den Fabric-Typ auswählen, den Sie installieren möchten. Wählen Sie zwischen LAN oder FAB aus, da jeder Typ einen anderen Zweck hat. Stellen Sie deshalb sicher, dass Sie die richtige Wahl treffen. In diesem Beispiel wird die LAN-Fabric verwendet. Dies gilt für die meisten VXLAN-EVPN-Bereitstellungen.

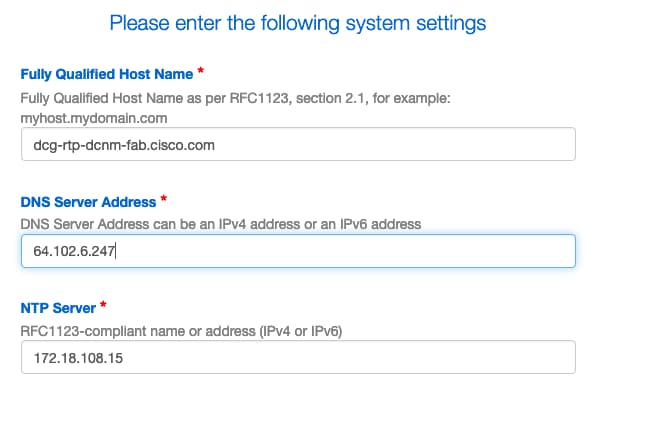

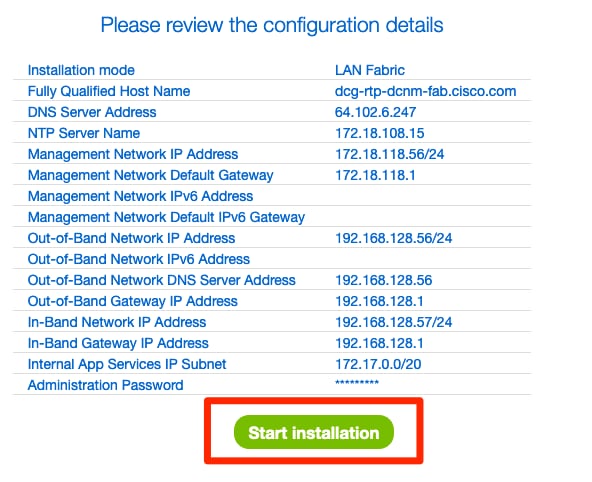

Schritt 6: Folgen Sie den Anweisungen des Installers, und geben Sie DNS, NTP-Server (Network Time Protocol), DCNM-Hostname usw. an.

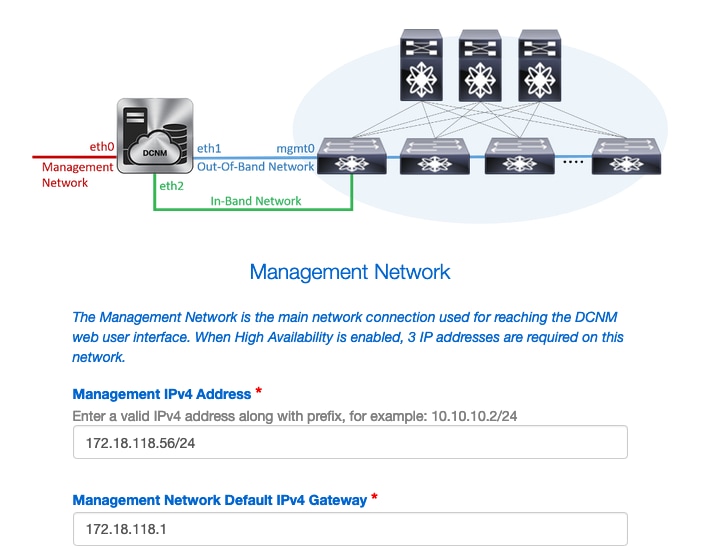

Schritt 7: Konfigurieren Sie die Verwaltungs-IP und das Management-Gateway. Das Managementnetzwerk stellt Verbindungen (SSH, SCP, HTTP, HTTPS) zum DCNM-Server bereit. Dies ist auch die IP, die Sie verwenden, um die GUI zu erreichen. Die IP-Adresse sollte von Ihnen aus der zuvor durchgeführten OVA-Installation vorkonfiguriert werden.

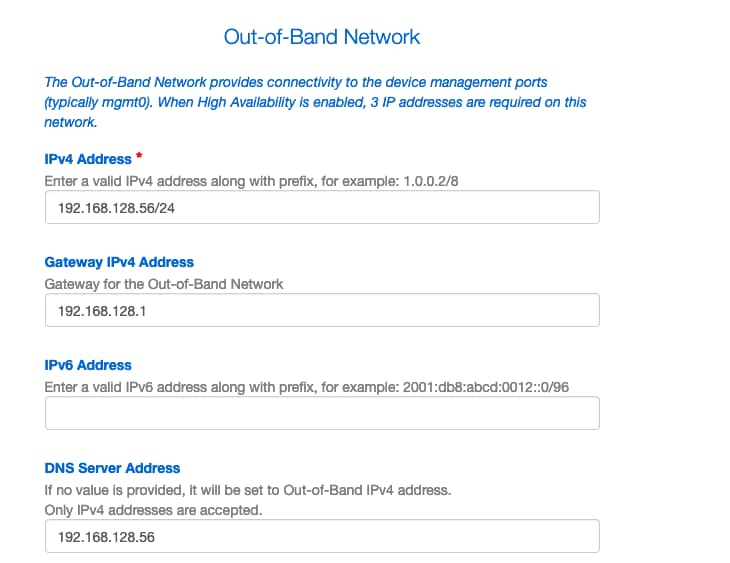

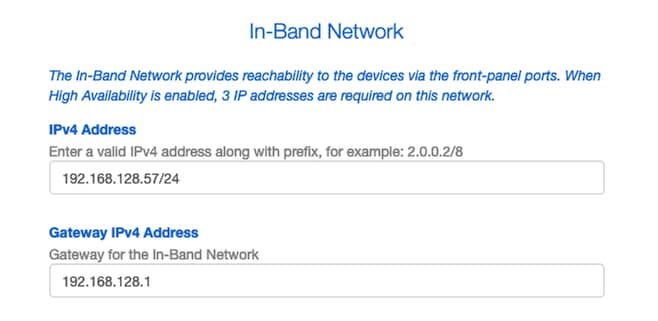

Schritt 8: Konfigurieren des In-Band-Netzwerks Das In-Band-Netzwerk wird für Anwendungen wie Endpoint Locator verwendet, bei denen die Front-Panel-Port-Verbindung mit den 9Ks im Fabric erforderlich ist, damit sie während der Border Gateway Protocol (BGP)-Sitzung zwischen DCNM und 9K funktionieren.

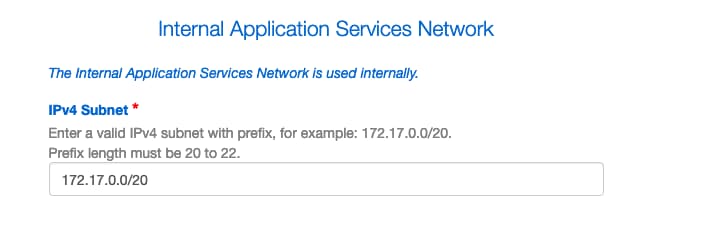

Schritt 9: Konfigurieren des Internal Application Services Network

Um mit der DCNM Version 11.0 zu beginnen, unterstützt DCNM Application Framework (AFW) mit DCNM LAN OVA/ISO-Installation. Dieses Framework verwendet Docker zur Orchestrierung von Anwendungen als Mikroservices in geclusterten und nicht geclusterten Umgebungen zur Realisierung einer Scale-Out-Architektur.

Weitere Anwendungen, die standardmäßig mit DCNM geliefert werden, sind Endpoint Locator, Watch Tower, Virtual Machine Manager-Plug-In, Config Compliance usw. AFW übernimmt das Lifecycle-Management für diese Anwendungen, z. B. für Netzwerke, Storage, Authentifizierung, Sicherheit usw. AFW verwaltet außerdem die Bereitstellung und den Lebenszyklus der Network Insights-Anwendungen (insbesondere NIR und NIA). Dieses Subnetz ist für Docker-Services vorgesehen, wenn NIA/NIR aktiviert ist.

Die Installation von NIA/NIR ist im Abschnitt "Day 2 Operations" (Day-2-Betrieb) beschrieben.

Anmerkung: Dieses Subnetz sollte sich nicht mit den Netzwerken überschneiden, die den eth0/eth1/eth2-Schnittstellen zugewiesen sind, die dem DCNM und den Rechenknoten zugewiesen sind. Außerdem sollte sich dieses Subnetz nicht mit den IPs überschneiden, die den Switches oder anderen von DCNM verwalteten Geräten zugewiesen sind. Das ausgewählte Subnetz sollte bei der Installation der primären und sekundären DCNM-Knoten konsistent bleiben (bei einer nativen HA-Bereitstellung).

Schritt 10: Überprüfen und bestätigen Sie alle Konfigurationsdetails, und starten Sie die Installation.

Schritt 11: Sobald DCNM vollständig installiert ist, melden Sie sich bei der GUI (IP-Adresse oder Hostname, die Sie zuvor konfiguriert haben) an.

Bereitstellung der ersten Fabric - RTP-Fabric

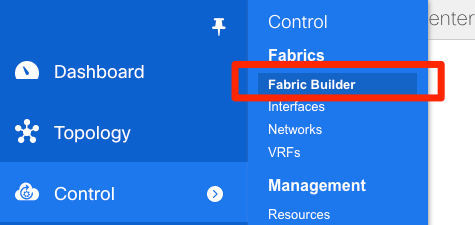

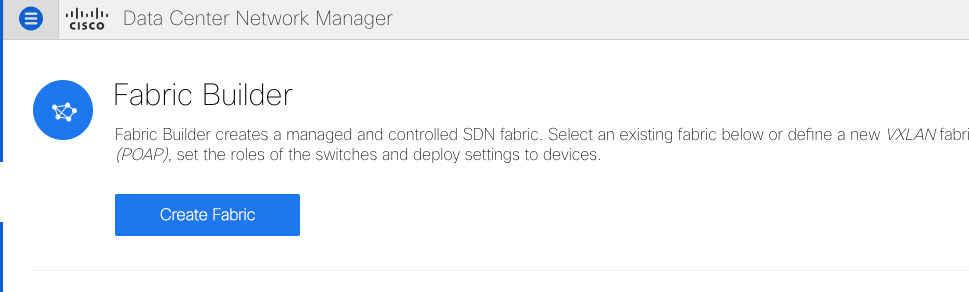

Schritt 1: Navigieren Sie in der DCNM-GUI zu Fabric Builder. Control > Fabrics > Fabric Builder, um die erste Fabric zu erstellen.

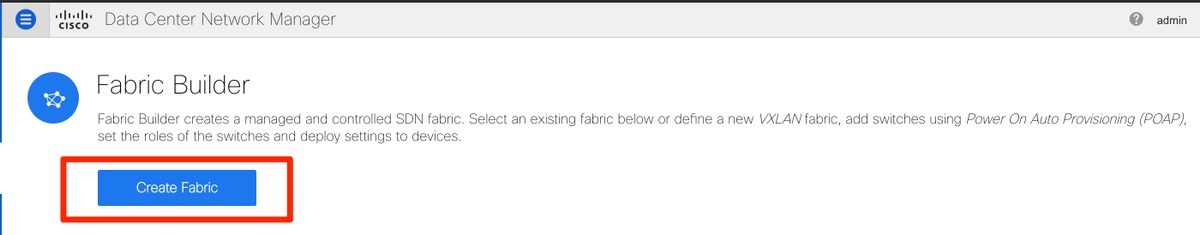

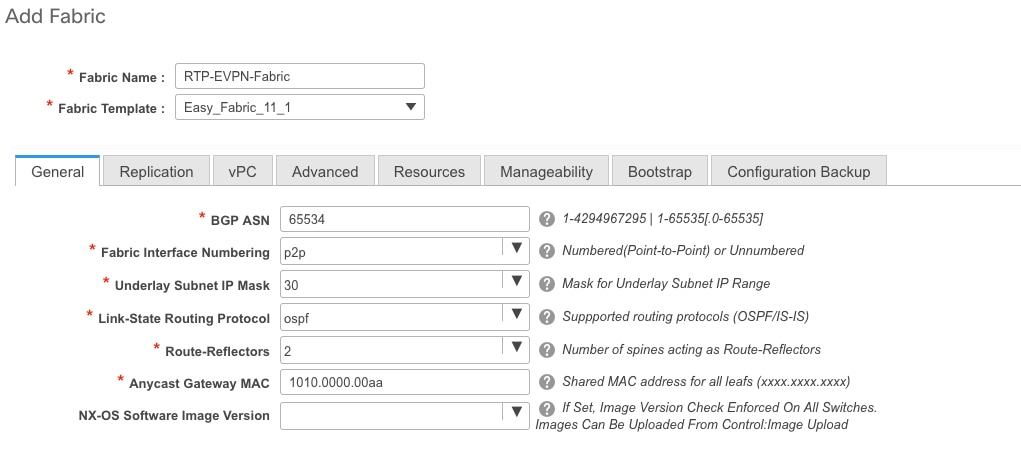

Schritt 2: Klicken Sie auf "Create Fabric" und füllen Sie die Formulare aus, die für Ihr Netzwerk erforderlich sind. Easy Fabric ist die richtige Vorlage für die lokale EVPN VXLAN-Bereitstellung.

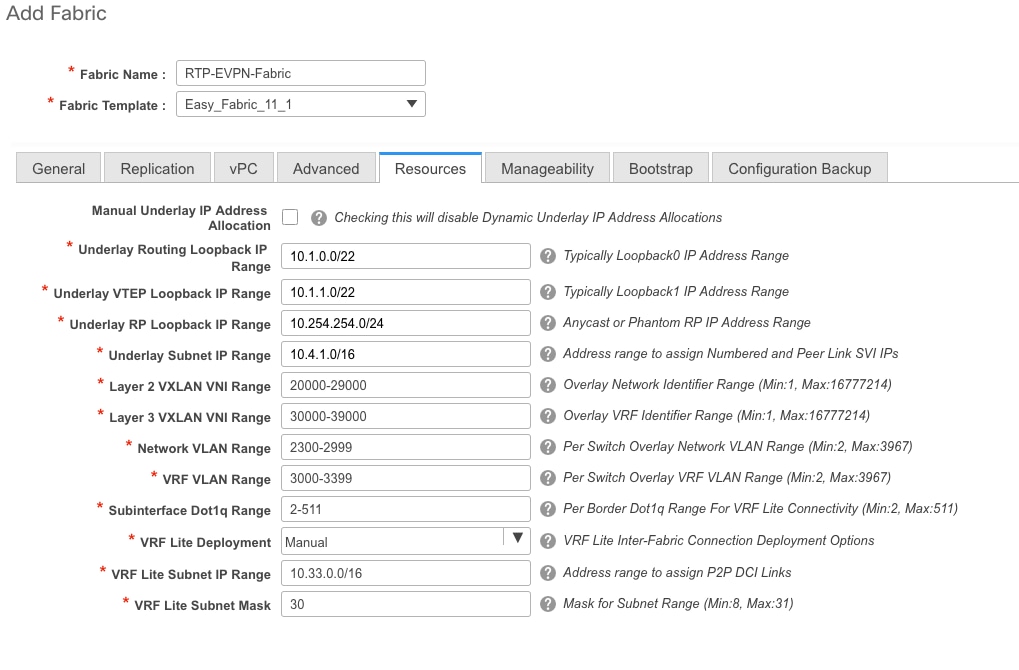

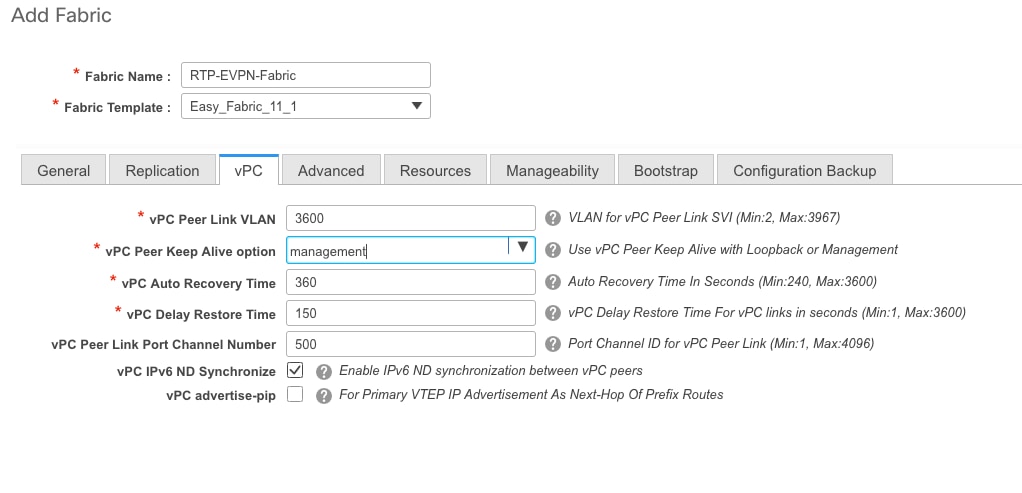

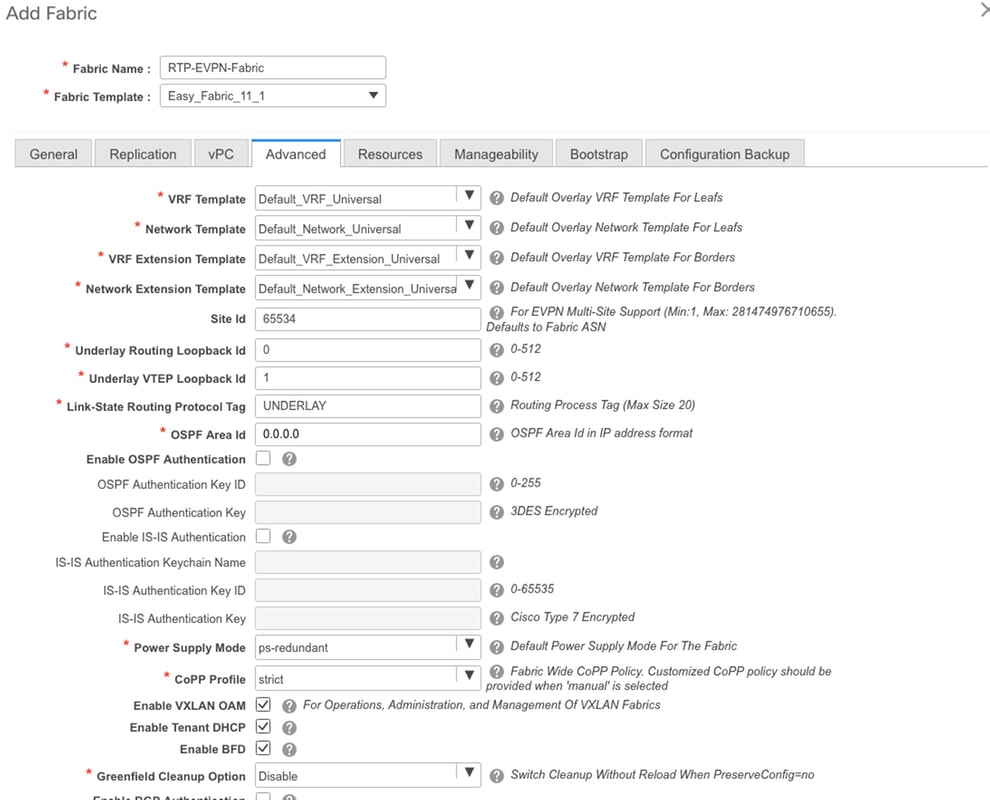

Schritt 3: Füllen Sie die Anforderungen für Underlay, Overlay, vPC, Replikation, Ressourcen usw. von Fabric aus.

In diesem Abschnitt werden alle über DCNM erforderlichen Einstellungen für Underlay, Overlay, vPC, Replikation usw. behandelt. Dies hängt vom Netzwerkadressierungsschema, den Anforderungen usw. ab. In diesem Beispiel werden die meisten Felder als Standardwerte beibehalten. L2VNI und L3VNI wurden so geändert, dass L2VNIs mit 2 beginnen und L3VNIs mit 3 beginnen, um eine spätere Fehlerbehebung zu erleichtern. Die bidirektionale Weiterleitungserkennung (BFD) ist zusammen mit anderen Funktionen ebenfalls aktiviert.

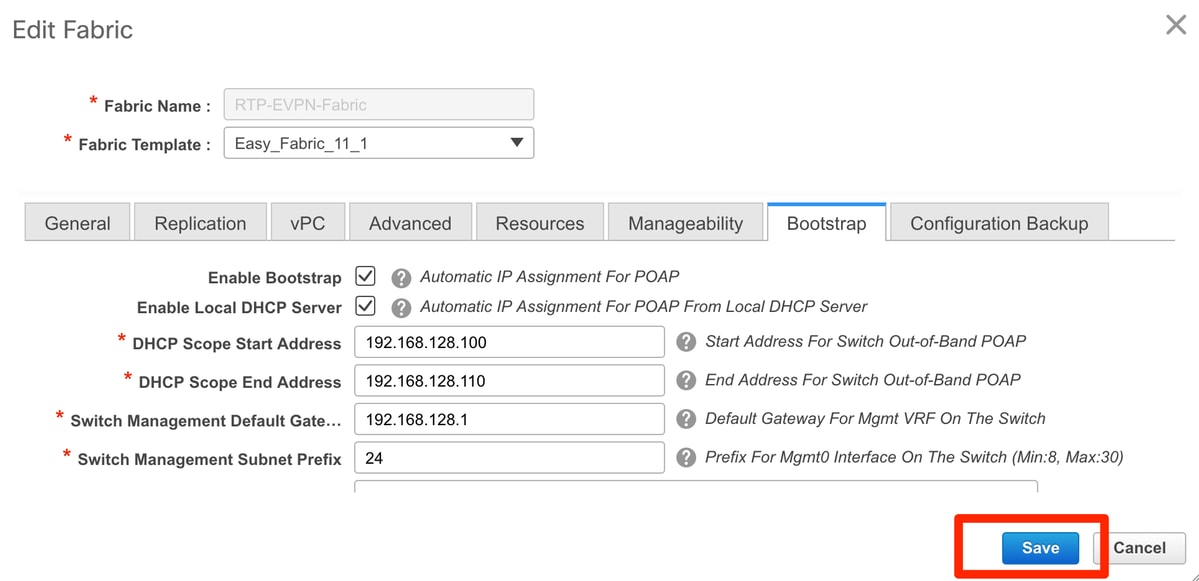

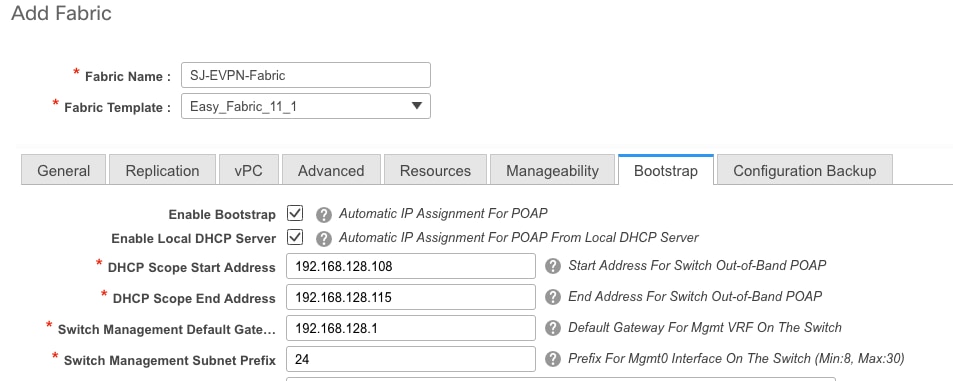

Schritt 4: Konfigurieren Sie unter "Bootstrap Configuration" den Bereich der DHCP-Adressen, die DCNM während des POAP-Prozesses an die Switches in der Fabric weitergeben soll. Konfigurieren Sie auch ein geeignetes (vorhandenes) Standard-Gateway. Klicken Sie auf Save (Speichern), sobald Sie fertig sind und Switches zur Fabric hinzugefügt werden können.

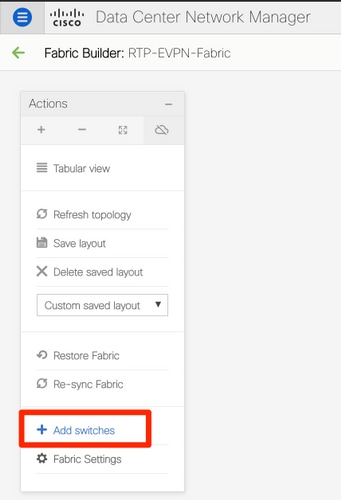

Hinzufügen von Switches zum Fabric

Schritt 1: Navigieren Sie zu Control > Fabrics > Fabric Builder, und wählen Sie dann Ihre Fabric aus. Klicken Sie auf der linken Seite auf Switches hinzufügen, wie im Bild gezeigt.

Sie können Switches entweder über eine Seed-IP erkennen (d. h. die mgmt0-IP jedes Switches muss manuell konfiguriert werden) oder Sie können die Switches über POAP erkennen und von DCNM alle mgmt0-IP-Adressen, das VRF-Management usw. für Sie konfigurieren lassen. Für dieses Beispiel wird POAP verwendet.

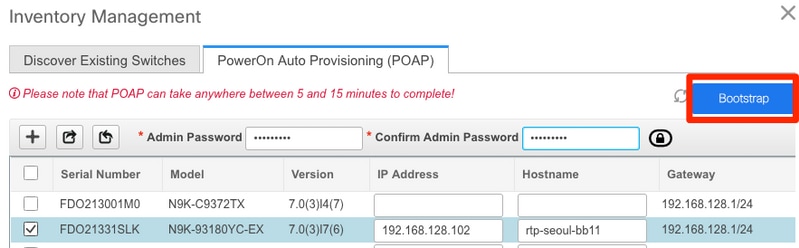

Schritt 2: Sobald Sie den bzw. die gewünschten Switches sehen, geben Sie die gewünschte IP-Adresse und den Hostnamen ein, die DCNM verwenden soll, geben Sie Admin PW ein, und klicken Sie dann auf Bootstrap, wie im Bild gezeigt.

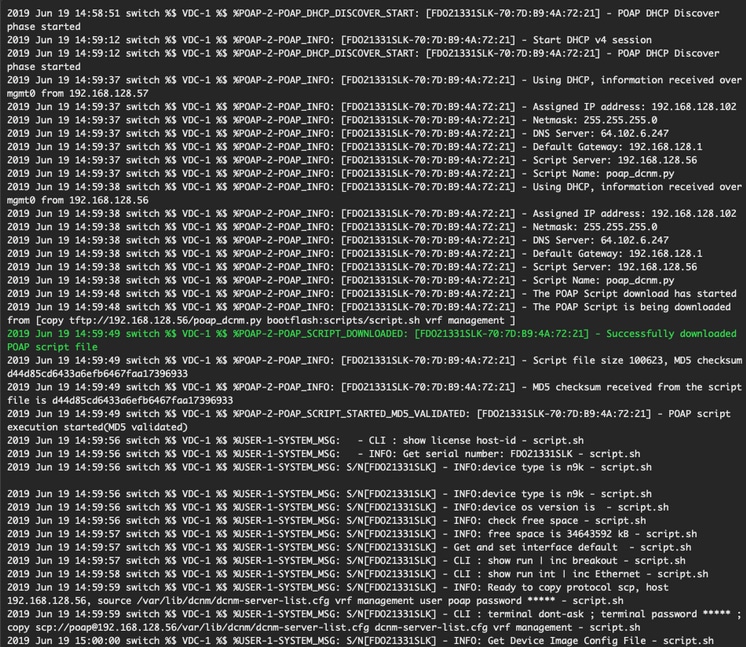

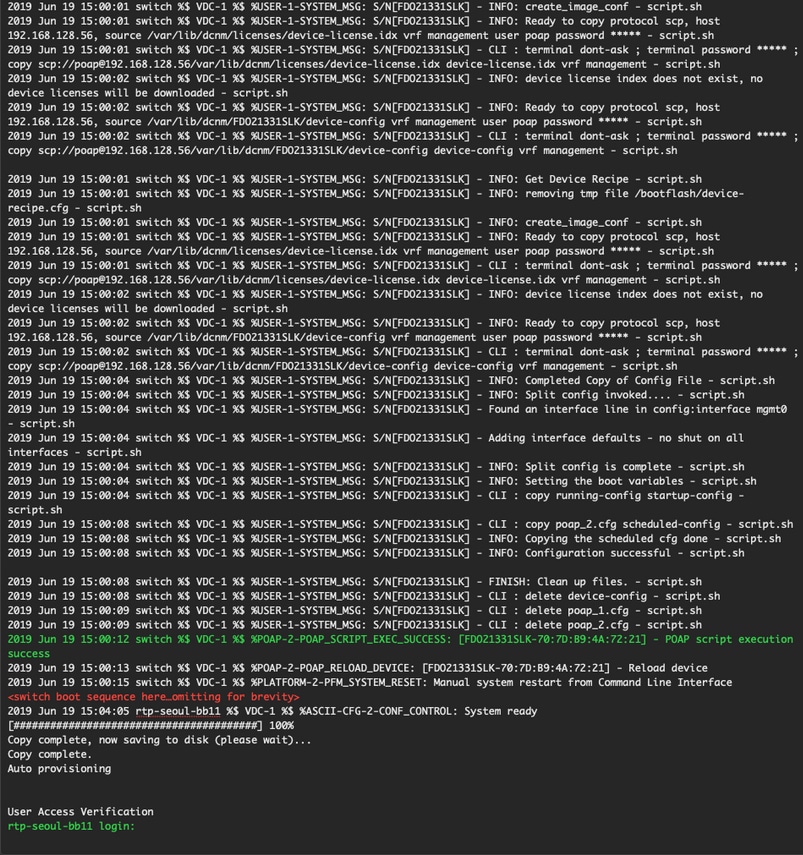

Ein erfolgreiches Bootprotokoll sollte so aussehen, wie in der Abbildung hier aus der Konsole des Switches dargestellt.

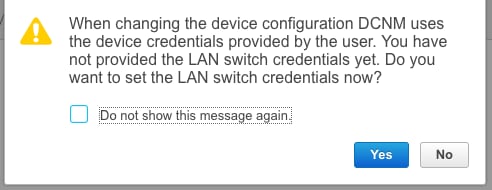

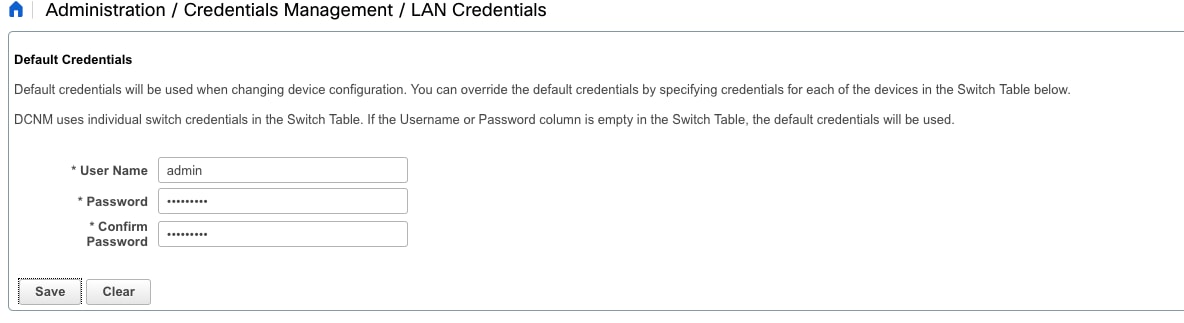

Schritt 3: Bevor Sie die Konfiguration für die gesamte Fabric bereitstellen, stellen Sie sicher, dass Sie zuvor DCNM mit den Geräteanmeldeinformationen konfiguriert haben. Bei der Anmeldung sollte ein Popup-Fenster in der GUI angezeigt werden. Sollte dies nicht der Fall sein, können Sie jederzeit über Administration > Credentials Management > LAN Credentials darauf zugreifen.

Anmerkung: Wenn die Geräteanmeldedaten fehlen, kann DCNM die Konfiguration nicht per Push an die Switches übertragen.

Bereitstellung der Fabric-Konfiguration

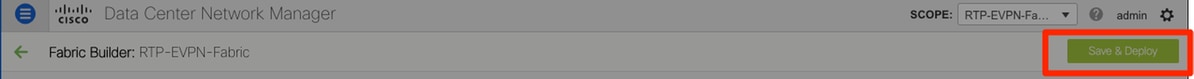

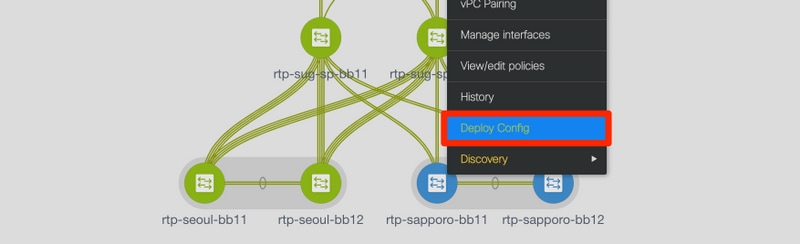

Schritt 1: Nachdem Sie alle Switches für die jeweilige Fabric mit den gleichen Schritten ermittelt haben, navigieren Sie zu Control > Fabrics > Fabric Builder > <Ihr ausgewähltes Fabric>. Hier sollten Sie Ihre Switches und alle zugehörigen Links sehen. Klicken Sie auf Speichern und Bereitstellen.

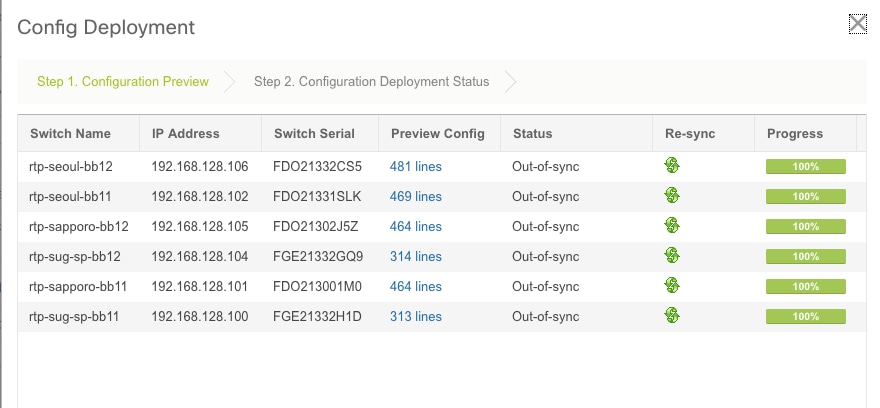

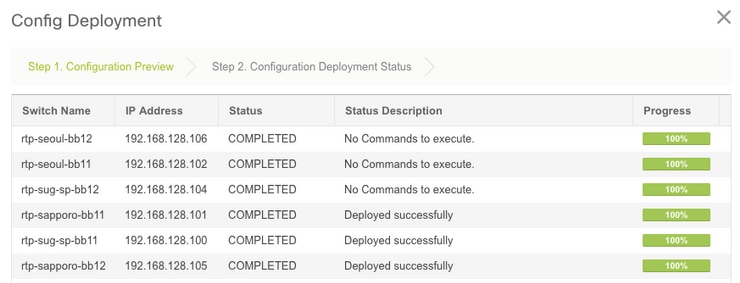

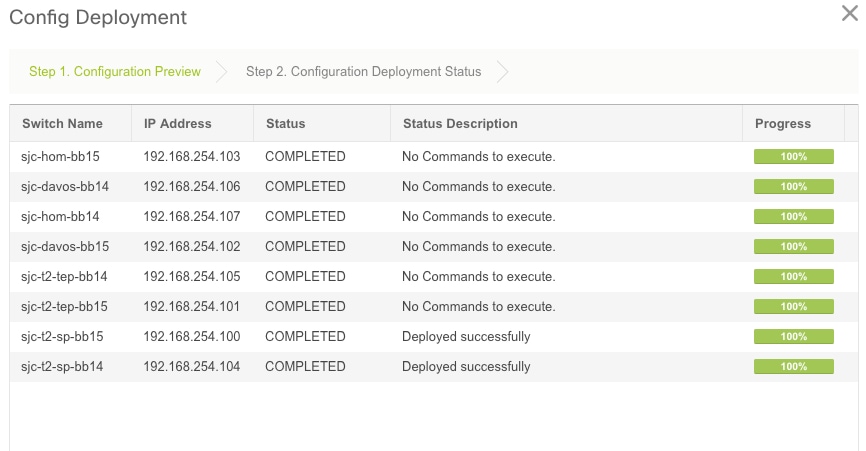

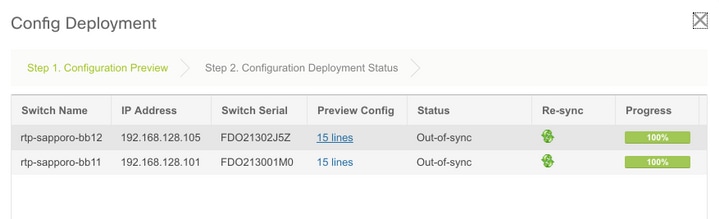

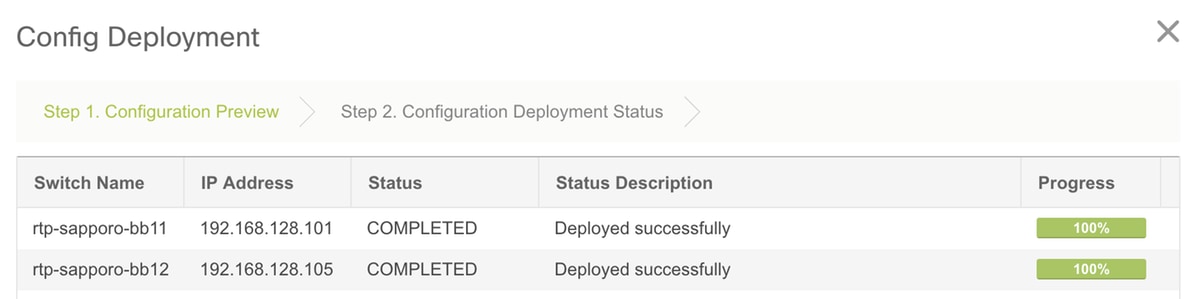

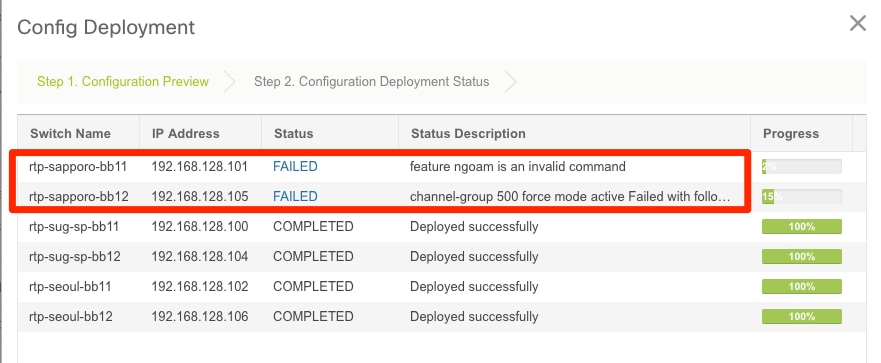

Schritt 2: Im Fenster Config Deployment (Konfigurationsbereitstellung) wird angezeigt, wie viele Konfigurationszeilen für jeden Switch von DCNM übertragen werden. Sie können die Konfiguration bei Bedarf auch in der Vorschau anzeigen und die davor und danach vergleichen:

Stellen Sie sicher, dass alle Switches den Status "ABGESCHLOSSEN" und 100 % ohne Fehler aufweisen. Falls Fehler auftreten, beheben Sie diese unbedingt einzeln (Beispiele finden Sie im Abschnitt Probleme bei dieser Bereitstellung).

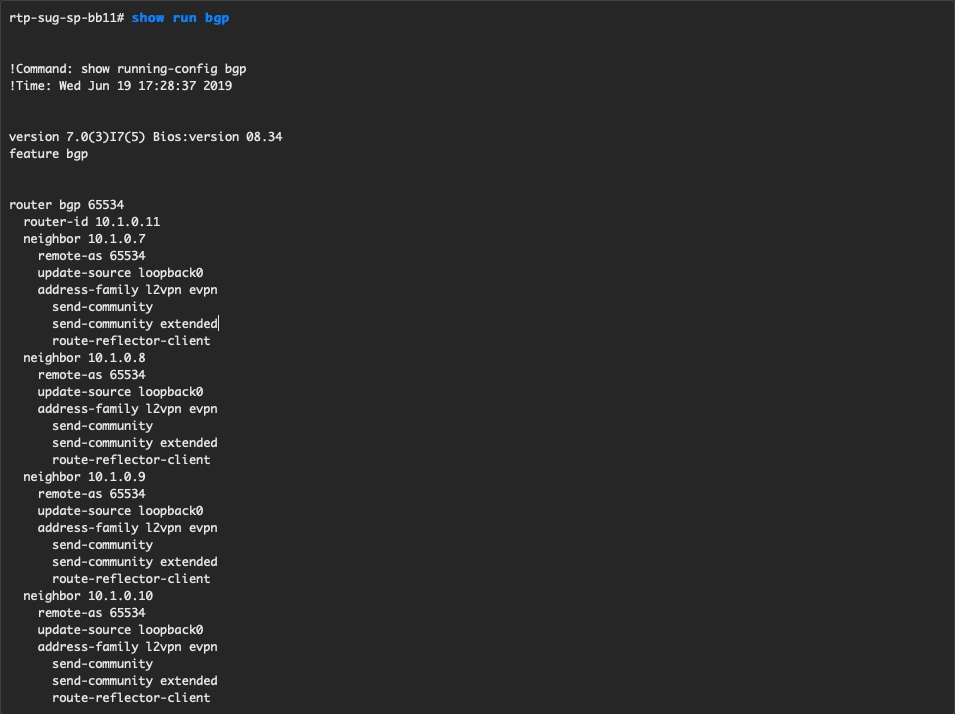

Schritt 3: (Optional) Sie können sich zu diesem Zeitpunkt bei den Geräten anmelden und show run-CLIs ausgeben, um zu überprüfen, ob die Konfiguration von DCNM erfolgreich übertragen wurde.

Beispiel:

Bereitstellung der zweiten Fabric - SJ

Führen Sie die gleichen Schritte wie in der RTP-Fabric aus, und verwenden Sie dabei unterschiedliche Werte für BGP AS usw.

Schritt 1: Navigieren Sie zu Control > Fabrics > Fabric Builder > Create Fabric > Name it!

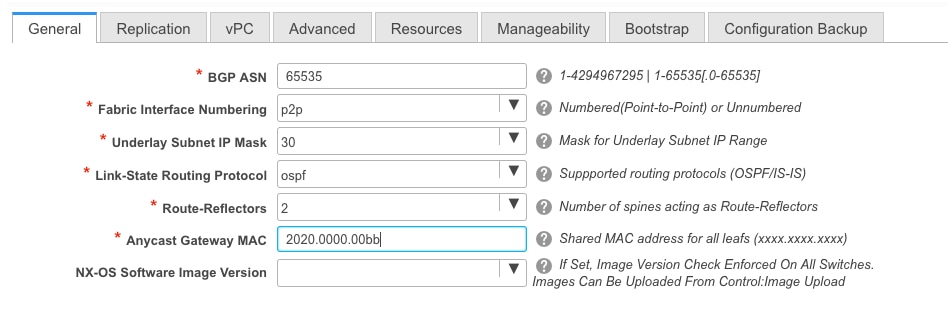

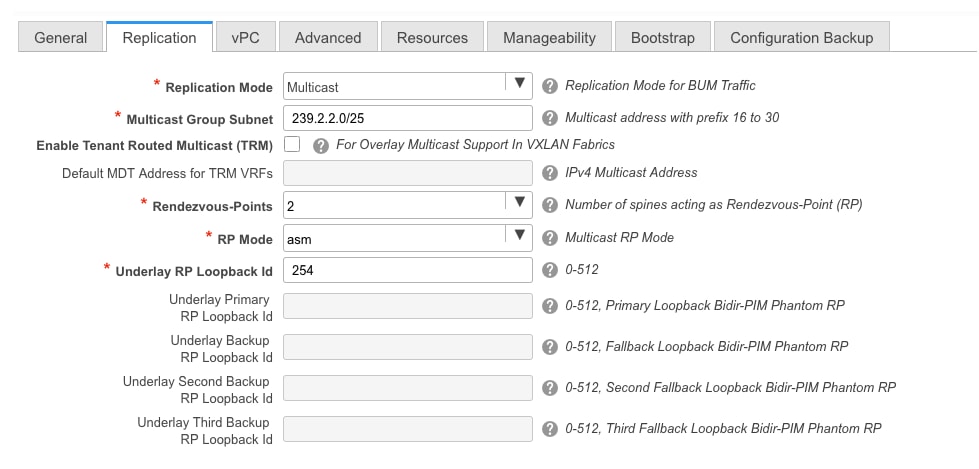

In diesem Abschnitt werden alle erforderlichen Einstellungen für Underlay, Overlay, vPC, Replikation usw. behandelt. Dies hängt vom Netzwerkadressierungsschema, den Anforderungen usw. ab.

Anmerkung: Die Anycast Gateway-MAC-Adresse sollte hier mit der anderen Fabric übereinstimmen, wenn mehrere Standorte verwendet werden. Später werden andere Anycast Gateway-MACs nicht unterstützt. Dies wurde später im Abschnitt zur Bereitstellung mehrerer Standorte korrigiert (in diesem Artikel aus Gründen der Kürze nicht dargestellt).

Schritt 2: Konfigurieren Sie den Bootstrap-Abschnitt wie zuvor ausgeführt. Navigieren Sie erneut durch Switches hinzufügen. Sobald alle erkannt wurden, klicken Sie auf Save & Deploy, um die Konfiguration bereitzustellen. All dies wurde im Abschnitt zur RTP Fabric-Bereitstellung behandelt (hier aus Gründen der Kürze nicht erwähnt).

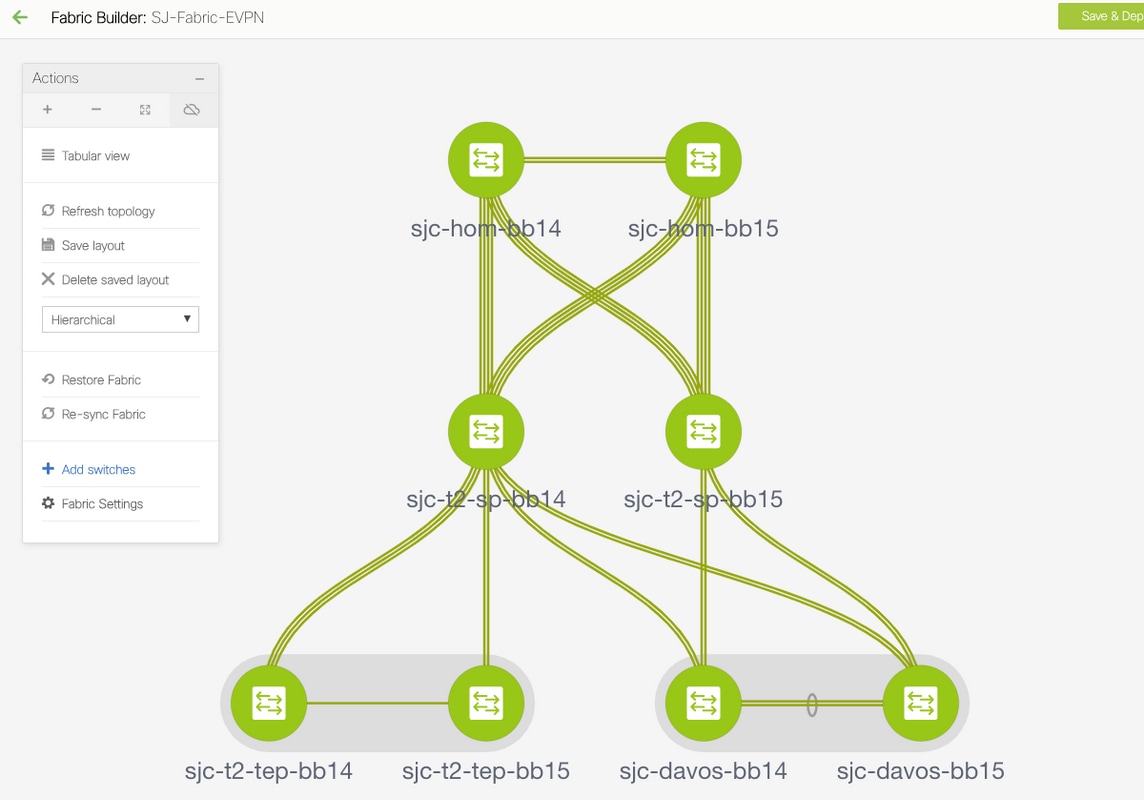

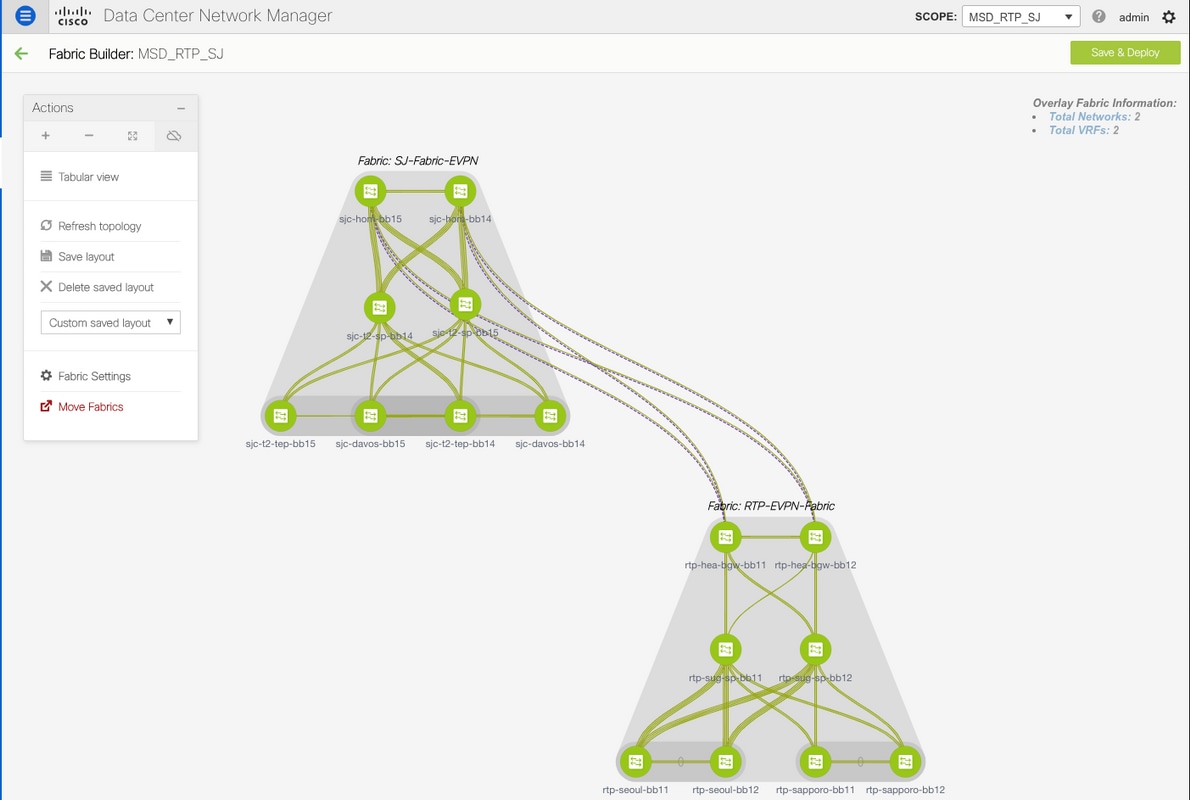

Topologie aus Sicht von Fabric Builder am Ende.

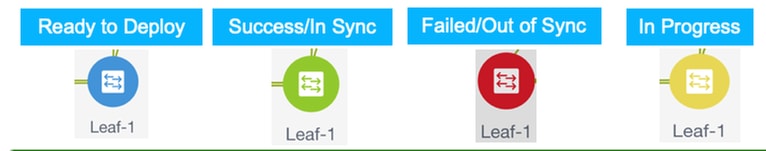

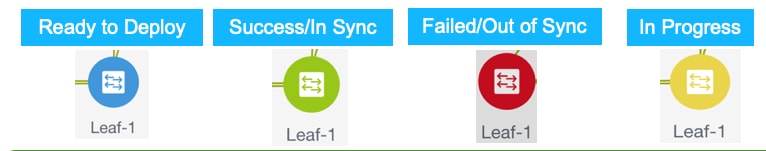

Im Idealfall sollten alle Switches zusammen mit ihren Links grün angezeigt werden. Dieses Bild zeigt die verschiedenen Statusfarben im DCNM-Mittelwert.

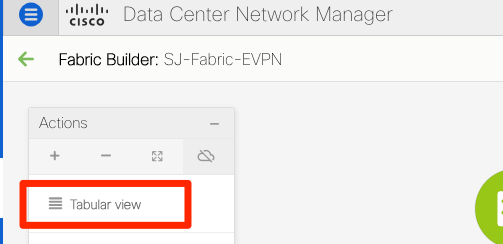

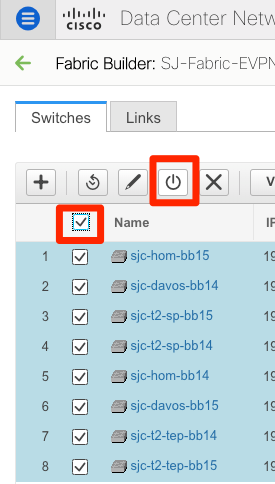

Schritt 3: Nachdem beide Fabrics konfiguriert und bereitgestellt wurden, speichern Sie die Konfiguration und laden Sie sie erneut, damit die TCAM-Änderungen wirksam werden. Gehen Sie zu Controls > Fabrics > Fabric Builder > <your Fabric>, navigieren Sie zur Tabellenansicht, wie im Bild dargestellt.

Schritt 4. Klicken Sie dann auf den Netzschalter (dieser lädt alle Switches gleichzeitig neu):

Erstellen eines Netzwerks (VLAN/L2VNI) und von VRFs (L3VNIs)

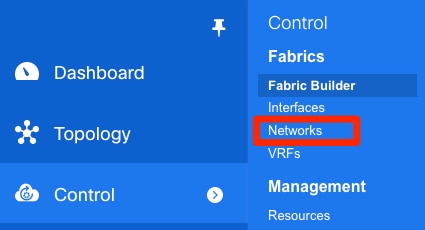

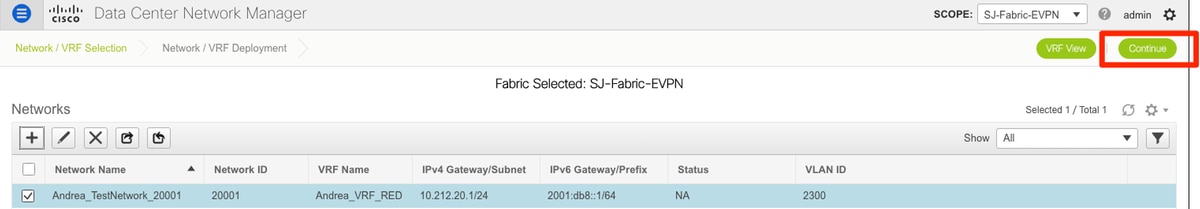

Schritt 1: Navigieren Sie zu Steuerung > Strukturen > Netzwerke, wie im Bild dargestellt.

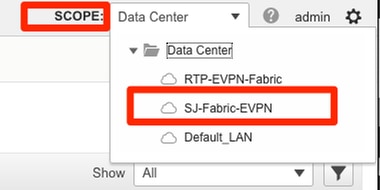

Schritt 2: Wählen Sie, wie im Bild dargestellt, den Bereich für die Änderung aus. d. h. auf welche Fabric muss diese Konfiguration angewendet werden?

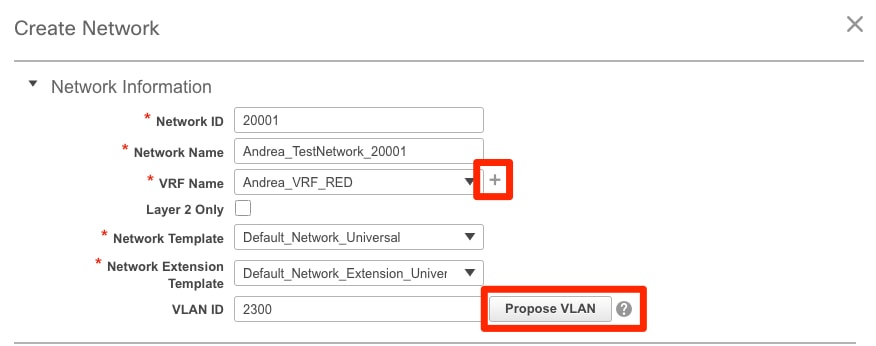

Schritt 3. Klicken Sie auf das +-Zeichen, wie im Bild dargestellt.

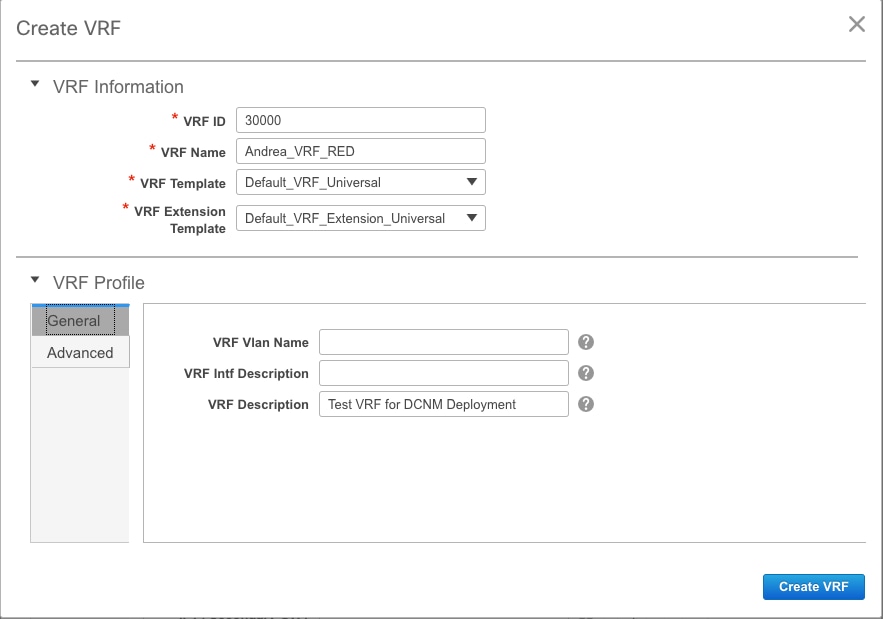

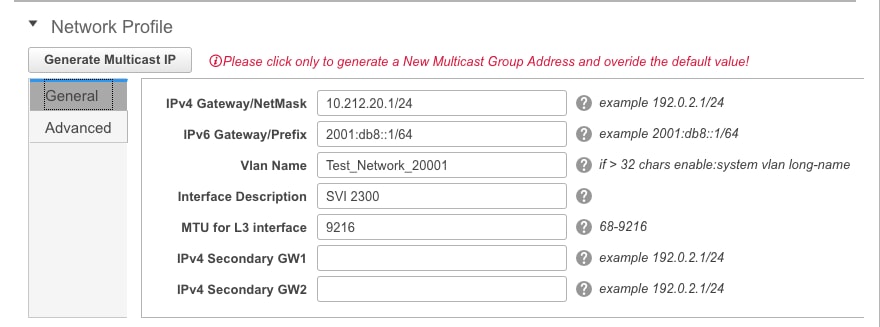

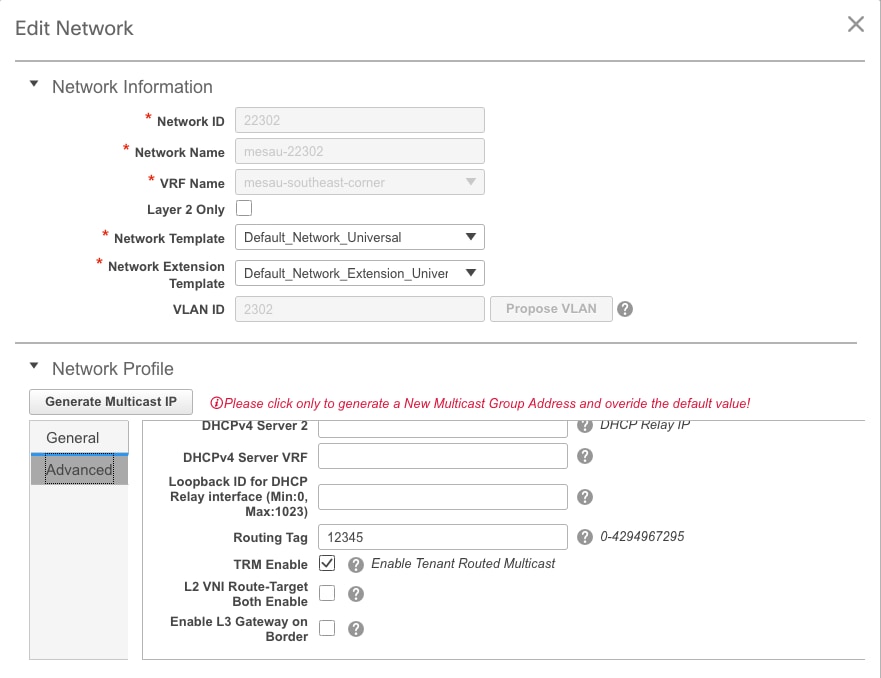

Schritt 4: DCNM leitet Sie durch den Prozess zum Erstellen der Switch Virtual Interface (SVI) (oder eines reinen L2-VLAN). Wenn zu diesem Zeitpunkt keine VRF-Instanzen erstellt werden, klicken Sie erneut auf die Schaltfläche +. Dadurch gelangen Sie vorübergehend zu den VRF-Instanzen, bevor Sie mit den SVI-Einstellungen fortfahren.

Diese Funktionen können auf der Registerkarte Erweitert konfiguriert werden:

- ARP-Unterdrückung

- Eingangsreplikation

- Multicast-Gruppe

- DCHP

- Route Tags

- LAUFZEIT

- L2 VNI-Route-Target

- L3-Gateway an Grenze aktivieren

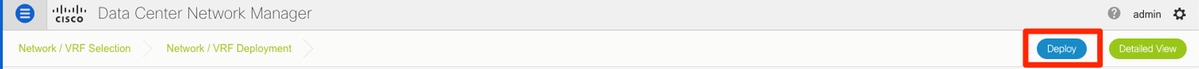

Schritt 5: Klicken Sie auf "Weiter", um die Netzwerk-/VRF-Konfiguration bereitzustellen.

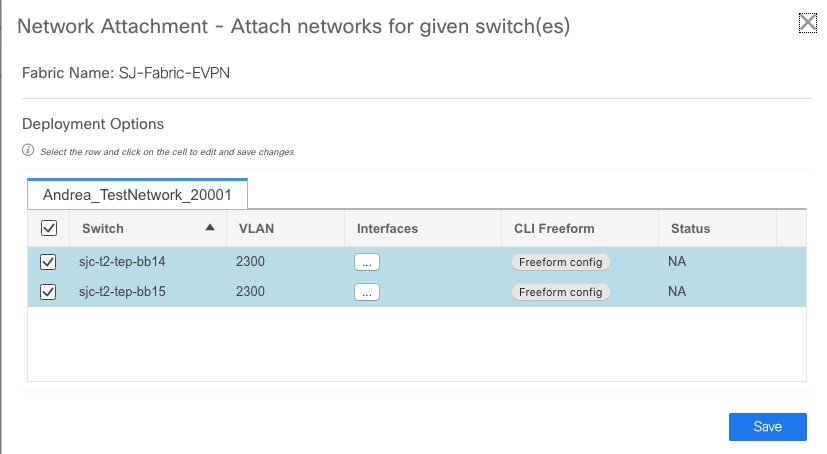

Schritt 6: Doppelklicken Sie in der Topologieansicht auf ein Gerät (oder Geräte) (DCNM führt Sie automatisch hierher), um es bzw. sie für die entsprechende Konfiguration auszuwählen. Klicken Sie auf Speichern, wie im Bild dargestellt.

Schritt 7: Nach der Auswahl sollten die Switches blau (Ready to Deploy) aussehen, wie in dieser Abbildung dargestellt.

Hinweis: Wenn Sie die Konfiguration für die CLI vor der Bereitstellung überprüfen möchten, können Sie auf Detailansicht statt auf Bereitstellen klicken und auf dem nächsten Bildschirm auf Vorschau klicken.

Die Switches leuchten gelb, während die Konfiguration angewendet wird. Nach Abschluss der Konfiguration leuchtet sie grün auf.

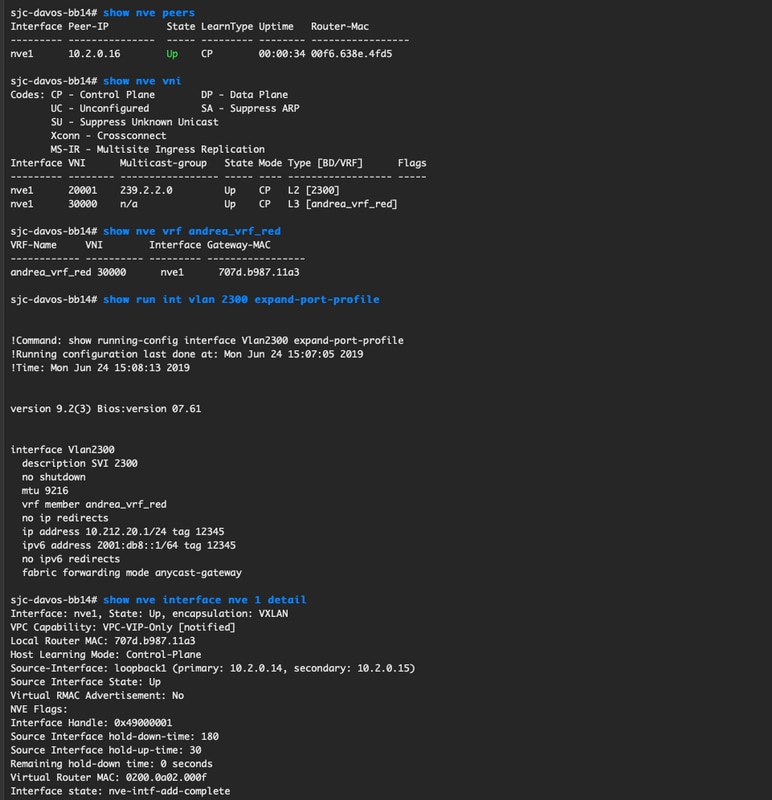

Schritt 8: (Optional) Sie können sich bei Bedarf an der CLI anmelden, um die Konfiguration zu überprüfen (denken Sie daran, die Option "expand-port-profile" zu verwenden):

Konfiguration mehrerer Standorte

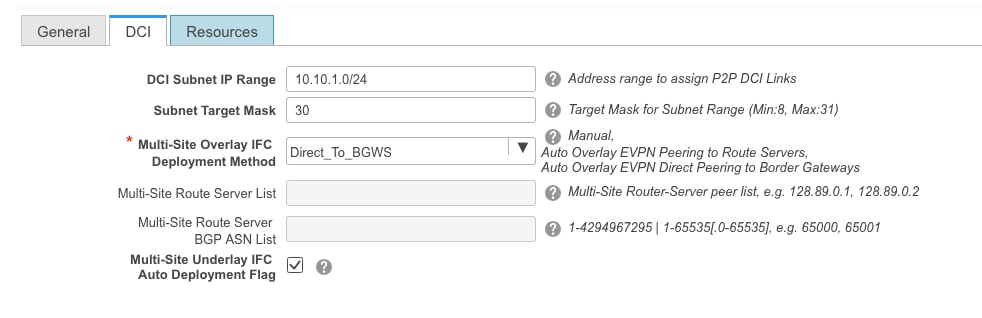

Für diese neuartige Bereitstellung wird die MSD-Fabric mittels direktem Peering zwischen Border Gateways (BGWs) bereitgestellt. Eine Alternative hierzu wäre die Verwendung eines zentralisierten Routingservers, der in diesem Dokument nicht behandelt wird.

Schritt 1: Navigieren Sie zu Control > Fabric Builder > Create Fabric, wie im Bild dargestellt.

Schritt 2: Geben Sie der Multi-Site-Fabric einen Namen, und wählen Sie im Dropdown-Menü für die Fabric-Vorlage MSD_Fabric_11_1 aus.

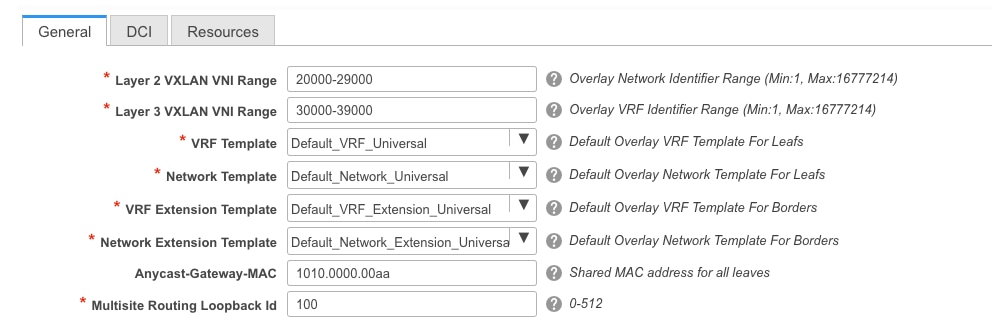

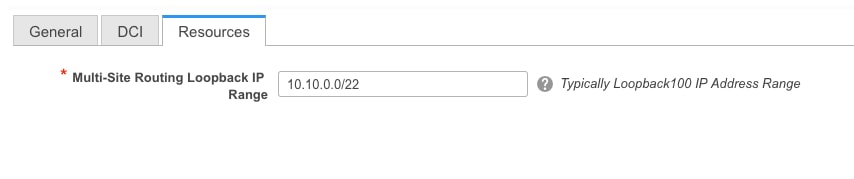

Schritt 3: Stellen Sie unter Allgemein sicher, dass Ihre L2- und L3-VNI-Reichweite mit den von Ihren individuellen Stoffen verwendeten übereinstimmt. Darüber hinaus muss die Anycast Gateway-MAC-Adresse auf beiden Fabrics (in diesem Beispiel RTP/SJ) übereinstimmen. DCNM gibt einen Fehler aus, wenn die Gateway-MACs nicht übereinstimmen und korrigiert werden muss, bevor mit der MSD-Bereitstellung fortgefahren werden kann.

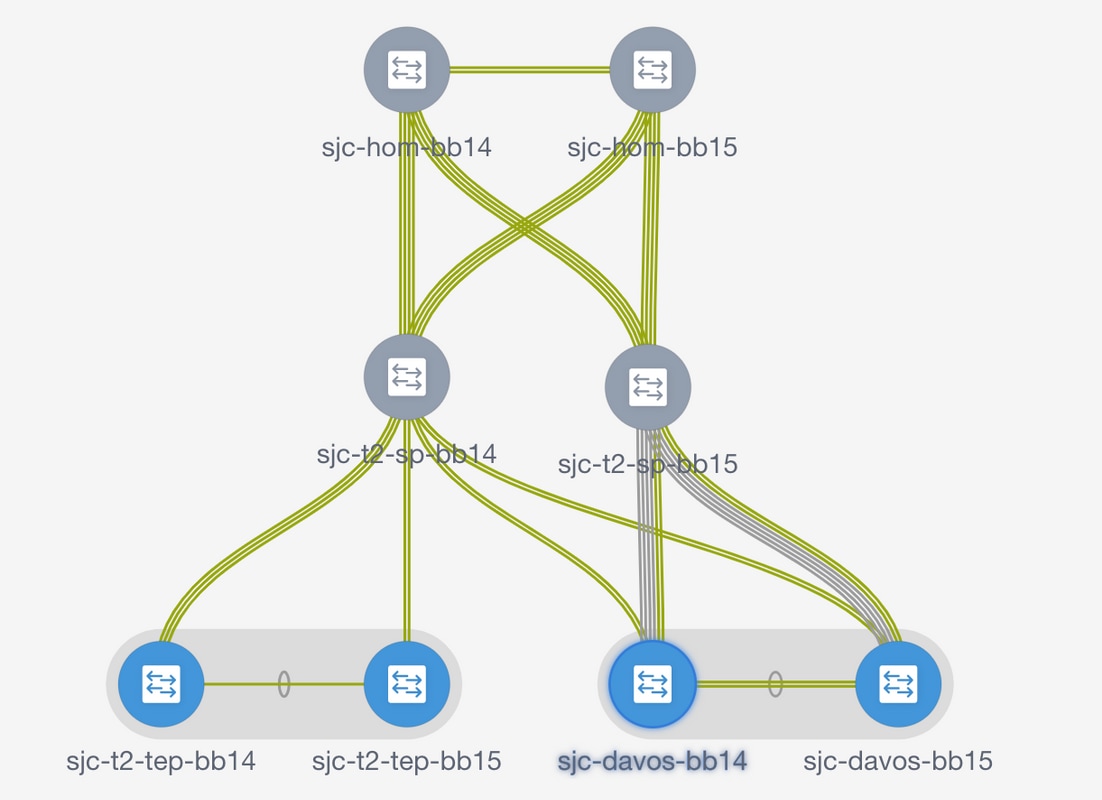

Schritt 4: Klicken Sie auf Speichern, navigieren Sie dann zur MSD Fabric, und klicken Sie auf Speichern und Bereitstellen. Ihre Topologie sollte nach dem erfolgreichen Abschluss wie folgt aussehen (alle Switches + Links grün):

Bereitstellen von Host-Zugriffs-/Trunk-Richtlinien

In diesem Beispiel werden vPC-Trunks von zwei verschiedenen VTEP-Paaren konfiguriert, und die Verbindung innerhalb der lokalen RTP-Fabric wird getestet. Relevante Topologie, wie im Bild gezeigt:

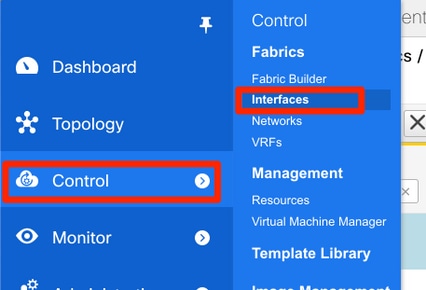

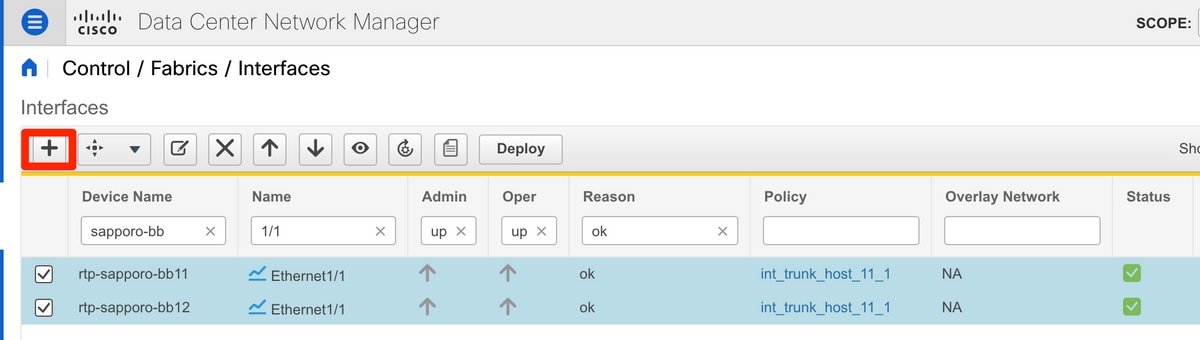

Schritt 1: Navigieren Sie zu Steuerung > Strukturen > Schnittstellen, wie im Bild dargestellt.

Schritt 2: Klicken Sie auf das +-Zeichen, um den Assistenten zum Hinzufügen einer Schnittstelle aufzurufen, wie im Bild dargestellt.

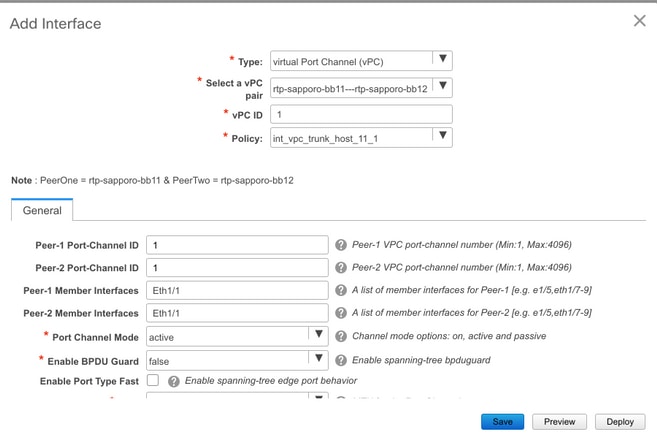

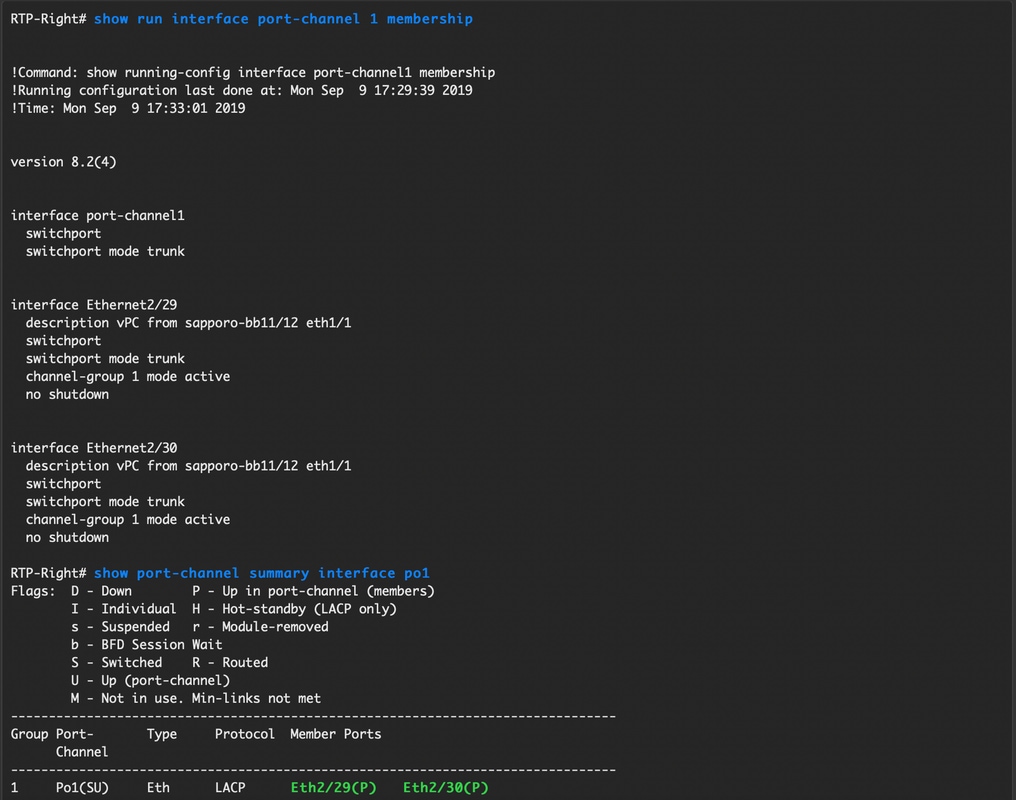

In diesem Beispiel wird ein vPC-Trunk nach dem Nexus 7000 erstellt, der verwendet wird, um Tests in dieser exemplarischen Vorgehensweise zu pingen.

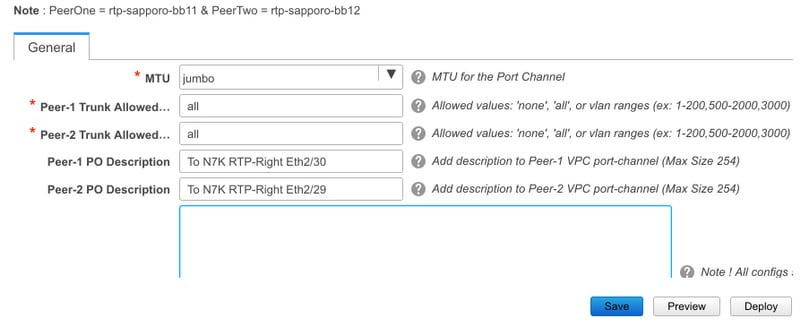

Schritt 3: Wählen Sie das entsprechende vPC-Paar, die physischen Schnittstellen, LACP on/off (Ein/Aus), BPDUGuard usw. aus.

Schritt 4. Klicken Sie abschließend auf Speichern. Alternativ können Sie, wie im Bild dargestellt, direkt Bereitstellen.

Schritt 5: Überprüfen Sie optional die anzuwendende Konfiguration.

Schritt 6. (Optional) Manuelle Konfiguration auf 7K:

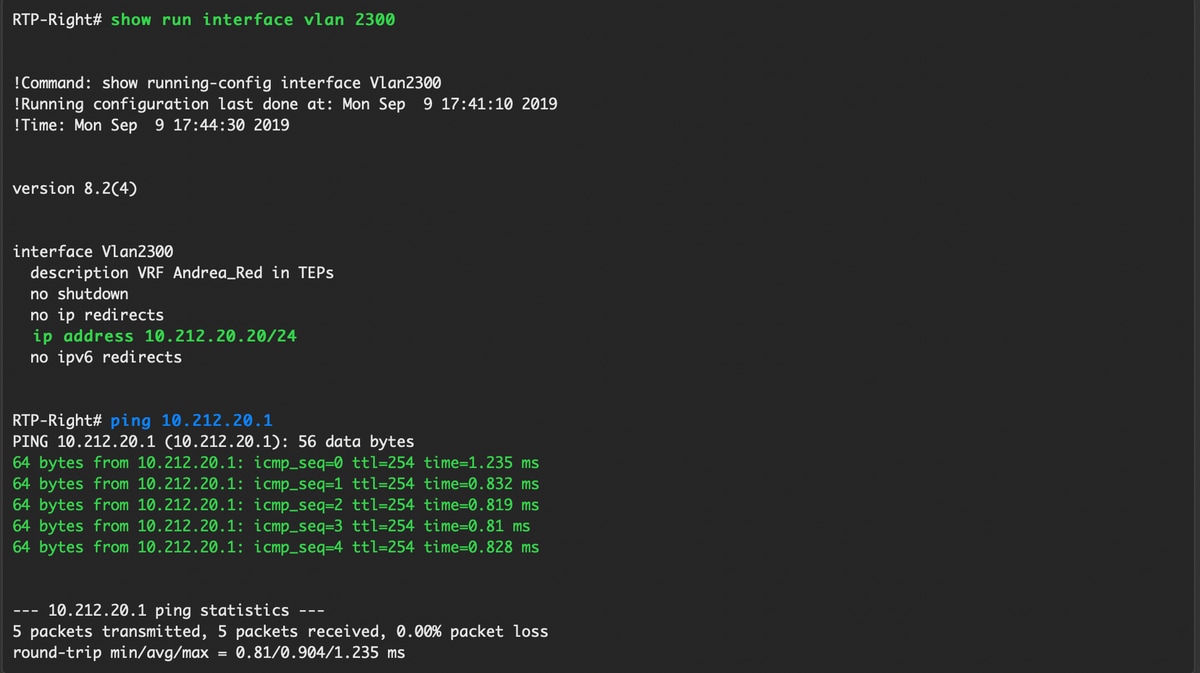

Schritt 7: (Optional) Erstellen einer Test-SVI auf Nexus 7000 zum Pingen der VTEPs in RTP (VTEPs haben Anycast Gateway von 10.212.20.1 in VRF andrea_red):

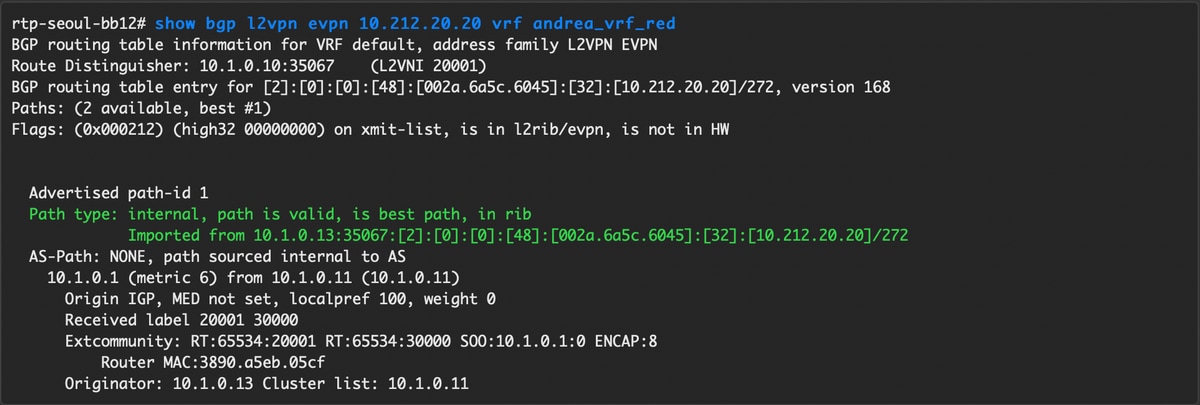

Schritt 8: Überprüfen Sie (optional), ob andere VTEPs im RTP diesen Host über EVPN/HMM sehen:

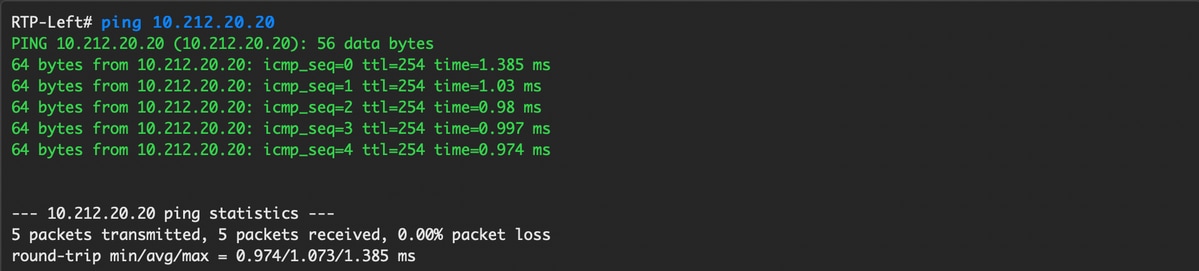

Schritt 9 (Optional) Wiederholen Sie den gleichen Prozess für seoul-bb11/12 (erstellen Sie einen vPC-Port-Channel, erstellen Sie eine SVI 2300). Pingen von RTP-Left an RTP-Right, um die L2-Verbindung über EVPN in der RTP-Fabric zu bestätigen:

Ähnliche Schritte können ausgeführt werden, um Nicht-vPC-Port-Channels, Zugriffsschnittstellen usw. im Kontext Add Interfaces (Schnittstellen hinzufügen) zu erstellen.

Day-2-Betrieb

Upgrade der NX-OS Software über DCNM

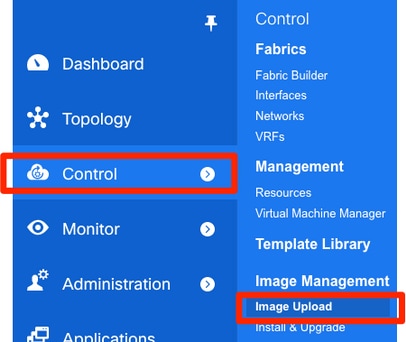

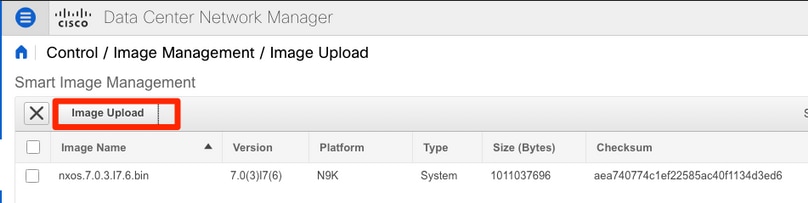

Schritt 1: Laden Sie ein Image (oder eine Gruppe von Images auf den DCNM-Server) hoch, und navigieren Sie dann zu Control > Image Management > Image Upload (Steuerung > Image-Management > Image-Upload), wie im Image dargestellt.

Schritt 2. Folgen Sie den Anweisungen für einen lokalen Upload. Die Datei(en) sollte(n) wie in diesem Bild dargestellt angezeigt werden:

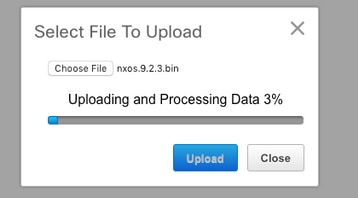

Schritt 3: Nachdem die Dateien hochgeladen wurden, können Sie mit Install & Upgrade fortfahren, wenn die Switches ein Upgrade erfordern. Navigieren Sie zu Control > Image Management > Install & Upgrade (Steuerung > Image-Verwaltung > Installation und Upgrade), wie im Bild dargestellt.

Schritt 4: Wählen Sie die Switches aus, die aktualisiert werden sollen. In diesem Beispiel wird die gesamte RTP-Fabric aktualisiert.

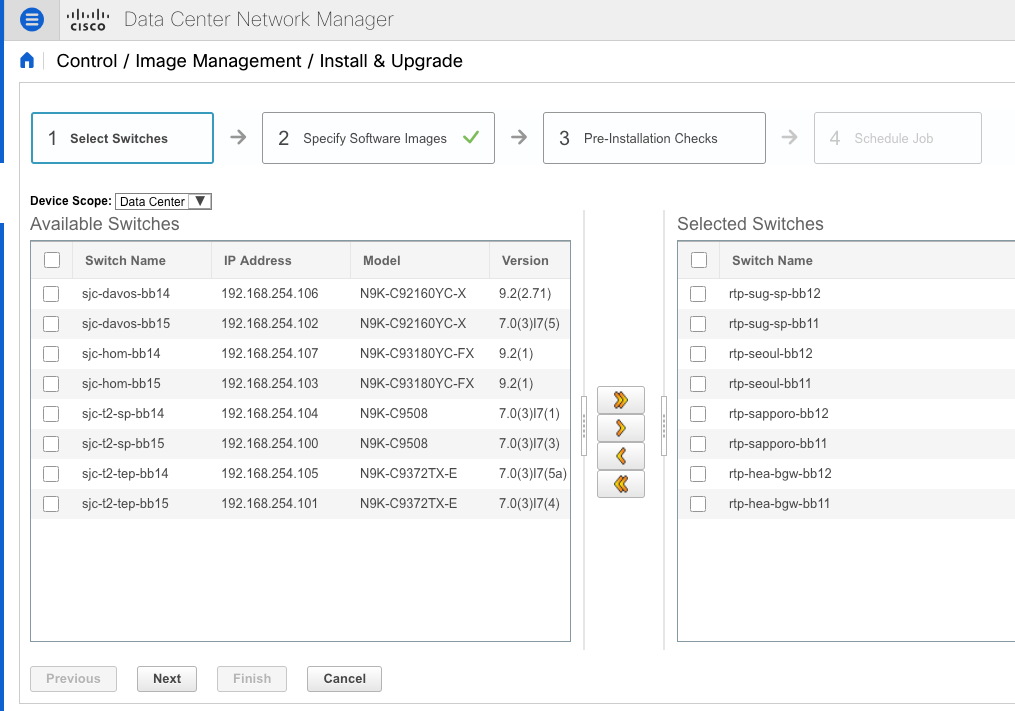

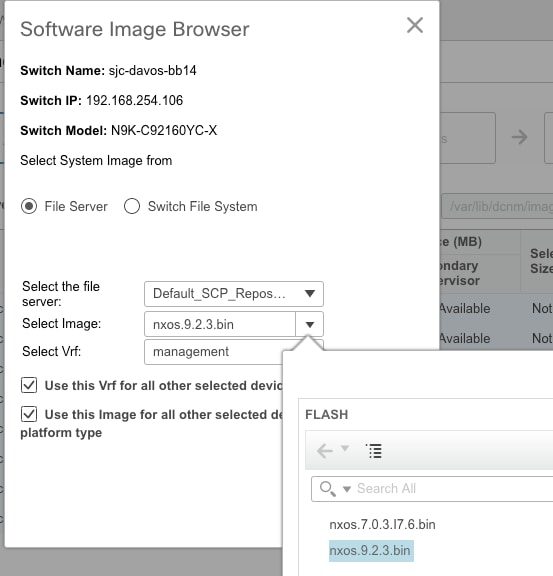

Schritt 5: Wählen Sie die NX-OS-Version aus, auf die Sie ein Upgrade der Switches durchführen möchten (als Best Practice sollten Sie alle Switches auf die gleiche NX-OS-Version aktualisieren):

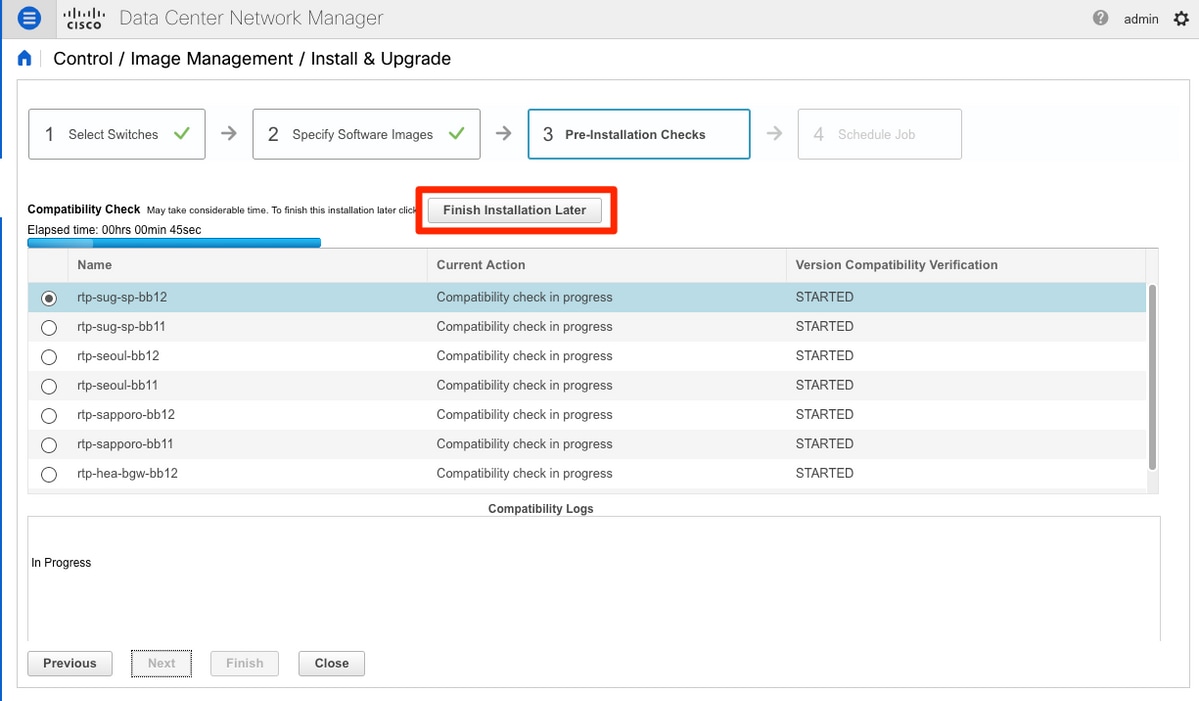

Schritt 6: Klicken Sie auf Weiter, und DCNM führt die Switches durch Prüfungen vor der Installation. Dieses Fenster kann einige Zeit in Anspruch nehmen, sodass Sie alternativ die Option Installation später beenden auswählen und das Upgrade planen können, während Sie weg sind.

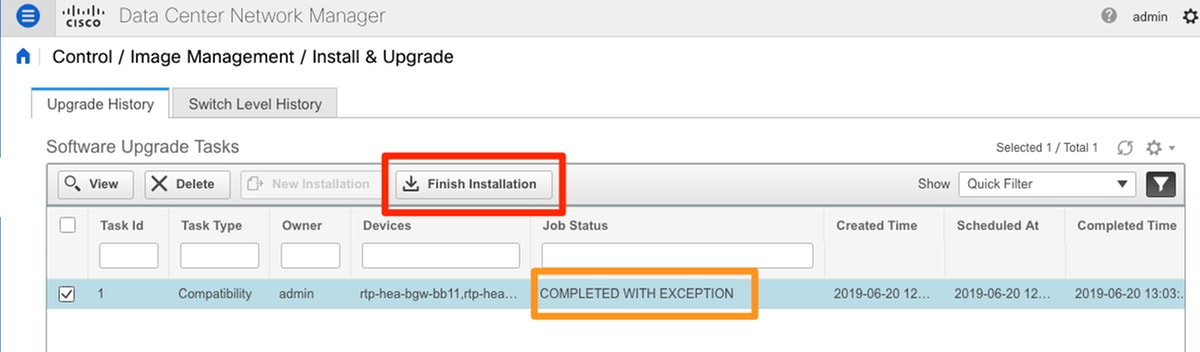

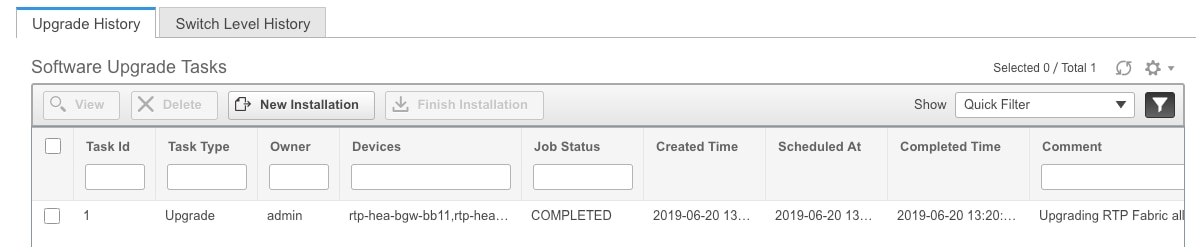

Dadurch wird die Aufgabe in die Warteschlange gestellt und sieht ähnlich aus, wie in der Abbildung hier gezeigt, sobald sie abgeschlossen ist.

Hinweis: Die Ausnahme in diesem Fall war, dass einer der RTP-Switches nicht über genügend Platz für das NX-OS-Image verfügte.

Schritt 7. Sobald die Kompatibilität abgeschlossen ist, klicken Sie auf Installation beenden im gleichen Fenster, wie in der Abbildung dargestellt.

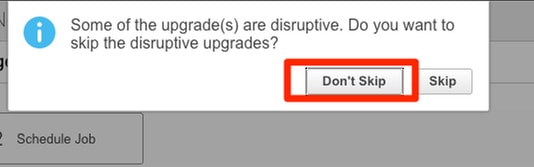

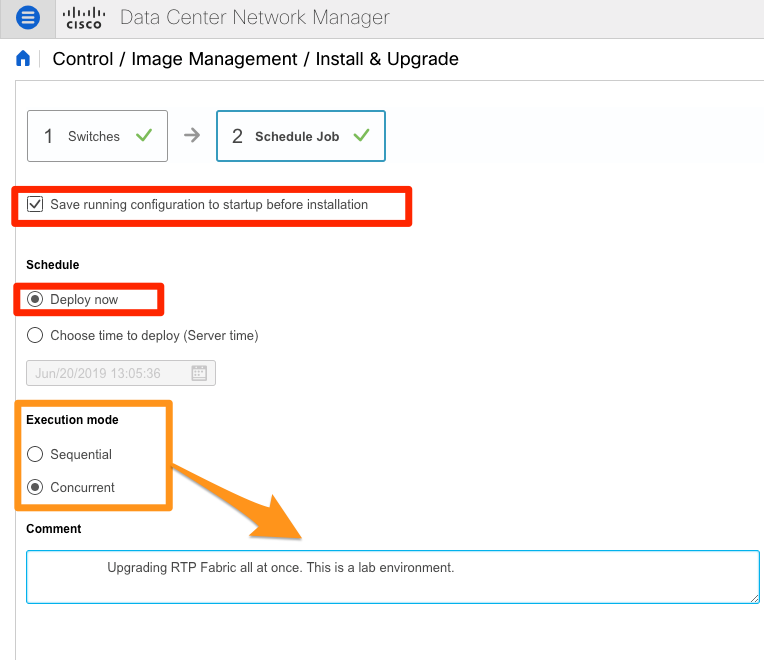

Schritt 8: Sie können die Upgrades auswählen, die gleichzeitig (alle gleichzeitig) oder sequenziell (jeweils eine) durchgeführt werden sollen. Da es sich um eine Laborumgebung handelt, wurde als gleichzeitig ausgewählt.

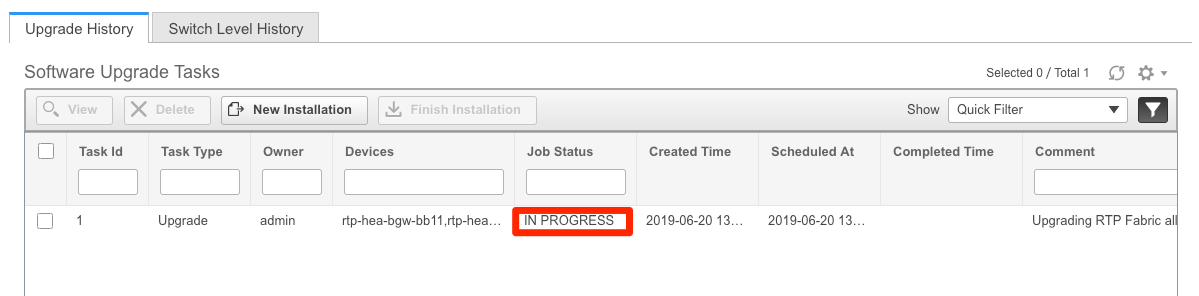

Die Aufgabe wird erstellt und IN AKTUELLER Ausführung angezeigt, wie in der Abbildung dargestellt.

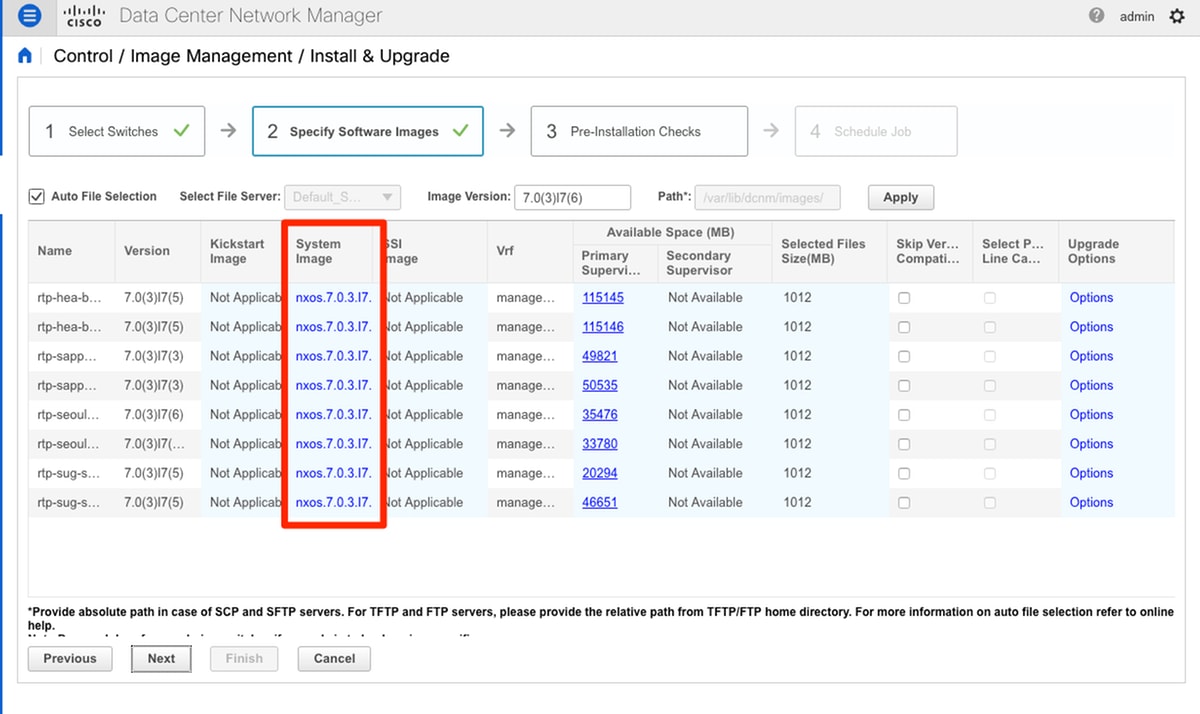

Eine alternative Möglichkeit zur Auswahl des Bildes ist hier dargestellt.

Endpunkt-Locator installieren

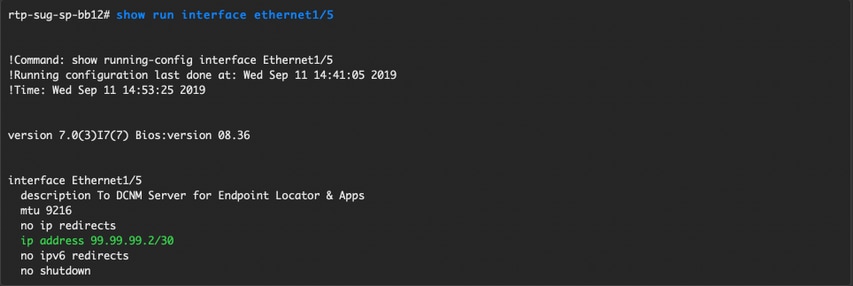

Damit die DCNM-Anwendungen ordnungsgemäß funktionieren, müssen Sie über In-Band-Verbindungen zwischen dem DCNM-Server und einem Port an der Vorderseite eines Nexus 9000 im Fabric verfügen. In diesem Beispiel ist der DCNM-Server mit Ethernet1/5 eines der Spines in der RTP-Fabric verbunden.

Schritt 1. Diese CLI wird dem Nexus 9000 manuell hinzugefügt:

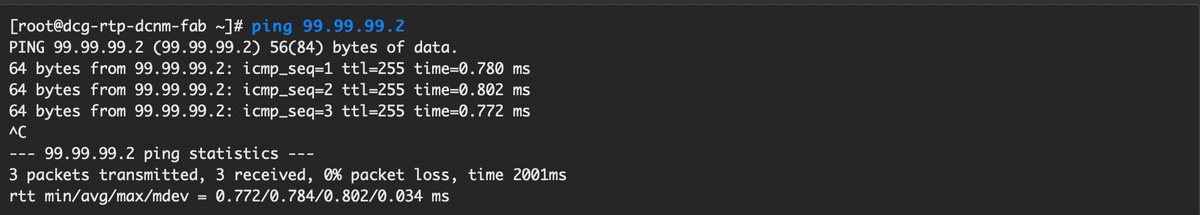

Schritt 2: Stellen Sie sicher, dass Sie für diese Punkt-zu-Punkt-Verbindung einen Ping an den DCNM-Server senden können und umgekehrt.

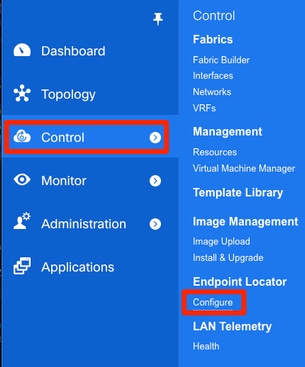

Schritt 3: Navigieren Sie zu DCNM GUI > Control > Endpoint Locator > Configure, wie im Bild dargestellt.

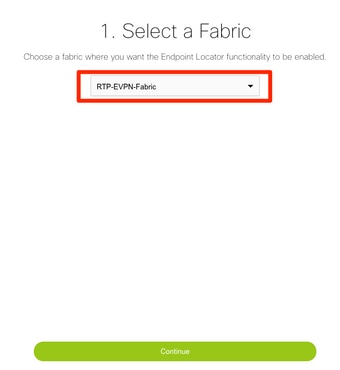

Schritt 4: Wählen Sie die Fabric aus, die Endpoint Locator aktivieren soll, wie im Bild gezeigt.

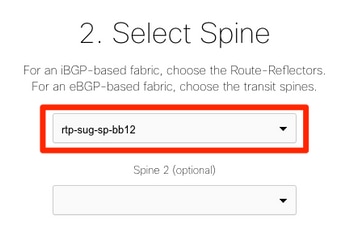

Schritt 5: Wählen Sie, wie im Bild gezeigt, eine Wirbelsäule.

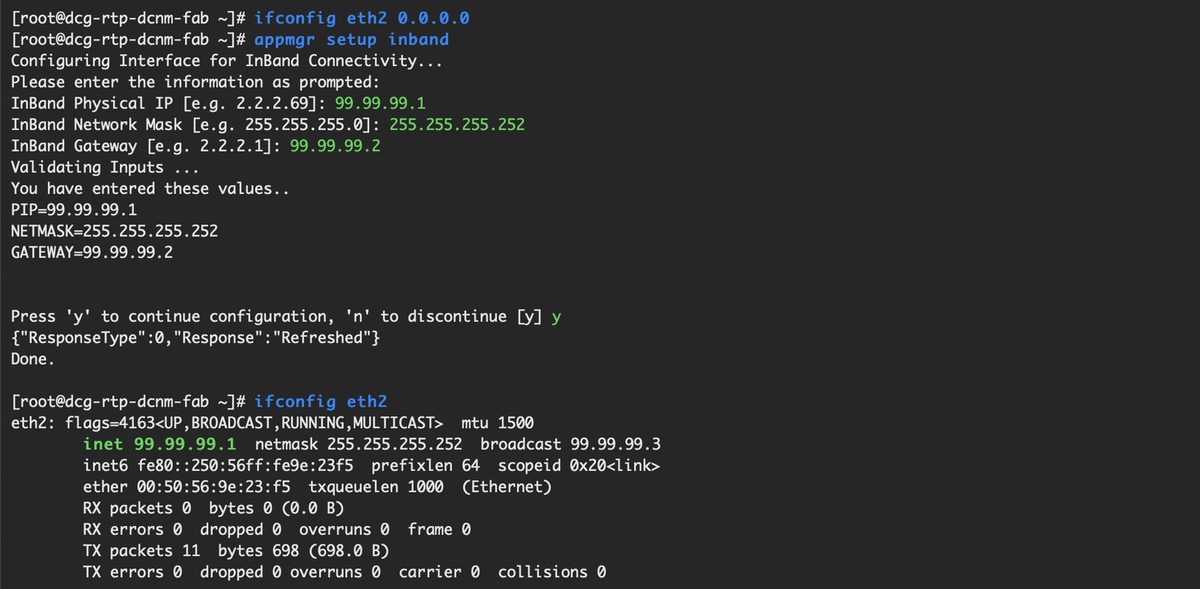

Schritt 6 (optional). Bevor mit dem nächsten Schritt fortgefahren wird, wurde die IP-Adresse von eth2 von der ursprünglichen Bereitstellung über diese CLI auf dem DCNM-Server geändert (dieser Schritt ist nicht erforderlich, wenn die ursprüngliche IP, die während der Neuinstallation des DCNM-Servers konfiguriert wurde, korrekt bleibt):

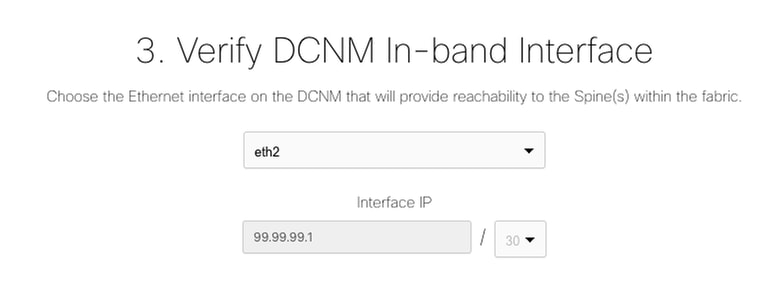

Schritt 7: Überprüfen der In-Band-Schnittstellenkonfiguration Dies sollte mit der Konfiguration aus dem vorherigen Schritt übereinstimmen.

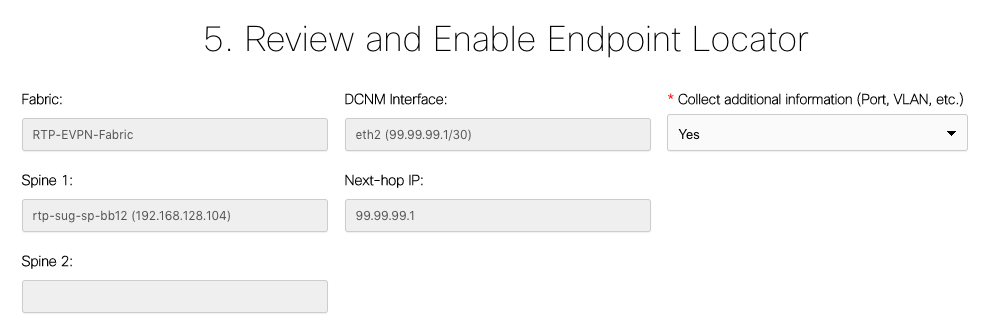

Schritt 8: Nachdem Sie die Konfiguration überprüft haben, klicken Sie auf Konfigurieren. Dieser Schritt kann einige Minuten dauern:

Nach Abschluss des Vorgangs wird die Benachrichtigung angezeigt, wie in der Abbildung dargestellt.

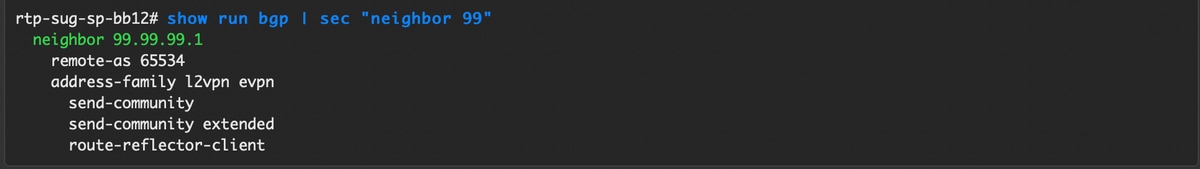

Beachten Sie, dass DCNM einen BGP-Nachbarn für den ausgewählten Spine in der L2VPN EVPN-Familie konfiguriert hat.

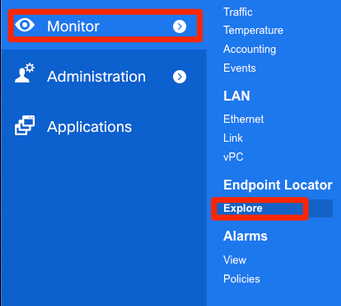

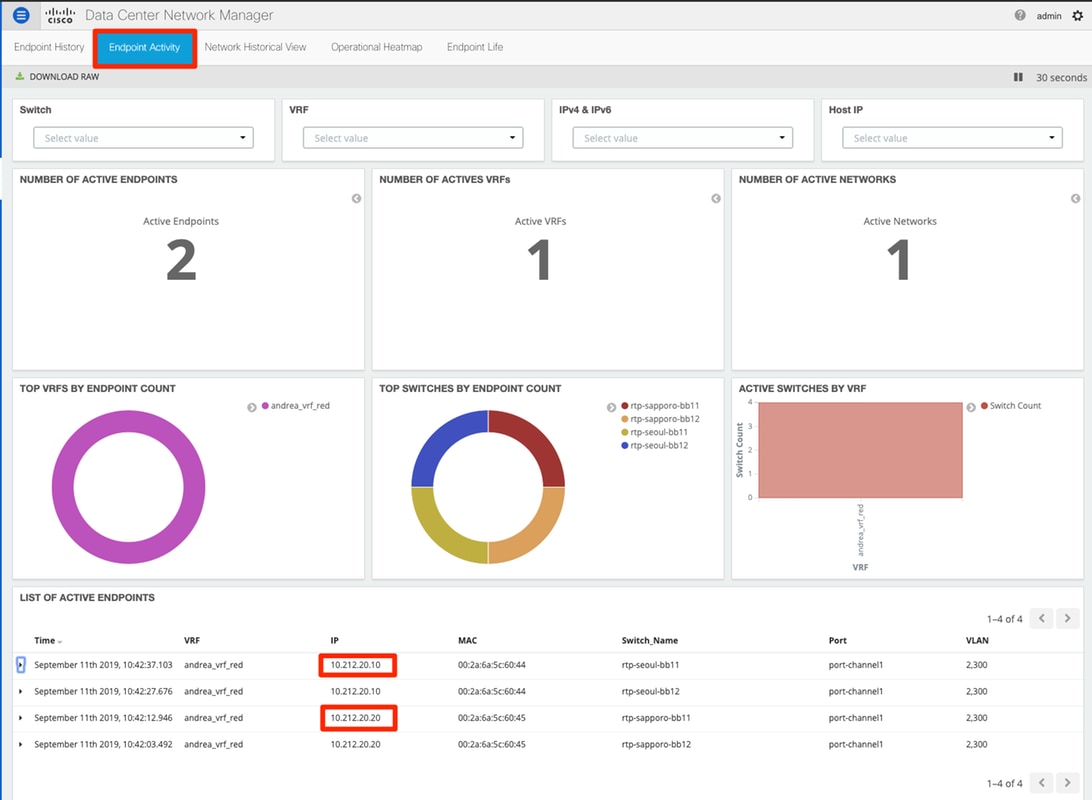

Schritt 9: Sie können jetzt Endpoint Locator verwenden. Navigieren Sie zu Monitor > Endpoint Locator > Explore.

In diesem Beispiel werden die beiden Hosts angezeigt, die für die lokalen Ping-Tests in der RTP-Fabric konfiguriert wurden:

Probleme bei dieser Bereitstellung

Fehlerhafte Verkabelung

Die Verkabelung eines Switch-Paars war defekt. Dies verursachte einen Bündelungsfehler für den vPC Peer-Link-Port-Channel500. Beispiel:

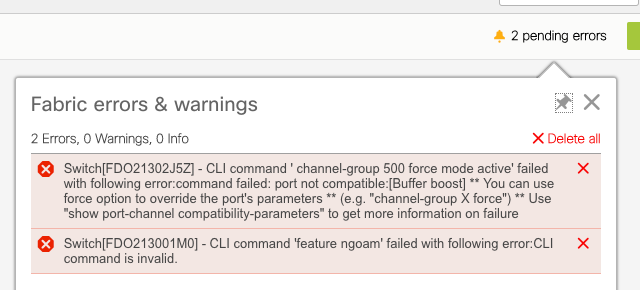

Schritt 1: Navigieren Sie zurück zu Control > Fabric Builder, und überprüfen Sie die Fehler:

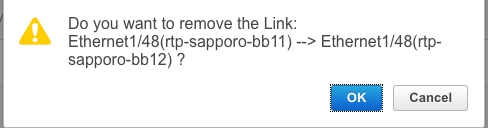

Schritt 2: Der erste Fehler bezüglich des Befehls port-channel500 ist fehlgeschlagen - Über show cdp neighbors wurde überprüft, ob die Verbindung zum vPC-Peer über einen 10G- und einen 40G-Port (nicht kompatibel) hergestellt wurde. 10G-Port physisch entfernt und Link ebenfalls von DCNM gelöscht:

Fehler beim Konfigurieren einer Funktion

Für den zweiten Fehler bezüglich der "feature ngoam"-Fehlkonfiguration — Der Switch wurde auf eine neuere NX-OS-Version aktualisiert, in der "feature ngoam" unterstützt wird, und klicken Sie erneut auf Save & Deploy (Speichern und Bereitstellen). Beide Probleme wurden gelöst.

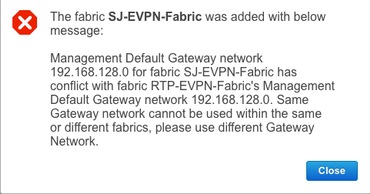

Überlappung der Management-Subnetze für verschiedene Fabrics

Während der Bereitstellung der zweiten Fabric, SJ, wurde dasselbe Subnetz verwendet (sofern physisch getrennt, sollte dies in Ordnung sein). DCNM protokolliert jedoch einen Konflikt und der POAP schlägt fehl. Dies wird behoben, da die SJ-Fabric in einem anderen Management-VLAN platziert wird und sich der Bereich der DHCP-Adressen ändert.

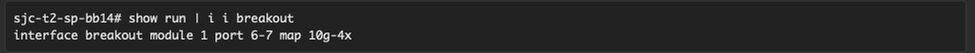

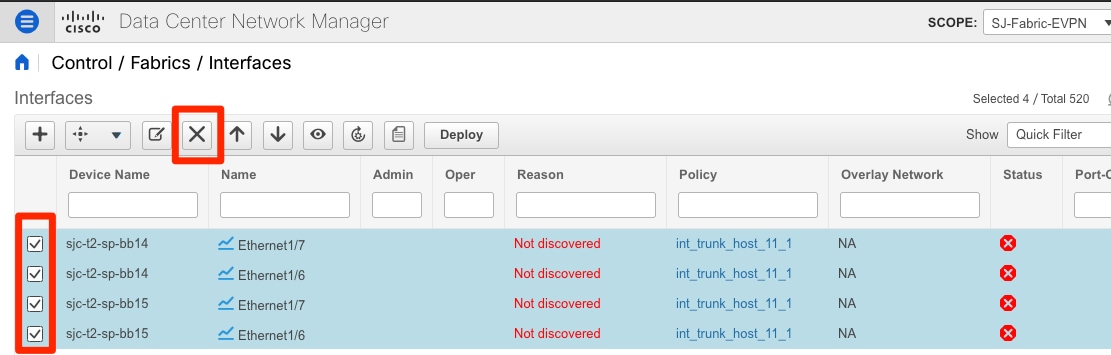

Breakout-Schnittstellen

Schritt 1: Für Breakout-Schnittstellen in einigen Switches (siehe Topologie) wurde diese CLI für die T2-Spines manuell hinzugefügt:

Schritt 2: Navigieren Sie zu Steuerung > Schnittstellen, und löschen Sie die übergeordneten Schnittstellen:

Die tatsächlich verwendeten Schnittstellen sind Eth1/6/1-4 und Eth1/7/1-4. Wenn Sie dies nicht korrigieren, schlägt das Speichern und Bereitstellen später fehl. Es gibt eine Möglichkeit, den Breakout über DCNM selbst durchzuführen (Schaltfläche neben dem +-Zeichen; jedoch nicht in diesem Artikel erfasst)

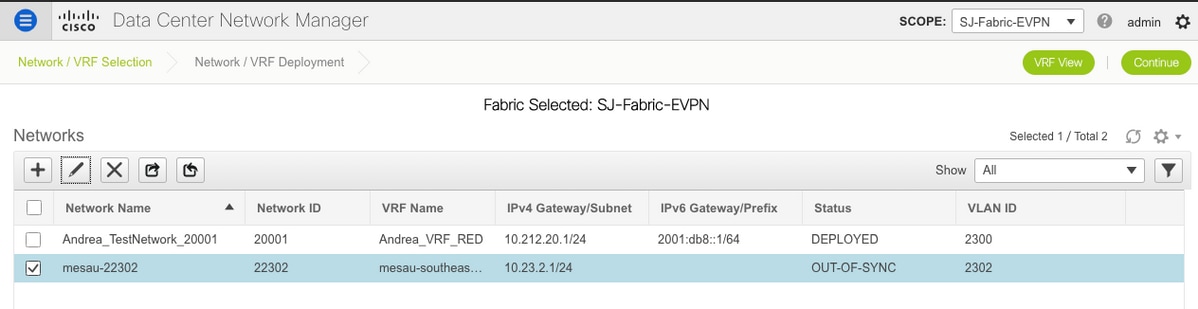

Fabric-Fehler bei Bereitstellung zu nicht unterstützter Funktion

Einige der Chassis (T2s) in SJ Fabric unterstützen TRM nicht. Als DCNM also versuchte, diese Konfiguration per Push zu übertragen, konnte es nicht weiterarbeiten. TRM-Unterstützung hier: https://www.cisco.com/c/en/us/td/docs/switches/datacenter/nexus9000/sw/92x/vxlan-92x/configuration/guide/b-cisco-nexus-9000-series-nx-os-vxlan-configuration-guide-92x/b_Cisco_Nexus_9000_Series_NX-OS_VXLAN_Configuration_Guide_9x_chapter_01001.html#concept_vw1_syb_zfb

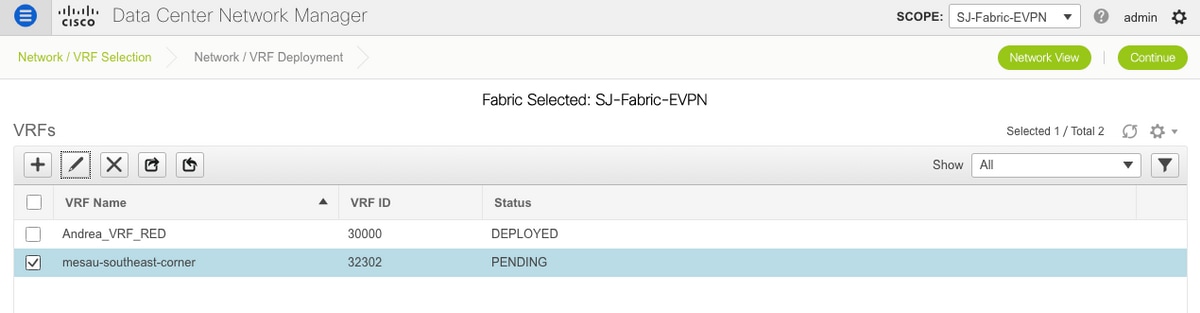

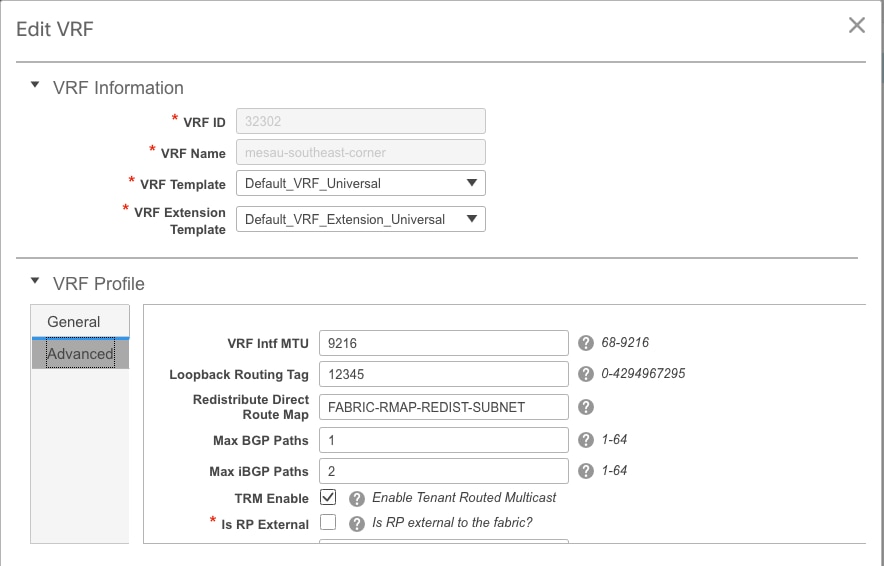

Deaktivieren Sie das Kontrollkästchen TRM aktivieren unter den Fenstern Netzwerk und VRF Bearbeiten.

Wiederholen Sie den gleichen Vorgang unter Steuerung > Fabric Builder > VRF.

Klicken Sie auf Continue (Weiter) und dann auf Deploy (Bereitstellen), wie zuvor geschehen.

Neue Funktionen in DCNM 11.2

-

vPC-Fabric-Peering

-

eBGP-basierte geroutete Fabrics

-

EVPN oben aktivieren

-

-

Einfache Erweiterung des Fabric-Bestands

-

Grenz-Spine/Grenz-GW-Spine

-

PIM-Bidir

-

Multicast mit Tenant-Routing

-

-

Day-0/Bootstrap mit externem DHCP-Server

Day-2-Betrieb:

-

Ressourcen mit Netzwerkinformationen

-

Network Insights Advisor

-

IPv6-Unterstützung für externen Zugriff (eth0)

-

VMM-Computing-Transparenz mit UCS-FI

-

Verbesserungen der Topologieansicht

-

Inline-Upgrade von 11.0/11.1

Wechsel von traditionellem vPC zu MCT-freiem vPC mit DCNM:

Vorteile von MCT-Less vPC:

-

Erweiterte Dual-Homing-Lösung ohne Verschwendung physischer Ports

-

Beibehaltung der herkömmlichen vPC-Eigenschaften

-

Optimiertes Routing für Single-Homed-Endgeräte mit PIP

Zugehörige Informationen

- Konfigurationsleitfaden für Cisco DCNM LAN Fabric, Version 11.2(1)

https://www.cisco.com/c/en/us/td/docs/switches/datacenter/sw/11_2_1/config_guide/lanfabric/b_dcnm_fabric_lan/control.html - Kapitel: Einsatzmöglichkeit für Border Provisioning in VXLAN BGP EVPN-Fabrics - an mehreren Standorten

https://www.cisco.com/c/en/us/td/docs/switches/datacenter/sw/11_2_1/config_guide/lanfabric/b_dcnm_fabric_lan/border-provisioning-multisite.html - Whitepaper: NextGen DCI mit VXLAN EVPN Multi-Site Using vPC Border Gateways

https://www.cisco.com/c/en/us/products/collateral/switches/nexus-9000-series-switches/whitepaper-c11-742114.html#_Toc5275096 - Kapitel: DCNM-Anwendungen

https://www.cisco.com/c/en/us/td/docs/switches/datacenter/sw/11_2_1/config_guide/lanfabric/b_dcnm_fabric_lan/applications.html

Revisionsverlauf

| Überarbeitung | Veröffentlichungsdatum | Kommentare |

|---|---|---|

1.0 |

19-Sep-2019

|

Erstveröffentlichung |

Beiträge von Cisco Ingenieuren

- Andrea TestinoCisco Engineering

Cisco kontaktieren

- Eine Supportanfrage öffnen

- (Erfordert einen Cisco Servicevertrag)

Feedback

Feedback