更换计算服务器UCS C240 M4 - CPAR

下载选项

非歧视性语言

此产品的文档集力求使用非歧视性语言。在本文档集中,非歧视性语言是指不隐含针对年龄、残障、性别、种族身份、族群身份、性取向、社会经济地位和交叉性的歧视的语言。由于产品软件的用户界面中使用的硬编码语言、基于 RFP 文档使用的语言或引用的第三方产品使用的语言,文档中可能无法确保完全使用非歧视性语言。 深入了解思科如何使用包容性语言。

关于此翻译

思科采用人工翻译与机器翻译相结合的方式将此文档翻译成不同语言,希望全球的用户都能通过各自的语言得到支持性的内容。 请注意:即使是最好的机器翻译,其准确度也不及专业翻译人员的水平。 Cisco Systems, Inc. 对于翻译的准确性不承担任何责任,并建议您总是参考英文原始文档(已提供链接)。

目录

简介

本文档介绍在Ultra-M设置中替换故障计算服务器所需的步骤。

此程序适用于使用NEWTON版本的Openstack环境,其中Elastic Series Controller(ESC)不管理Cisco Prime Access Registrar(CPAR),并且CPAR直接安装在Openstack上部署的VM上。

背景信息

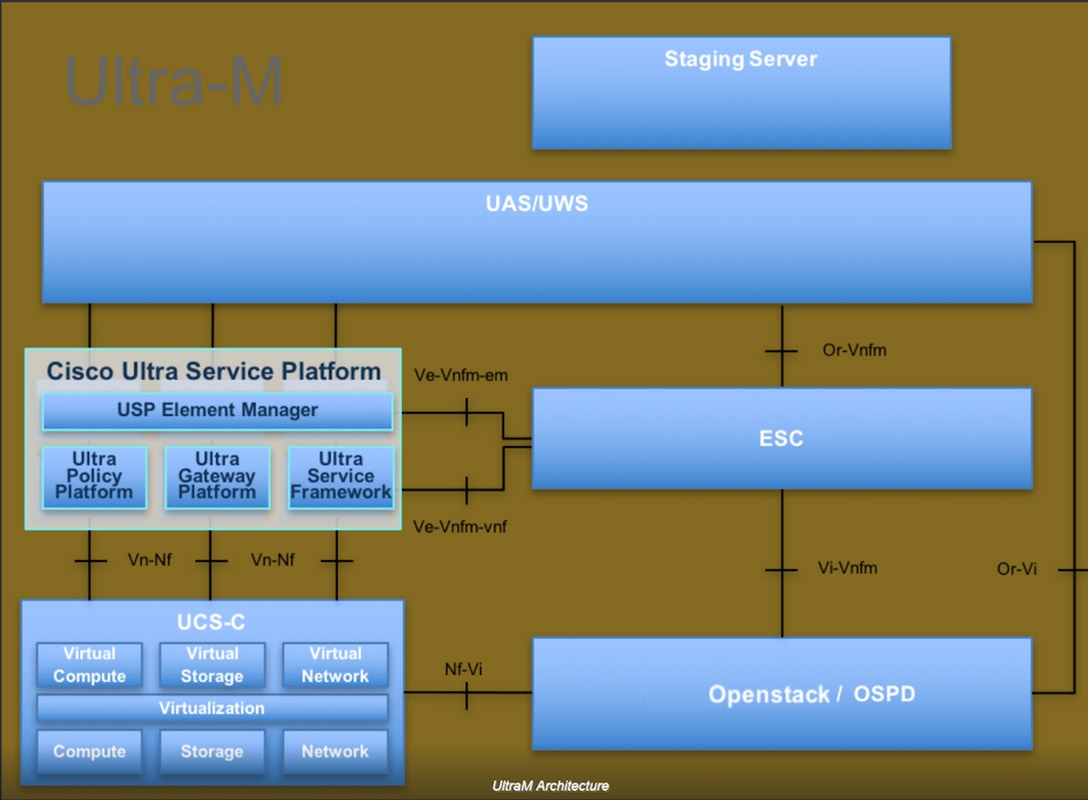

Ultra-M是经过预先打包和验证的虚拟化移动数据包核心解决方案,旨在简化VNF的部署。OpenStack是适用于Ultra-M的虚拟化基础设施管理器(VIM),由以下节点类型组成:

- 计算

- 对象存储磁盘 — 计算(OSD — 计算)

- 控制器

- OpenStack平台 — 导向器(OSPD)

Ultra-M的高级体系结构和涉及的组件如下图所示:

本文档面向熟悉Cisco Ultra-M平台的思科人员,详细介绍在OpenStack和Redhat操作系统上需要执行的步骤。

注意:Ultra M 5.1.x版本用于定义本文档中的过程。

缩写

| MOP | 程序方法 |

| OSD | 对象存储磁盘 |

| OSPD | OpenStack平台导向器 |

| HDD | 硬盘驱动器 |

| SSD | 固态驱动器 |

| VIM | 虚拟基础设施管理器 |

| VM | 虚拟机 |

| EM | 元素管理器 |

| UAS | 超自动化服务 |

| UUID | 通用唯一ID标识符 |

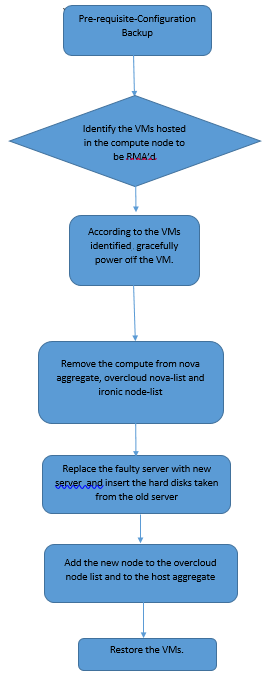

MoP的工作流程

先决条件

备份

在替换计算节点之前,必须检查Red Hat OpenStack平台环境的当前状态。建议您检查当前状态,以避免当启用计算更换过程时并发症。通过这种替换流程可以实现这一点。

在进行恢复时,Cisco建议使用以下步骤备份OSPD数据库:

[root@ al03-pod2-ospd ~]# mysqldump --opt --all-databases > /root/undercloud-all-databases.sql [root@ al03-pod2-ospd ~]# tar --xattrs -czf undercloud-backup-`date +%F`.tar.gz /root/undercloud-all-databases.sql /etc/my.cnf.d/server.cnf /var/lib/glance/images /srv/node /home/stack tar: Removing leading `/' from member names

此过程可确保在不影响任何实例可用性的情况下替换节点。

注意:确保您具有实例的快照,以便在需要时恢复虚拟机。请按照以下步骤了解如何拍摄虚拟机快照。

确定托管在计算节点中的VM

确定托管在计算服务器上的VM。

[stack@al03-pod2-ospd ~]$ nova list --field name,host +--------------------------------------+---------------------------+----------------------------------+ | ID | Name | Host | +--------------------------------------+---------------------------+----------------------------------+ | 46b4b9eb-a1a6-425d-b886-a0ba760e6114 | AAA-CPAR-testing-instance | pod2-stack-compute-4.localdomain | | 3bc14173-876b-4d56-88e7-b890d67a4122 | aaa2-21 | pod2-stack-compute-3.localdomain | | f404f6ad-34c8-4a5f-a757-14c8ed7fa30e | aaa21june | pod2-stack-compute-3.localdomain | +--------------------------------------+---------------------------+----------------------------------+

注意:在此显示的输出中,第一列对应于通用唯一ID标识符(UUID),第二列是VM名称,第三列是存在VM的主机名。此输出的参数将在后续部分中使用。

快照流程

CPAR应用关闭

步骤1.打开连接到网络的任何SSH客户端并连接到CPAR实例。

切勿同时关闭一个站点内的所有4个AAA实例,逐个关闭。

步骤2.使用以下命令关闭CPAR应用程序:

/opt/CSCOar/bin/arserver stop

消息显示“Cisco Prime Access Registrar Server Agent shutdown complete”。 应该出现。

注意:如果用户使CLI会话保持打开状态,则arserver stop命令将无法运行,并显示以下消息:

ERROR: You can not shut down Cisco Prime Access Registrar while the

CLI is being used. Current list of running

CLI with process id is:

2903 /opt/CSCOar/bin/aregcmd –s

在本例中,需要终止突出显示的进程ID 2903,然后才能停止CPAR。如果出现这种情况,请使用以下命令终止进程:

kill -9 *process_id*

然后重复步骤1。

步骤3.使用以下命令检验CPAR应用程序确实已关闭:

/opt/CSCOar/bin/arstatus

应显示以下消息:

Cisco Prime Access Registrar Server Agent not running Cisco Prime Access Registrar GUI not running

VM快照任务

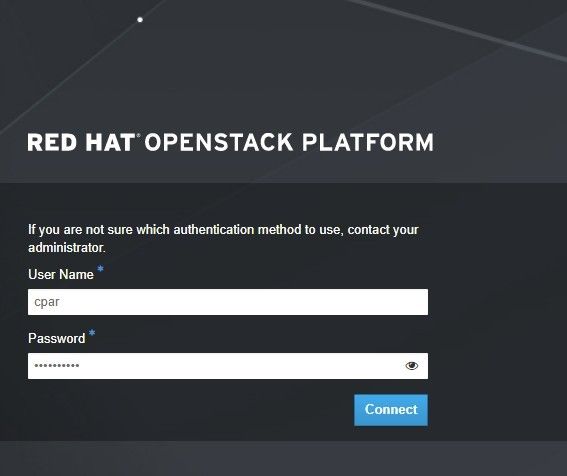

步骤1.输入与当前正在处理的站点(城市)对应的Horizon GUI网站。访问“Horizon”时,将观察图像中所示的屏幕:

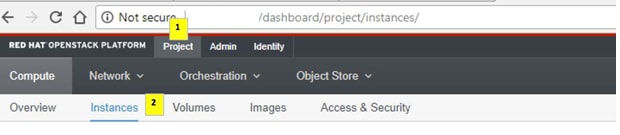

步骤2.如图所示,导航到项目>实例。

如果使用的用户为cpar,则此菜单中仅显示4个AAA实例。

步骤3.一次仅关闭一个实例,重复本文档中的整个过程。要关闭VM,请导航到操作>关闭实例,并确认您的选择。

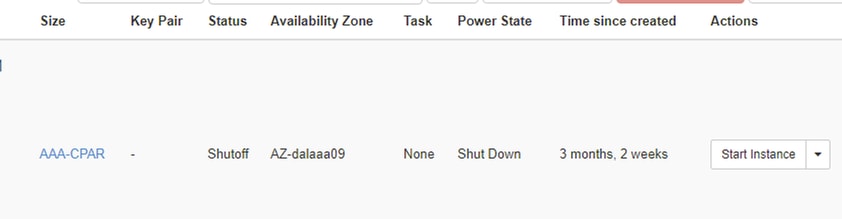

第4步验证实例确实通过Status = Shutoff和Power State = Shut Down关闭。

此步骤结束CPAR关闭过程。

VM快照

一旦CPAR VM关闭,可以并行拍摄快照,因为它们属于独立计算。

四个QCOW2文件并行创建。

拍摄每个AAA实例的快照(25分钟–1小时)(使用qcow映像作为源的实例为25分钟,使用原始映像作为源的实例为1小时)。

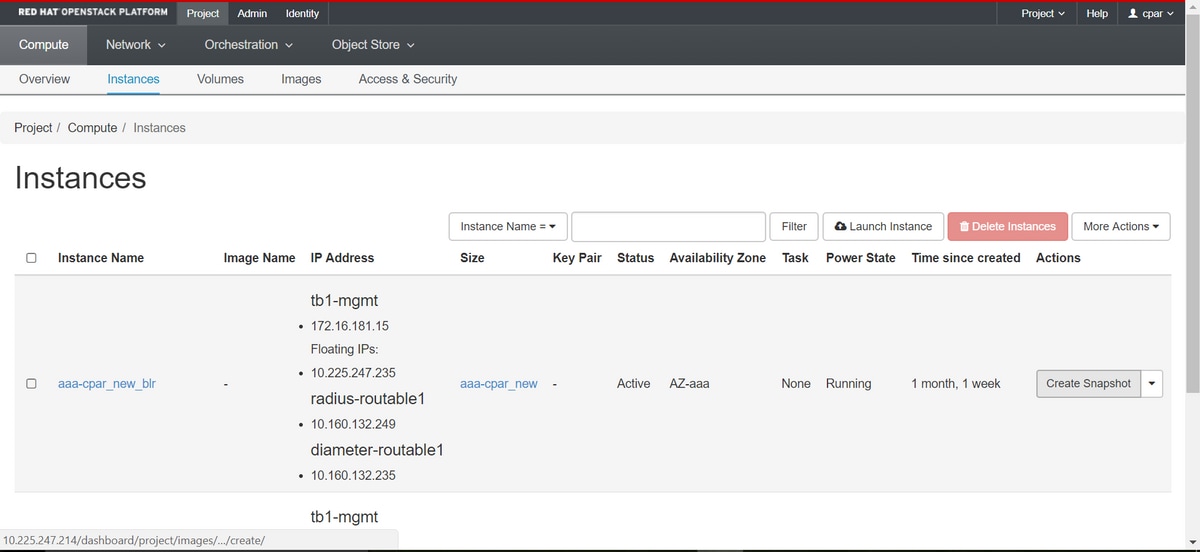

步骤1.登录到POD的Openstack的Horizon GUI。

步骤2.登录后,进入顶部菜单上的Project > Compute > Instances部分并查找AAA实例。

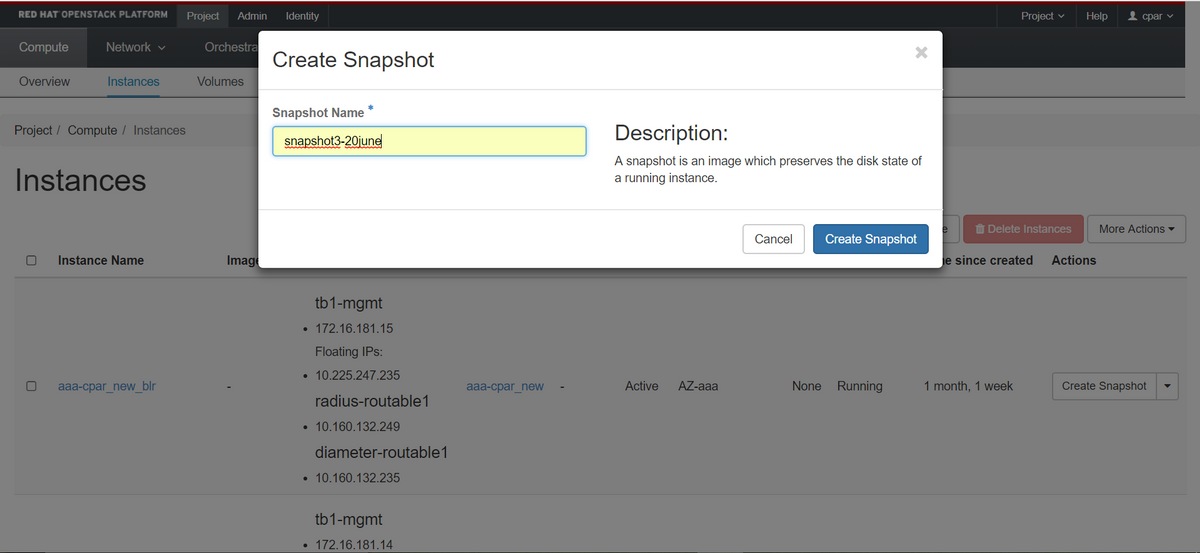

步骤3.单击Create Snapshot继续创建快照(此操作需要在相应的AAA实例上执行)。

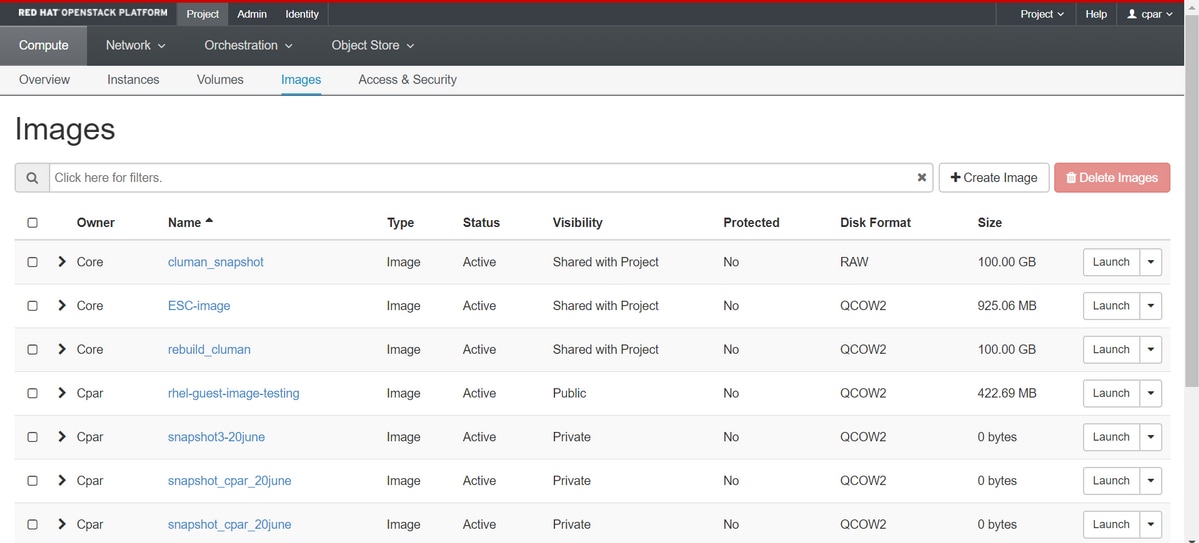

步骤4.执行快照后,导航到Images菜单,验证快照是否完成并报告没有问题。

步骤5.下一步是以QCOW2格式下载快照,并将其传输到远程实体,以防OSPD在此过程中丢失。为此,请使用此命令glance image-list在OSPD级别标识快照

[root@elospd01 stack]# glance image-list +--------------------------------------+---------------------------+ | ID | Name | +--------------------------------------+---------------------------+ | 80f083cb-66f9-4fcf-8b8a-7d8965e47b1d | AAA-Temporary | | 22f8536b-3f3c-4bcc-ae1a-8f2ab0d8b950 | ELP1 cluman 10_09_2017 | | 70ef5911-208e-4cac-93e2-6fe9033db560 | ELP2 cluman 10_09_2017 | | e0b57fc9-e5c3-4b51-8b94-56cbccdf5401 | ESC-image | | 92dfe18c-df35-4aa9-8c52-9c663d3f839b | lgnaaa01-sept102017 | | 1461226b-4362-428b-bc90-0a98cbf33500 | tmobile-pcrf-13.1.1.iso | | 98275e15-37cf-4681-9bcc-d6ba18947d7b | tmobile-pcrf-13.1.1.qcow2 | +--------------------------------------+---------------------------+

步骤6.一旦确定要下载的快照(在本例中是以上绿色标记的快照),将通过此命令glance image-download以QCOW2格式下载该快照,如下所示。

[root@elospd01 stack]# glance image-download 92dfe18c-df35-4aa9-8c52-9c663d3f839b --file /tmp/AAA-CPAR-LGNoct192017.qcow2 &

- “&”将进程发送到后台。完成此操作需要一些时间,一旦完成,映像就可以位于/tmp目录。

- 当进程发送到后台时,如果连接丢失,则进程也会停止。

- 运行命令disown -h,以便在Secure Shell(SSH)连接丢失的情况下,该进程仍然在OSPD上运行和完成。

步骤7.下载过程完成后,需要执行压缩过程,因为操作系统处理的过程、任务和临时文件可能使快照填满0。用于文件压缩的命令是virt-sparsify。

[root@elospd01 stack]# virt-sparsify AAA-CPAR-LGNoct192017.qcow2 AAA-CPAR-LGNoct192017_compressed.qcow2

此过程需要一些时间(大约10-15分钟)。 完成后,生成的文件即为下一步中指定的需要传输到外部实体的文件。

需要验证文件完整性,要做到这一点,请运行下一个命令,并在输出末尾查找corrupted属性。

[root@wsospd01 tmp]# qemu-img info AAA-CPAR-LGNoct192017_compressed.qcow2 image: AAA-CPAR-LGNoct192017_compressed.qcow2 file format: qcow2 virtual size: 150G (161061273600 bytes) disk size: 18G cluster_size: 65536 Format specific information: compat: 1.1 lazy refcounts: false refcount bits: 16 corrupt: false

为了避免丢失OSPD的问题,需要将最近在QCOW2格式上创建的快照转移到外部实体。在开始文件传输之前,我们必须检查目标是否有足够的可用磁盘空间,使用命令df -kh验证内存空间。建议通过SFTP sftp root@x.x.x.x将目标临时传输到其他站点的OSPD,其中x.x.x.x是远程OSPD的IP。为了加快传输速度,可将目标发送到多个OSPD。同样,可以使用此命令scp *name_of_the_file*.qcow2 root@ x.x.x.x:/tmp(其中x.x.x.x是远程OSPD的IP)将文件传输到另一个OSPD。

正常断电

关闭节点电源

- 要关闭实例电源,请执行以下操作:nova stop <INSTANCE_NAME>

- 现在,您会看到实例名称的状态为shutoff。

[stack@director ~]$ nova stop aaa2-21 Request to stop server aaa2-21 has been accepted. [stack@director ~]$ nova list +--------------------------------------+---------------------------+---------+------------+-------------+------------------------------------------------------------------------------------------------------------+ | ID | Name | Status | Task State | Power State | Networks | +--------------------------------------+---------------------------+---------+------------+-------------+------------------------------------------------------------------------------------------------------------+ | 46b4b9eb-a1a6-425d-b886-a0ba760e6114 | AAA-CPAR-testing-instance | ACTIVE | - | Running | tb1-mgmt=172.16.181.14, 10.225.247.233; radius-routable1=10.160.132.245; diameter-routable1=10.160.132.231 | | 3bc14173-876b-4d56-88e7-b890d67a4122 | aaa2-21 | SHUTOFF | - | Shutdown | diameter-routable1=10.160.132.230; radius-routable1=10.160.132.248; tb1-mgmt=172.16.181.7, 10.225.247.234 | | f404f6ad-34c8-4a5f-a757-14c8ed7fa30e | aaa21june | ACTIVE | - | Running | diameter-routable1=10.160.132.233; radius-routable1=10.160.132.244; tb1-mgmt=172.16.181.10 | +--------------------------------------+---------------------------+---------+------------+-------------+------------------------------------------------------------------------------------------------------------+

计算节点删除

此部分中提到的步骤是通用的,与计算节点中托管的VM无关。

从服务列表中删除计算节点

从服务列表中删除计算服务:

[stack@director ~]$ openstack compute service list |grep compute-3 | 138 | nova-compute | pod2-stack-compute-3.localdomain | AZ-aaa | enabled | up | 2018-06-21T15:05:37.000000 |

openstack compute service delete <ID>

[stack@director ~]$ openstack compute service delete 138

删除Neutron代理

删除计算服务器的旧关联中子代理和open vswitch代理:

[stack@director ~]$ openstack network agent list | grep compute-3 | 3b37fa1d-01d4-404a-886f-ff68cec1ccb9 | Open vSwitch agent | pod2-stack-compute-3.localdomain | None | True | UP | neutron-openvswitch-agent |

openstack network agent delete <ID>

[stack@director ~]$ openstack network agent delete 3b37fa1d-01d4-404a-886f-ff68cec1ccb9

从Ironic数据库中删除

从ironic数据库中删除节点并验证它:

nova show <compute-node> | grep虚拟机监控程序

[root@director ~]# source stackrc [root@director ~]# nova show pod2-stack-compute-4 | grep hypervisor | OS-EXT-SRV-ATTR:hypervisor_hostname | 7439ea6c-3a88-47c2-9ff5-0a4f24647444

ironic node-delete <ID>

[stack@director ~]$ ironic node-delete 7439ea6c-3a88-47c2-9ff5-0a4f24647444 [stack@director ~]$ ironic node-list

删除的节点现在不能在ironic node-list中列出。

从Overcloud中删除

步骤1.使用所示内容创建名为delete_node.sh的脚本文件。请确保提到的模板与deploy.sh脚本中用于堆栈部署的模板相同:

delete_node.sh

openstack overcloud node delete --templates -e /usr/share/openstack-tripleo-heat-templates/environments/puppet-pacemaker.yaml -e /usr/share/openstack-tripleo-heat-templates/environments/network-isolation.yaml -e /usr/share/openstack-tripleo-heat-templates/environments/storage-environment.yaml -e /usr/share/openstack-tripleo-heat-templates/environments/neutron-sriov.yaml -e /home/stack/custom-templates/network.yaml -e /home/stack/custom-templates/ceph.yaml -e /home/stack/custom-templates/compute.yaml -e /home/stack/custom-templates/layout.yaml -e /home/stack/custom-templates/layout.yaml --stack <stack-name> <UUID>

[stack@director ~]$ source stackrc [stack@director ~]$ /bin/sh delete_node.sh + openstack overcloud node delete --templates -e /usr/share/openstack-tripleo-heat-templates/environments/puppet-pacemaker.yaml -e /usr/share/openstack-tripleo-heat-templates/environments/network-isolation.yaml -e /usr/share/openstack-tripleo-heat-templates/environments/storage-environment.yaml -e /usr/share/openstack-tripleo-heat-templates/environments/neutron-sriov.yaml -e /home/stack/custom-templates/network.yaml -e /home/stack/custom-templates/ceph.yaml -e /home/stack/custom-templates/compute.yaml -e /home/stack/custom-templates/layout.yaml -e /home/stack/custom-templates/layout.yaml --stack pod2-stack 7439ea6c-3a88-47c2-9ff5-0a4f24647444 Deleting the following nodes from stack pod2-stack: - 7439ea6c-3a88-47c2-9ff5-0a4f24647444 Started Mistral Workflow. Execution ID: 4ab4508a-c1d5-4e48-9b95-ad9a5baa20ae real 0m52.078s user 0m0.383s sys 0m0.086s

步骤2.等待OpenStack堆栈操作进入COMPLETE状态:

[stack@director ~]$ openstack stack list +--------------------------------------+------------+-----------------+----------------------+----------------------+ | ID | Stack Name | Stack Status | Creation Time | Updated Time | +--------------------------------------+------------+-----------------+----------------------+----------------------+ | 5df68458-095d-43bd-a8c4-033e68ba79a0 | pod2-stack | UPDATE_COMPLETE | 2018-05-08T21:30:06Z | 2018-05-08T20:42:48Z | +--------------------------------------+------------+-----------------+----------------------+----------------------+

安装新的计算节点

有关安装新UCS C240 M4服务器的步骤和初始设置步骤,请参阅Cisco UCS C240 M4服务器安装和维修指南

步骤1.安装服务器后,将硬盘插入相应插槽中作为旧服务器。

步骤2.使用CIMC IP登录到服务器。

步骤3.如果固件与之前使用的推荐版本不一致,请执行BIOS升级。BIOS升级步骤如下:Cisco UCS C系列机架式服务器BIOS升级指南

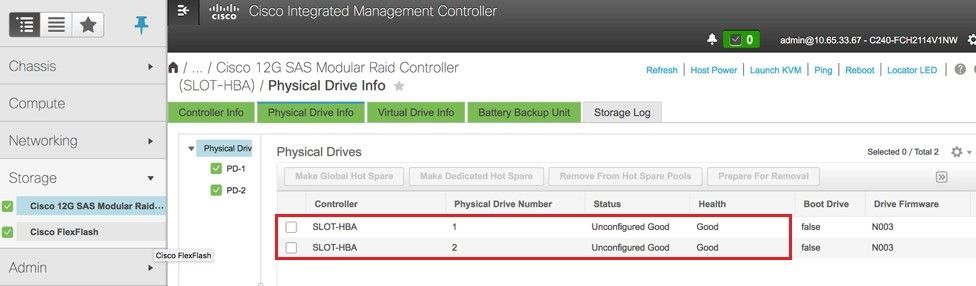

步骤4.要验证未配置完好的物理驱动器的状态,请导航到存储> Cisco 12G SAS模块化Raid控制器(SLOT-HBA)>物理驱动器信息。

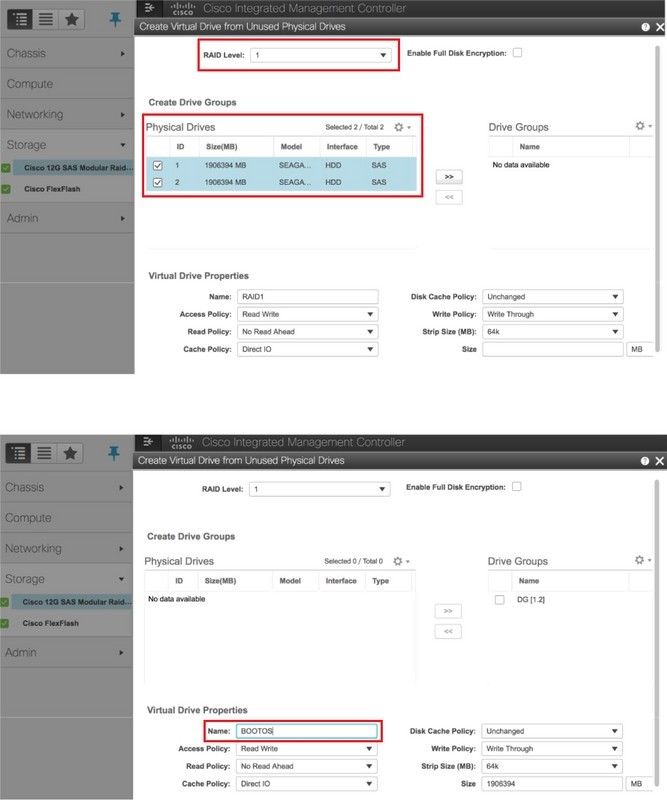

步骤5.要从RAID级别为1的物理驱动器创建虚拟驱动器,请导航到Storage > Cisco 12G SAS Modular Raid Controller(SLOT-HBA)> Controller Info > Create Virtual Drive from Unused Physical Drives。

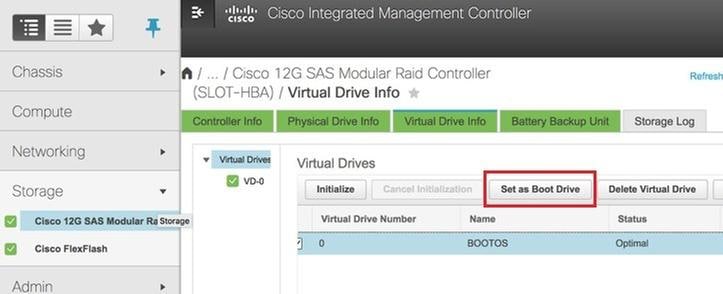

步骤6.选择VD并配置Set as Boot Drive,如图所示。

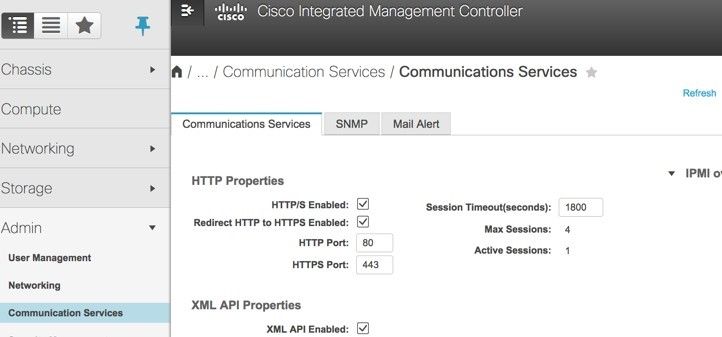

步骤7.要启用LAN上的IPMI,请导航到Admin > Communication Services > Communication Services,如图所示。

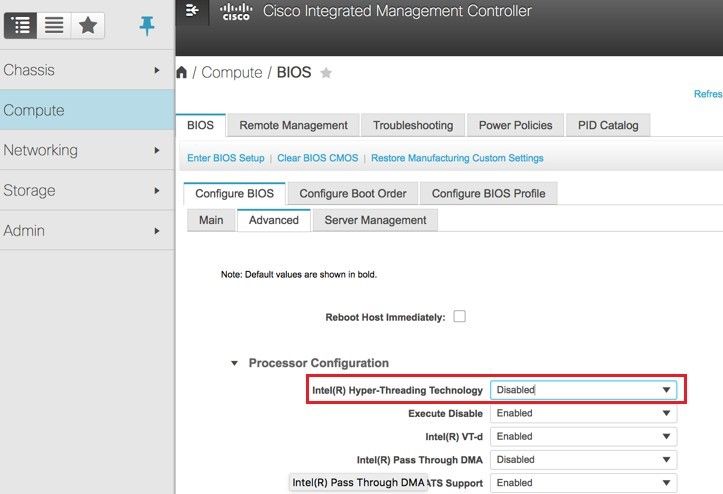

步骤8.要禁用超线程,请导航到计算 > BIOS >配置BIOS >高级>处理器配置。

注意:此处显示的映像和本节中提到的配置步骤是参考固件版本3.0(3e),如果您使用其他版本,可能会有细微的差异。

将新的计算节点添加到超云中

无论计算节点托管的VM如何,本节中提到的步骤都是通用的。

步骤1.使用不同的索引添加计算服务器

创建一个add_node.json文件,其中仅包含要添加的新计算服务器的详细信息。确保新计算服务器的索引号之前未使用过。通常,递增下一个最高计算值。

示例:先前最高是compute-17,因此在2-vnf系统的情况下创建了compute-18。

注意:请记住json格式。

[stack@director ~]$ cat add_node.json

{

"nodes":[

{

"mac":[

"<MAC_ADDRESS>"

],

"capabilities": "node:compute-18,boot_option:local",

"cpu":"24",

"memory":"256000",

"disk":"3000",

"arch":"x86_64",

"pm_type":"pxe_ipmitool",

"pm_user":"admin",

"pm_password":"<PASSWORD>",

"pm_addr":"192.100.0.5"

}

]

}

步骤2.导入json文件。

[stack@director ~]$ openstack baremetal import --json add_node.json Started Mistral Workflow. Execution ID: 78f3b22c-5c11-4d08-a00f-8553b09f497d Successfully registered node UUID 7eddfa87-6ae6-4308-b1d2-78c98689a56e Started Mistral Workflow. Execution ID: 33a68c16-c6fd-4f2a-9df9-926545f2127e Successfully set all nodes to available.

步骤3.使用上一步中标注的UUID运行节点内省。

[stack@director ~]$ openstack baremetal node manage 7eddfa87-6ae6-4308-b1d2-78c98689a56e [stack@director ~]$ ironic node-list |grep 7eddfa87 | 7eddfa87-6ae6-4308-b1d2-78c98689a56e | None | None | power off | manageable | False | [stack@director ~]$ openstack overcloud node introspect 7eddfa87-6ae6-4308-b1d2-78c98689a56e --provide Started Mistral Workflow. Execution ID: e320298a-6562-42e3-8ba6-5ce6d8524e5c Waiting for introspection to finish... Successfully introspected all nodes. Introspection completed. Started Mistral Workflow. Execution ID: c4a90d7b-ebf2-4fcb-96bf-e3168aa69dc9 Successfully set all nodes to available. [stack@director ~]$ ironic node-list |grep available | 7eddfa87-6ae6-4308-b1d2-78c98689a56e | None | None | power off | available | False |

第4步:运行以前用于部署堆栈的deploy.sh脚本,以便将新计算机添加到超云堆栈:

[stack@director ~]$ ./deploy.sh ++ openstack overcloud deploy --templates -r /home/stack/custom-templates/custom-roles.yaml -e /usr/share/openstack-tripleo-heat-templates/environments/puppet-pacemaker.yaml -e /usr/share/openstack-tripleo-heat-templates/environments/network-isolation.yaml -e /usr/share/openstack-tripleo-heat-templates/environments/storage-environment.yaml -e /usr/share/openstack-tripleo-heat-templates/environments/neutron-sriov.yaml -e /home/stack/custom-templates/network.yaml -e /home/stack/custom-templates/ceph.yaml -e /home/stack/custom-templates/compute.yaml -e /home/stack/custom-templates/layout.yaml --stack ADN-ultram --debug --log-file overcloudDeploy_11_06_17__16_39_26.log --ntp-server 172.24.167.109 --neutron-flat-networks phys_pcie1_0,phys_pcie1_1,phys_pcie4_0,phys_pcie4_1 --neutron-network-vlan-ranges datacentre:1001:1050 --neutron-disable-tunneling --verbose --timeout 180 … Starting new HTTP connection (1): 192.200.0.1 "POST /v2/action_executions HTTP/1.1" 201 1695 HTTP POST http://192.200.0.1:8989/v2/action_executions 201 Overcloud Endpoint: http://10.1.2.5:5000/v2.0 Overcloud Deployed clean_up DeployOvercloud: END return value: 0 real 38m38.971s user 0m3.605s sys 0m0.466s

步骤5.等待openstack状态变为Complete。

[stack@director ~]$ openstack stack list +--------------------------------------+------------+-----------------+----------------------+----------------------+ | ID | Stack Name | Stack Status | Creation Time | Updated Time | +--------------------------------------+------------+-----------------+----------------------+----------------------+ | 5df68458-095d-43bd-a8c4-033e68ba79a0 | ADN-ultram | UPDATE_COMPLETE | 2017-11-02T21:30:06Z | 2017-11-06T21:40:58Z | +--------------------------------------+------------+-----------------+----------------------+----------------------+

步骤6.检查新计算节点是否处于Active状态。

[root@director ~]# nova list | grep pod2-stack-compute-4 | 5dbac94d-19b9-493e-a366-1e2e2e5e34c5 | pod2-stack-compute-4 | ACTIVE | - | Running | ctlplane=192.200.0.116 |

恢复VM

通过快照恢复实例

恢复过程:

可以使用之前步骤中拍摄的快照重新部署之前的实例。

第1步[可选]。如果没有以前的VMsnapshot可用,则连接到发送备份的OSPD节点,并将备份回其原始OSPD节点。通过sftp root@x.x.x.x,其中x.x.x.x是原始OSPD的IP。将快照文件保存在/tmp目录中。

步骤2.连接到重新部署实例的OSPD节点。

使用以下命令获取环境变量:

# source /home/stack/pod1-stackrc-Core-CPAR

步骤3.要将快照用作图像,必须将其上传到水平线。使用下一个命令执行此操作。

#glance image-create -- AAA-CPAR-Date-snapshot.qcow2 --container-format bare --disk-format qcow2 --name AAA-CPAR-Date-snapshot

这一过程从视野中看出来。

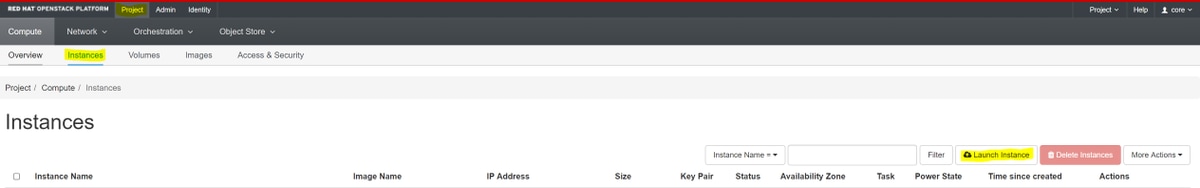

步骤4.在“水平面”中,导航到项目>实例,然后单击启动实例,如图所示。

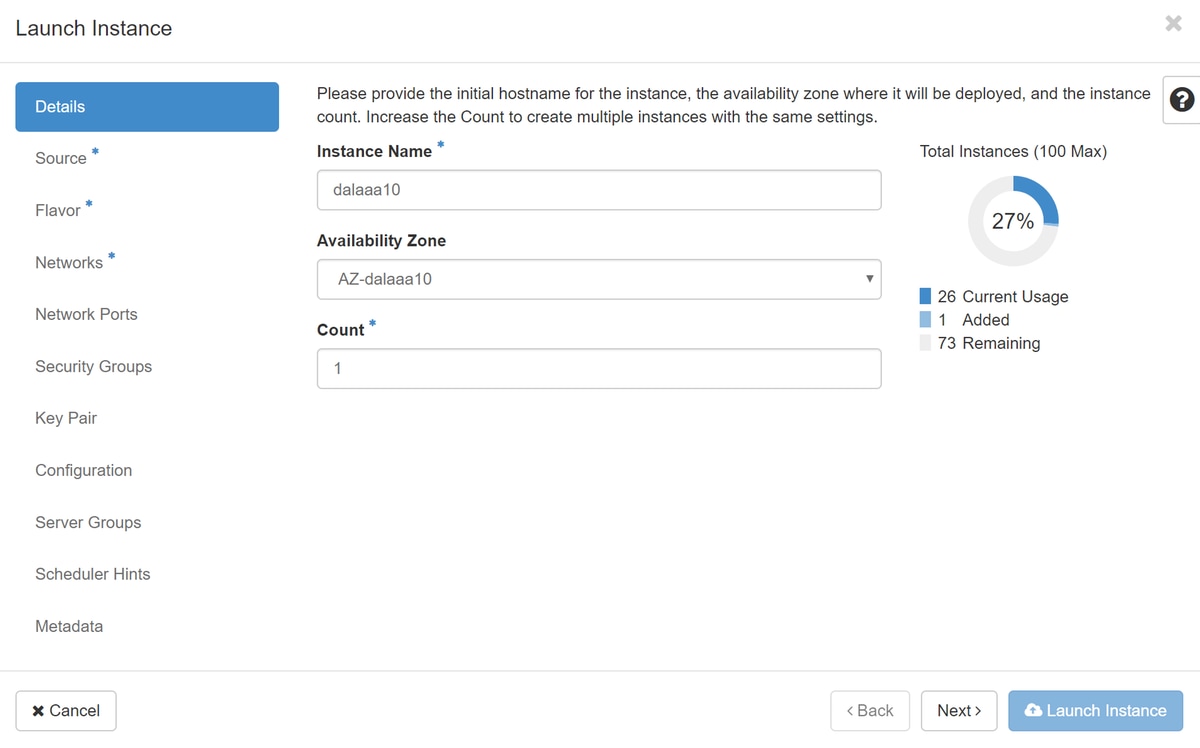

步骤5.输入实例名称并选择可用性区域,如图所示。

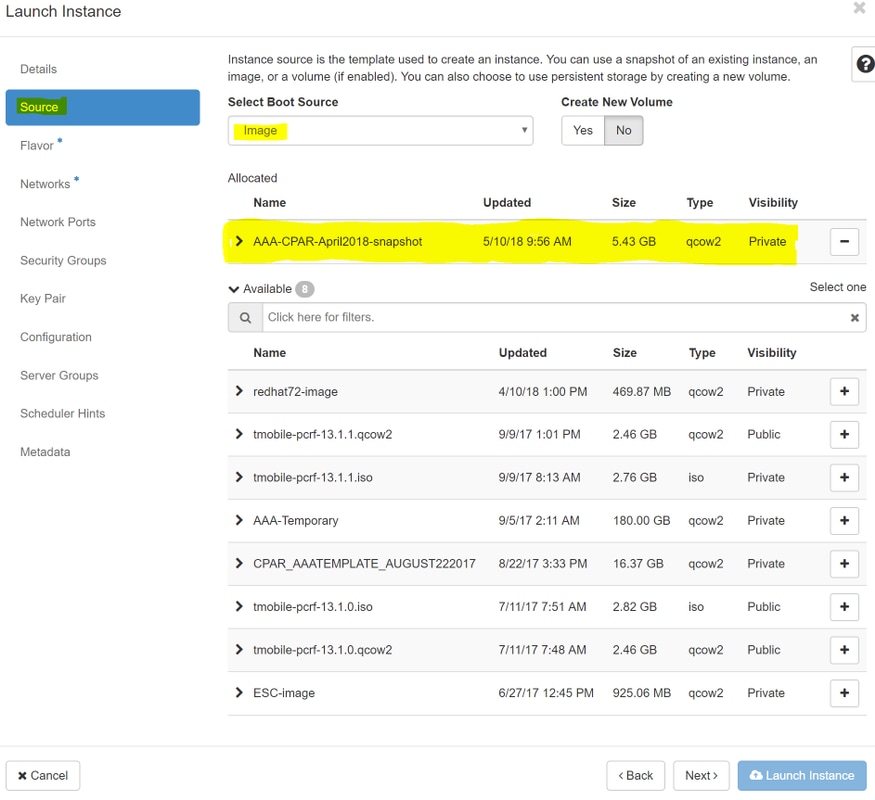

步骤6.在源选项卡中,选择要创建实例的映像。在Select Boot Source菜单中,选择image,此处显示一个映像列表,选择之前上传的映像,然后单击+sign。

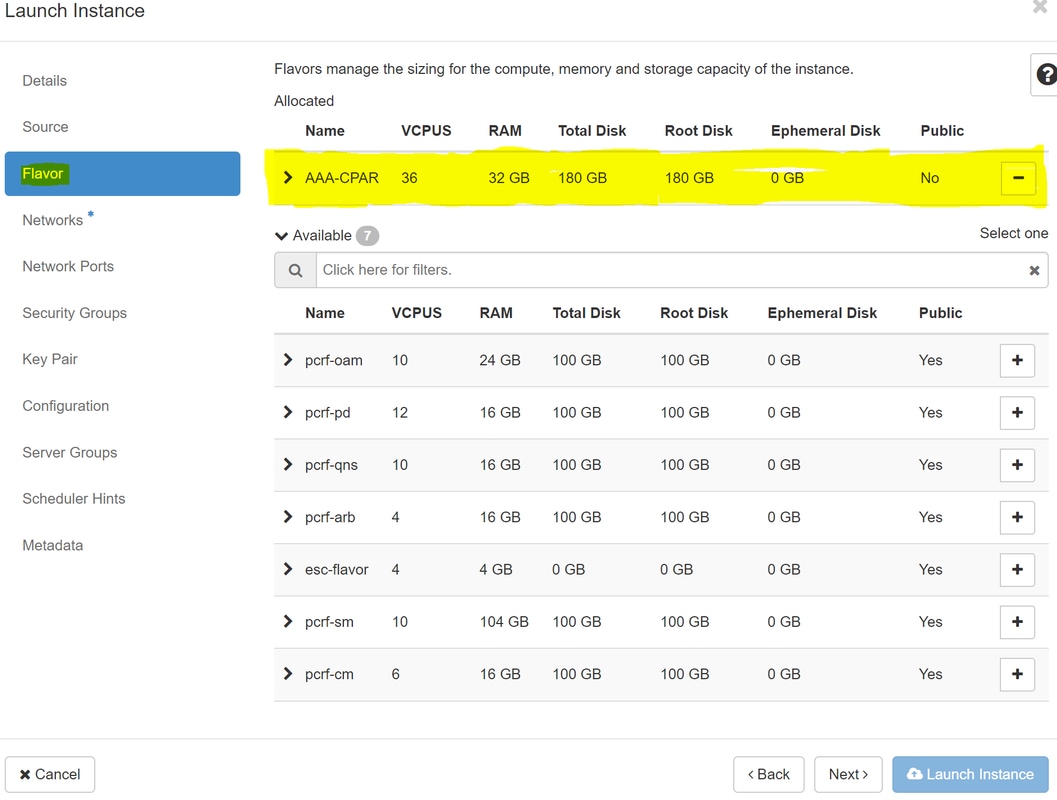

第7步:在Flavor选项卡中,单击+符号时选择AAA风格,如图所示。

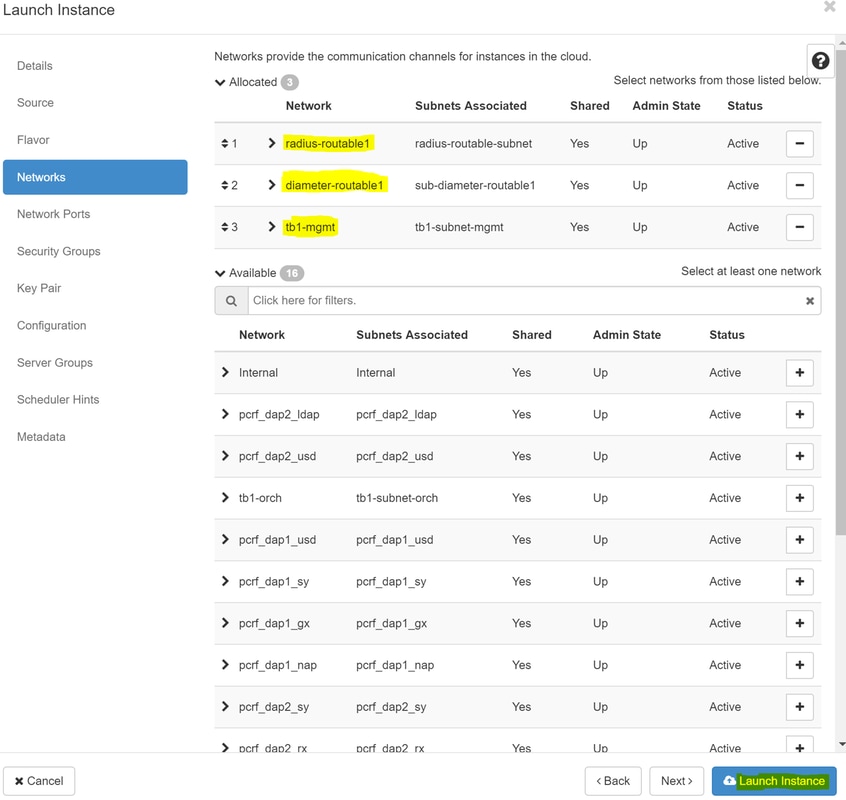

步骤8.现在导航到网络选项卡,并在点击+号时选择实例所需的网络。在这种情况下,请选择diameter-soutable1、radius-routable1和tb1-mgmt,如图所示。

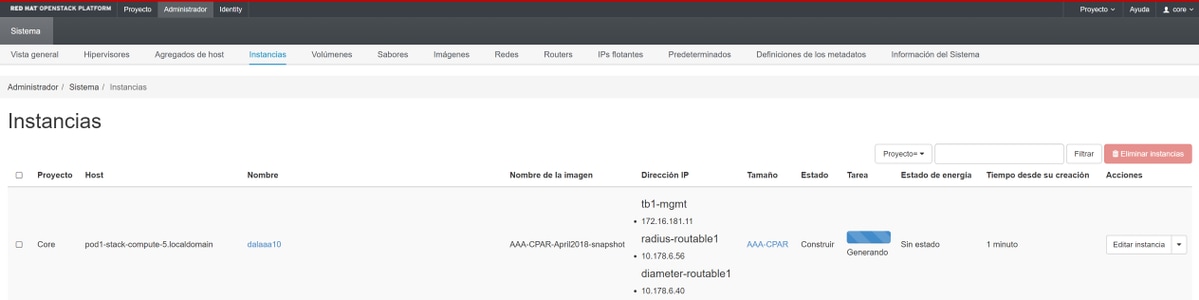

步骤9.点击Launch instance创建实例。可以在Horizon中监控进度:

几分钟后,该实例将完全部署并可供使用。

创建并分配浮动IP地址

浮动IP地址是可路由的地址,这意味着它可从Ultra M/Openstack架构的外部访问,并且能够与网络中的其他节点通信。

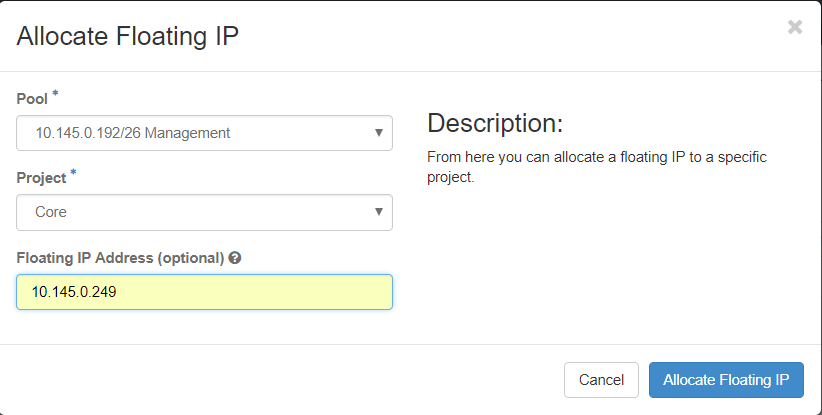

步骤1.在Horizon顶部菜单中,导航到Admin > Floating IPs。

步骤2.单击Allocate IP to Project按钮。

步骤3.在分配浮动IP窗口中,选择新浮动IP所属的池、将分配它的Project以及新的浮动IP地址。

例如:

步骤4.单击Allocate Floating IP按钮。

步骤5.在“展望期”顶部菜单中,定位至“项目”>“实例”。

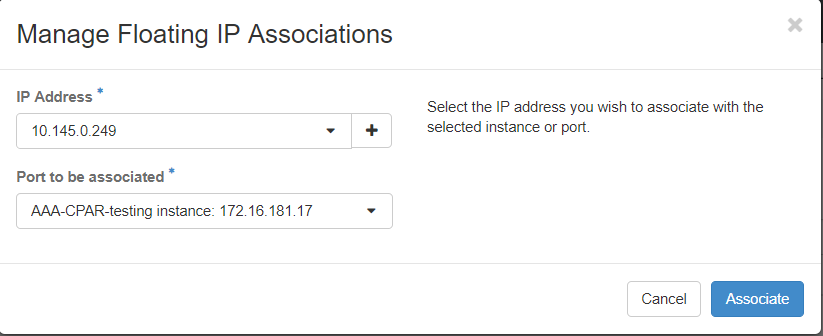

步骤6.在操作列中,单击创建快照按钮中指向下方的箭头,此时将显示菜单。选择关联浮动IP选项。

步骤7.在IP地址字段中选择要使用的相应浮动IP地址,然后从要在要关联的端口中分配此浮动IP的新实例中选择相应的管理接口(eth0)。请参考下一幅图像作为此过程的示例。

步骤8.单击Associate。

启用 SSH

步骤1.在“展望期”顶部菜单中,导航至“项目”>“实例”。

步骤2.点击在Cunch a new instance部分中创建的实例/VM的名称。

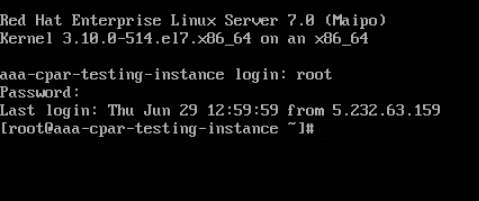

步骤3.单击Console选项卡。这将显示VM的CLI。

步骤4.显示CLI后,输入正确的登录凭证:

username:根

密码:Cisco123

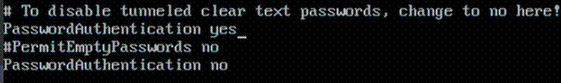

步骤5.在CLI中输入命令vi /etc/ssh/sshd_config编辑ssh配置。

步骤6.打开ssh配置文件后,按I编辑该文件。然后查找下面显示的部分,并将第一行从PasswordAuthentication no更改为PasswordAuthentication yes。

步骤7.按ESC并输入:wq!保存sshd_config文件更改。

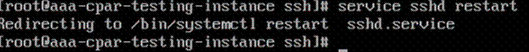

步骤8.运行命令service sshd restart。

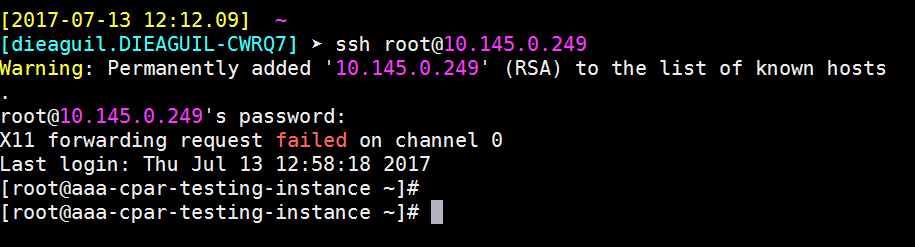

步骤9.为了测试已正确应用SSH配置更改,请打开任何SSH客户端,并尝试使用分配给实例的浮动IP(例如10.145.0.249)和用户root建立远程安全连接。

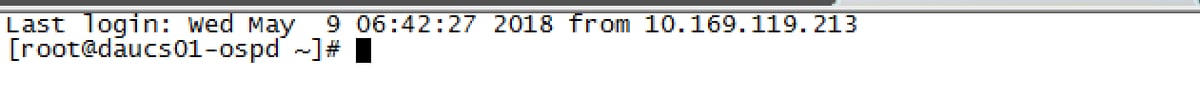

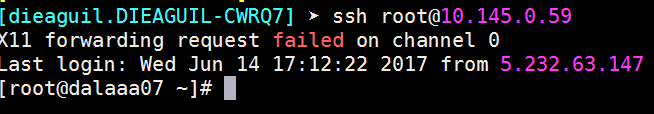

建立SSH会话

使用安装应用程序的相应VM/服务器的IP地址打开SSH会话。

CPAR实例开始

一旦完成练习,并且可以在关闭的站点中重新建立CPAR服务,请按照以下步骤操作。

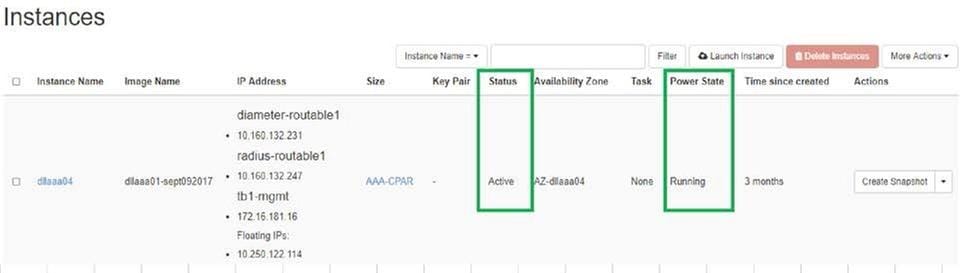

- 要重新登录到Horizon,请导航到Project > Instance > Start Instance。

- 验证实例的状态为活动且电源状态为正在运行:

活动后运行状况检查

步骤1.在操作系统级别执行命令/opt/CSCOar/bin/arstatus。

[root@wscaaa04 ~]# /opt/CSCOar/bin/arstatus Cisco Prime AR RADIUS server running (pid: 24834) Cisco Prime AR Server Agent running (pid: 24821) Cisco Prime AR MCD lock manager running (pid: 24824) Cisco Prime AR MCD server running (pid: 24833) Cisco Prime AR GUI running (pid: 24836) SNMP Master Agent running (pid: 24835) [root@wscaaa04 ~]#

步骤2.在操作系统级别执行命令/opt/CSCOar/bin/aregcmd,并输入管理员凭据。验证CPAR Health(CPAR运行状况)为10(满分10),并退出CPAR CLI。

[root@aaa02 logs]# /opt/CSCOar/bin/aregcmd

Cisco Prime Access Registrar 7.3.0.1 Configuration Utility

Copyright (C) 1995-2017 by Cisco Systems, Inc. All rights reserved.

Cluster:

User: admin

Passphrase:

Logging in to localhost

[ //localhost ]

LicenseInfo = PAR-NG-TPS 7.2(100TPS:)

PAR-ADD-TPS 7.2(2000TPS:)

PAR-RDDR-TRX 7.2()

PAR-HSS 7.2()

Radius/

Administrators/

Server 'Radius' is Running, its health is 10 out of 10

--> exit

步骤3.执行命令netstat | grep diameter并验证所有DRA连接均已建立。

下面提到的输出适用于预期存在Diameter链接的环境。如果显示的链路较少,则表示需要分析与DRA的断开连接。

[root@aa02 logs]# netstat | grep diameter tcp 0 0 aaa02.aaa.epc.:77 mp1.dra01.d:diameter ESTABLISHED tcp 0 0 aaa02.aaa.epc.:36 tsa6.dra01:diameter ESTABLISHED tcp 0 0 aaa02.aaa.epc.:47 mp2.dra01.d:diameter ESTABLISHED tcp 0 0 aaa02.aaa.epc.:07 tsa5.dra01:diameter ESTABLISHED tcp 0 0 aaa02.aaa.epc.:08 np2.dra01.d:diameter ESTABLISHED

步骤4.检查TPS日志中是否显示了CPAR正在处理的请求。突出显示的值代表了TPS,这些是需要注意的值。

TPS的值不应超过1500。

[root@wscaaa04 ~]# tail -f /opt/CSCOar/logs/tps-11-21-2017.csv 11-21-2017,23:57:35,263,0 11-21-2017,23:57:50,237,0 11-21-2017,23:58:05,237,0 11-21-2017,23:58:20,257,0 11-21-2017,23:58:35,254,0 11-21-2017,23:58:50,248,0 11-21-2017,23:59:05,272,0 11-21-2017,23:59:20,243,0 11-21-2017,23:59:35,244,0 11-21-2017,23:59:50,233,0

步骤5.在name_radius_1_log中查找任何“error”或“alarm”消息

[root@aaa02 logs]# grep -E "error|alarm" name_radius_1_log

步骤6.使用以下命令检验CPAR进程所需的内存量:

顶部 | grep radius

[root@sfraaa02 ~]# top | grep radius 27008 root 20 0 20.228g 2.413g 11408 S 128.3 7.7 1165:41 radius

此突出显示的值应低于:7Gb,这是应用级别允许的最大值。

由思科工程师提供

- 卡尔提克扬·达查纳莫蒂思科高级服务

- 哈尔希塔·巴德瓦杰思科高级服务

反馈

反馈