Ultra-M UCS 240M4 서버의 마더보드 교체 - CPAR

다운로드 옵션

편견 없는 언어

본 제품에 대한 문서 세트는 편견 없는 언어를 사용하기 위해 노력합니다. 본 설명서 세트의 목적상, 편견 없는 언어는 나이, 장애, 성별, 인종 정체성, 민족 정체성, 성적 지향성, 사회 경제적 지위 및 교차성에 기초한 차별을 의미하지 않는 언어로 정의됩니다. 제품 소프트웨어의 사용자 인터페이스에서 하드코딩된 언어, RFP 설명서에 기초한 언어 또는 참조된 서드파티 제품에서 사용하는 언어로 인해 설명서에 예외가 있을 수 있습니다. 시스코에서 어떤 방식으로 포용적인 언어를 사용하고 있는지 자세히 알아보세요.

이 번역에 관하여

Cisco는 전 세계 사용자에게 다양한 언어로 지원 콘텐츠를 제공하기 위해 기계 번역 기술과 수작업 번역을 병행하여 이 문서를 번역했습니다. 아무리 품질이 높은 기계 번역이라도 전문 번역가의 번역 결과물만큼 정확하지는 않습니다. Cisco Systems, Inc.는 이 같은 번역에 대해 어떠한 책임도 지지 않으며 항상 원본 영문 문서(링크 제공됨)를 참조할 것을 권장합니다.

목차

소개

이 문서에서는 Ultra-M 설정에서 서버의 결함이 있는 마더보드를 교체하는 데 필요한 단계를 설명합니다.

이 절차는 ESC가 CPAR을 관리하지 않고 CPAR이 Openstack에 구축된 VM에 직접 설치되는 NEWTON 버전을 사용하는 Openstack 환경에 적용됩니다.

배경 정보

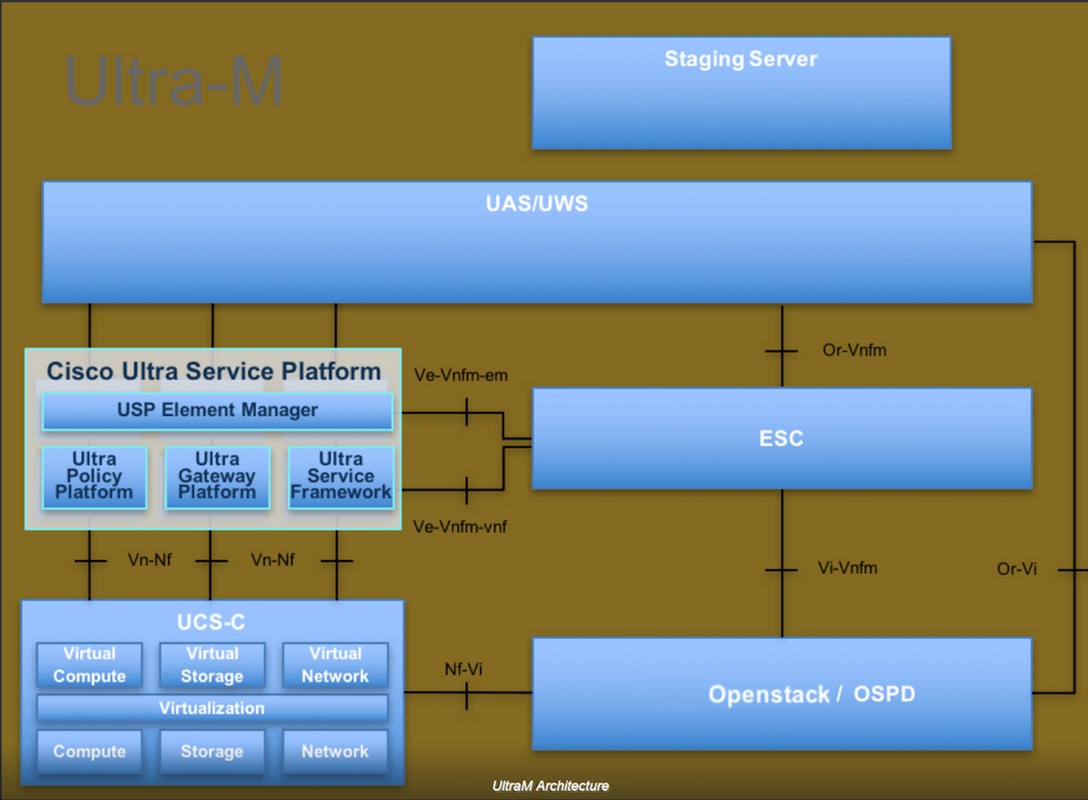

Ultra-M은 VNF의 구축을 간소화하기 위해 설계된, 사전 패키징되고 검증된 가상화된 모바일 패킷 코어 솔루션입니다. OpenStack은 Ultra-M용 VIM(Virtualized Infrastructure Manager)이며 다음 노드 유형으로 구성됩니다.

- 컴퓨팅

- 개체 스토리지 디스크 - 컴퓨팅(OSD - 컴퓨팅)

- 컨트롤러

- OpenStack 플랫폼 - 디렉터(OSPD)

이 그림에는 Ultra-M의 고급 아키텍처와 관련 구성 요소가 나와 있습니다.

이 문서는 Cisco Ultra-M 플랫폼에 대해 잘 알고 있는 Cisco 직원을 대상으로 하며 OpenStack 및 Redhat OS에서 수행해야 하는 단계에 대해 자세히 설명합니다.

참고: 이 문서의 절차를 정의하기 위해 Ultra M 5.1.x 릴리스가 고려됩니다.

약어

| 자루걸레 | 절차 방법 |

| OSD | 개체 스토리지 디스크 |

| OSPD | OpenStack 플랫폼 디렉터 |

| HDD | 하드 디스크 드라이브 |

| SSD | SSD(Solid State Drive) |

| 빔 | 가상 인프라 관리자 |

| VM | 가상 머신 |

| 엠 | 요소 관리자 |

| UAS | Ultra Automation 서비스 |

| UUID | 보편적으로 고유한 식별자 |

MoP의 워크플로

Ultra-M 설정에서 마더보드 교체

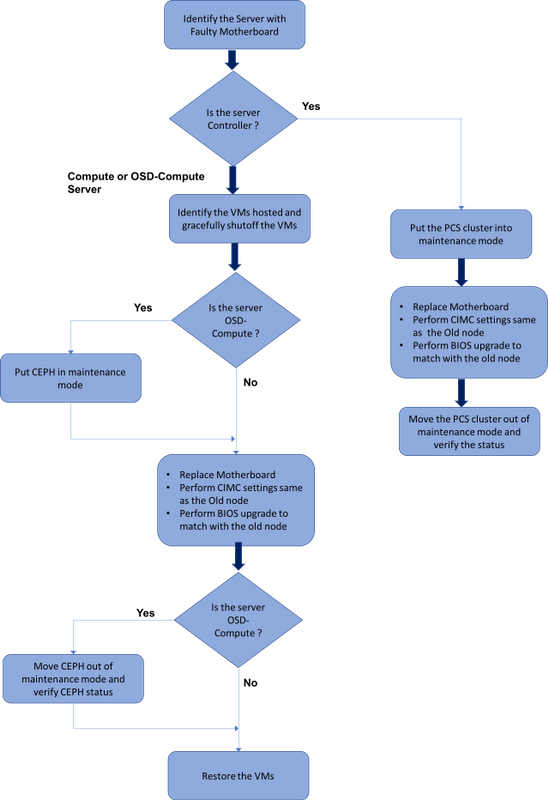

Ultra-M 설정에서는 다음 서버 유형에서 마더보드 교체가 필요한 경우가 있습니다. 컴퓨팅, OSD-컴퓨팅 및 컨트롤러.

참고: 마더보드를 교체한 후 openstack이 설치된 부팅 디스크를 교체합니다. 따라서 노드를 오버클라우드에 다시 추가할 필요가 없습니다. 교체 작업 후 서버의 전원이 켜지면 다시 오버클라우드 스택에 등록됩니다.

사전 요구 사항

컴퓨팅 노드를 교체하기 전에 Red Hat OpenStack Platform 환경의 현재 상태를 확인하는 것이 중요합니다. 컴퓨팅 교체 프로세스가 켜져 있을 때 복잡성을 피하기 위해 현재 상태를 확인하는 것이 좋습니다. 이러한 교체 흐름으로 달성할 수 있습니다.

복구의 경우 다음 단계를 사용하여 OSPD 데이터베이스를 백업하는 것이 좋습니다.

[root@director ~]# mysqldump --opt --all-databases > /root/undercloud-all-databases.sql [root@director ~]# tar --xattrs -czf undercloud-backup-`date +%F`.tar.gz /root/undercloud-all-databases.sql /etc/my.cnf.d/server.cnf /var/lib/glance/images /srv/node /home/stack tar: Removing leading `/' from member names

이 프로세스를 통해 인스턴스의 가용성에 영향을 주지 않고 노드를 교체할 수 있습니다.

참고: 필요한 경우 VM을 복원할 수 있도록 인스턴스의 스냅샷이 있어야 합니다. VM의 스냅샷을 생성하는 방법에 대해 이 절차를 수행합니다.

컴퓨팅 노드의 마더보드 교체

활동 전에 컴퓨팅 노드에 호스트된 VM이 정상적으로 종료됩니다. 마더보드를 교체하면 VM이 다시 복원됩니다.

컴퓨팅 노드에서 호스팅되는 VM 식별

[stack@al03-pod2-ospd ~]$ nova list --field name,host +--------------------------------------+---------------------------+----------------------------------+ | ID | Name | Host | +--------------------------------------+---------------------------+----------------------------------+ | 46b4b9eb-a1a6-425d-b886-a0ba760e6114 | AAA-CPAR-testing-instance | pod2-stack-compute-4.localdomain | | 3bc14173-876b-4d56-88e7-b890d67a4122 | aaa2-21 | pod2-stack-compute-3.localdomain | | f404f6ad-34c8-4a5f-a757-14c8ed7fa30e | aaa21june | pod2-stack-compute-3.localdomain | +--------------------------------------+---------------------------+----------------------------------+

참고: 여기에 표시된 출력에서 첫 번째 열은 UUID(Universally Unique IDentifier)에 해당하고, 두 번째 열은 VM 이름이며, 세 번째 열은 VM이 있는 호스트 이름입니다. 이 출력의 매개변수는 후속 섹션에서 사용됩니다.

백업: 스냅샷 프로세스

1단계. CPAR 애플리케이션 종료

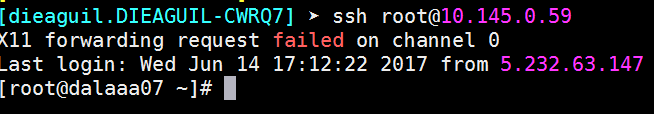

1단계. 네트워크에 연결된 ssh 클라이언트를 열고 CPAR 인스턴스에 연결합니다.

한 사이트 내에 있는 4개의 AAA 인스턴스를 모두 동시에 종료하지 않고, 하나씩 차례로 수행하는 것이 중요합니다.

2단계.다음 명령을 사용하여 CPAR 애플리케이션을 종료합니다.

/opt/CSCOar/bin/arserver stop A Message stating “Cisco Prime Access Registrar Server Agent shutdown complete.” Should show up

사용자가 CLI 세션을 열어 둔 경우 arserver stop 명령이 작동하지 않으며 다음 메시지가 표시됩니다.

ERROR: You can not shut down Cisco Prime Access Registrar while the CLI is being used. Current list of running CLI with process id is: 2903 /opt/CSCOar/bin/aregcmd –s

이 예에서, 하이라이트된 프로세스 ID(2903)는 CPAR이 중단될 수 있기 전에 종료될 필요가 있다. 이 경우 다음 명령을 사용하여 이 프로세스를 종료하십시오.

kill -9 *process_id*

그런 다음 1단계를 반복합니다.

3단계.다음 명령을 실행하여 CPAR 애플리케이션이 실제로 종료되었는지 확인합니다.

/opt/CSCOar/bin/arstatus

다음 메시지가 표시되어야 합니다.

Cisco Prime Access Registrar Server Agent not running Cisco Prime Access Registrar GUI not running

VM 스냅샷 작업

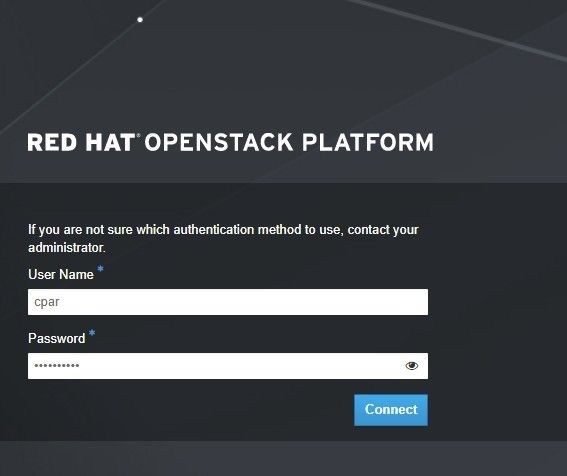

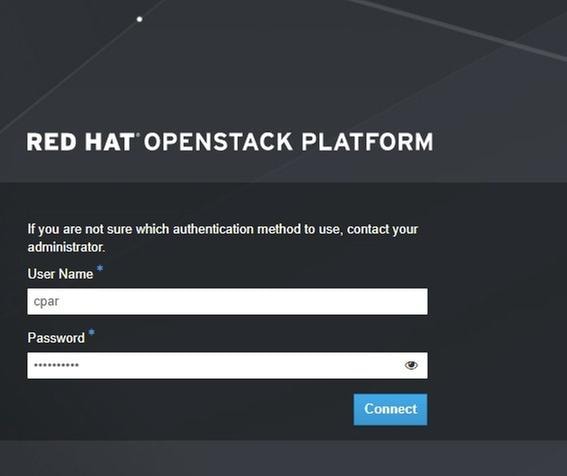

1단계.현재 작업 중인 사이트(도시)에 해당하는 Horizon GUI 웹 사이트를 입력합니다.

Horizon에 액세스하면 다음 화면이 표시됩니다.

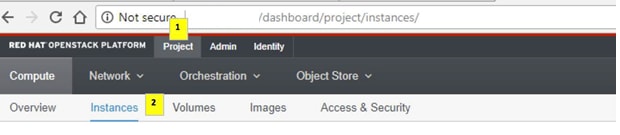

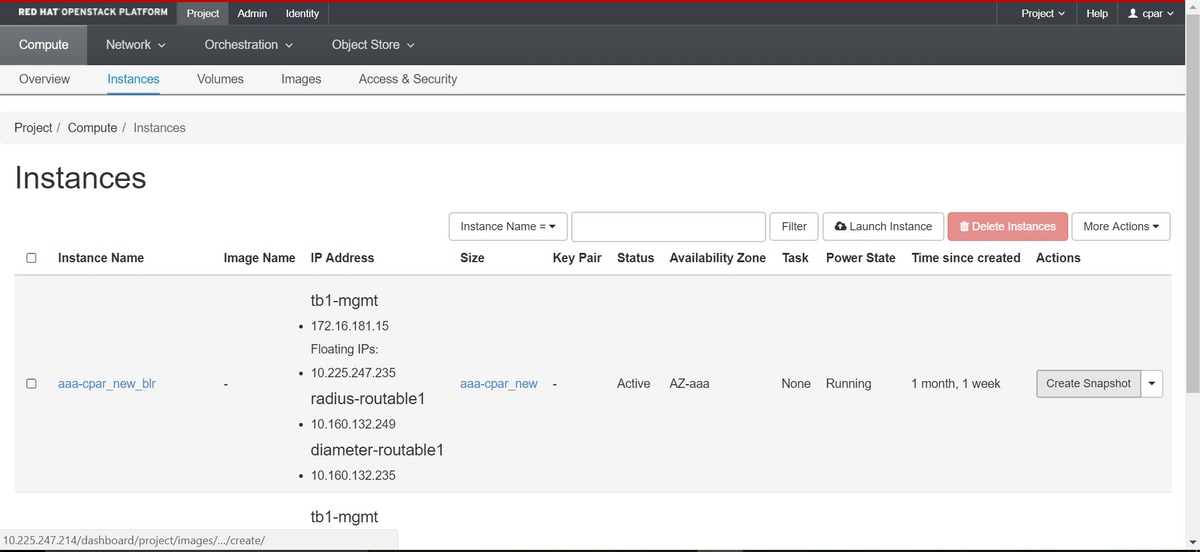

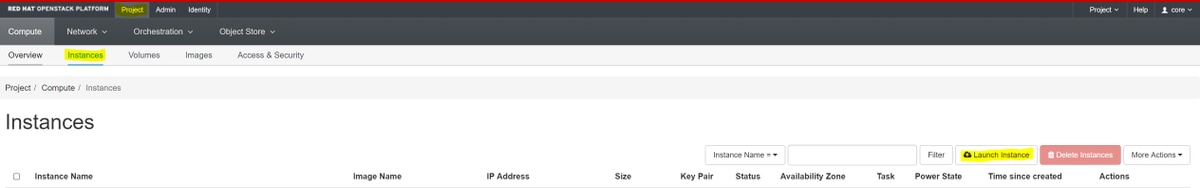

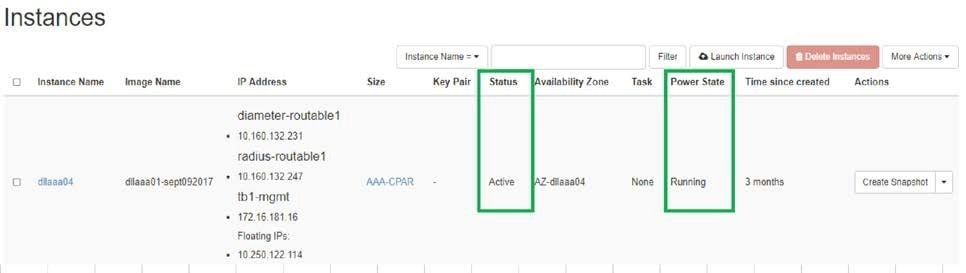

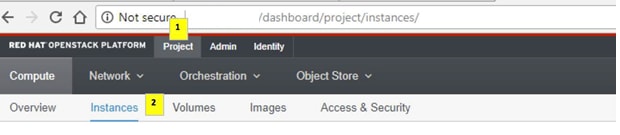

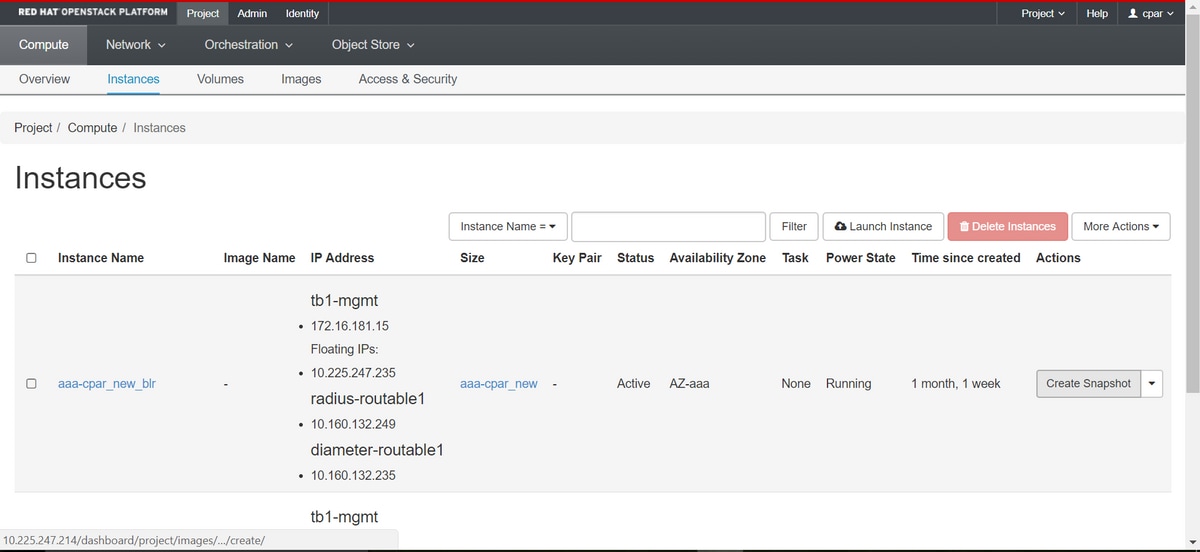

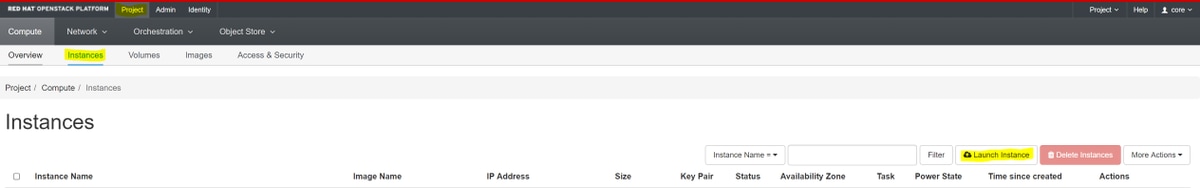

2단계.이미지에 표시된 대로 Project(프로젝트) > Instances(인스턴스)로 이동합니다.

사용한 사용자가 CPAR인 경우 이 메뉴에는 4개의 AAA 인스턴스만 표시됩니다.

3단계.한 번에 하나의 인스턴스만 종료하십시오. 이 문서의 전체 프로세스를 반복하십시오.

VM을 종료하려면 Actions(작업) > Shut Off Instance(인스턴스 종료)로 이동하여 선택 사항을 확인합니다.

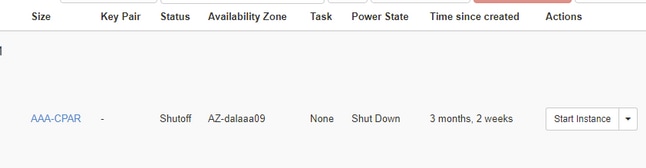

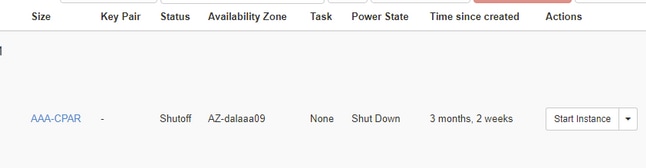

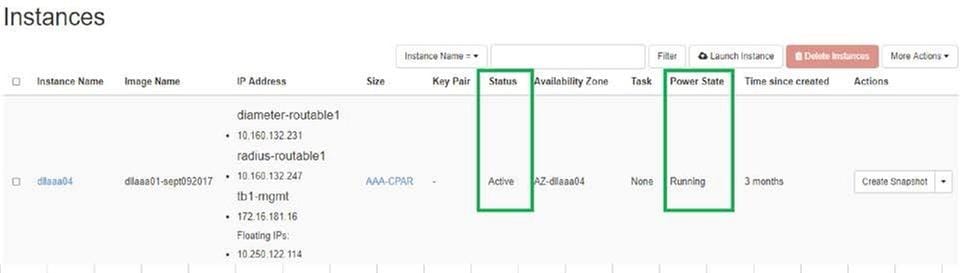

4단계.Status(상태) = Shutoff(차단) 및 Power State(전력 상태) = Shut Down(종료)을 선택하여 인스턴스가 실제로 종료되었는지 확인합니다.

이 단계에서는 CPAR 종료 프로세스를 종료합니다.

VM 스냅샷

CPAR VM이 다운되면 독립 컴퓨터에 속하므로 스냅샷을 병렬로 만들 수 있습니다.

4개의 QCOW2 파일이 병렬로 생성됩니다.

각 AAA 인스턴스의 스냅샷 생성(25분 -1시간)(qcow 이미지를 소스로 사용한 인스턴스는 25분, 원시 이미지를 소스로 사용한 인스턴스는 1시간)

1단계. POD의 Openstack에 로그인GUI.

2단계. 로그인했으면 상단 메뉴의 Project > Compute > Instances 섹션으로 이동하여 AAA 인스턴스를 찾습니다.

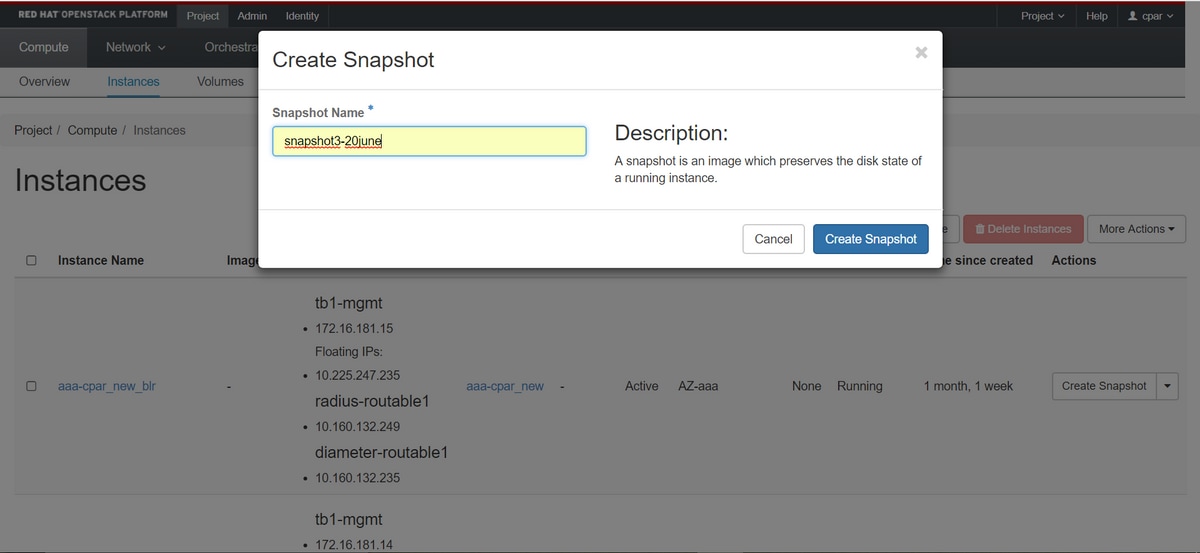

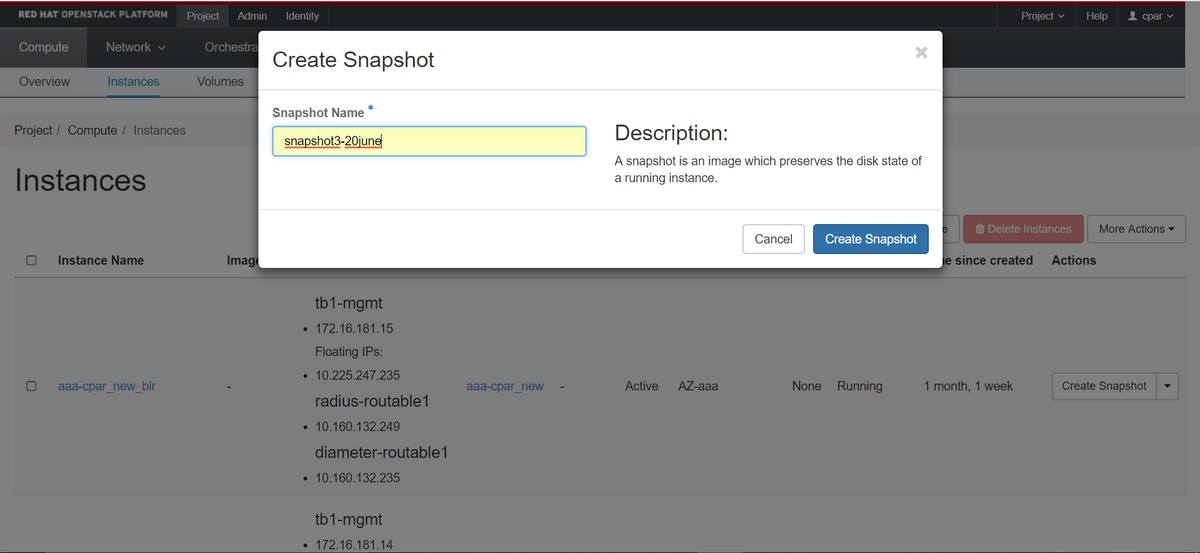

3단계. 스냅샷 생성을 계속하려면 Create Snapshot(스냅샷 생성) 버튼을 클릭합니다(해당 AAA 인스턴스에서 실행되어야 함).

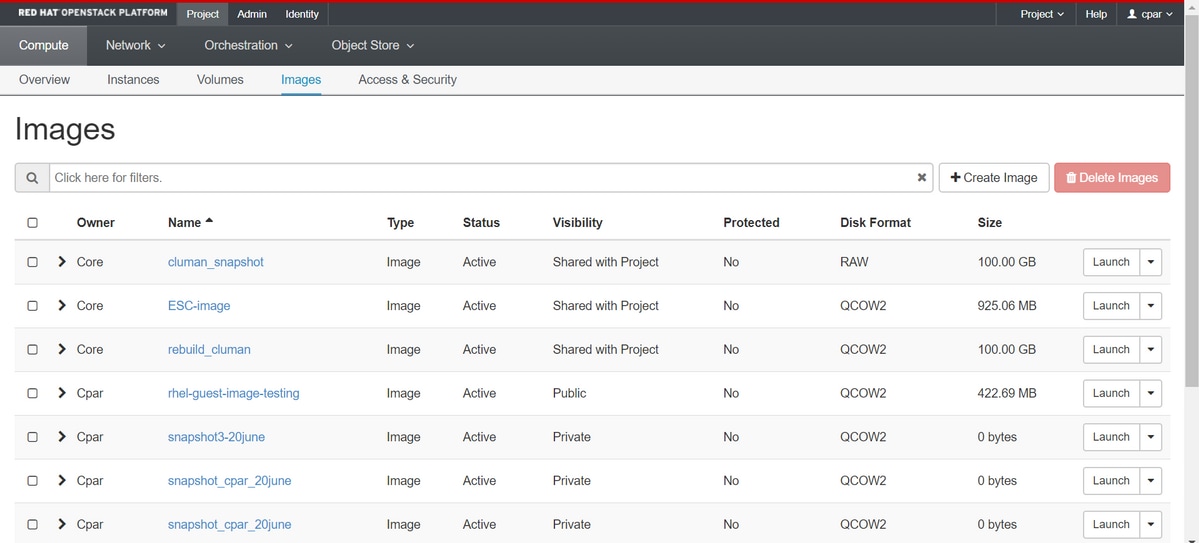

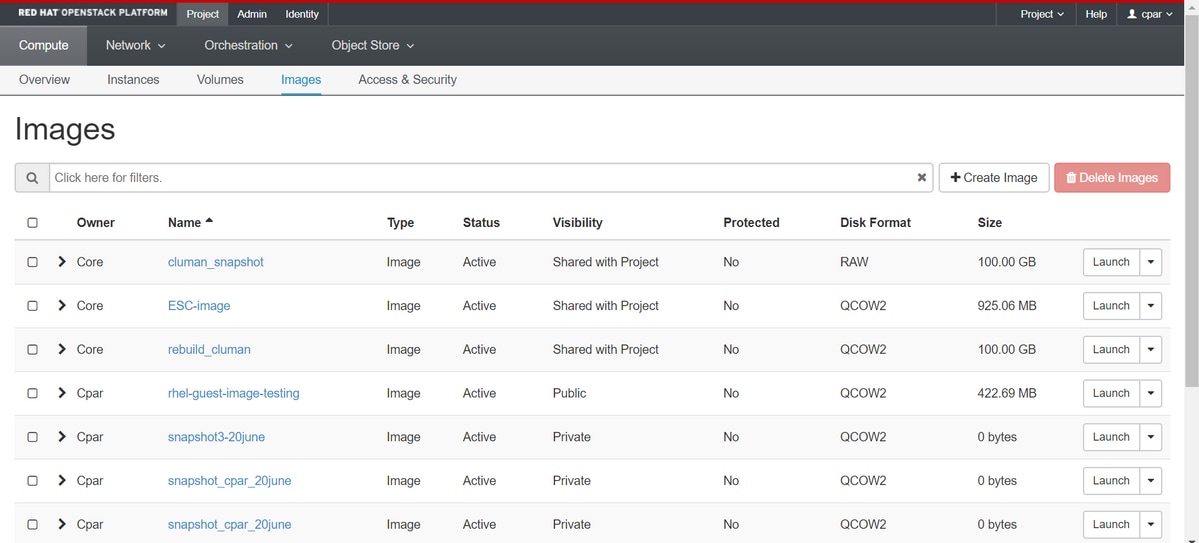

4단계. 스냅샷이 실행되면 IMAGES(이미지) 메뉴로 이동하여 모든 작업이 완료되었는지 확인하고 문제가 없음을 보고합니다.

5단계. 다음 단계는 이 프로세스 중에 OSPD가 손실될 경우 QCOW2 형식으로 스냅샷을 다운로드하고 원격 엔티티로 전송하는 것입니다. 이를 위해 OSPD 레벨에서 이 명령 glance image-list를 사용하여 스냅샷을 식별합니다.

[root@elospd01 stack]# glance image-list +--------------------------------------+---------------------------+ | ID | Name | +--------------------------------------+---------------------------+ | 80f083cb-66f9-4fcf-8b8a-7d8965e47b1d | AAA-Temporary | | 22f8536b-3f3c-4bcc-ae1a-8f2ab0d8b950 | ELP1 cluman 10_09_2017 | | 70ef5911-208e-4cac-93e2-6fe9033db560 | ELP2 cluman 10_09_2017 | | e0b57fc9-e5c3-4b51-8b94-56cbccdf5401 | ESC-image | | 92dfe18c-df35-4aa9-8c52-9c663d3f839b | lgnaaa01-sept102017 | | 1461226b-4362-428b-bc90-0a98cbf33500 | tmobile-pcrf-13.1.1.iso | | 98275e15-37cf-4681-9bcc-d6ba18947d7b | tmobile-pcrf-13.1.1.qcow2 | +--------------------------------------+---------------------------+

6단계. 다운로드할 스냅샷을 식별한 경우(이 경우 녹색으로 표시된 스냅샷임), 여기 표시된 것처럼 glance image-download 명령을 사용하여 QCOW2 형식으로 다운로드합니다.

[root@elospd01 stack]# glance image-download 92dfe18c-df35-4aa9-8c52-9c663d3f839b --file /tmp/AAA-CPAR-LGNoct192017.qcow2 &

- "&"가 프로세스를 백그라운드로 전송합니다. 이 작업을 완료하는 데 시간이 조금 걸립니다. 작업이 완료되면 이미지가 /tmp 디렉토리에 위치할 수 있습니다.

- 프로세스를 백그라운드로 전송할 때 연결이 끊기면 프로세스도 중지됩니다.

- SSH 연결이 끊긴 경우 프로세스가 계속 실행되고 OSPD에서 종료되도록 "disown -h" 명령을 실행합니다.

7단계. 다운로드 프로세스가 완료되면 운영 체제에서 처리하는 프로세스, 작업 및 임시 파일로 인해 스냅샷이 0으로 채워질 수 있으므로 압축 프로세스를 실행해야 합니다. 파일 압축에 사용할 명령은 virt-sparsify입니다.

[root@elospd01 stack]# virt-sparsify AAA-CPAR-LGNoct192017.qcow2 AAA-CPAR-LGNoct192017_compressed.qcow2

이 프로세스에는 약간의 시간(약 10-15분)이 소요됩니다. 완료되면 결과 파일은 다음 단계에서 지정한 대로 외부 엔티티로 전송해야 하는 파일입니다.

파일 무결성을 검증하려면 다음 명령을 실행하고 출력 끝에 있는 "corrupt" 특성을 찾아야 합니다.

[root@wsospd01 tmp]# qemu-img info AAA-CPAR-LGNoct192017_compressed.qcow2 image: AAA-CPAR-LGNoct192017_compressed.qcow2 file format: qcow2 virtual size: 150G (161061273600 bytes) disk size: 18G cluster_size: 65536 Format specific information: compat: 1.1 lazy refcounts: false refcount bits: 16 corrupt: false

OSPD가 손실되는 문제를 방지하기 위해 최근에 생성된 QCOW2 형식의 스냅샷을 외부 엔터티로 전송해야 합니다. 파일 전송을 시작하기 전에 대상에 사용 가능한 디스크 공간이 충분한지 확인해야 합니다. "df -kh" 명령을 사용하여 메모리 공간을 확인합니다. x.x.x.x는 원격 OSPD의 IP인 SFTP "sftproot@x.x.x.x"을 사용하여 다른 사이트의 OSPD로 임시로 전송하는 것이 좋습니다. 전송 속도를 높이기 위해 대상을 여러 OSPD로 전송할 수 있습니다. 같은 방법으로 scp *name_of_the_file*.qcow2 root@ x.x.x.x:/tmp 명령을 사용하여 파일을 다른 OSPD로 전송할 수 있습니다(여기서 x.x.x.x.x는 원격 OSPD의 IP).

정상 전원 끄기

노드 전원 끄기

- 인스턴스 전원을 끄려면 nova stop <INSTANCE_NAME>

- 이제 상태 차단과 함께 인스턴스 이름이 표시됩니다.

[stack@director ~]$ nova stop aaa2-21 Request to stop server aaa2-21 has been accepted. [stack@director ~]$ nova list +--------------------------------------+---------------------------+---------+------------+-------------+------------------------------------------------------------------------------------------------------------+ | ID | Name | Status | Task State | Power State | Networks | +--------------------------------------+---------------------------+---------+------------+-------------+------------------------------------------------------------------------------------------------------------+ | 46b4b9eb-a1a6-425d-b886-a0ba760e6114 | AAA-CPAR-testing-instance | ACTIVE | - | Running | tb1-mgmt=172.16.181.14, 10.225.247.233; radius-routable1=10.160.132.245; diameter-routable1=10.160.132.231 | | 3bc14173-876b-4d56-88e7-b890d67a4122 | aaa2-21 | SHUTOFF | - | Shutdown | diameter-routable1=10.160.132.230; radius-routable1=10.160.132.248; tb1-mgmt=172.16.181.7, 10.225.247.234 | | f404f6ad-34c8-4a5f-a757-14c8ed7fa30e | aaa21june | ACTIVE | - | Running | diameter-routable1=10.160.132.233; radius-routable1=10.160.132.244; tb1-mgmt=172.16.181.10 | +--------------------------------------+---------------------------+---------+------------+-------------+------------------------------------------------------------------------------------------------------------+

마더보드 교체

UCS C240 M4 서버에서 마더보드를 교체하는 절차는 Cisco UCS C240 M4 Server Installation and Service Guide에서 참조할 수 있습니다

- CIMC IP를 사용하여 서버에 로그인합니다.

- 펌웨어가 이전에 사용한 권장 버전에 따라 다르면 BIOS 업그레이드를 수행합니다. BIOS 업그레이드 단계는 다음과 같습니다. Cisco UCS C-Series Rack-Mount Server BIOS 업그레이드 가이드

VM 복원

스냅샷을 통해 인스턴스 복구

복구 프로세스

이전 단계에서 생성한 스냅샷으로 이전 인스턴스를 재구축할 수 있습니다.

1단계[선택 사항].사용 가능한 이전 VMsnapshot이 없으면 백업이 전송된 OSPD 노드에 연결하고 백업을 원래 OSPD 노드로 다시 sftp합니다. 여기서 x.x.x.x는 원래 OSPD의 IP인 "sftproot@x.x.x.x"를 사용합니다. 스냅샷 파일을 /tmp 디렉토리에 저장합니다.

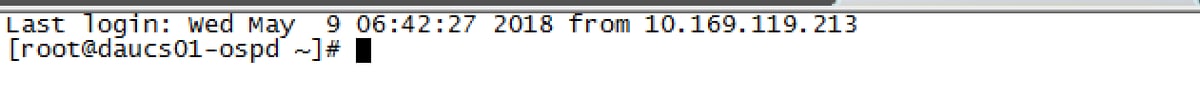

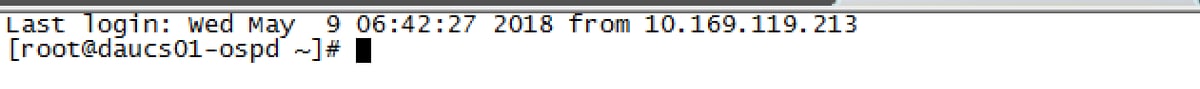

2단계.인스턴스가 재배포되는 OSPD 노드에 연결합니다.

다음 명령으로 환경 변수를 소싱합니다.

다음 명령으로 환경 변수를 소싱합니다.

# source /home/stack/pod1-stackrc-Core-CPAR

3단계.스냅샷을 이미지로 사용하려면 이미지를 지평선에 업로드해야 합니다. 다음 명령을 사용하여 이 작업을 수행합니다.

#glance image-create -- AAA-CPAR-Date-snapshot.qcow2 --container-format bare --disk-format qcow2 --name AAA-CPAR-Date-snapshot

그 과정을 곧 볼 수 있다.

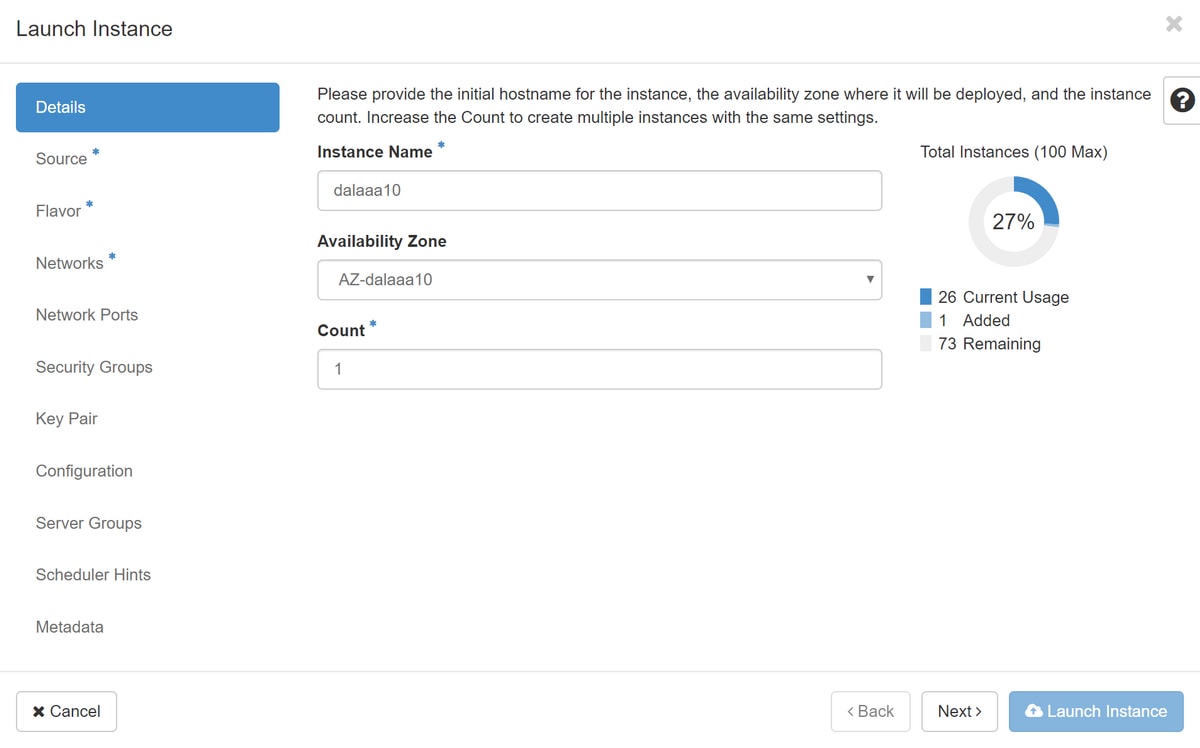

4단계.Horizon에서 Project(프로젝트) > Instances(인스턴스)로 이동하고 Launch Instance(인스턴스 실행)를 클릭합니다.

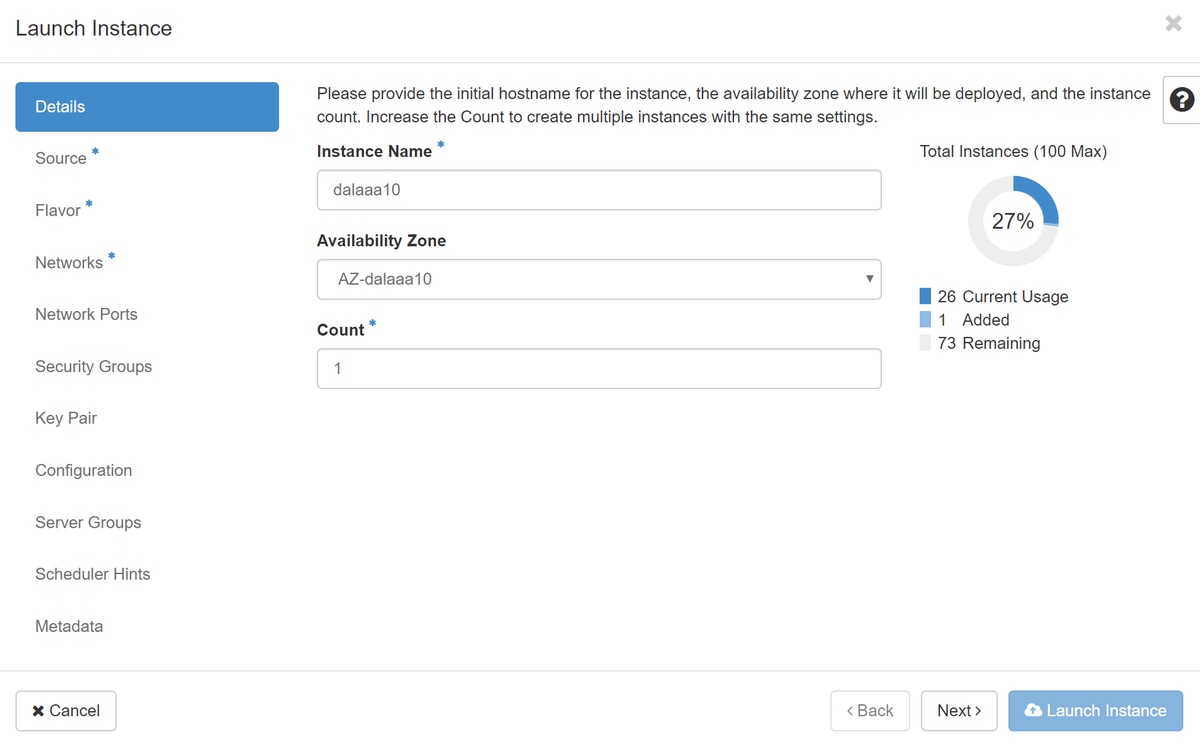

5단계.인스턴스 이름을 입력하고 가용 영역을 선택합니다.

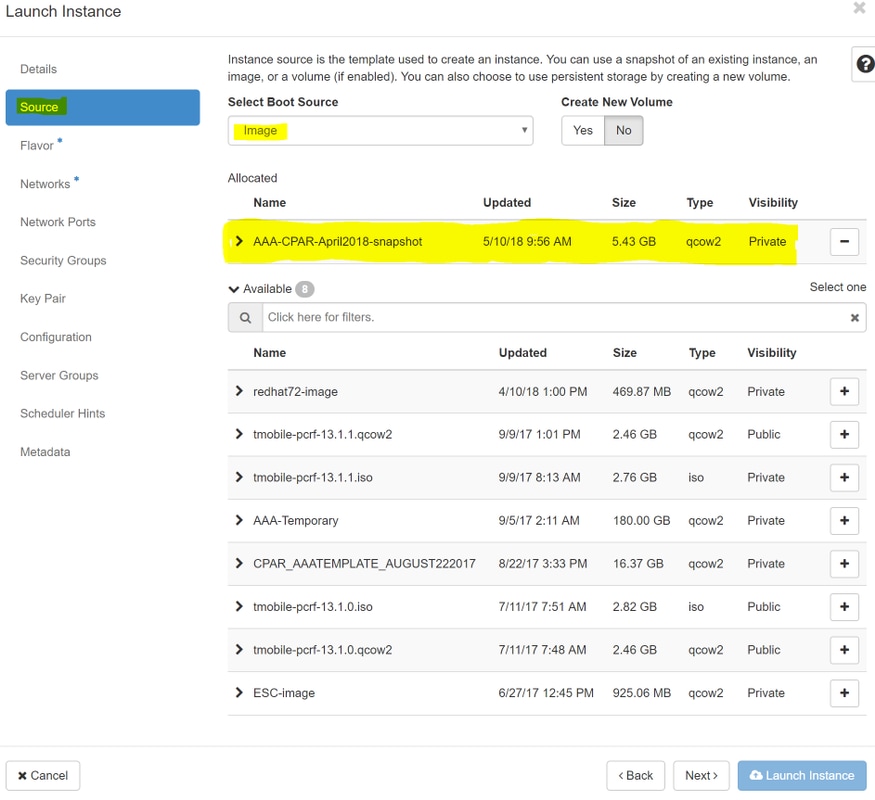

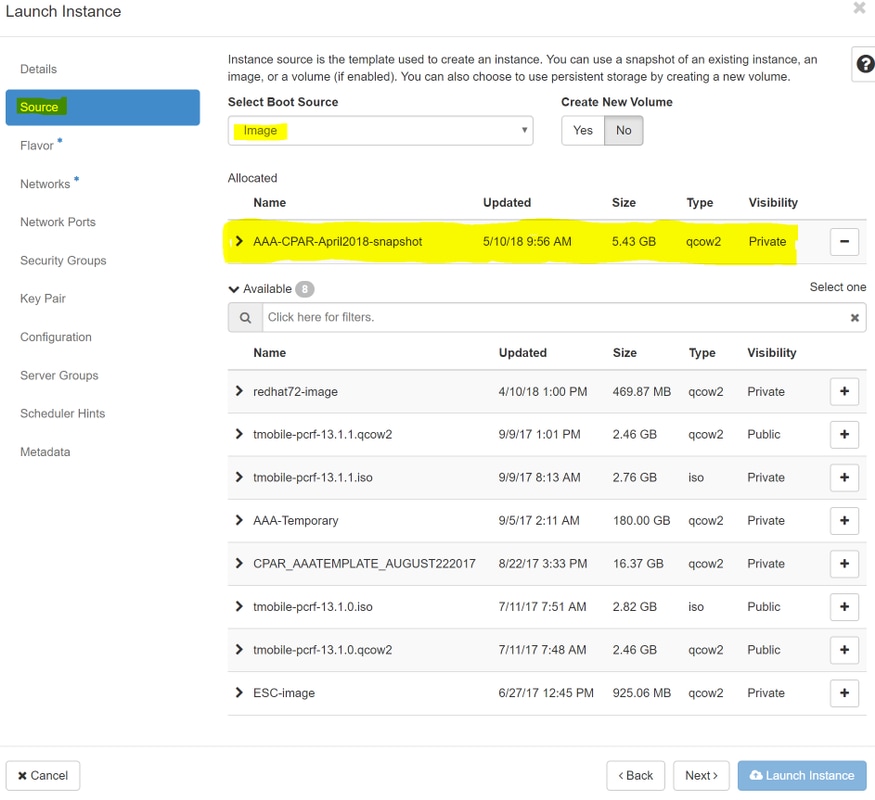

6단계.소스 탭에서 인스턴스를 생성할 이미지를 선택합니다. Select Boot Source(부트 소스 선택) 메뉴 이미지의 여기에 이미지 목록이 표시됩니다. + 기호를 클릭할 때 이전에 업로드한 이미지를 선택합니다.

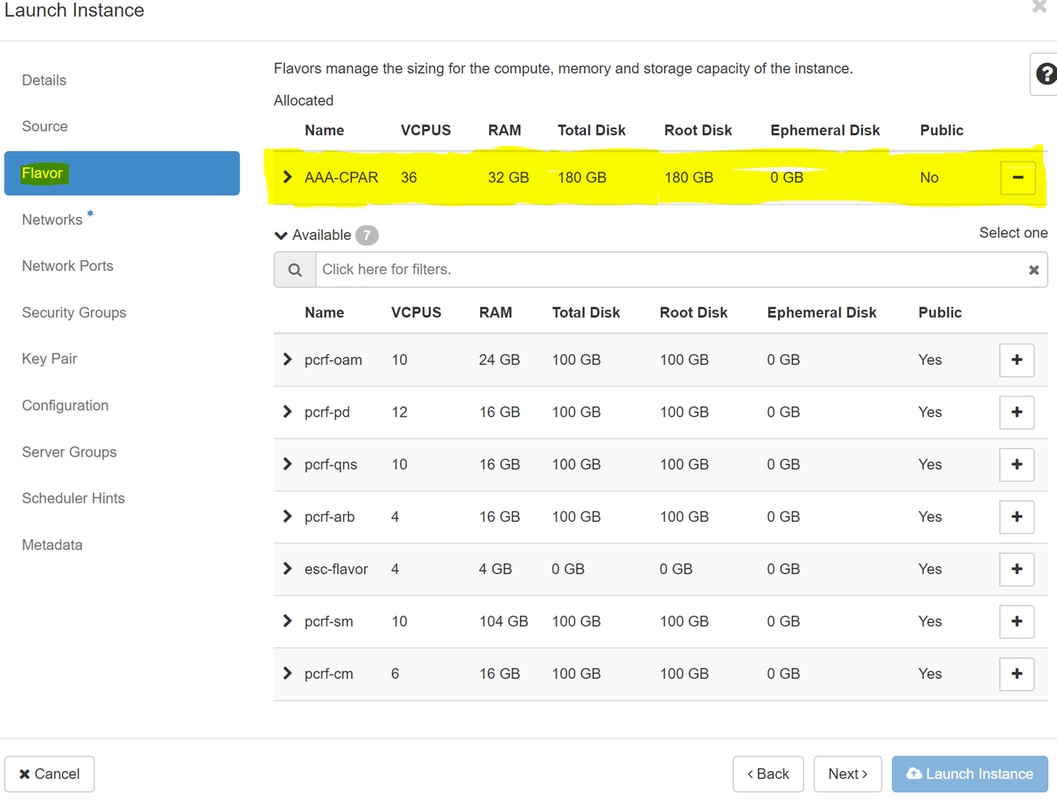

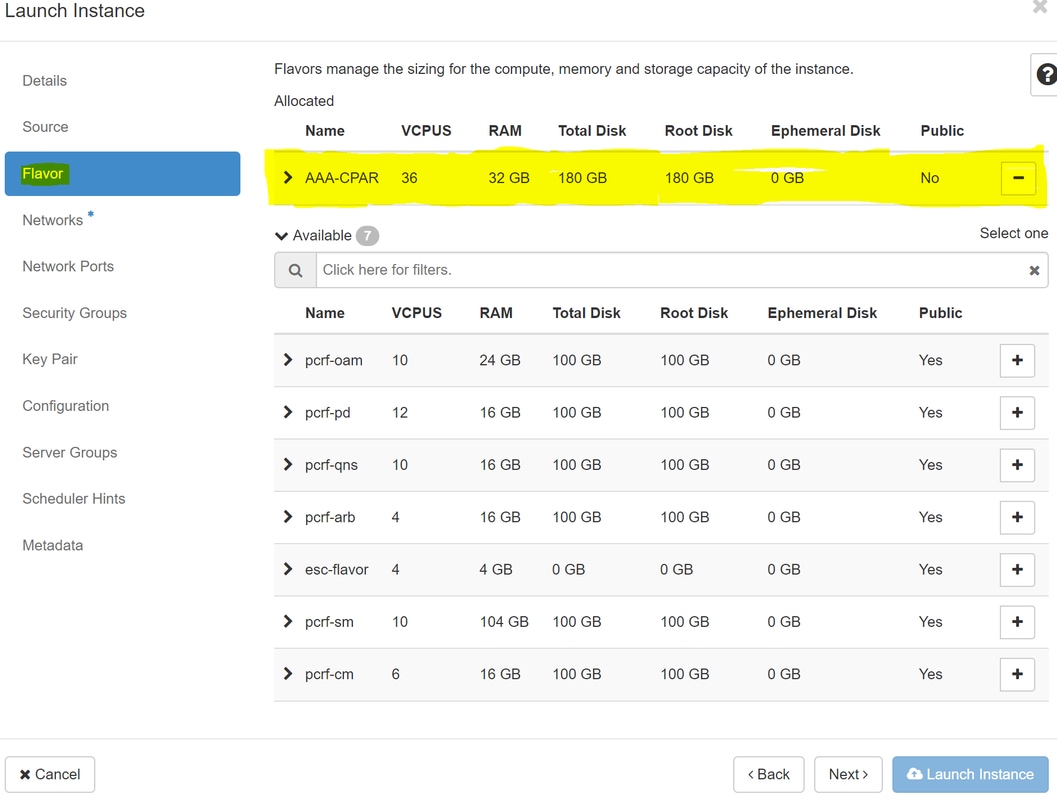

7단계.Flavor(풍미) 탭에서 + 기호를 클릭할 때 AAA 풍미를 선택합니다.

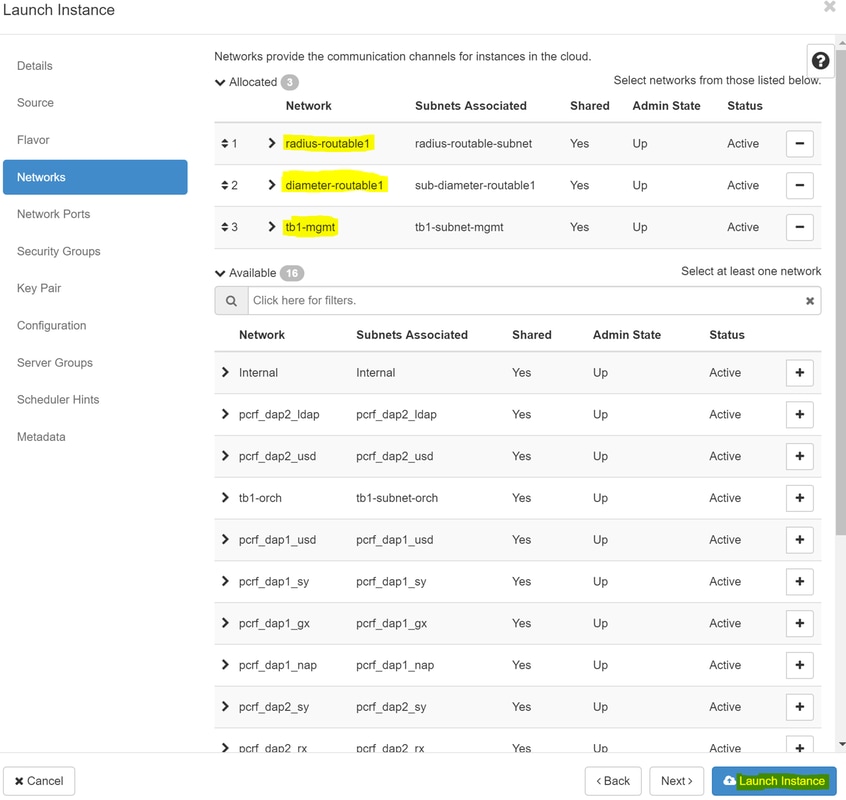

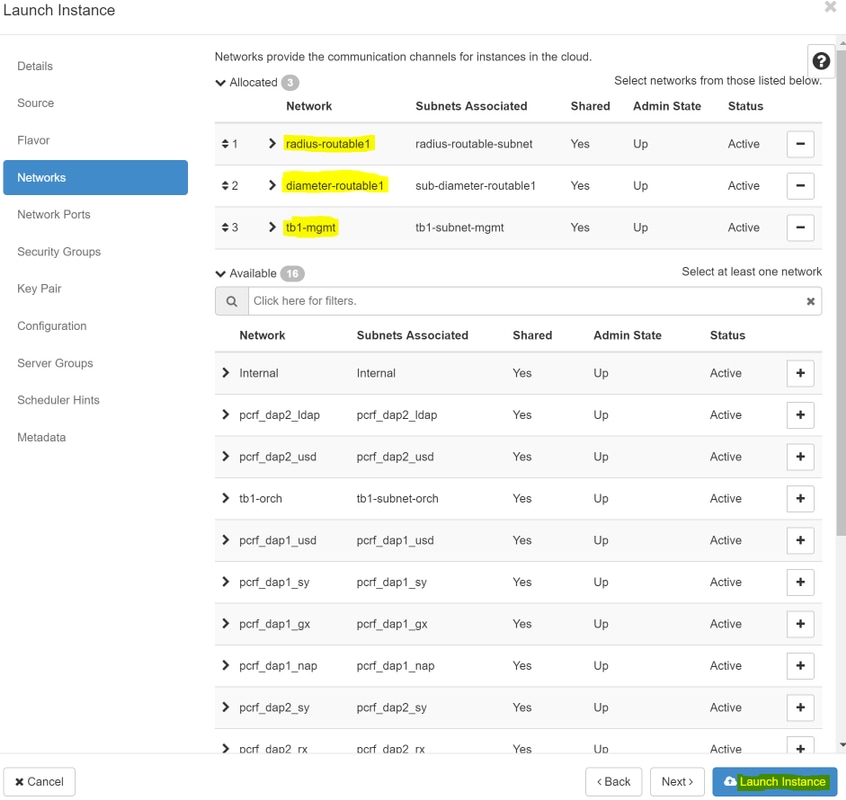

8단계.마지막으로, network(네트워크) 탭으로 이동하여 +sign(+서명)을 클릭할 때 인스턴스에 필요한 네트워크를 선택합니다. 이 경우 diameter-soutable1, radius-routable1 및 tb1-mgmt를 선택합니다.

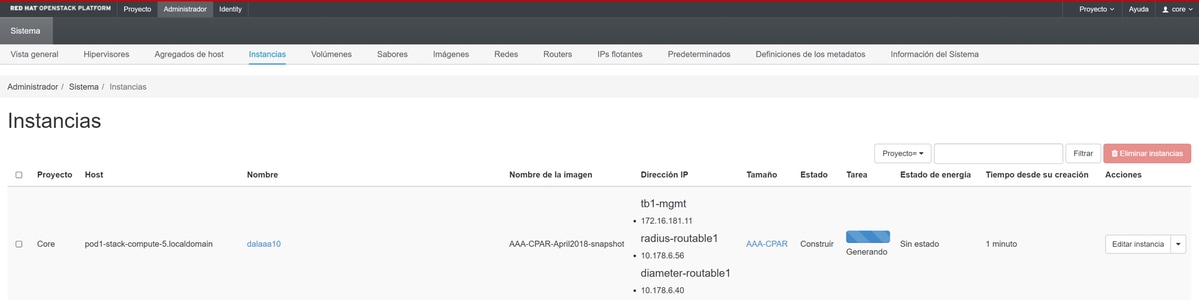

9단계. 마지막으로 Launch instance(인스턴스 실행)를 클릭하여 인스턴스를 생성합니다. Horizon에서 진행 상황을 모니터링할 수 있습니다.

몇 분 후에 인스턴스가 완전히 구축되어 사용할 준비가 됩니다.

부동 IP 주소 생성 및 할당

부동 IP 주소는 라우팅 가능한 주소입니다. 즉 Ultra M/Openstack 아키텍처 외부에서 연결할 수 있고 네트워크의 다른 노드와 통신할 수 있습니다.

1단계.Horizon 상단 메뉴에서 Admin(관리) > Floating IPs(부동 IP)로 이동합니다.

2단계. AllocateIP to Project(프로젝트에 IP 할당) 버튼을 클릭합니다.

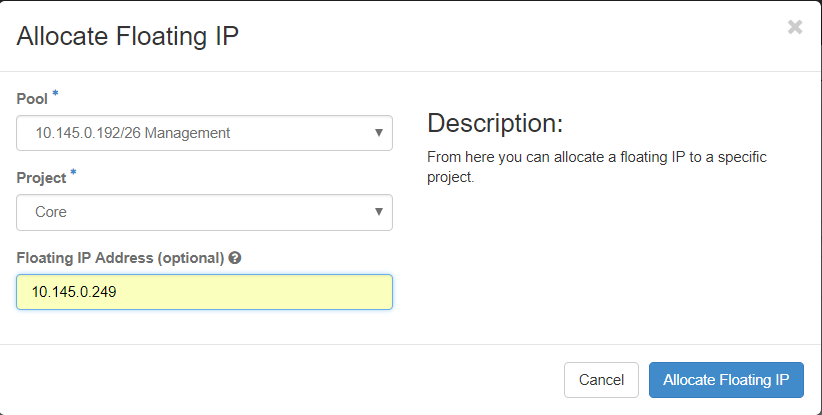

3단계. Allocate Floating IP(부동 IP 할당) 창에서 새 부동 IP가 속한 풀, 할당할 프로젝트 및 새 부동 IP 주소 자체를 선택합니다.

예를 들면 다음과 같습니다.

4단계.AllocateFloating IPbutton을 클릭합니다.

5단계. Horizon 상단 메뉴에서 Project(프로젝트) > Instances(인스턴스)로 이동합니다.

6단계.Actioncolumn(작업 열)에서 Create Snapshotbutton(스냅샷 생성 버튼)을 가리키는 화살표를 클릭하면 메뉴가 표시됩니다. Associate Floating IPoption을 선택합니다.

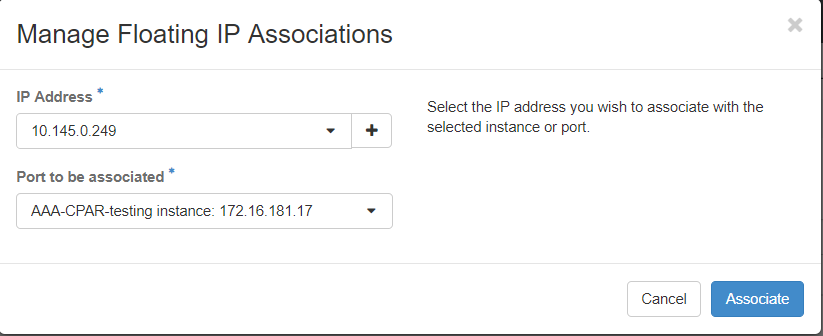

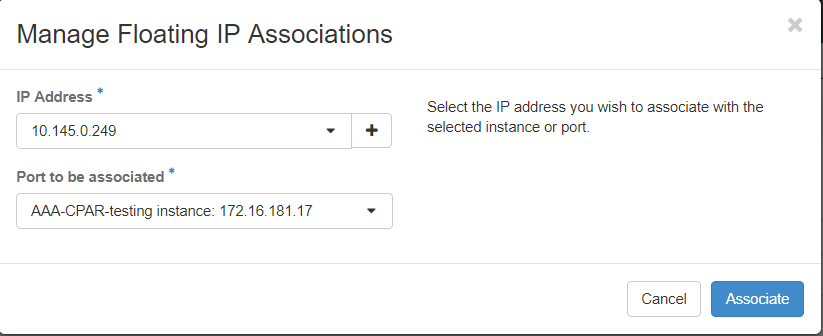

7단계. IP 주소 필드에서 사용할 해당 부동 IP 주소를 선택하고 이 부동 IP가 연결될 포트에서 할당될 새 인스턴스에서 해당 관리 인터페이스(eth0)를 선택합니다. 이 절차의 예시로 다음 이미지를 참조하시기 바랍니다.

8단계. 마지막으로, Associate(연결)버튼을 클릭합니다.

SSH 활성화

1단계.Horizon 상단 메뉴에서 Project(프로젝트) > Instances(인스턴스)로 이동합니다.

2단계.섹션Lunch a new instance(새 인스턴스 점심)에서 생성한 인스턴스/VM의 이름을 클릭합니다.

3단계. Consoletab을 클릭합니다. 이렇게 하면 VM의 명령줄 인터페이스가 표시됩니다.

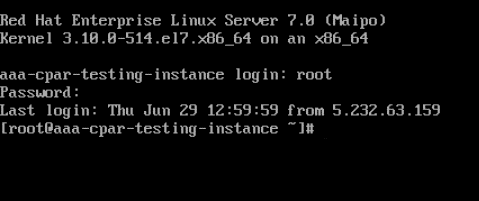

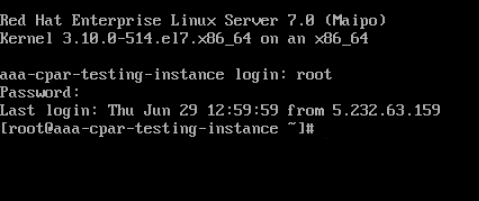

4단계.CLI가 표시되면 적절한 로그인 자격 증명을 입력합니다.

사용자 이름:root

비밀번호:cisco123

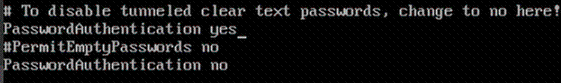

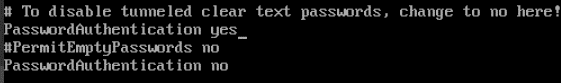

5단계.CLI에 commandvi /etc/ssh/sshd_configurator를 입력하여 ssh 컨피그레이션을 수정합니다.

6단계. ssh 컨피그레이션 파일이 열리면 Ito를 눌러 파일을 편집합니다. 그런 다음 아래에 표시된 섹션을 찾아 첫 번째 줄을 PasswordAuthentication notoPasswordAuthentication yes로 변경합니다.

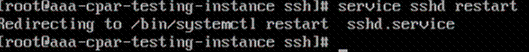

7단계.esc를 누르고:wq!를 입력하여 sshd_config 파일 변경 내용을 저장합니다.

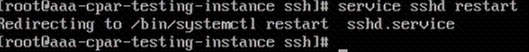

8단계. commandservice sshd 다시 시작을 실행합니다.

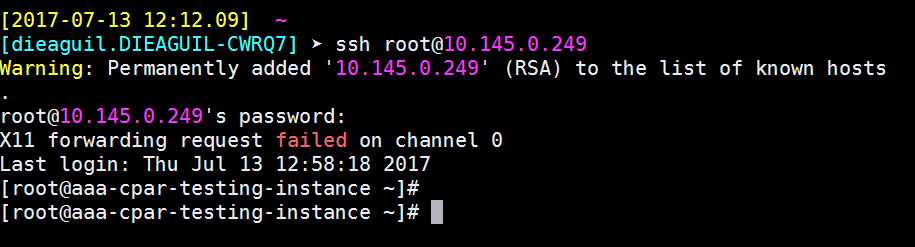

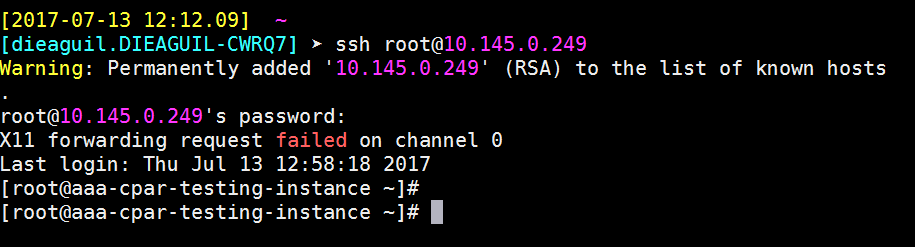

9단계 SSH 컨피그레이션 변경 사항이 올바르게 적용되었는지 테스트하려면 SSH 클라이언트를 열고 인스턴스에 할당된 부동 IP(예: 10.145.0.249)와 userroot를 사용하여 원격 보안 연결을 설정합니다.

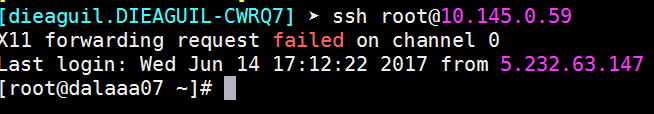

SSH 세션 설정

애플리케이션이 설치된 해당 VM/서버의 IP 주소를 사용하여 SSH 세션을 엽니다.

CPAR 인스턴스 시작

활동이 완료되고 종료된 사이트에서 CPAR 서비스를 다시 설정할 수 있게 되면 아래 단계를 따르십시오.

- Horizon에 다시 로그인하려면 Project > Instance > Start Instance로 이동합니다.

- 인스턴스의 상태가 활성 상태이고 전원 상태가 실행 중인지 확인합니다.

작업 후 상태 확인

1단계. OS 레벨에서 명령/opt/CSCOar/bin/arstatus를 실행합니다.

[root@aaa04 ~]# /opt/CSCOar/bin/arstatus Cisco Prime AR RADIUS server running (pid: 24834) Cisco Prime AR Server Agent running (pid: 24821) Cisco Prime AR MCD lock manager running (pid: 24824) Cisco Prime AR MCD server running (pid: 24833) Cisco Prime AR GUI running (pid: 24836) SNMP Master Agent running (pid: 24835) [root@wscaaa04 ~]#

2단계 OS 레벨에서 명령/opt/CSCOar/bin/aregcmd를 실행하고 관리자 자격 증명을 입력합니다. CPAR Health(CPAR 상태)가 10개 중 10개인지 확인하고 CPAR CLI를 종료합니다.

[root@aaa02 logs]# /opt/CSCOar/bin/aregcmd Cisco Prime Access Registrar 7.3.0.1 Configuration Utility Copyright (C) 1995-2017 by Cisco Systems, Inc. All rights reserved. Cluster: User: admin Passphrase: Logging in to localhost [ //localhost ] LicenseInfo = PAR-NG-TPS 7.2(100TPS:) PAR-ADD-TPS 7.2(2000TPS:) PAR-RDDR-TRX 7.2() PAR-HSS 7.2() Radius/ Administrators/ Server 'Radius' is Running, its health is 10 out of 10 --> exit

3단계.netstat 명령을 실행합니다 | grep diameter 및 모든 DRA 연결이 설정되었는지 확인합니다.

아래 표시된 출력은 Diameter 링크가 필요한 환경에 대한 것입니다. 표시되는 링크 수가 적을 경우, 이는 분석해야 하는 DRA와의 연결이 끊겼음을 나타냅니다.

[root@aa02 logs]# netstat | grep diameter tcp 0 0 aaa02.aaa.epc.:77 mp1.dra01.d:diameter ESTABLISHED tcp 0 0 aaa02.aaa.epc.:36 tsa6.dra01:diameter ESTABLISHED tcp 0 0 aaa02.aaa.epc.:47 mp2.dra01.d:diameter ESTABLISHED tcp 0 0 aaa02.aaa.epc.:07 tsa5.dra01:diameter ESTABLISHED tcp 0 0 aaa02.aaa.epc.:08 np2.dra01.d:diameter ESTABLISHED

4단계. TPS 로그에 CPAR에서 처리 중인 요청이 표시되는지 확인합니다. 강조 표시된 값은 TPS를 나타내며 해당 값은 우리가 주목해야 할 값입니다.

TPS의 값은 1500을 초과할 수 없습니다.

[root@wscaaa04 ~]# tail -f /opt/CSCOar/logs/tps-11-21-2017.csv 11-21-2017,23:57:35,263,0 11-21-2017,23:57:50,237,0 11-21-2017,23:58:05,237,0 11-21-2017,23:58:20,257,0 11-21-2017,23:58:35,254,0 11-21-2017,23:58:50,248,0 11-21-2017,23:59:05,272,0 11-21-2017,23:59:20,243,0 11-21-2017,23:59:35,244,0 11-21-2017,23:59:50,233,0

5단계.name_radius_1_log에서 "오류" 또는 "경보" 메시지를 확인합니다.

[root@aaa02 logs]# grep -E "error|alarm" name_radius_1_log

6단계.다음 명령을 실행하여 CPAR 프로세스에서 사용 중인 메모리의 양을 확인합니다.

꼭대기 | grep radius

[root@sfraaa02 ~]# top | grep radius 27008 root 20 0 20.228g 2.413g 11408 S 128.3 7.7 1165:41 radius

이 강조 표시된 값은 다음 값보다 작아야 합니다. 7Gb - 애플리케이션 수준에서 허용되는 최대 용량입니다.

OSD 컴퓨팅 노드의 마더보드 교체

활동 전에 컴퓨팅 노드에 호스트된 VM이 정상적으로 종료되고 CEPH가 유지 보수 모드로 전환됩니다. 마더보드를 교체하면 VM이 다시 복원되고 CEPH가 유지 보수 모드에서 벗어납니다.

Osd-Compute 노드에서 호스팅되는 VM 식별

OSD 컴퓨팅 서버에서 호스팅되는 VM을 식별합니다.

[stack@director ~]$ nova list --field name,host | grep osd-compute-0 | 46b4b9eb-a1a6-425d-b886-a0ba760e6114 | AAA-CPAR-testing-instance | pod2-stack-compute-4.localdomain |

백업: 스냅샷 프로세스

CPAR 애플리케이션 종료

1단계. 네트워크에 연결된 ssh 클라이언트를 열고 CPAR 인스턴스에 연결합니다.

한 사이트 내에 있는 4개의 AAA 인스턴스를 모두 동시에 종료하지 않고, 하나씩 차례로 수행하는 것이 중요합니다.

2단계.다음 명령을 사용하여 CPAR 애플리케이션을 종료합니다.

/opt/CSCOar/bin/arserver stop A Message stating “Cisco Prime Access Registrar Server Agent shutdown complete.” Should show up

참고: 사용자가 CLI 세션을 열어 둔 경우 arserver stop 명령이 작동하지 않으며 다음 메시지가 표시됩니다.

ERROR: You can not shut down Cisco Prime Access Registrar while the CLI is being used. Current list of running CLI with process id is: 2903 /opt/CSCOar/bin/aregcmd –s

이 예에서, 하이라이트된 프로세스 ID(2903)는 CPAR이 중단될 수 있기 전에 종료될 필요가 있다. 이 경우 다음 명령을 사용하여 이 프로세스를 종료하십시오.

kill -9 *process_id*

그런 다음 1단계를 반복합니다.

3단계.다음 명령을 사용하여 CPAR 애플리케이션이 실제로 종료되었는지 확인합니다.

/opt/CSCOar/bin/arstatus

다음과 같은 메시지가 표시됩니다.

Cisco Prime Access Registrar Server Agent not running Cisco Prime Access Registrar GUI not running

VM 스냅샷 작업

1단계.현재 작업 중인 사이트(도시)에 해당하는 Horizon GUI 웹 사이트를 입력합니다.

Horizon에 액세스하면 다음과 같은 이미지가 표시됩니다.

2단계. 이미지에 표시된 대로 Project > Instances로 이동합니다.

사용한 사용자가 CPAR인 경우 이 메뉴에는 4개의 AAA 인스턴스만 표시됩니다.

3단계.한 번에 하나의 인스턴스만 종료하십시오. 이 문서의 전체 프로세스를 반복하십시오.

VM을 종료하려면 Actions(작업) > Shut Off Instance(인스턴스 종료)로 이동하여 선택 사항을 확인합니다.

4단계.Status(상태) = Shutoff(차단) 및 Power State(전력 상태) = Shut Down(종료)을 선택하여 인스턴스가 실제로 종료되었는지 확인합니다.

이 단계에서는 CPAR 종료 프로세스를 종료합니다.

VM 스냅샷

CPAR VM이 다운되면 독립 컴퓨터에 속하므로 스냅샷을 병렬로 만들 수 있습니다.

4개의 QCOW2 파일이 병렬로 생성됩니다.

각 AAA 인스턴스의 스냅샷을 만듭니다(25분 -1시간)(qcow 이미지를 소스로 사용한 인스턴스는 25분, 원시 이미지를 소스로 사용한 인스턴스는 1시간)

1단계. POD의 Openstack HorizonGUI에 로그인합니다.

2단계. 로그인했으면 상단 메뉴의 Project > Compute > Instances 섹션으로 이동하여 AAA 인스턴스를 찾습니다.

3단계. 스냅샷 생성을 계속하려면 Create Snapshot(스냅샷 생성) 버튼을 클릭합니다(해당 AAA 인스턴스에서 실행되어야 함).

4단계. 스냅샷이 실행되면 IMAGES(이미지) 메뉴로 이동하여 모든 작업이 완료되었는지 확인하고 문제가 없음을 보고합니다.

5단계. 다음 단계는 이 프로세스 중에 OSPD가 손실될 경우 QCOW2 형식으로 스냅샷을 다운로드하고 원격 엔티티로 전송하는 것입니다. 이를 위해 OSPD 레벨에서 이 명령 glance image-list를 사용하여 스냅샷을 식별합니다.

[root@elospd01 stack]# glance image-list +--------------------------------------+---------------------------+ | ID | Name | +--------------------------------------+---------------------------+ | 80f083cb-66f9-4fcf-8b8a-7d8965e47b1d | AAA-Temporary | | 22f8536b-3f3c-4bcc-ae1a-8f2ab0d8b950 | ELP1 cluman 10_09_2017 | | 70ef5911-208e-4cac-93e2-6fe9033db560 | ELP2 cluman 10_09_2017 | | e0b57fc9-e5c3-4b51-8b94-56cbccdf5401 | ESC-image | | 92dfe18c-df35-4aa9-8c52-9c663d3f839b | lgnaaa01-sept102017 | | 1461226b-4362-428b-bc90-0a98cbf33500 | tmobile-pcrf-13.1.1.iso | | 98275e15-37cf-4681-9bcc-d6ba18947d7b | tmobile-pcrf-13.1.1.qcow2 | +--------------------------------------+---------------------------+

6단계. 스냅샷이 다운로드될 것임을 확인했으면(이 경우 녹색으로 위에 표시된 스냅샷임), 여기에 표시된 대로 이 명령 glance image-download를 사용하여 QCOW2 형식으로 다운로드합니다.

[root@elospd01 stack]# glance image-download 92dfe18c-df35-4aa9-8c52-9c663d3f839b --file /tmp/AAA-CPAR-LGNoct192017.qcow2 &

- "&"가 프로세스를 백그라운드로 전송합니다. 이 작업을 완료하는 데 시간이 조금 걸립니다. 작업이 완료되면 이미지가 /tmp 디렉토리에 위치할 수 있습니다.

- 프로세스를 백그라운드로 전송할 때 연결이 끊기면 프로세스도 중지됩니다.

- SSH 연결이 끊긴 경우 프로세스가 계속 실행되고 OSPD에서 종료되도록 "disown -h" 명령을 실행합니다.

7. 다운로드 프로세스가 완료되면 운영 체제에서 처리하는 프로세스, 작업 및 임시 파일로 인해 스냅샷이 0으로 채워질 수 있으므로 압축 프로세스를 실행해야 합니다. 파일 압축에 사용할 명령은 virt-sparsify입니다.

[root@elospd01 stack]# virt-sparsify AAA-CPAR-LGNoct192017.qcow2 AAA-CPAR-LGNoct192017_compressed.qcow2

이 프로세스에는 약간의 시간(약 10-15분)이 소요됩니다. 완료되면 결과 파일은 다음 단계에서 지정한 대로 외부 엔티티로 전송해야 하는 파일입니다.

파일 무결성을 확인하려면 다음 명령을 실행하고 출력 끝에 있는 "corrupt" 특성을 찾아야 합니다.

[root@wsospd01 tmp]# qemu-img info AAA-CPAR-LGNoct192017_compressed.qcow2 image: AAA-CPAR-LGNoct192017_compressed.qcow2 file format: qcow2 virtual size: 150G (161061273600 bytes) disk size: 18G cluster_size: 65536 Format specific information: compat: 1.1 lazy refcounts: false refcount bits: 16 corrupt: false

OSPD가 손실되는 문제를 방지하기 위해 최근에 생성된 QCOW2 형식의 스냅샷을 외부 엔터티로 전송해야 합니다. 파일 전송을 시작하기 전에 대상에 사용 가능한 디스크 공간이 충분한지 확인해야 합니다. "df -kh" 명령을 사용하여 메모리 공간을 확인합니다. x.x.x.x는 원격 OSPD의 IP인 SFTP "sftproot@x.x.x.x"을 사용하여 다른 사이트의 OSPD로 임시로 전송하는 것이 좋습니다. 전송 속도를 높이기 위해 대상을 여러 OSPD로 전송할 수 있습니다. 같은 방법으로 scp *name_of_the_file*.qcow2 root@ x.x.x.x:/tmp 명령을 사용하여 파일을 다른 OSPD로 전송할 수 있습니다(여기서 x.x.x.x.x는 원격 OSPD의 IP).

CEPH를 유지 보수 모드로 전환

1단계. 서버에서 ceph osd 트리 상태가 up인지 확인합니다.

[heat-admin@pod2-stack-osd-compute-0 ~]$ sudo ceph osd tree

ID WEIGHT TYPE NAME UP/DOWN REWEIGHT PRIMARY-AFFINITY

-1 13.07996 root default

-2 4.35999 host pod2-stack-osd-compute-0

0 1.09000 osd.0 up 1.00000 1.00000

3 1.09000 osd.3 up 1.00000 1.00000

6 1.09000 osd.6 up 1.00000 1.00000

9 1.09000 osd.9 up 1.00000 1.00000

-3 4.35999 host pod2-stack-osd-compute-1

1 1.09000 osd.1 up 1.00000 1.00000

4 1.09000 osd.4 up 1.00000 1.00000

7 1.09000 osd.7 up 1.00000 1.00000

10 1.09000 osd.10 up 1.00000 1.00000

-4 4.35999 host pod2-stack-osd-compute-2

2 1.09000 osd.2 up 1.00000 1.00000

5 1.09000 osd.5 up 1.00000 1.00000

8 1.09000 osd.8 up 1.00000 1.00000

11 1.09000 osd.11 up 1.00000 1.00000

2단계. OSD Compute(OSD 컴퓨팅) 노드에 로그인하고 CEPH를 유지 보수 모드로 설정합니다.

[root@pod2-stack-osd-compute-0 ~]# sudo ceph osd set norebalance

[root@pod2-stack-osd-compute-0 ~]# sudo ceph osd set noout

[root@pod2-stack-osd-compute-0 ~]# sudo ceph status

cluster eb2bb192-b1c9-11e6-9205-525400330666

health HEALTH_WARN

noout,norebalance,sortbitwise,require_jewel_osds flag(s) set

monmap e1: 3 mons at {pod2-stack-controller-0=11.118.0.10:6789/0,pod2-stack-controller-1=11.118.0.11:6789/0,pod2-stack-controller-2=11.118.0.12:6789/0}

election epoch 10, quorum 0,1,2 pod2-stack-controller-0,pod2-stack-controller-1,pod2-stack-controller-2

osdmap e79: 12 osds: 12 up, 12 in

flags noout,norebalance,sortbitwise,require_jewel_osds

pgmap v22844323: 704 pgs, 6 pools, 804 GB data, 423 kobjects

2404 GB used, 10989 GB / 13393 GB avail

704 active+clean

client io 3858 kB/s wr, 0 op/s rd, 546 op/s wr

참고: CEPH를 제거하면 VNF HD RAID가 Degraded(저하됨) 상태로 전환되지만 hd-디스크에 계속 액세스할 수 있어야 합니다

정상 전원 끄기

노드 전원 끄기

- 인스턴스 전원을 끄려면 nova stop <INSTANCE_NAME>

- 상태 차단과 함께 인스턴스 이름이 표시됩니다.

[stack@director ~]$ nova stop aaa2-21 Request to stop server aaa2-21 has been accepted. [stack@director ~]$ nova list +--------------------------------------+---------------------------+---------+------------+-------------+------------------------------------------------------------------------------------------------------------+ | ID | Name | Status | Task State | Power State | Networks | +--------------------------------------+---------------------------+---------+------------+-------------+------------------------------------------------------------------------------------------------------------+ | 46b4b9eb-a1a6-425d-b886-a0ba760e6114 | AAA-CPAR-testing-instance | ACTIVE | - | Running | tb1-mgmt=172.16.181.14, 10.225.247.233; radius-routable1=10.160.132.245; diameter-routable1=10.160.132.231 | | 3bc14173-876b-4d56-88e7-b890d67a4122 | aaa2-21 | SHUTOFF | - | Shutdown | diameter-routable1=10.160.132.230; radius-routable1=10.160.132.248; tb1-mgmt=172.16.181.7, 10.225.247.234 | | f404f6ad-34c8-4a5f-a757-14c8ed7fa30e | aaa21june | ACTIVE | - | Running | diameter-routable1=10.160.132.233; radius-routable1=10.160.132.244; tb1-mgmt=172.16.181.10 | +--------------------------------------+---------------------------+---------+------------+-------------+------------------------------------------------------------------------------------------------------------+

마더보드 교체

UCS C240 M4 서버에서 마더보드를 교체하는 절차는 Cisco UCS C240 M4 Server Installation and Service Guide에서 참조할 수 있습니다

- CIMC IP를 사용하여 서버에 로그인합니다.

- 펌웨어가 이전에 사용한 권장 버전에 따라 다르면 BIOS 업그레이드를 수행합니다. BIOS 업그레이드 단계는 다음과 같습니다. Cisco UCS C-Series Rack-Mount Server BIOS 업그레이드 가이드

유지 관리 모드에서 CEPH 이동

OSD Compute(OSD 컴퓨팅) 노드에 로그인하고 CEPH를 유지 보수 모드에서 빠져나옵니다.

[root@pod2-stack-osd-compute-0 ~]# sudo ceph osd unset norebalance

[root@pod2-stack-osd-compute-0 ~]# sudo ceph osd unset noout

[root@pod2-stack-osd-compute-0 ~]# sudo ceph status

cluster eb2bb192-b1c9-11e6-9205-525400330666

health HEALTH_OK

monmap e1: 3 mons at {pod2-stack-controller-0=11.118.0.10:6789/0,pod2-stack-controller-1=11.118.0.11:6789/0,pod2-stack-controller-2=11.118.0.12:6789/0}

election epoch 10, quorum 0,1,2 pod2-stack-controller-0,pod2-stack-controller-1,pod2-stack-controller-2

osdmap e81: 12 osds: 12 up, 12 in

flags sortbitwise,require_jewel_osds

pgmap v22844355: 704 pgs, 6 pools, 804 GB data, 423 kobjects

2404 GB used, 10989 GB / 13393 GB avail

704 active+clean

client io 3658 kB/s wr, 0 op/s rd, 502 op/s wr

VM 복원

스냅샷을 통해 인스턴스 복구

복구 프로세스:

이전 단계에서 생성한 스냅샷으로 이전 인스턴스를 재구축할 수 있습니다.

1단계[선택 사항].사용 가능한 이전 VMsnapshot이 없으면 백업이 전송된 OSPD 노드에 연결하고 백업을 원래 OSPD 노드로 다시 sftp합니다. 여기서 x.x.x.x는 원래 OSPD의 IP인 "sftproot@x.x.x.x"를 사용합니다. 스냅샷 파일을 /tmp 디렉토리에 저장합니다.

2단계.인스턴스가 재배포되는 OSPD 노드에 연결합니다.

다음 명령으로 환경 변수를 소싱합니다.

# source /home/stack/pod1-stackrc-Core-CPAR

3단계.스냅샷을 이미지로 사용하려면 이미지를 지평선에 업로드해야 합니다. 다음 명령을 사용하여 이 작업을 수행합니다.

#glance image-create -- AAA-CPAR-Date-snapshot.qcow2 --container-format bare --disk-format qcow2 --name AAA-CPAR-Date-snapshot

그 과정을 곧 볼 수 있다.

4단계.Horizon에서 Project(프로젝트) > Instances(인스턴스)로 이동하고 Launch Instance(인스턴스 실행)를 클릭합니다.

5단계.인스턴스 이름을 입력하고 가용 영역을 선택합니다.

6단계.Source(소스) 탭에서 인스턴스를 생성할 이미지를 선택합니다. Select Boot Source(부팅 소스 선택) 메뉴 이미지의 목록이 여기에 표시됩니다. + 기호를 클릭할 때 이전에 업로드한 이미지를 선택합니다.

7단계.Flavor(풍미) 탭에서 + 기호를 클릭할 때 AAA 풍미를 선택합니다.

8단계. 마지막으로, network(네트워크) 탭으로 이동하여 + 기호를 클릭할 때 인스턴스에 필요한 네트워크를 선택합니다. 이 경우 diameter-soutable1, radius-routable1 및 tb1-mgmt를 선택합니다.

9단계. 마지막으로 Launch instance(인스턴스 실행)를 클릭하여 인스턴스를 생성합니다. Horizon에서 진행 상황을 모니터링할 수 있습니다.

몇 분 후에 인스턴스가 완전히 구축되어 사용할 준비가 됩니다.

부동 IP 주소 생성 및 할당

부동 IP 주소는 라우팅 가능한 주소입니다. 즉 Ultra M/Openstack 아키텍처 외부에서 연결할 수 있고 네트워크의 다른 노드와 통신할 수 있습니다.

1단계.Horizon 상단 메뉴에서 Admin(관리) > Floating IPs(부동 IP)로 이동합니다.

2단계.AllocateIP to Project(프로젝트에 IP 할당) 버튼을 클릭합니다.

3단계. Allocate Floating IP(부동 IP 할당) 창에서 새 부동 IP가 속한 풀, 할당할 프로젝트 및 새 부동 IP 주소 자체를 선택합니다.

예를 들면 다음과 같습니다.

4단계.AllocateFloating IPbutton을 클릭합니다.

5단계. Horizon 상단 메뉴에서 Project(프로젝트) > Instances(인스턴스)로 이동합니다.

6단계. Actioncolumn(작업 열)에서 Create Snapshotbutton(스냅샷 생성 버튼)을 가리키는 화살표를 클릭하면 메뉴가 표시됩니다. Associate Floating IPoption을 선택합니다.

7단계. IP 주소 필드에서 사용할 해당 부동 IP 주소를 선택하고 이 부동 IP가 연결될 포트에서 할당될 새 인스턴스에서 해당 관리 인터페이스(eth0)를 선택합니다. 이 절차의 예시로 다음 이미지를 참조하시기 바랍니다.

8단계. 마지막으로 Associate(연결) 버튼을 클릭합니다.

SSH 활성화

1단계.Horizon 상단 메뉴에서 Project(프로젝트) > Instances(인스턴스)로 이동합니다.

2단계.섹션Lunch a new instance(새 인스턴스 점심)에서 생성한 인스턴스/VM의 이름을 클릭합니다.

3단계.콘솔 탭을 클릭합니다. VM의 CLI가 표시됩니다.

4단계. CLI가 표시되면 적절한 로그인 자격 증명을 입력합니다.

사용자 이름:root

비밀번호:cisco123

5단계.CLI에 commandvi /etc/ssh/sshd_configurator를 입력하여 ssh 컨피그레이션을 수정합니다.

6단계. ssh 컨피그레이션 파일이 열리면 Ito를 눌러 파일을 편집합니다. 그런 다음 여기에 표시된 섹션을 찾아 첫 번째 줄을 PasswordAuthentication notoPasswordAuthentication yes로 변경합니다.

7단계.esc를 누르고:wq!를 입력하여 sshd_config 파일 변경 내용을 저장합니다.

8단계. commandservice sshd restart를 실행합니다.

9단계 SSH 컨피그레이션 변경 사항이 올바르게 적용되었는지 테스트하려면 SSH 클라이언트를 열고 인스턴스에 할당된 부동 IP(예: 10.145.0.249)와 userroot를 사용하여 원격 보안 연결을 설정합니다.

SSH 세션 설정

애플리케이션이 설치된 해당 VM/서버의 IP 주소를 사용하여 SSH 세션을 엽니다.

CPAR 인스턴스 시작

활동이 완료되고 종료된 사이트에서 CPAR 서비스를 다시 설정할 수 있게 되면 다음 단계를 수행하십시오.

- Horizon으로 다시 로그인하고 Project > Instance > Start Instance로 이동합니다.

- 인스턴스의 상태가 활성 상태이고 전원 상태가 실행 중인지 확인합니다.

작업 후 상태 확인

1단계. OS 레벨에서 /opt/CSCOar/bin/arstatus 명령을 실행합니다.

[root@aaa04 ~]# /opt/CSCOar/bin/arstatus Cisco Prime AR RADIUS server running (pid: 24834) Cisco Prime AR Server Agent running (pid: 24821) Cisco Prime AR MCD lock manager running (pid: 24824) Cisco Prime AR MCD server running (pid: 24833) Cisco Prime AR GUI running (pid: 24836) SNMP Master Agent running (pid: 24835) [root@wscaaa04 ~]#

2단계. OS 레벨에서 /opt/CSCOar/bin/aregcmd 명령을 실행하고 관리자 자격 증명을 입력합니다. CPAR Health(CPAR 상태)가 10개 중 10개인지 확인하고 CPAR CLI를 종료합니다.

[root@aaa02 logs]# /opt/CSCOar/bin/aregcmd Cisco Prime Access Registrar 7.3.0.1 Configuration Utility Copyright (C) 1995-2017 by Cisco Systems, Inc. All rights reserved. Cluster: User: admin Passphrase: Logging in to localhost [ //localhost ] LicenseInfo = PAR-NG-TPS 7.2(100TPS:) PAR-ADD-TPS 7.2(2000TPS:) PAR-RDDR-TRX 7.2() PAR-HSS 7.2() Radius/ Administrators/ Server 'Radius' is Running, its health is 10 out of 10 --> exit

3단계.netstat 명령을 실행합니다. | grep diameter 및 모든 DRA 연결이 설정되었는지 확인합니다.

여기에 언급된 출력은 Diameter 링크가 예상되는 환경을 위한 것입니다. 표시되는 링크 수가 적을 경우, 이는 분석해야 하는 DRA와의 연결이 끊겼음을 나타냅니다.

[root@aa02 logs]# netstat | grep diameter tcp 0 0 aaa02.aaa.epc.:77 mp1.dra01.d:diameter ESTABLISHED tcp 0 0 aaa02.aaa.epc.:36 tsa6.dra01:diameter ESTABLISHED tcp 0 0 aaa02.aaa.epc.:47 mp2.dra01.d:diameter ESTABLISHED tcp 0 0 aaa02.aaa.epc.:07 tsa5.dra01:diameter ESTABLISHED tcp 0 0 aaa02.aaa.epc.:08 np2.dra01.d:diameter ESTABLISHED

4단계. TPS 로그에 CPAR에서 처리 중인 요청이 표시되는지 확인합니다. 강조 표시된 값은 TPS를 나타내며 해당 값은 우리가 주목해야 할 값입니다.

TPS의 값은 1500을 초과할 수 없습니다.

[root@wscaaa04 ~]# tail -f /opt/CSCOar/logs/tps-11-21-2017.csv 11-21-2017,23:57:35,263,0 11-21-2017,23:57:50,237,0 11-21-2017,23:58:05,237,0 11-21-2017,23:58:20,257,0 11-21-2017,23:58:35,254,0 11-21-2017,23:58:50,248,0 11-21-2017,23:59:05,272,0 11-21-2017,23:59:20,243,0 11-21-2017,23:59:35,244,0 11-21-2017,23:59:50,233,0

5단계.name_radius_1_log에서 "오류" 또는 "경보" 메시지를 확인합니다.

[root@aaa02 logs]# grep -E "error|alarm" name_radius_1_log

6단계.CPAR 프로세스에서 다음 명령으로 사용하는 메모리의 양을 확인합니다.

꼭대기 | grep radius

[root@sfraaa02 ~]# top | grep radius 27008 root 20 0 20.228g 2.413g 11408 S 128.3 7.7 1165:41 radius

이 강조 표시된 값은 다음 값보다 작아야 합니다. 7Gb - 애플리케이션 수준에서 허용되는 최대 용량입니다.

컨트롤러 노드의 마더보드 교체

컨트롤러 상태를 확인하고 클러스터를 유지 관리 모드로 설정합니다.

OSPD에서 컨트롤러에 로그인하여 PC가 정상 상태인지 확인합니다. 세 컨트롤러 모두 Online 및 galera에 세 컨트롤러 모두 Master로 표시됩니다.

[heat-admin@pod2-stack-controller-0 ~]$ sudo pcs status

Cluster name: tripleo_cluster

Stack: corosync

Current DC: pod2-stack-controller-2 (version 1.1.15-11.el7_3.4-e174ec8) - partition with quorum

Last updated: Fri Jul 6 09:02:52 2018Last change: Mon Jul 2 12:49:52 2018 by root via crm_attribute on pod2-stack-controller-0

3 nodes and 19 resources configured

Online: [ pod2-stack-controller-0 pod2-stack-controller-1 pod2-stack-controller-2 ]

Full list of resources:

ip-11.120.0.49(ocf::heartbeat:IPaddr2):Started pod2-stack-controller-1

Clone Set: haproxy-clone [haproxy]

Started: [ pod2-stack-controller-0 pod2-stack-controller-1 pod2-stack-controller-2 ]

Master/Slave Set: galera-master [galera]

Masters: [ pod2-stack-controller-0 pod2-stack-controller-1 pod2-stack-controller-2 ]

ip-192.200.0.110(ocf::heartbeat:IPaddr2):Started pod2-stack-controller-1

ip-11.120.0.44(ocf::heartbeat:IPaddr2):Started pod2-stack-controller-2

ip-11.118.0.49(ocf::heartbeat:IPaddr2):Started pod2-stack-controller-2

Clone Set: rabbitmq-clone [rabbitmq]

Started: [ pod2-stack-controller-0 pod2-stack-controller-1 pod2-stack-controller-2 ]

ip-10.225.247.214(ocf::heartbeat:IPaddr2):Started pod2-stack-controller-1

Master/Slave Set: redis-master [redis]

Masters: [ pod2-stack-controller-2 ]

Slaves: [ pod2-stack-controller-0 pod2-stack-controller-1 ]

ip-11.119.0.49(ocf::heartbeat:IPaddr2):Started pod2-stack-controller-2

openstack-cinder-volume(systemd:openstack-cinder-volume):Started pod2-stack-controller-1

Daemon Status:

corosync: active/enabled

pacemaker: active/enabled

pcsd: active/enabled

클러스터를 유지 보수 모드로 전환

[heat-admin@pod2-stack-controller-0 ~]$ sudo pcs cluster standby

[heat-admin@pod2-stack-controller-0 ~]$ sudo pcs status

Cluster name: tripleo_cluster

Stack: corosync

Current DC: pod2-stack-controller-2 (version 1.1.15-11.el7_3.4-e174ec8) - partition with quorum

Last updated: Fri Jul 6 09:03:10 2018Last change: Fri Jul 6 09:03:06 2018 by root via crm_attribute on pod2-stack-controller-0

3 nodes and 19 resources configured

Node pod2-stack-controller-0: standby

Online: [ pod2-stack-controller-1 pod2-stack-controller-2 ]

Full list of resources:

ip-11.120.0.49(ocf::heartbeat:IPaddr2):Started pod2-stack-controller-1

Clone Set: haproxy-clone [haproxy]

Started: [ pod2-stack-controller-1 pod2-stack-controller-2 ]

Stopped: [ pod2-stack-controller-0 ]

Master/Slave Set: galera-master [galera]

Masters: [ pod2-stack-controller-0 pod2-stack-controller-1 pod2-stack-controller-2 ]

ip-192.200.0.110(ocf::heartbeat:IPaddr2):Started pod2-stack-controller-1

ip-11.120.0.44(ocf::heartbeat:IPaddr2):Started pod2-stack-controller-2

ip-11.118.0.49(ocf::heartbeat:IPaddr2):Started pod2-stack-controller-2

Clone Set: rabbitmq-clone [rabbitmq]

Started: [ pod2-stack-controller-0 pod2-stack-controller-1 pod2-stack-controller-2 ]

ip-10.225.247.214(ocf::heartbeat:IPaddr2):Started pod2-stack-controller-1

Master/Slave Set: redis-master [redis]

Masters: [ pod2-stack-controller-2 ]

Slaves: [ pod2-stack-controller-1 ]

Stopped: [ pod2-stack-controller-0 ]

ip-11.119.0.49(ocf::heartbeat:IPaddr2):Started pod2-stack-controller-2

openstack-cinder-volume(systemd:openstack-cinder-volume):Started pod2-stack-controller-1

Daemon Status:

corosync: active/enabled

pacemaker: active/enabled

pcsd: active/enabled

마더보드 교체

UCS C240 M4 서버의 마더보드 교체 절차는 Cisco UCS C240 M4 서버 설치 및 서비스 가이드에서 참조할 수 있습니다

- CIMC IP를 사용하여 서버에 로그인합니다.

- 펌웨어가 이전에 사용한 권장 버전에 따라 다르면 BIOS 업그레이드를 수행합니다. BIOS 업그레이드 단계는 다음과 같습니다.

Cisco UCS C-Series 랙 마운트 서버 BIOS 업그레이드 가이드

클러스터 상태 복원

영향을 받는 컨트롤러에 로그인하고, unstandby를 설정하여 대기 모드를 제거합니다. 컨트롤러가 클러스터와 함께 Online(온라인)으로 오는지 확인하고, galera(갤러리)에 세 컨트롤러 모두 Master(마스터)로 표시됩니다. 몇 분 정도 걸릴 수 있습니다.

[heat-admin@pod2-stack-controller-0 ~]$ sudo pcs cluster unstandby

[heat-admin@pod2-stack-controller-0 ~]$ sudo pcs status

Cluster name: tripleo_cluster

Stack: corosync

Current DC: pod2-stack-controller-2 (version 1.1.15-11.el7_3.4-e174ec8) - partition with quorum

Last updated: Fri Jul 6 09:03:37 2018Last change: Fri Jul 6 09:03:35 2018 by root via crm_attribute on pod2-stack-controller-0

3 nodes and 19 resources configured

Online: [ pod2-stack-controller-0 pod2-stack-controller-1 pod2-stack-controller-2 ]

Full list of resources:

ip-11.120.0.49(ocf::heartbeat:IPaddr2):Started pod2-stack-controller-1

Clone Set: haproxy-clone [haproxy]

Started: [ pod2-stack-controller-0 pod2-stack-controller-1 pod2-stack-controller-2 ]

Master/Slave Set: galera-master [galera]

Masters: [ pod2-stack-controller-1 pod2-stack-controller-2 ]

Slaves: [ pod2-stack-controller-0 ]

ip-192.200.0.110(ocf::heartbeat:IPaddr2):Started pod2-stack-controller-1

ip-11.120.0.44(ocf::heartbeat:IPaddr2):Started pod2-stack-controller-2

ip-11.118.0.49(ocf::heartbeat:IPaddr2):Started pod2-stack-controller-2

Clone Set: rabbitmq-clone [rabbitmq]

Started: [ pod2-stack-controller-1 pod2-stack-controller-2 ]

Stopped: [ pod2-stack-controller-0 ]

ip-10.225.247.214(ocf::heartbeat:IPaddr2):Started pod2-stack-controller-1

Master/Slave Set: redis-master [redis]

Masters: [ pod2-stack-controller-2 ]

Slaves: [ pod2-stack-controller-0 pod2-stack-controller-1 ]

ip-11.119.0.49(ocf::heartbeat:IPaddr2):Started pod2-stack-controller-2

openstack-cinder-volume(systemd:openstack-cinder-volume):Started pod2-stack-controller-1

Daemon Status:

corosync: active/enabled

pacemaker: active/enabled

pcsd: active/enabled

Cisco 엔지니어가 작성

- 카르티케얀 다차나모르티Cisco 고급 서비스

- 하시타 바드와이Cisco 고급 서비스

지원 문의

- 지원 케이스 접수

- (시스코 서비스 계약 필요)

피드백

피드백