Cisco All-Flash HyperFlex 3.5 Hyperconverged System と最大 4400 の VMware Horizon 7 ユーザ

Cisco All-Flash HyperFlex 3.5

Hyperconverged System と最大 4400 の VMware Horizon 7 ユーザ

VMware Horizon 7.6 を使用した仮想デスクトップ インフラストラクチャとしての Cisco HyperFlex の設計と導入

『Cisco All-Flash HyperFlex 3.5 Hyperconverged System と最大 4400 の VMware Horizon 7 ユーザ』PDF

最終更新日:2019 年 3 月 10 日

Cisco Validated Design プログラムについて

Cisco Validated Design(CVD)プログラムは、お客様による信頼性の高い、確実かつ速やかな展開を容易にするために、デザイン、テスト、および文書化されたシステムおよびソリューションで構成されています。詳細については、次のサイトにアクセスしてください。

http://www.cisco.com/go/designzone 。

このマニュアルに記載されているデザイン、仕様、表現、情報、および推奨事項(総称して「デザイン」)は、障害も含めて本マニュアル作成時点のものです。シスコおよびそのサプライヤは、商品性の保証、特定目的への準拠の保証、および権利を侵害しないことに関する保証、あるいは取引過程、使用、取引慣行によって発生する保証をはじめとする、一切の保証の責任を負わないものとします。いかなる場合においても、シスコおよびそのサプライヤは、このデザインの使用または使用できないことによって発生する利益の損失やデータの損傷をはじめとする、間接的、派生的、偶発的、あるいは特殊な損害について、あらゆる可能性がシスコまたはそのサプライヤに知らされていても、それらに対する責任を一切負わないものとします。

デザインは予告なしに変更されることがあります。このマニュアルに記載されているデザインの使用は、すべてユーザ側の責任になります。これらのデザインは、シスコ、そのサプライヤ、パートナーの技術的な助言や他の専門的な助言に相当するものではありません。ユーザは、デザインを実装する前に技術アドバイザーに相談してください。シスコによるテストの対象外となった要因によって、結果が異なることがあります。

CCDE、CCENT、Cisco Eos、Cisco Lumin、Cisco Nexus、Cisco StadiumVision、Cisco TelePresence、Cisco WebEx、Cisco ロゴ、DCE、Welcome to the Human Network は商標です。Changing the Way We Work, Live, Play, and Learn、および Cisco Store はサービス マークです。Access Registrar、Aironet、AsyncOS、Bringing the Meeting To You、Catalyst、CCDA、CCDP、CCIE、CCIP、CCNA、CCNP、CCSP、CCVP、Cisco、Cisco Certified Internetwork Expert ロゴ、Cisco IOS、Cisco Press、Cisco Systems、Cisco Systems Capital、Cisco Systems ロゴ、Cisco Unified Computing System(Cisco UCS)、Cisco UCS B-Series Blade Servers、Cisco UCS C-Series Rack Servers、Cisco UCS S-Series Storage Servers、Cisco UCS Manager、Cisco UCS Management Software、Cisco Unified Fabric、Cisco Application Centric Infrastructure、Cisco Nexus 9000 Series、Cisco Nexus 7000 Series。Cisco Prime Data Center Network Manager、Cisco NX-OS Software、Cisco MDS Series、Cisco Unity、Collaboration Without Limitation、EtherFast、EtherSwitch、Event Center、Fast Step、Follow Me Browsing、FormShare、GigaDrive、HomeLink、Internet Quotient、IOS、iPhone、iQuick Study、LightStream、Linksys、MediaTone、MeetingPlace、MeetingPlace Chime Sound、MGX、Networkers、Networking Academy、Network Registrar、PCNow、PIX、PowerPanels、ProConnect、ScriptShare、SenderBase、SMARTnet、Spectrum Expert、StackWise、The Fastest Way to Increase Your Internet Quotient、TransPath、WebEx、および WebEx ロゴは Cisco Systems, Inc. またはその関連会社の米国および一部の国における登録商標です。

本ドキュメントまたは Web サイトに掲載されているその他の商標はそれぞれの所有者に帰属します。「パートナー」または「partner」という用語の使用はシスコと他社との間のパートナーシッ プ関係を意味するものではありません。(0809R)

© 2018 Cisco Systems, Inc. All rights reserved.

目次

Cisco HyperFlex コンピューティング専用ノード

Cisco HyperFlex データ プラットフォーム ソフトウェア

Cisco Unified Computing System

Cisco Unified Computing System のコンポーネント

Cisco VIC 1387 MLOM インターフェイス カード

Cisco VIC1340 コンバージド ネットワーク アダプタ

Cisco UCS 2304XP ファブリック エクステンダ

Cisco HyperFlex HX Data Platform 管理プラグイン

Cisco HyperFlex Connect HTML5 対応の管理 Web ページ

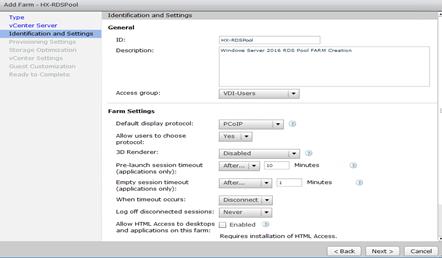

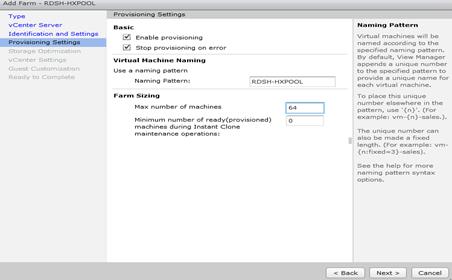

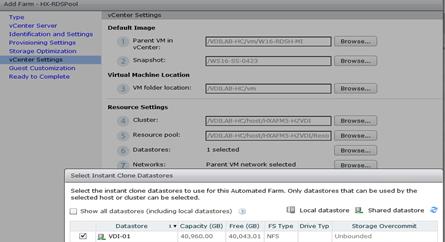

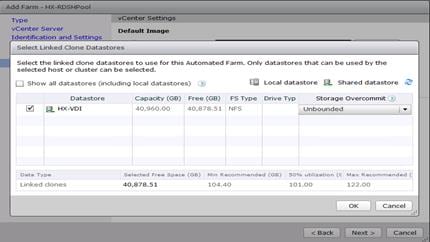

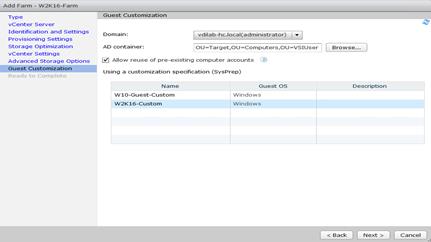

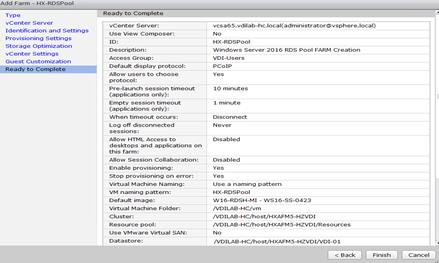

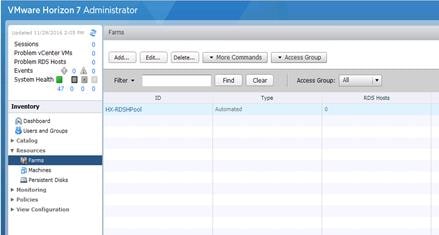

ファーム、RDS ホスト、デスクトップおよびアプリケーション プール

Cisco Unified Computing System の VMware Horizon のアーキテクチャと設計、 および Cisco HyperFlex のシステム設計の基本

プロジェクト計画とソリューション サイジングに関する確認事項の例

さまざまなワークロード タイプ向けの VMware Horizon 環境の設計

Cisco Unified Computing System の構成

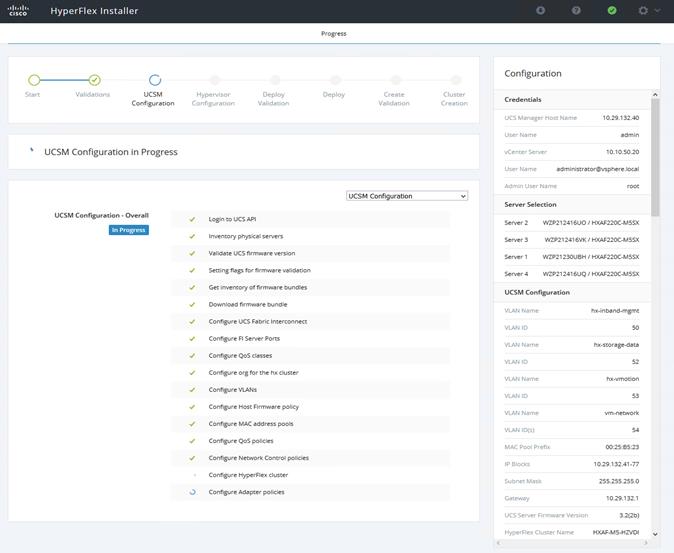

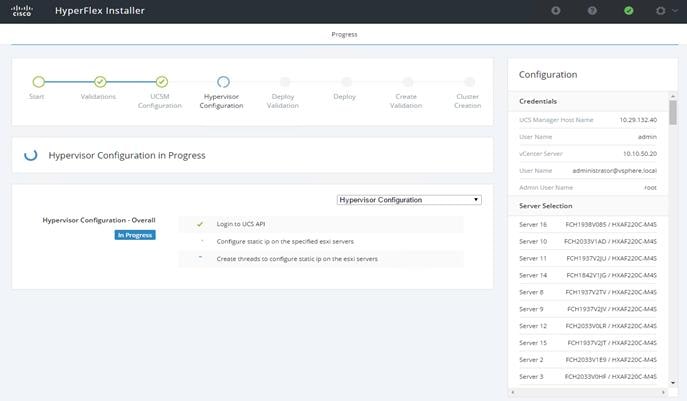

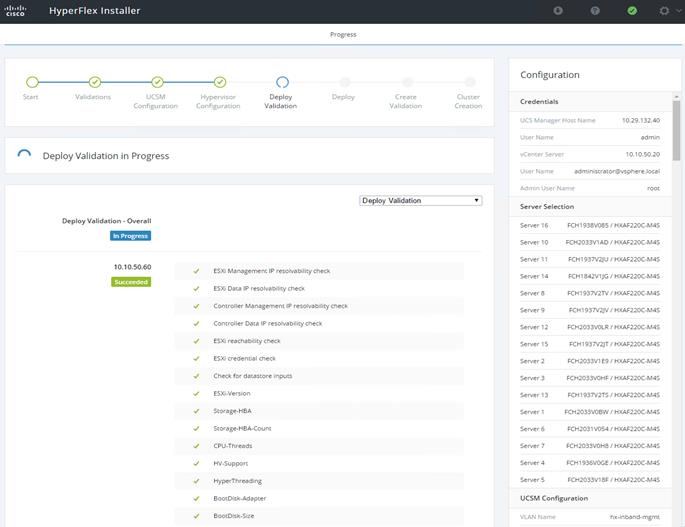

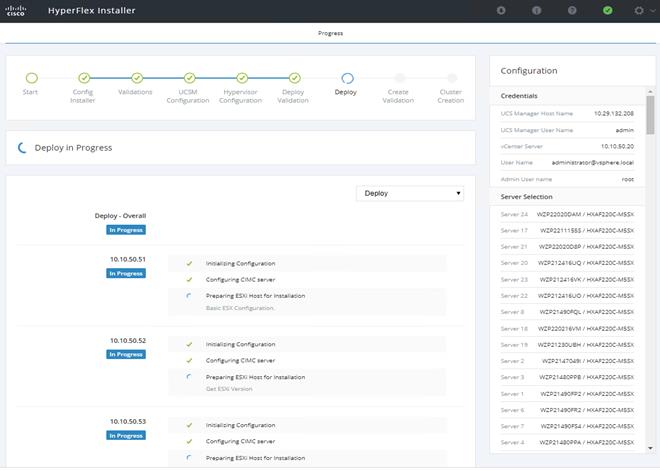

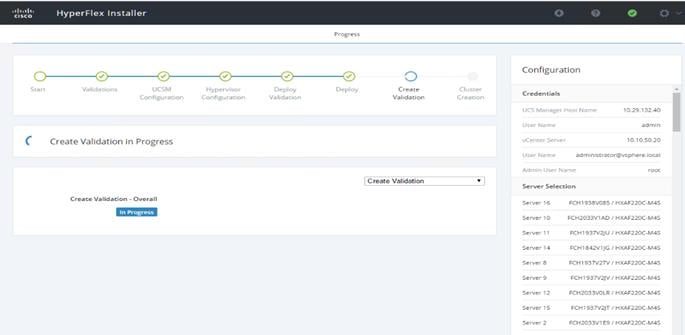

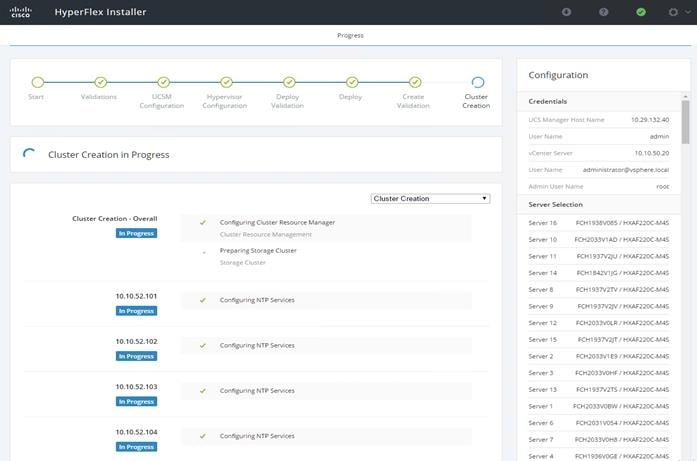

HyperFlex データ プラットフォームの展開および設定

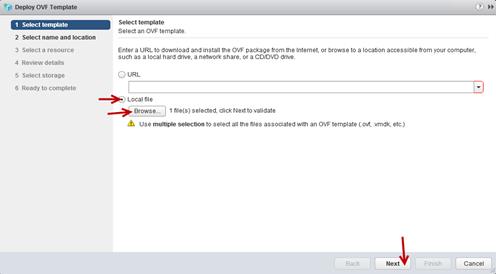

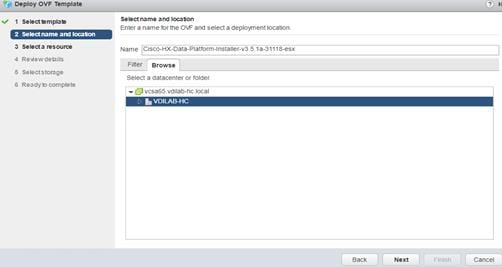

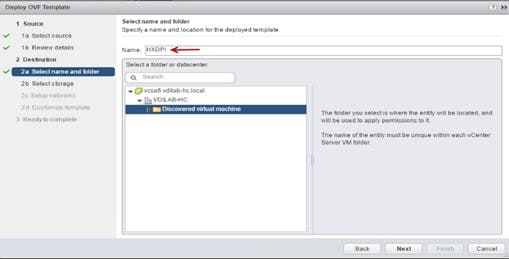

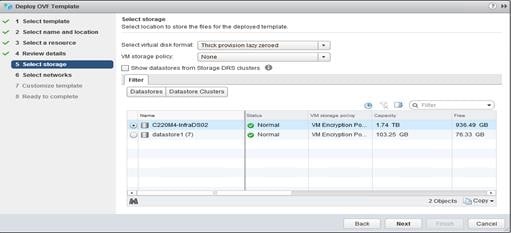

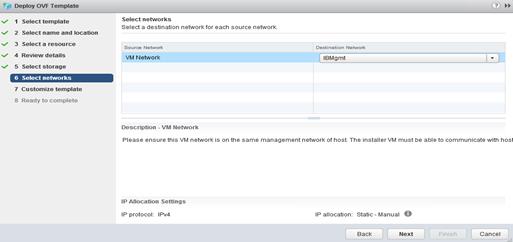

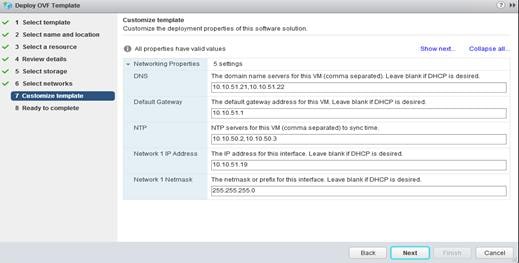

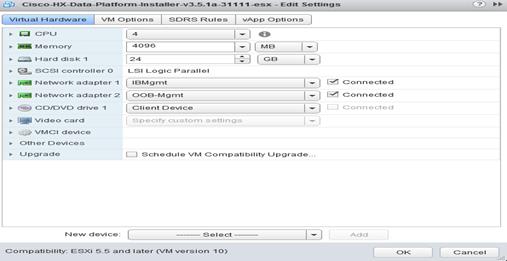

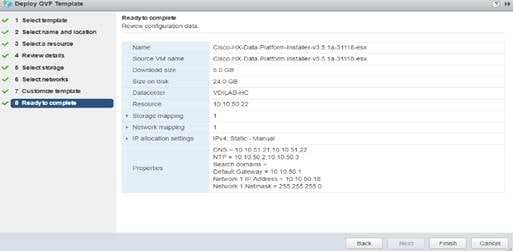

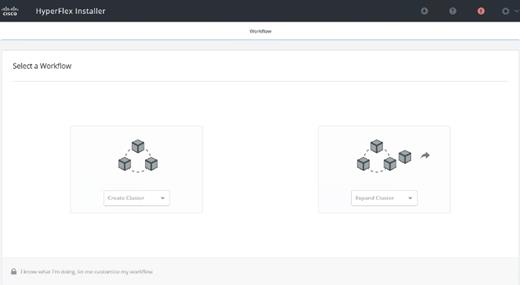

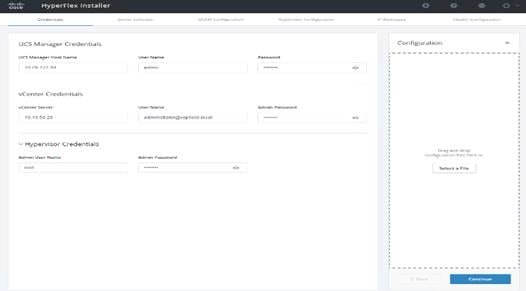

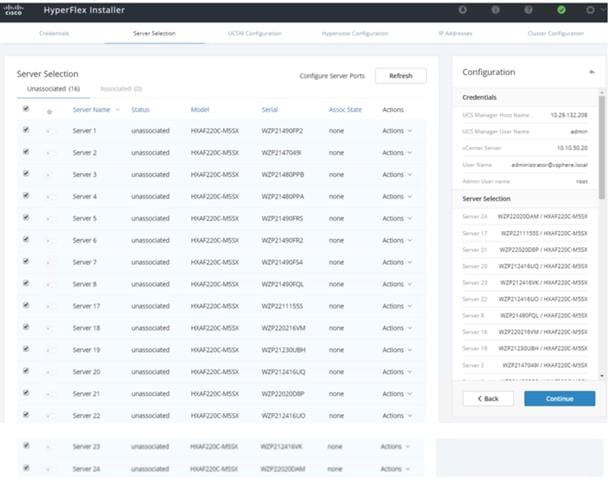

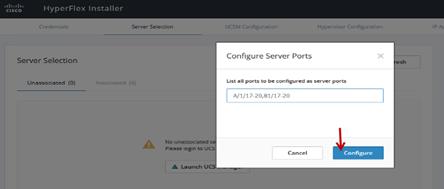

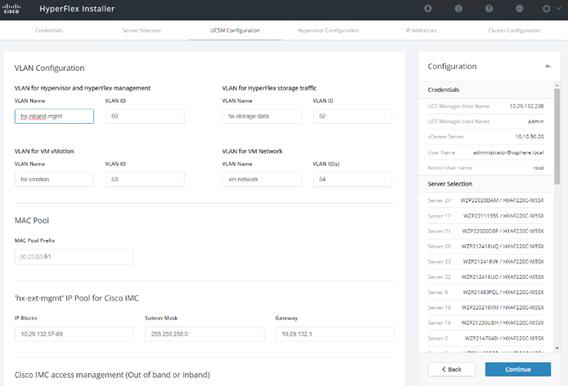

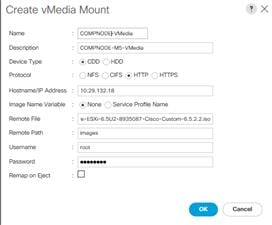

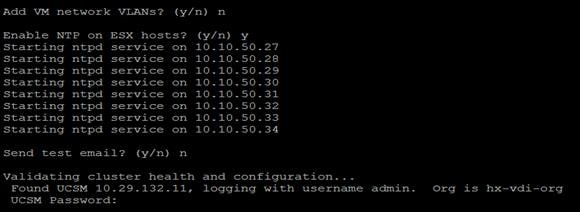

Cisco HyperFlex Data Platform インストーラ VM の導入

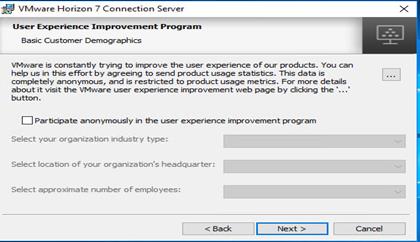

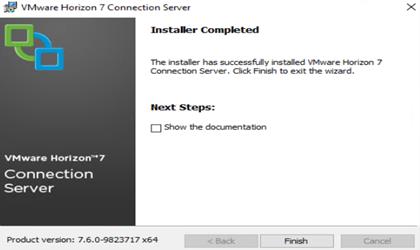

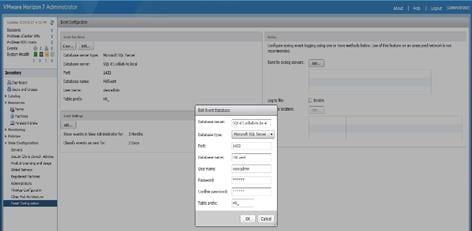

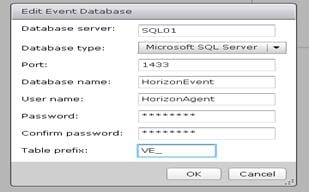

Horizon 7 インフラストラクチャ コンポーネントのインストール

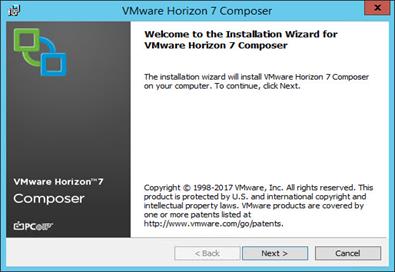

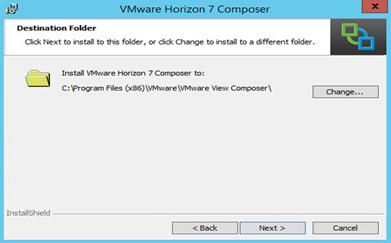

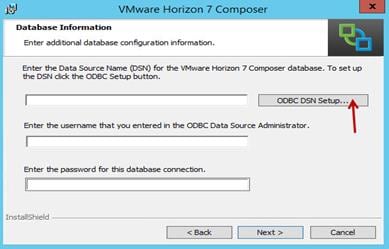

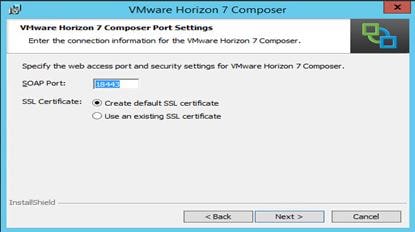

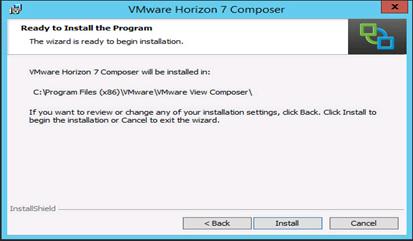

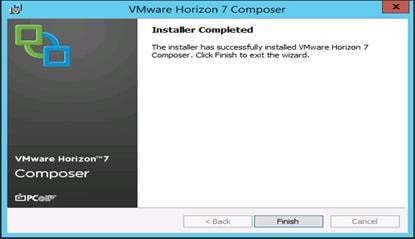

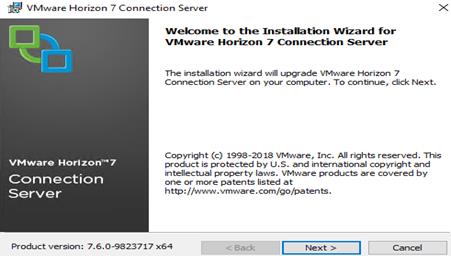

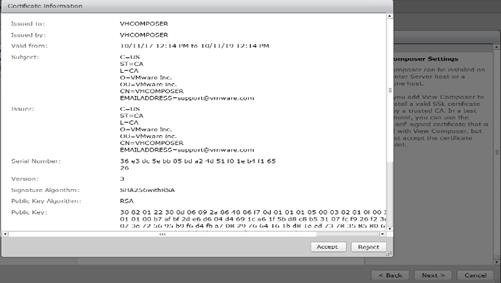

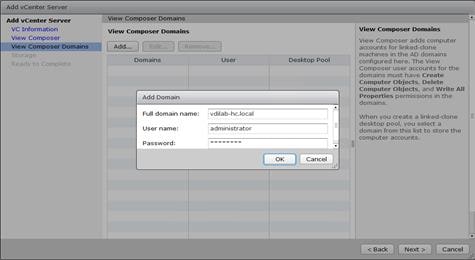

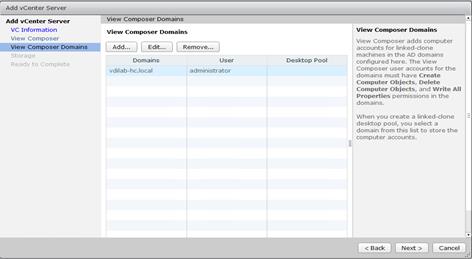

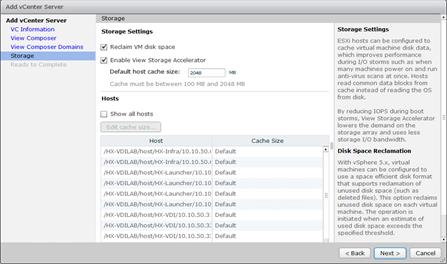

VMware Horizon Composer Server のインストール

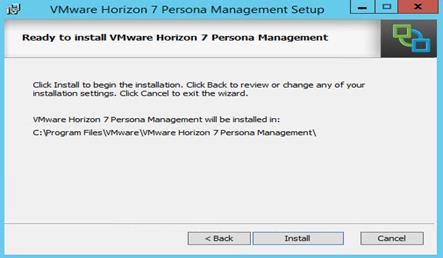

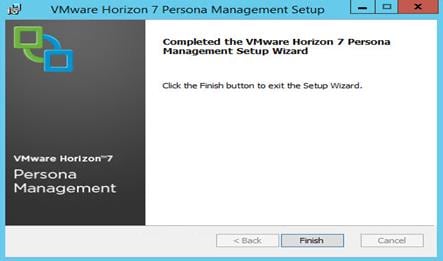

Horizon Persona Manager のインストール

テスト済み Horizon 展開タイプのマスター イメージの作成

Microsoft Office 2016 をインストールした Microsoft Windows 10 および Server 2016 R2 の準備

ベース Windows 10 または Server 2016 ゲスト OS の最適化

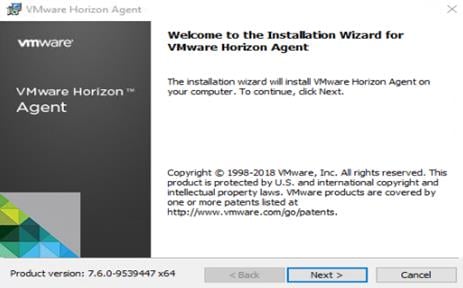

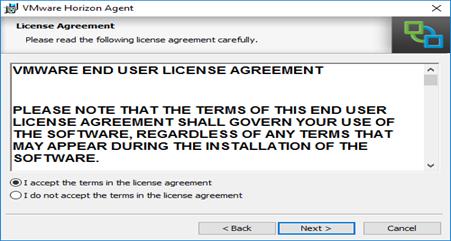

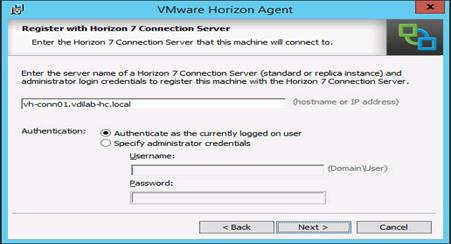

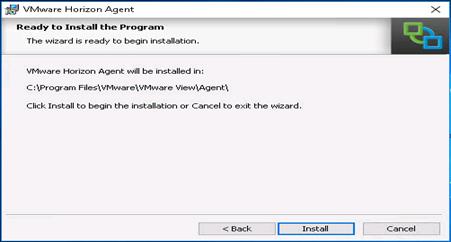

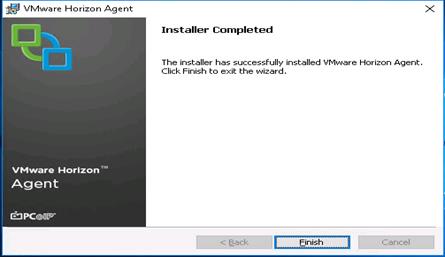

Horizon 用仮想デスクトップ エージェント ソフトウェアのインストール

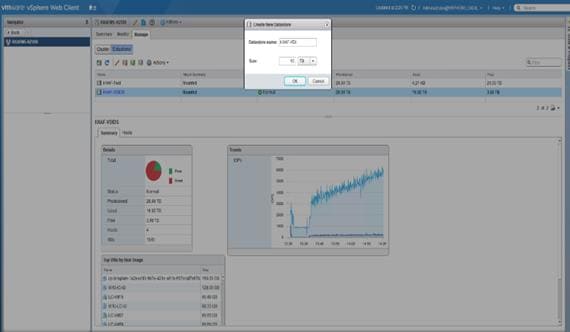

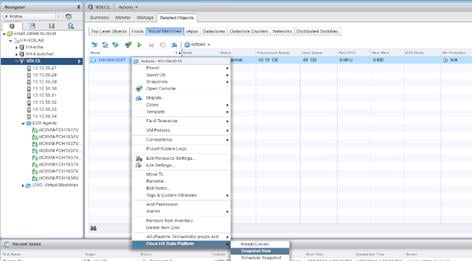

デスクトップ プールの自動作成に使用するネイティブ スナップショットの作成

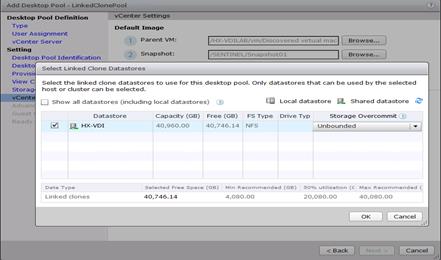

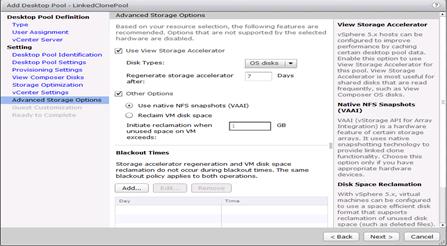

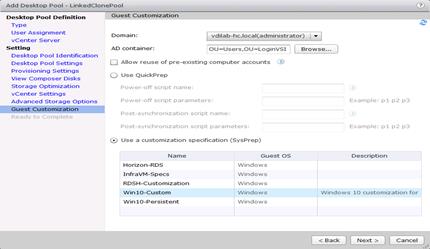

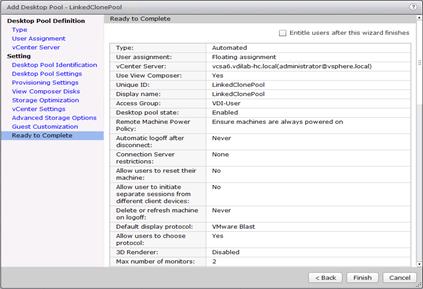

VMware Horizon リンクド クローン Windows 10 デスクトップ プールの作成

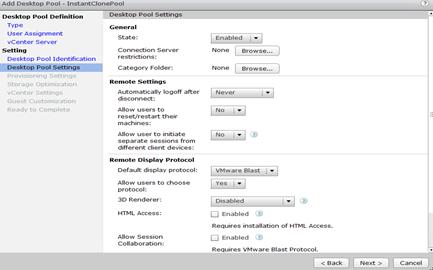

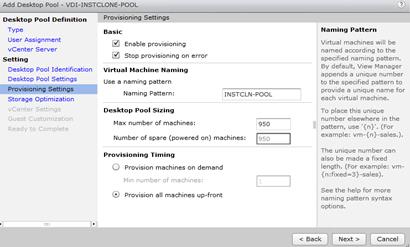

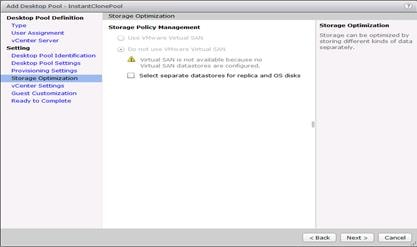

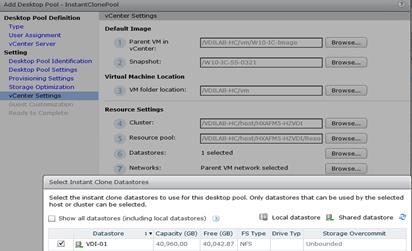

VMware Horizon インスタント クローン Windows 10 デスクトップ プールの作成

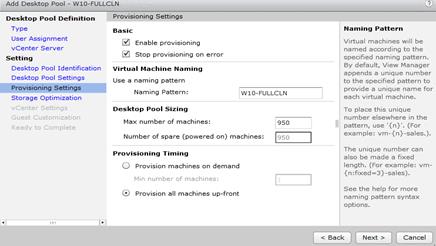

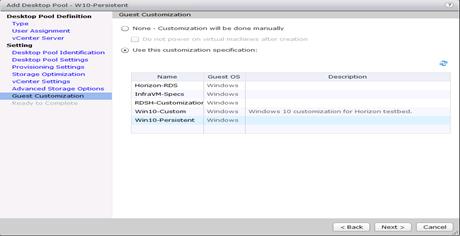

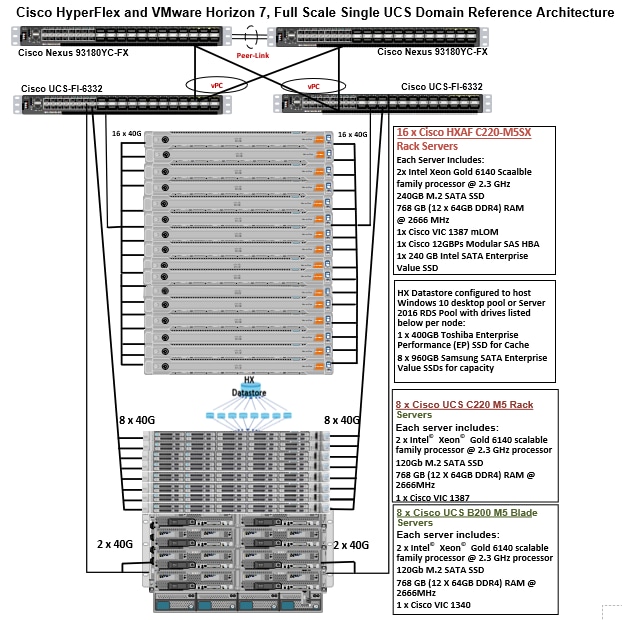

VMware Horizon 永続 Windows 10 デスクトップ プールの作成

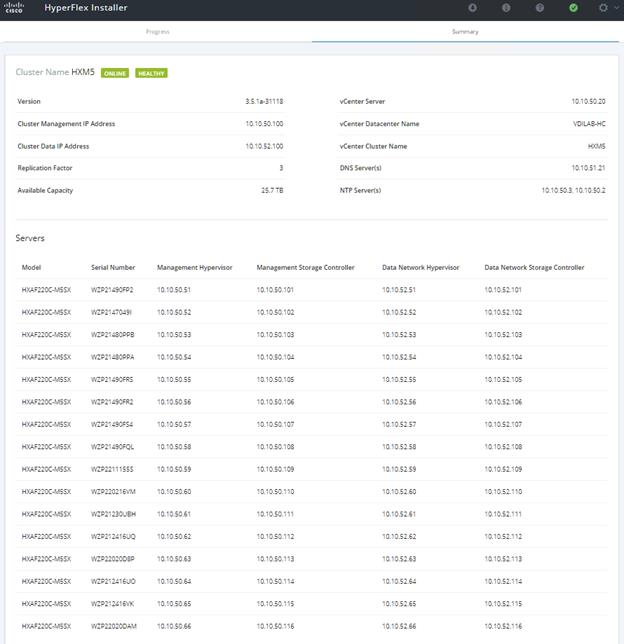

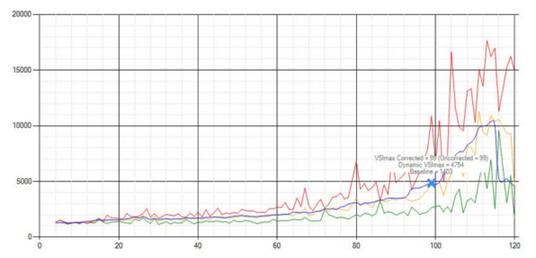

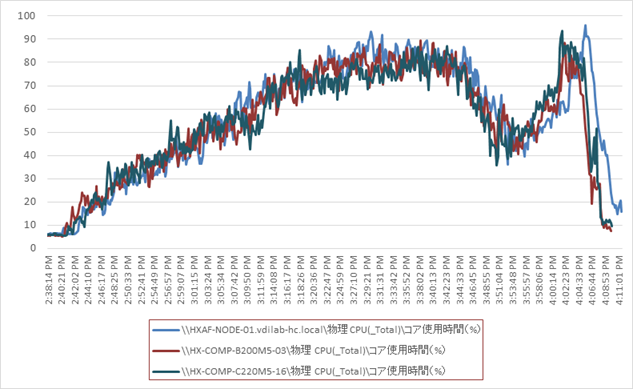

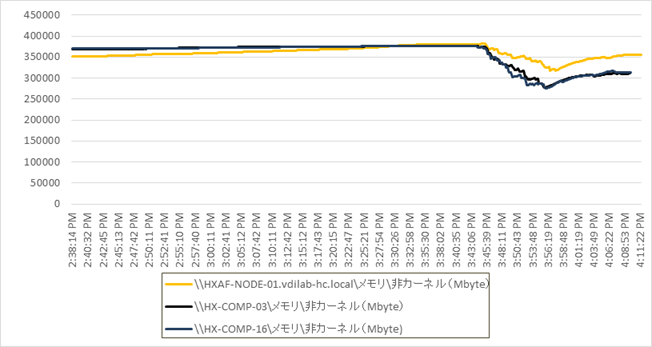

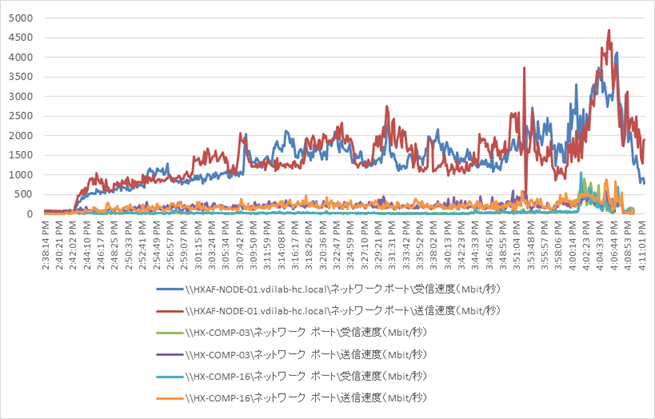

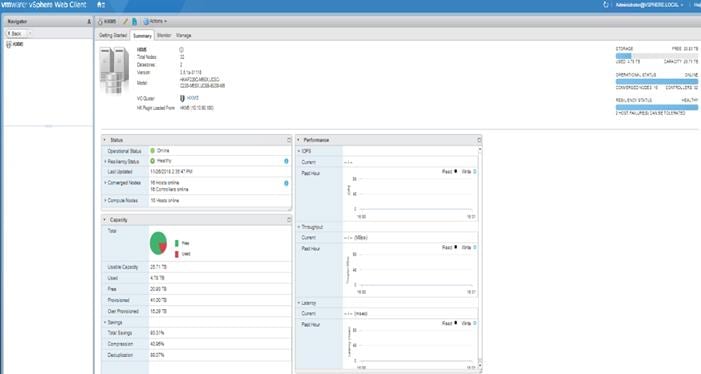

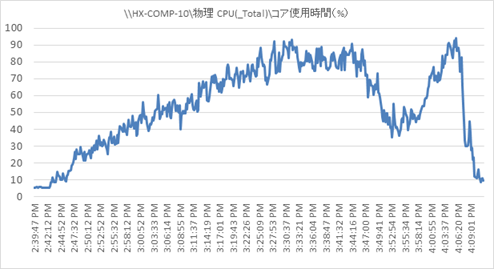

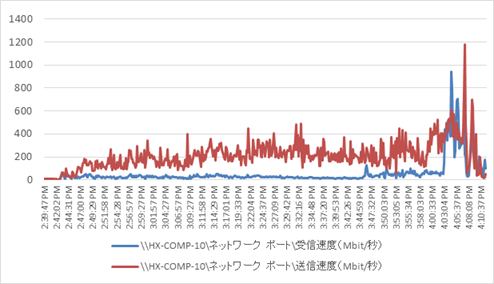

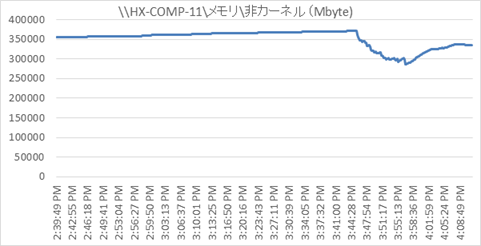

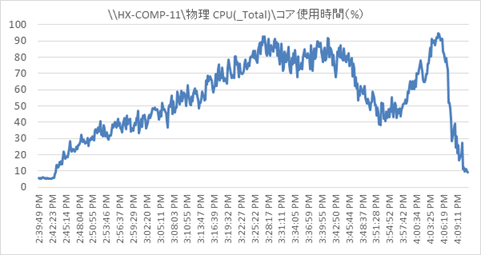

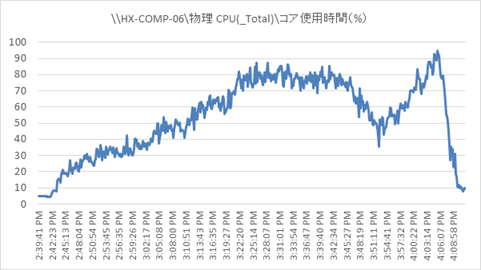

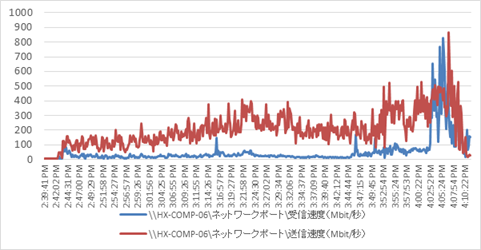

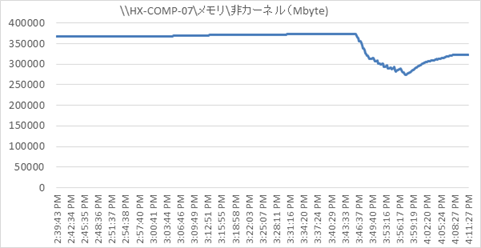

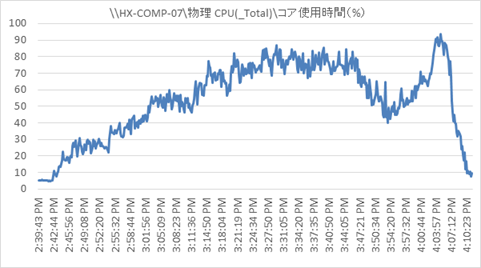

32 ノードの Cisco HyperFlex クラスタでの 4400 ユーザのフルスケール テスト

付録 A – Cisco Nexus 93180 スイッチの構成

市場の変化に即応するためには、瞬時に対応できる開発プロセスを支えるシステムが欠かせません。Cisco HyperFlex™ システムでは、ハイパーコンバージェンスの持てる力を最大限に引き出し、IT をワークロード ニーズに適応させることができます。ソフトウェア デファインド インフラストラクチャ アプローチを採用したこのシステムでは、Cisco HyperFlex HX シリーズ ノードによるソフトウェア デファインド コンピューティング、強力な Cisco HyperFlex HX Data Platform を利用したソフトウェア デファインド ストレージ、そして Cisco® Application Centric Infrastructure(Cisco ACI™)と統合できる Cisco UCS ファブリックによるソフトウェア デファインド ネットワークが 1 つのシステムに統合されています。

この一元化された技術により、サーバ、ストレージ、ネットワークが統合された適応性の高いクラスタとして実現します。この中では、リソースの迅速な導入、適合、拡大・縮小、管理が可能で、アプリケーションとビジネスを効率化できます。

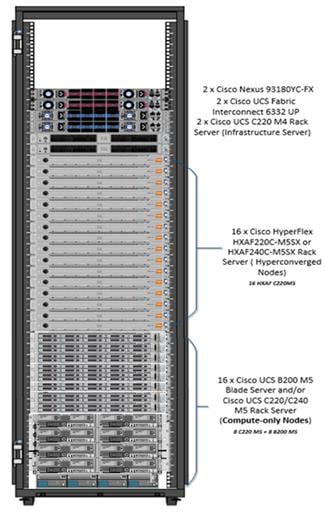

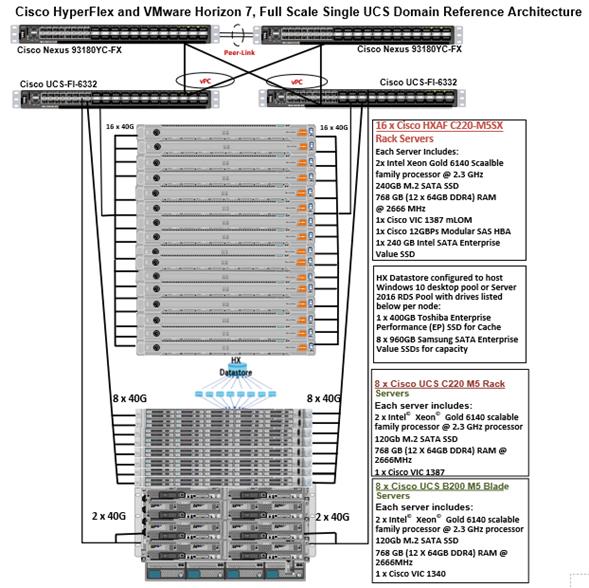

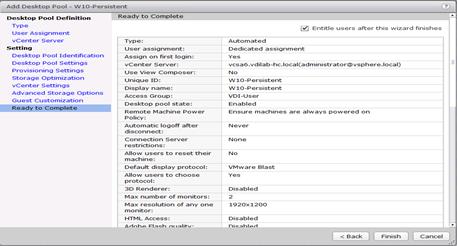

このドキュメントは、32 ノード(Cisco HyperFlex HXAF220C-M5SX サーバ 16 台と、Cisco UCS C220 M5 8 台、B200 M5 ブレード サーバ 8 台)の Cisco HyperFlex システムで、最大 4400 ユーザの混合ワークロードを扱う場合のアーキテクチャ リファレンスと設計ガイドです。VMware Horizon 7.6 仮想デスクトップ セッションで、WindowsServer 2016 RDSH サーバをベースとするリモート デスクトップ サーバ セッションと Office 2016 搭載の Microsoft Windows 10 を実行する場合の導入ガイダンスとパフォーマンス データを提供します。特に、vSphere 6.5 でインスタントクローン、リンククローン、および持続的仮想デスクトップを使用したプロビジョニングについて説明します。

このソリューションでは、あらかじめ統合され、ベスト プラクティスに則ったデータセンター アーキテクチャが採用されており、Cisco Unified Computing System(Cisco UCS)、Cisco Nexus® 9000 ファミリ スイッチ、Cisco HyperFlex Data Platform ソフトウェア バージョン 3.5(1a) での構築が対象となっています。

ソリューションのペイロードは、Cisco HyperFlex HXAF220C-M5SX ハイパーコンバージド ノード、Cisco UCS C220 M5 ラック サーバ、および Cisco UCS B200 M5 ブレード サーバ上で 100 % 仮想化されます。これらは、VMware vSphere 6.5 U2 ハイパーバイザを実行するオンボード Flex-Flash コントローラの SD カードを介して起動されます。仮想デスクトップは VMware Horizon 7.6 で構成されており、従来の永続/非永続仮想デスクトップ(Windows 7/8/10)、ホスト アプリケーションおよびリモート デスクトップ サービス(RDS)(Microsoft Server 2008 R2)、Windows Server 2012 R2、または Windows Server 2016 ベースのデスクトップが含まれています。これまでにない拡張性とシンプルな管理が実現されており、32 ノードの Cisco HyperFlex クラスタで、インスタントクローン浮動割り当ての Windows 10 デスクトップ(950)、コンポーザベースのラインクローン浮動割り当ての Windows 10 デスクトップ(950)、完全クローン デスクトップ(950)をプロビジョニングできます。本ドキュメントを利用することで、このソリューションを導入するお客様に対して、推奨されるベスト プラクティスとサイジングに関するガイドラインも提供します。

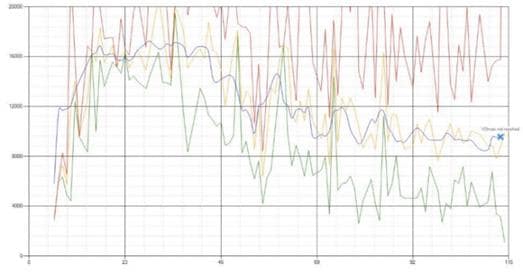

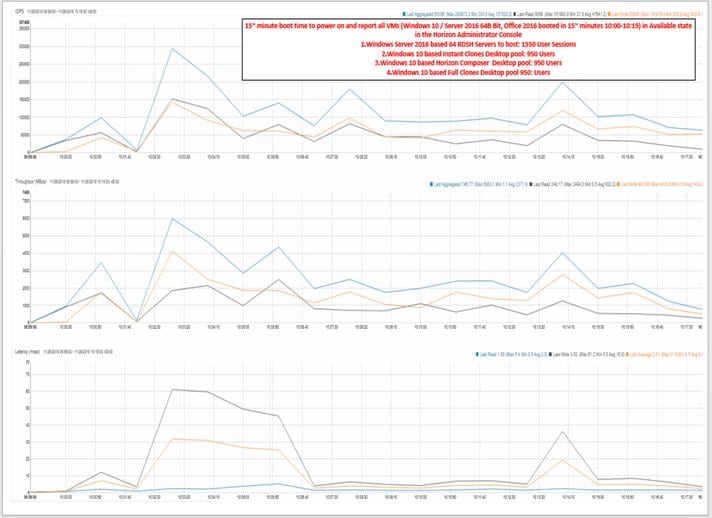

このソリューションでは、4400 の RDSH 仮想サーバおよび仮想デスクトップ マシンを 15 分以内で起動させ、ユーザが就業開始するような、HyperFlex 上の仮想ワークスペースを利用開始するケースでも、大きな遅延が発生しないようにします。

このソリューションでは、ハードウェア アクセラレーション グラフィックのワークロードもサポートしています。Cisco HyperFlex HXAF240c M5 ノード、および Cisco UCS C240 M5 コンピューティング専用サーバでは、最大 2 枚の NVIDIA M10 カードまたは P40 カードと、最大 6 枚の NVIDIA P4 カードをサポートできます。Cisco UCS B200 M5 サーバでは、高密度、高パフォーマンスのグラフィック ワークロード用に、最大 2 枚の NVIDIA P6 カードをサポートします。この機能と VMware Horizon との統合方法の詳細については、NVIDIA GPU およびソフトウェアを使用した第 5 世代サーバに関する『Cisco Graphics White Paper』を参照してください。

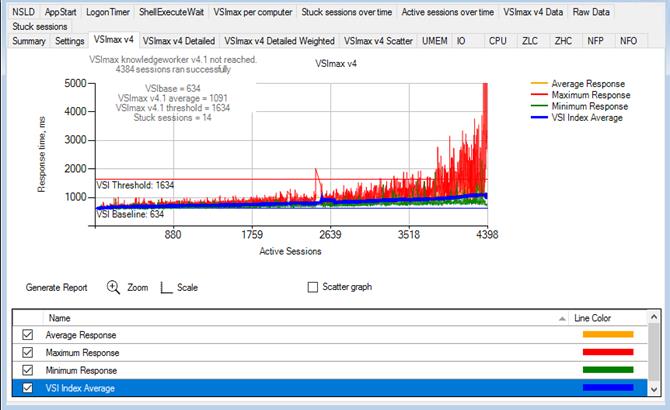

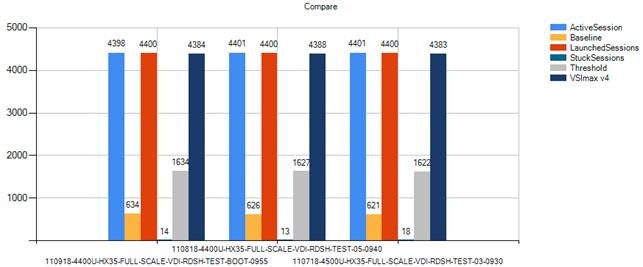

本ソリューションにより、仮想デスクトップを使用するエンド ユーザに対して非常に優れた操作性が提供されます。Login VSI 4.1x を使用して Knowledge Worker ワークロードをベンチマーク モードで評価したところ、テストしたすべての提供方法で、エンドユーザの平均反応時間が 1 秒を下回りました。これは業界でも最も高い性能にあることを示しています。

はじめに

データセンター設計における現在の業界の傾向としては、小規模な細かく拡張できるハイパーコンバージド インフラストラクチャが求められつつあります。事前検証済みの IT プラットフォームに合わせて仮想化をもちいることで、あらゆる規模のお客様がこの新しい技術を使用した「ジャストインタイムのインフラ提供」を模索しています。Cisco HyperFlex ハイパー コンバージド ソリューションでは、導入時間を短縮できるため、俊敏性の向上とコストの削減が可能です。最高品質のストレージ、サーバ、ネットワーク コンポーネントを使用して、デスクトップ仮想化のワークロード処理基盤として動作し、迅速かつ着実な導入とスケール アウトを可能とする効率的なアーキテクチャ設計が実現します。

対象読者

このドキュメントの対象読者には、セールス エンジニア、フィールド コンサルタント、プロフェッショナル サービス、IT マネージャ、パートナー エンジニアリング、および Cisco HyperFlex システムを導入しているお客様が含まれますが、これらに限定されません。必要に応じて外部参照が提示されますが、読者は、VMware 固有のテクノロジー、インフラストラクチャの概念、ネットワーキング接続、およびお客様のインストールのセキュリティ ポリシーに精通していることが求められます。

このマニュアルの目的

このドキュメントは、Cisco HyperFlex オールフラッシュ システムの Cisco Validated Design(CVD)として、体系的な設計、構成、実装について説明します。この Cisco HyperFlex オールフラッシュ システムでは、Cisco UCS 6300 シリーズ ファブリック インターコネクトおよび Cisco Nexus 93000 シリーズ ネットワーキング スイッチを使用した VMware Horizon 7 のワークロードが 4 つ別個に実行されます。

今回のリリースでの新機能

Cisco HyperFlex オールフラッシュ システムの Cisco Validated Design で、第 5 世代 UCS をベースにした HyperFlex システムに搭載可能なインテル Xeon スケーラブル ファミリー プロセッサーをベースとした仮想デスクトップ インフラストラクチャの検証結果をご案内するのは、今回が初めてとなります。次の機能が導入されています。

· Cisco HyperFlex を使用する場合の Cisco Nexus 93000 YC シリーズ サポートの検証

· Cisco UCS 4.0(1b) リリースおよび Cisco HyperFlex v 3.5(1a) のサポート

· VMware vSphere 6.5 U2 Hypervisor

· VMware Horizon 7.6 Remote Desktop Sever Hosted Sessions

· VMware Horizon 7.6 Horizon インスタント クローン、リンク クローン、および永続的デスクトップ

バージョン 3.5 の機能拡張

バージョン 3.5 の新機能の一部を以下にご紹介します。

· ネイティブ ディザスタ リカバリの機能拡張: シンプルな「移行計画ワークフロー」を使用して、ディザスタ リカバリ、VM の移行、レプリケーションの再開を簡単に実行できます。また、Stretched Cluster の導入でレプリケーション、計画的移行、ディザスタ リカバリがネイティブでサポートされます。詳細については、下記を参照してください。

Cisco HyperFlex Systems リリース 3.5 アドミニストレーション ガイド

· HX データ プラットフォーム インストーラの機能拡張:新しい拡張機能として、HX データ プラットフォーム インストーラの強化と信頼性向上が図られています。

· Hyper-V コンバージド ノードのクラスタ拡張。

· Stretched Cluster コンピューティング専用ノードおよびコンバージド ノードのクラスタ拡張。

· クラスタ作成ワークフローの一部として Hyper-V および Windows Server OS のベア メタル インストールが追加されています。

· ネットワーキングの機能拡張:HX コンバージドおよびコンピューティング専用ノードでマルチ VIC ネットワーク設計とサードパーティ製 NIC がサポートされます。詳細については、Cisco HyperFlex システム:ネットワーク トポロジを参照してください。

· アップグレードの機能拡張:ESXi ハイパーバイザの協調アップグレードのサポート。HXDP とサーバ ファームウェアについての既存のアップグレードに加えて、今回のリリースでは、HX Connect を介してすべてが協調して動作するシームレスなフル スタック アップグレードの機能が提供されています。

· リリース 3.5(1a) 以降では、今後のすべてのアップグレードを HX Connect の UI で完了できます。今後のすべてのアップグレードについて、この機能はリリース 3.5 のすべてのクラスタで有効になります。古いバージョンからリリース 3.5 にアップグレードする場合は、引き続きドキュメントに記載されているブートストラップ スクリプトを実行してください。今回の新しいエンドツーエンドの UI ベースアップグレード機能は、今後のすべてのアップグレードで利用します。詳細については、『Cisco HyperFlex システム リリース 3.5 アップグレード ガイド』を参照してください。

· ESXi ロックダウン モード:ホストに許可するアクセスを制限することにより、VMware ESXi のロックダウン モードをサポートし、ESXi ホストのセキュリティを強化します。このモードを有効にすると、ESXi ホストには vCenter Server またはダイレクト コンソール ユーザ インターフェイス(DCUI)からのみアクセスできます。詳細については、『Cisco HyperFlex システム リリース 3.5 インストール ガイド』を参照してください。

· HX Edge 10GbE エッジ ネットワーク オプション:新しい 10GbE エッジのサポートにより、HyperFlex Edge クラスタ向けに完全に冗長な高速接続オプションが追加提供されます。詳細については、『Cisco HyperFlex システム リリース 3.5 エッジ導入ガイド』を参照してください。

· Cisco Container Platform(CCP)と Open Shift Platform(OpenShift)の統合:Kubernetes とのストレージ統合により、HyperFlex の動的な(オンデマンドの)永続的ボリュームが使用できます。この機能は OpenShift(バージョン 3.10)と Cisco Container Platform(CCP)でサポートされます。詳細については、『Cisco HyperFlex Systems Kubernetes リリース 3.5 アドミニストレーション ガイド』を参照してください。

· NVIDIA V100 GPU での人工知能および機械学習(AI/ML)ワークロード:HyperFlex ノード内で NVIDIA Tesla V100 GPU の統合を使用して AI/ML のアプリケーションを作成できます。詳細については、Cisco HyperFlex HX シリーズ スペック シートを参照してください。

· Permanent License Reservation(PLR):この機能は、高度なセキュリティで保護されたインテリジェンス、エアギャップ環境、軍用環境など、外部との通信が制限される状況を対象としています。詳細については、『Cisco HyperFlex システム注文およびライセンス ガイド』を参照してください。

· DISA STIG の自動化:VMware vSphere に関連して、米国国防情報システム局(DISA)が推奨する SecurityTechnical Implementation Guides(STIG)の実装を自動化することで、HyperFlex コンバージドおよびコンピューティング専用ノードのセキュリティ ポスチャを強化します。

· テクニカル サポート モード:テクニカル サポート モードを無効にして HyperFlex コンバージド ノードのセキュリティ ポスチャを強化します。これにより、SSH 経由でのコントローラ VM へのリモート アクセスが無効になります。

· マルチハイパーバイザ サポートにより、VMware ESXi ハイパーバイザ、または Microsoft Hyper-V のどちらかによる HyperFlex のインストールが可能になります。このドキュメントでは、VMware ESXi ハイパーバイザによる HyperFlex のインストールとサポートを中心に説明します。

· Cisco HyperFlex クラスタのインストールは 2 つの物理的な場所にまたがって実行でき、ストレッチ クラスタを作成できます。「スプリット ブレイン」の状況を防ぐため、監視用の仮想マシンを実行するための 3 つ目の場所が必要になります。

· ノード障害の許容度を高めるため、HyperFlex クラスタは論理可用性ゾーンを使用して設定できます。論理可用性ゾーンにより、ノードがグループに分割され、データがすべてのゾーンにわたって均等に分散されます。

· 64 ノード クラスタのサポート:クラスタあたり最大 32 のコンバージド ノードと 32 のコンピューティング専用ノードを使用できます。

· Cisco HyperFlex オールフラッシュ ノードで、Intel Optane ベースの NVMe ベース SSD をキャッシュ ドライブとして使用できます。

· HyperFlex HX240-M5SL モデル サーバで、ストレージ容量を高めるためにラージ フォーム ファクタのハード ドライブを使用できます。

· HyperFlex Connect のネイティブの HTML5 管理 GUI で、拡張とカスタマイズが可能です。

· 新しい FlexVolume ドライバを介したストレージとネットワーキングの自動導入で、Kubernetes がサポートされ、完全に統合されたコンテナ プラットフォームを作成できます。

ドキュメンテーション ロードマップ

包括的なドキュメント スイートについては、Cisco HyperFlex システム ドキュメンテーション ロードマップを参照してください。

![]() ドキュメンテーション ロードマップではログインが必要です。

ドキュメンテーション ロードマップではログインが必要です。

Cisco HX Data Platform を正常にインストールするには、特定のソフトウェアおよびハードウェアのバージョン、ネットワーク設定が必要です。すべての要件については、Cisco HyperFlex Systems Getting Started Guide を参照してください。

ハードウェアとソフトウェアの相互依存関係の一覧については、Cisco UCS Manager リリース バージョンの Cisco HyperFlex HX シリーズにおけるハードウェアおよびソフトウェアの相互運用性 [英語] を参照してください。

データセンターの市場分野は、業界標準のシステム上で動作する仮想化の進んだプライベート、パブリック、ハイブリッド クラウド コンピューティング モデルに移行しつつあります。こうした環境では、管理が容易で拡張性に優れ、繰り返し使用可能な統一的な設計ポイントが必要になります。

このような要因から、事前設計されたコンピューティング、ネットワーキング、ストレージの構成要素に対するニーズが生じ、初期設計のコスト削減、管理のシンプル化、水平スケーラビリティ、高い使用率の実現への最適化が求められています。使用例として以下が挙げられます。

· 大企業のデータセンター(障害発生時の対象範囲は小さい)

· サービス プロバイダーのデータセンター(障害発生時の対象範囲は小さい)

· 一般企業・期間の汎用的データセンター

· リモート オフィス/ブランチ オフィス

· 小中規模における独立、個別展開

· ソリューションの概要

この Cisco Validated Design では、Microsoft Server 2016 をベースとした Horizon Microsoft Windows 10 仮想デスクトップと Horizon RDSH サーバ デスクトップ セッションの両方の統合基盤として機能するハードウェアとソフトウェアの定義・設定情報を含んでいます。単一システムとして、Cisco HyperFlex ハードウェアおよび Data Platform ソフトウェア、Cisco Nexus® スイッチ、Cisco Unified Computing System(Cisco UCS®)、VMware Horizon、VMware vSphere ソフトウェアを対象とした複合ワークロード ソリューションが含まれます。設置面積は、業界で標準的な 42U ラックシステムの 18 ラック ユニット分に相当し、ネットワーキング コンポーネント、コンピューティング コンポーネント、ストレージ コンポーネントなどに適した設計となっています。Cisco Nexus スイッチおよび Cisco UCS ファブリック インターコネクトには充分なポート密度があり、ネットワーク コンポーネントに複数の HyperFlex クラスタを搭載し、単一の Cisco UCS ドメインとすることが可能です。

Cisco Validated Design アーキテクチャの主な利点は、お客様の要件に合わせて環境をカスタマイズできることです。要件や要求の変化に合わせて簡単に拡張でき、スケール アップ(Cisco Validated Design ユニットにリソースを追加)とスケール アウト(Cisco Validated Design ユニット自体を追加)の両方が可能です。

このドキュメントで詳しく説明するリファレンス アーキテクチャでは、ハイパーコンバージド デスクトップ仮想化ソリューションの特長として復元力、費用面でのメリット、導入の容易さが強調されています。単一のインターフェイスで複数のプロトコルを利用することができ、まさに一度接続すれば事足りるアーキテクチャであることから、顧客の選択と投資保護が実現します。

シスコと VMware 社のテクノロジーを結集することにより、効率性と堅牢性が高く、手頃なデスクトップ仮想化ソリューションが生まれました。このソリューションは、仮想デスクトップとホステッド共有デスクトップが混在する導入をサポートし、さまざまな使用例に対応できます。ソリューションの主要コンポーネントには、次のようなものがあります。

· 同じサイズで、より強力に。Cisco HX シリーズ ノードは、768 GB の 2666 Mhz メモリを備えたデュアル 18 コア 2.3 GHz Intel Xeon(Gold 6140)スケーラブル ファミリー プロセッサーと VMware Horizon を搭載しており、同一ハードウェアの過去にリリースされた世代の製品に比べ、より多くの仮想デスクトップをサポートします。さらに、このスタディで使用された Intel Xeon Gold 6140 18 コア スケーラブル ファミリー プロセッサーを利用したケースでは、サーバごとの容量の増加とコストのバランスが実現されました。

· デザインに組み込まれたハイ アベイラビリティによる耐障害性。仮想デスクトップおよびインフラストラクチャ ワークロード用に、複数の Cisco HX シリーズ ノード、Cisco UCS ラック サーバ、Cisco UCS ブレード サーバをベースとして、さまざまな設計が行われており、テストされたあらゆるペイロードに対して、N+1 のサーバ耐障害性が考慮されています。

· 厳しいブート シナリオで限界に対するストレス テストを実施。4400 ユーザのホステッド仮想デスクトップとホステッド共有デスクトップが混在する環境をブートし、15 分以内に Horizon 7 への登録が完了しました。コールド スタートが非常に高速で安定したデスクトップ仮想化システムをお客様に提供できます。

· シミュレーションされたログイン ストームで限界に対するストレス テストを実施。4400 人のユーザ全員がログインして、プロセッサが過負荷になったり、メモリまたはストレージ リソースを使い果たしたりすることなく、ワークロードは 48 分の間、定常状態で実行されました。非常に要求の厳しいログインおよび起動ストームを簡単に処理できるデスクトップ仮想化システムをお客様に提供できます。

· データセンター向けの非常にコンパクトなコンピューティング。Cisco Nexus スイッチと Cisco ファブリック インターコネクトを含んだ初期段階のシステム構成は、26 ラック ユニットで 4400 ユーザをサポートできるようになっています。段階的なシート:Cisco HyperFlex クラスタを一度に 1 つずつ、合計 64 ノードに追加できます。

· 100 % の仮想化:この CVD のデザインでは、VMware ESXi 6.5 での 100 % の仮想化が検証済みです。仮想デスクトップ、ユーザ データ、プロファイル、サポートするすべてのインフラストラクチャ コンポーネント(Active Directory、SQL サーバ、VMware Horizon コンポーネント、Horizon VDI デスクトップ、RDSH サーバを含む)が仮想マシンとしてホストされました。これにより、システム全体が Cisco HyperFlex ハイパーコンバージド インフラストラクチャとステートレスな Cisco UCS HX シリーズ サーバで実行されることになり、お客様にメンテナンス性と容量追加における高い柔軟性を提供します(ソリューションのキャパシティを最大に高め、最適な経済性を追求するため、VM のインフラストラクチャは HX クラスタの外側の Cisco UCS C220 M4 ラック サーバ 2 台でホストされています)。

· シスコのデータセンターの管理:シスコは、シンプルな拡張性、一貫性の保証、容易なメンテナンスを実現する新しい Cisco UCS Manager 4.0(1b) ソフトウェアによって、業界におけるリーダーシップを維持しています。また、Cisco UCS Manager、Cisco UCS Central、Cisco UCS Director の継続的な開発に取り組んでおり、ローカル側、Cisco UCS ドメイン間、全世界における顧客環境の一貫性を確実なものとしています。Cisco UCS ソフトウェア スイートを提供することで、導入/運用管理をさらにシンプルにし、顧客組織におけるコンピューティング、ストレージ、ネットワーキングの各分野の専門家が、制御できる範囲を引き続き広げられるようにします。

· Cisco 40G ファブリック:40G ユニファイド ファブリックには、6300 シリーズ ファブリック インターコネクトに関する追加検証が加えられ、より厳しいワークロード テストを実施しながら、優れたユーザ応答時間が維持されました。

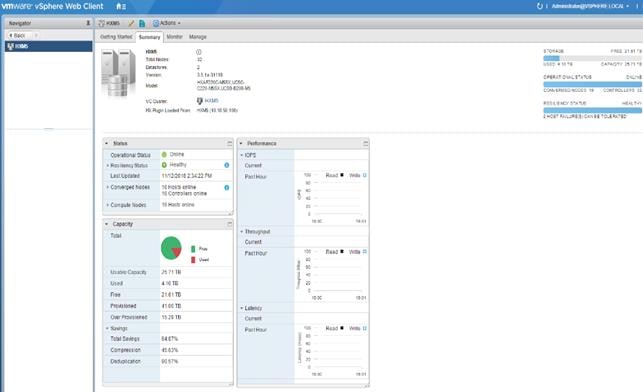

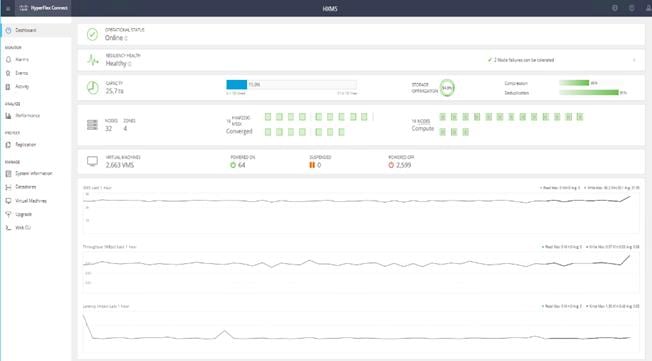

· Cisco HyperFlex Connect(HX Connect):HyperFlex v2.5 以降では、HTML 5 をベースとした新しい Web UI が導入され、Cisco HyperFlex の主要管理ツールとして利用可能となっています。これはクラスタ上で一元化された制御ポイントとして機能します。管理者はボリュームを作成し、データ プラットフォームの状態をモニタリングし、リソースの使用率を管理できます。また管理者はこのデータを使用して、クラスタをいつ拡張する必要があるかを予測することもできます。

· Cisco HyperFlex ストレージのパフォーマンス:Cisco HyperFlex では、業界トップクラスのハイパーコンバージド ストレージ性能が実現されており、相当に負荷の高い I/O バースト(ログイン ストームなど)でも効率的に処理できます。低遅延で書き込みスループットが高く、シンプルで柔軟なビジネス継続性を実現し、デスクトップ単位のストレージ コストの削減を支援します。

· Cisco HyperFlex の俊敏性:Cisco HyperFlex システムにより、ユーザがインフラストラクチャに対してシームレスにストレージを追加、アップグレード、削除でき、仮想デスクトップの要件を満たせるようになります。

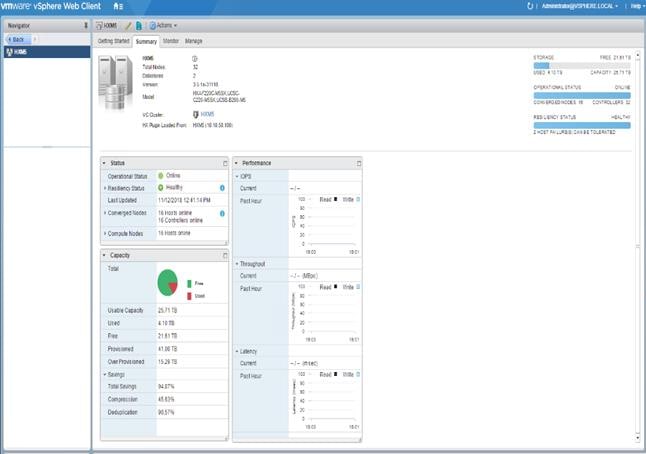

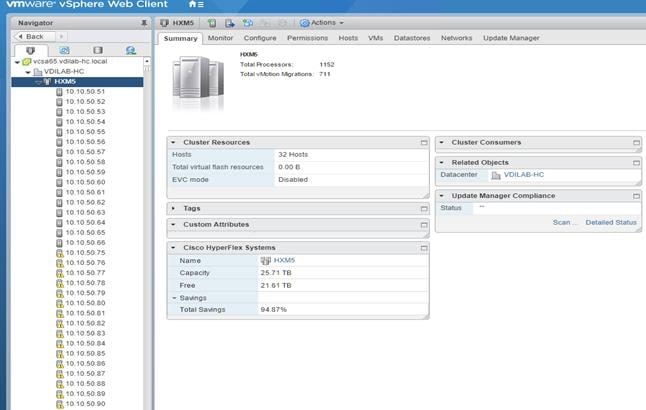

· Cisco HyperFlex vCenter の統合:VMware vSphere 用 Cisco HyperFlex プラグインにより、ストレージのプロビジョニング、ストレージのサイズ変更、クラスタの正常性ステータスとパフォーマンスのモニタリングといった主要なストレージ タスクを、vCenter Web クライアントから直接、1 つの画面を通して簡単なボタン操作で自動化できます。vCenter 管理者の経験があれば特に学習を必要とせずに HyperFlex を環境に導入できます。

· VMware Horizon 7 のメリット:VMware Horizon 7 は、ホステッド共有デスクトップおよびアプリケーション(RDS)と完全な仮想デスクトップ(VDI)の両方をサポートする、新しい統一製品アーキテクチャに準拠しています。今回新しくリリースされた Horizon により、大規模な VDI 管理に伴うタスクが簡素化されます。モジュラ型ソリューションにより、ユーザ数の増加に合わせて Windows のアプリやデスクトップをシームレスに配信できます。また、PCoIP と Blast の大幅な強化により、ワークステーションからモバイル デバイス、ラップトップ、タブレット、スマートフォンに至るさまざまなエンドポイント デバイス タイプにわたって、パフォーマンスの最適化とユーザ エクスペリエンスの向上が促進されます。

· パフォーマンスと拡張性の最適化。ホステッド共有デスクトップ セッションの場合、Horizon 7 RDSH 仮想マシンに割り当てられた vCPU の数が、サーバ上で使用可能なハイパースレッド(論理)コアの数を超えない場合に最高のパフォーマンスが得られました。つまり、最高のパフォーマンスは、仮想化 RDS システムを実行している仮想マシンに対して、限度を超えた CPU リソースをコミットしない場合に得られます。

· デスクトップ マシンのプロビジョニングが簡単に。VMware Horizon 7 により、このソリューションではホステッド仮想デスクトップだけでなくホステッド共有デスクトップ仮想マシンもプロビジョニングできます。どちらも「自動浮動割り当てデスクトップ プール」という 1 つの方法でプロビジョニングされます。同じ Horizon 7 管理コンソールで、永続的なデスクトップに対して「専用のユーザ割り当てデスクトップ プール」がプロビジョニングされました。Horizon 7 では、「インスタントクローン」と呼ばれる非永続的な仮想デスクトップの新しいプロビジョニング方法が導入されています。この方法により、ゲスト OS のライフサイクル消費量とメンテナンス時間枠が大幅に減少します。

オールフラッシュとハイブリッド

当初の HyperFlex ハイブリッドシステムでは、一次ストレージ キャッシュ層では SSD を使用し、長期ストレージ データストア層では HDD を使用するハイブリッド コンバージド ノードが特徴でした。ハイブリッド HyperFlex システムは、エントリまたはミッドレンジのストレージソリューションに適しています。ハイブリッド ソリューションは、ディスクの高パフォーマンスがあまり重要視されない多くの仮想環境に導入されています。一方で、高パフォーマンスが要求されるクリティカルなアプリケーション用途での導入も大幅に増えています。高パフォーマンスが要求される用途でハイブリッド HyperFlex システムを使う場合、ストレージ遅延の増大による影響を受けやすいことが主な課題になります。ハード ディスクの物理特性により、遅延の増大がボトルネックになることは避けられません。理想的には、すべてのストレージ運用がキャッシュ SSD 層で行われれば、ハイブリッド システムのパフォーマンスは非常に高くなります。しかしシナリオによっては、読み書きされるデータ量がキャッシュ層の容量を超過し、HDD データストア層の負荷が増加して遅延も増大し、パフォーマンスが低下します。

HyperFlex オールフラッシュシステムは、遅延の影響を受けやすい、高パフォーマンスを必要とする用途に最適です。フラッシュに最適化された専用の高パフォーマンス ログファイル システムを備えた HyperFlex オールフラッシュシステムでは、次のことが実現されます。

· クラスタ内の HyperFlex オールフラッシュ モデルおよびコンピューティング専用ノードの仮想マシンすべてにおいて、安定した高パフォーマンスを実現

· Microsoft SQL や Oracle などのデータ集約型のアプリケーションやデータベースで、高い安定性と低遅延を実現

· NVMe キャッシュ SSD のサポートによりパフォーマンスが向上

· フラッシュ メモリ構成に適した、将来を見越したアーキテクチャ:

- クラスタ全体の SSD をプーリングすることでパフォーマンスを最大化し、SSD 使用率のバランスをとって SSD ライフ負荷を分散

- 分散対応したログファイル システムにより、データ パスが最適化され、書き込み回数の増加を抑制

- 書き込みは、順次書き込み主体の処理によりフラッシュ ドライブの劣化(ライフタイム消費)を軽減し、コンポーネントの寿命を延長

- 重複排除や圧縮などによるインライン スペースでの最適化によりデータ操作を最小化し、劣化を軽減

· 高密度ドライブによってシステム容量が増加し、運用コストを削減

· スケールアウトが容易な分散インフラストラクチャと、個々のリソースを別個にスケールアウトできる柔軟性を備えたクラウド スケール ソリューション

Cisco HyperFlex でハイブリッド モデルとオールフラッシュ モデルがサポートされたことで、容量、アプリケーション、パフォーマンス、予算の要件に基づいて、適切なプラットフォーム構成を選択できるようになりました。オールフラッシュ構成では、反復可能かつ持続可能な高パフォーマンスが得られます。これは、多くのデータ セットを扱うシナリオ、つまり稼働中に多量のデータを扱うシナリオに特に最適です。ハイブリッド構成は、Cisco HyperFlex ソリューションのシンプルさを求めると同時に、容量の影響を受けやすいソリューション、低予算、

パフォーマンスの影響を受けやすいアプリケーション数の抑制を必要とするお客様に適しています。

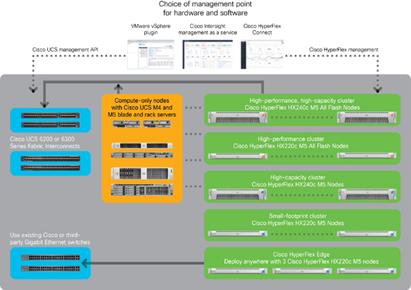

Cisco HyperFlex コンピューティング専用ノード

現行モデルの Cisco UCS M4 および M5 世代サーバ(Cisco UCS C880 M4 と Cisco UCS C880 M5 を除く)と、従来の M3 世代サーバ モデルの一部と合わせて、HyperFlex クラスタに接続するコンピューティング専用ノードとして使用できます。コンピューティング専用ノードでは任意の有効な CPU およびメモリ構成が可能で、サーバを SAN、ローカル ディスク、内蔵 SD カードからブートするように設定できます。コンピューティング専用ノードとして使用できるサーバには、次のものがあります。

· Cisco UCS B200 M3 ブレード サーバ

· Cisco UCS B200 M4 ブレード サーバ

· Cisco UCS B200 M5 ブレード サーバ

· Cisco UCS B260 M4 ブレード サーバ

· Cisco UCS B420 M4 ブレード サーバ

· Cisco UCS B460 M4 ブレード サーバ

· Cisco UCS B480 M5 ブレード サーバ

· Cisco UCS C220 M3 ラックマウント サーバ

· Cisco UCS C220 M4 ラックマウント サーバ

· Cisco UCS C220 M5 ラックマウント サーバ

· Cisco UCS C240 M3 ラックマウント サーバ

· Cisco UCS C240 M4 ラックマウント サーバ

· Cisco UCS C240 M5 ラックマウント サーバ

· Cisco UCS C460 M4 ラックマウント サーバ

· Cisco UCS C480 M5 ラックマウント サーバ

Cisco HyperFlex データ プラットフォーム ソフトウェア

Cisco HyperFlex HX Data Platform は専用の高性能な分散ファイルシステムで、多岐にわたるエンタープライズクラス データ管理サービスを提供します。データ プラットフォームの革新により、分散ストレージ テクノロジーが再定義され、従来のハイパーコンバージド インフラストラクチャをしのぐ性能を提供します。HX データ プラットフォームはエンタープライズ共有ストレージ システムに期待される全機能を備えているため、複雑なファイバ チャネル ストレージ ネットワークと端末の設定管理の必要がなくなります。このプラットフォームは操作を簡素化し、データの可用性を保証します。エンタープライズクラスのストレージ機能には、次のものがあります。

· データ保護:クラスタ全体のデータ コピーを複数作成します。単一または複数のコンポーネントに障害が発生した場合にも、データの可用性は影響を受けません(設定されたレプリケーション ファクタの設定によって異なります)。

· ストレッチ クラスタ:2 つの物理的な場所の間でノードを均等に分割できます。これにより、両方の場所ですべてのデータの重複コピーが維持され、サイト全体の障害に備えた保護機能が提供されます。

· 論理可用性ゾーン:ノードを複数の論理グループに分け、1 つのグループにデータのコピーが複数存在しないような方法で、それらのグループ全体にデータを配布します。これによりノード障害からの保護が強化され、より多くのノードが障害を起こしてもクラスタ全体をオンラインに保てるようになります。

· 重複排除:常にオンになっており、仮想クラスタ内のストレージ要件を削減できます。仮想クラスタ内では、ゲスト仮想マシンの OS インスタンスが複数コピーされるため、大量の複製データにアクセスできます。

· 圧縮によりデータ ストレージ使用量を削減し、コストを削減します。またログ構造のファイル システムは、さまざまなサイズのブロックを保存し、内部のフラグメンテーションを減らすよう設計されています。

· レプリケーション:1 つの HyperFlex クラスタから別の HyperFlex クラスタに仮想マシン レベルのスナップショットを複製します。これにより、すべての VM のセカンダリ サイトに対してフェールオーバーが行われ、クラスタやサイトの障害から復旧できます。

· 暗号化:キャッシュ ドライブと容量ディスク上の全データを暗号化形式で保存します。偶発的なデータ損失やデータの盗難を防止します。キー管理は、ローカルの Cisco UCS Manager が管理するキーによって、または暗号化ドライブのキー管理プロトコル(KMIP)を通じた他社製のキー管理システム(KMS)と連動させることができます。

· シン プロビジョニングは、実際に利用する必要性が生じるまで、サポートするストレージ スペースを必要とせずに大きなボリュームを作成できるため、データ ボリュームの増加を簡素化し、ストレージを「成長に合わせた投資」という課題に対応します。

· 高速でスペース効率の高いクローン機能:仮想ストレージ ボリュームを迅速に複製できます。仮想マシンをメタデータの操作だけで複製でき、実際のデータ コピーは書き込み操作に対してのみ実行されます。

· スナップショット:バックアップとリモートレプリケーション操作を促進し、常時「オン」状態となっているため、データ可用性のニーズに対応します。

シスコ デスクトップ仮想化ソリューション:データセンター

進化する職場環境

今日の IT 部門は、急速に進化する職場環境に直面しています。海外の請負業者、分散したコールセンターの運営、ナレッジワーカーとタスク ワーカー、パートナー、コンサルタント、世界各地から時間を問わず接続してくるパートナー、コンサルタント、幹部など、ユーザの多様化と地理的分散はますます進んでいます。

こうしたユーザのモバイル化も進み、従来のようにオフィスだけでなく、社内の会議室やホーム オフィス、移動中やホテル、さらにはコーヒー ショップなどで仕事する従業員が増えています。また、従業員は、増え続ける多様なクライアント コンピューティング デバイスやモバイル デバイスから、自分の好みのデバイスを選べることも望んでいます。こうした傾向から IT 部門にますます求められるのは、企業データの保護と、ユーザ、エンドポイント デバイス、デスクトップ アクセスの複合的なシナリオによるデータの漏洩や損失の防止です(図 1)。

これらの課題は、古くなった PC や制限のあるローカル ストレージに対応するためのデスクトップ更新サイクルや、新しいオペレーティング システム(特に Microsoft Windows 10 や生産性ツール、Microsoft Office 2016)への移行によって複雑化しています。

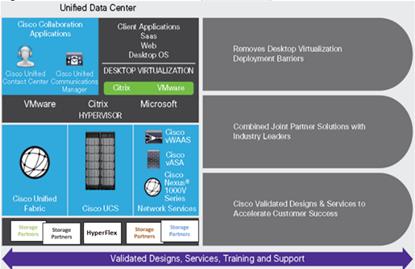

図 1 シスコ データセンター パートナー コラボレーション

デスクトップ仮想化を推進する主な要素として、制御の向上と管理コストの削減によるデータ セキュリティの向上、キャパシティの拡大・縮小、TCO の削減が挙げられます。

シスコ デスクトップ仮想化における重点項目

シスコは、優れたデスクトップ仮想化データセンター インフラストラクチャを提供するため、シンプル化、セキュリティ、拡張性という 3 つの主要要素を重視しています。プラットフォームのモジュール化され、連係するソフトウェアが、シンプルで、セキュアで、スケーラブルなデスクトップ仮想化プラットフォームを実現します。

シンプル化

Cisco UCS と Cisco HyperFlex により、業界標準のコンピューティングに対して、先進的な新しいアプローチを提供し、デスクトップ仮想化におけるデータセンター インフラストラクチャの中核を担います。Cisco UCS の数多くの機能および利点の代表的な例として、必要なサーバ数やサーバあたりで使用されるケーブル数が大幅に削減されること、および Cisco UCS サービス プロファイルを通してサーバを迅速に導入または再プロビジョニングできることが挙げられます。管理が必要なサーバやケーブル数が削減され、サーバおよび仮想デスクトップ プロビジョニングが合理化されることによって、操作が大幅にシンプル化されます。Cisco UCS Manager サービス プロファイルとシスコ エコパートナー ソリューションのクローニングを利用すると、数千ものデスクトップを数分でプロビジョニングできます。このアプローチにより、エンド ユーザの生産性が高まり、ビジネスの俊敏性が向上するため、IT リソースを他のタスクに割り当てることができます。

Cisco UCS Manager は、データセンターで日常的に生じるサーバ、ネットワーク、ストレージ アクセス インフラストラクチャの構成やプロビジョニングなどのエラーが発生しやすい操作を自動化します。さらに、1 RU あたりのメモリ・CPU 密度の高い Cisco UCS B シリーズ ブレード サーバ、C シリーズ、HX シリーズ ラック サーバにより、高いデスクトップ密度が実現し、サーバ インフラストラクチャに求められる要件を軽減することができます。

シンプル化は、デスクトップ仮想化を実装する際の問題を減らす上でも役立ちます。シスコと VMware 社などをはじめとするテクノロジー パートナーが、HyperFlex などの事前定義済みハイパーコンバージド アーキテクチャ インフラストラクチャ パッケージを含む検証済み統合アーキテクチャを開発しました。シスコ デスクトップ仮想化ソリューションは、VMware vSphere を使用してテストされています。

Secure

仮想デスクトップは本質的に従来の物理的なものよりもセキュアですが、セキュリティに関する新たな課題も伴います。ミッションクリティカルな Web サーバやアプリケーション サーバと、仮想デスクトップなどが共通インフラストラクチャを使用している場合、セキュリティの脅威の上で高いリスクを負うようになりました。仮想マシン間でのトラフィックが、セキュリティ面での重要な検討課題となっています。特に、VMware vMotion のようにサーバ インフラストラクチャ内を仮想マシンが移動する場合など、動的な環境において、IT マネージャがリスクに対処する必要が生じています。

つまり、拡大されたコンピューティング インフラストラクチャにおける仮想マシンのモビリティの動的かつ流動的な性質を考慮すると、デスクトップ仮想化により、ポリシーやセキュリティを仮想マシン レベルで認識する必要性が大きく高まります。新しい仮想デスクトップを容易に増加させることが可能になったことが、仮想化対応のネットワークおよびセキュリティ インフラストラクチャの重要性を高めています。デスクトップ仮想化のためのシスコのデータセンター インフラストラクチャ(Cisco UCS および Cisco Nexus ファミリ ソリューション)では、デスクトップからハイパーバイザまで包括的に対応したセキュリティを通して、データセンター、ネットワーク、およびデスクトップのセキュリティを強化します。セキュリティは、仮想デスクトップのセグメンテーション、仮想マシン対応のポリシーや管理、および LAN や WAN のインフラ全体のネットワーク セキュリティによって強化されます。

スケーラブル

デスクトップ仮想化ソリューションは拡大を続けています。したがって、そのような拡大に応じて、ソリューションの規模の拡張や推定が可能でなければなりません。シスコ デスクトップ仮想化ソリューションは、デスクトップ密度(サーバごとのデスクトップ数)が高く、サーバを追加することでほぼリニアに性能が増加します。シスコのデータセンター インフラストラクチャが提供する柔軟なプラットフォームを利用すると、このような拡大にも対応でき、ビジネスの俊敏性が向上します。Cisco UCS Manager のサービス プロファイルにより、オンデマンドでのデスクトップのプロビジョニングが可能となり、数千単位のデスクトップの展開が、数十単位での展開と同じように容易になります。

Cisco HyperFlex サーバは、ほぼリニアに性能を向上させ、規模を拡大することができます。Cisco UCS には、特許取得済みの Cisco 拡張メモリ テクノロジーが実装されており、より少ないソケットで大きなメモリ面積を実現しています(2 および 4 ソケットのサーバで最大 3.0 テラバイト(TB)の拡張性を実現)。構成要素としてユニファイド ファブリック テクノロジーを使用しており、Cisco UCS サーバでの集約帯域幅は、サーバごとに最大 80 Gbps にまで拡張できます。また、ノースバウンド Cisco UCS ファブリック インターコネクトでは、ラインレートでの 2 テラビット/秒(Tbps)での送信が可能です。これにより、デスクトップ仮想化の I/O とメモリにおけるボトルネックの発生を防ぎます。Cisco UCS は高性能と低遅延を実現したユニファイド ファブリックベース ネットワーキング アーキテクチャであり、高精細ビデオやコミュニケーション トラフィックなどの非常に通信量の多い仮想デスクトップ トラフィックをサポートします。さらに、Cisco HyperFlex は、シスコ デスクトップ仮想化ソリューションの一部として、起動時やログイン ストーム時のデータの可用性と最適なパフォーマンスを維持します。VMware Horizon や Cisco HyperFlex ソリューションをベースとした最近の Cisco Validated Design では、拡張性とパフォーマンスが重視されており、4400 以上のホステッド仮想デスクトップとホステッド共有デスクトップが 10 分以内に起動されます。

Cisco UCS および Cisco Nexus データセンター インフラストラクチャでは、デスクトップ仮想化、データセンター アプリケーション、クラウド コンピューティングをサポートする、サーバ、ネットワーク、およびストレージ リソースの透過的拡張機能を備えた、成長のための理想的なプラットフォームが提供されます。

節約と成功

簡素化された、安全性と拡張性の高いデスクトップ仮想化向けシスコ データセンター インフラストラクチャでは、他のアプローチと比べて時間とコストを節約できます。Cisco UCS により、サーバあたり仮想デスクトップ密度が業界トップレベルの水準で提供されます。そして、導入コスト(CapEx)と運用コスト(OpEx)の両方が削減され、早期の投資回収および継続的なコスト削減(投資効果(ROI)の向上と総所有コストの削減)が実現します。また、Cisco UCS アーキテクチャとシスコ ユニファイド ファブリックにより、サーバごとの必要なケーブル数やポート数が減ることで、より低コストのネットワーク インフラストラクチャを構築できます。また、ストレージの階層化と重複排除テクノロジーによって、ストレージ コストを下げ、デスクトップ ストレージのニーズを最大 50 % にまで削減します。

デスクトップ仮想化対応の Cisco HyperFlex を利用することで、導入が簡素化され、生産性発揮までの時間が短縮され、ビジネスの俊敏性が向上します。IT スタッフおよびエンド ユーザは迅速に生産性を向上させることができ、企業が、仮想デスクトップを必要に応じて時間や場所を問わず導入できるため、新規のビジネス チャンスに迅速に対応できます。シスコの高性能なシステムとネットワークは物理 PC デスクトップ環境に近いユーザ エクスペリエンスを実現し、ユーザは時と場所を問わず生産性を発揮できます。

組織のデスクトップ仮想化の効果を測定するには、通常、直近および長期での効率性や有効性を確認します。シスコ デスクトップ仮想化ソリューションは非常に効率性が高く、迅速な導入が可能な上、必要なデバイスやケーブルの数が少ないため、コストを削減できます。また、エンド ユーザの選択したデバイスに必要なサービスが提供され、同時に IT の運用、管理、データ セキュリティも向上するため、大変高い効果が見込めます。このような効果は、仮想化分野を主導するパートナーとシスコとの業界内でも最高のパートナーシップと設計のテストや検証を元に実現されており、ソリューション ライフサイクルを通じて顧客を支援します。また、デスクトップ仮想化向けプラットフォームとして、安全かつ柔軟で拡張可能なシスコのプラットフォームを使用することで、長期的な効果を担保します。

最終的には、デスクトップ仮想化製品のそれぞれのエンド ユーザが、優れたエクスペリエンスを享受できるかが評価の基準になります。Cisco HyperFlex ではクラス最高の性能が提供されており、1 秒を切るベースライン応答時間とフル ロード時の 1 秒足らずの平均指数応答時間が実現されています。

使用例

· 医療:デスクトップと端末間のモビリティ、コンプライアンス、コスト

· 官公庁:テレワーキング導入、ビジネス継続性、業務の連続性(COOP)トレーニング センター

· 金融:リテール バンクの IT コスト削減、保険代理店、コンプライアンス、プライバシー

· 教育:幼稚園から高校までの生徒のアクセス、高等教育、リモート学習

· 地方自治体:機関間の IT およびサービスの統合、セキュリティ

· 小売:ブランチオフィス IT コストの削減およびリモート ベンダー

· 製造:タスク ワーカーおよびナレッジ ワーカーと海外請負業者

· Microsoft Windows 10 への移行

· グラフィック要件の厳しいアプリケーション

· セキュリティおよびコンプライアンスの取り組み

· リモート オフィスおよびブランチ オフィス、またはオフショア施設の開設

· 合併と買収などによるクライアント基盤の統合

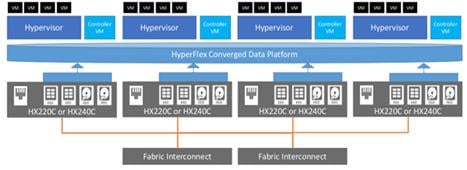

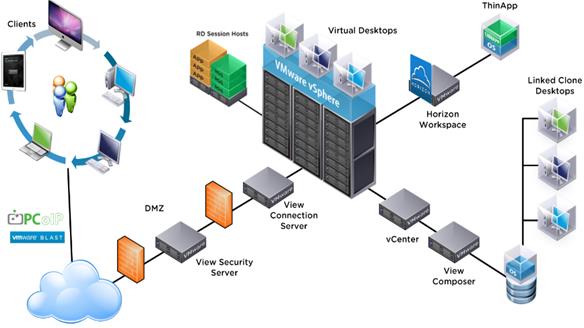

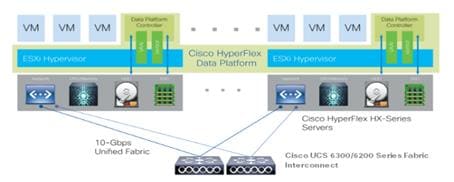

図 2 では、Cisco UCS コンポーネント上に構築された VMware Horizon 7 とネットワーク接続について示しています。この参照アーキテクチャは、ワイヤワンス(wire-once)戦略を強化するものです。新たなストレージがアーキテクチャに追加され、ホストから Cisco UCS ファブリック インターコネクトまでの配線をやり直す必要がありません。

図 2 Cisco Unified Computing System 上に構築された vSphere 6.5 の VMware Horizon 7

物理トポロジ

Cisco HyperFlex System は、1 組の Cisco UCS 6200/6300 シリーズ ファブリック インターコネクトから構成されており、クラスタあたり最大 32 の HXAF シリーズ ラック マウント サーバを備えています。さらに、クラスタごとに最大 32 のコンピューティング専用サーバを追加できます。Cisco UCS 5108 ブレード シャーシを追加することで、ハイブリッド クラスタ設計において追加のコンピューティング リソースに Cisco UCS B200 M5 ブレード サーバを使用できます。また、Cisco UCS C240 と C220 ラックサーバを、追加のコンピューティング リソースに使用することもできます。両方のファブリック インターコネクトが、すべての HX シリーズ ラックマウント サーバに接続され、すべての Cisco UCS 5108 ブレード シャーシに接続されます。インストール時に、「ノースバウンド」ネットワーク接続と呼ばれるアップストリーム ネットワーク接続がファブリック インターコネクトとお客様のデータセンター ネットワーク間で構築されます。

![]() このスタディでは、Cisco 6332 UP ファブリック インターコネクトを Cisco Nexus 93180YC-FX スイッチにアップリンクしました。

このスタディでは、Cisco 6332 UP ファブリック インターコネクトを Cisco Nexus 93180YC-FX スイッチにアップリンクしました。

図 3 および図 4 では、ハイパーコンバージド トポロジ、ハイブリッド ハイパーコンバージド トポロジ、

コンピューティング専用トポロジについて示しています。

図 3 Cisco HyperFlex の標準トポロジ

図 4 Cisco HyperFlex ハイパーコンバージドおよびコンピューティング専用ノード トポロジ

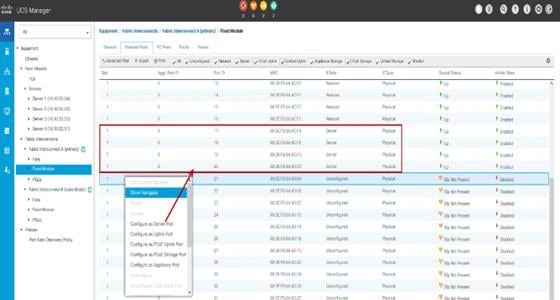

ファブリック インターコネクト

ファブリック インターコネクト(FI)はペアで導入されます。そこでは、2 つのユニットが管理クラスタとして動作しながら、A サイド ファブリックと B サイド ファブリックと呼ばれる 2 つの別個のネットワーク ファブリックを形成します。そのため、多くの設計要素が FI A または FI B あるいはファブリック A またはファブリック B を参照します。両方のファブリック インターコネクトが常にアクティブで、両方のネットワーク ファブリック上にデータを転送することによって、冗長で可用性の高い構成を実現します。Cisco UCS Manager などの管理サービスにおいても、2 つの FI がクラスタ形式で提供されます。つまり、一方の FI がプライマリでもう一方の FI がセカンダリとなり、クラスタ化されたローミング IP アドレスが付与されます。このプライマリ/セカンダリの関係は管理クラスタに関してのみであり、データ伝送には影響を与えません。

ファブリック インターコネクトは、Cisco UCS ドメインを適切に管理するために接続する必要がある次のポートを備えています。

· Mgmt:GUI ツールと CLI ツールを介してファブリック インターコネクトと Cisco UCS ドメインを管理するための 10/100/1000 Mbps ポート。ドメイン内の管理対象サーバへのリモート KVM、IPMI、および SOL セッションでも使用されます。通常は、お客様の管理ネットワークに接続されます。

· L1:Cisco UCS 管理クラスタを形成するためのクロス コネクト ポート。これは、標準の RJ45 プラグ付き CAT5 または CAT6 イーサネット ケーブルを使用して、ペア化されたファブリック インターコネクトの L1 ポートに直接接続されます。スイッチまたはハブに接続する必要はありません。

· L2:Cisco UCS 管理クラスタを形成するためのクロス コネクト ポート。これは、標準の RJ45 プラグ付き CAT5 または CAT6 イーサネット ケーブルを使用して、ペア化されたファブリック インターコネクトの L2 ポートに直接接続されます。スイッチまたはハブに接続する必要はありません。

· コンソール:ファブリック インターコネクトへの直接コンソール アクセス用の RJ45 シリアル ポート。通常は、同梱のシリアル/RJ45 アダプタ ケーブルを使用した初期 FI セットアップ プロセスで使用されます。端末アグリゲータまたはリモート コンソール サーバ デバイスにプラグインすることもできます。

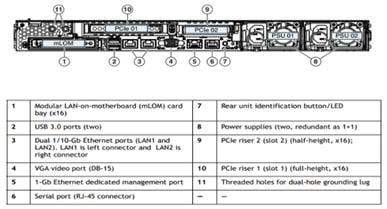

HX シリーズおよび C シリーズ ラックマウント サーバ

HX シリーズ コンバージド サーバ、およびオプションの UCS C シリーズ コンピューティング専用サーバは、直接接続モードで Cisco UCS ファブリック インターコネクトに直接接続されます。このオプションを使用すると、Cisco UCS Manager は、管理通信とデータ通信の両方にシングル ケーブルを使用して HX シリーズ ラックマウント サーバと UCS C シリーズ サーバを管理できます。HXAF220C-M5SX、HXAF240C-M5SX、C240-M5 および C220 M5 の各サーバで、Cisco VIC 1387 ネットワーク インターフェイス カード(NIC)を、デュアル 40 ギガビット イーサネット(GbE)ポートを備えたモジュール型 LAN on Motherboard(MLOM)スロットに取り付けて構成することができます。標準接続、および冗長接続を行うには、VIC 1387 のポート 1 を FI A のポートにつなぎ、VIC 1387 のポート 2 を FI B のポートにつなぎます(図 5)。

![]() このケーブル配線プラクティスに従わなかった場合は、エラー、検出失敗、および冗長接続の消失につながる可能性があります。

このケーブル配線プラクティスに従わなかった場合は、エラー、検出失敗、および冗長接続の消失につながる可能性があります。

図 5 HX シリーズおよび C シリーズ サーバの接続

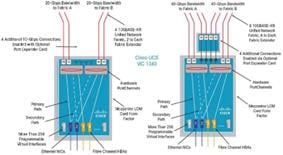

Cisco UCS B シリーズ ブレード サーバ

ハイブリッド HyperFlex クラスタには、コンピューティング容量の強化策として、Cisco UCS B200 M5 ブレード サーバも 1 ~ 16 台組み合わせることができます。他の Cisco UCS B シリーズ ブレード サーバと同様に、Cisco UCS B200 M5 は、Cisco UCS 5108 ブレード シャーシ内に取り付ける必要があります。ブレード シャーシには 1 ~ 4 台の電源と 8 台のモジュール式冷却ファンが付属しています。シャーシの背面には、シスコ ファブリック エクステンダを取り付けるための 2 つのベイがあります。ファブリック エクステンダ(一般的には IO モジュール(IOM)とも呼ばれる)は、シャーシをファブリック インターコネクトに接続します。内部的に、ファブリック エクステンダは、シャーシのバックプレーンを介して各ブレード サーバに実装された Cisco VIC 1340 カードに接続されます。標準的な方法で接続するには、左側の IOM または IOM 1 から 40 GbE リンク(1 ~ 4)か 40 GbE リンク(ネイティブ X 2)を FI A に接続し、右側の IOM または IOM 2 から同じ数の 40 GbE リンクを FI B に接続します(図 6)。これ以外のケーブル配線設定はすべて無効であり、エラー、検出の失敗、および冗長接続の消失につながる可能性があります。

図 6 Cisco UCS 5108 シャーシの接続

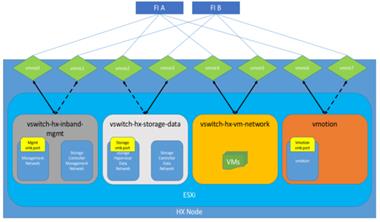

論理ネットワーク設計

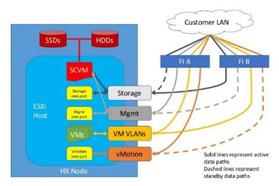

Cisco HyperFlex システムは、4 つの定義済みゾーンに分類される通信パスを備えています(図 6)。

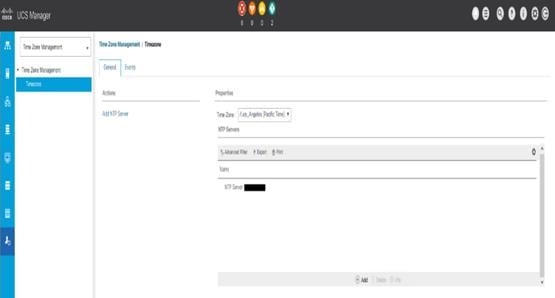

· 管理ゾーン:このゾーンは、物理ハードウェア、ハイパーバイザ ホスト、およびストレージ プラットフォーム コントローラ仮想マシン(SCVM)を制御するために必要な接続で構成されます。これらのインターフェイスと IP アドレスは、LAN/WAN 全体で HX システムを管理するすべてのスタッフが利用できる必要があります。このゾーンでは、ドメイン ネーム システム(DNS)、Network Time Protocol(NTP)サービスへのアクセス権限があり、セキュア シェル(SSH)通信が許可されている必要があります。このゾーンは、複数の物理コンポーネントと仮想コンポーネントからできています。

- ファブリック インターコネクト管理ポート。

- Cisco UCS 外部管理インターフェイス。サーバやブレードによって使用され、FI 管理ポートを通じて応答します。

- ESXi ホスト管理インターフェイス。

- ストレージ コントローラ VM 管理インターフェイス。

- ローミング HX クラスタ管理インターフェイス。

· VM ゾーン:このゾーンは、HyperFlex ハイパーコンバージド システム内で動作するゲスト VM にネットワーク IO を提供するために必要な接続で構成されます。通常、このゾーンには、ネットワークのアップリンクを介して Cisco UCS ファブリック インターコネクトにトランクされる複数の VLAN が含まれており、802.1Q VLAN ID のタグが付けられます。これらのインターフェイスと IP アドレスは、LAN/WAN 全体で HX システム内のゲスト VM と通信する必要があるすべてのスタッフおよびその他のコンピュータ エンドポイントが利用できる必要があります。

· ストレージ ゾーン:このゾーンは、Cisco HX データ プラットフォーム ソフトウェア、ESXi ホスト、およびストレージ コントローラ VM が HX 分散データ ファイルシステムにサービス提供するために使用する接続で構成されます。適切に運用するためには、これらのインターフェイスと IP アドレスが相互に通信できる必要があります。通常の運用では、このトラフィックのすべてが Cisco UCS ドメイン内で発生しますが、このトラフィックが Cisco UCS ドメインのネットワーク ノースバウンドを通過する必要があるハードウェア障害シナリオがあります。そのため、HX ストレージ トラフィックに使用される VLAN は、FI B から FI A に、または、その逆方向に到達する Cisco UCS ドメインからのネットワーク アップリンクを通過できる必要があります。このゾーンは、基本的にはジャンボ フレームでのトラフィックになるため、Cisco UCS のアップリンクでジャンボ フレームを有効にする必要があります。このゾーンは複数のコンポーネントで構成されます。

- HX クラスタ内の各 ESXi ホストのストレージ トラフィックに使用する vmkernel インターフェイス。

- ストレージ コントローラ VM ストレージ インターフェイス。

- ローミング HX クラスタ ストレージ インターフェイス。

· VMotion ゾーン:このゾーンは、ESXi ホストがゲスト VM の vMotion をホスト間で有効にするために使用する接続で構成されます。通常の運用では、このトラフィックのすべてが Cisco UCS ドメイン内で発生しますが、このトラフィックが Cisco UCS ドメインのネットワーク ノースバウンドを通過する必要があるハードウェア障害シナリオがあります。そのため、HX ストレージ トラフィックに使用される VLAN は、FI B から FI A に、または、その逆方向に到達する Cisco UCS ドメインからのネットワーク アップリンクを通過できる必要があります。

ロジカル アベイラビリティ ゾーン

HyperFlex クラスタは、大規模になるほど単純にクラスタ内のノード数が原因となって、障害のリスクが高くなります。個々のノードの障害リスクはノード数に関係なく同じですが、クラスタのサイズが 64 ノードにまでなると、ノード数が少ないクラスタと比べて、1 つのノードで障害が起きる確率が論理的に高くなります。比較的規模の大きいクラスタでこうしたリスクを軽減するため、8 ノード以上の HyperFlex クラスタでは論理可用性ゾーン(LAZ)と呼ばれる機能を使用して設定を行うことができます。論理可用性ゾーンの機能では、2 つ以上の HyperFlex ノードが、論理的に定義されたゾーンにグループ分けされます。最低 3 つのゾーンが作成され、1 つのゾーン内のノードにブロックが複数回書き込まれることがないような方法で、クラスタ内のデータが分散されます。このようにデータの分散パターンがゾーン間に広がり、各ゾーンに複数のサーバが存在するため、LAZ を使用したクラスタでは、この機能を有効にせずに稼働するクラスタと比べて、通常は障害への耐久度を高めることができます。許容される障害の数は、クラスタ内のゾーンの数と、各ゾーン内のサーバの数によって異なります。一般に、1 つか 2 つのゾーン間で複数のノード障害が発生する場合の許容度は向上し、3 つ以上のゾーン間で複数のノード障害が発生する場合よりもリスクが減少します。HyperFlex Connect ダッシュボードに表示される障害許容度は常に「最悪の状況におけるシナリオ」ビューを表すことに注意してください。たとえば、ダッシュボードで 2 つの障害を許容できることが示された場合でも、実際には 2 台のサーバが障害を起こして、クラスタがオンラインのままになり、障害許容度がまだ 2 にとどまっている可能性があります。

論理可用性ゾーンを障害ドメインの概念と混同しないように注意してください。障害ドメインの例として考えられるのは、単一の HyperFlex クラスタにおいて、一部のノードが 1 台の無停電電源(UPS)によって給電されているか 1 台の配電ユニット(PDU)に接続していて、他のノードが別の UPS または PDU に接続している場合などです。仮に UPS または PDU のいずれか 1 台が障害を起こした場合、複数のノードで同時に障害が発生することになります。LAZ によって実際にこうしたシナリオでクラスタの障害を防止できる可能性がありますが、それを保証するためにはゾーンのメンバーシップを手動で制御する必要があります。そうすることで、1 台の UPS または PDU によって保護されているすべてのサーバの障害が、機能停止を引き起こさないような方法で分散されます。LAZ 機能はこうした方法での手動設定には対応していませんが、代わりに、ゾーンのメンバーシップがシステムによって自動的に決定されます。前述した UPS の例のように物理的な制限があるために、または耐障害性の距離要件のために、HyperFlex クラスタを物理的に半分に分割する必要がある場合は、LAZ を使用する代わりにクラスタをストレッチ クラスタとして構築する必要があります。

図 8 は、論理可用性ゾーンを有効にしてレプリケーション係数を 3 に設定したクラスタにおけるデータの分配方法の例を示しています。ここでは、各ゾーンにはクラスタにあるデータの 3 つのコピーのうちいずれか 1 つの

みが含まれています。このクラスタは 8 つのノードで構成され、システムによって 4 つのゾーンに設定されています。

図 8 論理可用性ゾーンが有効になっているクラスタのデータの分散方法

論理可用性ゾーンには次の要件や制限事項が適用されます。

· インストール処理中に論理可用性ゾーンを設定できるのは、8 ノード以上の HyperFlex クラスタのみです。

· 論理可用性ゾーンは、HyperFlex クラスタのインストール中に有効にするか、または後でコマンド ラインから有効にすることができます。クラスタ全体のデータの大規模な移行と再編成を避けるため、この機能はインストール中に有効にすることをお勧めします。データの大規模な移行と再編成では、すでにデータが含まれているクラスタで LAZ を有効にしている場合、データ分散規則に従う必要があります。

· ゾーンの数は、手動で 3、4、5 に指定するか、またはインストーラを通じて自動的に選択するようにできます(推奨設定)。

· HyperFlex クラスタによって各ゾーンにどのノードが参加するかが決定されます。この設定は変更できません。

· 容量の利用とデータの分散を最もバランス良く保つため、クラスタ内のノード数を 3、4、5、または 7 の倍数にすることをお勧めします。たとえば、8 ノードは 2 台のサーバによる 4 つのゾーンに均等に分割され、9 ノードは 3 台のサーバによる 3 つのゾーンに均等に分割されます。11 ノードでは、ゾーン間でノード数のバランスが悪くなり、ノードにおける容量の利用のバランスが悪くなります。

· 前述の要件に加えて、LAZ を有効にしてクラスタを動作させている場合は、クラスタの拡張をゾーン数の倍数で行ってください。そのように拡張することで、各ノードでノード数の一致が保たれ、容量の利用のバランスが悪くなるのを防ぎます。たとえば、3 つのゾーンがあるクラスタは、さらに 3 つのノードを追加して拡張します。これは、1 つまたは 2 つのノードしか追加しないとバランスが悪くなるからです。4 つのノードを追加しても同様です。

参照ハードウェア構成は次のとおりです。

· 2 台の Cisco Nexus 93180YC-FX スイッチ

· 2 台の Cisco UCS 6332 ファブリック インターコネクト

· HyperFlex データ プラットフォーム バージョン 3.5.1a を実行している 16 台の Cisco HXAF C220M5 ラック サーバ

· HyperFlex データ プラットフォーム バージョン 3.5.1a をコンピューティング専用ノードとして実行している 8 台の Cisco UCS C220 M5 ラック サーバ

· HyperFlex データ プラットフォーム バージョン 3.5.1a をコンピューティング専用ノードとして実行している 8 台の Cisco UCS B200 M5 ブレード サーバ

デスクトップ仮想化では、VMware vSphere 6.5 上で実行される VMware Horizon 7 が導入に含まれます。これは、RDSH と永続/非永続デスクトップの両方について、30 ノード設定ごとに次の密度で大規模な構成要素を提供することを目的としています。

· 1550 の Horizon 7 RDSH サーバ デスクトップ セッション

· 950 の Horizon 7 Windows 10 非永続インスタント クローン仮想デスクトップ

· 950 の Horizon 7 Windows 10 非永続コンポーザ クローン仮想デスクトップ

· 950 の Horizon 7 Windows 10 永続フル クローン仮想デスクトップ

![]() 今回の検証済み設計においては、すべての Windows 10 仮想デスクトップが 4 GB のメモリでプロビジョニングされています。通常、永続デスクトップのユーザは、より多くのメモリを必要とします。4 GB 以上のメモリを必要とする合は、Cisco HXAF220c-M5S HX シリーズ ラック サーバおよび Cisco UCS B200 M5 サーバで、追加のメモリ チャネルを設定する必要があります。

今回の検証済み設計においては、すべての Windows 10 仮想デスクトップが 4 GB のメモリでプロビジョニングされています。通常、永続デスクトップのユーザは、より多くのメモリを必要とします。4 GB 以上のメモリを必要とする合は、Cisco HXAF220c-M5S HX シリーズ ラック サーバおよび Cisco UCS B200 M5 サーバで、追加のメモリ チャネルを設定する必要があります。

ここで提供されるデータにより、お客様の環境に合わせて RDSH サーバセッションと VDI デスクトップを実行できるようになります。たとえば、追加の Cisco HX サーバをコンピューティング専用の方法で導入してコンピューティング キャパシティを増やすことができます。または、既存のサーバにドライブを追加することで、I/O キャパシティやスループットを改善することができます。もしくは、新しい機能を導入するために、特別なハードウェアやソフトウェア機能を追加することができます。このドキュメントでは、図 2 で示したベース アーキテクチャ導入の詳細な手順について詳しく説明します。これらの手順には、物理的なネットワークのケーブリングやコンピューティング デバイス、ストレージ デバイスの設定などがすべて含まれます。

設定時の注意事項

このドキュメントでは、Cisco HyperFlex の仮想デスクトップにおけるさまざまな種類のワークロードに対して、Cisco Validated Design(CVD)での冗長構成や高可用性設定を行う際の詳細について説明します。どの冗長コンポーネントが各手順で設定されるかを示す設定のガイドラインが提示されます。たとえば、Cisco Nexus A および Cisco Nexus B は、設定される Cisco Nexus スイッチのペア メンバーを識別します。同様に、Cisco UCS 6332 UP ファブリック インターコネクトも識別されます。さらに、このドキュメントでは、複数の Cisco UCS および HyperFlex ホスト(VM-Host-Infra-01、VM-Host-Infra-02、VM-Host-RDSH-01、VM-Host-VDI-01 などのように連番で識別されます)をプロビジョニングするための詳細な手順について説明します。最後に、環境に関連する情報を、所定の手順で指定する必要がある点についてふれます。<text> がコマンド構造の一部として表示されます。

ここでは、このスタディで概要が示されているソリューションで使用されるインフラストラクチャのコンポーネントについて説明します。

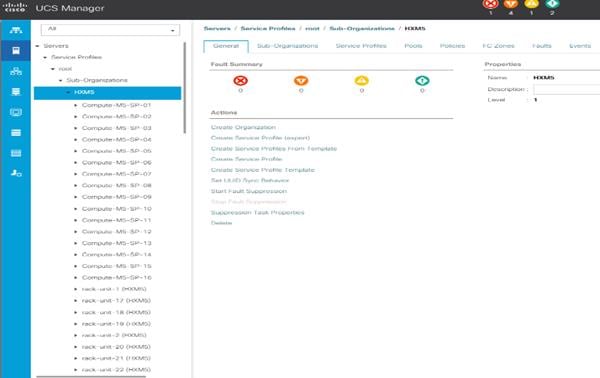

Cisco Unified Computing System

Cisco UCS Manager(UCSM)は、Cisco Unified Computing System™(Cisco UCS)と Cisco HyperFlex のすべてのソフトウェアとハードウェアのコンポーネントを、直感的な GUI、コマンドライン インターフェイス(CLI)、XML API によって統合管理できる機能を備えています。一元管理機能を備えた単一の管理ドメインがあり、複数のシャーシや数千台もの仮想マシンを制御できます。

Cisco UCS は、コンピューティング、ネットワーキング、およびストレージ アクセスを統合した次世代のデータセンター プラットフォームです。仮想環境向けに最適化されたこのプラットフォームは、オープンな業界標準テクノロジーを使用して設計されており、総所有コスト(TCO)を削減し、ビジネスの俊敏性を高めます。このシステムは、低遅延のロスレス 40 ギガビット イーサネット ユニファイド ネットワーク ファブリックと、エンタープライズクラスの x86 アーキテクチャ サーバを統合します。これはすべてのリソースが単一の管理ドメインに集約された、統合型の拡張性に優れたマルチシャーシ対応のプラットフォームです。

Cisco Unified Computing System のコンポーネント

Cisco UCS の主なコンポーネントは、次のとおりです。

· コンピューティング:インテル® Xeon® スケーラブル ファミリー プロセッサーをベースとしたブレード サーバ、ラック サーバ、ハイパーコンバージド サーバをシステムに組み込んだ、まったく新しいクラスのコンピューティング システムをベースとする設計です。

· ネットワーク:このシステムは低遅延でロスレスの 40 Gbps ユニファイド ネットワーク ファブリック上で統合されています。このネットワーク基盤は、現状では LAN、SAN、高性能コンピューティング(HPC)ネットワークとして扱われている異なるネットワークを統合します。ユニファイド ファブリックにより、ネットワーク アダプタ、スイッチ、およびケーブルの数が減少し、電力と冷却の要件が緩和されるため、コスト削減につながります。

· 仮想化:このシステムは、仮想環境の拡張性、パフォーマンス、および運用管理を強化することで、仮想化の可能性を最大限に引き出します。シスコのセキュリティ、ポリシー適用、および診断機能が仮想化環境にまで拡張され、変化の激しいビジネス要件と IT 要件により良く対応できるようになりました。

· ストレージ:Cisco HyperFlex ラック サーバにより、強力な HX データ プラットフォーム ソフトウェアを使用した高性能で復元力の高いストレージを提供します。顧客は、耐障害性要件に応じて、少なくとも 3 つのノード(レプリケーション ファクタ 2/3)を展開できます。これらのノードは、HyperFlex ストレージとコンピューティング クラスタを構成します。各ノードのオンボード ストレージはクラスタ レベルで集約され、すべてのノードで自動的に共有されます。ストレージ リソースは使い慣れた VMware vCenter Web クライアントから管理され、vCenter 管理者の機能が拡張されます。

· 管理:Cisco UCS の特色は、あらゆるシステム コンポーネントを統合し、ソリューション全体を 1 つのエンティティとして、Cisco UCS Manager ソフトウェアから管理できることです。すべてのシステムの設定プロセスや動作を管理できる直感的な GUI、CLI、堅牢な API を備えています。

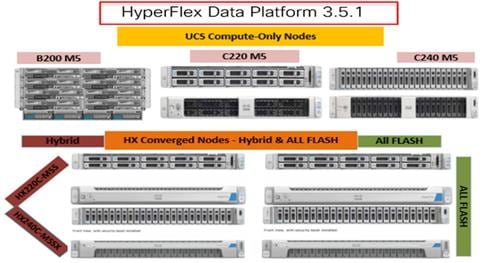

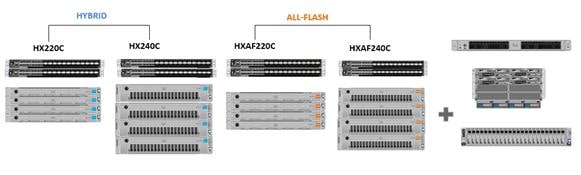

図 9 Cisco HyperFlex ファミリの概要

Cisco UCS と Cisco HyperFlex は、次の機能を提供するように設計されています。

· TCO の削減と、ビジネスの俊敏性の向上。

· ジャストインタイム プロビジョニングとモビリティ サポートを通した IT スタッフの生産性の向上。

· 単一の統合されたシステムにより、データセンターのテクノロジーを統合し、全体として管理、サービスを提供。

· 何百台もの孤立サーバと何千台もの仮想マシン用の設計による拡張性と、需要を満たすために I/O 帯域幅をスケーリングできる能力。

· 業界リーダーのパートナー エコシステムによってサポートされる業界標準。

Cisco UCS Manager は、複数のブレード シャーシ、ブレード/ラック サーバ、および数千単位の仮想マシンにわたる Cisco Unified Computing System のすべてのソフトウェア コンポーネントとハードウェア コンポーネントを管理する、統合された組み込みソフトとしての管理機能を提供します。Cisco UCS Manager は直感的な GUI、コマンドライン インターフェイス(CLI)、または XML API を使用してすべての Cisco UCS Manager 機能に包括的にアクセスできるように、Cisco UCS を単一のエンティティとして管理します。

Cisco HyperFlex システムは、サーバおよびメモリ リソース、統合されたネットワーク接続、VM ストレージ用の高性能の分散ログ構造ファイル システム、仮想化サーバ用のハイパーバイザ ソフトウェア、これらが単一の Cisco UCS 管理ドメインに統合された、完結型の仮想サーバ プラットフォームです。

図 10 Cisco HyperFlex システムの概要

バージョン 3.5.1a の機能拡張

Cisco HyperFlex System のバージョン 3.5.1a では、いくつかの新機能と拡張機能が追加されています (図 11 を参照)。

図 11 3.5.1a での HX All-Flash ノードの追加

· 新しい All-Flash HX サーバ モデルは、全永続ストレージ デバイスに SSD を使用し、フラッシュ ストレージを提供する Cisco HyperFlex 製品ファミリに追加されます。

· Cisco HyperFlex は、Cisco UCS Manager 4.0 (1b) 以降の最新の Cisco UCS ソフトウェアをサポートします。新しい All-Flash 展開では、Cisco UCS Manager 4.0 (1b) 以降がインストールされていることを確認してください。

· HX Data Platform ソフトウェアのインストール中の HX ノードへの外部ストレージ (iSCSI またはファイバ チャネル) アダプタの追加をサポート。これにより、外部ストレージ アレイを HX ドメインに接続するプロセスが簡略化されます。

· 既存の Cisco UCS-FI ドメインへの HX ノードの追加をサポート。

· Cisco Hyperflex Sizer をサポート:コンピューティング、キャパシティ、およびパフォーマンスのための新しいエンド ツー エンド サイジング ツール。

· 複数のハイパーバイザ:すでにサポートされている VMware ESXi に加えて Microsoft Hyper-V をサポート。

· 拡大クラスタ:データ センターの場所全体の高可用性向け。

· Kubernetes FlexVolume ドライバ:企業向けのターンキー Kubernetes の永続ストレージであり Cisco コンテナ プラットフォームの基盤。

· 高い拡張性(32 コンバージド + 32 コンピューティング専用)およびロジカル アベイラビリティ ゾーン(LAZ)による耐障害性の向上。

· Intel Optane NVMe サポートによるドライブ レベルでのパフォーマンスと耐久性の向上。

· 大規模なフォーム ファクタ:6 TB、8 TB ドライブ オプションを備えた HX M5 240 LFF シャーシ。

· ディザスタ リカバリの高度なワークフロー。

· ハイパーバイザ プラットフォーム全体での Cisco Intersight のサポート。

· 拡張 HyperFlex Edge 設定オプション。

· リンク モード:vCenterの拡張リンク モード機能のための HyperFlex プラグイン サポート。

· REST API: Cisco DevNet の『Cisco HyperFlex Systems REST API スタートアップ ガイド』

· 新しい All-Flash および Hybrid HX M5 サーバ モデルが Cisco HyperFlex 製品ファミリに追加されます。

· シスコ スマート ライセンシング:Cisco Smart Software Manager サテライトのサポート。詳細についてはhttps://www.cisco.com/c/en/us/td/docs/hyperconverged_systems/HyperFlex_HX_DataPlatformSoftware/Installation_VMWare_ESXi/3_5/b_HyperFlexSystems_Installation_Guide_for_VMware_ESXi_3_5.htmlを参照してください。

· M5 サーバ

· リリースの主な概要

- HX 3.5.1a と同じソフトウェア機能セット

- HyperFlex の M5 サーバのサポート。

- Cisco HX240c M5 および HXAF240c M5 サーバの有効化:

- デュアル CPU:Intel Xeon プロセッサ スケーラブル ファミリ

- 最大 3 TB DRAM:最低 256 GB DRAM を推奨

- M.2 ドライブ:ESX ブートおよびストレージ コントローラ VM 向け

- 最大 2 GPU:M10、P40、AMD 7150 x 2

- キャッシュ専用の背面スロット

· Cisco HX220c M5 および HXAF220c M5 サーバの有効化:

- デュアル CPU(エッジを除く):インテル Xeon プロセッサ スケーラブル ファミリ

- 最大 3 TB DRAM: 256 GB DRAM の推奨最小サイズ

- データ ドライブ(SATA または SAS) x 8

- M.2 ドライブ:ESX ブートおよびストレージ コントローラ VM 向け

· 同じクラスタ上の M4/M5 をサポート。

- 混合クラスタは、同じストレージ クラスタ内の M4 および M5 HX コンバージド ノードの両方を持つことで定義されます。

- HyperFlex Edge は混合クラスタをサポートしません。

- SED SKU は混合クラスタをサポートしません。

· 周辺機器(Peripherals)

- HX220C M5S と HXAF220C M5S のノードで 6 ~ 8 個のドライブの選択肢。

- HX240C M5SX と HXAF240C M5SX のノード用の最大 2 個の GPU。

Cisco UCS ファブリック インターコネクト

Cisco UCS 6300 シリーズ ファブリック インターコネクトは、Cisco UCS の中核であり、システムのネットワーク接続と管理の機能を提供します。Cisco UCS 6300 シリーズは、ライン レート、低遅延、ロスレスの 40 ギガビット イーサネット、FCoE、ファイバ チャネル機能を提供します。

ファブリック インターコネクトは、Cisco UCS B シリーズ ブレード サーバ、Cisco UCS C-シリーズおよび HX シリーズ ラックサーバ、Cisco UCS 5100 シリーズ ブレード サーバ シャーシの管理および通信の基盤となります。ファブリック インターコネクトに接続されているすべてのサーバは、可用性の高い単一の管理ドメインの一部として管理されます。さらに、Cisco UCS 6300 シリーズは、ユニファイド ファブリックをサポートしているため、ドメイン内のすべてのブレードが LAN と SAN の両方に接続できます。

ネットワーキングでは、Cisco UCS 6300 シリーズはカットスルー アーキテクチャを使用し、パケット サイズや対応サービスに依存せず、すべてのポートで低遅延のラインレート 40 ギガビット イーサネット、2.56 テラビット(Tb)のスイッチング容量、シャーシあたり 320 Gbps の帯域幅をサポートします。この製品シリーズでは、シスコの低遅延でロスレスの 40 ギガビット イーサネット ユニファイド ネットワーク ファブリック機能をサポートし、これによりイーサネット ネットワークの信頼性、効率性、拡張性が向上します。ファブリック インターコネクトでは、ロスレス イーサネット ファブリックに対する複数のトラフィック クラスがブレード サーバからインターコネクトにかけてサポートされます。ネットワーク インターフェイス カード(NIC)、ホスト バス アダプタ(HBA)、ケーブル、およびスイッチを統合可能な FCoE 最適化サーバ設計により、TCO が大幅に削減されます。

図 12 Cisco UCS 6332 シリーズ ファブリック インターコネクト

図 13 Cisco UCS 6332-16UP ファブリック インターコネクト

Cisco HyperFlex HX シリーズ ノード

ソフトウェア デファインド インフラをベースとする Cisco HyperFlex システムでは、Cisco Unified Computing System(Cisco UCS)サーバによるソフトウェア デファインドのコンピューティング、強力な Cisco HX Data Platform を利用したソフトウェア デファインド ストレージ、そして Cisco Application Centric Infrastructure(Cisco ACI™)とも連携・統合可能な Cisco UCS ファブリックによるソフトウェア デファインドネットワーキングが一元化されています。こうしたテクノロジーにより接続とハードウェア管理を一元化することで、統合されたリソース プールをビジネス ニーズに合わせて提供できる、適応性の高い統合クラスタが実現します。

Cisco HyperFlex クラスタには(ディスク ストレージと共に)最低 3 つの HX シリーズ ノードが必要です。データはこれらのうち最低 2 つのノードで複製され、3 番目のノードは単一ノードの障害時に運用を継続する上で必要になります。各ノードのディスク ストレージには 1 台の高性能 SSD ドライブが搭載されており、データ キャッシュと書き込み要求への迅速な応答(ACK)を可能にしています。また、各ノードの最大データ容量には、プラットフォームの回転ディスクかエンタープライズ レベルの SSD の物理的な容量が備えられています。

Cisco UCS HXAF220c-M5S ラック サーバ

HXAF220c M5 サーバは、インテル® Xeon® プロセッサー スケーラブル ファミリ、24 個の 2666MHz DIMM 用 DIMM スロット、最大 128 GB の個別 DIMM 容量、および最大 3.0 TB の総 DRAM 容量を搭載した 1U フォーム ファクタで Cisco HyperFlex ポートフォリオの機能を拡張します。

この構成の Cisco HyperFlex オール フラッシュ ノードは設置面積が小さく、ストレージ キャパシティ用として、起動ドライブとして動作する M.2 SATA SSD ドライブを 1 台、240 GB のソリッド ステート ドライブ(SSD)データ ロギング ドライブを 1 台、400 GB の SSD ログ書き込みドライブを 1 台、3.8 テラバイト(TB)もしくは 960 GB の SATA SSD ドライブを最大 8 台含んでいます。1 つの HX クラスタには、最小で 3 個、最大で 16 個のノードを構成できます。詳細については、Cisco HyperFlex HXAF220c-M5S スペックシートを参照してください。

表 1 HXAF220c-M5SX サーバ オプション

| HXAF220c-M5SX オプション |

必須ハードウェア |

|

| プロセッサ |

Intel Xeon プロセッサ スケーラブル ファミリ CPU のモデルが同じ 2 個を選択 |

|

| メモリ |

16 GB、32 GB、64 GB または 128 GB の DDR4 2666 MHz 1.2 v メモリ メモリ容量合計 192 GB ~ 3 TB |

|

| ディスク コントローラ |

Cisco 12Gbps モジュラ SAS HBA |

|

| SSD |

規格 |

240 GB 2.5 インチ Enterprise Value 6G SATA SSD x 1 400 GB 2.5 インチ Enterprise Performance 12G SAS SSD x 1、または 1.6 TB 2.5 インチ Enterprise Performance NVMe SSD x 1、もしくは 375 GB 2.5 インチ Optane Extreme Pereformance SSD x 1 3.8 TB 2.5 インチ Enterprise Value 6G SATA SSD x 6 ~ 8、または 960 GB 2.5 インチ Enterprise Value 6G SATA SSD x 6 ~ 8 |

| SED |

240 GB 2.5 インチ Enterprise Value 6G SATA SSD x 1 800 GB 2.5 インチ Enterprise Performance 12G SAS SED SSD x 1 3.8 TB 2.5 インチ Enterprise Value 6G SATA SED SSD x 6 ~ 8、または 960 GB 2.5 インチ Enterprise Value 6G SATA SED SSD x 6 ~ 8、または 800 GB 2.5 インチ Enterprise Performance 12G SAS SED SSD x 6 ~ 8 |

|

| ネットワーク |

Cisco UCS VIC1387 VIC MLOM |

|

| ブート デバイス |

240 GB M.2 フォーム ファクタ SATA SSD x 1 |

|

| マイクロ SD カード |

ローカル ホスト ユーティリティ ストレージ用 32 GB マイクロ SD カード x 1 |

|

| 任意 |

40 GbE QSFP+ を 10 GbE SFP+ に変換する Cisco QSA モジュール |

|

図 14 Cisco UCS HXAF220c M5SX ラック サーバの正面図

図 15 Cisco UCS HXAF220c-M5SX ラック サーバの背面図

![]()

Cisco UCS HXAF220c-M5S は、データセンターおよびリモート サイトに高いパフォーマンスと柔軟性を提供し、最適化を可能とします。このエンタープライズクラスのサーバは、Web インフラストラクチャから分散型データベースの処理サービスに関して妥協することなく、市場で最高レベルの性能、汎用性、密度を実現します。Cisco UCS HXAF220c-M5SX は、プログラム制御機能を備えた使いやすい Cisco UCS Manager ソフトウェアと、Cisco® Single Connect テクノロジーによる簡素化されたサーバ アクセスにより、ステートレスで実際の処理サービスおよび仮想化での処理状況に合わせて迅速に実行することが可能です。インテル Xeon スケーラブル ファミリー プロセッサー製品ファミリを基盤とし、64 GB の DIMM を使用した場合、最大 1.5TB のメモリ、最大 10 台のディスク ドライブを搭載でき、最大 40 Gbps の I/O スループットを実現します。Cisco UCS HXAF220c-M5S は、要求の厳しいアプリケーション処理の実行に必要とされる優れたパフォーマンス、柔軟性、I/O スループットを提供します。

Cisco UCS HXAF220c-M5S では、次の内容が提供されます。

· 最大 2 つのマルチコア インテル Xeon スケーラブル ファミリー プロセッサー。最大 56 プロセス コア

· 業界標準の DDR4 メモリ用 DIMM スロット 24 個、2666 MHz のメモリアクセス速度をサポート、合計で最大 1.5TB のメモリ容量(64 GB DIMM 使用時)

· 10 台のホットプラグ対応 SAS および SATA HDD または SSD

· Cisco UCS VIC 1387、2 ポート、80 ギガビット イーサネットおよび FCoE:モジュラ型(mLOM)対応メザニン アダプタ

· Cisco FlexStorage ローカル ドライブ ストレージ サブシステム。柔軟なブートおよびローカル ストレージ機能により、ハイパーバイザのインストールおよび起動が可能

· エンタープライズ クラスのパススルー RAID コントローラ

· Cisco FlexStorage モジュールの追加、変更、削除が容易

Cisco VIC 1387 MLOM インターフェイス カード

Cisco UCS 仮想インターフェイス カード(VIC)1387 は、Cisco UCS HX シリーズ ラック サーバに搭載可能なカードで、拡張された着脱可能小型フォームファクタ(QSFP+)の 40 Gbps イーサネットおよび Fibre Channel over Ethernet(FCoE)を 2 ポート搭載したモジュール型 LAN On Motherboard(mLOM)アダプタです(図 5)。mLOM スロットを使用すれば、PCIe スロットを占有せずに Cisco VIC を実装できます。これにより、I/O 拡張性が向上します。シスコの次世代統合型ネットワーク アダプタ(CNA)テクノロジーを取り入れることで、将来の機能リリースにおける投資を保護します。このカードでは、ポリシーベースでステートレス、かつ俊敏性の高いサーバ インフラストラクチャを構築できます。このインフラストラクチャは、ネットワーク インターフェイス カード(NIC)またはホスト バス アダプタ(HBA)として動的に設定可能な、最大 256 の PCIe 規格準拠インターフェイスをホストに提供します。カードの特性は、ブート時にサーバに関連付けられたサービス プロファイルを使用して動的に決定されます。サービス プロファイルでは、PCIe インターフェイスの番号、タイプ(NIC または HBA)、ID(MAC アドレスおよび World Wide Name(WWN))、フェールオーバー ポリシー、帯域幅、Quality of Service(QoS)ポリシーを定義できます。

図 16 Cisco VIC 1387 mLOM カード

表 2 サポートされる物理接続

| ファブリック インターコネクト モデル |

6248 |

6296 |

6332 |

6332-16UP |

|||

| ポート タイプ |

10 GbE |

10 GbE |

40 GbE |

10 GbE ブレー |

40 GbE |

10GbE ブレー |

10 GbE オンボード |

| VIC 1227 を使用する M4 |

✓ |

✓ |

✕ |

✕ |

✕ |

✕ |

✕ |

| VIC 1387 を使用する M4 |

✕ |

✕ |

✓ |

✕ |

✓ |

✕ |

✕ |

| VIC 1387 + QSA を使用する M4 |

✕ |

✕ |

✕ |

✕ |

✕ |

✕ |

✕ |

| VIC 1387 を使用する M5 |

✕ |

✕ |

✓ |

✕ |

✓ |

✕ |

✕ |

| VIC 1387 + QSA を使用する M5 |

✓ |

✓ |

✕ |

✕ |

✕ |

✕ |

✕ |

Cisco HyperFlex コンピューティング ノード

Cisco UCS B200-M5 ブレード サーバ

ワークロードに対して、コンピューティング リソースやメモリ リソースを追加する必要が生じたが、追加できるストレージ容量がない場合には、コンピューティング専用のハイブリッド クラスタ構成を使用することができます。この構成を使用する場合には、HyperFlex コンバージド ノードが最小で 3 台(最大で 16 台)と、追加のコンピューティング容量として Cisco UCS B200-M5 ブレード サーバが 1 ~ 16 台必要になります。HX シリーズ ノードは前述のように設定し、Cisco UCS B200 M5 サーバにはブート ドライブが搭載されています。Cisco UCS B200 M5 コンピューティング ノードを使用するには、Cisco UCS 5108 ブレード サーバ シャーシ、および Cisco UCS 2300/2200 シリーズ ファブリック エクステンダのペアも必要です。詳細については、Cisco UCS B200 M5 ブレード サーバ スペック シートを参照してください。

図 17 Cisco UCS B200 M5 ブレード サーバ

Cisco VIC1340 コンバージド ネットワーク アダプタ

Cisco UCS 仮想インターフェイス カード(VIC)1340(図 18)は、Cisco UCS B シリーズ ブレード サーバの M4 世代に特化して設計された、2 ポート 40 Gbps イーサネットまたはデュアル 10 Gbps イーサネット X 4、Fibre Channel over Ethernet(FCoE)対応のモジュール型 LAN on Motherboard(mLOM)です。オプションのポート エクスパンダと組み合わせて使用すると、40 Gbps イーサネットの 2 つのポートに対して Cisco UCS VIC 1340 の機能を有効にできます。

Cisco UCS VIC 1340 では、ポリシーベースでステートレス、かつ俊敏性の高いサーバ インフラストラクチャを構築できます。このインフラストラクチャは、ネットワーク インターフェイス カード(NIC)またはホスト バス アダプタ(HBA)として動的に設定可能な、最大 256 の PCIe 規格準拠インターフェイスをホストに提供します。さらに、Cisco UCS VIC 1340 は Cisco UCS ファブリック インターコネクト ポートを仮想マシンに拡張し、サーバ仮想化の展開および管理を簡素化する Cisco® Data Center Virtual Machine Fabric Extender(VM-FEX)をサポートします。

図 19 Cisco UCS B シリーズ B200 M5 ブレード サーバに搭載された Cisco UCS VIC 1340 仮想インターフェイス カード

Cisco UCS 5108 ブレード シャーシ

Cisco UCS 5100 シリーズ ブレード サーバ シャーシは、Cisco Unified Computing System の重要なビルディング ブロックであり、現在および将来のデータセンターに対してスケーラブルかつ柔軟なブレード サーバ シャーシを提供するとともに、TCO の低減を促進します。

Cisco UCS 5108 ブレード サーバ シャーシ(図 20)は、高さが 6 ラック ユニット(6 RU)で、業界標準の

19 インチ ラックシステムに搭載可能です。1 台のシャーシに最大で 8 個のハーフ幅の Cisco UCS B シリーズ ブレード サーバを格納できます。また、ハーフ幅とフル幅の両方のブレードのフォーム ファクタに対応できます。

4 つのホットスワップ可能な電源モジュールにはシャーシの前面からアクセスでき、単相 2500 W AC、2500 W

–48 VDC、および 2500 W 200 - 380 VDC 電源およびシャーシを使用できます。これらの電源モジュールの効率は最大 94% で、80 Plus プラチナ認証の要件を満たしています。この電源サブシステムは、非冗長構成、N+1 冗長構成、およびグリッド冗長構成をサポートするように設定できます。シャーシの背面には、8 基のホットスワップ可能なファン、4 つの電源コネクタ(各電源装置に 1 つ)、Cisco UCS ファブリック エクステンダ用の 2 つの I/O ベイがあり、Cisco UCS 2000 シリーズ ファブリック エクステンダまたは Cisco UCS 6324 ファブリック インターコネクトのいずれかに対応可能です。パッシブ ミッドプレーンでは、サーバ スロットごとに最大で

80 Gbps の I/O 帯域幅が提供され、2 スロットでは最大で 160 Gbps の I/O 帯域幅になります。シャーシは、2304 ファブリック エクステンダにより、40 ギガビット イーサネットの規格をサポートします。

図 20 Cisco UCS 5108 ブレード シャーシの前面図と背面図

機能と利点

Cisco UCS 5108 ブレード サーバ シャーシは、ブレードベース システムの使用と導入に革命をもたらします。ユニファイド ファブリック、組み込み型の管理機能、およびファブリック エクステンダ テクノロジーが導入されることで、シャーシが使用する物理コンポーネントの数が減少し、独立した管理機能が不要になり、従来のブレード サーバ シャーシよりもエネルギー効率が向上します。こうした単純化により、専用のシャーシ管理やブレード スイッチを用意する必要はなくなり、ケーブル配線も少なくなります。さらに、Cisco UCS の規模を 20 台のシャーシまで複雑さを増すことなく拡大することが可能です。Cisco UCS 5108 シャーシは、Cisco UCS の持つデータセンターの単純さと IT の応答性の利点を実現するうえで欠かせないコンポーネントです。

さらに、Cisco UCS 5108 シャーシには、各シャーシ内のスイッチへの給電と冷却が不要になるという構造上の利点もあります。シスコは、ブレード サーバごとの電力バジェットを拡大することによって、妥協のない拡張性と機能性を備えたブレード サーバを設計することができ、これは、業界随一のメモリ スロットとドライブ容量を備えた新しい Cisco UCS B200 M5 および B480 M5 ブレード サーバで実証されています。詳細については、Cisco UCS 5100 シリーズ ブレード サーバ シャーシ データ シートを参照してください。

Cisco UCS 2304XP ファブリック エクステンダ

Cisco UCS 2304 ファブリック エクステンダは、ファブリック インターコネクトとブレード シャーシに格納されている各ブレードサーバの間でユニファイド ファブリック接続するモジュールとして組み込みます。40 ギガビット イーサネット接続を提供し、接続配線、診断、サーバ ネットワーク管理を簡素化します。本製品は第 3 世代の I/O モジュール(IOM)となり、第 2 世代の Cisco UCS 2200/2300 シリーズ ファブリック エクステンダと共通のモジュールサイズで、現在提供中の Cisco UCS 5108 ブレード サーバ シャーシと互換性を持ちます。

Cisco UCS 2304 によって、Cisco UCS 6300 シリーズ ファブリック インターコネクトと Cisco UCS 5100 シリーズ ブレード サーバ シャーシとの間で I/O ファブリック接続され、すべてのブレードサーバとシャーシがロスレスで、ユーザ定義可能な Fibre Channel over Ethernet(FCoE)ファブリックによって 1 つに結ばれます。ファブリック エクステンダは分散型ラインカードと同様の製品であり、スイッチング処理は行わず、ファブリック インターコネクトの拡張部分として管理されます。このようなアプローチを取ることで、ブレード シャーシからスイッチングが取り払われ、インフラストラクチャ全体の複雑さが低減します。また、Cisco UCS の規模を拡大してシャーシの数を増やしても、必要なスイッチの数が増えることはないので、TCO が削減され、すべてのシャーシを可用性の高い 1 つの管理ドメインとして扱えます。

Cisco UCS 2304 ではファブリック インターコネクトと併せてシャーシ環境(電源、ファン、ブレード)も管理できます。したがって、個別のシャーシ管理モジュールは必要ありません。

Cisco UCS 2304 ファブリック エクステンダは Cisco UCS 5100 シリーズ ブレードシャーシの背面に取り付けられます。Cisco UCS 5100 シリーズ シャーシ 1 台でファブリック エクステンダを 2 枚までサポートできるため、容量と冗長性が向上しています(図 21)。

Cisco UCS 2304 ファブリック エクステンダには 40 ギガビット イーサネット、FCoE 対応の Quad Small Form-Factor Pluggable(QSFP+)ポートが 4 個あり、これらのポートでブレード シャーシとファブリック インターコネクトに接続します。それぞれの Cisco UCS 2304 では、40 ギガビット イーサネット ポートが 1 基あり、ミッド プレーンを経由してシャーシのハーフ幅スロットにそれぞれ接続されます。その結果、合計で 40G X 8 のコンピューティング用インターフェイスが提供されます。通常は冗長性を得るためファブリック エクステンダをペアで構成し、その 2 台により、最大 320 Gbps の I/O をシャーシに提供することが可能です。

図 21 Cisco UCS 2304XP ファブリック エクステンダ

Cisco UCS C220-M5 ラック サーバ

Cisco UCS C220 M5 ラック サーバは、1 RU フォーム ファクタのエンタープライズクラスのインフラストラクチャ サーバです。インテル Xeon プロセッサー E5-2600 v4 および v3 製品ファミリと次世代の DDR4 メモリが組み込まれており、12 Gbps の SAS スループットにより、非常に高いパフォーマンスと効率性を実現します。ワークロードに対して追加のコンピューティング リソースやメモリ リソースが必要になる一方でストレージ容量を追加できない場合にも、HX シリーズ コンバージド ノードの数に応じて、 Cisco UCS C220 M5 ラック サーバをコンピューティング専用ハイブリッド HX クラスタの構築に使用することができます。この構成には、HX シリーズ コンバージド ノードが最小で 3 台(最大で 8 台)と、追加のコンピューティング容量として Cisco UCS C220-M5 ラック サーバが 1 ~ 8 台が含まれています。

図 22 Cisco UCS C220 M5 ラック サーバ

Cisco HyperFlex HX Data Platform 管理プラグイン

Cisco HyperFlex HX Data Platform は専用の高性能な分散ファイルシステムで、多岐にわたるエンタープライズクラス データ管理サービスを提供します。データ プラットフォームの革新により、分散ストレージ テクノロジーが再定義され、従来のハイパーコンバージド インフラストラクチャをしのぐ性能を提供します。このデータ プラットフォームにはエンタープライズ共有ストレージ システムに期待されるすべての機能があるため、複雑なファイバ チャネル ストレージ ネットワークとデバイスの設定や管理をする必要がなくなります。このプラットフォームは操作を簡素化し、データの可用性を保証します。エンタープライズクラスのストレージ機能には、次のものがあります。

· レプリケーションはクラスタ全体でデータを複製するため、単一または複数のコンポーネントに障害が発生した場合にも、データの可用性は影響を受けません(設定されたレプリケーション ファクタによります)。

· 重複排除は常にオンになっているので、仮想クラスタ内のストレージ要件を削減できます。仮想クラスタ内では、クライアント仮想マシンの複数のオペレーティング システムのインスタンスが複製された大量のデータ アクセスを提供します。

· 圧縮によりデータ ストレージ使用量を削減し、コストを削減します。またログ構造のファイル システムは、さまざまなサイズのブロックを保存し、内部のフラグメンテーションを減らすよう設計されています。

· シン プロビジョニングは、実際に利用する必要性が生じるまで、サポートするストレージ スペースを必要とせずに大きなボリュームを作成できるため、データ ボリュームの増加を簡素化し、ストレージを「成長に合わせた投資」という課題に対応します。

· 高速でスペース効率の高いクローン機能により、ストレージ ボリュームを迅速に複製可能です。そのため、仮想マシンをメタデータの操作だけで複製でき、実際のデータ コピーは書き込み操作に対してのみ実行されます。

· スナップショットはバックアップとリモートレプリケーション操作を促進し、常時「オン」状態となっているため、データ可用性のニーズに対応します。

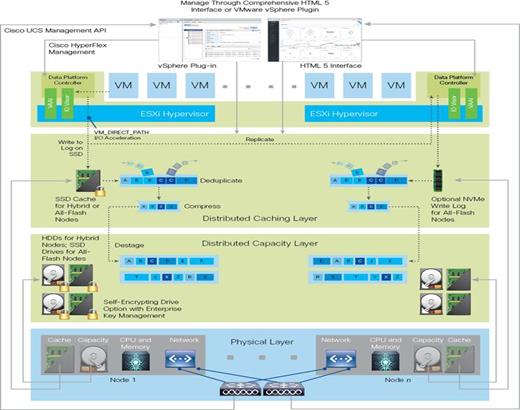

Cisco HyperFlex HX Data Platform は VMware vSphere Web クライアント プラグインを通して管理します。この一元化されたクラスタ制御ポイントを通して、管理者はボリュームを作成し、データ プラットフォームの状態を監視し、リソースの使用を管理できます。また管理者はこのデータを使用して、クラスタをいつ拡張する必要があるかを予測することもできます。軽量な Web インターフェイスがお好みのお客様は、ブラウザを開いて HX クラスタ インターフェイスの IP アドレスへアクセスし、技術プレビュー URL 管理インターフェイスを使用できます。さらに、Web ブラウザでの CLI コマンドの実行を支援するインターフェイスもあります。

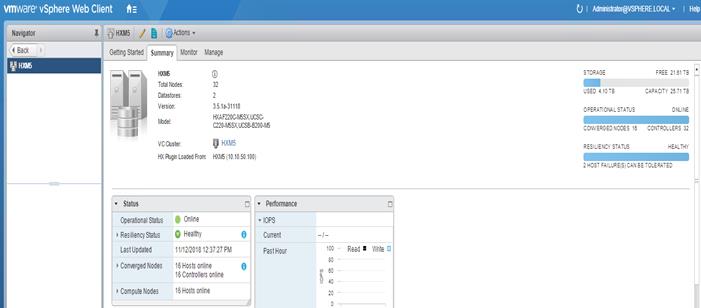

図 23 HyperFlex Web クライアント プラグイン

Cisco HyperFlex Connect HTML5 対応の管理 Web ページ

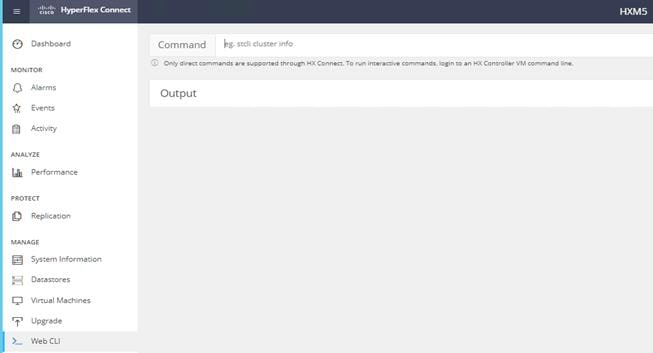

Cisco HyperFlex の主要な管理ツールとして、新しい HTML 5 ベースの Web UI を使用できます。これはクラスタ上で一元化された制御ポイントとして機能します。管理者はボリュームを作成し、データ プラットフォームの状態をモニタリングし、リソースの使用率を管理できます。また管理者はこのデータを使用して、クラスタをいつ拡張する必要があるかを予測することもできます。HyperFlex Connect UI を使用するには、Web ブラウザから HyperFlex クラスタの IP アドレス http://<hx controller cluster ip> にアクセスします。

技術プレビュー Web UI の HX コントローラ クラスタ IP の場合:http://hx controller cluster ip/ui

図 24 HyperFlex Web GUI のプレビュー

図 25 Web CLI

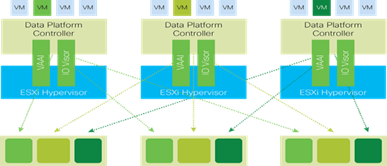

Cisco HyperFlex HX Data Platform コントローラ

HX データ プラットフォーム コントローラは各ノードに常駐し、分散ファイル システムを実装します。コントローラは仮想マシン内のユーザ領域で動作し、ゲスト仮想マシンからのすべての I/O を取り込み、処理します。プラットフォーム コントローラ VM は、VMDirectPath I/O 機能を使用して、物理サーバの SAS ディスク コントローラの PCI パススルー制御を提供します。この方法では、コントローラ VM に物理ディスク リソースのフル コントロールを提供し、SSD ドライブを読み取り/書き込みキャッシング レイヤとして、HDD を分散ストレージ用の容量レイヤとして利用します。コントローラは、プリインストールされた以下の 2 つの VMware ESXi vSphere Installation Bundle(VIB)を使用して、データ プラットフォームを VMware ソフトウェアに統合します。

· IO Visor:この VIB はネットワーク ファイル システム(NFS)マウント ポイントを提供し、個々の仮想マシンに接続された仮想ディスクに ESXi ハイパーバイザがアクセスできるようにします。ハイパーバイザからは、単にネットワーク ファイル システムに接続されているように見えます。

· VMware API for Array Integration(VAAI):このストレージ オフロード API は、vSphere が高度なファイル システム操作(スナップショット、クローニングなど)を要求できるようにします。コントローラは、実際のデータのコピーではなくメタデータの操作によって、これらの操作を発生させます。そのため、迅速な対応が可能で、新しい環境をすぐに導入できます。

レプリケーション ファクタ

各ストレージ ブロックの重複コピー数に関するポリシーがクラスタのセットアップ時に選択され、レプリケーション ファクタ(RF)と呼ばれます。

· レプリケーション ファクタ 3:I/O 書き込みがストレージ レイヤに対してコミットされるたびに、書き込まれたブロックの 2 つの追加のコピーが作成され、全部で 3 つのブロックのコピーが別の場所に保存されます。ブロックは、複数のブロックのコピーが同じディスク上に保存されず、クラスタの同じノード上にも保存されないように分散されます。この仕組みにより、2 つのノード全体で同時に障害が発生してもデータ損失が発生せず、バックアップなどのリカバリ プロセスによる復元が可能になります。

· レプリケーション ファクタ 2:I/O 書き込みがストレージ レイヤに対してコミットされるたびに、書き込まれたブロックの 1 つの追加のコピーが作成され、全部で 2 つのブロックのコピーが別の場所に保存されます。ブロックは、複数のブロックのコピーが同じディスク上に保存されず、クラスタの同じノード上にも保存されないように分散されます。この仕組みにより、1 つのノード全体で障害が発生してもデータ損失が発生せず、バックアップなどのリカバリ プロセスによる復元が可能になります。

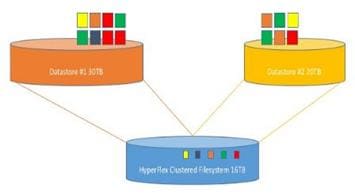

データ分散化

キャッシング レイヤを使用してパフォーマンスが最適化されるように、着信データがクラスタ内のすべてのノードに分散されます(図 26)。すべてのノードに均等に保存されているストライプ ユニットに対して、新しいデータをマッピングすることで、効果的なデータ分散化を実現します。データ レプリカの数は、設定したポリシーによって決まります。アプリケーションがデータを書き込むと、そのデータは関連する情報ブロックが含まれているストライプ ユニットに基づいて適切なノードに送信されます。このデータ分散化アプローチを、同時に複数のストリームを書き込める機能と組み合わせることで、ネットワークとストレージのホット スポットを回避できます。また、仮想マシンの場所にかかわらず同じ I/O パフォーマンスを実現でき、ワークロード配置の柔軟性も向上します。これは、データをローカルで使用するアプローチを取り、利用可能なネットワーキング リソースと I/O リソースを完全に使用せず、ホット スポットに対して脆弱な他のアーキテクチャとは逆のアプローチになります。

図 26 データはクラスタ内の複数のノードにわたってストライプ

VMware Dynamic Resource Scheduling(DRS)などのツールを使用して仮想マシンを新しい場所に移動する場合に、Cisco HyperFlex HX Data Platform ではデータを移動する必要がありません。このアプローチにより、システム間での仮想マシンの移動に伴う影響やコストを大幅に削減できます。

データの操作

データ プラットフォームに分散型のログ構造ファイル システムを採用することで、ノードの構成に応じてキャッシング容量やストレージ容量の処理方法が変化します。

オールフラッシュメモリ構成の場合、データ プラットフォームでは SSD にキャッシング レイヤが使用され、書き込み時の処理速度を向上させます。そして、SSD でキャパシティ レイヤが構成され、読み込み要求が SSD で取得されたデータに対して、直接実行されます。読み込み処理の速度を向上させるために、専用の読み込みキャッシュを用意する必要はありません。

新しいデータは、可用性要件に対応できるように複数のノードにわたってストライプされます(通常は 2 台または 3 台のノードです)。設定したポリシーに基づき、新しい書き込み操作は、クラスタ内の別のノードにある SSD ドライブに複製されます。その後、永続的な書き込み操作として認識されます。このアプローチにより、SSD やノードで障害が発生した場合のデータ損失の可能性を低減できます。なお、データを長期間格納する場合には、書き込み操作がオールフラッシュ メモリ構成にあるキャパシティ レイヤの SSD に移行されます。

ログ構造ファイル システムでは、2 つのうち 1 つの書き込みログ(RF=3 の場合は 3 つのうち 1 つ)に、容量が満たされるまで順に書き込みが行われます。そして、最初のレイヤからキャパシティ レイヤにデータが移行される際に、他の書き込みログに切り替えられます。既存のデータが(論理的に)上書きされる場合、ログ構造のアプローチではシンプルに新しいブロックを付加し、メタデータを更新します。このレイアウトの利点は、シーク操作に大きく時間を費やすことがないように SSD を構成できることです。これにより、データへの書き込み操作と上書き操作がランダムに実行されることによるフラッシュ メディア上のトータルの書き込み処理数を削減し、SSD における書き込み操作の増幅レベルを低減させます。

各ノードのキャパシティ レイヤに移行されたデータは、重複排除されて圧縮されます。このプロセスは書き込み操作が認識された後に行われるため、これらの操作でパフォーマンスに悪影響が及ぶことはありません。小さな重複排除ブロック サイズにより、重複排除率が向上します。さらに圧縮によりデータ スペースを削減します。その後、データはキャパシティ レイヤに移動され、書き込みキャッシュ セグメントは解放されて再利用可能になります(図 27)。

図 27 Cisco HyperFlex HX Data Platform 書き込みオペレーション フロー

キャパシティ レイヤから頻繁に読み取られる直近のデータであるホット データ セットは、メモリにキャッシュされます。しかしながら、オールフラッシュ構成では、高性能の SSD にすでに永続型のデータ コピーがあることから、そのようなキャッシュにはパフォーマンス上の利点がなく、キャッシュの読み込みに SSD は使用されません。これらの構成では、SSD で読み込みキャッシュを使用するとボトルネックとなり、SSD 全体で集約された帯域幅を使用する際の妨げとなる可能性があります。

データ最適化

Cisco HyperFlex HX Data Platform には、精密なインライン重複排除や可変ブロック インライン圧縮が搭載されており、キャッシュ(SSD、メモリ)レイヤおよびキャパシティ(SSD または HDD)レイヤのオブジェクトに対して常に有効になっています。他社のソリューションでは、パフォーマンス維持のためにこれらの機能を無効にする必要があります。一方、シスコのデータ プラットフォームの重複排除と圧縮機能は、パフォーマンスを維持、強化し、物理ストレージのキャパシティ要件を大幅に削減できるように設計されています。

データ重複排除

データ重複排除は、クラスタ内のすべてのストレージ(メモリ、SSD ドライブを含む)で使用されます。このプラットフォームは、特許出願中の Top-K Majority アルゴリズムを基盤とし、実証的研究の成果を活用しています。実証的研究では、小さなデータ ブロックに分割し、少数のデータ ブロックに基づけば、ほとんどのデータは大幅に重複排除できる可能性があることが示されています。頻繁に使用されるブロックのみに対してフィンガープリントとインデックスを作成することにより、少量のメモリで高い重複排除率を実現でき、クラスタ ノード内の価値の高いリソースであるメモリ使用量を節約できます(図 28)。

図 28 Cisco HyperFlex HX Data Platform はパフォーマンスに影響を与えずにデータ ストレージを最適化

インライン圧縮

Cisco HyperFlex HX Data Platform は、データ セットに対して高性能なインライン圧縮を使用し、ストレージ容量を節約します。他の製品も圧縮機能を提供していますが、パフォーマンスに悪影響を及ぼす場合が少なくありません。一方、シスコのデータ プラットフォームは CPU オフロード指示を使用して、圧縮操作によるパフォーマンスへの影響を軽減します。さらに、ログ構造の分散オブジェクト レイヤは、以前に圧縮されたデータの変更(書き込み操作)に影響を及ぼしません。新規の変更は圧縮されて新しい場所に書き込まれ、既存の(古い)データは削除用にマークされます(そのデータをスナップショット内で保持する必要がある場合を除きます)。

書き込み操作の前に、変更対象のデータを読み取る必要はありません。一般的には読み取り、変更、書き込みという手順が必要ですが、この機能はその手順に伴う悪影響を回避し、書き込みパフォーマンスを大幅に向上させます。

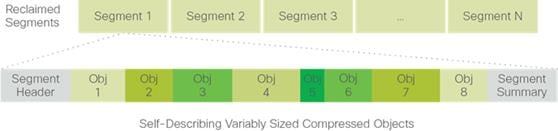

ログ構造の分散オブジェクト

Cisco HyperFlex HX Data Platform では、ログ構造の分散オブジェクト ストア レイヤにより、データをグループ化して圧縮します。データは、重複排除エンジンでフィルタされ、自己アドレス可能なオブジェクトになります。これらのオブジェクトは、ログ構造でディスクに順次書き込まれます。すべての新しい I/O(ランダム I/O を含む)は、キャッシング層(SSD、メモリ)および永続層(SSD または HDD)の両方に順次書き込まれます。オブジェクトはクラスタ内のすべてのノードにわたって分散されるため、ストレージ容量を均等に使用できます。

シーケンシャル レイアウトを使用することで、プラットフォームのフラッシュ メモリの耐久性を向上させることができます。読み取り、変更、書き込みという手順ではないため、圧縮、スナップショット、複製操作のパフォーマンスには影響がほとんどないか、まったくありません。また、全体的なパフォーマンスに対しても同様です。

データ ブロックはオブジェクトに圧縮され、固定サイズのセグメント内に順次配置されます。次に、それらのセグメントはログ構造で順次配置されます(図 29)。ログ構造セグメント内の圧縮された各オブジェクトは、キーを使用して一意にアドレス可能です。各キーはフィンガープリントされ、チェックサムと保存されており、高度なデータ整合性を実現します。また、オブジェクトが時系列で書き込まれるため、このプラットフォームはメディアやノードの障害から迅速に回復できます。障害が発生してデータが削除された場合、その時点より後にシステムが受信したデータのみを再度書き込めば回復できるからです。

図 29 Cisco HyperFlex HX Data Platform はパフォーマンスに影響を与えずにデータ ストレージを最適化

暗号化

安全に暗号化されたストレージでは、データ プラットフォームのキャッシング レイヤと永続型レイヤの両方を随時暗号化します。エンタープライズ キー管理ソフトウェアによる統合、またはパスフレーズで保護されたキーによる統合を通じて、保管中のデータを暗号化することで、HIPAA、PCI DSS、FISMA、SOX 規制に準拠できます。プラットフォーム自体が連邦情報処理標準(FIPS)140-1 に沿うように強化され、暗号化ドライブにキー管理の仕組みを備えることで FIPS 140-2 標準にも準拠します。

データ サービス

Cisco HyperFlex HX Data Platform では、スペース効率の高いデータ サービスがスケーラブルに実装されています。これらのサービスには、シン プロビジョニング、スペース再利用、ポインタベースのスナップショット、クローンが含まれ、パフォーマンスには影響が及びません。

シン プロビジョニング

HX データ プラットフォームでは、ディスク容量を予測して購入・インストールする必要がないため、長期間使用されないままになるリスクを回避し、ストレージを効率的に使用できます。仮想データ コンテナは、任意の量の論理スペースをアプリケーションに示せます。一方、必要な物理記憶域の量は、書き込まれるデータによって決定されます。ビジネス要件に応じて、既存ノードのストレージを拡張したり、ストレージ集約型ノードを追加してクラスタを拡張したりできます。必要になる前の段階で容量確保のためにストレージを購入しておく必要性はなくなります。

スナップショット

Cisco HyperFlex HX Data Platform はメタデータベースのゼロコピー スナップショットを使用して、バックアップ操作やリモート複製を容易にします。これらの機能は、データを常時利用する必要がある企業にとって極めて重要です。スペース効率の高いスナップショットにより、物理ストレージ容量の消費を心配せずに、データのオンライン バックアップを頻繁に実行できます。データはオフライン移動や、これらのスナップショットからの迅速な復元が可能です。

· 高速なスナップショットの更新:スナップショットに変更されたデータが含まれている場合、新しい場所に書き込まれ、メタデータが更新されます。読み取り、変更、書き込みという手順を実行する必要はありません。

· 高速なスナップショットの削除:スナップショットは迅速に削除できます。このプラットフォームでは、SSD 上の少量のメタデータを削除するだけで済みます。デルタディスク技術を使用するソリューションで必要となる、長時間の統合プロセスは不要です。

· 柔軟なスナップショット:Cisco HyperFlex HX Data Platform を使用すると、個別のファイル ベースでスナップショットを作成できます。仮想環境内で、これらのファイルは仮想マシンのドライブにマッピングされます。柔軟に異なる仮想マシンに異なるスナップショット ポリシーを適用できます。

多くの基本的なバックアップ アプリケーションでは、データ セット全体、または前回のバックアップ以降に変更されたブロックが、ストレージあるいはオペレーティング システムが処理可能な速度で読み取られます。この場合、HyperFlex が Cisco UCS 上に 40GbE で構築されていることから、複数のバックアップ スループットが数ギガビット/秒単位となり、パフォーマンスに影響が生じる可能性があります。Windows Server Backup などの基本的なバックアップ アプリケーション、特に初回のバックアップで変更ブロック トラッキングなどが行われない場合には、ピーク時以外の時間にスケジュールする必要があります。

Veeam Backup and Replication v9.5 などのフル機能のバックアップ アプリケーションでは、バックアップ アプリケーションが利用できるスループットを制限して、遅延の影響を受けやすいアプリケーションを稼働時間中に保護する機能があります。v9.5 Update 2 のリリースによって、Veeam は HX のネイティブ スナップショットを統合 した製品になりました。HX のネイティブ スナップショットでは、デルタ ディスク スナップショットによるパフォーマンスの低下が起こらず、スナップショットを削除する際の統合作用に影響を与えるサイズの大きなディスク IO が発生しません。

SQL の管理者にとって特に重要となるのは、Veeam Explorer for SQL です。Microsoft VSS フレームワーク内でのトランザクション レベルを回復させることができます。Veeam Explorer for SQL Server では SQL Server データベースの復元が可能で、バックアップ復元ポイントから、特定の時点までのログ再生から、特定のトランザクションまでのログ再生から、という 3 つの方法があります。その際に、VM または SQL Server をオフラインにする必要はありません。

高速でスペース効率の高いクローン

Cisco HyperFlex HX Data Platform では、クローンは書き込み可能なスナップショットです。クローンを使用すると、テストや開発環境用に、仮想デスクトップやアプリケーションなどの項目を迅速にプロビジョニングできます。これらの高速でスペース効率の高いクローンにより、ストレージ ボリュームを迅速に複製可能です。そのため、仮想マシンをメタデータの操作だけで複製でき、実際のデータ コピーは書き込み操作に対してのみ実行されます。このアプローチでは、何百個ものクローンの作成や削除を数分で行えます。フルコピー方式と比較すると、このアプローチは時間を大幅に節約し、IT の俊敏性や生産性を高められます。

クローンは作成時に重複排除されます。それぞれのクローンに差が生じ始めた場合は、共通するデータは共有され、固有のデータのみが新たな記憶域に保存されます。差が生じたクローン内にあるデータ重複は、重複排除エンジンが排除し、クローンのストレージ フットプリントをさらに削減します。

データ レプリケーションと可用性

Cisco HyperFlex HX Data Platform では、ログ構造の分散オブジェクト レイヤが新しいデータを複製し、データの可用性を高めます。設定したポリシーに基づき、書き込みキャッシュに書き込まれたデータは、異なるノードにある 1 台または 2 台の SSD ドライブに同時に複製されます。その後で、書き込み操作がアプリケーションに認識されます。このアプローチにより、新しい書き込みが迅速に認識されるとともに、SSD やノードの障害からデータを保護できます。SSD またはノードで障害が発生した場合、データの利用可能なコピーを使用して、別の SSD ドライブまたはノード上でレプリカが迅速に再作成されます。

ログ構造の分散オブジェクト レイヤは、書き込みキャッシュからキャパシティ レイヤに移動されたデータも複製します。この複製されたデータは、先ほどと同様に、SSD やノードの障害から保護されています。2 つのレプリカ(合計 3 つのデータ コピー)があるため、クラスタは 2 台の SSD ドライブ、または 2 台のノードで、関連性のない障害が発生しても対応でき、データ損失のリスクがありません。関連性のない障害とは、複数の物理ノードで発生する障害のことです。同じノード上で発生した障害は、同じデータのコピーに影響することから、単一の障害として扱われます。たとえば、ノードのあるディスクで障害が起き、続いて同じノードの別のディスクで障害が発生した場合、これらの関連する障害は、そのシステムでは 1 件の障害とみなされます。この場合、クラスタは、別のノードで関連性のない障害が発生しても耐えられる場合があります。フォールトトレラントな構成および設定の一覧については、Cisco HyperFlex HX Data Platform のシステム管理者ガイドを参照してください。

Cisco HyperFlex HX コントローラ ソフトウェアで問題が発生した場合、そのノード内にあるアプリケーションからのデータ要求は、クラスタ内の別のコントローラに自動で転送されます。この機能を使用すると、クラスタやデータの可用性に影響を与えずに、コントローラ ソフトウェアのアップグレードやメンテナンスをローリング方式で実施できます。この自己修復機能は、Cisco HyperFlex HX Data Platform が実稼働アプリケーションに最適な理由の 1 つです。

さらに、ネイティブ レプリケーションにより、ローカルまたはリモート クラスタに整合性のとれたクラスタ データが転送されます。ネイティブ レプリケーションを使用することで、ローカルまたはリモート環境のスナップショットを取得したり、特定の時点のコピーを格納したりすることができ、バックアップやディザスタ リカバリにもちいることができます。

データ リバランシング

分散ファイル システムには、堅牢なデータ リバランシング機能が必要です。Cisco HyperFlex HX Data Platform では、メタデータ アクセスでオーバーヘッドが生じず、リバランシングが極めて効率的です。リバランシングは、中断を伴わないオンライン プロセスであり、キャッシング レイヤと永続レイヤの両方で実行されます。データを詳細に特定して移動することで、ストレージ容量の使用を改善します。このプラットフォームでは、ノードやドライブが追加または削除された場合や、それらで障害が発生した場合に、既存データが自動でリバランスされます。新しいノードがクラスタに追加されると、その容量とパフォーマンスを新しいデータと既存データで利用可能になります。リバランシング エンジンは、既存データを新しいノードに分配し、クラスタ内にあるすべてのノードの容量とパフォーマンスが均等に使用されるようにします。ノードで障害が発生した場合や、ノードがクラスタから削除された場合は、リバランシング エンジンがデータのコピーを再構築し、それらのノードからクラスタ内にある利用可能なノードに分配します。

オンライン アップグレード

Cisco HyperFlex HX シリーズ システムと HX データ プラットフォームではオンライン アップグレードがサポートされており、業務を中断することなく、環境の更新や拡張を行えます。プロセッサ性能の追加、BIOS、ドライバ、ハイパーバイザ、ファームウェアのダウンロードおよびインストール、Cisco UCS Manager のアップデート、強化、バグ修正などの物理リソースの拡張を容易に行うことができます。

Cisco Nexus 93180 スイッチ

Cisco Nexus 93180YC-FX スイッチは、48 個の 10/25 Gbps Small Form Pluggable Plus(SFP+)ポートと 6 個の Quad 40/100 Gbps SFP+(QSFP+)アップリンク ポートを備えています。すべてのポートはラインレートであり、1 ラックユニット(1RU)のフォーム ファクタで 3.6 Tbps のスループットを提供します。Cisco Nexus 93180-YC-FX の利点を以下に示します。

仕様一覧

· 1 ラック ユニット(1 RU)

· 1/10/25 Gbp ファイバ ポート x 48

· 40/100 Gbps QSFP28 ポート x 6

· 最大 3.6 Tbps の帯域幅

柔軟なアーキテクチャ

· 柔軟なポート設定が可能な Cisco ACI アーキテクチャのリーフ ノードのサポート

· シームレスなコンバージェンスが、1/10/25 Gbps のイーサネットか FCoE ポートまたは 8/16/32 Gbps ファイバ チャネル ポートとして動作可能な 48 個のダウンリンク ポートによって可能

· 40/100 Gbps イーサネットまたは FCoE ポートとして設定できる 6 個のアップリンク ポートによる簡単な移行

多機能

· Cisco ACI を使用した自動化されたポリシーベースのシステム管理

· オープン API によって、シスコ パートナーとサードパーティの統合が可能

· 40 MB の共有バッファ領域によるアクセス ポートとアップリンク ポート間のスピードの不一致の優れた管理

· バックエンド ストレージ接続でのファイバ チャネル インターフェイスのサポート

高可用性と効率に優れた設計

· 高性能な非ブロック アーキテクチャ

· ホットアイルまたはコールドアイルのいずれかの設定に簡単に導入可能

· ホットスワップが可能な冗長電源およびファン トレイ

運用のシンプル化

· IT のワーク フローの自動化とアプリケーションの導入の週単位から分単位への短縮

一流のセキュリティ

· Cisco ACI マイクロセグメンテーションを使用したホワイトリスト モデル、ポリシーの適用およびアプリケーションのセキュリティ

· すべてのポートでのワイヤレート MACsec 暗号化

リアルタイムの可視化とテレメトリ

· 組み込みの Cisco Tetration センサーのサポートによる充実したトラフィック フロー テレメトリおよびラインレートのデータ収集機能

· 実用的なインサイトを1 秒未満で取得

· データセンター内のすべての可視性を実現

投資保護

· 10 Gbps と 25 Gbps のアクセス接続および 40 Gbps と 100 Gbps のアップリンクのサポートのための柔軟な移行オプション

· シスコの 40 GB 双方向トランシーバを使用し、40 ギガビット イーサネット用に既存の 10 ギガビット イーサネット ケーブル設備の再利用が可能

リソース

· Cisco Nexus 9300-EX および 9300-FX プラットフォーム リーフ

· Switches for Cisco Application Centric Infrastructure データ シート

図 30 Cisco Nexus 93180YC-FX スイッチ

VMware vSphere 6.5

VMware では、仮想化ソフトウェアが提供されます。VMware のサーバ向けエンタープライズ ソフトウェア ハイパーバイザ(VMware vSphere ESX、vSphere ESXi、vSphere)は、基盤となるオペレーティング システムを追加することなく、サーバ ハードウェア上で直接実行できるベアメタル ハイパーバイザです。vSphere 用の VMware vCenter サーバでは、クラスタ、ホスト、仮想マシン、ストレージ、ネットワーク、および仮想インフラストラクチャ上の他の重要な要素に対し、一元管理、完全なコントロール、可視性を提供します。

VMware vSphere 6.5 により、vSphere ハイパーバイザ、VMware 仮想マシン、vCenter サーバ、仮想ストレージ、仮想ネットワークの機能が大きく強化され、vSphere プラットフォームのコア機能がさらに拡張されます。

VMware vCenter サーバ

· 移行ツール

· アプライアンスの管理の改善

· ネイティブな高可用性

· ネイティブなバックアップおよび復元

· vSphere Web クライアントおよび完全にサポートされている HTML5 ベースの vSphere クライアントを含む VCenter Server 6.5 の全般的な強化も実施。

VMware ESXi 6.5 Hypervisor

· vSphere 6.5 を使用すると、管理者は、 デフォルトで有効になっている vSphere Update Manager による ESXi ホストの設定へのパッチ適用、アップグレードおよび管理が飛躍的が向上していることを確認できます。

· VMware ツールと仮想ハードウェアのアップグレード

· ホストのプロファイルと日常的な運用の改善

· 自動展開の管理機能および設定のルールの改善

· モニタリングの強化、GPU 使用状況をモニタするオプションの追加

· VMkernel ネットワーク アダプタの専用のゲートウェイ

· ストレージのポリシー ベースの管理を使用した VMware vSphere ストレージの I/O 制御

VMware Horizon

VMware Horizon は、統合型アーキテクチャ上に構築されたアプリケーションおよびデスクトップ仮想化ソリューションです。管理が容易で、あらゆる組織のユーザのニーズを満たすのに十分な柔軟性を備えています。オンプレミス導入と同じアーキテクチャと管理ツールを使用して、パブリック クラウド、プライベート クラウド、およびハイブリッド クラウドの導入を管理できます。

· サーバ ベースのホスト型セッションとも呼ばれる VMware Horizon 仮想マシンおよび RDSH:これは、Microsoft Windows サーバから任意のタイプのデバイス(Windows PC、Mac、スマートフォン、タブレットなど)にホストされるアプリケーションです。一部の VMware エディションには、モバイル デバイス上での Windows アプリケーションのユーザ エクスペリエンスをさらに最適化するテクノロジーが組み込まれています。たとえば、ネイティブ モバイル デバイスのディスプレイ、ナビゲーション、コントロールを自動的に Windows アプリケーションに変換し、モバイル ネットワーク上のパフォーマンスを向上させ、開発者があらゆるモバイル環境にカスタム Windows アプリケーションを最適化できるようになっています。

· サーバ ホスト型デスクトップとも呼ばれる VMware Horizon RDSH セッション ユーザ:これは、Windows サーバ オペレーティング システムからホストされる、低コストのロックダウン型 Windows 仮想デスクトップです。このデスクトップは、コール センターの従業員など、標準の一連作業を行うユーザに最適です。

VMware Horizon を使用する利点

VMware Horizon 7 バージョン 7.6 には、次の新機能および拡張機能が用意されています。

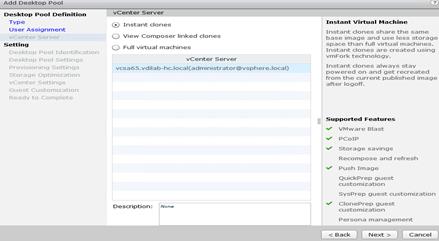

· 瞬時に複製

- 従来の View Composer のリンク クローンよりもさらに迅速なプロビジョニングを実行できる新しいタイプの仮想マシン。

- 完全に機能するデスクトップは、2 秒以内にプロビジョニングが可能です。

- スケジュールされたプール再作成の時間よりも前に親イメージを準備できるため、新しい OS イメージでのデスクトップ プールの再作成は、View Composer にかかるわずかな時間で達成できます。

- クローンのリバランシングは、使用可能なデータストア全体で自動的に行われます。

- View Storage Accelerator は自動的に有効になります。

- インスタント クローン デスクトップ プールと共に NVIDIA グリッド vGPU を使用できます。NVIDIA GRID vGPU を使用して PCoIP をディスプレイ プロトコルとして設定するのは技術プレビュー機能です。

- 大規模なインスタント クローン デスクトップ プールを作成する複数の vLAN ネットワークを選択することができます。静的ポート グループのみをサポートします。

- 内部 VM デバッグ モードを使用して、インスタント クローン デスクトップ プールまたはインスタント クローン ファームで内部仮想マシンのトラブルシューティングを行うことができます。

- 管理者は、vCenter Server が管理する仮想デスクトップの再起動またはリセットを実行できます。

- インスタント クローン仮想マシンのメンテナンスを実施するには、ESXi ホストをメンテナンス モードにします。ESXi ホストをメンテナンス モードにするには、vSphere Web クライアントを使用します。ESXi ホストのメンテナンス操作によって、その ESXi ホストから親仮想マシンが自動的に削除されます。

· VMware Blast Extreme

- Horizon プラットフォームでは、Blast Extreme が完全にサポートされています。

- NVIDIA グラフィックス カードでは、モニタが接続されていない物理マシンへの接続がサポートされています。これは、Horizon 7 バージョン 7.1 の技術プレビュー機能です。

- Blast セキュア ゲートウェイには Blast Extreme Adaptive Transport(BEAT)ネットワーキングが含まれており、さまざまな速度とパケット損失など、ネットワークの状態を動的に調整します。

- 管理者は、プール、ファーム、および権限付与のデフォルトまたは利用可能なプロトコルとして VMware Blast ディスプレイ プロトコルを選択できます。

- エンド ユーザは、リモート デスクトップおよびアプリケーションに接続するときに、VMware Blast ディスプレイ プロトコルを選択できます。

- VMware Blast Extreme 機能は次のとおりです。

§ TCP および UDP トランスポートのサポート

§ H.264 サポートによる多くのデバイス間での最適なパフォーマンス

§ バッテリ寿命の改善のためデバイス電力消費の削減

§ サーバあたりのグラフィカル ワークロードの増加、パフォーマンスの向上、およびリモート ユーザの優れたエクスペリエンスのための NVIDIA GRID アクセラレーション。

· True SSO

- VMware Identity Manager 統合のために、True SSO は、エンドツー エンドのログイン エクスペリエンスを合理化します。スマート カードまたは RSA SecurID または RADIUS トークンを使用してユーザが VMware Identity Manager にログインすると、リモート デスクトップまたはアプリケーションを使用するために Active Directory のクレデンシャルを入力する必要はありません。

- パスワードのない Windows ログインを有効にするには、短期間の Horizon 仮想証明書を使用します。

- ネイティブ Horizon Client または HTML アクセスのいずれかがサポートされています。

- True SSO のシステム ヘルス ステータスは、Horizon 管理者ダッシュ ボードに表示されます。

- 1 つのドメイン、複数のドメインに 1 つのフォレスト、複数のドメインにマルチ フォレストで使用できます。

· スマート ポリシー

- クリップボードのカット アンド ペースト、クライアント ドライブのリダイレクト、USB リダイレクト、および定義されたポリシーによる仮想印刷デスクトップ機能の制御。

- PCoIP プロファイルを介した PCoIP セッション制御。

- ユーザの場所、デスクトップ タギング、プール名、および Horizon Client レジストリ値に基づく条件付きポリシー。

· VMware Blast と PCoIP セッションのクリップボード メモリのサイズの設定

Horizon の管理者は、VMware Blast および PCoIP セッションの GPO の設定によってサーバのクリップボードのメモリのサイズを設定できます。Windows、Linux、および Mac OS X システムの Horizon Client 4.1 ユーザは、クライアントのクリップボードのメモリのサイズを設定できます。メモリのサイズは、サーバとクライアントのクリップボードのメモリのサイズ値より小さくするのが効果的です。

· VMware Blast ネットワーク リカバリの拡張機能

iOS、Android、Mac OS X、Linux、および Chrome の OS クライアントから開始された VMware Blast セッションでは、ネットワーク リカバリがサポートされています。以前は、ネットワーク リカバリは、Windows クライアント セッションでのみサポートされていました。VMware Blast セッション中に予期せずネットワーク接続が切断された場合は、Horizon Client がネットワークへの再接続を試行し、リモート デスクトップまたはアプリケーションの使用を続行できます。ネットワーク リカバリ機能は IP ローミングもサポートしています。これは、WiFi ネットワークへの切り替え後、VMware Blast セッションを再開できることを意味します。

· ログイン名を記憶しない Horizon 管理者の設定

Horizon 管理者はユーザ名の保存チェックボックスを表示しない、したがって管理者のログイン名を記憶しないように設定できます。

· Mac OS X ユーザによるクレデンシャルの保存を許可

Horizon 管理者は、Horizon Client Mac OS X システムがユーザのユーザ名、パスワード、およびドメイン情報を記憶するように接続サーバを設定できます。ユーザが自分のクレデンシャルを保存することを選択すると、後続の接続では、クレデンシャルが Horizon Client のログイン フィールドに追加されます。

· Windows 10

- Windows 10 は、デスクトップのゲスト オペレーティング システムとしてサポートされています。

- Horizon Client は Windows 10 で実行されます。

- Windows 10 ではスマート カードがサポートされています。

- Horizon ユーザ プロファイルの移行ツールは、Windows 7、8/8.1、Server 2008 R2、または Server 2012 R2 ユーザ プロファイルの Windows 10 ユーザ プロファイルへの移行を行います。

· RDS デスクトップとホストされるアプリ

- View コンポーザ。View コンポーザとリンク クローンは、RDS サーバ ファームを自動的かつ効率的に管理します。

- グラフィックス サポート。VDI デスクトップでの既存の 3D vDGA および GRID vGPU グラフィックス ソリューションは RDS ホストに拡張されており、グラフィックを多用するアプリケーションを RDS デスクトップおよびホストされるアプリで実行できます。

- ロード バランシングの拡張新しい機能では、メモリと CPU リソースに基づくサーバ ファーム アプリケーションのロード バランシングを提供します。

- 一方向の AD 信頼

一方向の AD 信頼ドメインがサポートされています。この機能により、Horizon 接続サーバが外部ドメイン内になくてもよい、ドメイン間の限定的な信頼関係をもつ環境が有効になります。

· クラウド ポッド アーキテクチャ(CPA)の拡張機能

- ホストされるアプリのサポート。アプリケーションのリモート処理のサポートにより、ポッド フェデレーション全体でグローバル権限を使用したアプリケーションの起動が可能になります。

- HTML アクセス(Blast)のサポート。ユーザは、HTML アクセスを使用してクラウド ポッド アーキテクチャ展開内のリモート デスクトップおよびアプリケーションに接続できます。

· アクセス ポイントの統合

- アクセス ポイントとは、インターネットからセキュアなリモート アクセスを可能にするためにセキュリティを強化した Linux ベースの仮想アプライアンスであり、仮想デスクトップとアプリケーションのリソースを保護します。アクセス ポイントは、Horizon 接続サーバへの新しい認証 DMZ ゲートウェイを提供します。アクセス ポイントでのスマート カードのサポートは、技術プレビューとして使用できます。セキュリティ サーバは引き続き、代替の設定として使用されます。詳細については、「アクセス ポイントの設定と配置」を参照してください。

· FIPS

- インストール時の FIPS モードにより、お客様は Horizon 6 を導入するための高度なセキュリティの要件を持つことができます。

· グラフィックスの拡張機能

- AMD vDGA を使用すると AMD グラフィックス ハードウェアの vDGA パススルー グラフィックが有効になります。

- 4K 解像度モニター(3840 x 2160)がサポートされます。

· Horizon 管理者の機能拡張

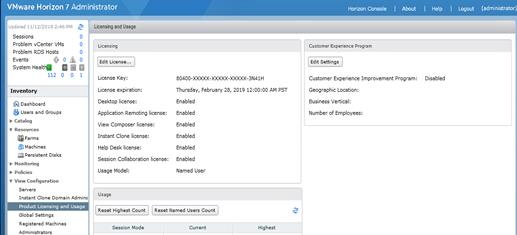

- Horizon 管理者には、ライセンス キー、名前付きのユーザ、およびユーザの同時接続数を含む追加のライセンス情報が表示されます。

- プールの作成が、Horizon 管理者による既存のプールのクローン化により簡素化されます。

· Horizon 7 による Linux デスクトップの拡張機能

- 管理される仮想マシンのサポート

- SSO を使用したスマート カードのリダイレクトのサポート

- iOS 向けの Horizon Client のサポート

- SLES 12 SP1 のサポート

- H.264 エンコーダ ソフトウェアのサポート

- RHEL/CentOS 7 デスクトップでの SSO サポート

True シングル サインオン(SSO)は RHEL 7 および CentOS デスクトップでサポートされています。

- サポートされるプラットフォームの追加

Ubuntu 18.04、RHEL/CentOS 6.10、および RHEL/CentOS 7.5 プラットフォームのサポートが追加されています。

- RHEL 7.1 以降のバージョンのインスタント クローンのサポート

RHEL 7.1 以降がインストールされているシステムで、インスタント クローンのフローティング デスクトップ プールを作成できます。

· 追加機能

- セキュリティ サーバでの VMware Blast Extreme を使用した IPv6 のサポート。

- Horizon 管理者セキュリティ保護レイヤ。詳細については、VMware ナレッジ ベース(KB)の記事 2144303 を参照してください。

- 不注意によるプールの削除に対する保護。

- RDS のデバイスごとのライセンスの改善。

- Intel vDGA のサポート。

- vDGA を使用した AMD マルチ ユーザー GPU のサポート。

- 復元力のあるアップグレード。

- Windows Horizon Client のスケーリングが表示されます。

- DPI スケーリングは、システム レベルで設定されていて、スケーリング レベルが 100 を超える場合にサポートされます。

· vSphere のサポート

- vSphere 6.5 U2 がサポートされています。

· バーチャル デスクトップ

- vGPU 対応の仮想デスクトップの vMotion サポート

VMware RDS ホスト セッションとは何ですか。

VMware RDS ホスト セッションの説明を次に示します。

· RDS ホストは、リモート アクセス用のアプリケーションおよびデスクトップ セッションをホストするサーバ コンピュータです。RDS ホストには、仮想マシンまたは物理サーバを指定できます。

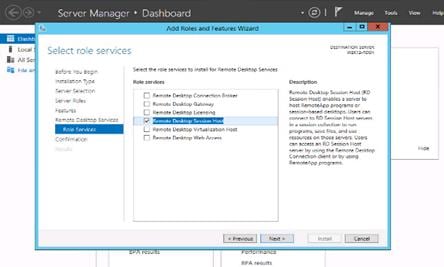

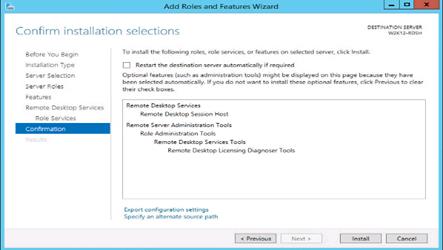

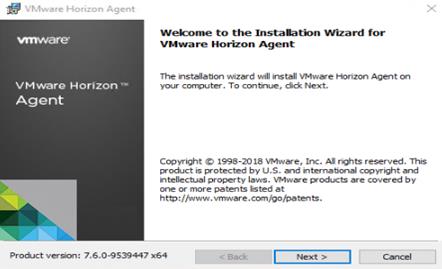

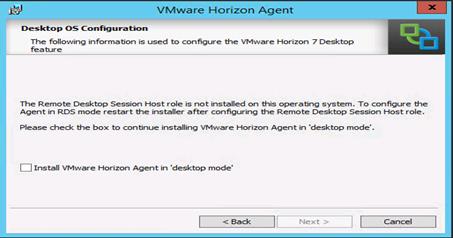

· RDS ホストには、Microsoft リモート デスクトップ サービス ロール、Microsoft リモート デスクトップ セッション ホスト サービス、および Horizon エージェントがインストールされています。リモート デスクトップ サービスは、以前はターミナル サービスと呼ばれていました。リモート デスクトップ セッション ホスト サービスにより、サーバはアプリケーションおよびリモート デスクトップのセッションをホストすることができます。RDS ホストにインストールされている Horizon エージェントを使用すると、ユーザは、ディスプレイ プロトコル PCoIP Blast Extreme を使用してアプリケーションやデスクトップ セッションに接続できます。両方のプロトコルにより、イメージ、オーディオ、およびビデオなどのリモート コンテンツの配信向けに最適化されたユーザ エクスペリエンスが提供されます。

· RDS ホストのパフォーマンスは、多くの要因によって異なります。Windows サーバのさまざまなバージョンのパフォーマンスを調整する方法については、http://msdn.microsoft.com/library/windows/hardware/gg463392.aspx を参照してください。

· Horizon 7 は、RDS ホスト上のユーザごとに最大 1 つのデスクトップ セッションおよび 1 つのアプリケーション セッションをサポートしています。

· ユーザが RDS デスクトップまたは同じ RDS ホストでホストされているアプリケーションから同時に印刷ジョブを送信すると、RDS 上の ThinPrint サーバは印刷要求を並列ではなくシリアルで処理します。これにより、一部のユーザに遅延が発生する可能性があります。プリント サーバは、印刷ジョブの完了を待機してから次のジョブを処理するわけではないことに注意してください。異なるプリンタに送信される印刷ジョブは、並列で印刷されます。

· ユーザがアプリケーションと RDS デスクトップも起動する場合、および両方が同じ RDS ホストでホストされている場合、それらは同じユーザ プロファイルを共有します。ユーザがデスクトップからアプリケーションを起動すると、両方のアプリケーションがユーザ プロファイルの同じ部分を変更しようとする場合に競合が発生する可能性があります。

· リモート アクセスのためにアプリケーションまたは RDS デスクトップを設定する手順では、次の作業が必要です。

· アプリケーションのインストール

- アプリケーション プールを作成する場合は、アプリケーションを RDS ホストにインストールする必要があります。インストールされているアプリケーションのリストを Horizon 7 に自動的に表示させる場合、スタート メニューからすべてのユーザが利用できるように、アプリケーションをインストールする必要があります。アプリケーション プールを作成する前であればいつでもアプリケーションをインストールすることができます。アプリケーションを手動で指定する場合、アプリケーション プールの作成前または後のいずれかであればいつでもアプリケーションをインストールすることができます。

· 重要

- アプリケーションをインストールするときに、ファーム内のすべての RDS ホスト上および各 RDS ホスト上の同じ場所にインストールする必要があります。そうしないと、View アドミニストレータ ダッシュ ボードにヘルスに関する警告が表示されます。このような状況では、アプリケーション プールを作成する場合に、アプリケーションを実行しようとするとエラーが発生する可能性があります。

- アプリケーション プールを作成する際に、Horizon 7 には、ファーム内のすべての RDS ホスト上で、スタート メニューから個々のユーザではなくすべてのユーザが利用可能なアプリケーションが自動的に表示されます。そのリストから任意のアプリケーションを選択できます。さらに、スタート メニューから一部のユーザが利用できるアプリケーションを手動で指定できます。RDS ホストにインストールできるアプリケーションの数に制限はありません。

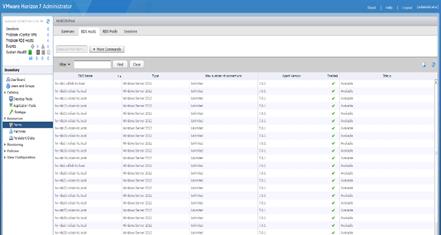

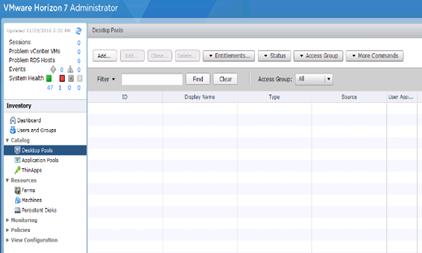

ファーム、RDS ホスト、デスクトップおよびアプリケーション プール

VMware Horizon を使用すると、ユーザはデスクトップおよびアプリケーション プールを作成して、仮想マシン ベースのデスクトップ、セッション ベースのデスクトップ、物理コンピュータ、およびアプリケーションにリモート アクセスできます。Horizon は、Microsoft リモート デスクトップ サービス(RDS)および VMware PC over IP(PCoIP)テクノロジーを活用し、高品質のリモート アクセスをユーザに提供します。

· RDS ホスト

- RDS ホストは、Windows リモート デスクトップ サービスおよび View エージェントがインストールされているサーバ コンピュータです。 これらのサーバは、ユーザがリモートでアクセスできるアプリケーションおよびデスクトップ セッションをホストします。RDS デスクトップ プールまたはアプリケーションを使用するには、エンド ユーザは Horizon Client 3.0 以降のソフトウェアにアクセスできる必要があります。

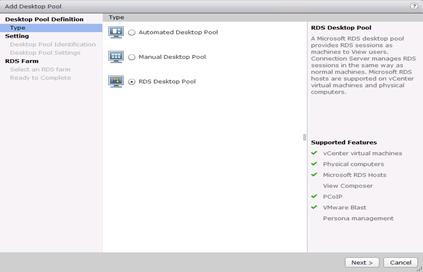

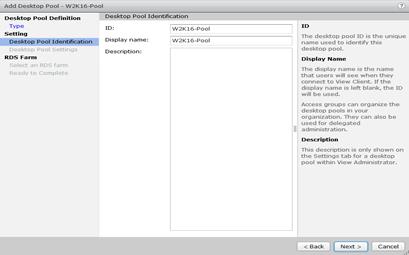

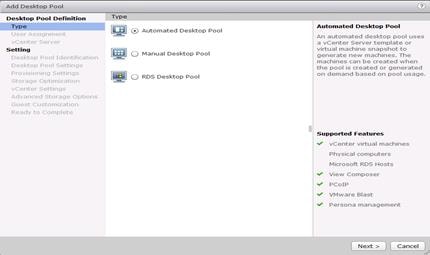

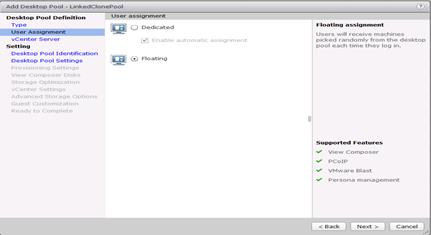

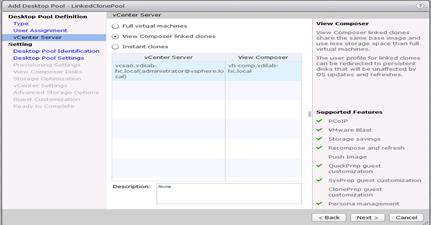

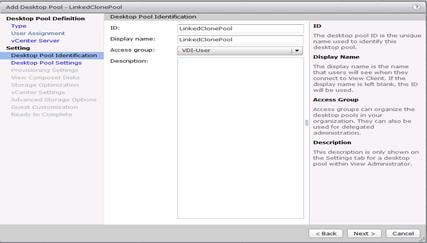

· デスクトップ プール

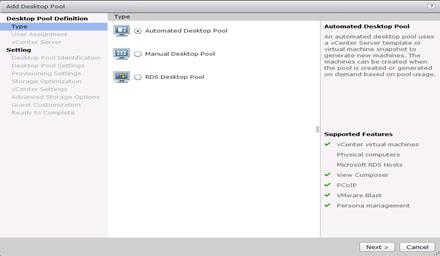

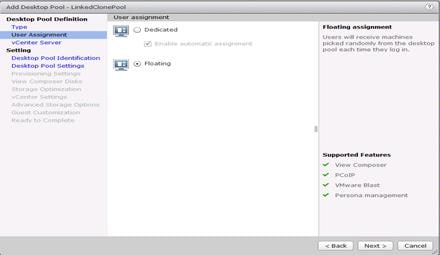

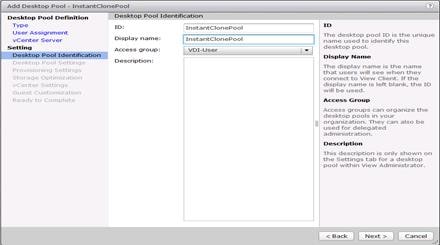

- デスクトップ プールには自動、手動、および RDS の 3 つのタイプがあります。自動デスクトップ プールは、同一の仮想マシンのプールを作成するのに vCenter Server 仮想マシン テンプレートまたはスナップショットを使用します。手動のデスクトップ プールは、既存の vCenter Server 仮想マシン、物理コンピュータ、またはサード パーティ仮想マシンのコレクションです。自動または手動のプールでは、1 人のユーザが任意のタイミングでリモートでアクセスする際に各マシンを利用できます。RDS デスクトップ プールはマシンのコレクションではありませんが、RDS ホスト上のデスクトップ セッションをユーザに提供し、複数のユーザに RDS ホスト上のデスクトップ セッションを同時に設定できます。

· アプリケーション プール

- アプリケーション プールを使用すると、多くのユーザにアプリケーションを提供できます。アプリケーション プール内のアプリケーションは、RDS ホストのファームで実行されます。

· ファーム

- ファームは RDS ホストのコレクションであり、それらのホストの管理を容易にします。ファームには可変数の RDS ホストを設定でき、アプリケーションまたは RDS デスクトップの一般的なセットをユーザに提供します。RDS デスクトップ プールまたはアプリケーション プールを作成する際に、ファームを指定する必要があります。ファームの RDS ホストは、ユーザにデスクトップおよびアプリケーション セッションを提供します。

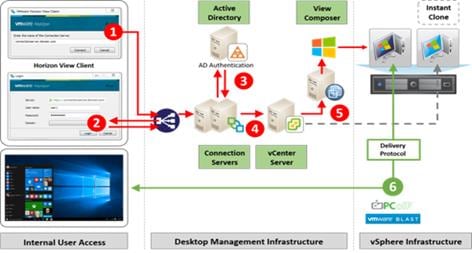

図 31 VMware Horizon アーキテクチャ概要

Cisco Unified Computing System の VMware Horizon のアーキテクチャと設計、

および Cisco HyperFlex のシステム設計の基本

ますます増加し多様化するユーザ デバイス基盤、従来のデスクトップの管理における複雑さ、セキュリティ、

さらにはプログラムを機能させるための Bring Your Own Computer(BYO)など、仮想デスクトップ ソリューションを考慮すべき理由は数多くあります。仮想デスクトップ ソリューションの設計の最初のステップは、ユーザのコミュニティとそのロールを正常に実行するために必要なタスクのタイプを理解することです。次のサンプル ユーザ分類が提供されます。

· ナレッジ ワーカーは現在、ただオフィスで一日中作業するだけではありません。会議に出席し、支社を訪れ、

自宅やコーヒー ショップでさえも作業を行います。これらのさまざまな場所で働く作業者たちは、どこにいるとしてもすべて同じアプリケーションとデータへのアクセスを期待機体しています。

· 外部請負業者の存在は、ますます日常的なビジネスの一部になってきています。業者はアプリケーションや特定のデータへのアクセスを必要としますが、管理者はまだ彼ら業者に使用されるデバイスや、53 もの現場の制御はできません。このため、IT にとってこれらのユーザにデバイスを提供するコストと、これらのユーザに各自のデバイスからのアクセスを許可するセキュリティ リスクとが妥協点を見つける上での妨げになっています。

· タスク作業者は、一連の明確に定義されたタスクを実行します。作業者は、小規模なアプリケーション セットにアクセスし、自分の PC からの要件も限定されています。ただし、顧客やパートナー、従業員などと対話があるため、最も重要なデータへのアクセスをもっています。

· モバイル作業者は、ネットワークに接続する必要性に関係なく、どこからでも仮想デスクトップへアクセスできる必要があります。さらに、これらの作業者は、PC に独自のアプリケーションや、各自の写真や音楽といったデータを保存してパーソナライズすることを期待しています。

· 共用ワークステーション ユーザは、多くの場合、最先端の大学やビジネス コンピュータ ラボ、会議室やトレーニング センターにいます。共有ワークステーション環境には、組織のニーズが変化するときに優先して最新のオペレーティング システムとアプリケーションでデスクトップを再度プロビジョニングするという一定の要件があります。

ユーザの分類が特定され、各ユーザの分類のビジネス要件が定義されたら、ユーザの要件に基づいて必要な仮想デスクトップの種類を評価することが不可欠になります。各ユーザ向けに基本的には次の 5 つ潜在的なデスクトップ環境があります。

· 従来の PC:従来の PC は、一般的にデスクトップ環境を構成していたもの(ローカルにオペレーティング システムがインストールされた物理デバイス)です。

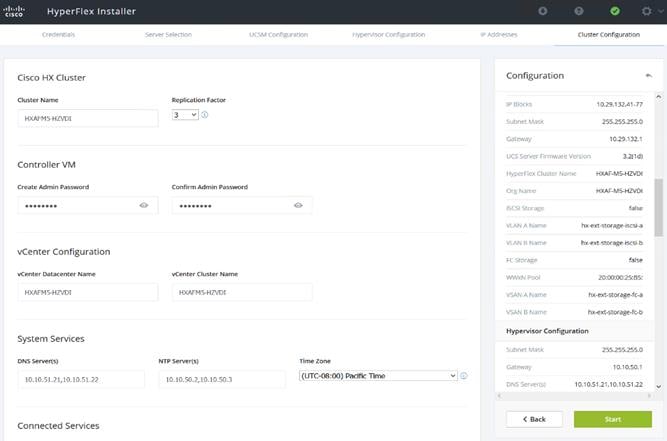

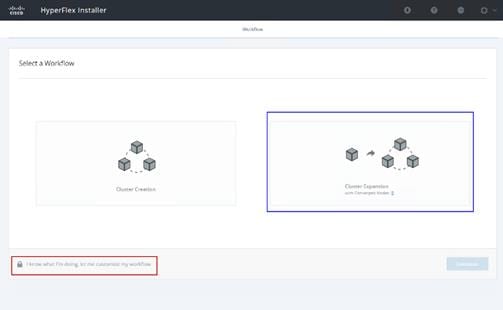

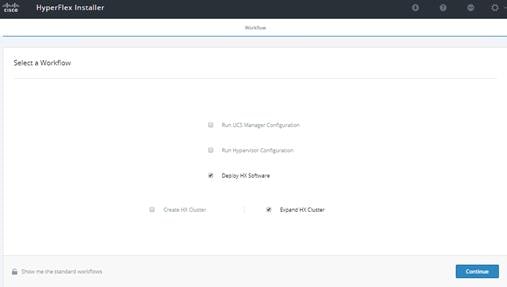

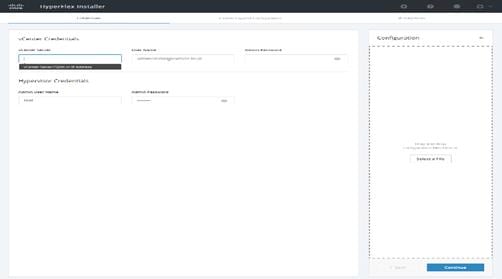

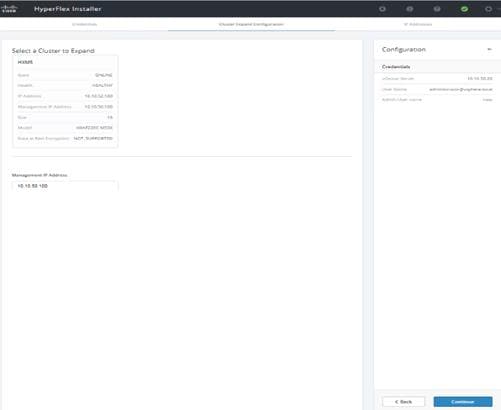

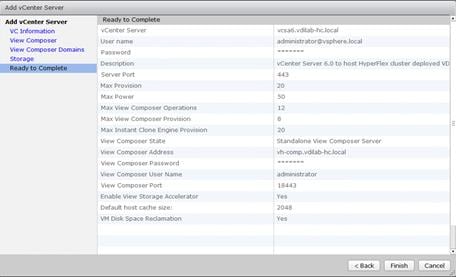

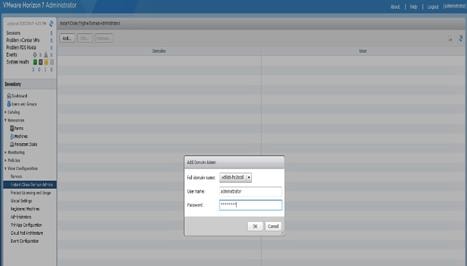

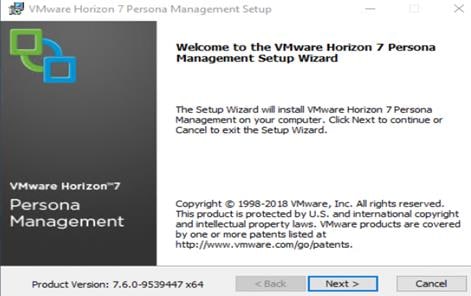

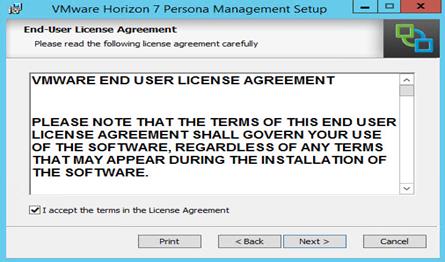

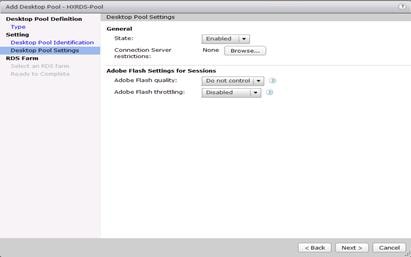

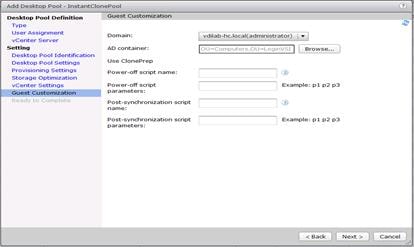

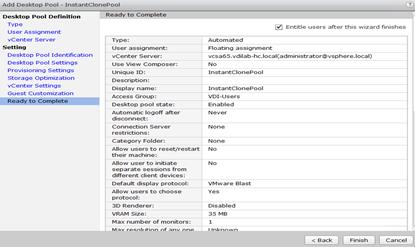

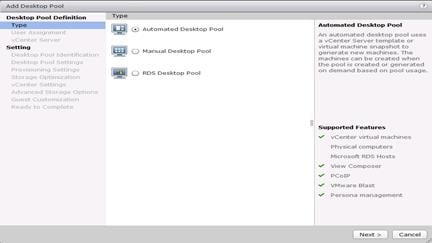

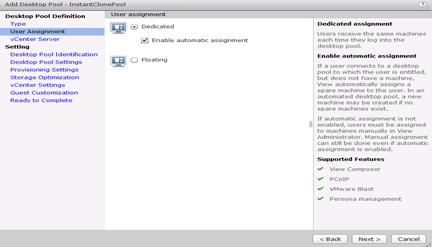

· ホステッド共有デスクトップ:ホステッド サーバベース デスクトップは、デリバリプロトコルを介してユーザが相互対話できるデスクトップです。ホステッド サーバベース デスクトップでは、Microsoft Windows Server 2012 または 2016 などのサーバ オペレーティング システムの単一のインストール済インスタンスが、複数のユーザにより同時に共有されます。各ユーザは、デスクトップ「セッション」を受信し、隔離されたメモリ スペースで作業します。1 人のユーザによって行われた変更は他のユーザに影響を与える可能性があります。