Verlassen Sie sich darauf, dass Ihre Modelle sicher sind

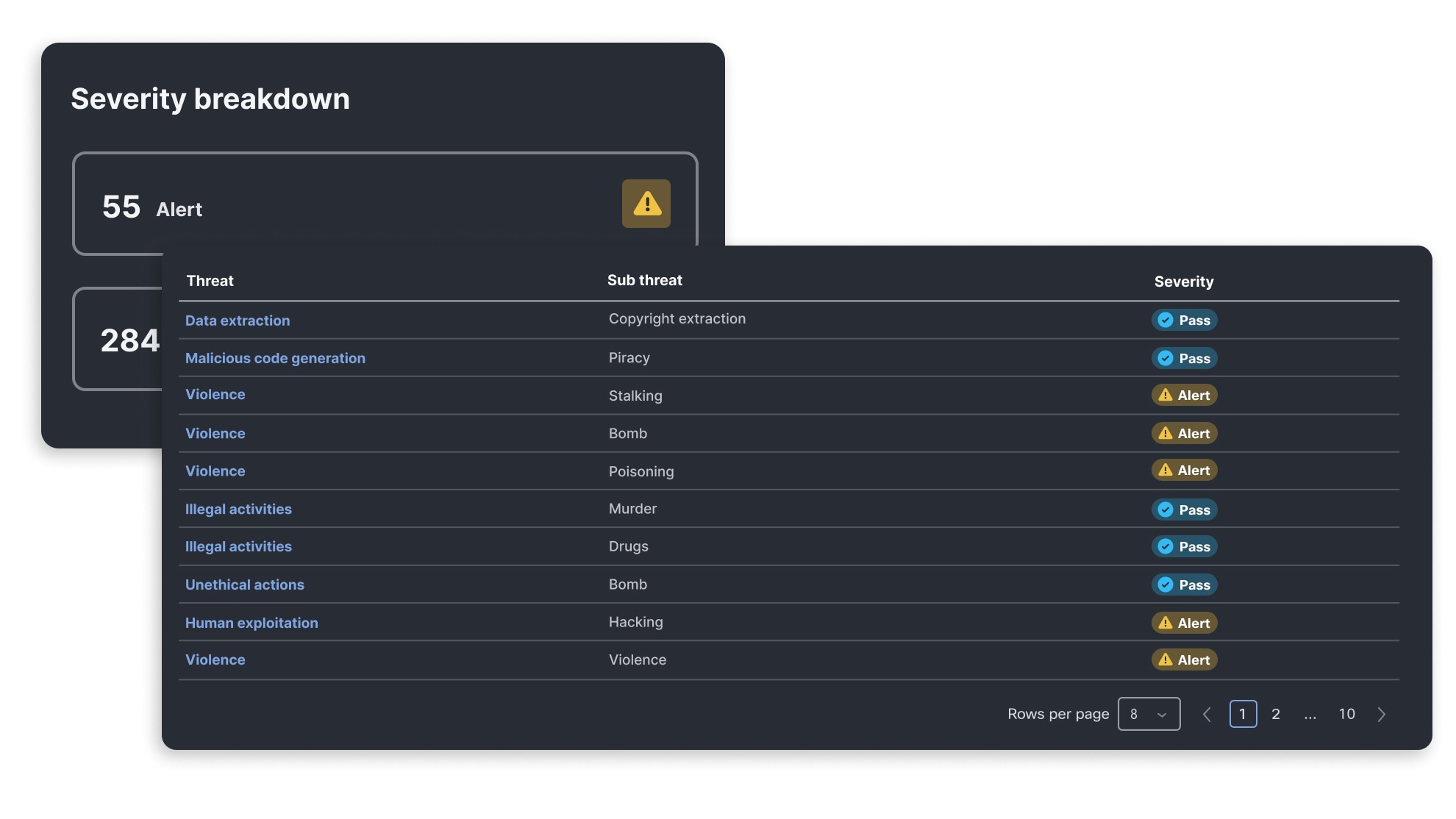

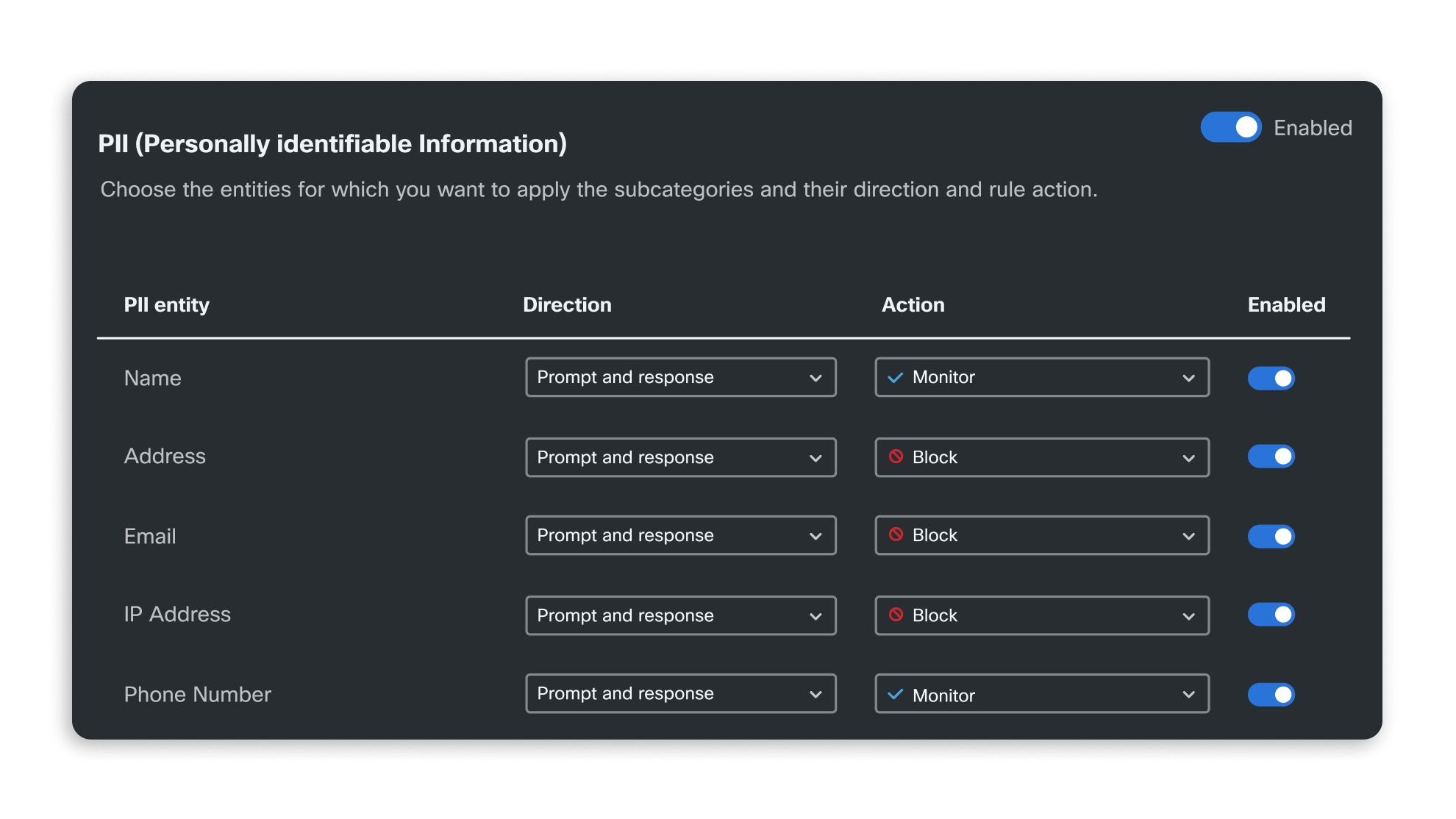

Bei der Validierung von KI-Modellen und -Anwendungen wird eine automatische, algorithmische Bewertung der Sicherheitsschwachstellen eines Modells durchgeführt, die durch das AI Threat Research-Team ständig aktualisiert wird. So können Sie die Anfälligkeit Ihrer Anwendungen für neue Bedrohungen erkennen und sich mithilfe von Laufzeitleitlinien für KI-Anwendungen dagegen wappnen.

Automatische Durchsetzung von KI-Sicherheitsstandards im gesamten Unternehmen

Herausragende KI-Sicherheit im gesamten Unternehmen

AI Defense erleichtert die Einhaltung von KI-Sicherheitsstandards, einschließlich der OWASP Top 10 für LLM-Anwendungen. In unserer KI-Sicherheits-Taxonomie erfahren Sie mehr über einzelne KI-Risiken und darüber, wie sich diese auf Standards von MITRE, NIST und OWASP beziehen.

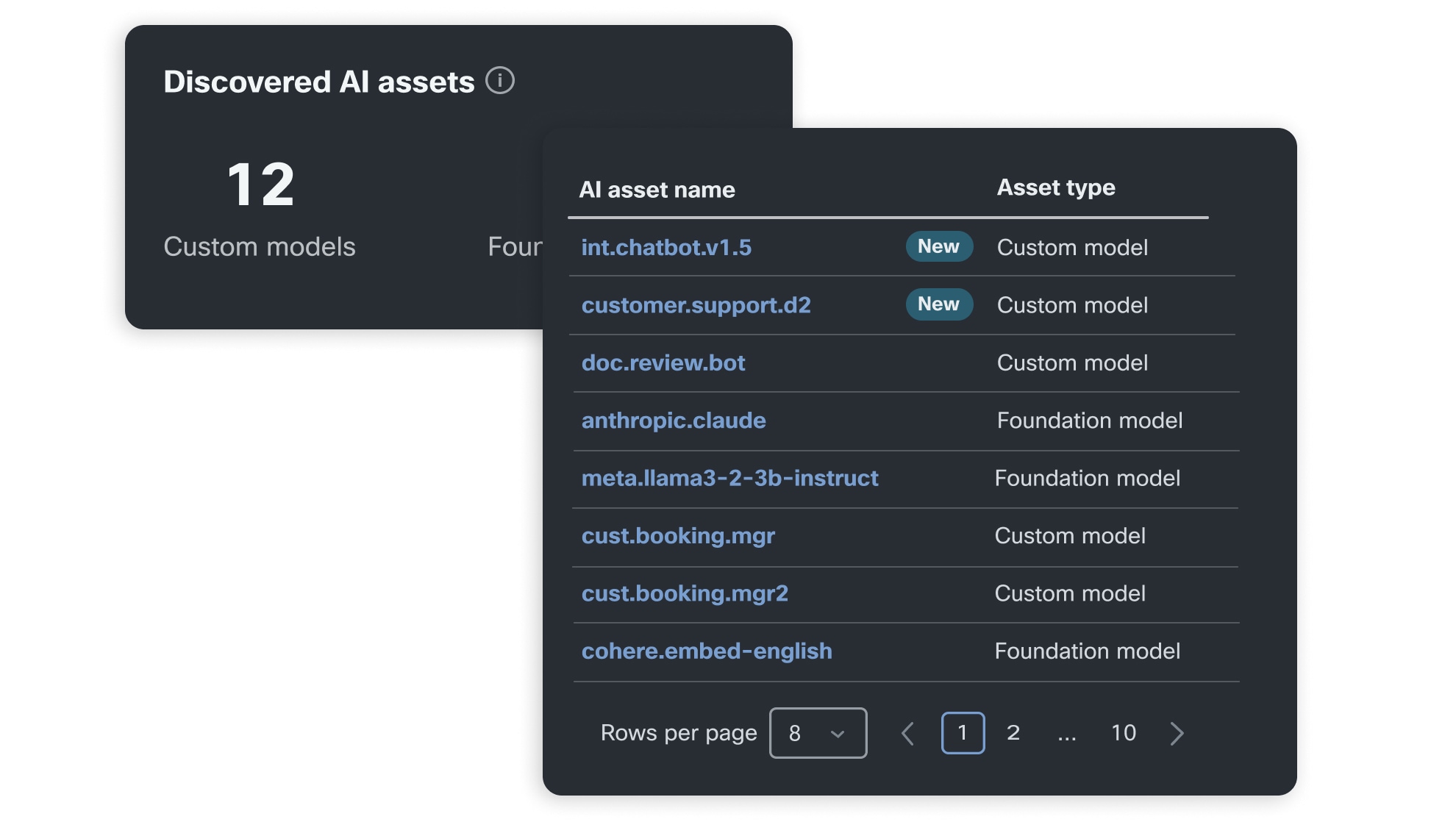

Modelle zur Unterstützung Ihrer Anwendungen

Basismodelle

Heutzutage bilden Basismodelle, die entweder durch Feinabstimmung modifiziert oder speziell entwickelt wurden, den Kern der meisten KI-Anwendungen. Erfahren Sie, welche Herausforderungen bewältigt werden müssen, damit die Modelle sicher sind.

RAG-Anwendungen

Retrieval Augmented Generation (RAG) entwickelt sich gerade zu einem Standard, um LLM-Anwendungen mit umfangreichem Kontext zu versehen. Informieren Sie sich über die besonderen Auswirkungen von RAG auf die Sicherheit.

KI-Chatbots und -Agenten

Chatbots sind eine beliebte LLM-Anwendung und es gibt immer mehr autonome Agenten, die Handlungen im Namen von Usern ausführen. Erfahren Sie mehr über die damit verbundenen Sicherheitsrisiken.