基于安全组件构建 AI 应用与各类智能体

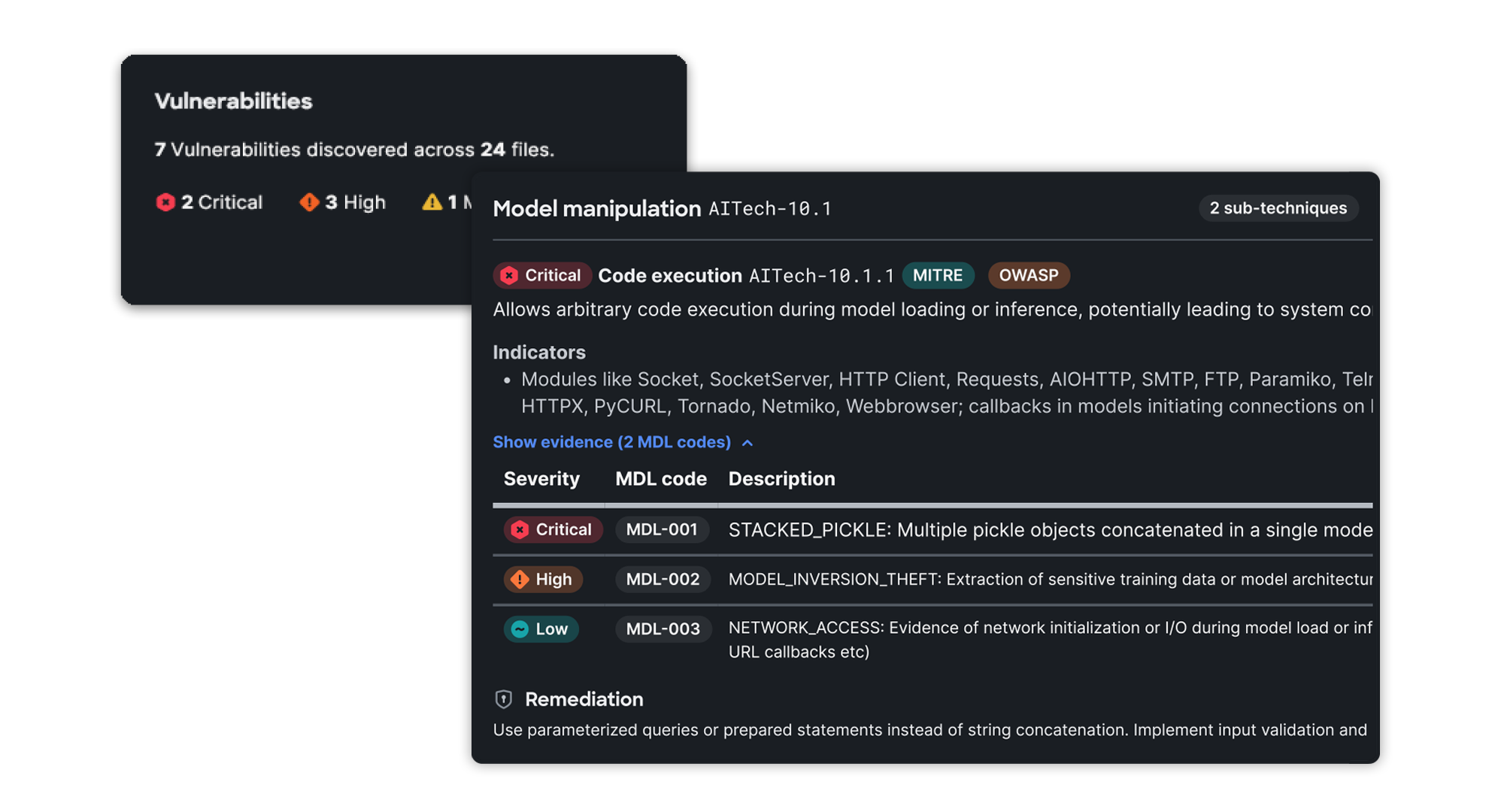

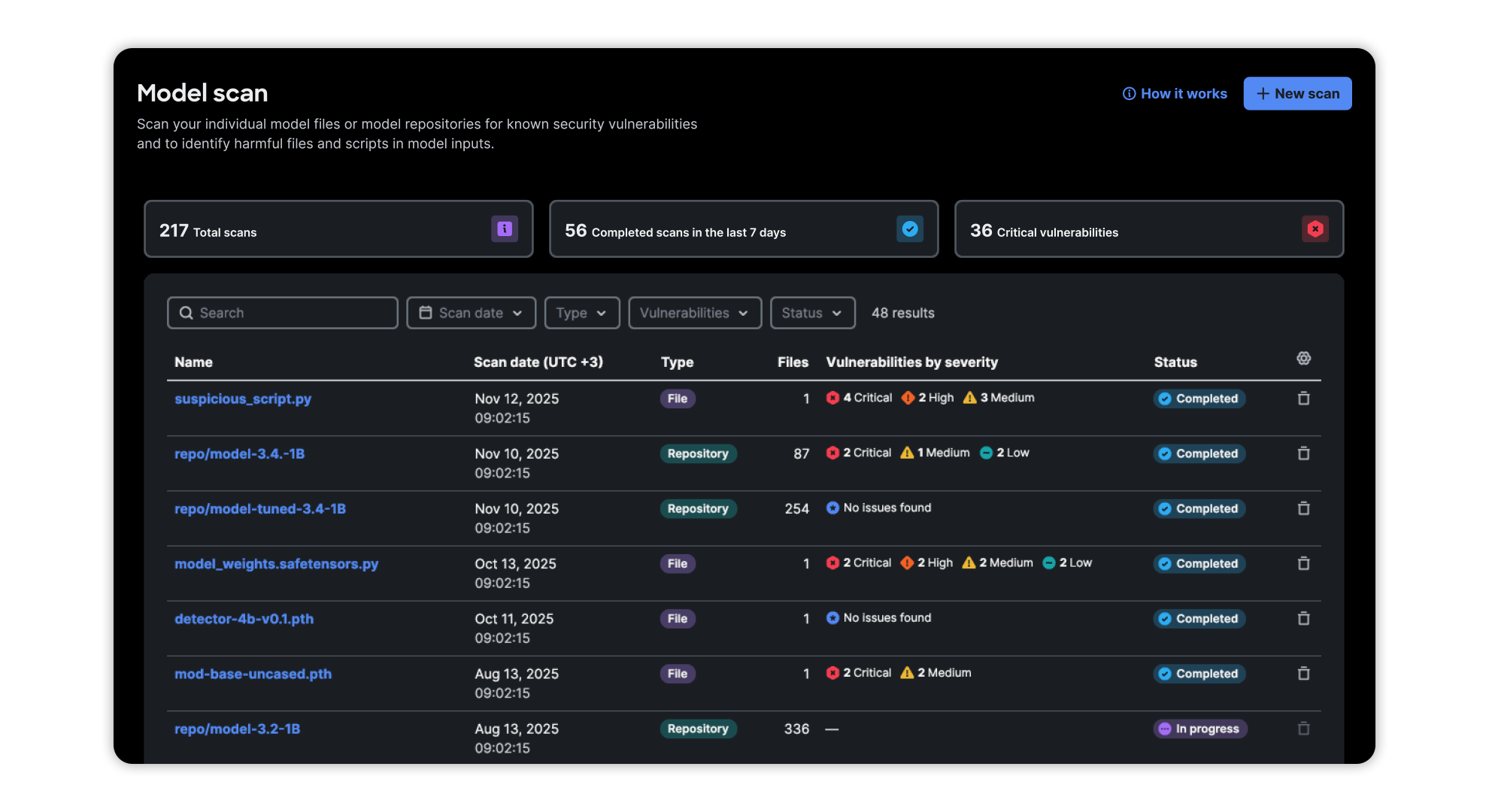

第三方组件前所未有地降低了 AI 开发门槛,但也带来了风险。AI Defense 会自动扫描这些组件,以发现潜在威胁、主动通知开发者,并确保您的 AI 应用构建于可信赖的基础之上。

为 AI 创新奠定安全基础

AI 安全分类

深入了解生成式 AI 所面临的威胁形势,掌握相关定义、缓解措施和标准分类。

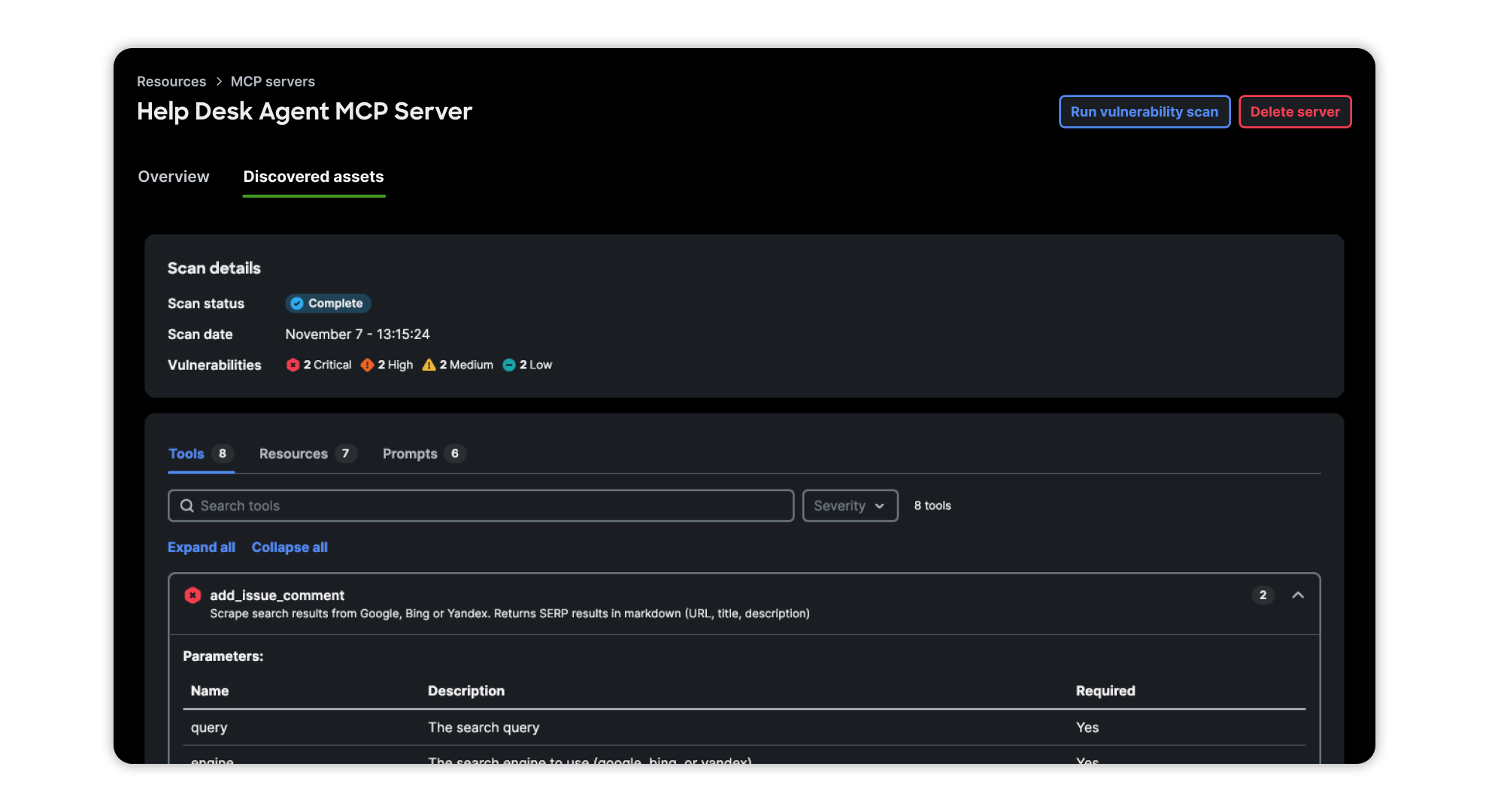

思科开源 MCP 扫描工具

深入了解我们专为主动发现 MCP 服务器漏洞而构建的开源工具。

全面保障智能体和 AI 供应链的安全

深入了解 Cisco AI Defense 如何全面保护第三方 AI 资产和智能体系统。

思科智能体间交互 (A2A) 安全扫描工具

深入了解这个开源安全框架如何全面保护智能体网络。