WAAS - Analyse der WAAS-Architektur und des Datenverkehrsflusses

Kapitel: Analyse der WAAS-Architektur und des Datenverkehrsflusses

In diesem Artikel wird die WAAS-Architektur und die Art und Weise beschrieben, wie Daten in ein WAAS-Gerät fließen, dort verarbeitet werden und daraus abgeleitet werden. Sie bietet ein grundlegendes Verständnis dieser Konzepte, um Ihnen bei der Fehlerbehebung für das WAAS-System zu helfen.

Hauptartikel

Analyse der WAAS-Architektur und des Datenverkehrsflusses

Vorläufige WAAS-Fehlerbehebung

Optimierung der Fehlerbehebung

Problembehebung Anwendungsbeschleunigung

Fehlerbehebung CIFS AO

Fehlerbehebung für HTTP AO

Fehlerbehebung für EPM AO

Fehlerbehebung bei MAPI AO

Fehlerbehebung: NFS AO

Fehlerbehebung bei SSL AO

Fehlerbehebung bei Video-Audio

Fehlerbehebung bei generischem AO

Fehlerbehebung bei Überlastungsbedingungen

Fehlerbehebung WCCP

Fehlerbehebung AppNav

Fehlerbehebung bei Festplatten- und Hardwareproblemen

Fehlerbehebung bei seriellen Inline-Clustern

vWAAS-Fehlerbehebung

Fehlerbehebung: WAAS Express

Fehlerbehebung NAM-Integration

Inhalt

Grundlagen der WAAS-Architektur

Ein grundlegendes Verständnis der WAAS-Architektur (Wide Area Applications Services) und des Datenflusses kann die Fehlerbehebung für das WAAS-System vereinfachen. In diesem Abschnitt werden die wichtigsten Funktionsbereiche des WAAS-Systems und ihre Zusammenarbeit beschrieben.

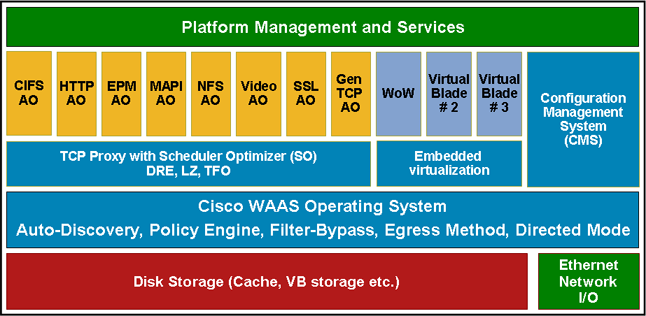

Die WAAS-Systemarchitektur ist in eine Reihe von Funktionsbereichen oder Diensten unterteilt, wie in Abbildung 1 gezeigt.

- Abbildung 1: WAAS-Architektur

AOs

AOs (Application Optimizers, auch als Application Accelerators bezeichnet) sind anwendungsspezifische Software, die bestimmte Protokolle auf Layer 7 optimiert (über die allgemeinen Layer-4-Optimierungen hinaus). AOs können im WAE-System als "Anwendungen" angesehen werden (in einer BS-Analogie). Die generische AO fungiert als "catch all" für den gesamten Datenverkehr, der über keine protokollspezifische AO verfügt, und fungiert auch als Delegat, wenn eine protokollspezifische AO beschließt, keine Optimierung anzuwenden.

WoW und virtuelle Blades

Windows-Server auf WAAS (WoW) ist Microsoft Windows Server, der in einem virtuellen Blade ausgeführt wird. Mit der Virtualisierungsfunktion von WAAS können Sie einen oder mehrere virtuelle Blades konfigurieren. Dabei handelt es sich um Computer-Emulatoren, die sich auf einem WAE- oder WAVE-Gerät befinden. Mit einem virtuellen Blade können Sie WAE-Systemressourcen für die Verwendung durch zusätzliche Betriebssysteme zuweisen, die Sie auf der WAE-Hardware installieren. Sie können Anwendungen von Drittanbietern in der isolierten Umgebung hosten, die von einem virtuellen Blade bereitgestellt wird. Sie können beispielsweise einen virtuellen Blade in einem WAE-Gerät konfigurieren, um Windows-Drucken und Dienste für die Domänensuche auszuführen.

Konfigurationsmanagementsystem

Das Konfigurationsmanagementsystem (CMS) besteht aus dem WAAS Central Manager und seiner Datenbank zum Speichern von Konfigurationsinformationen für WAAS-Geräte. Mit dem CMS können Sie WAE-Geräte und Gerätegruppen über eine zentrale Benutzeroberfläche für den zentralen Manager konfigurieren und verwalten.

DRE mit Scheduler

Die DRE mit Scheduler (SO-DRE) ist das Schlüsselmodul im Layer-4-Optimierungsbereich und ist für alle Datenreduktionstechniken im System verantwortlich, einschließlich Data Redundancy Elimination (DRE) und persistente LZ-Komprimierung. Neben den hier implementierten systemweiten Algorithmen zur Datenreduzierung enthält diese Komponente auch ein Planungselement, mit dem das System die Reihenfolge und Geschwindigkeit der Verwendung von DRE für verschiedene AOs besser steuern kann.

Speicher

Das Speichersystem verwaltet die Systemfestplatten und die logischen RAID-Volumes auf Systemen mit mehreren Festplatten. Festplattenspeicher wird für Systemsoftware, den DRE-Cache, den CIFS-Cache und virtuelle Blade-Storage verwendet.

Netzwerk-E/A

Die Netzwerkeingabe/-ausgabe-Komponente ist für alle Aspekte verantwortlich, die mit der Verarbeitung der Datenkommunikation von bzw. an einer WAE zusammenhängen, einschließlich der Kommunikation zwischen WAE und WAE und zwischen Client und Server.

Abfangen und Flow-Management

Die Abfangen- und Datenflussverwaltung besteht aus mehreren Untermodulen, die mithilfe der vom Benutzer konfigurierten Richtlinien Datenverkehr abfangen, Peers automatisch erkennen und die Optimierung über eine TCP-Verbindung starten. Einige der wichtigsten Untermodule sind Auto-Discovery, Policy Engine und Filter Bypass.

Automatische Erkennung

Durch die automatische Erkennung können Peer-Geräte einander dynamisch erkennen, ohne dass zuvor WAE-Paare konfiguriert werden müssen. Die automatische Erkennung ist ein End-to-End-Mechanismus mit mehreren WAEs, der ein Protokoll zwischen den WAEs definiert, das ein Paar Peer-WAEs für eine bestimmte Verbindung erkennt.

WAE-Geräte erkennen sich automatisch beim TCP-Handshake, der auftritt, wenn zwei Knoten eine TCP-Verbindung herstellen. Diese Erkennung wird durch Hinzufügen einer geringen Datenmenge zum Feld TCP-Optionen (0x21) in der SYN-, SYN/ACK- und ACK-Nachricht erreicht. Mit dieser TCP-Option können WAE-Geräte ermitteln, welche WAE sich am anderen Ende der Verbindung befindet, und beide können beschreiben, welche Optimierungsrichtlinien sie für den Datenfluss verwenden möchten. Wenn zwischengeschaltete WAEs im Netzwerkpfad vorhanden sind, durchlaufen sie einfach Datenflüsse, die von anderen WAEs optimiert werden. Am Ende des automatischen Erkennungsvorgangs verschieben die WAEs die Sequenznummern in den TCP-Paketen zwischen den beteiligten WAEs, indem sie diese auf mehr als 2 Milliarden erhöhen, um das optimierte Segment der Verbindung zu kennzeichnen.

Policy-Engine

Das Policy Engine-Modul bestimmt, ob der Datenverkehr optimiert werden muss, auf welche AO er weitergeleitet werden soll, und ggf. den Grad der Datenreduzierung (Data Reduction, DRE), der auf dieses Modul angewendet werden sollte. Die Policy Engine klassifiziert den Datenverkehr über die Verbindungsherstellung hinaus (z. B. anhand von Payload-Informationen) und ändert den Verbindungsfluss dynamisch von nicht optimierten hin zu optimierten Verbindungen.

Zu den Elementen einer Richtlinie gehören:

- Anwendungsdefinition: Eine logische Gruppierung von Datenverkehr, um Statistiken über die Art des Datenverkehrs zu erstellen.

- Verkehrsklassifizierung: Zugriffskontrollliste (ACL) zur Auswahl von Verbindungen basierend auf IP-Adressen, Ports usw.

- Richtlinienübersicht: Bindet die Anwendung und den Klassifizierer mit einer Aktion, die ggf. den Optimierungstyp angibt, der angewendet werden soll. Es gibt zwei Arten von Richtlinienzuordnungen:

- Statische Richtlinienzuweisung: Auf dem Gerät über die CLI oder die GUI konfiguriert (oder standardmäßig installiert) und beständig, sofern sie nicht entfernt wird.

- Dynamische Richtlinienzuweisung: Automatische Konfiguration durch die WAE und eine Lebensdauer, die gerade lang genug ist, um eine neue Verbindung zu akzeptieren.

Das folgende Konfigurationsbeispiel zeigt eine Policy Engine Application Definition (Web), die einen Klassifizierer (HTTP) und eine Aktion (vollständige Beschleunigung optimieren http:) enthält:

wae(config)# policy-engine application map basic wae(config-app-bsc)# name Web classifier HTTP action optimize full accelerate http set-dscp copy

Umgehung filtern

Nach dem Abfangen fungiert das Filter-Bypass-Modul als Vermittler zwischen der Policy Engine und der automatischen Erkennung. Das Filter-Bypass-Modul verfolgt alle optimierten Verbindungen in einer Filtertabelle für die gesamte Lebensdauer der Verbindung. Darüber hinaus verfolgt sie Passthrough-Verbindungen, aber die Einträge in der Übergabetabelle werden nach 3 Sekunden nach Ablauf der Zeitüberschreitung angezeigt.

WAAS-Datenverkehrsfluss

In diesem Abschnitt wird der Paketfluss in WAAS beschrieben.

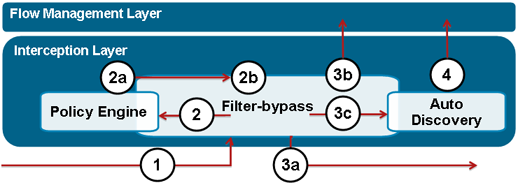

Abbildung 2 zeigt die Flow-Einrichtung für den Filter-Bypass, wenn ein Paket in das System eintritt.

- Abbildung 2: Flow-Einrichtung durch Filter umgehen

1. Ein SYN-Paket auf einem Fluss tritt in das System ein. Dieses Paket wird an das Filter-Bypass-Modul weitergeleitet.

2. Das Filter-Bypass-Modul berät das Policy-Engine hinsichtlich der Behandlung des Datenflusses.

2a) Die Policy Engine ruft die konfigurierten und dynamisch hinzugefügten Richtlinien ab und entscheidet anhand des aktuellen Betriebsstatus der AOs und SO-DRE, was die WAE für diesen Datenfluss tun kann: passieren, lokal terminieren oder optimieren.

2b) Das Paket und die Entscheidung der Policy Engine werden dann an das Filter-Bypass-Modul zurückgegeben.

3. Das Filter-Bypass-Modul wirkt bei der Richtlinienmodulentscheidung auf eine der folgenden Arten aus:

3a) Sendet das Paket sofort aus (durchlaufen).

3b) Sendet das Paket zur lokalen Terminierung durch eine AO nach oben.

3c) Sendet das Paket zur Optimierung an das Auto-Discovery-Modul.

Wenn das Filter-Bypass-Modul Option 3c auswählt, wird das Paket an das Auto-Discovery-Modul gesendet. Das Modul für die automatische Erkennung bestimmt, welche Optimierungen durchgeführt werden können, basierend auf der Verfügbarkeit einer Peer-WAE und den aktivierten Funktionen. Eine Peer-WAE wird durch die Verwendung von TCP-Optionen erkannt, die während des TCP-Handshake zum Remote-Knoten hinzugefügt werden. Wenn das Modul für die automatische Erkennung feststellt, dass eine Peer-WAE verfügbar ist, wird die Verbindung zur weiteren Verarbeitung weitergeleitet, sobald der Drei-Wege-TCP-Handshake abgeschlossen ist. Wenn zum ersten Mal eine Peer-WAE erkannt wird, handeln die WAEs zusätzlich AO-Versionen und -Funktionen aus. Diese Informationen werden verwendet, um die AO-Level-Funktionen für die Verbindung festzulegen.

4. Die Verbindung wird schließlich mit spezifischen L4- und L7-Optimierungen in das System aufgenommen und an die entsprechenden L4- (DRE) und L7 (AO)-Beschleunigungsmodule übergeben. Bei Verbindungen, die später durch protokollspezifische AOs (HTTP, MAPI usw.) nicht optimiert werden können, wird die Verbindung vom generischen AO mit oder ohne DRE-Optimierung (wie bei der Verbindungseinrichtung ausgehandelt) behandelt.

Cisco kontaktieren

- Eine Supportanfrage öffnen

- (Erfordert einen Cisco Servicevertrag)

Feedback

Feedback