Introdução

Este documento descreve as opções de ajuste para os adaptadores de VNIC no modo gerenciado de interceptação (IMM - Intersight Managed Mode) através dos perfis de servidor.

Pré-requisitos

Configurações recomendadas pelo fornecedor do sistema operacional para adaptadores ethernet.

As políticas operacionais de computação, armazenamento e gerenciamento devem ser configuradas com antecedência.

Requisitos

A Cisco recomenda que você tenha conhecimento destes tópicos:

- Modo Gerenciado de Intervisão

- Conectividade de rede física

- Configurações do adaptador Ethernet recomendadas pelo SO

- Elementos de ajuste de VNIC

Componentes Utilizados

As informações neste documento são baseadas nestas versões de software e hardware:

- Firmware UCS-B200-M5 4.2(1a)

- Interconexão em malha Cisco UCS 6454, firmware 4.2(1e)

- Software como serviço (SaaS) da Intersight

As informações neste documento foram criadas a partir de dispositivos em um ambiente de laboratório específico. Todos os dispositivos utilizados neste documento foram iniciados com uma configuração (padrão) inicial. Se a rede estiver ativa, certifique-se de que você entenda o impacto potencial de qualquer comando.

Configurar

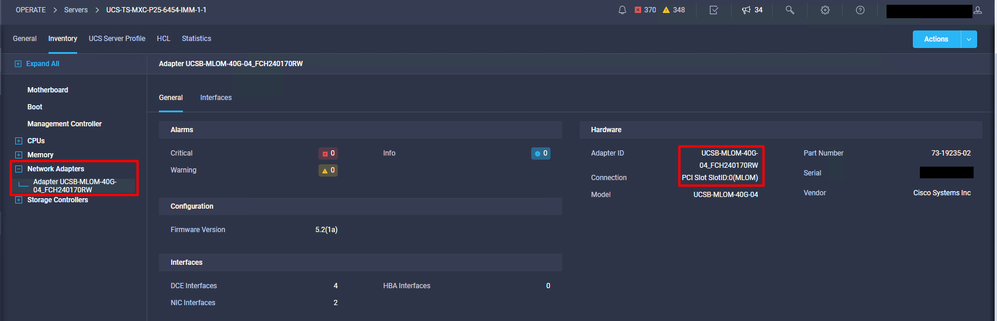

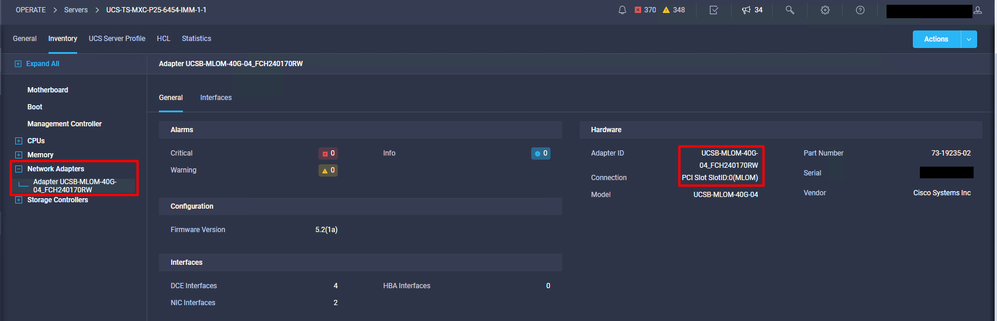

Etapa 1. Identificar o adaptador VIC e a ID do slot no servidor

Navegue até a guia Servers > Inventory > selecione a opção Network Adapters.

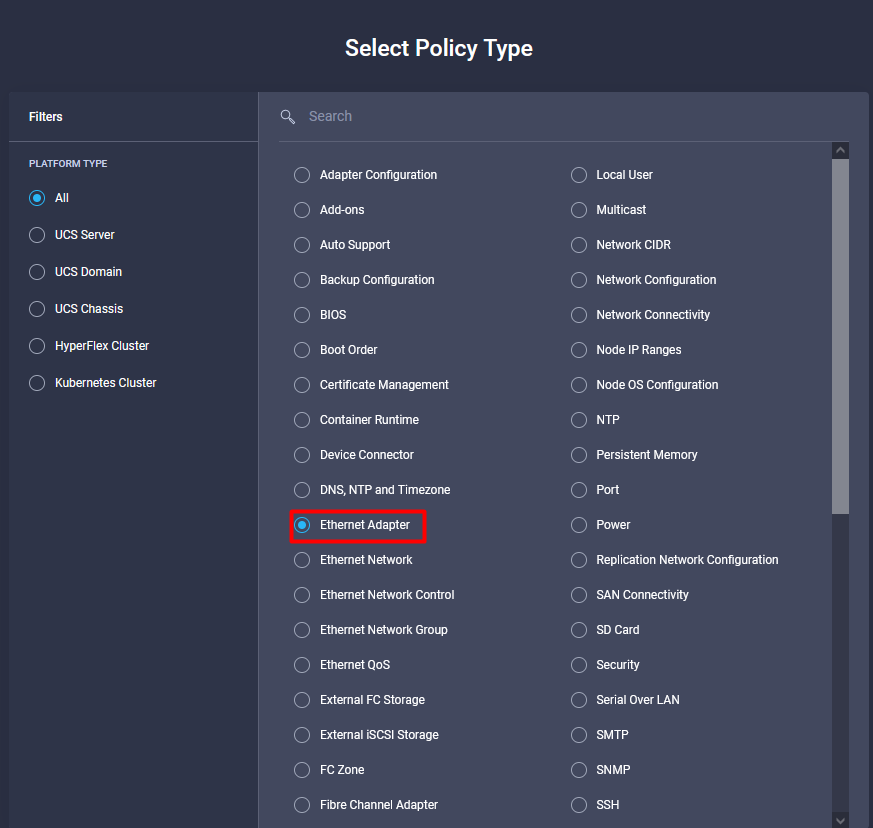

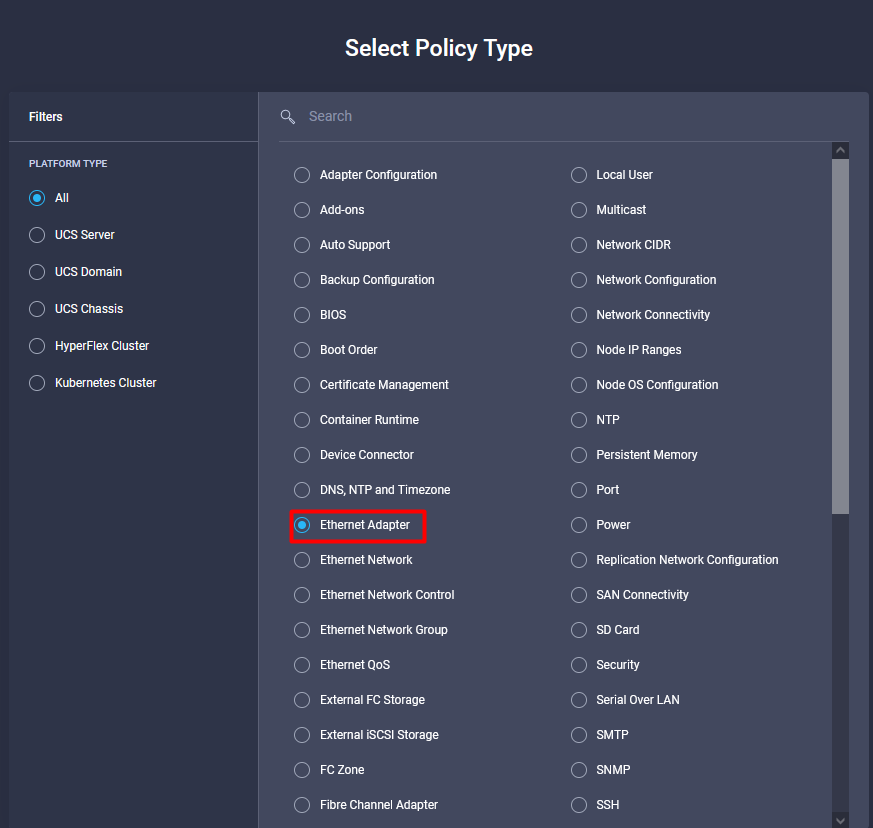

Etapa 2. Criar política do Adaptador Ethernet

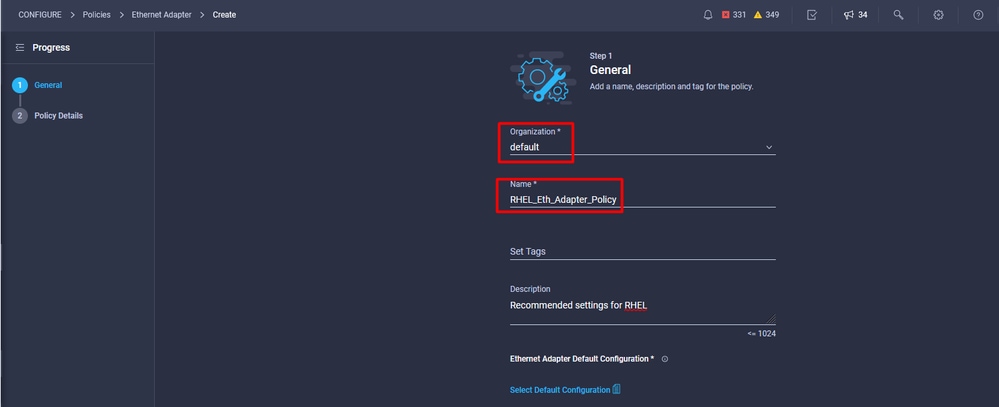

Crie a política do Adaptador Ethernet com os valores sugeridos pelo Fornecedor do SO.

Navegue até a guia Policies > Create Policy > Select Ethernet Adapter.

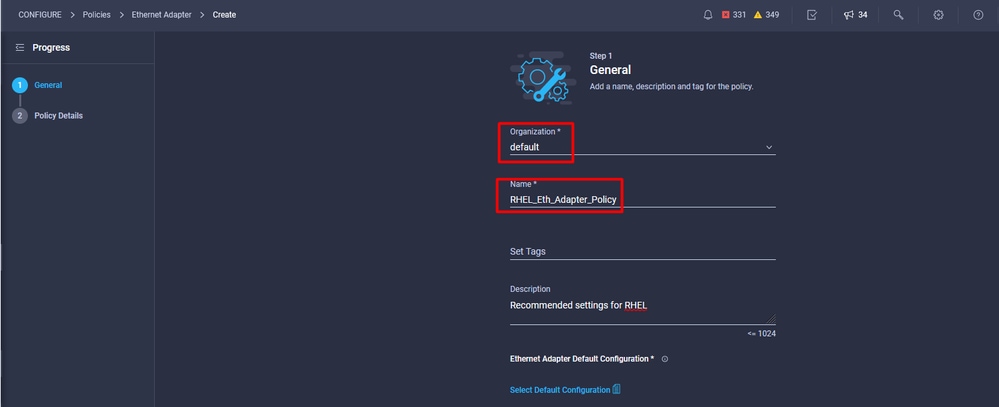

No menu Create Policy, selecione a Organization e forneça o Policy Name.

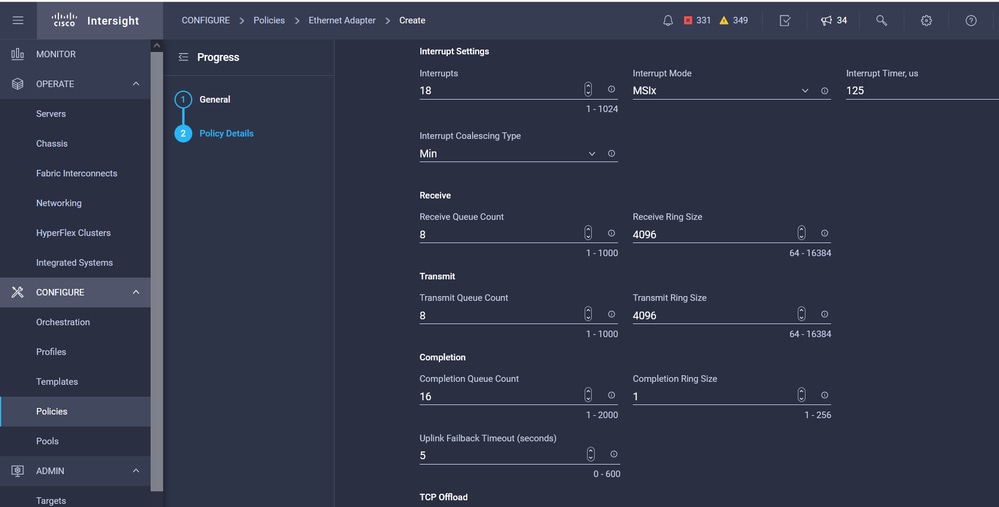

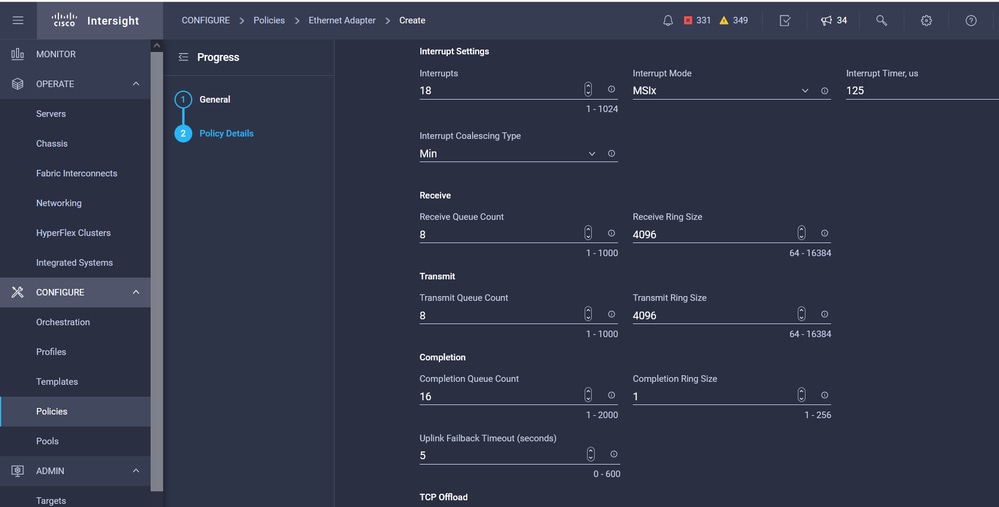

Etapa 3. Definir as configurações sugeridas pelo fornecedor do sistema operacional. Geralmente, os recursos listados são configurados na Política de adaptador Ethernet:

- Filas de recebimento

- Filas de transmissão

- Tamanho do toque

- Filas de Conclusão

- Interrupções

- Ativar Receive Side Scaling (RSS) ou Accelerated Receive Flow Steering (ARFS)

Note: RSS e ARFS são mutuamente exclusivos, portanto, configure apenas um. Não configure ambos.

Depois de criada, atribua a política do adaptador Ethernet a uma política de conectividade de LAN.

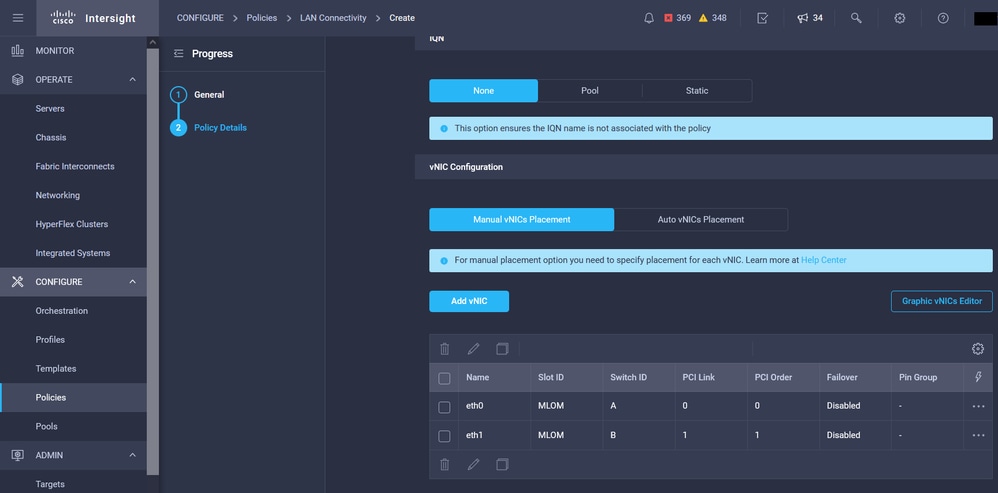

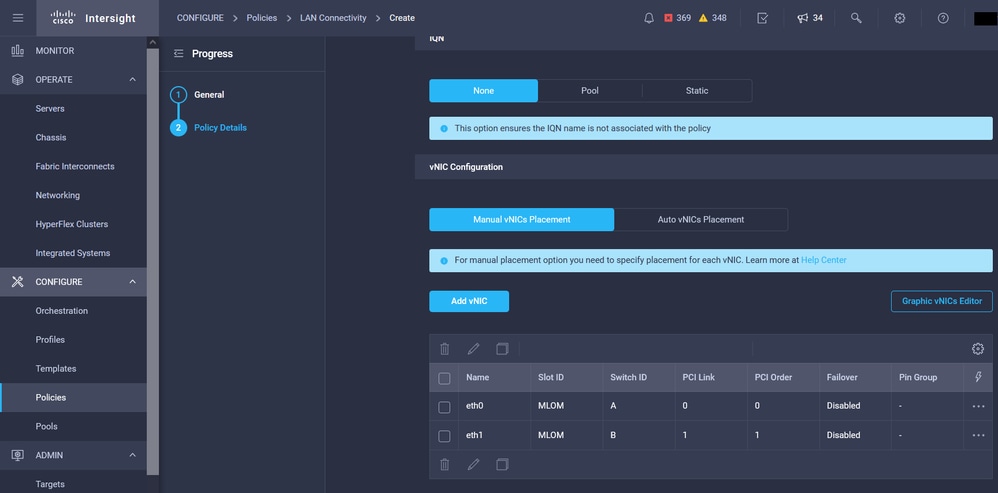

Etapa 4. Criar Política de Conectividade LAN

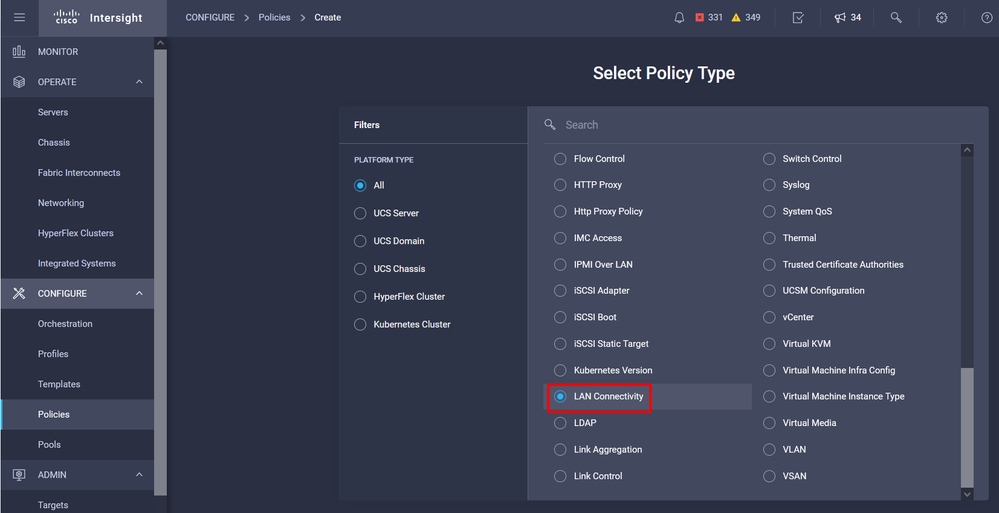

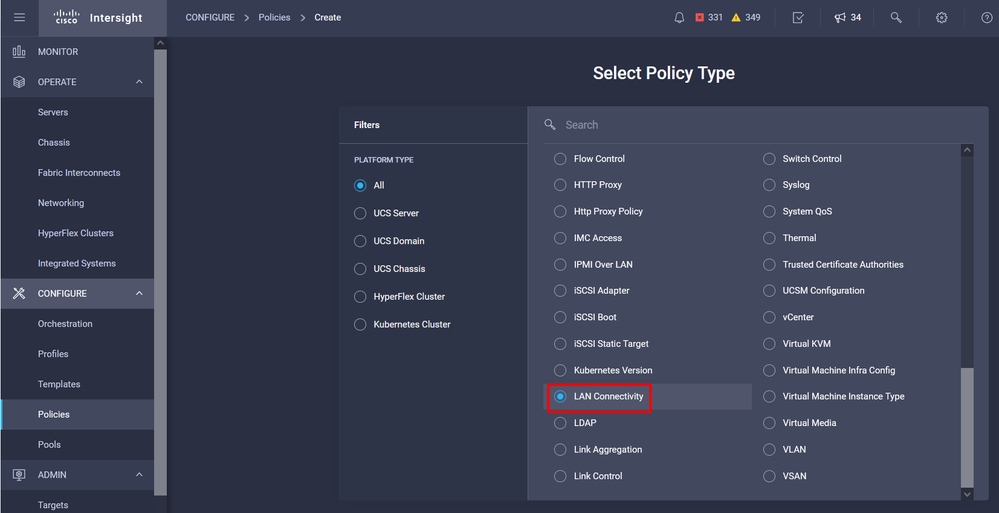

Navegue até a guia Policies > Create Policy > LAN Connectivity

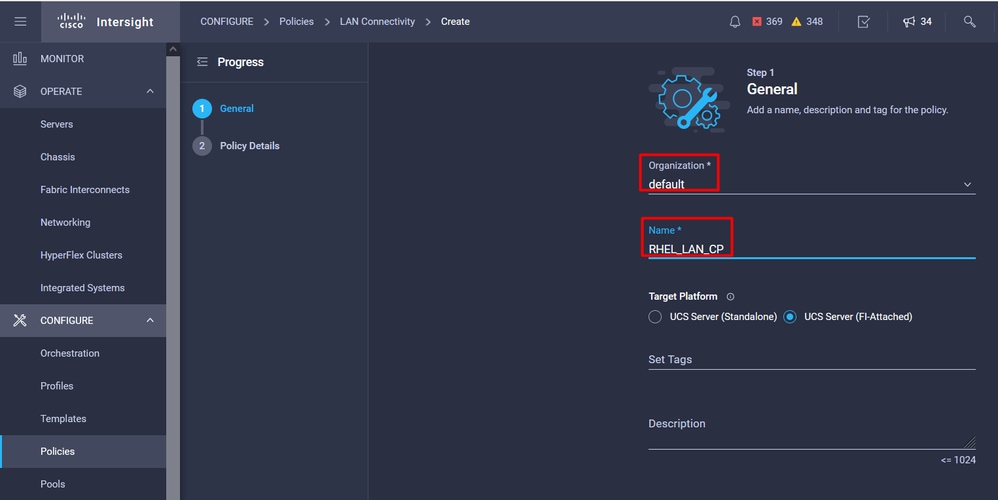

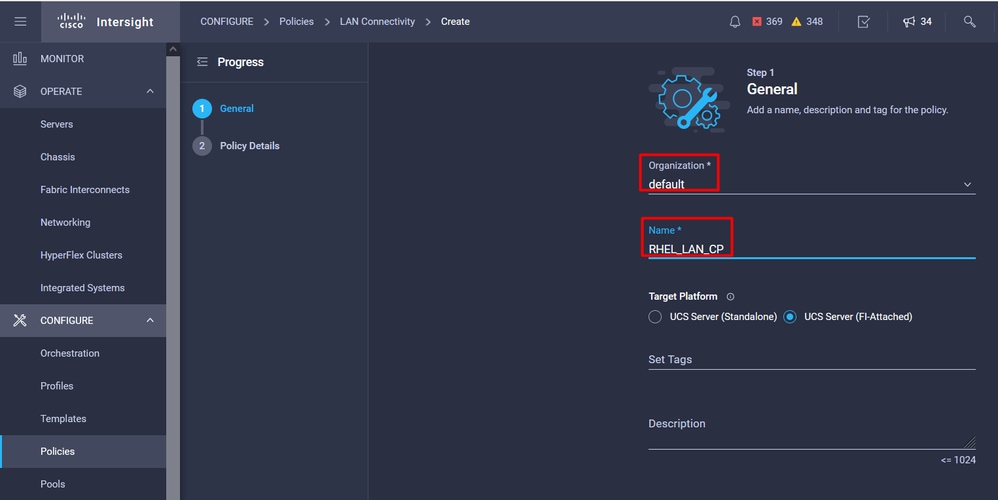

Selecione a Organização e forneça o Nome da política.

No destino, a plataforma seleciona UCS Server (FI-Attached).

Na política de Conectividade de LAN, navegue até a seção Configuração de vNIC e configure pelo menos duas interfaces de rede. Neste exemplo, as interfaces eth0 e eth1 são criadas.

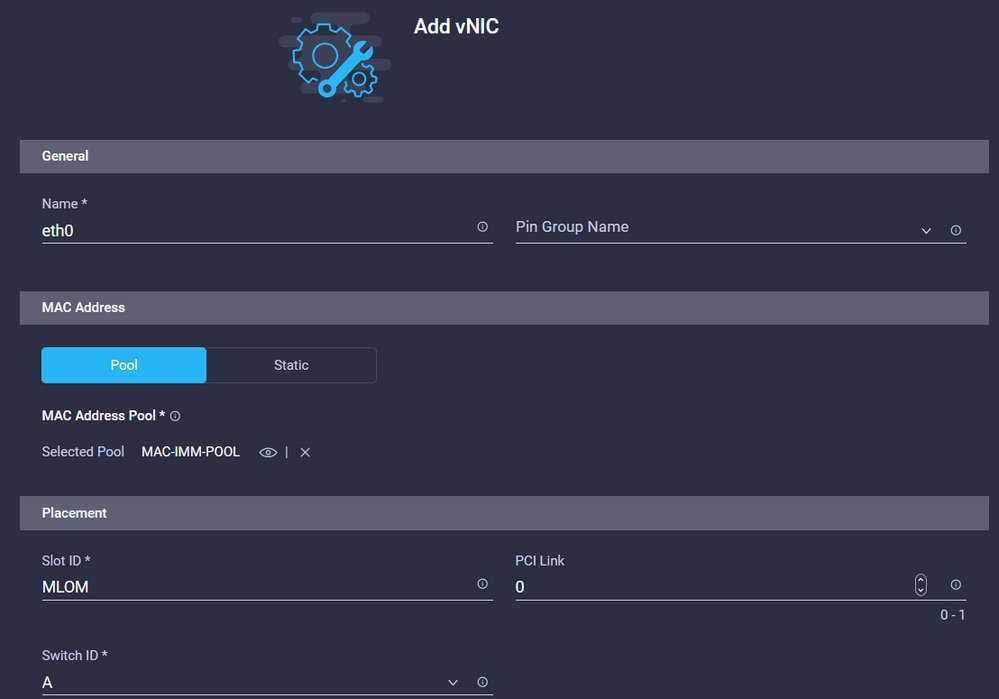

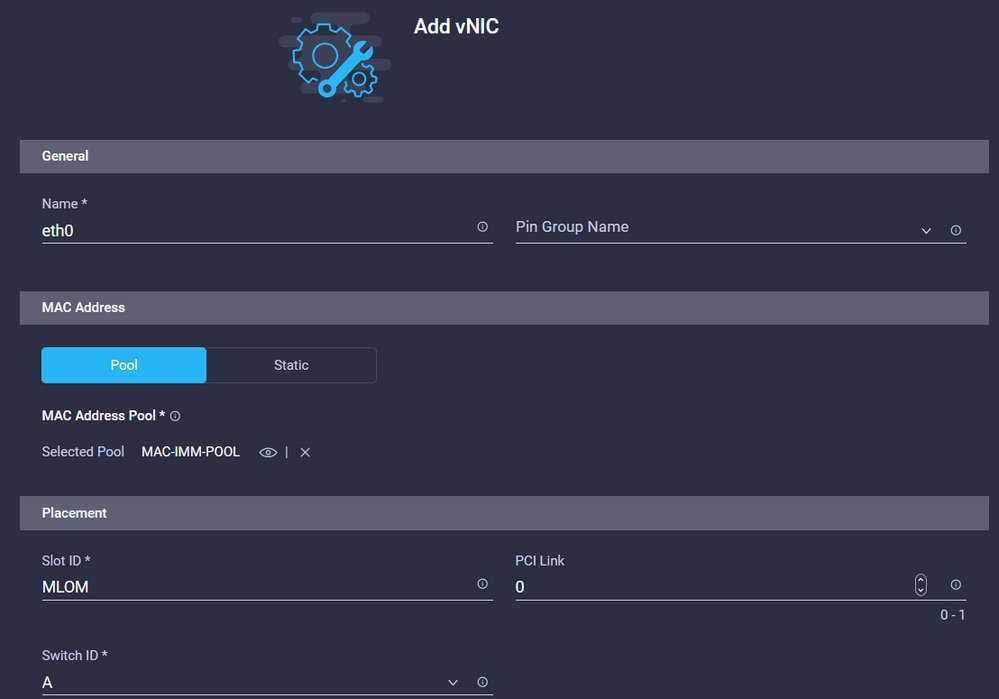

Na guia de configuração Add vNIC, em General, forneça o nome eth0.

Na seção MAC Address, selecione o MAC Address Pool apropriado.

Na seção Posicionamento, configure o ID do slot como MLOM.

Deixe as opções PCI Link e PCI Order com o valor 0 e Switch ID com a opção A.

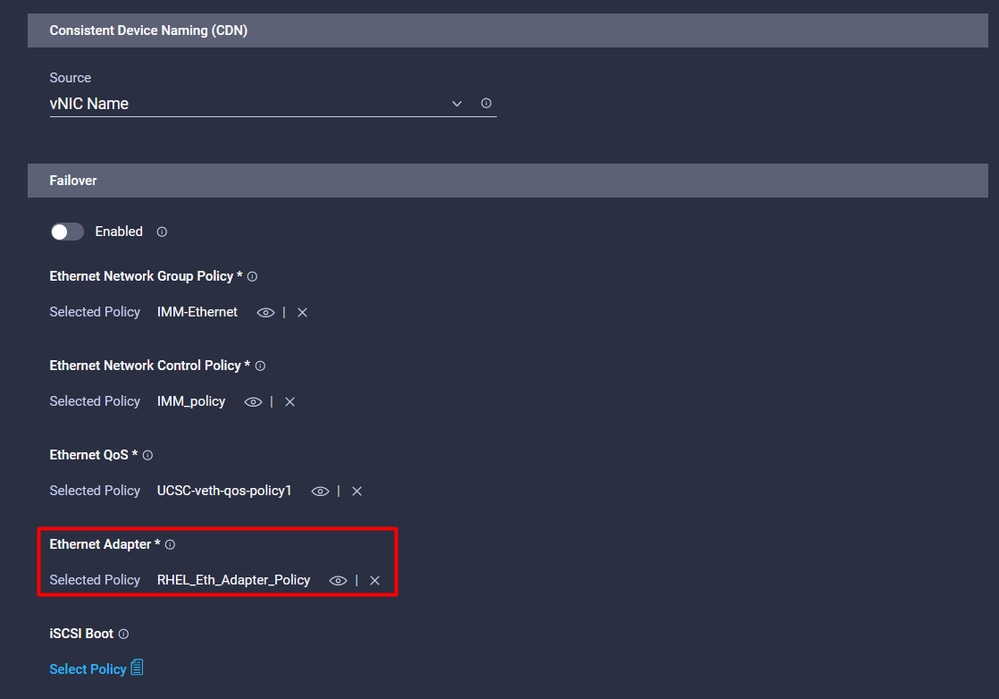

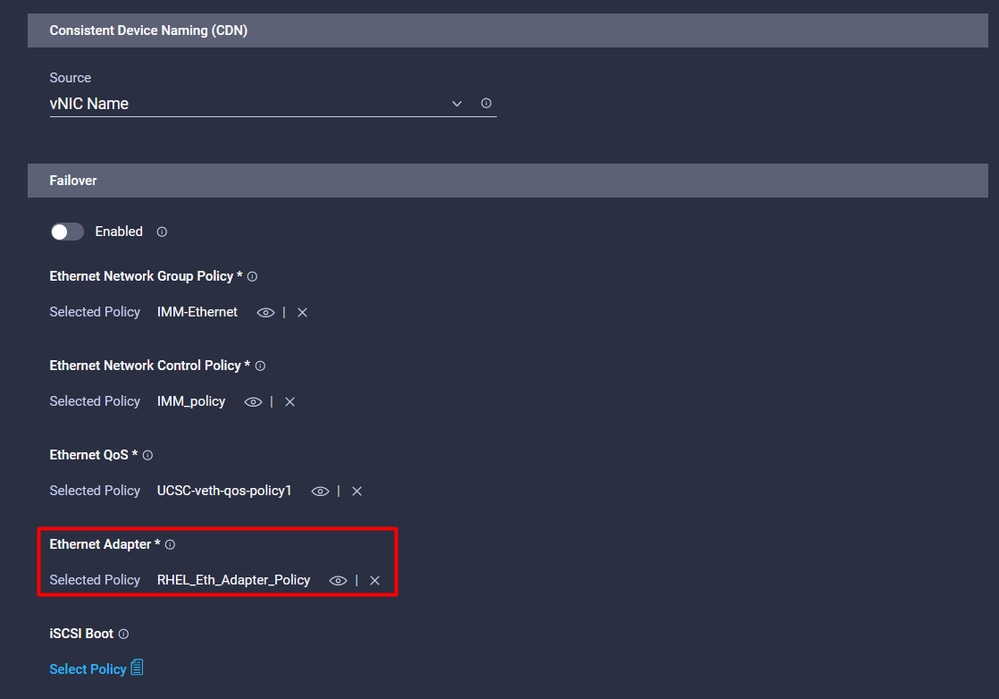

Navegue até o menu Nomenclatura de Dispositivo Consistente (CDN) e selecione Nome da VNIC.

Adicione as políticas Ethernet Network Group Policy, Ethernet Network Control Policy, Ethernet QoS e Ethernet Adapter.

Repita as mesmas etapas para criar a interface eth1, configure os valores PCI Link, PCI Order e Switch ID de acordo.

Por fim, crie a Política de Conectividade LAN. Depois de criado, atribua-o a um Perfil de servidor UCS.

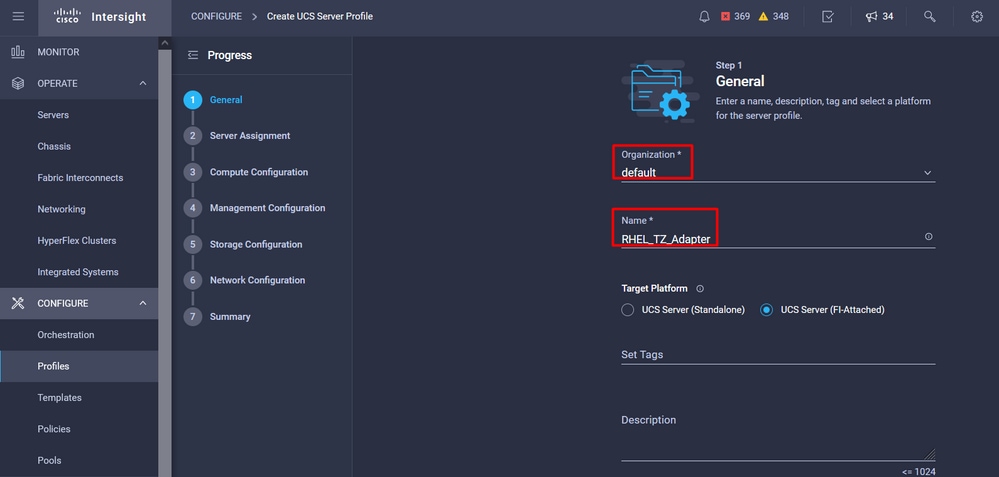

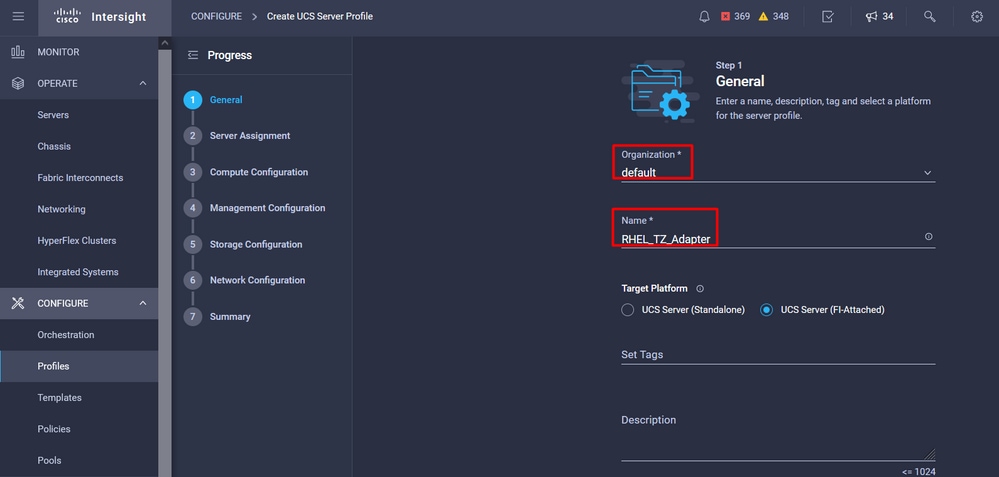

Etapa 5. Crie um perfil de servidor.

Navegue até a guia Profiles e selecione Create UCS Server Profile.

Forneça os detalhes de Organização e Nome.

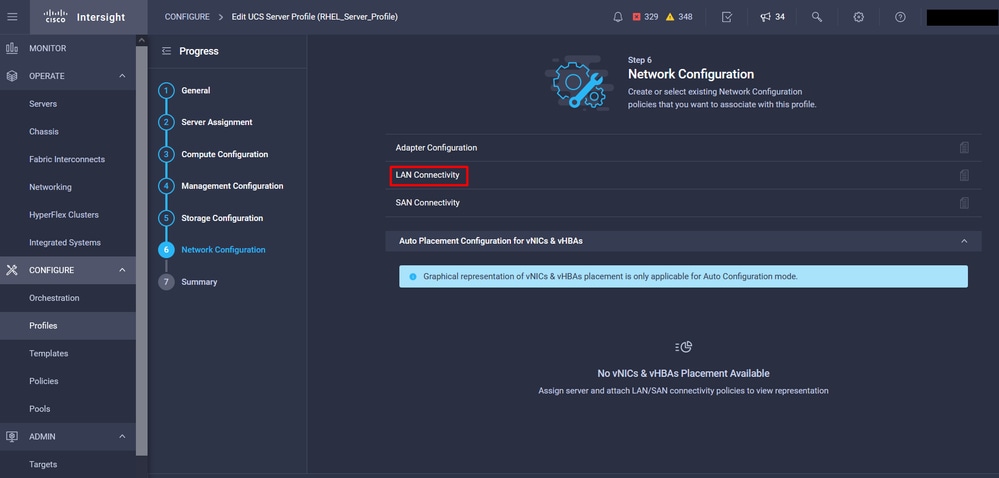

Selecione todas as configurações relacionadas, como as configurações de Computação, Gerenciamento e Armazenamento.

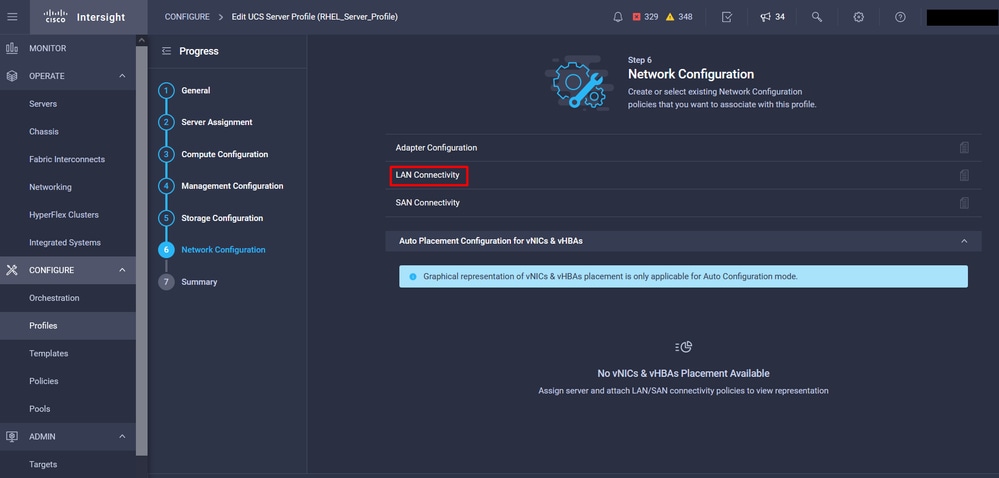

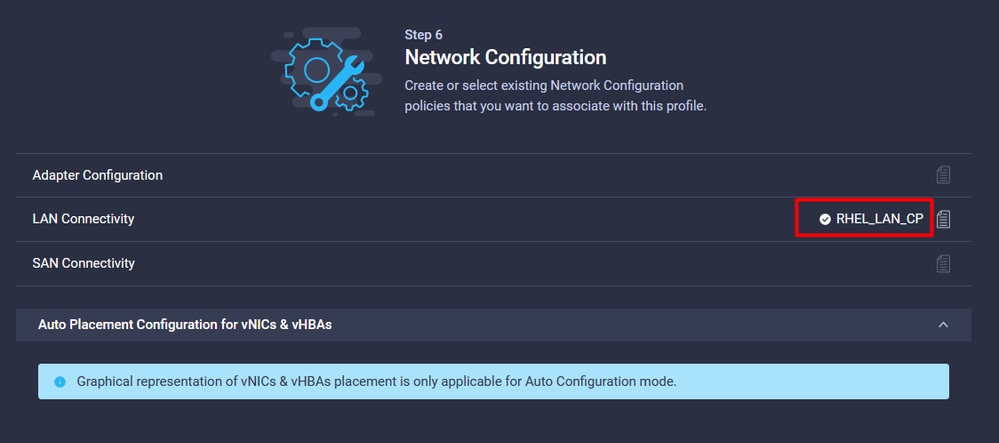

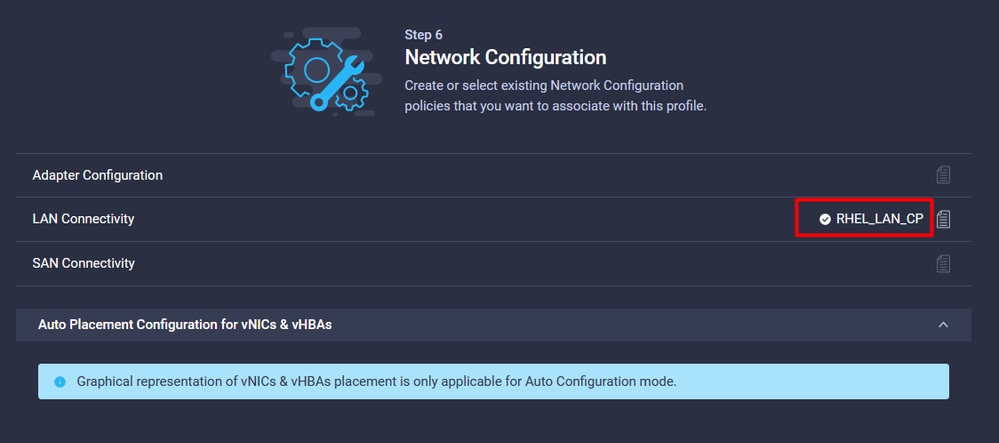

Em Configuração de rede, selecione a política de conectividade de LAN apropriada.

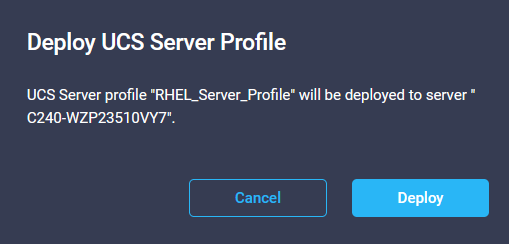

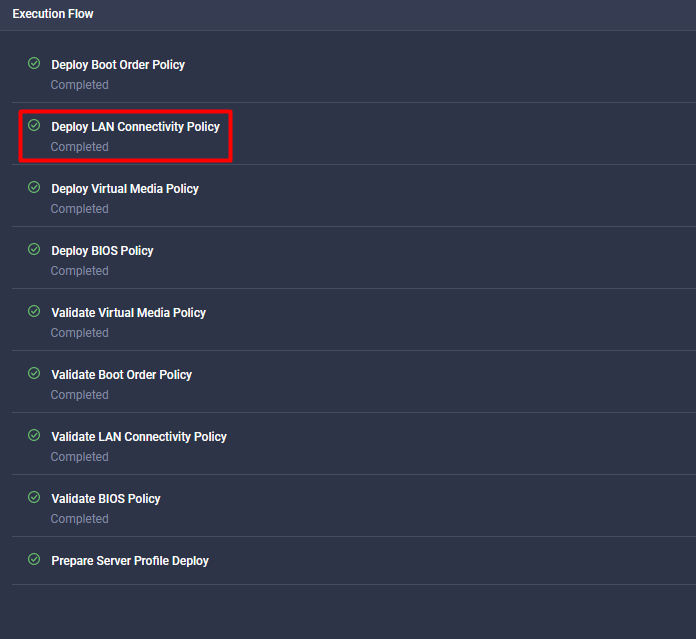

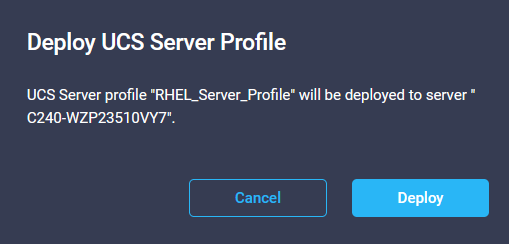

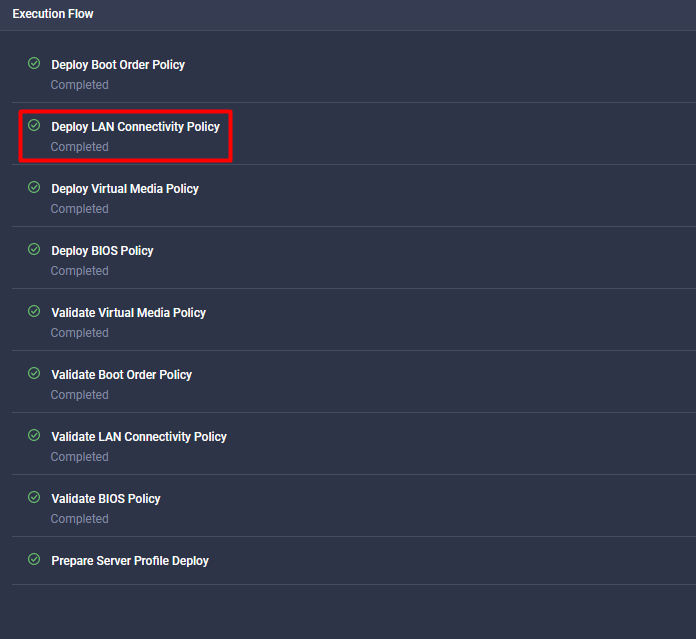

Selecione Deploy para configurar o Server Profile e validar se todas as etapas foram concluídas com êxito.

Verificar

Use esta seção para confirmar se a sua configuração funciona corretamente.

Note: Esses valores foram configurados como exemplo. Os valores reais podem variar de acordo com o modelo do adaptador e a versão do SO.

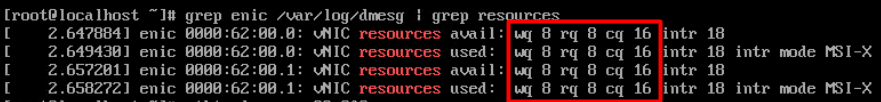

Valide as configurações do adaptador no RHEL.

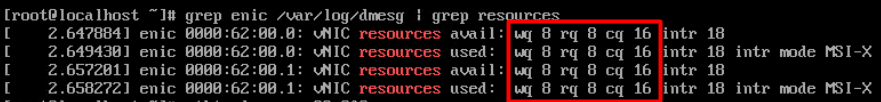

Para verificar os recursos disponíveis atualmente fornecidos pelo adaptador VIC, valide as filas de transmissão e recepção no arquivo dmesg:

$ grep enic /var/log/dmesg | grep resources

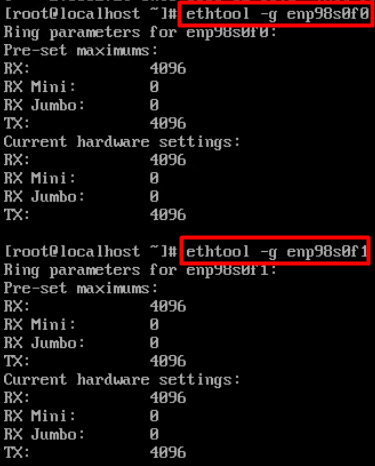

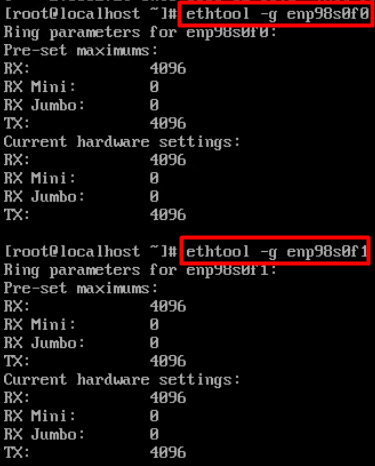

Valide o tamanho do toque configurado.

ethtool -g interface_name

Valide as configurações do adaptador no VMware ESXi.

Para verificar os recursos disponíveis no momento fornecidos pelo adaptador VIC, valide as filas de transmissão e recepção com o comando abaixo, onde X é o número vmnic.

vsish -e get /net/pNics/vmnicX/txqueues/info

vsish -e get /net/pNics/vmnicX/rxqueues/info

Execute este comando para validar o tamanho do toque:

esxcli network nic ring current get -n vmnicX

Valide as configurações do adaptador diretamente no UCS.

Para validar as configurações, conecte-se a qualquer uma das interconexões em malha via SSH.

Conecte ao adaptador de servidor com o comando connect adapter x/y/z onde x é o número do gabinete, y é o número do slot e z é o número do adaptador.

Quando conectado ao adaptador, no login extra, digite dbgsh.

Execute o comando attach-mcp.

Em seguida, execute o comando vnicl para listar as vnics disponíveis.

Procure o nome da vnic correspondente eth0 e eth1 e valide as configurações:

UCS-IMM-A# connect adapter 1/1/1

Entering character mode

Escape character is '^]'.

(none) login: dbgsh

adapter (top):1#

adapter (top):4# attach-mcp

adapter (mcp):1# vnicl

adapter (mcp):19# vnicl

================================

vnicid : 18

name : eth0

type : enet

state : UP

adminst : UP

flags : OPEN, INIT, LINKUP, NOTIFY_INIT, ENABLE, USING_DEVCMD2

ucsm name : eth0

spec_flags : MULTIFUNC, TRUNK

mq_spec_flags :

slot : 0

h:bdf : 0:03:00.0

vs.mac : 00:25:b5:01:00:46

mac : 00:25:b5:01:00:46

vifid : 801

vifcookie : 801

uif : 0

portchannel_bypass : 0x0

cos : 0

vlan : 0

rate_limit : unlimited

cur_rate : unlimited

stby_vifid : 0

stby_vifcookie : 0

stby_recovery_delay : 0

channel : 0

stdby_channel : 0

profile :

stdby_profile :

init_errno : 0

cdn : eth0

devspec_flags : TSO, LRO, RXCSUM, TXCSUM, RSS, RSSHASH_IPV4, RSSHASH_TCPIPV4, RSSHASH_IPV6, RSSHASH_TCPIPV6

lif : 18

vmode : STATIC

encap mode : NONE

host wq : [11-18] (n=8)

host rq : [2010-2017] (n=8) (h=0x080107da)

host cq : [2002-2017] (n=16)

host intr : [3008-3025] (n=18)

notify : pa=0x10384de000/40 intr=17

devcmd2 wq : [19] (n=1)

================================

vnicid : 19

name : eth1

type : enet

state : UP

adminst : UP

flags : OPEN, INIT, LINKUP, NOTIFY_INIT, ENABLE, USING_DEVCMD2

ucsm name : eth1

spec_flags : MULTIFUNC, TRUNK

mq_spec_flags :

slot : 0

h:bdf : 0:03:00.1

vs.mac : 00:25:b5:01:00:45

mac : 00:25:b5:01:00:45

vifid : 800

vifcookie : 800

uif : 1

portchannel_bypass : 0x0

cos : 0

vlan : 0

rate_limit : unlimited

cur_rate : unlimited

stby_vifid : 0

stby_vifcookie : 0

stby_recovery_delay : 0

channel : 0

stdby_channel : 0

profile :

stdby_profile :

init_errno : 0

cdn : eth1

devspec_flags : TSO, LRO, RXCSUM, TXCSUM, RSS, RSSHASH_IPV4, RSSHASH_TCPIPV4, RSSHASH_IPV6, RSSHASH_TCPIPV6

lif : 19

vmode : STATIC

encap mode : NONE

host wq : [20-27] (n=8)

host rq : [2002-2009] (n=8) (h=0x080107d2)

host cq : [1986-2001] (n=16)

host intr : [2976-2993] (n=18)

notify : pa=0x1038e27000/40 intr=17

devcmd2 wq : [28] (n=1)

================================

Informações Relacionadas

Suporte Técnico e Documentação - Cisco Systems

Perfis de servidor na Intersight

Diretrizes de ajuste para placas de interface virtual Cisco UCS (White Paper)

Guia de ajuste de desempenho de rede do Red Hat Enterprise Linux

Ver "rx_no_bufs" cair com o driver genérico da Cisco (conta do Portal do cliente Red Hat necessária)

Feedback

Feedback